Pas besoin de changer le sens original, les robots sont une technologie qui peut avoir des possibilités illimitées, surtout lorsqu'elle est combinée avec une technologie intelligente. Récemment, certains modèles à grande échelle dotés d'applications révolutionnaires devraient devenir le centre intelligent des robots, aidant les robots à percevoir et à comprendre le monde, à prendre des décisions et à planifier

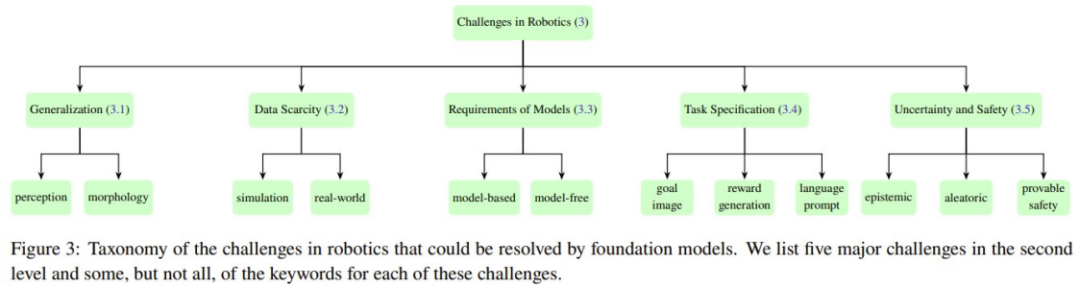

Récemment, dirigé par Yonatan Bisk de CMU et Fei Xia de Google DeepMind Une équipe conjointe a publié un rapport d'examen présentant l'application et le développement de modèles de base dans le domaine de la robotique. Le premier auteur du rapport est Yafei Hu, doctorant de quatrième année à la CMU dont les recherches portent sur l'intersection de la robotique et de l'intelligence artificielle. Quanting Xie collabore avec lui, qui se concentre sur l'exploration de l'intelligence incarnée à travers des modèles de base.

Adresse papier : https://arxiv.org/pdf/2312.08782.pdf

Développer des robots capables de s'adapter de manière autonome à différents environnements a toujours été un rêve de l'humanité, mais c'est un long et longue route Une route difficile. Auparavant, les systèmes de perception robotisés utilisant des méthodes traditionnelles d'apprentissage en profondeur nécessitaient généralement une grande quantité de données étiquetées pour former des modèles d'apprentissage supervisé, et le coût de l'étiquetage de grands ensembles de données via le crowdsourcing était très élevé.

De plus, en raison de la capacité de généralisation limitée des méthodes d'apprentissage supervisé classiques, afin de déployer ces modèles dans des scénarios ou des tâches spécifiques, ces modèles formés nécessitent généralement des techniques d'adaptation de domaine soigneusement conçues, qui à leur tour nécessitent souvent une collecte de données supplémentaire. et les étapes d'annotation. De même, les approches classiques de planification et de contrôle des robots nécessitent souvent une modélisation minutieuse du monde, de la propre dynamique de l'agent et/ou de la dynamique des autres agents. Ces modèles sont généralement construits pour chaque environnement ou tâche spécifique, et lorsque les conditions changent, le modèle doit être reconstruit. Cela montre que les performances de migration du modèle classique sont également limitées.

En fait, pour de nombreux cas d'utilisation, créer des modèles efficaces est soit trop coûteux, soit tout simplement impossible. Bien que les méthodes de planification et de contrôle de mouvement basées sur l'apprentissage profond (par renforcement) aident à atténuer ces problèmes, elles souffrent toujours d'un changement de distribution et d'une capacité de généralisation réduite.

Bien que le développement de systèmes robotiques à usage général présente de nombreux défis, les domaines du traitement du langage naturel (NLP) et de la vision par ordinateur (CV) ont récemment fait des progrès rapides, notamment les grands modèles de langage (LLM) pour la PNL, la diffusion utilisateur modèle pour la génération d'images haute fidélité, modèle visuel puissant et modèle de langage visuel pour les tâches CV telles que la génération de plans zéro/quelques plans.

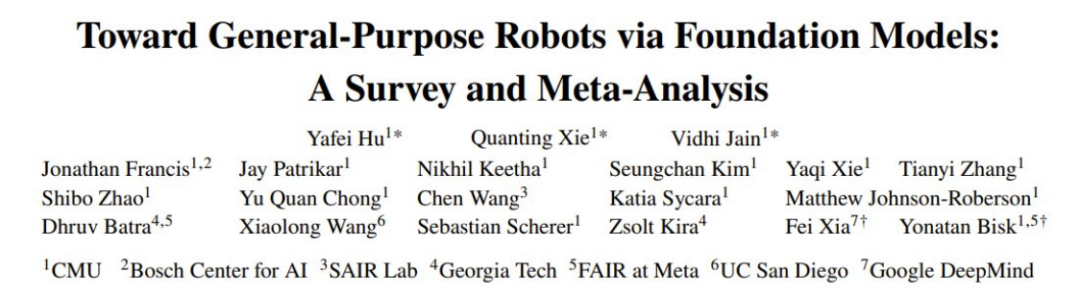

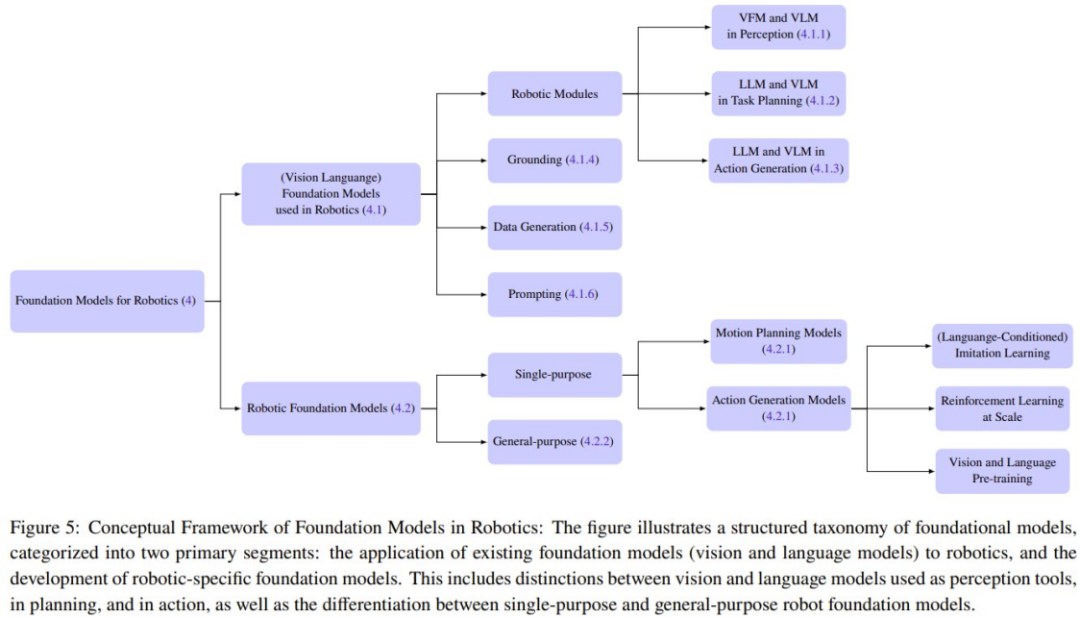

Le soi-disant « modèle de base » est en fait un grand modèle de pré-formation (LPTM). Ils ont de puissantes capacités visuelles et verbales. Récemment, ces modèles ont également été appliqués dans le domaine de la robotique et devraient donner aux systèmes robotiques une perception du monde ouvert, une planification des tâches et même des capacités de contrôle des mouvements. En plus d’utiliser des modèles de base de vision et/ou de langage existants dans le domaine de la robotique, certaines équipes de recherche développent également des modèles de base pour les tâches robotiques, comme des modèles d’action pour la manipulation ou des modèles de planification de mouvements pour la navigation. Ces modèles de robots de base démontrent de fortes capacités de généralisation et peuvent s’adapter à différentes tâches et même à des solutions spécifiques. Il existe également des chercheurs qui utilisent directement des modèles de base vision/langage pour les tâches robotiques, ce qui montre la possibilité d'intégrer différents modules robotiques dans un seul modèle unifié.

Bien que les modèles de base de vision et de langage aient des perspectives prometteuses dans le domaine de la robotique et que de nouveaux modèles de base de robots soient également en cours de développement, il existe encore de nombreux défis difficiles à résoudre dans le domaine de la robotique.

Du point de vue du déploiement réel, les modèles sont souvent non reproductibles, incapables de se généraliser à différentes formes de robots (généralisation multi-incarnations) ou difficiles de comprendre avec précision quels comportements dans l'environnement sont réalisables (ou acceptables). De plus, la plupart des études utilisent des architectures basées sur Transformer, en se concentrant sur la perception sémantique des objets et des scènes, la planification et le contrôle au niveau des tâches. D'autres parties du système robotique sont moins étudiées, comme les modèles de base pour la dynamique mondiale ou les modèles de base capables d'effectuer un raisonnement symbolique. Ceux-ci nécessitent des capacités de généralisation inter-domaines.

Enfin, nous avons également besoin de données réelles à plus grande échelle et de simulateurs haute fidélité prenant en charge diverses tâches robotiques.

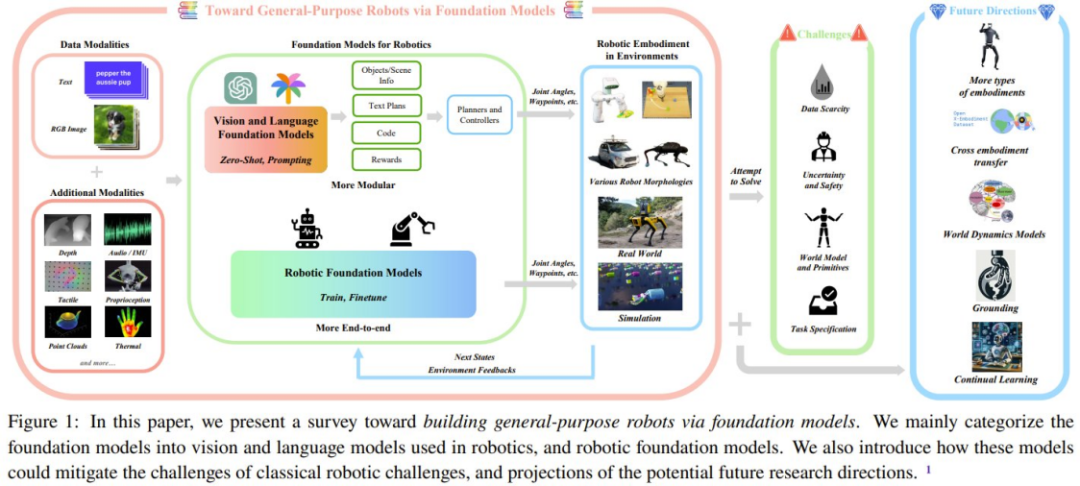

Cet article de synthèse résume les modèles de base utilisés dans le domaine de la robotique, dans le but de comprendre comment les modèles de base peuvent aider à résoudre ou à atténuer les principaux défis dans le domaine de la robotique.

Dans cette revue, le terme « modèles de base » utilisé par les chercheurs inclut deux aspects du domaine de la robotique : (1) Les principaux modèles visuels et linguistiques existants, principalement grâce au tir zéro et pour y parvenir grâce à l'apprentissage contextuel (2 ; ) Utiliser les données générées par les robots pour développer et appliquer spécifiquement des modèles de base pour résoudre les tâches des robots. Les chercheurs ont résumé les méthodes sur les modèles de base dans des articles pertinents et ont mené une méta-analyse sur les résultats expérimentaux de ces articles.

Afin d'aider les lecteurs à mieux comprendre le contenu de cette revue, l'équipe propose d'abord une section de connaissances préparatoires

Afin d'aider les lecteurs à mieux comprendre le contenu de cette revue, l'équipe propose d'abord une section de connaissances préparatoires

Les principaux composants du robot peuvent être divisés en trois parties : la perception, la prise de décision et la planification, et la génération d'actions.

Dans la section prise de décision et planification des robots, le chercheur a présenté les méthodes de planification classiques et les méthodes de planification basées sur l'apprentissage.

La génération d'actions machine dispose également de méthodes de contrôle classiques et de méthodes de contrôle basées sur l'apprentissage.

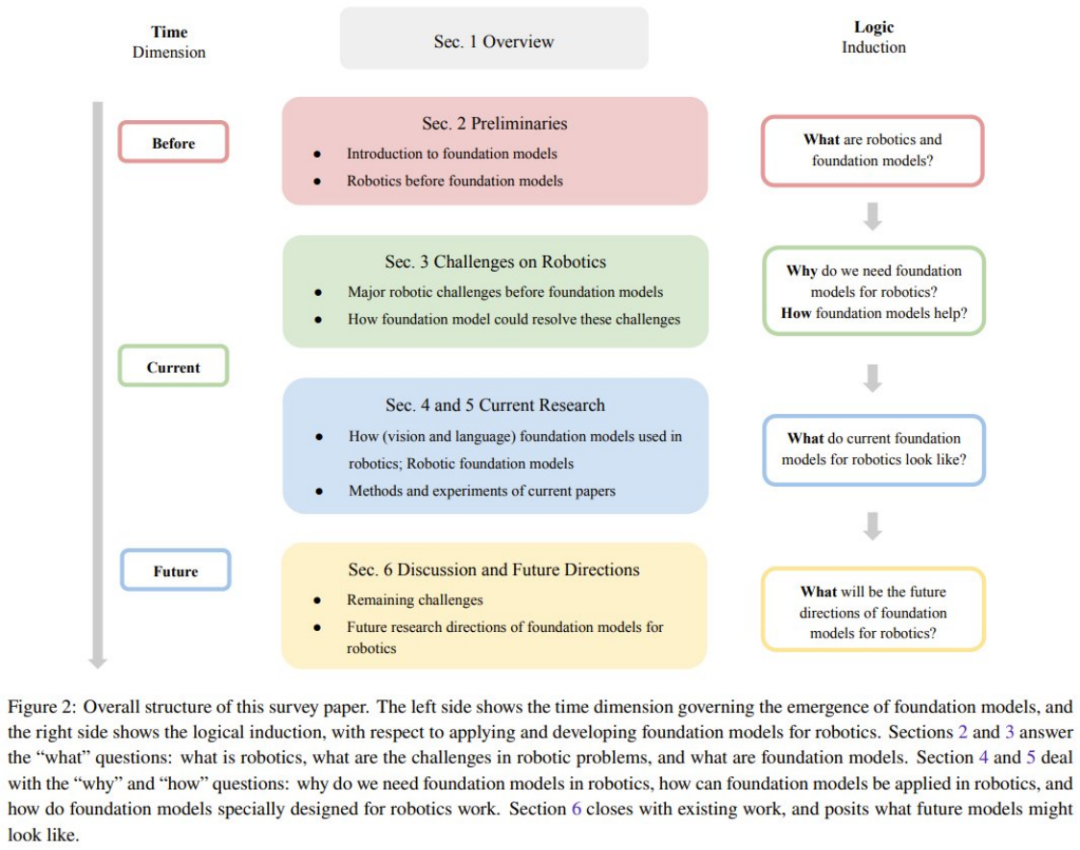

Généralisation

Puricité des données

Pour développer des modèles de robots fiables, des données à grande échelle et de haute qualité sont cruciales. Des efforts sont déjà en cours pour collecter des ensembles de données à grande échelle provenant du monde réel, notamment la conduite autonome, les trajectoires de fonctionnement des robots, etc. Et la collecte de données robotiques à partir de démonstrations humaines coûte cher. Cependant, le processus de collecte de données suffisantes et étendues dans le monde réel est encore compliqué par la diversité des tâches et des environnements. Il existe également des problèmes de sécurité concernant la collecte de données dans le monde réel. De plus, dans le monde réel, il est très difficile de collecter des données à grande échelle, et il est encore plus difficile de collecter les données d'image/texte à l'échelle Internet utilisées pour entraîner le modèle de base. Pour relever ces défis, de nombreux efforts de recherche ont tenté de générer des données synthétiques dans des environnements simulés. Ces environnements simulés peuvent fournir un monde virtuel très réaliste, permettant aux robots d'apprendre et d'appliquer leurs compétences dans des situations proches des scénarios réels. Cependant, l'utilisation d'environnements simulés présente certaines limites, notamment en termes de diversité d'objets, qui rendent difficile l'application directe des compétences acquises à des situations réelles.

Une approche à grand potentiel est la collecte de données collaborative, qui permettra de provenant de différents environnements de laboratoire et types de robots sont rassemblés, comme le montre la figure 4a. Cependant, l’équipe a examiné en profondeur l’ensemble de données d’implémentation Open-X et a découvert qu’il existait certaines limites en termes de disponibilité des types de données.

Exigences du modèle et des primitives

Les méthodes classiques de planification et de contrôle nécessitent généralement un environnement et des modèles de robots soigneusement conçus. Les méthodes précédentes basées sur l’apprentissage (telles que l’apprentissage par imitation et l’apprentissage par renforcement) entraînaient les politiques de bout en bout, c’est-à-dire en obtenant des résultats de contrôle directement à partir d’entrées sensorielles, évitant ainsi la nécessité de créer et d’utiliser des modèles. Ces méthodes peuvent résoudre en partie le problème du recours à des modèles explicites, mais elles sont souvent difficiles à généraliser à différents environnements et tâches.

Il y a deux problèmes qui doivent être résolus : (1) Comment apprendre des stratégies indépendantes du modèle et pouvant bien se généraliser ? (2) Comment apprendre d'excellents modèles mondiaux pour appliquer les méthodes classiques basées sur des modèles ?

Spécification de la tâche

Pour parvenir à un agent à usage général, un défi clé consiste à comprendre la spécification de la tâche et à l'ancrer dans la compréhension actuelle du monde du robot. Généralement, ces spécifications de tâches sont fournies par l'utilisateur, qui n'a qu'une compréhension limitée des limites des capacités cognitives et physiques du robot. Cela soulève de nombreuses questions, notamment quelles sont les meilleures pratiques qui peuvent être fournies pour ces spécifications de tâches et si la rédaction de ces spécifications est suffisamment naturelle et simple. Il est également difficile de comprendre et de résoudre les ambiguïtés dans les spécifications des tâches en fonction de la compréhension qu'a le robot de ses capacités.

Incertitude et sécurité

Pour déployer des robots dans le monde réel, un défi clé consiste à gérer l'incertitude inhérente à l'environnement et aux spécifications des tâches. Selon la source, l'incertitude peut être divisée en incertitude épistémique (incertitude causée par le manque de connaissances) et incertitude accidentelle (bruit inhérent à l'environnement).

Le coût de la quantification de l'incertitude (UQ) peut être si élevé que la recherche et les applications ne sont pas durables, et cela peut également empêcher la résolution optimale des tâches en aval. Compte tenu de la nature massivement surparamétrée du modèle sous-jacent, afin d'atteindre l'évolutivité sans sacrifier les performances de généralisation du modèle, il est crucial de fournir des méthodes UQ qui préservent le schéma de formation tout en modifiant le moins possible l'architecture sous-jacente. Concevoir des robots capables de fournir des estimations fiables de leur propre comportement et, en retour, de demander intelligemment des commentaires clairement exprimés reste un défi non résolu.

Bien que certains progrès aient été réalisés récemment, garantir que les robots aient la capacité d'apprendre de l'expérience pour affiner leurs stratégies et assurer la sécurité dans de nouveaux environnements reste un défi.

Cet article résume également les méthodes de recherche actuelles pour les modèles de base de robots. L'équipe a divisé les modèles de base utilisés dans le domaine de la robotique en deux grandes catégories : les modèles de base pour robots et le contenu réécrit : Robot Basic Model (RFM).

Le modèle de base du robot fait référence à l'utilisation du modèle de base de vision et de langage du robot d'une manière sans échantillon, sans réglage ni formation supplémentaire. Le modèle de base du robot peut être démarré à chaud avec une initialisation de pré-entraînement en langage visuel, ou le modèle peut être entraîné directement sur l'ensemble de données du robot

Classification détaillée

Modèle de base pour les robots

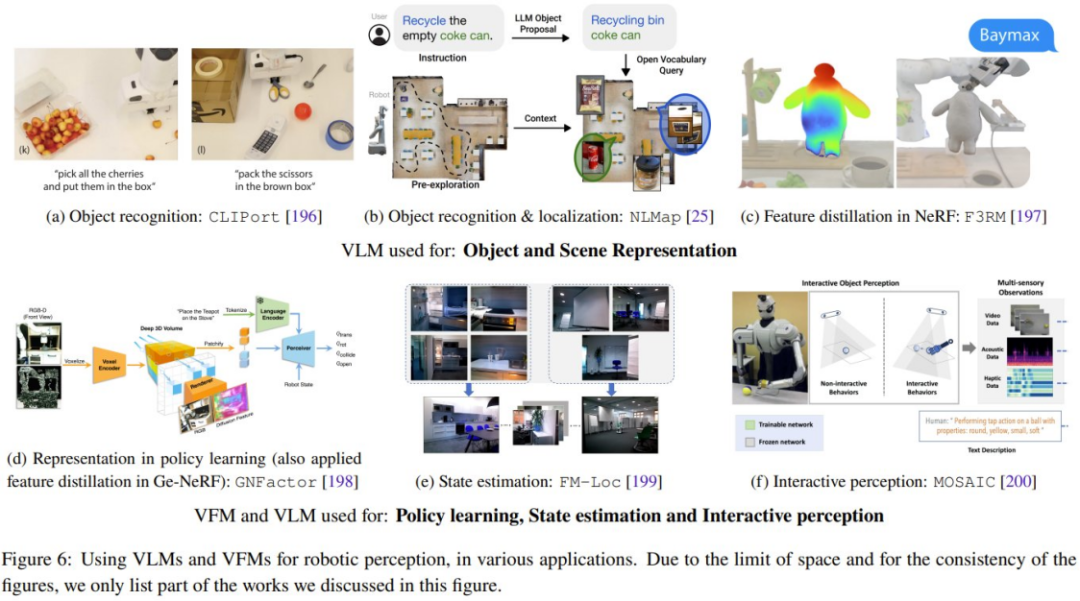

Cette section est réécrite comme suit : Cette section se concentre sur l'application de modèles de base de vision et de langage à des situations de tir nul dans le domaine de la robotique. Parmi eux, cela comprend principalement le déploiement de l'échantillon zéro VLM dans des applications de perception robotique et l'application des capacités d'apprentissage contextuel de LLM à la planification et à la génération d'actions au niveau des tâches et des mouvements. La figure 6 montre quelques travaux de recherche typiques

Ce qui est réécrit est : Modèle de base du robot (RFM)

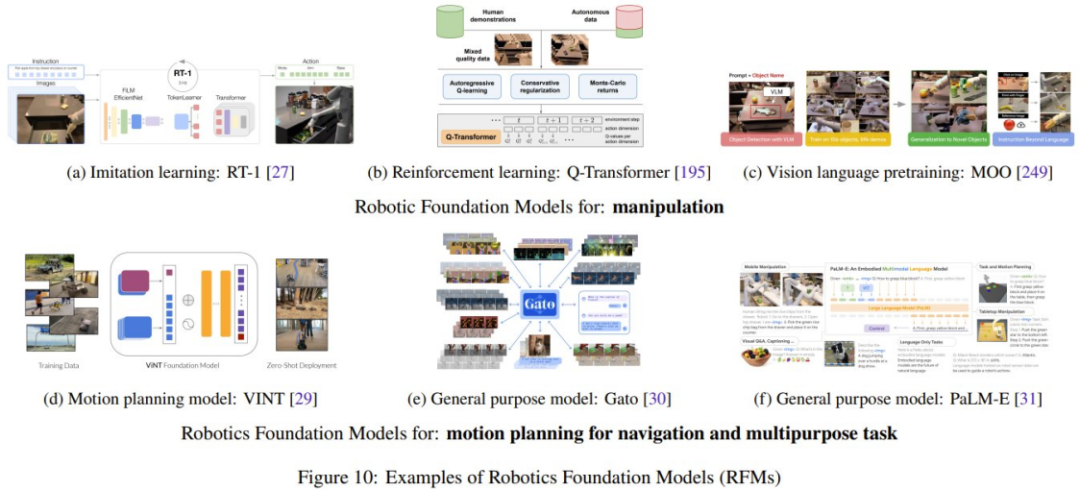

Avec le robot contenant des paires état-action du robot réel comme ensemble de données grandit, la réécriture est que la catégorie Robotics Foundation Model (RFM) a également de plus en plus de chances de réussir. Ces modèles utilisent des données robotiques pour entraîner le modèle à résoudre des tâches robotiques.

L'équipe de recherche a résumé les différents types de RFM au cours de la discussion. Le premier est un RFM capable d’effectuer des tâches spécifiques dans un seul module robotique, également appelé modèle de base de robot à objectif unique. Par exemple, la capacité de générer des RFM qui contrôlent les actions de bas niveau d'un robot ou des modèles capables de générer une planification de mouvement de niveau supérieur. L'article présente également des RFM capables d'effectuer des tâches dans plusieurs modules robotiques, c'est-à-dire des modèles universels capables d'effectuer des tâches de perception, de contrôle et même non robotiques.

Quel rôle le modèle de base joue-t-il dans la résolution des défis robotiques ?

L'article précédent énumère les cinq défis majeurs auxquels est confronté le domaine de la robotique. Nous décrivons ici comment les modèles de base peuvent aider à relever ces défis.

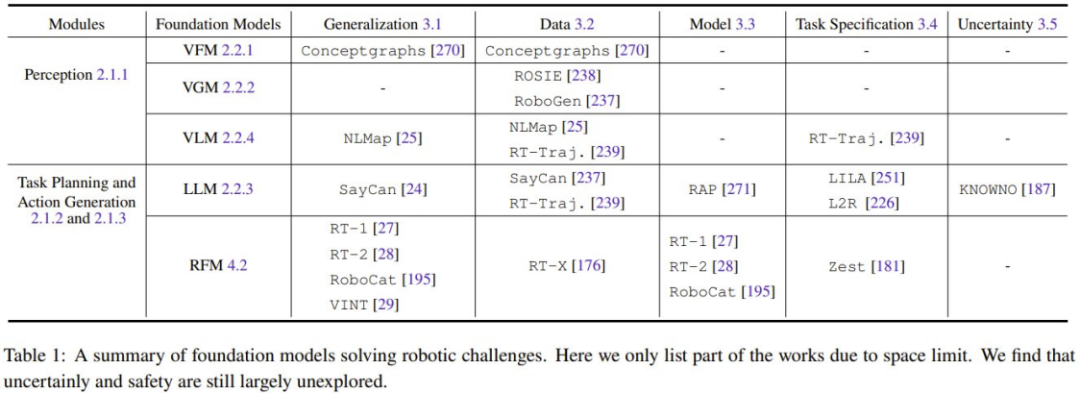

Tous les modèles de base liés aux informations visuelles (tels que VFM, VLM et VGM) peuvent être utilisés dans le module de perception du robot. LLM, en revanche, est plus polyvalent et peut être utilisé pour la planification et le contrôle. Le contenu réécrit est le suivant : Le modèle de base du robot (RFM) est généralement utilisé dans les modules de planification et de génération d'actions. Le tableau 1 résume les modèles sous-jacents pour résoudre différents défis robotiques.

Comme le montre le tableau, tous les modèles de base peuvent bien généraliser les tâches des différents modules de robot. En particulier, LLM fonctionne bien dans la spécification des tâches. RFM, en revanche, est efficace pour relever le défi des modèles dynamiques, puisque la plupart des RFM sont des méthodes sans modèle. Pour les capacités de perception des robots, les capacités de généralisation et les défis du modèle sont interdépendants. Si le modèle de perception possède déjà de bonnes capacités de généralisation, il n'est alors pas nécessaire d'obtenir plus de données pour l'adaptation du domaine ou des ajustements supplémentaires

De plus, il y a un manque de recherche sur les défis de sécurité, ce qui constituera un avenir important direction de la recherche.

Cette section résume les résultats de la recherche actuelle sur les ensembles de données, les références et les expériences.

Ensembles de données et références

Il y a des limites à s'appuyer uniquement sur les connaissances acquises à partir d'ensembles de données linguistiques et visuelles. Comme le montrent certains résultats de recherche, certains concepts tels que la friction et le poids ne peuvent pas être facilement appris par ces seules modalités.

Par conséquent, pour permettre aux agents robotiques de mieux comprendre le monde, la communauté des chercheurs adapte non seulement des modèles fondamentaux issus des domaines du langage et de la vision, mais fait également progresser le développement de robots multimodaux de grande taille et diversifiés pour les entraîner et les affiner. modèles.

Actuellement, ces efforts peuvent être divisés en deux directions principales : d'une part, la collecte de données du monde réel, et d'autre part, la collecte de données du monde simulé et leur migration vers le monde réel. Chaque direction a ses avantages et ses inconvénients. Les ensembles de données collectés dans le monde réel incluent RoboNet, Bridge Dataset V1, Bridge-V2, Language-Table, RT-1, etc. Les simulateurs couramment utilisés incluent Habitat, AI2THOR, Mujoco, AirSim, Arrival Autonomous Racing Simulator, Issac Gym, etc.

Analyse d'évaluation des méthodes actuelles (méta-analyse)

Une autre contribution majeure de l'équipe est A la méta-analyse des expériences dans les articles mentionnés dans ce rapport de synthèse peut aider à clarifier les questions suivantes :

1 Quelles tâches les gens résolvent-ils ?

2. Quels ensembles de données ou simulateurs ont été utilisés pour entraîner le modèle ? Quelles sont les plateformes robotiques utilisées pour les tests ?

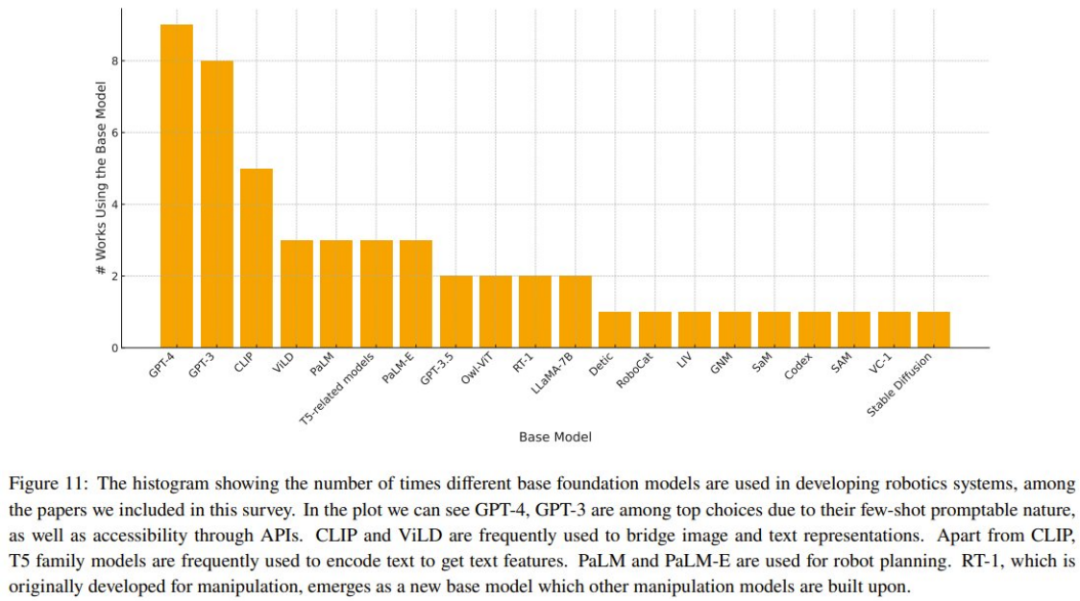

3. Quels modèles de base sont utilisés par la communauté des chercheurs ? Dans quelle mesure est-il efficace pour résoudre la tâche ?

4. Quels modèles de base sont les plus couramment utilisés parmi ces méthodes ?

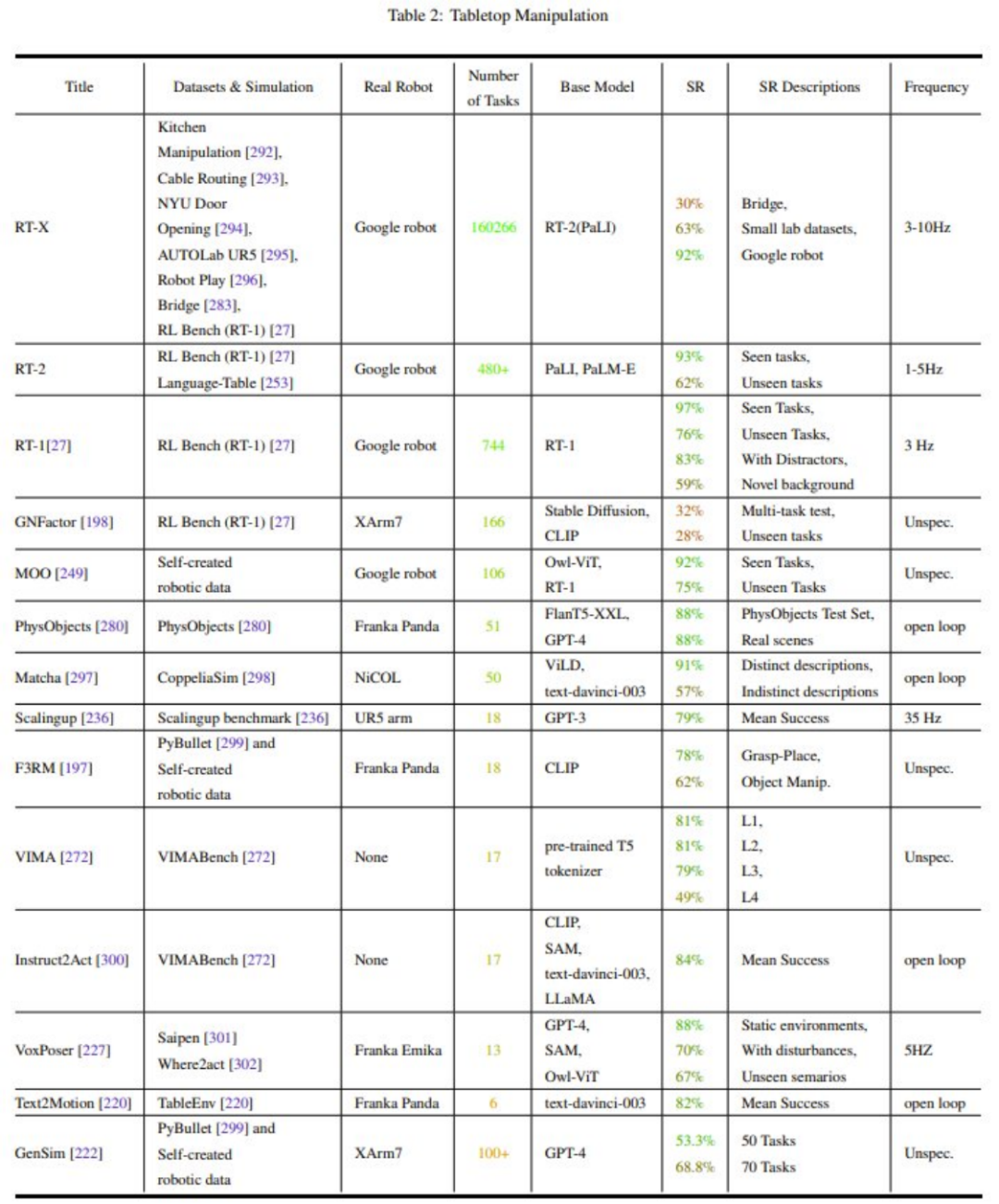

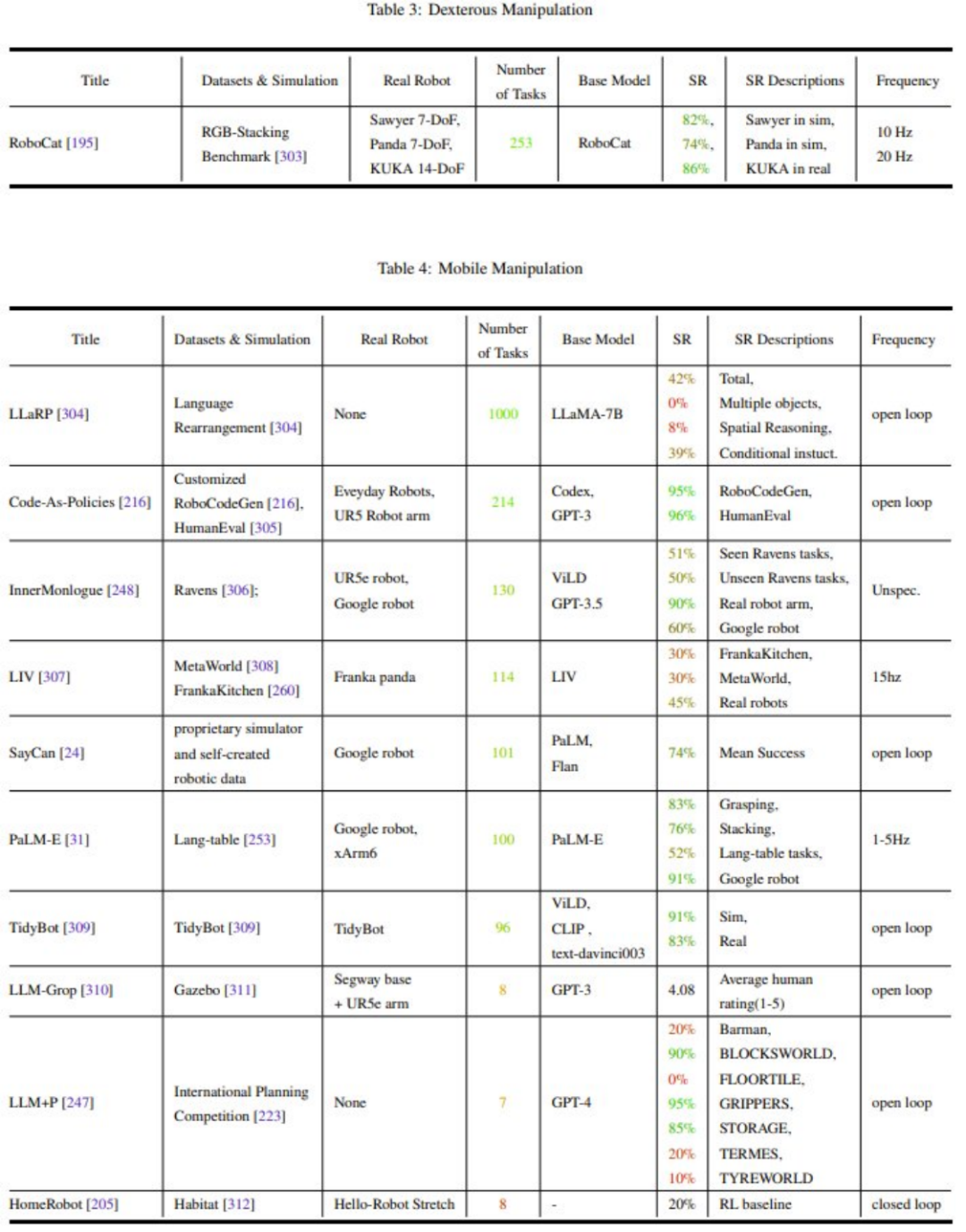

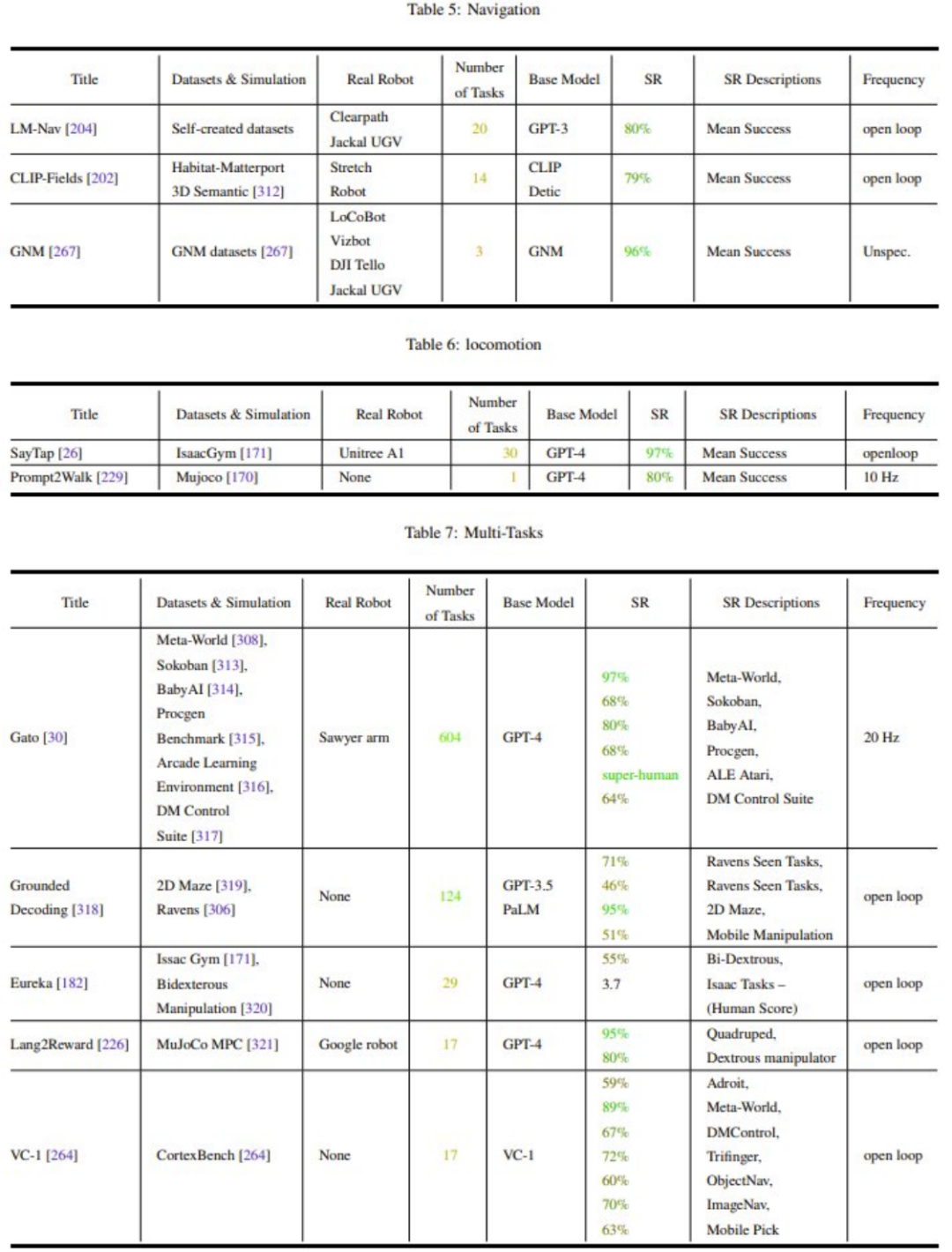

Le Tableau 2-7 et la Figure 11 montrent les résultats de l'analyse.

Quelques-unes des principales observations faites par l'équipe grâce à la méta-analyse :

L'attention de la communauté des chercheurs aux tâches de fonctionnement des robots (Manipulation) est déséquilibrée

La généralisation et la robustesse doivent être améliorées

L'exploration des actions de bas niveau (Contrôle de bas niveau) est très limitée

La fréquence de contrôle est trop basse (

Le manque de benchmarks de test unifiés (métriques) et de plates-formes de test (simulation ou matériel) rend la comparaison très difficile.

L'équipe a résumé certains défis qui doivent encore être résolus et les orientations de recherche qui méritent d'être discutées :

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Quel fichier est une ressource ?

Quel fichier est une ressource ?

Comment définir un arrêt programmé dans UOS

Comment définir un arrêt programmé dans UOS

Springcloud cinq composants principaux

Springcloud cinq composants principaux

Le rôle de la fonction mathématique en langage C

Le rôle de la fonction mathématique en langage C

Que signifie le wifi désactivé ?

Que signifie le wifi désactivé ?

Jailbreak iPhone 4

Jailbreak iPhone 4

La différence entre les fonctions fléchées et les fonctions ordinaires

La différence entre les fonctions fléchées et les fonctions ordinaires

Comment ignorer la connexion à Internet après le démarrage de Windows 11

Comment ignorer la connexion à Internet après le démarrage de Windows 11