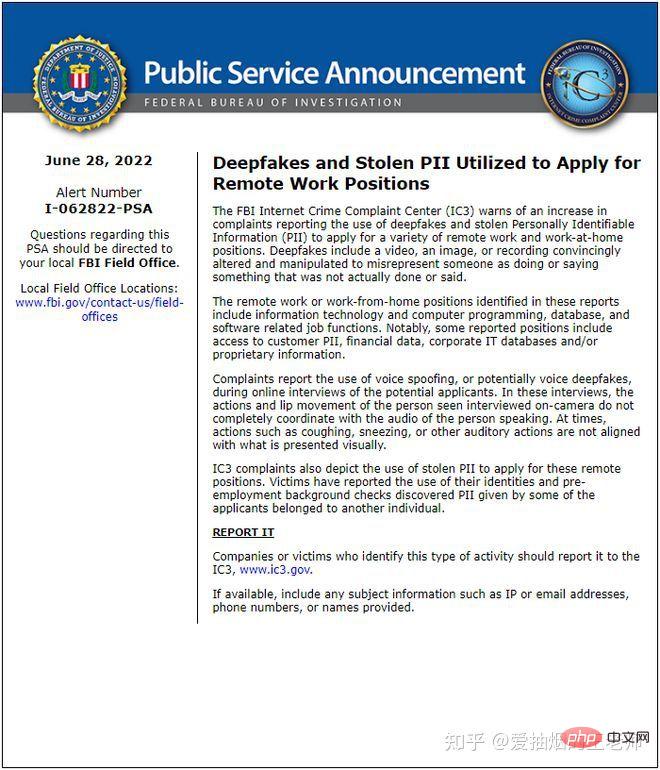

米国での感染症流行後、多くの企業が「在宅勤務」(WFH)モデルを採用しました。 FBIの犯罪苦情センターは、最近多くの企業雇用主から、採用プロセス中に求職者が他人の身元を盗み、ディープフェイク技術を使用して遠隔面接に参加したという苦情を受け取ったと述べた。

これらの職種には、情報技術、コンピューター プログラム、データベース、ソフトウェア関連分野が含まれます。求職者の中には、他の人の経歴や専門知識を利用して仕事を獲得しようとしたり、ディープフェイクを使用したりする人もいます。動画を偽造する技術。

求職者とのオンライン面接では、くしゃみや咳の音が出るなど、求職者の動きや口の開閉が話し声と一致しないことが判明しました。画面が同期しませんでした。

これらの求職者の身元調査を行ったところ、一部の求職者が実際に仕事を見つけるために他人のアイデンティティを使用していることが判明しました。仕事を探しているだけならまだ小さな問題ですが、ハッカーの場合、一度契約に成功すれば、無事に会社に侵入でき、機密データにアクセスできるようになってしまいます。

あなたも興味がありますか、このソフトウェアはとても使いやすいですか?

答えは、確かに非常に高度です。

ディープフェイクは、敵対的生成ネットワーク (GAN) の強力な画像生成機能を利用しており、既存の画像やビデオをソース画像やビデオに結合して重ね合わせることができ、人の顔の詳細を記録できます。 。長年の開発を経て、ディープフェイク技術は侵害を感じることなくリアルタイムで顔を変更できるようになりました。

しかし、ビデオに関しては、ディープフェイクで顔の表情を高い信頼性でアニメーション化することは難しく、ビデオ内の人物はまばたきをまったくしないか、まばたきの頻度が多すぎたり、不自然であったりします。さらに、音声とダミー画像は自然に十分に一致しません。

したがって、この種のビデオが 10 秒続くと、人々は不審に思うでしょう。インタビュー全体の時間が長くなり、欠陥が明らかになりやすくなります。

科学技術の進歩と変化は両刃の剣です。

人工知能テクノロジーは私たちに大きな利便性をもたらしますが、セキュリティ、倫理、プライバシーなどの一連の問題も引き起こす可能性があります。

人工知能の開発の本質は、アルゴリズム、計算能力、データを使用して、完全な情報と構造化された環境で決定論的な問題を解決することです。このデータ サポートの時代において、人工知能は多くのセキュリティ リスクに直面しています。

つまり、ハッカーは悪意のあるデータを注入して AI システムの信頼性と精度を低下させ、それによって人工知能の意思決定エラーを引き起こします。偽のデータや悪意のあるサンプルなどをトレーニング データに追加すると、データの完全性が破壊され、トレーニングされたアルゴリズム モデルの意思決定に逸脱が生じます。

このような動作を自動運転の分野で利用すると、車両が交通ルールに違反し、場合によっては交通事故を引き起こす可能性があります。

逆攻撃によりアルゴリズムモデル内の情報漏えいが発生する可能性がある現在、スマートブレスレット、スマートスピーカー生体認証システム、スマート医療システムなど、さまざまなスマートデバイスが普及し、あらゆる方向から個人情報が収集されています。 。顔、指紋、声紋、虹彩、心拍、遺伝子などを含むこれらの情報は、一意かつ不変であり、ひとたび漏洩または悪用されると重大な影響を及ぼします。

例えば、国内の多数の店舗がユーザーの同意なしに収集した大量の顔写真が流出したことが明らかになりましたが、これらの顔写真は多かれ少なかれ黒色の商品に流出している可能性があります。詐欺や経済的安全のリスクが考えられます。

人工知能は必然的にネットワーク接続を導入します。人工知能テクノロジー自体も、ネットワーク攻撃のインテリジェンス レベルを向上させ、インテリジェントなデータ窃盗やデータ恐喝攻撃を実行したり、大量の偽の脅威インテリジェンスを自動的に生成したりすることもできます。解析システムに影響を与える攻撃を実行します。

主な攻撃手法には、バイパス攻撃、推論攻撃、バックドア攻撃、モデル抽出攻撃、属性推論攻撃、トロイの木馬攻撃、モデル反転攻撃、アンチウォーターマーク攻撃、再プログラミング攻撃などがあります。

人工知能時代のデータセキュリティは、多くの新たな課題にも直面していることを明確に認識する必要があります。データ セキュリティとアルゴリズム セキュリティの保護は、企業にとって最優先事項となっています。

以上がハッカーは AI の顔変更技術を利用して仕事に応募する 人工知能のセキュリティ問題は無視できないの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。