Le 13 décembre, Microsoft a publié aujourd'hui un communiqué de presse indiquant que son modèle Phi-2 2.7B est supérieur au Gemini Nano-2 3.2B publié par Google à bien des égards.

Selon les rapports de ce site en novembre de l'année dernière, lors de la conférence Ignite 2023, Microsoft a publié Phi-2 avec des paramètres atteignant 2,7 milliards et des performances considérablement améliorées par rapport à la version précédente

Microsoft a publié Phi-1 en juin de cette année, avec seulement 1,3 milliard de paramètres, adaptés à des scénarios tels que les questions et réponses QA, le format de chat et le code. Le modèle est entièrement formé sur des données de haute qualité et surpasse jusqu'à 10 fois les modèles concurrents sur les benchmarks.

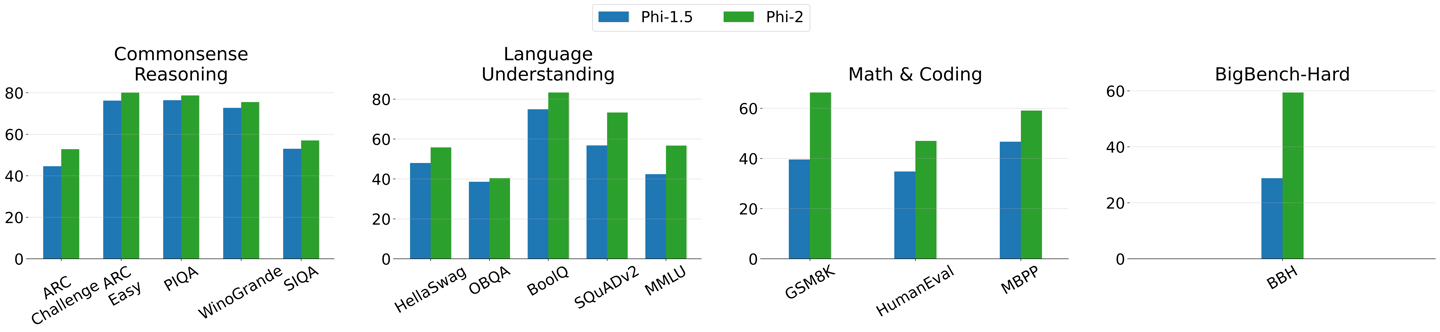

Microsoft a mis à jour la version Phi-1.5 en septembre de cette année, qui compte également 1,3 milliard de paramètres. Cette version peut être utilisée pour écrire de la poésie, rédiger des e-mails, écrire des histoires et résumer des textes. Dans les tests de bon sens, de compréhension du langage et de raisonnement, le modèle a pu suivre le rythme des modèles comportant jusqu'à 10 milliards de paramètres dans certains domaines

La dernière version de Phi-2 de Microsoft compte désormais 2,7 milliards de paramètres, bien qu'à une échelle plus grande que celle de Phi-2. versions précédentes Doublé, mais toujours petit par rapport aux autres modèles de langage traditionnels

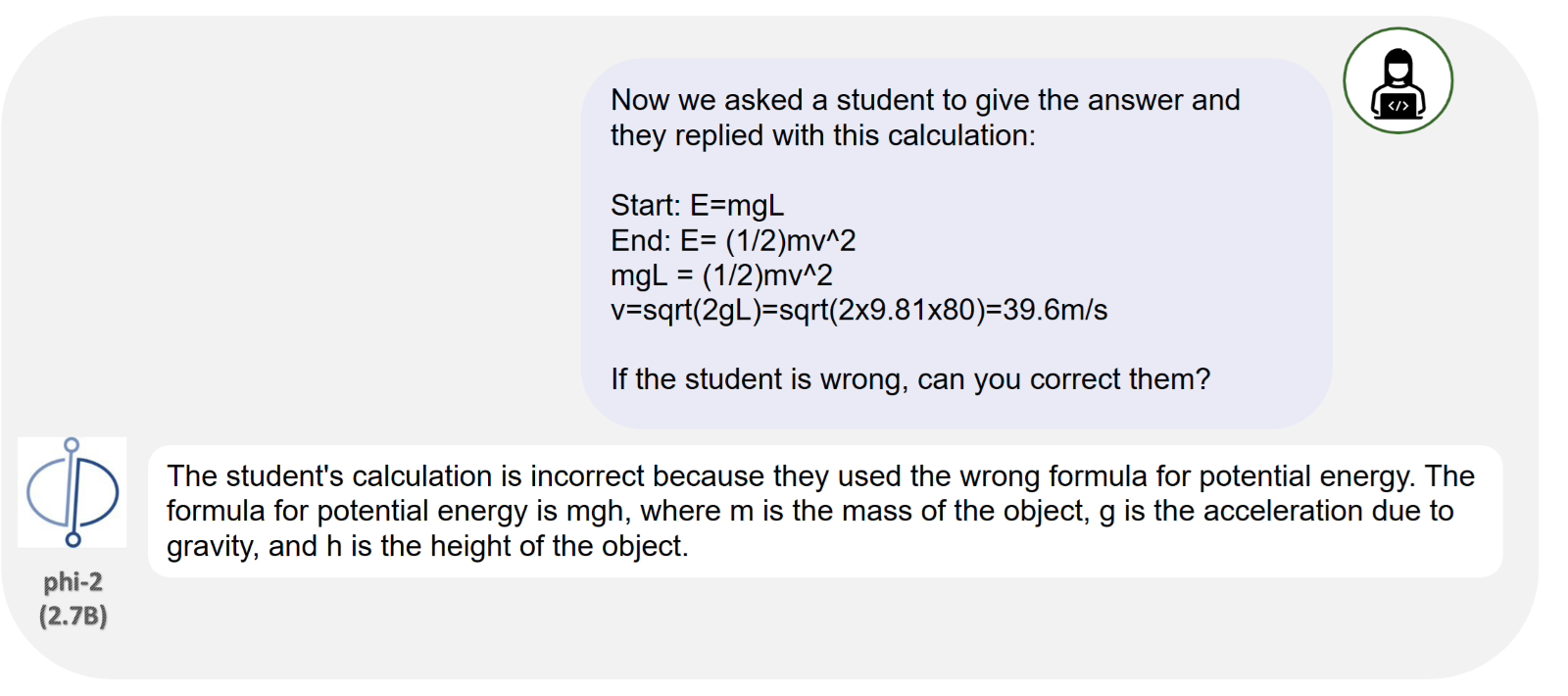

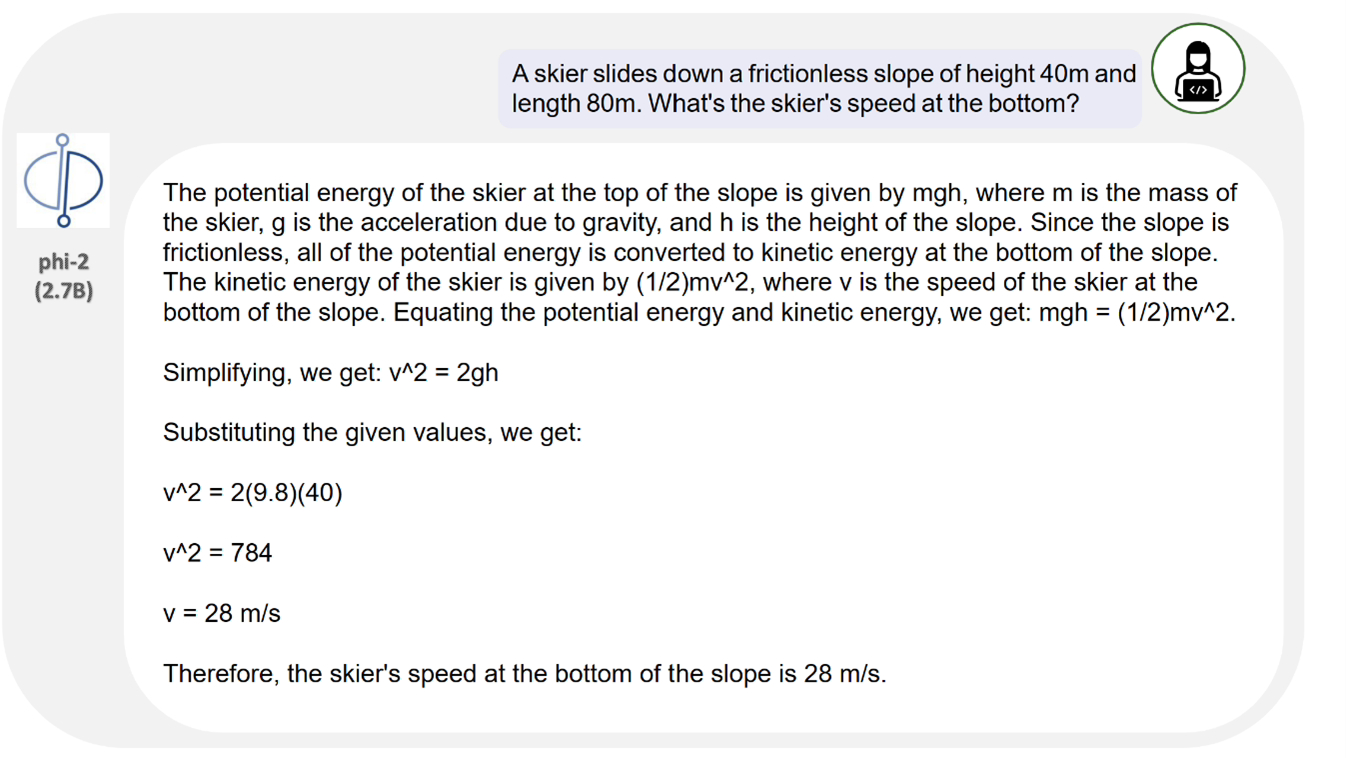

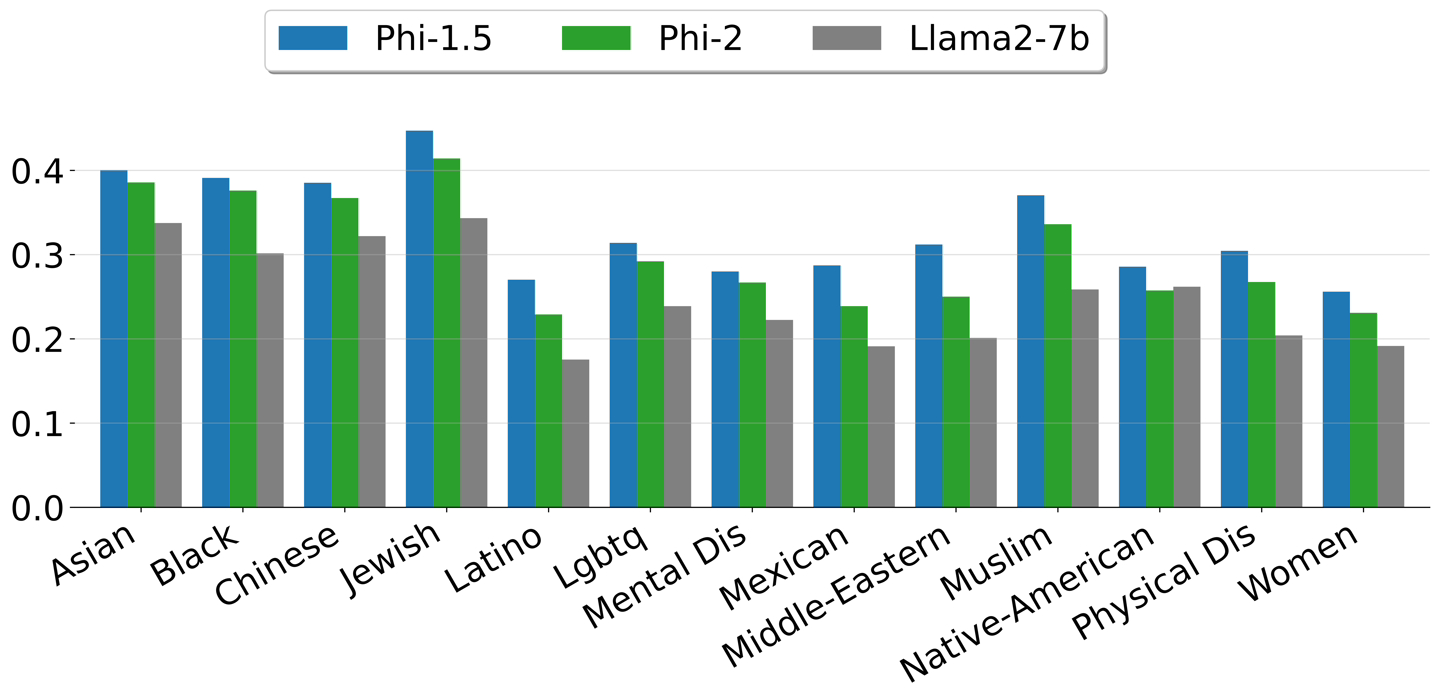

Microsoft affirme que Phi-2 présente des améliorations significatives en termes de raisonnement logique et de sécurité. Avec les réglages et la personnalisation appropriés, les petits modèles de langage sont des outils puissants pour les applications cloud et Edge.

Gemini Nano est une version de modèle spécialement conçue pour fonctionner nativement sur les petits appareils. La dernière version 2.0 compte 3,2 milliards de paramètres et sera la première à être équipée sur les modèles Pixel 8 Pro.

Dans la scène d'enregistrement, sélectionnez le fichier d'enregistrement et cliquez sur l'onglet "Transcription", puis cliquez sur le bouton "Résumé" en haut, et l'application générera plusieurs points clés liés au contenu de l'enregistrement.

Dans la méthode de saisie Gboard, Gemini Nano obtiendra des « réponses de haute qualité tenant compte des conversations ». WhatsApp sera la première application à prendre en charge les réponses intelligentes, et d'autres applications recevront également une assistance l'année prochaine.

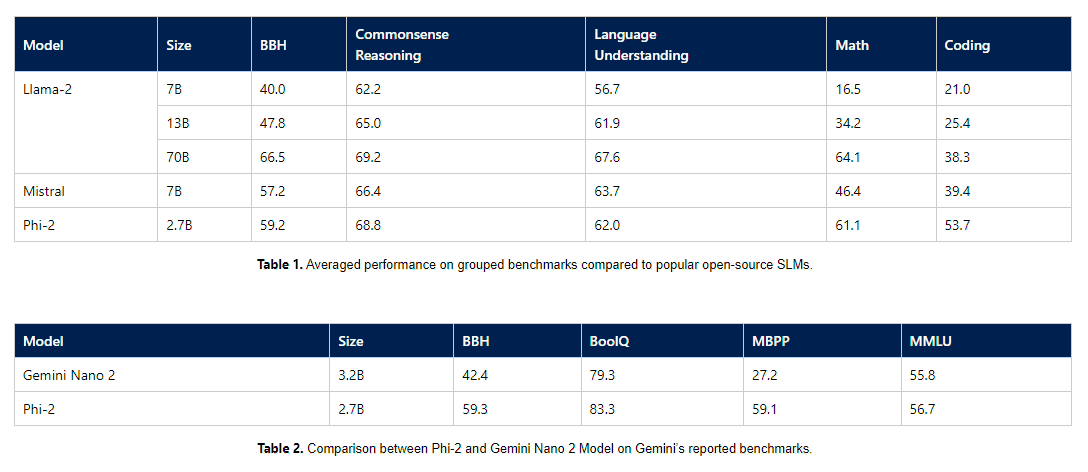

Dans son dernier article de blog, Microsoft a comparé le modèle Phi-2 avec le modèle Gemini Nano-2 de Google, affirmant que Phi-2 a de meilleures performances que le modèle Gemini Nano-2 à bien des égards.

Microsoft a également souligné que les performances de Phi-2 ont dépassé les 7 milliards de paramètres et les 13 milliards de paramètres de Llama-2, ainsi que les 7 milliards de paramètres de Mistral

Ben L'adresse officielle du blog de Microsoft est jointe au site, les utilisateurs intéressés peuvent la lire en profondeur.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Application de l'intelligence artificielle dans la vie

Application de l'intelligence artificielle dans la vie

Quel est le concept de base de l'intelligence artificielle

Quel est le concept de base de l'intelligence artificielle

Solution à l'échec de la connexion entre wsus et le serveur Microsoft

Solution à l'échec de la connexion entre wsus et le serveur Microsoft

Mongodb et MySQL sont faciles à utiliser et recommandés

Mongodb et MySQL sont faciles à utiliser et recommandés

Que sont les plug-ins jquery ?

Que sont les plug-ins jquery ?

que signifie Facebook

que signifie Facebook

méthode de réglage chinois vscode

méthode de réglage chinois vscode

Qu'est-ce qu'ECharts

Qu'est-ce qu'ECharts