IT Home a rapporté le 11 juillet que Baichuan Intelligence, une filiale de Wang Xiaochuan, avait publié aujourd'hui le grand modèle Baichuan-13B, qui serait « open source de 13 milliards de paramètres et disponible dans le commerce ».

▲ Source de l'image Page GitHub Baichuang-13B

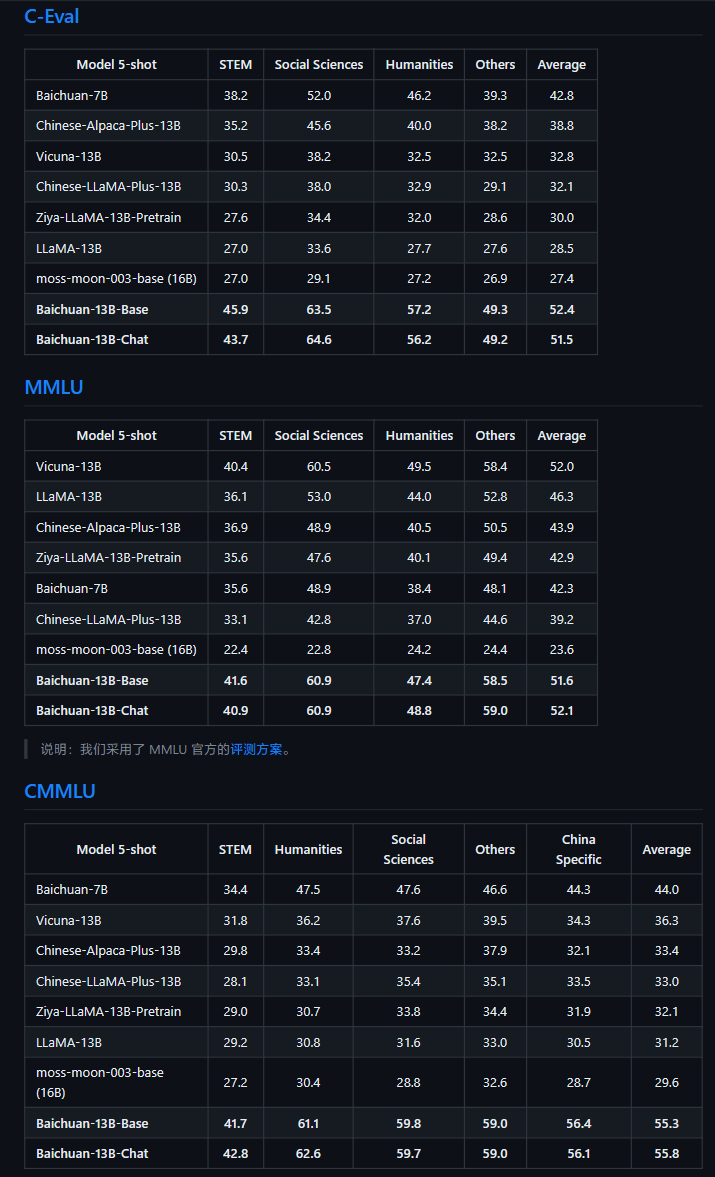

Selon l'introduction officielle, Baichuan-13B est un modèle de langage à grande échelle open source disponible dans le commerce contenant 13 milliards de paramètres développé par Baichuan Intelligence après Baichuan-7B. Il a obtenu les meilleurs résultats parmi les modèles de même taille en chinois et en chinois. Repères anglais. Cette version comprend deux versions : pré-formation (Baichuan-13B-Base) et alignement (Baichuan-13B-Chat).

▲ Source de l'image Page GitHub Baichuang-13B

A affirmé officiellement que Baichuan-13B possède les caractéristiques suivantes :

- Plus grande taille, plus de données : Baichuan-13B a encore augmenté le nombre de paramètres à 13 milliards sur la base de Baichuan-7B et a formé 1,4 billion de jetons sur un corpus de haute qualité, dépassant de 40 % LLaMA-13B. Le modèle avec la plus grande quantité de données d’entraînement à la taille 13 B. Prend en charge les langues chinoise et anglaise, utilise le codage de position ALiBi et la longueur de la fenêtre contextuelle est de 4096.

- Modèles de pré-formation et d'alignement open source à la fois : le modèle de pré-formation est une « base » pour les développeurs, alors que la majorité des utilisateurs ordinaires ont des besoins plus forts en modèles d'alignement avec fonctions de dialogue. Par conséquent, le projet dispose également d'un modèle d'alignement (Baichuan-13B-Chat), qui possède de fortes capacités conversationnelles. Il peut être utilisé immédiatement et peut être facilement déployé avec quelques lignes de code.

- Raisonnement plus efficace : afin de prendre en charge l'utilisation d'un plus large éventail d'utilisateurs, le projet a également open source les versions quantifiées de int8 et int4. Par rapport à la version non quantifiée, cela réduit considérablement le seuil de ressources machine pour le déploiement avec. presque aucune perte d'effet et peut être déployé sur des cartes graphiques grand public telles que NVIDIA RTX3090.

- Open source, gratuit pour un usage commercial : Baichuan-13B est non seulement entièrement ouvert à la recherche universitaire, mais les développeurs peuvent également l'utiliser gratuitement après avoir postulé par e-mail et obtenu une licence commerciale officielle.

Actuellement, le modèle a été publié sur HuggingFace, GitHub et Model Scope. Les amis IT Home intéressés peuvent aller en savoir plus.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

qu'est-ce que l'index MySQL

qu'est-ce que l'index MySQL

Qu'est-ce qui est mis en évidence dans jquery

Qu'est-ce qui est mis en évidence dans jquery

Requête blockchain du navigateur Ethereum

Requête blockchain du navigateur Ethereum

Comment récupérer les flammes Douyin après leur disparition ?

Comment récupérer les flammes Douyin après leur disparition ?

Comment résoudre le problème des 400 requêtes incorrectes lorsque la page Web s'affiche

Comment résoudre le problème des 400 requêtes incorrectes lorsque la page Web s'affiche

Outils de recherche couramment utilisés

Outils de recherche couramment utilisés

Logiciel gratuit pour créer des sites Web

Logiciel gratuit pour créer des sites Web

Quel est le concept de base de l'intelligence artificielle

Quel est le concept de base de l'intelligence artificielle