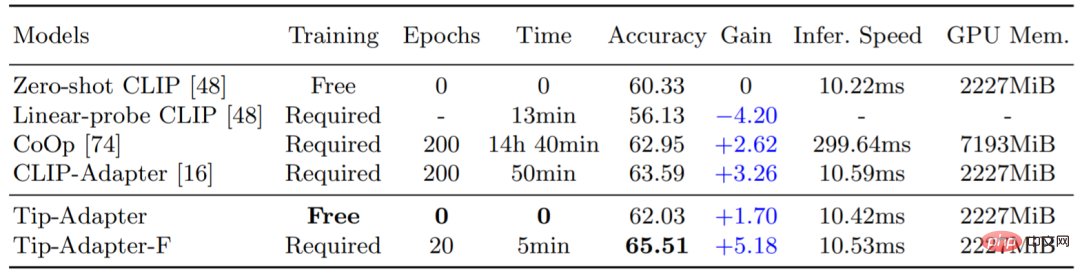

Le modèle de pré-entraînement au langage d'image contrasté (CLIP) a récemment démontré de solides capacités de transfert de domaine visuel et peut effectuer une reconnaissance d'image sans prise de vue sur un nouvel ensemble de données en aval. Afin d'améliorer encore les performances de migration de CLIP, les méthodes existantes utilisent des paramètres à faible consommation, tels que CoOp et CLIP-Adapter, qui fournissent une petite quantité de données de formation pour les ensembles de données en aval, permettant à CLIP de mieux prendre des décisions pour différents scénarios visuels. . Ajustement. Cependant, cette étape de formation supplémentaire entraînera une surcharge considérable en termes de temps et d'espace, ce qui affecte dans une certaine mesure la capacité inhérente de transfert rapide de connaissances du CLIP. Par conséquent, nous proposons Tip-Adapter, une méthode de classification d'images en quelques prises de vue qui ne nécessite pas de formation supplémentaire en aval et peut grandement améliorer la précision de CLIP. Sur cette base, nous avons proposé une solution capable d'atteindre des performances de pointe avec seulement quelques réglages fins : Tip-Adapter-F, obtenant le meilleur compromis entre efficacité et performances. Comme le montre le tableau 1 ci-dessous, Tip-Adapter ne nécessite aucun temps de formation, ce qui peut améliorer CLIP dans l'ensemble de données ImageNet de +1,7 % de précision (précision), tandis que Tip-Adapter-F ne nécessite qu'un dixième du temps de formation. de la solution précédente (Epoques, Temps), les meilleures performances de classification existantes peuvent être obtenues.

Tableau 1 : Comparaison de la précision de la classification d'images de 16 prises de vue et du temps de formation de différents schémas sur l'ensemble de données ImageNet

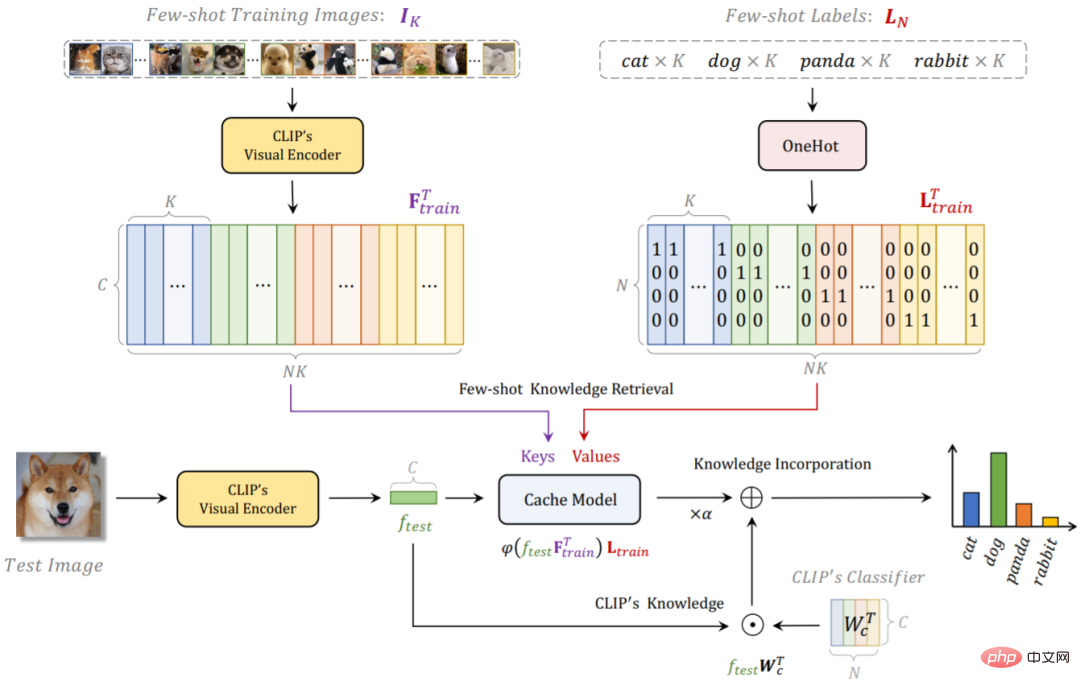

La structure globale du réseau de Tip-Adapter est illustrée dans la figure 1 ci-dessous pour un ensemble de données et d'étiquettes de formation donnés, nous utilisons CLIP pour créer un cache de solution sans formation. Modèle, qui stocke les connaissances de classification à partir des données de formation en aval ; pendant les tests, Tip-Adapter obtient des résultats de classification finaux plus solides en ajoutant linéairement les prédictions du modèle de cache et les prédictions du CLIP d'origine.

En détail, nous utilisons l'encodeur visuel pré-entraîné CLIP (Visual Encoder) pour extraire les caractéristiques de toutes les images de l'ensemble d'entraînement en quelques plans en tant que clés du modèle de cache et convertir les étiquettes d'image correspondantes en une seule - ; forme d'encodage à chaud, en tant que valeurs du modèle de cache. Cette méthode de construction de modèle de cache de valeurs-clés ne nécessite aucune surcharge de formation car elle utilise l'encodeur visuel pré-entraîné et étant donné que l'ensemble de formation de quelques prises de vue ne contient qu'un petit nombre d'images pour chaque catégorie (1 à 16 prises de vue) ; le modèle de cache ne nécessite également presque aucune surcharge de mémoire vidéo supplémentaire. Reportez-vous aux indicateurs GPU Mem dans le tableau 1.

Pour une image de test, nous utiliserons d'abord l'encodeur visuel de CLIP pour obtenir ses fonctionnalités, puis traiterons les fonctionnalités comme une requête pour effectuer une récupération de connaissances sur les données de quelques plans en aval dans le modèle de cache. Étant donné que les clés sont également extraites par l'encodeur visuel de CLIP, elles ont la même origine que la requête de fonctionnalité de l'image de test. Nous pouvons calculer directement la similarité cosinus entre elles pour obtenir une matrice de contiguïté clé-requête. Cette matrice peut être considérée comme chacune des pondérations correspondantes. à la valeur. Par conséquent, nous pouvons calculer la somme pondérée des valeurs pour obtenir la prédiction de classification pour cette image de test obtenue en récupérant le modèle de cache. De plus, nous pouvons également obtenir la prédiction zéro-shot de CLIP en faisant correspondre les fonctionnalités de l'image de test avec les fonctionnalités de texte de Textual Encoder de CLIP. En pondérant linéairement la somme des deux, nous obtenons la prédiction de classification finale, qui contient à la fois les connaissances contrastées du langage d'image pré-entraînées par CLIP et la connaissance de quelques plans du nouvel ensemble de données en aval, afin de pouvoir obtenir des prédictions plus précises. Forte précision de classification des images.

Sur la base de la structure réseau de Tip-Adapter, nous pouvons transformer davantage la partie clés du modèle de cache en paramètres d'apprentissage, qui peuvent être mis à jour via la formation. Cette solution est Tip-Adapter-F. Avec l'aide du modèle de cache déjà construit, Tip-Adapter-F ne nécessite qu'un dixième des cycles de formation et du temps de l'adaptateur CLIP existant pour atteindre des performances plus élevées, comme le montre le tableau 1.

Figure 1 : Organigramme réseau de Tip-Adapter et Tip-Adapter-F

2 Différences et connexions entre Tip-Adapter et les solutions existantes

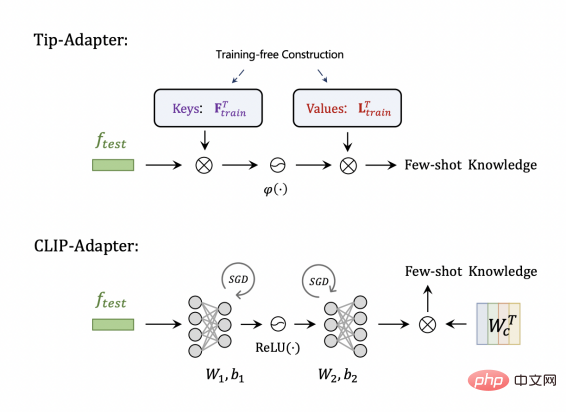

Comparaison CLIP-Adapter. , comme le montre la figure 2, les clés et les valeurs stockées dans Tip-Adapter peuvent en fait correspondre aux deux couches linéaires de la structure de l'adaptateur dans CLIP-Adapter, mais la première ne nécessite pas de formation pour être construite et la seconde est aléatoire. initialisé. Ensuite, une formation est nécessaire pour apprendre les paramètres optimaux.

Figure 2 : Tip-Adapter comparé à CLIP-Adapter

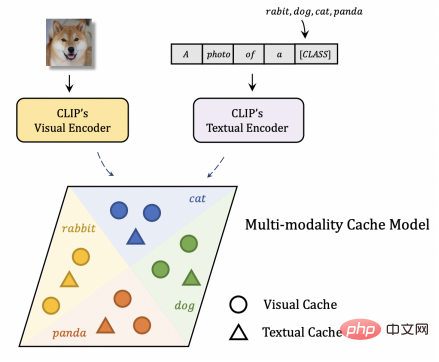

Comparé à d'autres solutions existantes pour créer un modèle de cache, comme le montre la figure 3, le modèle de cache de Tip-Adapter peut être vu Cache est un langage visuel multimodal. Parce que les fonctionnalités produites par l'encodeur textuel de CLIP peuvent être considérées comme la valeur-clé du texte, ce qui équivaut à tester les fonctionnalités de l'image en tant que requête, récupérant les connaissances dans le cache visuel et textuel respectivement par rapport à la solution existante qui ne contient que le cache. Visual Cache, Tip-Adapter peut utiliser des connaissances multimodales pour obtenir de meilleures performances de reconnaissance.

Figure 3 : Tip-Adapter comparé à d'autres solutions pour créer un modèle de cache

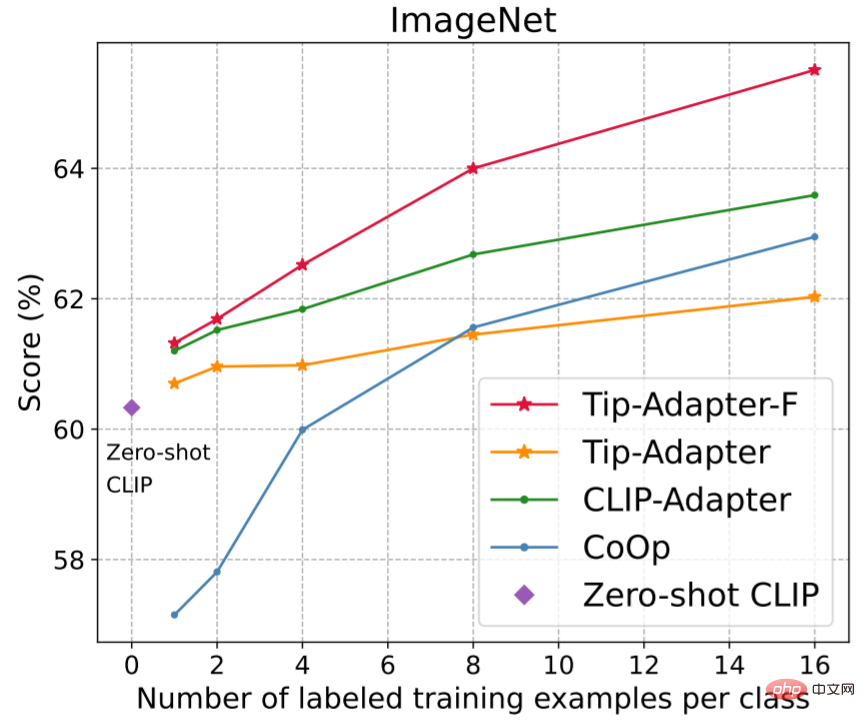

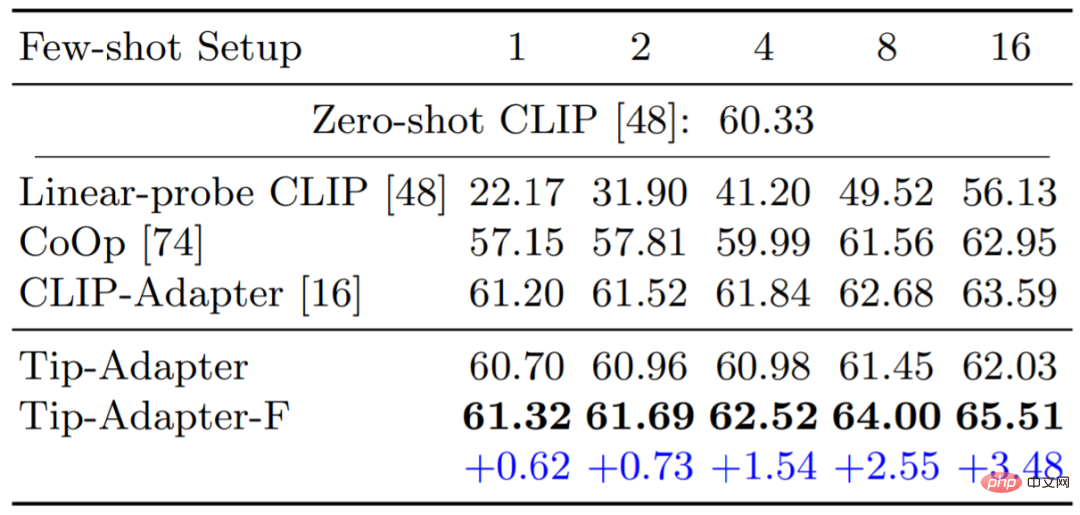

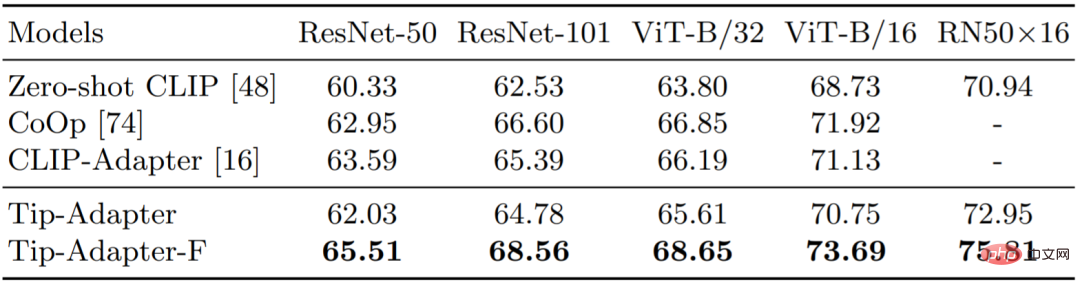

La figure 4 et le tableau 2 comparent la précision de la classification des images Tip-Adapter, Tip-Adapter-F et 16 prises de vue ; 3 compare la précision de Visual Encoder en utilisant différents CLIP sur l'ensemble de données ImageNet de 16 prises de vue. On peut constater que nos deux solutions atteignent d’excellentes performances avec très peu de ressources.

Figure 4 et Tableau 2 : Comparaison de la précision de la classification d'images de 1 à 16 prises de vue de différentes méthodes sur l'ensemble de données ImageNet

5:16 - shot Comparaison de la précision de la classification d'images de Visual Encoder avec différents CLIP sur ImageNet

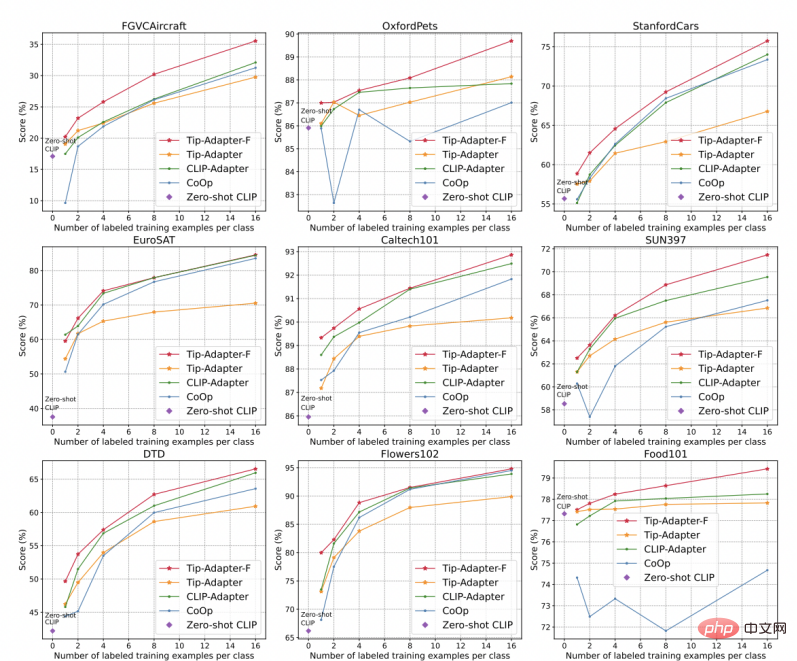

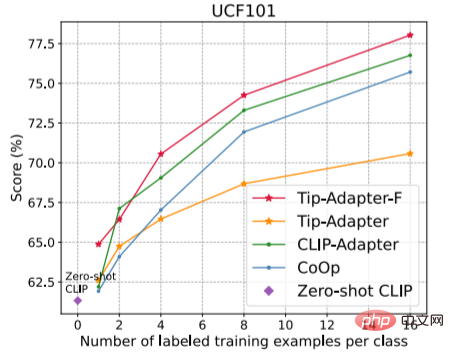

Comme le montre la figure 5, nous fournissons la précision de 10 autres ensembles de données de classification d'images. les résultats sont StandfordCars, UCF101, Caltech101, Flowers102, SUN397, DTD, EuroSAT, FGVCAircraft, OxfordPets et Food101. Comme le montre la figure, nos Tip-Adapter-F ont tous atteint la plus grande précision de reconnaissance.

Figure 5 : Comparaison de la précision de la classification d'images de 1 à 16 prises de vue de différentes méthodes sur 10 autres ensembles de données

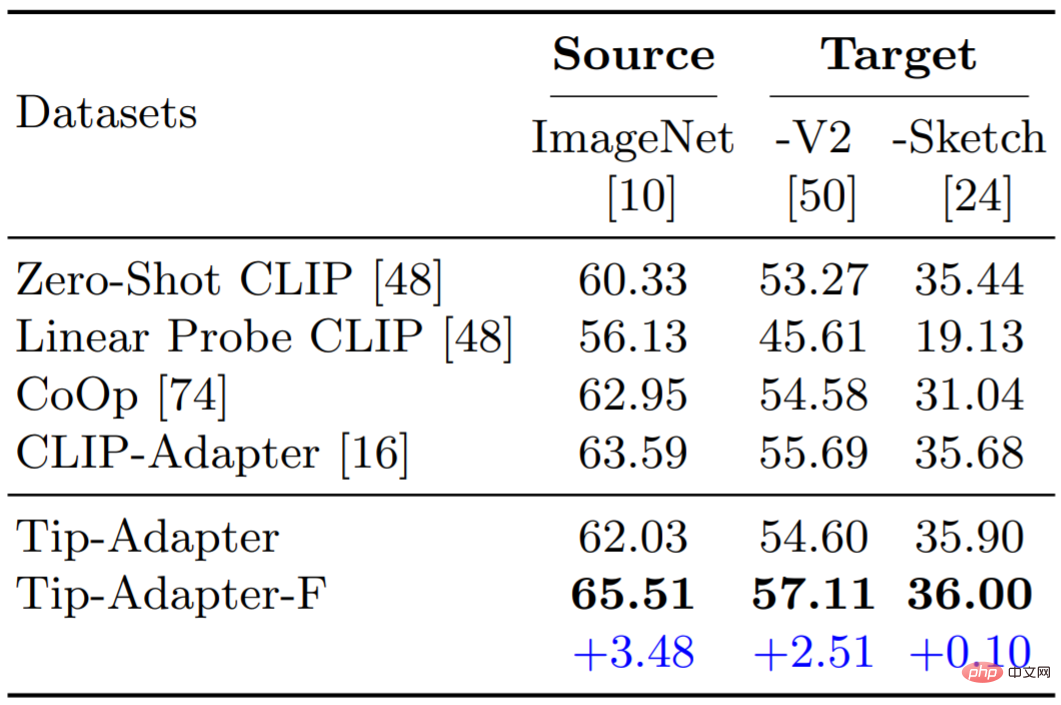

Nous avons également testé les performances de Tip-Adapter et Tip-Adapter-F en généralisation de domaine. Comme le montre le tableau 6, nos deux systèmes présentent une forte robustesse et de fortes capacités de transfert de fonctionnalités.

Cet article propose Tip-Adapter, une solution sans formation pour l'utilisation de CLIP pour la classification d'images en quelques prises de vue en aval. Tip-Adapter construit un modèle de cache clé-valeur en tant que base de données de récupération de connaissances pour la requête d'image de test et obtient de meilleures performances de reconnaissance en fusionnant les prédictions du modèle de cache et les prédictions zéro-shot de CLIP. Nous espérons que Tip-Adapter pourra inspirer davantage de travaux de suivi sur la migration efficace des modèles pré-entraînés.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

code d'activation de la clé Vista

code d'activation de la clé Vista

Quelles sont les méthodes pour changer instantanément l'IP dans les vps dynamiques ?

Quelles sont les méthodes pour changer instantanément l'IP dans les vps dynamiques ?

Comment résoudre le problème que cette copie de Windows n'est pas authentique

Comment résoudre le problème que cette copie de Windows n'est pas authentique

Que dois-je faire si mon compte QQ est volé ?

Que dois-je faire si mon compte QQ est volé ?

Quelle est la différence entre le protocole TCP et le protocole UDP ?

Quelle est la différence entre le protocole TCP et le protocole UDP ?

Comment résoudre l'erreur 0xc000409

Comment résoudre l'erreur 0xc000409

Comment résoudre le problème selon lequel document.cookie ne peut pas être obtenu

Comment résoudre le problème selon lequel document.cookie ne peut pas être obtenu

Que comprennent les systèmes logiciels informatiques ?

Que comprennent les systèmes logiciels informatiques ?