論文"NeuRAD: Neural Rendering for Autonomous Driving",來自Zenseact,Chalmers科技大學,Linkoping大學和Lund大學。

神經輻射場(NeRF)在自動駕駛(AD)社群中越來越受歡迎。最近的方法顯示了NeRFs在閉環模擬、AD系統測試和訓練資料增強技術方面的潛力。然而,現有的方法往往需要長的訓練時間、密集的語意監督,缺乏可推廣性。這反過來又阻礙了NeRF在AD的大規模應用。本文提出NeuRAD,一種針對動態AD資料的穩健的新視圖合成方法。此方法具有簡單的網路設計、包括相機和雷射雷達的感測器建模(包括滾動快門、光束發散和光線降落),適用於開箱即用的多個資料集。

神經輻射場(NeRF)在自動駕駛(AD)社群中越來越受歡迎。最近的方法顯示了NeRFs在閉環模擬、AD系統測試和訓練資料增強技術方面的潛力。然而,現有的方法往往需要長的訓練時間、密集的語意監督,缺乏可推廣性。這反過來又阻礙了NeRF在AD的大規模應用。本文提出NeuRAD,一種針對動態AD資料的穩健的新視圖合成方法。此方法具有簡單的網路設計、包括相機和雷射雷達的感測器建模(包括滾動快門、光束發散和光線降落),適用於開箱即用的多個資料集。

如圖所示:NeuRAD是一種為動態汽車場景量身打造的神經渲染方法。可以改變自車和其他道路使用者的姿態,也可以自由添加和/或移除參與者。這些功能使NeuRAD適合作為感測器逼真的閉環模擬器或強大資料增強引擎等組件的基礎。

本文目標是學習一種表示,從中可以產生真實的感測器數據,其中可以改變自車平台、行動者的姿態,或者兩者兼而有之。假設可以存取由移動平台收集的數據,由設定的相機影像和雷射雷達點雲組成,以及對任何移動行動者大小和姿態的估計。為了實用性,該方法需要在主要汽車資料集上的重建誤差方面表現良好,同時將訓練和推理時間保持在最低限度。

本文目標是學習一種表示,從中可以產生真實的感測器數據,其中可以改變自車平台、行動者的姿態,或者兩者兼而有之。假設可以存取由移動平台收集的數據,由設定的相機影像和雷射雷達點雲組成,以及對任何移動行動者大小和姿態的估計。為了實用性,該方法需要在主要汽車資料集上的重建誤差方面表現良好,同時將訓練和推理時間保持在最低限度。

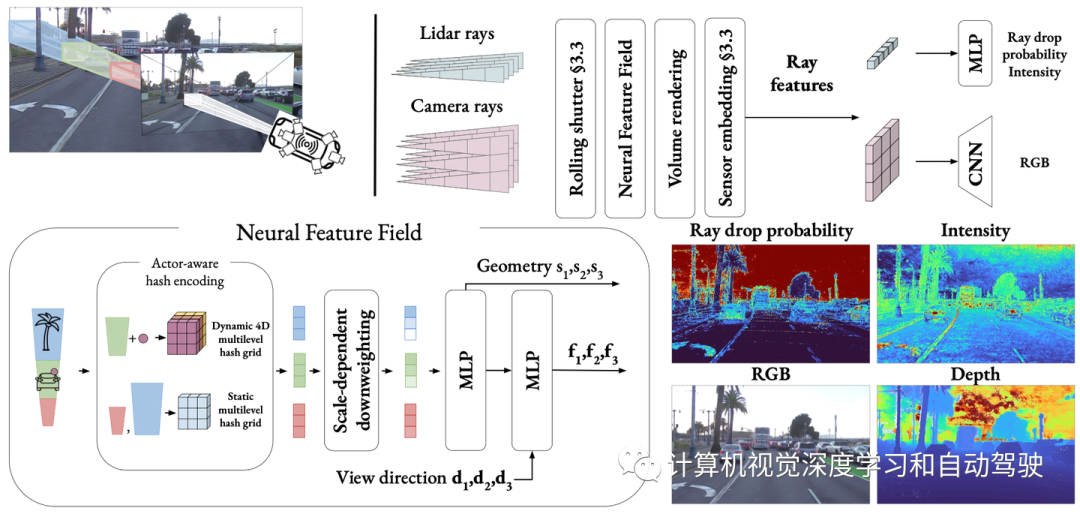

如圖是本文提出方法NeuRAD的概覽:學習一個用於汽車場景的靜態和動態的聯合神經特徵場,透過行動者-覺察的雜湊編碼來區分。落入行動者邊框內的點被轉換為行動者局部座標,並與行動者索引一起用於查詢4D哈希網格。用上採樣CNN將體渲染的光線級特徵解碼為RGB值,並用MLP將其解碼為光線降落機率和強度。

在新視圖合成[4,47]的工作基礎上,作者用神經特徵場(NFF)、NeRFs[25]的推廣和類似方法[23]對世界進行建模。

在新視圖合成[4,47]的工作基礎上,作者用神經特徵場(NFF)、NeRFs[25]的推廣和類似方法[23]對世界進行建模。

為了渲染影像,需要對一組相機射線進行體渲染,產生特徵圖F。如論文[47]所述,之後再利用卷積神經網路(CNN)來渲染最終的影像。在實際應用中,特徵圖的分辨率較低,需要使用CNN進行上採樣,以大幅減少光線查詢的數量

雷射雷達感測器允許自動駕駛車輛測量一組離散點的深度和反射率(強度)。他們透過發射雷射光束脈衝和測量飛行時間來確定距離和反射率的返回功率。為了捕捉這些特性,將來自姿態光達感測器的傳輸脈衝建模為一組射線,並使用類似體渲染技術。

考慮不返回任何點的雷射光束射線。如果返回功率過低,就會出現一種現象,稱為射線降落,這對於減少模擬-實際差異的建模非常重要[21]。通常,這樣的光線傳播得很遠而不會碰到表面,或碰到光束反彈到空地上的表面,例如鏡子、玻璃或潮濕的路面。對這些影響進行建模對於感測器真實模擬很重要,但如[14]所述,很難完全基於物理來捕捉,因為它們依賴(通常未公開的)低層感測器檢測邏輯的細節。因此,選擇從數據中學習光線降落。與強度類似,可體渲染光線特徵,並將其透過小MLP來預測光線下降機率pd(r)。請注意,與[14]不同的是,不對雷射雷達光束的二次回波進行建模,因為實驗中五個資料集中不存在此資訊。

將神經特徵場(NFF)的定義擴展為學習函數(s,f)=NFF(x,t,d),其中x是空間座標,t表示時間, d表示視角方向。這個定義引入了時間作為輸入,對於場景的動態方面建模至關重要

NFF架構遵循NeRF[4,27]中公認的最佳方法。給定位置x和時間t,查詢行動者-覺察哈希編碼。然後,這種編碼輸入到一個小MLP中,該感知器計算有符號距離s和中間特徵g。以球諧波[27]對視圖方向d進行編碼,使模型能夠捕捉反射和其他與視圖相關的效果。最後,透過第二個MLP聯合處理方向編碼和中間特徵,以g的跳躍連接來增強,從而產生特徵f。

與先前的工作[18, 29, 46, 47]相似,我們將世界分為兩個部分,即靜態背景和一組剛性動態行動者,每個行動者由一個3D邊框和一組SO(3)姿態來定義。我們提供了雙重目的:簡化學習過程,並允許一定程度的可編輯性,在訓練後可以動態行動者產生新場景。不同於先前的方法將不同場景元素使用單獨的NFF,我們使用單一統一NFF,其中所有網路都是共享的,靜態和動態組件之間的區別由行動者-覺察的哈希編碼透明處理。編碼策略很簡單:根據給定樣本(x,t)是否位於行動者邊框內,用兩個函數中的一個對其進行編碼

使用多解析度哈希網格來表示靜態場景已被證明是一種高度表達和高效的表示方法。然而,為了將無界場景映射到網格上,我們採用了MipNerf-360中提出的收縮方法。這種方法可以用單一哈希網格精確地表示附近的道路元素和遠處的雲。與此相比,現有的方法利用專用的NFF來捕捉天空和其他遙遠的區域

當樣本(x,t)落在行動者的邊框內時,其空間座標x和視角方向d在給定時間t轉換到行動者的座標系。忽略之後的時間方面,並從與時間無關的多重解析度雜湊網格中取樣特徵,就像靜態場景一樣。簡單地說,需要分別對多個不同的哈希網格進行採樣,每個行動者都是一個。然而,轉而使用單一4D哈希網格,其中第四個維度對應於行動者索引。這種方法允許並行地對所有行動者特徵進行採樣,在匹配單獨哈希網格性能的同時實現顯著的加速。

將神經渲染應用於汽車資料的最大挑戰之一是處理這些資料中存在的多個細節級別。當汽車行駛很長距離時,無論是遠處還是近距離,都會看到許多表面。在這種多尺度的情況下,簡單地應用iNGP[27]或NeRF的位置嵌入會導致混疊偽影[2]。為了解決這個問題,許多方法將射線建模為截錐體,截錐體的縱向由bin的大小決定,徑向由像素面積和與感測器的距離決定[2,3,13]

Zip-NeRF[4]是目前iNGP雜湊網格的唯一抗混疊(anti-aliasing)方法,它結合了兩種截頭體建模技術:多重取樣和降低權重。在多重採樣中,將截頭體多個位置的位置嵌入進行平均,捕捉縱向和徑向範圍。對於降低權重,每個樣本都被建模為各向同性高斯,網格特徵的權重與單元(cell)大小和高斯方差之間比例成比,從而有效地抑制更精細的分辨率。雖然組合技術顯著提高了效能,但多重取樣也顯著增加了運行時間。所以本文目標是以最小的運行影響結合規模資訊。受Zip-NeRF的啟發,作者提出了一種直觀的降低權重方案,根據哈希網格特徵相對於截頭體的大小對其進行權重降低。

渲染大規模場景的另一個困難是需要高效率的取樣策略。在一張圖像中,可能想在附近的交通標誌上渲染詳細的文本,同時捕捉幾公里外摩天大樓之間的視差效果。為了實現這兩個目標,對射線進行均勻採樣將需要每條射線數千個樣本,這在計算上是不可行的。先前的工作在很大程度上依賴雷射雷達資料來修剪樣本[47],因此很難在雷射雷達的工作之外進行渲染。

相反,本文根據冪函數[4]沿著射線渲染樣本,使得樣本之間的空間隨著與射線原點的距離而增加。即便如此,不可能在樣本數量急劇增加的情況下滿足所有相關條件。因此,也採用兩輪的提議採樣(proposal sampling)[25],其中查詢NFF(neural feature field)的輕量級版本,產生沿射線的權重分佈。然後,根據這些權重渲染一組新的樣本。經過兩輪這個過程後,得到了一組精細的樣本,這些樣本集中在射線上的相關位置,可以用來查詢全尺寸NFF。為了監督所提出的網絡,採用了一種抗混疊的在線蒸餾方法[4],並進一步使用雷射雷達進行監督。

在基於NeRF的標準公式中,假設每個影像都是從一個原點o捕獲的。然而,許多相機感光元件都有滾動快門,即像素行是按順序捕獲的。因此,相機感測器可以在第一行的捕獲和最後一行的捕獲之間移動,打破了單一原點的假設。雖然合成資料[24]或慢速手持相機拍攝的資料不是問題,但滾動快門在快速移動車輛的拍攝中變得明顯,尤其是側面相機。同樣的影響也存在於光達中,每次掃描通常在0.1s內收集,當以高速公路速度行駛時,這相當於幾公尺移動。即使對於自我運動補償的點雲,這些差異也可能導致有害的視線誤差,即3D點轉化為穿過其他幾何的射線。為了減輕這些影響,為每條光線指定單獨的時間並根據估計的運動調整其原點,以便對滾動快門進行建模。由於滾動快門會影響場景的所有動態元素,因此會對每個單獨的光線時間,行動者姿態做線性插值。

模擬自動駕駛序列時的另一個問題是,影像來自不同的相機,具有潛在的不同捕獲參數,如曝光。在這裡,從「NeRFs in the wild」[22]的研究中獲得了靈感,其中為每個圖像學習外觀嵌入,並與其特徵一起傳遞到第二個MLP。然而,當知道哪個影像來自哪個感測器時,反而為每個感測器學習單一嵌入,從而最大限度地減少過擬合的可能性,並允許在生成新視圖時使用這些感測器嵌入。當渲染特徵而不是顏色時,在體渲染後應用這些嵌入,顯著減少了計算開銷。

模型依賴對動態行動者姿態的估計,無論其是以註釋的形式還是作為跟踪輸出。為了解決缺陷,將行動者姿態作為可學習的參數納入模型中,並對其進行聯合優化。姿態參數化為平移t和旋轉R,以6D-表示[50]。

NeuRAD是在Nerfstudio[33]開源專案中實現的。使用Adam[17]優化器進行20000次迭代的訓練。在一台英偉達A100上,訓練約1小時

重現UniSim:UniSim[47]是一種神經閉環感測器模擬器。它具有逼真的渲染效果,對可用的監督幾乎沒有任何假設,即它只需要相機圖像、光達點雲、感測器姿態和帶有動態行動者軌蹟的3D邊框。這些特性使UniSim成為一個合適的基線,因為它很容易應用於新自動駕駛資料集。然而,該代碼是封閉原始碼,也沒有非官方的實作。因此,本文選擇重新實作UniSim,作為自己的模型,在Nerfstudio[33]中這樣實現。由於UniSim的主要文章沒有詳細說明許多模型細節,只能依賴IEEE Xplore提供的補充資料。儘管如此,一些細節仍然是未知的,作者已經調整了這些超參數,匹配10個選定PandaSet[45]序列的報告性能。

以上是NeuRAD:領先多資料集的神經渲染技術在自動駕駛的應用的詳細內容。更多資訊請關注PHP中文網其他相關文章!