Pertama daripada semua Mari perkenalkan senario yang terlibat dalam artikel ini - senario "barangan bagus tersedia". Lokasinya adalah dalam grid empat persegi pada laman utama Taobao, yang dibahagikan kepada halaman pemilihan satu lompatan dan halaman penerimaan dua lompatan. Terdapat dua bentuk utama halaman pengehosan, satu ialah halaman pengehosan grafik dan teks, dan satu lagi ialah halaman pengehosan video pendek. Matlamat senario ini adalah terutamanya untuk menyediakan pengguna dengan barangan yang memuaskan dan memacu pertumbuhan GMV, seterusnya memanfaatkan bekalan pakar.

Seterusnya fokus artikel ini, bias populariti. Apakah bias populariti? Mengapa bias populariti berlaku?

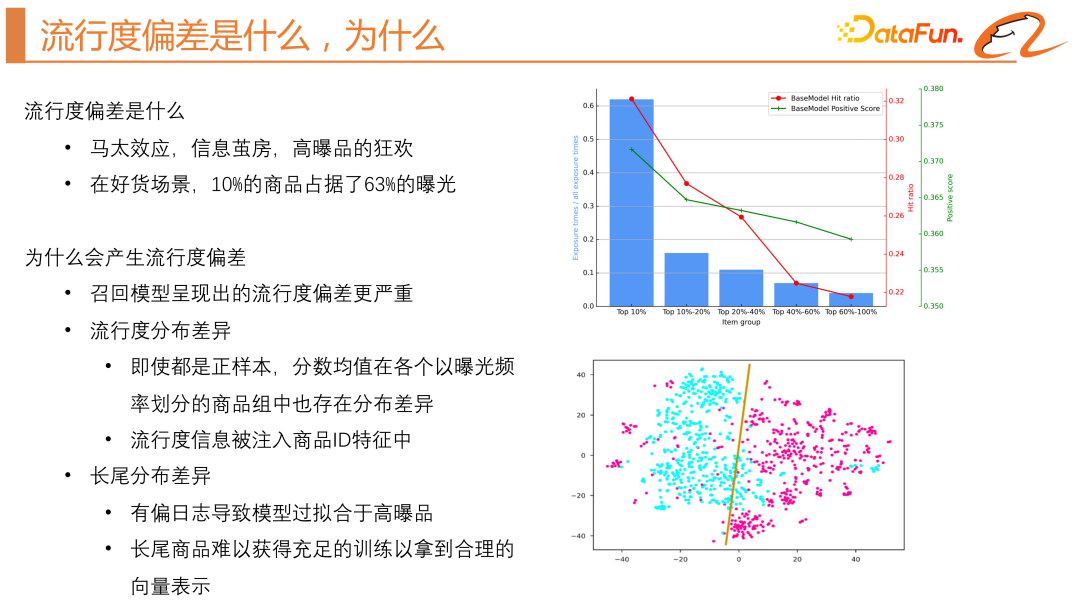

Seperti yang dapat dilihat dari histogram biru di sebelah kanan gambar di atas, 10% produk terdedah teratas menyumbang 63% daripada pendedahan pada hari tertentu, yang membuktikan bahawa dalam The Matthew effect sangat serius apabila ada barang yang baik. 2 Mengapakah kecenderungan populariti berlaku? Pertama, kita perlu menjelaskan sebab kita melakukan kerja mengurangkan berat sebelah populariti dalam pemangkasan ingat. Model ranking sesuai dengan CTR produk, dan sampel latihannya termasuk sampel positif dan sampel negatif Produk dengan CTR yang lebih tinggi lebih berkemungkinan mendapat pendedahan. Tetapi dalam peringkat penarikan semula, kami biasanya menggunakan model menara berkembar biasanya dijana dalam dua cara Yang pertama ialah pensampelan negatif rawak global, dan yang kedua ialah persampelan negatif intra-batch sama Satu kumpulan mengambil log pendedahan sampel positif yang lain sebagai sampel negatif, jadi ia boleh mengurangkan kesan Matthew pada tahap tertentu. Walau bagaimanapun, melalui eksperimen, kami mendapati bahawa kesan kecekapan dalam talian sebenar persampelan negatif global akan menjadi lebih baik. Walau bagaimanapun, pensampelan negatif rawak global dalam sistem pengesyor mungkin membawa kepada kecenderungan populariti kerana ia hanya memberikan maklum balas positif kepada model. Bias ini mungkin dikaitkan dengan perbezaan pengedaran populariti dan gangguan pengetahuan terdahulu, iaitu, pengguna cenderung mengklik pada item yang lebih popular. Oleh itu, model mungkin mengesyorkan item popular tanpa mengira kaitannya.

Kami

juga menganalisis perbezaan dalam taburan populariti, seperti yang ditunjukkan dalam garisan hijau di sebelah kanan rajah di atas, dengan mengumpulkan produk mengikut kekerapan pendedahan mereka Mengira skor purata sampel positif bagi setiap kumpulan, didapati walaupun semua sampel adalah sampel positif, skor purata berkurangan dengan kekerapan pendedahan. Terdapat perbezaan dalam pengedaran populariti dan pengedaran ekor panjang apabila model sistem pengesyoran latihan. Model ini akan cenderung untuk menyuntik maklumat populariti ke dalam ciri ID item, mengakibatkan perbezaan dalam pengedaran populariti. Bilangan masa latihan yang diperolehi oleh produk letupan tinggi adalah jauh lebih besar daripada produk ekor panjang, menjadikan model terlalu muat untuk produk letupan tinggi, dan sukar untuk produk ekor panjang mendapatkan latihan yang mencukupi dan vektor yang munasabah perwakilan. Seperti yang ditunjukkan dalam carta TSN di sebelah kanan rajah di atas, titik biru mewakili vektor produk produk pendedahan tinggi, manakala titik merah mewakili vektor produk produk ekor panjang, menunjukkan perbezaan yang ketara dalam pengedaran. Dan seperti yang ditunjukkan dalam garis merah di sebelah kanan rajah di atas, nisbah hit juga akan berkurangan apabila bilangan pendedahan berkurangan. Oleh itu, kami mengaitkan kecenderungan populariti kepada perbezaan dalam taburan populariti dan perbezaan taburan ekor panjang.

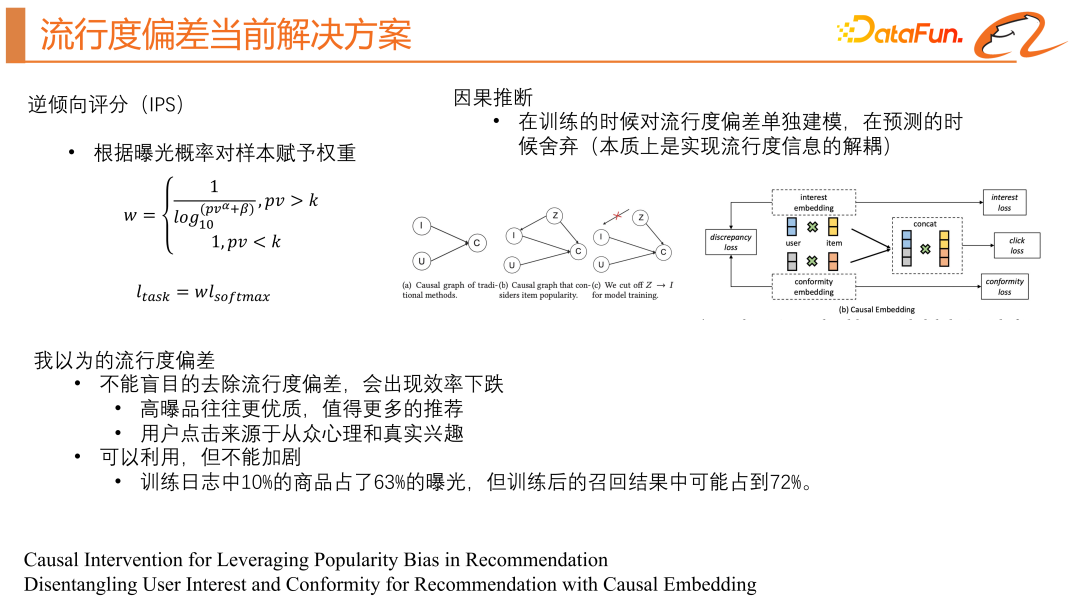

Penyelesaian semasa dalam industri Terdapat dua jenis utama iaitu skor kecenderungan songsang (IPS) dan inferens sebab akibat.

Dalam istilah orang awam, ia bermaksud menurunkan berat produk kebarangkalian pendedahan tinggi dalam fungsi kehilangan tugas utama untuk Elakkan memberi terlalu banyak perhatian kepada produk dengan kebarangkalian pendedahan yang tinggi, supaya anda boleh memberi perhatian yang lebih sama kepada keseluruhan pengedaran sampel positif. Walau bagaimanapun, kaedah ini memerlukan meramalkan kebarangkalian pendedahan terlebih dahulu, yang tidak stabil dan terdedah kepada kegagalan atau turun naik yang besar.

Kita perlu membina rajah sebab, di mana i mewakili ciri produk dan u mewakili Ciri pengguna, c mewakili kebarangkalian klik Gambar ini menunjukkan bahawa ciri pengguna dan ciri produk adalah input kepada model untuk meramalkan kadar klik. Jika kita juga mengambil berat sebelah populariti ke dalam model ini, yang diwakili oleh z, ia bukan sahaja akan menjejaskan kadar klikan, tetapi juga mempengaruhi perwakilan ciri produk i Kaedah inferens sebab adalah untuk cuba menyekat kesan daripada z pada i.

Kaedah yang lebih mudah ialah menggunakan beberapa ciri statistik produk untuk mendapatkan menara bias yang berasingan Pada masa ini, model akan mengeluarkan dua mata, satu adalah kadar klikan sebenar , dan satu lagi ialah skor populariti produk Apabila membuat ramalan dalam talian, skor populariti produk akan dialih keluar untuk mencapai penyahgandingan sisihan populariti.

Kaedah kedua ialah mengaitkan klik pengguna kepada dua kategori, satu minat kumpulan dan satu lagi minat sebenar, dan membina latihan bersama sampel masing-masing. Ia bersamaan dengan mendapatkan dua model, satu model untuk mendapatkan skor minat kumpulan pengguna, dan satu model untuk mendapatkan skor minat sebenar pengguna. Sebenarnya terdapat masalah dengan inferens sebab Ia menyelesaikan perbezaan dalam pengedaran populariti, tetapi ia tidak dapat menyelesaikan masalah kekurangan data latihan untuk produk ekor panjang. Penyelesaian semasa cenderung untuk menghapuskan kecenderungan populariti, tetapi ini mungkin tidak selalunya bermanfaat untuk sistem pengesyor yang memerlukan "Kesan Matthew" untuk terus hidup. Oleh itu, kami mengesyorkan agar tidak membuang berat sebelah populariti sepenuhnya dalam sistem pengesyoran, kerana item popular biasanya mempunyai kualiti yang lebih tinggi, dan pengguna juga mempunyai kedua-dua mentaliti kumpulan dan minat sebenar Mengalih keluar berat sebelah populariti sepenuhnya akan menjejaskan kepuasan minat kumpulan pengguna . Bias populariti harus digunakan secara rasional dan tidak diburukkan lagi.

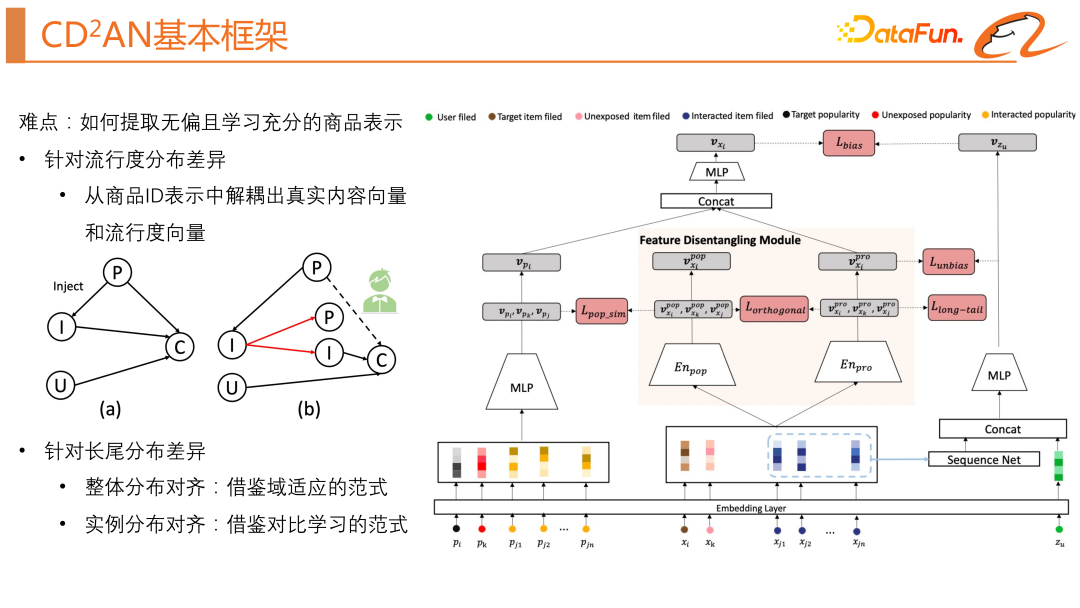

Kerja yang kami terokai kali ini ialah cara menggunakan bias populariti secara munasabah Untuk menggunakan kecenderungan populariti secara munasabah, kami perlu menyelesaikan masalah: "Bagaimana untuk mengekstrak perwakilan produk yang tidak berat sebelah dan dipelajari sepenuhnya." pengedaran, kita perlu memisahkan vektor kandungan sebenar dan vektor populariti daripada ID produk. Untuk menangani perbezaan pengedaran ekor panjang, kami menggunakan paradigma penyesuaian domain untuk menyelaraskan pengedaran keseluruhan dan menggunakan paradigma pembelajaran kontrastif untuk menyelaraskan pengedaran contoh.

Mari kita perkenalkan struktur asas model asas Model asas sebenarnya adalah model menara berkembar klasik. Seterusnya, kami akan memperkenalkan secara terperinci bagaimana kami menyelesaikan dua masalah yang dinyatakan sebelum ini (perbezaan pengedaran populariti dan perbezaan pengedaran ekor panjang).

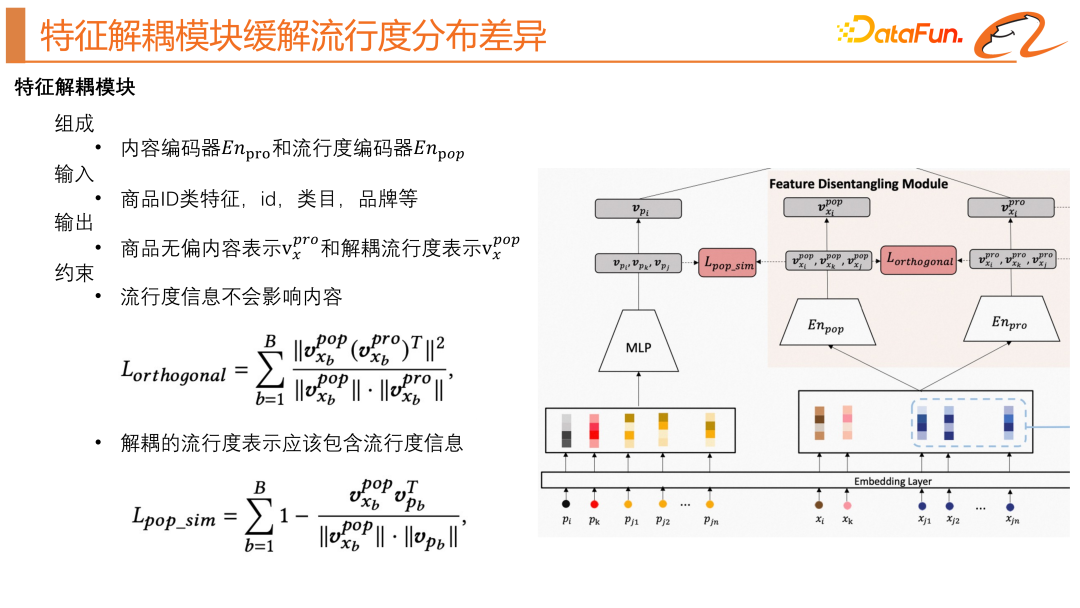

Modul penyahgandingan ciri ialah penyelesaian yang dicadangkan dalam artikel ini untuk menangani masalah berat sebelah populariti dalam sistem pengesyoran. Modul ini mengurangkan kesan populariti pada perwakilan vektor item dengan memisahkan maklumat populariti daripada maklumat atribut dalam perwakilan vektor item. Khususnya, modul ini termasuk pengekod populariti dan pengekod atribut, serta mempelajari atribut dan perwakilan vektor populariti bagi setiap item melalui gabungan perceptron berbilang lapisan. Input modul ini ialah ciri atribut item, seperti ID item, kategori item, jenama, dll., seperti yang ditunjukkan di bahagian kanan struktur model di atas. Terdapat dua kekangan di sini, termasuk penyelarasan ortogon dan penyelarasan persamaan populariti, bertujuan untuk memisahkan maklumat populariti daripada maklumat atribut item. Antaranya, melalui regularization persamaan populariti, modul digalakkan untuk menyelaraskan maklumat populariti yang tertanam dalam atribut item dengan maklumat populariti sebenar, manakala melalui regularization ortogonal, modul digalakkan untuk mengekalkan maklumat yang berbeza dalam pengekodan, dengan itu mencapai maklumat ijazah populariti yang berasingan. dan maklumat atribut item.

Kami juga memerlukan modul untuk mempelajari populariti sebenar, seperti yang ditunjukkan di bahagian kiri struktur model di atas, inputnya adalah terutamanya ciri statistik bagi produk. Kemudian pergi melalui MLP untuk mendapatkan perwakilan populariti sebenar.

Seterusnya, kami ingin menyelesaikan masalah perbezaan pengedaran ekor panjang.

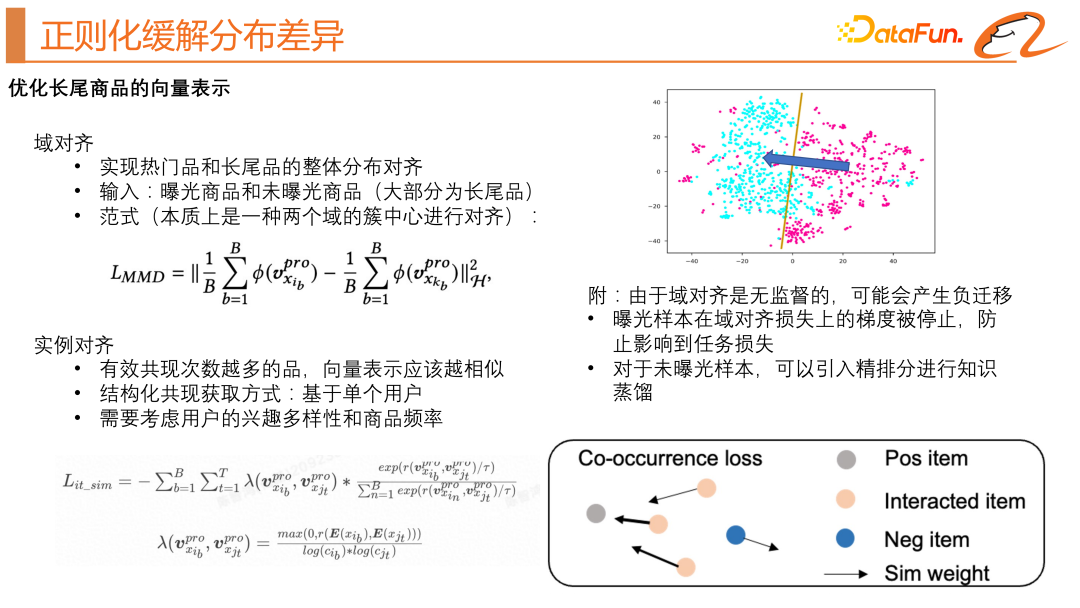

Kami menggunakan idea pemindahan pembelajaran untuk mencapai penjajaran pengedaran produk popular dan produk ekor panjang. Dalam model dua menara asal, kami memperkenalkan produk yang tidak terdedah dan menggunakan fungsi kehilangan MMD (seperti yang ditunjukkan di sebelah kiri atas rajah di atas). domain produk adalah sedekat mungkin, seperti yang ditunjukkan di atas Seperti yang ditunjukkan dalam rajah skematik di sebelah kanan atas rajah. Oleh kerana penjajaran domain jenis ini tidak diawasi dan mungkin menghasilkan pemindahan negatif, kami telah membuat pengoptimuman berikut: kecerunan sampel terdedah pada kehilangan penjajaran domain dihentikan untuk mengelakkannya daripada menjejaskan kehilangan tugasan bagi sampel yang tidak terdedah, kedudukan yang baik adalah diperkenalkan. Kami juga menggunakan idea penjajaran contoh, dengan harapan dapat mempelajari perwakilan vektor produk yang lebih baik. Idea utama ialah semakin berkesan kejadian bersama produk, semakin serupa perwakilan vektor. Kesukaran di sini ialah bagaimana untuk membina pasangan. Pasangan sedemikian wujud secara semula jadi dalam jujukan produk di mana pengguna mempunyai tingkah laku lampau. Mengambil pengguna sebagai contoh, sampel mengandungi urutan tingkah laku pengguna dan produk sasaran Kemudian produk sasaran dan setiap produk dalam jujukan tingkah laku pengguna boleh membentuk pasangan yang berlaku bersama. Berdasarkan fungsi kehilangan pembelajaran kontrastif klasik, kami juga mempertimbangkan kepelbagaian minat pengguna dan kekerapan produk Formula fungsi kerugian khusus boleh dilihat di bahagian kiri bawah rajah di atas.

Kita boleh melihat gambar rajah skema intuitif, seperti yang ditunjukkan di bahagian bawah sebelah kanan rajah di atas Titik kelabu ialah produk sasaran, titik oren ialah jujukan tingkah laku pengguna dan titik biru ialah negatif. nilai yang diperolehi oleh sampel negatif rawak kami. Kami berharap dapat belajar daripada kaedah pembelajaran kontrastif untuk mengekang setiap produk dalam urutan tingkah laku pengguna agar hampir dengan produk sasaran.

3. Latihan bersama berat sebelah dan tidak berat sebelah

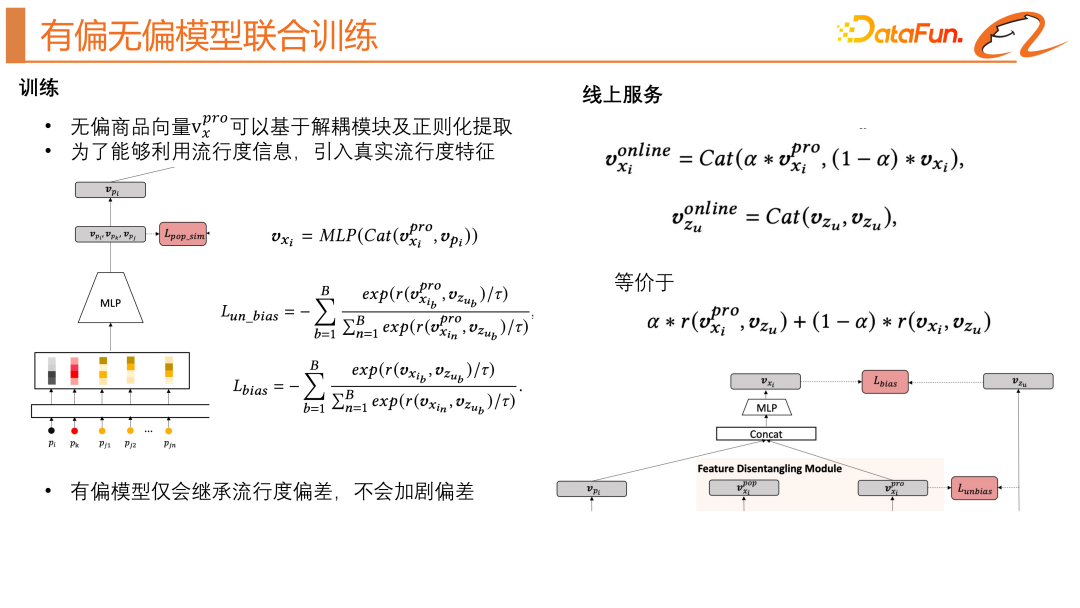

Modul di atas adalah sah Kami telah memperoleh perwakilan kandungan yang tidak berat sebelah dan representasi populariti produk yang dipisahkan. Bagaimanakah kita harus menggunakannya? Kami menggunakan kaedah latihan bersama model tidak berat sebelah dan model berat sebelah Vektor produk tidak berat sebelah boleh diekstrak berdasarkan modul penyahgandingan dan penyelarasan Untuk dapat menggunakan maklumat populariti, kami juga memperkenalkan ciri populariti, dan model berat sebelah akan hanya mewarisi bias Populariti tidak memburukkan lagi berat sebelah. Untuk bahagian perkhidmatan dalam talian, seperti yang ditunjukkan di sebelah kanan rajah di atas, kami menggabungkan perwakilan produk tidak berat sebelah dan perwakilan produk berat sebelah melalui parameter α untuk mendapatkan perwakilan produk dalam talian, supaya produk boleh dipanggil semula melalui vektor pengguna α ini ialah pelarasan Ingat sejauh mana perhatian diberikan kepada maklumat populariti.

4. Luar Talian dan percubaan dalam talian

Gambar di atas menunjukkan kesan luar talian dan dalam talian model ini. Dalam percubaan luar talian, kami memperkenalkan penunjuk C-Nisbah untuk mengukur bilangan item dalam hasil penarikan semula adalah item yang sangat terdedah. Melalui percubaan luar talian, kita dapat melihat bahawa setiap modul menyumbang pada tahap tertentu. Model tidak berat sebelah tidak mendapat keuntungan dalam penunjuk kecekapan dalam talian, menunjukkan bahawa maklumat populariti berguna, dan kami masih perlu menggunakan model berat sebelah untuk menggunakan maklumat populariti.

Akhir sekali, kami membuat paparan visual hasil model. Kami mendapati bahawa struktur model baharu sememangnya boleh menyelaraskan pengedaran produk letupan tinggi dan produk ekor panjang Vektor perwakilan populariti yang dipisahkan dan perwakilan kandungan produk yang tidak berat sebelah hampir tidak mempunyai persimpangan, dan produk dengan tujuan yang sama boleh menjadi lebih banyak. berkait rapat Dengan melaraskan α, model boleh menyesuaikan minat berikut dan minat sebenar pengguna.

Tajuk kertas kerja yang dikongsi hari ini ialah "Latihan Bersama Rangkaian Penyesuaian Domain Terpisah untuk Memanfaatkan Bias Populariti dalam Pengesyor".

A1: Dihasilkan di luar talian, kita boleh mendapatkan sampel positif sasaran dan kategori yang sepadan, dan kemudian sampel secara rawak dan sasaran sampel positif di luar talian kategori yang sama dilampirkan pada sampel latihan.

A2: Sampel yang tidak terdedah yang diperkenalkan tidak mempunyai label dan diedarkan dalam cara yang tidak diselia. Kami menggunakan dua teknik untuk menyelesaikan masalah ini: Kecerunan sampel terdedah pada penjajaran domain kehilangan dihentikan untuk mengelakkan menjejaskan kehilangan tugasan untuk sampel yang tidak terdedah, kedudukan yang baik boleh diperkenalkan untuk penyulingan pengetahuan.

A3: Gunakan model kedudukan yang baik untuk menjaringkan sampel di luar talian dan gunakannya sebagai ciri prestasinya.

J4: Tidak, terdapat kebarangkalian tinggi bahawa ini masih merupakan item yang boleh meletup tinggi Kami menggunakan keputusan persampelan rawak di bawah kategori global yang sama.

Atas ialah kandungan terperinci Rahsia Pengesyoran Tepat: Penjelasan Terperinci mengenai Model Pengingatan Tanpa Pinggir Adaptasi Domain Dipisahkan Alibaba. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Apakah yang dimaksudkan apabila mesej telah dihantar tetapi ditolak oleh pihak lain?

Apakah yang dimaksudkan apabila mesej telah dihantar tetapi ditolak oleh pihak lain?

oicq

oicq

penggunaan fungsi isnumber

penggunaan fungsi isnumber

Perkara yang perlu dilakukan jika Linux meminta Tiada fail atau direktori sedemikian semasa melaksanakan fail

Perkara yang perlu dilakukan jika Linux meminta Tiada fail atau direktori sedemikian semasa melaksanakan fail

Antivirus telefon mudah alih Apple

Antivirus telefon mudah alih Apple

apa itu xfce

apa itu xfce

Apakah kegunaan suis kvm?

Apakah kegunaan suis kvm?

Muat turun dan pemasangan rasmi aplikasi Euro-Italian Exchange

Muat turun dan pemasangan rasmi aplikasi Euro-Italian Exchange