海外メディア The Intercept の報道によると、OpenAI は最近、その使用ポリシーを若干調整し、軍事目的でのテクノロジーの使用を明示的に禁止する文言を削除しました。この動きは懸念と論争を引き起こした。

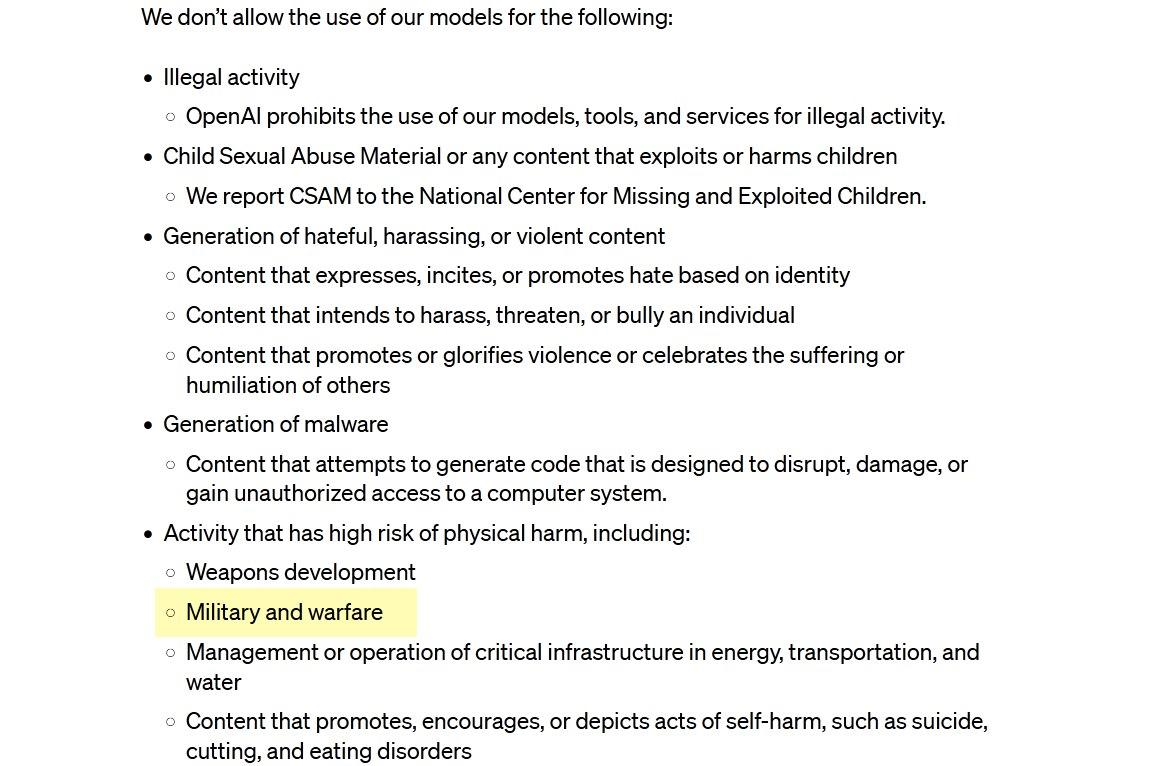

報告書は、OpenAIの利用方針に、特に兵器開発、軍事、軍事分野など「重大な身体的危害を引き起こす可能性がある」活動の禁止が依然として含まれていることが現地時間1月10日に明らかになったと指摘している。戦争。

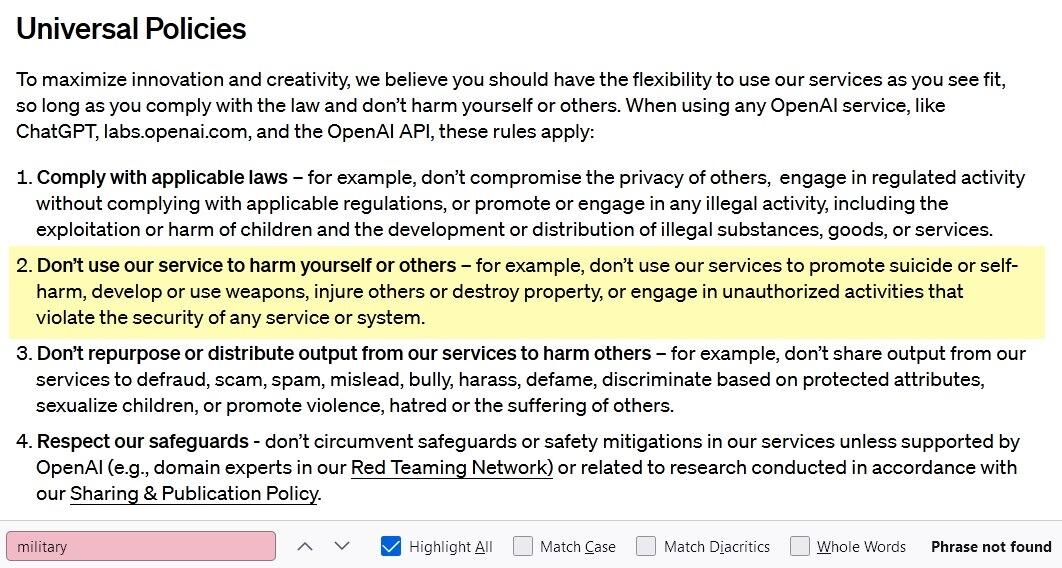

このサイトに添付されている写真: 上の写真は修正前、下の写真は修正後です。

ただし、新しいポリシーでは、「自分自身や他人に危害を加えるためにそのサービスを使用する」ことの禁止は維持され、「開発または使用する」で終わります。たとえば、「武器。」などですが、「軍事と戦争」に関するより包括的な禁止はもはや存在しません。

OpenAI は、この変更の目的はテキストを「より明確で読みやすくすること」であると主張しましたが、同社の広報担当ニック・フェリックス氏はメディアに「私たちの目標は、一連の共通の原則を作成することです。『他人に危害を与えない』などの原則は幅広く、多くの状況に関連しており、私たちは明白な例として特に武器や他人への危害を挙げています。 「禁止はすべての軍事用途を対象としています。 OpenAIの広報担当者はこれに対して次のように書いている:軍事での使用を含む当社のテクノロジーを使用して、武器を「開発」または「使用」したり、他人に危害を加えたり財産に損害を与えたり、サービスやシステムのセキュリティを侵害する無許可の活動に従事したりする者は、は許可されていません。

このレポートは、サイバーセキュリティ企業Trail of Bitsのエンジニアリングディレクターであり、機械学習と自律システムセキュリティの専門家であるハイディ・クラフ氏の発言を引用し、OpenAIは自社のテクノロジーとサービスを次の分野で使用することで起こり得る結果を十分に認識していると述べています。新しい使用ポリシーは、「安全性」よりも「合法性」を重視しているようです。以上がOpenAIはひそかに利用ポリシーを更新し、「軍事および戦争目的でテクノロジーを使用することは固く禁じられています」という条項を削除したの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。