IT ホーム 7 月 11 日のニュースによると、Wang Xiaochuan の子会社である Baichuan Intelligence は本日、「130 億パラメータのオープンソースで商用利用可能」として知られる Baichuan-13B 大型モデルをリリースしました。

▲ 画像ソース Baichuang-13B GitHub ページ

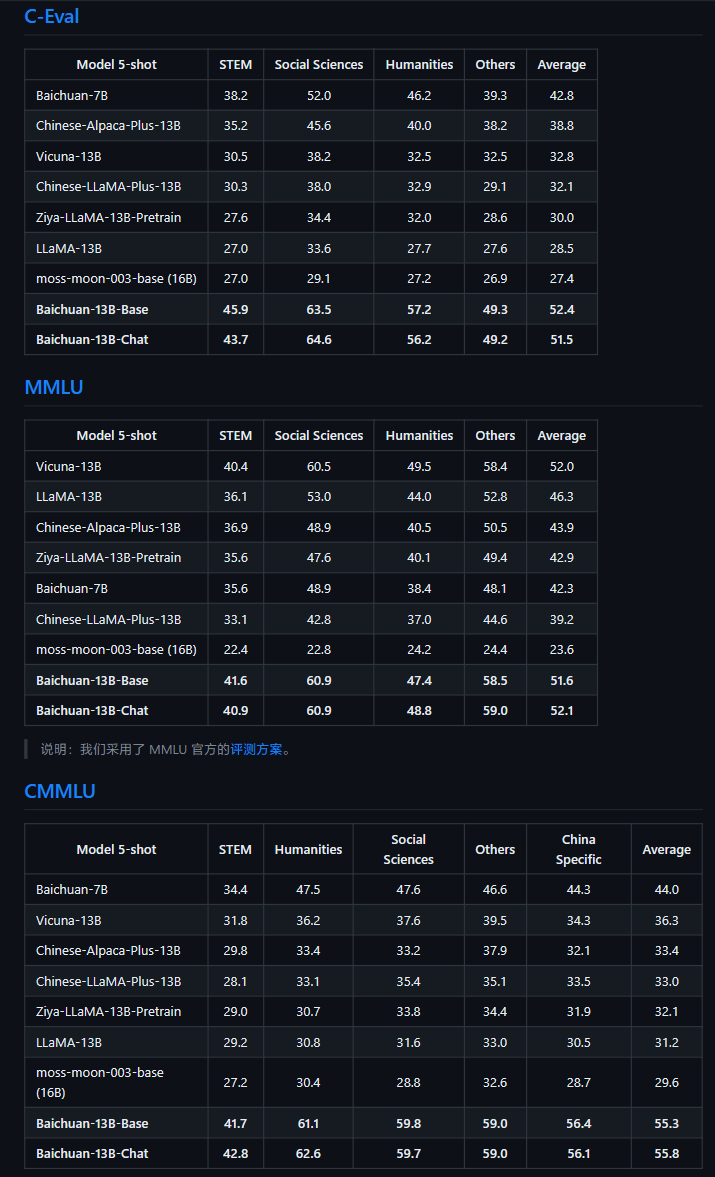

公式の紹介によると、Baichuan-13B は、Baichuan-7B の後に Baichuan Intelligent によって開発された、130 億個のパラメータを含むオープンソースの商用利用可能な大規模言語モデルであり、両方の同じサイズのモデルの中で最高の結果を達成しています。中国語と英語のベンチマーク。このリリースには、事前トレーニング (Baichuan-13B-Base) と調整 (Baichuan-13B-Chat) の 2 つのバージョンが含まれています。

▲ 画像ソース Baichuang-13B GitHub ページ

Baichuan-13B には次の特徴があると公式に主張されています:

- より大きなサイズ、より多くのデータ: Baichuan-13B は、Baichuan-7B に基づいてパラメーターの数をさらに 130 億に拡張し、高品質のコーパスで 1 兆 4000 億のトークンをトレーニングします。これは、LLaMA-13B を 40% 上回ります。 13B サイズで最大量のトレーニング データを備えたオープン ソース モデル。中国語と英語のバイリンガルをサポートし、ALiBi 位置エンコーディングを使用し、コンテキスト ウィンドウの長さは 4096 です。

- オープンソースの事前トレーニングモデルとアライメントモデルを同時に提供: 事前トレーニングモデルは開発者にとっての「ベース」ですが、大多数の一般ユーザーは対話機能を備えたアライメントモデルに対する強いニーズを持っています。したがって、このプロジェクトには、強力な会話機能を備えた調整モデル (Baichuan-13B-Chat) も含まれており、すぐに使用でき、数行のコードで簡単に導入できます。

- より効率的な推論: より幅広いユーザーの使用をサポートするために、プロジェクトは int8 と int4 の量子化バージョンもオープンソース化しました。非定量化バージョンと比較して、デプロイメント マシンのリソースしきい値が大幅に削減されます。効果の損失がほとんどなく、NVIDIA RTX3090 などのコンシューマーグレードのグラフィックス カードに導入できます。

- オープンソース、商用利用は無料: Baichuan-13B は学術研究に完全に公開されているだけでなく、開発者は電子メールで申請して正式な商用ライセンスを取得した後、無料で使用することもできます。

現在、このモデルは HuggingFace、GitHub、Model Scope で公開されているので、興味のある IT House の友人はアクセスして詳細を学ぶことができます。

以上がBaichuan Intelligent は Baichuan-13B AI モデルをリリースし、「130 億のパラメータがオープンソースで商用利用可能」と主張の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。