中山大学のヒューマン コンピュータ インテリジェンス融合研究室 (HCP) は、AIGC とマルチモーダル大規模モデルで実りある成果を上げており、最近の AAAI 2023 と CVPR 2023 で 10 以上の論文に選ばれました。 、世界的な研究機関の中でのランキングの第一階層。

作業の 1 つは、調整におけるマルチモーダル大規模モデルの制御性と一般化を大幅に向上させる因果モデルの使用を実現しています - 「マスクされた画像は、ロバストな微調整のための反事実のサンプルです」 」。

リンク: https://arxiv.org/abs/2303.03052

#事前トレーニングされた大規模モデルを使用して下流タスクを微調整することは、現在一般的な深層学習パラダイムです。特に、大規模な事前トレーニング済み言語モデルである ChatGPT の最近の優れたパフォーマンスにより、この技術パラダイムが広く認識されるようになりました。大量のデータを使用して事前トレーニングした後、これらの大規模な事前トレーニングされたモデルは、実際の環境で変化するデータ分布に適応できるため、一般的なシナリオで強力な堅牢性を示します。ただし、事前トレーニングされた大規模モデルが、特定のアプリケーション タスクに適応するために下流のシナリオ データを使用して微調整される場合、ほとんどの場合、これらのデータは単一です。これらのデータを使用して事前トレーニングされた大規模モデルを微調整すると、モデルの堅牢性が低下することが多く、事前トレーニングされた大規模モデルに基づいて適用することが困難になります。特に視覚モデルに関しては、画像の多様性が言語をはるかに超えているため、下流の微調整トレーニングが視覚関連の事前トレーニング済み大規模モデルのロバスト性の低下につながる問題が特に顕著です。

これまでの研究手法では、通常、モデル統合やその他の手法を通じて、微調整された事前トレーニング済みモデルの堅牢性がモデル パラメーター レベルで暗黙的に維持されていました。しかし、これらの研究では、微調整がモデルの分散外パフォーマンス低下につながる本質的な理由は分析されておらず、大規模モデルの微調整後のロバスト性の低下という前述の問題も明確に解決されていませんでした。

この研究は、クロスモーダル大規模モデルに基づいており、事前トレーニングされた大規模モデルのロバスト性損失の本質的な理由を因果関係の観点から分析し、それに応じて、モデルの堅牢性を大幅に向上させる微調整トレーニング方法。この方法により、モデルは下流のタスクに適応しながら強力な堅牢性を維持できるようになり、実際のアプリケーションのニーズをより適切に満たすことができます。

OpenAI が 2021 年にリリースしたクロスモーダル事前トレーニング大規模モデル CLIP (Contrastive Language-Image Pre-training) を例に挙げます。CLIP はコントラストベースの画像テキストです。 Union 学習済みクロスモーダル事前トレーニング済み大規模モデルは、安定拡散などの生成モデルの基礎となります。このモデルは、約 4 億の画像とテキストのペアを含む大規模なマルチソース データでトレーニングされ、分布の変化に対してある程度頑健ないくつかの因果関係を学習します。

ただし、単一特徴のダウンストリーム データを使用して CLIP を微調整する場合、モデルによって学習された因果関係の知識が簡単に破壊されます。調教画像は高度に絡み合っています。たとえば、CLIP モデル転送を「農場」の下流シナリオに適用すると、トレーニング画像の多くには草の中の「牛」が表示されます。この時点で、微調整トレーニングにより、モデルが画像の意味を予測するために草の非「牛」意味表現に依存することを学習できる可能性があります。ただし、この相関関係は必ずしも正しいとは限りません。たとえば、道路上に「牛」が出現する場合もあります。したがって、モデルを微調整してトレーニングした後は、その堅牢性が低下し、適用中の出力結果が非常に不安定になり、制御性が欠如する可能性があります。

チームの大規模モデルの構築とトレーニングにおける長年の経験に基づいて、この研究では、事前トレーニングされたモデルの微調整によって引き起こされる堅牢性の低下の問題を、次の観点から再検討します。因果関係。この研究では、因果モデリングと分析に基づいて、画像マスクに基づいて反事実サンプルを構築し、マスク画像学習を通じてモデルの堅牢性を向上させる微調整トレーニング方法を提案します。

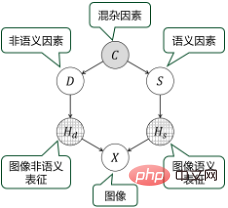

具体的には、下流のトレーニング画像の偽の相関を打ち破るために、この研究では、画像の特定の領域の内容をマスクして置き換えるクラス アクティベーション マップ (CAM) ベースの方法を提案しています。画像の非意味表現または意味表現を操作して反事実サンプルを生成する。微調整されたモデルは、蒸留を通じて事前トレーニングされたモデルによるこれらの反事実サンプルの表現を模倣することを学習でき、それによって意味論的要因と非意味論的要因の影響をより適切に分離し、下流分野での分布の変化への適応性を向上させます。

実験では、この方法により、下流のタスクで事前トレーニングされたモデルのパフォーマンスが大幅に向上し、同時に、他のタスクと比べて堅牢性が向上することが示されています。大規模モデルに対する既存の微調整トレーニング方法には、大きな利点があります。

この研究の重要な意義は、深層学習パラダイムから事前学習済みの大規模モデルが引き継いだ「ブラックボックス」をある程度オープンにし、「」を解決することです。大規模モデルの「解釈可能性」と「制御可能性」の問題を解決し、事前トレーニングされた大規模モデルによる目に見える生産性向上に近づけます。

中山大学の HCP チームは、Transformer メカニズムの出現以来、長年にわたって大規模モデル技術パラダイムの研究に従事しており、トレーニング効率の向上に取り組んでいます。大規模モデルの「制御可能な問題」を解決するための因果モデルの導入、「性」の問題。チームは長年にわたり、視覚、言語、音声、クロスモダリティのための複数の大規模な事前トレーニング モデルを独自に研究、開発してきました。「Wukong」クロスモーダル大規模モデルは、ファーウェイのノアの方舟研究所と共同開発しました (リンク: https:/ /arxiv .org/abs/2202.06767) が典型的なケースです。

チーム紹介

孫文大学ヒューマン・コンピュータ・オブジェクト知能融合研究室(HCP Lab)は、マルチモーダル認識に従事 インテリジェント コンピューティング、ロボット工学と組み込みシステム、メタバースとデジタル ヒューマン、制御可能なコンテンツ生成の分野で体系的な研究を実施し、詳細なアプリケーション シナリオを実施して製品のプロトタイプを作成し、多数のオリジナルの製品を出力します。テクノロジーを開発し、起業家チームを育成します。この研究室は、IAPRフェローの林梁教授によって2010年に設立され、中国画像グラフィック協会科学技術賞一等賞、呉文軍自然科学賞、省自然科学一等賞を受賞している。梁暁丹や王克澤など国家レベルの若手人材を育成してきた。

以上が中山大学の HCP 研究室における新たなブレークスルー: 因果関係パラダイムを使用したマルチモーダル大規模モデルのアップグレードの詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。