Le robot propulsé par le grand modèle d’OpenAI arrive tard dans la nuit !

Le nom est Figure 01, il peut écouter, parler et bouger avec flexibilité.

Être capable de décrire tout ce que tu vois devant toi :

J'ai vu une pomme rouge sur la table, et il y avait plusieurs assiettes et une tasse sur l'égouttoir, tu te tenais à côté d'elle, avec tes mains ; posez-le doucement sur la table.

Photos

Photos

Quand l'humain dit "Je veux manger", je lui tends immédiatement la pomme.

Photos

Photos

Et je comprends clairement ce que je fais. J'ai donné la pomme car c'est la seule chose comestible sur la table.

Il organise également les choses en passant et peut gérer deux tâches en même temps.

Photos

Photos

Le plus important est que ces démonstrations ne sont pas accélérées, les mouvements originaux du robot sont tellement rapides.

(Personne n'est au volant)

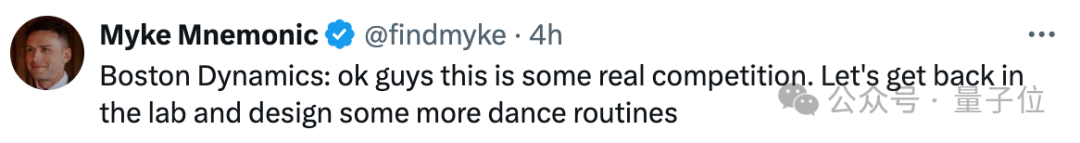

Maintenant, les internautes ne pouvaient plus rester assis et immédiatement @Boston Dynamics :

Les vieux, ce type est vraiment excité. Il faut retourner au labo et laisser le vieux robot (Boston Dynamics) danser encore un peu.

Photos

Photos

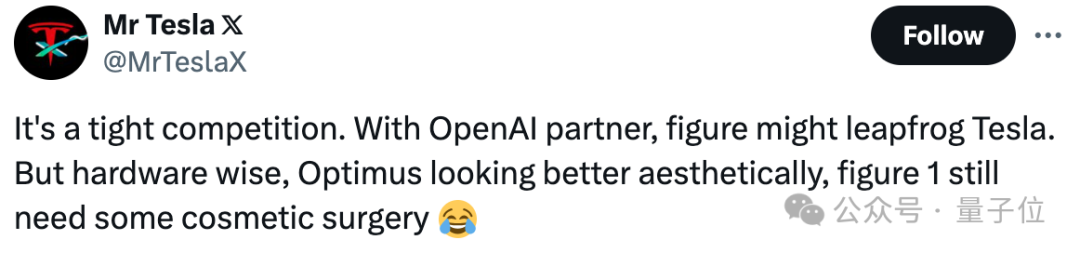

Il y a aussi des internautes qui ont regardé OpenAI déployer le grand modèle de langage et la vidéo de Vincent, puis ont tiré sur le robot et ont dit avec émotion :

C'est une concurrence féroce en coopérant avec OpenAI, Apple peut ; surpasser la traction de Tesla.

Mais en termes de matériel, Optimus Prime est plus beau, la Figure 01 a encore besoin d'une "chirurgie esthétique". (doge)

Photos

Photos

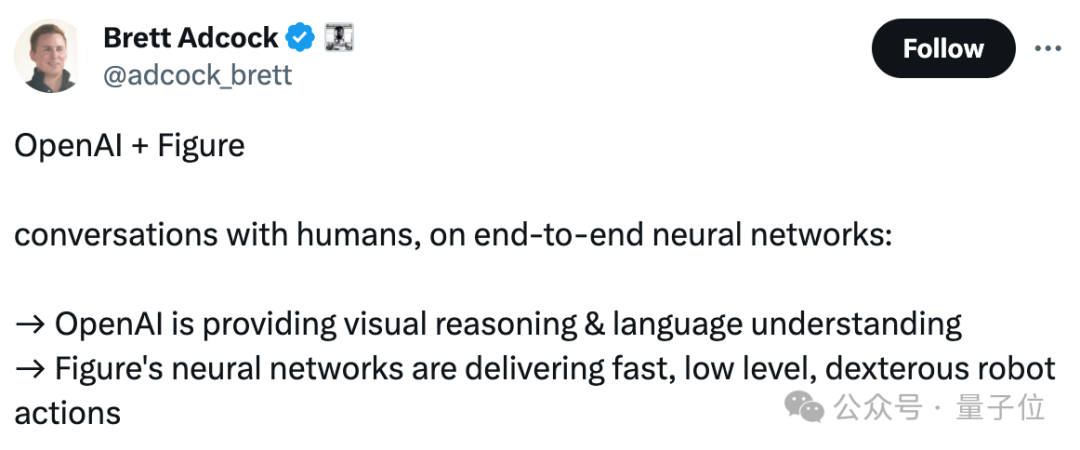

Ensuite, continuons à regarder les détails de la figure 01.

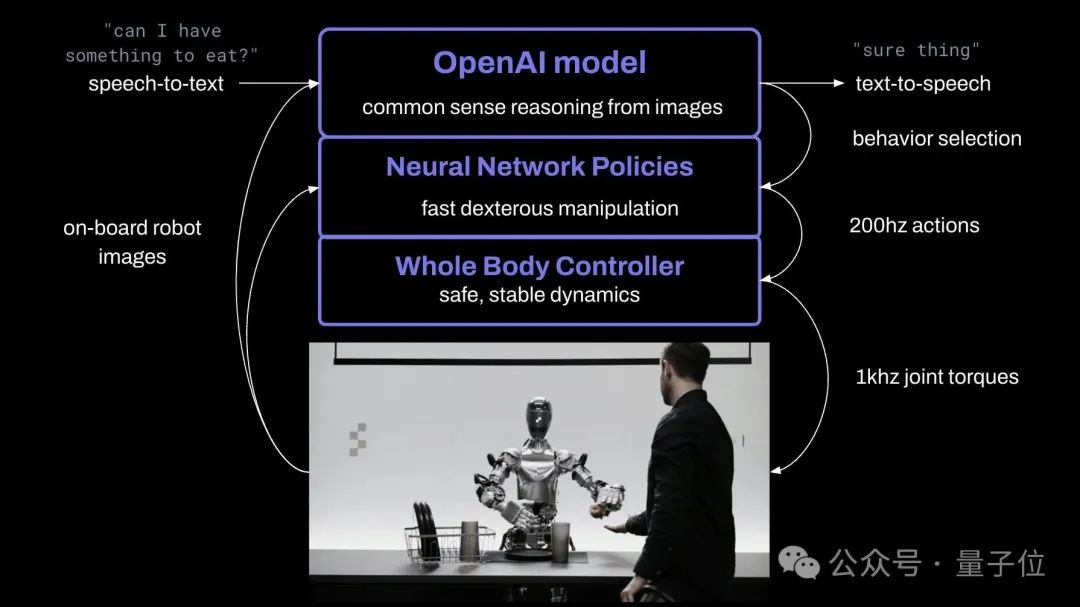

Selon l'introduction du fondateur, la figure 01 peut parler librement avec les humains via un réseau neuronal de bout en bout.

Basé sur les capacités de compréhension visuelle et de compréhension du langage fournies par OpenAI, il peut effectuer des actions rapides, simples et adroites.

On dit que le modèle est uniquement un grand modèle de langage visuel. On ne sait pas s'il s'agit de GPT-4V.

Images

Images

Il peut également planifier des actions, avoir des capacités de mémoire à court terme et expliquer son processus de raisonnement dans le langage.

Images

Images

Par exemple, dans le dialogue "Pouvez-vous les mettre là ?"

La compréhension d'expressions vagues telles que "eux" et "là" reflète la capacité de mémoire à court terme du robot.

Il utilise le modèle de langage visuel formé par OpenAI. La caméra du robot capturera l'image à 10 Hz, puis le réseau neuronal produira un mouvement de 24 degrés de liberté (angle de l'articulation du poignet et du doigt) à 200 Hz.

En termes de division spécifique du travail, la stratégie du robot est également très similaire à celle des humains.

Les actions complexes sont confiées au grand modèle d'IA. Le modèle pré-entraîné effectuera un raisonnement de bon sens sur des images et des textes et donnera des plans d'action ;

Des actions simples telles que saisir un sac en plastique (vous pouvez le saisir n'importe où), le robot est basé sur la vision apprise. Les stratégies d'exécution d'action vous permettent d'effectuer des actions de réaction rapides « subconscientes ».

Dans le même temps, le contrôleur du corps entier sera responsable du maintien de l'équilibre du corps et d'un mouvement stable.

Photos

Photos

Les capacités vocales du robot sont affinées sur la base d'un grand modèle texte-parole.

Pictures

Pictures

En plus du modèle d'IA le plus avancé, le fondateur et PDG de Figure, la société derrière Figure 01, a également mentionné dans un tweet que Figure intègre tous les composants clés du robot.

Y compris les moteurs, les systèmes d'exploitation middleware, les capteurs, les structures mécaniques, etc., tous conçus par les ingénieurs de Figure.

Il est entendu que cette start-up de robotique n'a annoncé officiellement sa coopération avec OpenAI qu'il y a 2 semaines, mais qu'elle n'a apporté un résultat aussi important que 13 jours plus tard. Beaucoup de gens commencent à espérer une coopération ultérieure.

Photos

Photos

Ainsi, une autre nouvelle star dans le domaine de l'intelligence incarnée est passée sous le feu des projecteurs.

En parlant de figure, cette société a été fondée en 2022. Comme mentionné précédemment, elle a de nouveau attiré l'attention du monde extérieur il y a à peine une douzaine de jours -

L'annonce officielle a eu lieu dans un communiqué. un nouveau cycle de financement de 675 millions de dollars a été levé et la valorisation a atteint 2,6 milliards de dollars. Les investisseurs ont rassemblé près de la moitié de la Silicon Valley, dont Microsoft, OpenAI, Nvidia, le fondateur d'Amazon Bezos, etc.

Plus important encore, OpenAI a également divulgué des projets de coopération plus poussée avec Figure : étendre les capacités des grands modèles multimodaux à la perception, au raisonnement et à l'interaction des robots, "développer des robots humanoïdes qui peuvent remplacer les humains dans le travail physique".

Pour utiliser le vocabulaire technologique le plus en vogue à l’heure actuelle, nous devons travailler ensemble pour développer l’intelligence incarnée.

Photos

Photos

A cette époque, les derniers progrès de la Figure 01 provenaient de tante Jiang :

En regardant des vidéos de démonstration humaine, la Figure 01 peut apprendre à faire du café avec une machine à café à capsules en seulement 10 heures de fin- jusqu'à la fin de la formation.

Photos

Photos

Dès que la coopération entre Figure et OpenAI a été rendue publique, les internautes étaient déjà pleins d'attentes quant à de futures avancées.

Photos

Photos

Après tout, Brett Adcock a écrit sur sa page d'accueil personnelle que "le seul objectif est de construire Figure dans une perspective de 30 ans pour avoir un impact positif sur l'avenir de l'humanité".

Mais peut-être que personne n'aurait pu imaginer que dans à peine deux semaines, de nouveaux progrès arriveraient.

Si vite, jusqu'à présent. Et elle peut continuer à être généralisée et étendue.

Photos

Photos

Il convient de mentionner que les informations de recrutement de Figure ont été publiées en même temps que la démo du site de bombardement :

Nous donnons vie à des robots humanoïdes. Rejoignez-nous.

Photos

Photos

Lien de référence :

[1]//m.sbmmt.com/link/59bbfbe0d3922ccd1d167661a26d8353

[2]//m.sbmmt.com/link/a3fc3 4dce 15cda93287496c84af5203c

[3]//m.sbmmt.com/link/194585b5215aea447389c5fefca09c61

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

utilisation du gradient linéaire

utilisation du gradient linéaire

Comment utiliser Swagger

Comment utiliser Swagger

utilisation des balises de jeu de champs

utilisation des balises de jeu de champs

Annuler le mot de passe de mise sous tension sous XP

Annuler le mot de passe de mise sous tension sous XP

présentation de l'interface Lightning

présentation de l'interface Lightning

Quel système est Android

Quel système est Android

Méthodes courantes en cours de mathématiques

Méthodes courantes en cours de mathématiques

Introduction au système d'exploitation Linux

Introduction au système d'exploitation Linux