Ces dernières années, avec l'essor des outils de génération d'images d'intelligence artificielle représentés par Midjourney et Stable Diffusion, la technologie de génération d'images d'intelligence artificielle 2D est devenue un outil auxiliaire utilisé par de nombreux concepteurs dans des projets réels. appliqué dans divers scénarios commerciaux et crée de plus en plus de valeur pratique. Dans le même temps, avec l'essor du Metaverse, de nombreuses industries s'orientent vers la création de mondes virtuels 3D à grande échelle, et un contenu 3D diversifié et de haute qualité devient de plus en plus important pour des secteurs tels que les jeux, la robotique, l'architecture, et les plateformes sociales. Cependant, la création manuelle d’actifs 3D prend du temps et nécessite des compétences artistiques et de modélisation spécifiques. L'un des principaux défis est la question de l'échelle : malgré le grand nombre de modèles 3D que l'on peut trouver sur le marché 3D, peupler un groupe de personnages ou de bâtiments qui ont tous un aspect différent dans un jeu ou un film nécessite toujours un investissement important de la part de l'artiste. temps. En conséquence, le besoin d'outils de création de contenu pouvant évoluer en termes de quantité, de qualité et de diversité du contenu 3D est devenu de plus en plus évident

Photos

Photos

Veuillez voir la figure 1, il s'agit d'une photo de l'espace métaverse ( Source : le film "Les Mondes de Ralph 2")

Grâce au fait que les modèles génératifs 2D ont atteint une qualité réaliste dans la synthèse d'images haute résolution, ces progrès ont également inspiré la recherche sur la génération de contenu 3D. Les premières méthodes visaient à étendre directement les générateurs CNN 2D aux grilles de voxels 3D, mais l'empreinte mémoire élevée et la complexité informatique des convolutions 3D ont entravé le processus de génération à haute résolution. Comme alternative, d’autres recherches ont exploré les nuages de points, les représentations implicites ou octree. Cependant, ces travaux se concentrent principalement sur la génération de géométrie et ignorent l’apparence. Leurs représentations de sortie doivent également être post-traitées pour les rendre compatibles avec les moteurs graphiques standards.

Afin d'être pratiques pour la production de contenu, les modèles génératifs 3D idéaux doivent répondre aux exigences suivantes :

Avoir la capacité de générer des graphiques 3D avec des géométries géométriques. détails et topologie arbitraire Capacité des formes

Réécrire le contenu : (b) Le résultat doit être un maillage texturé, qui est une expression courante utilisée par les logiciels graphiques standard tels que Blender et Maya

Peut être supervisé à l'aide d'images 2D, telles qu'elles sont plus petites que des formes 3D explicites Plus généralement

Pour faciliter le processus de création de contenu et permettre des applications pratiques, les réseaux 3D génératifs sont devenus un domaine de recherche actif capable de produire des actifs 3D diversifiés et de haute qualité . Chaque année, de nombreux modèles génératifs 3D sont publiés à l'ICCV, NeurlPS, ICML et d'autres conférences, y compris les modèles de pointe suivants

Textured3DGAN est un modèle génératif qui est une extension de la méthode convolutive de génération de maillages 3D texturés. Il est capable d'apprendre à générer des maillages de textures à partir d'images physiques à l'aide de GAN sous supervision 2D. Par rapport aux méthodes précédentes, Textured3DGAN assouplit les exigences relatives aux points clés dans l'étape d'estimation de pose et généralise la méthode aux collections d'images non étiquetées et aux nouvelles catégories/ensembles de données, tels que ImageNet

DIB-R : est un moteur de rendu différenciable basé sur l'interpolation, utilisant PyTorch. cadre d'apprentissage automatique en bas. Ce moteur de rendu a été ajouté au référentiel 3D Deep Learning PyTorch GitHub (Kaolin). Cette méthode permet le calcul analytique des dégradés pour tous les pixels de l'image. L'idée principale est de traiter la rastérisation de premier plan comme une interpolation pondérée d'attributs locaux et la rastérisation d'arrière-plan comme une agrégation de géométrie globale basée sur la distance. De cette façon, il peut prédire des informations telles que la forme, la texture et la lumière à partir d'une seule image

PolyGen : PolyGen est un modèle génératif autorégressif basé sur l'architecture Transformer pour modéliser directement des maillages. Le modèle prédit tour à tour les sommets et les faces du maillage. Nous avons formé le modèle à l'aide de l'ensemble de données ShapeNet Core V2, et les résultats sont déjà très proches des modèles de maillage construits par l'homme

SurfGen : synthèse de forme 3D contradictoire avec un discriminateur de surface explicite. Le modèle entraîné de bout en bout est capable de générer des formes 3D haute fidélité avec différentes topologies.

GET3D est un modèle génératif capable de générer des formes texturées 3D de haute qualité en apprenant des images. Son cœur est la modélisation de surface différenciable, le rendu différenciable et les réseaux contradictoires génératifs 2D. En s'entraînant sur une collection d'images 2D, GET3D peut générer directement des maillages 3D explicitement texturés avec une topologie complexe, des détails géométriques riches et des textures haute fidélité

images

images

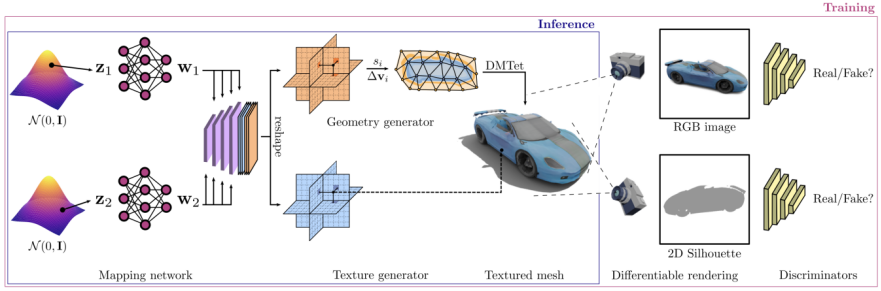

Ce qui doit être réécrit est : Figure 2 Modèle de génération GET3D (Source : site officiel du papier GET3D https://nv-tlabs.github.io/GET3D/)

GET3D est un modèle génératif 3D récemment proposé qui utilise plusieurs modèles avec des géométries complexes telles que ShapeNet, Turbosquid et Renderpeople Catégories telles que. des chaises, des motos, des voitures, des personnes et des bâtiments, démontrant des performances de pointe dans une génération illimitée de formes 3D

Pictures

Pictures

L'architecture GET3D provient du site officiel du papier GET3D. La figure 3 montre l'architecture

Un SDF 3D (champ de distance dirigé) est généré via deux encodages potentiels. et un champ de texture, puis utilisez DMTet (Deep Marching Tetrahedra) pour extraire le maillage de surface 3D de SDF et interrogez le champ de texture dans le nuage de points de surface pour obtenir la couleur. L'ensemble du processus est entraîné à l'aide d'une perte contradictoire définie sur des images 2D. En particulier, les images et les contours RVB sont obtenus à l'aide d'un moteur de rendu différenciable basé sur la rastérisation. Enfin, deux discriminateurs 2D sont utilisés, chacun pour les images RVB et les contours, pour distinguer si l'entrée est réelle ou fausse. L'ensemble du modèle peut être entraîné de bout en bout

GET3D est également très flexible sous d'autres aspects et peut être facilement adapté à d'autres tâches en plus d'exprimer des maillages explicites en sortie, notamment :

Implémentation séparée de la géométrie et de la texture : bon découplage entre la géométrie et la texture est obtenue, permettant une interpolation significative des codes latents de géométrie et des codes latents de texture

En effectuant une marche aléatoire dans l'espace latent, lors de la génération de transitions douces entre différentes classes de formes, et en générant des formes 3D correspondantes pour réaliser

Générer de nouvelles formes : cela peut être perturbé en ajoutant un petit bruit au code latent local, générant ainsi des formes qui se ressemblent mais sont légèrement différentes localement

Génération de matériaux non supervisée : via Combiné avec DIBR++, générez des matériaux de manière totalement non supervisée et produisez effets d'éclairage significatifs dépendant de la vue

Génération de formes guidée par texte : en combinant StyleGAN NADA, en exploitant les images 2D rendues par ordinateur et le texte fourni par l'utilisateur. En utilisant la perte CLIP directionnelle pour affiner le générateur 3D, les utilisateurs peuvent générer un grand nombre de formes via des invites de texte

Images

Images

Veuillez vous référer à la figure 4, qui montre le processus de génération de formes basées sur du texte. La source de cette figure est le site officiel de l'article GET3D, l'URL est https://nv-tlabs.github.io/GET3D/

Bien que GET3D ait fait un pas vers une 3D pratique modèle de génération de forme de texture. Une étape importante, mais qui présente encore certaines limites. En particulier, le processus de formation repose toujours sur la connaissance des silhouettes 2D et des répartitions de caméras. Par conséquent, actuellement GET3D ne peut être évalué que sur la base de données synthétiques. Une extension prometteuse consiste à exploiter les progrès de la segmentation des instances et de l'estimation de la pose de la caméra pour atténuer ce problème et étendre GET3D aux données du monde réel. GET3D n'est actuellement formé qu'en fonction des catégories et sera étendu à plusieurs catégories à l'avenir pour mieux représenter la diversité entre les catégories. Espérons que cette recherche rapprochera les gens de l’utilisation de l’intelligence artificielle pour la création gratuite de contenu 3D

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!