Le Laboratoire de fusion d'intelligence humaine (HCP) de l'Université Sun Yat-sen a réalisé des réalisations fructueuses dans les domaines de l'AIGC et des grands modèles multimodaux. Il a été sélectionné pour plus de dix articles lors des récents AAAI 2023 et CVPR 2023, se classant parmi les meilleurs. les premiers échelons des institutions de recherche mondiales.

L'un des travaux a mis en œuvre l'utilisation de modèles causals pour améliorer considérablement la contrôlabilité et la généralisation des grands modèles multimodaux dans le réglage - "Les images masquées sont des échantillons contrefactuels pour un réglage fin robuste". L'utilisation de modèles à grande échelle pré-entraînés pour affiner les tâches en aval est actuellement un paradigme d'apprentissage en profondeur populaire. . En particulier, les récentes performances exceptionnelles de ChatGPT, un vaste modèle de langage pré-entraîné, ont rendu ce paradigme technique largement reconnu. Après un pré-entraînement avec des données massives, ces grands modèles pré-entraînés peuvent s'adapter à l'évolution de la distribution des données dans l'environnement réel et faire donc preuve d'une forte robustesse dans les scénarios généraux.

Cependant, lorsque le grand modèle pré-entraîné est affiné avec les données de scène en aval pour s'adapter à des tâches d'application spécifiques, dans la grande majorité des cas, ces données sont singulières. L'utilisation de ces données pour affiner le grand modèle pré-entraîné réduira souvent la robustesse du modèle, ce qui le rendra difficile à appliquer sur la base du grand modèle pré-entraîné. Surtout en termes de modèles visuels, puisque la diversité des images dépasse de loin le langage, le problème de l'entraînement de réglage fin en aval conduisant à une diminution de la robustesse des grands modèles pré-entraînés liés à la vision est particulièrement important.

Les méthodes de recherche précédentes maintiennent généralement la robustesse du modèle pré-entraîné affiné implicitement au niveau des paramètres du modèle grâce à l'intégration du modèle et d'autres méthodes. Cependant, ces travaux n'ont pas analysé les raisons essentielles pour lesquelles un réglage fin conduit à une dégradation des performances du modèle hors distribution, ni n'ont résolu clairement le problème mentionné ci-dessus de robustesse réduite après un réglage fin de grands modèles. Ce travail est basé sur le grand modèle cross-modal, et analyse les raisons essentielles de la perte de robustesse du grand modèle pré-entraîné du point de vue de la causalité, et propose par conséquent une méthode qui peut améliorer considérablement la robustesse de le modèle. Affinez vos méthodes de formation. Cette méthode permet au modèle de conserver une forte robustesse tout en s'adaptant aux tâches en aval, et répond mieux aux besoins des applications pratiques.

Prenons comme exemple le grand modèle de pré-entraînement multimodal CLIP (Contrastive Language–Image Pre-training) publié par OpenAI en 2021 : CLIP est un grand modèle de pré-entraînement multimodal basé sur une image-texte contrastée L'apprentissage conjoint. Le modèle est la base des modèles génératifs tels que Stable Diffusion. Le modèle est formé sur des données multi-sources massives contenant environ 400 millions de paires image-texte et apprend certaines relations causales qui sont dans une certaine mesure robustes aux changements de distribution.

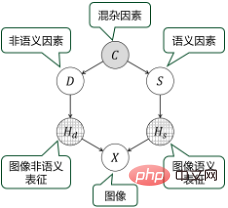

Cependant, lors du réglage fin de CLIP avec des données en aval à fonctionnalité unique, il est facile de détruire ces connaissances causales apprises par le modèle, car la représentation non sémantique et la représentation sémantique de l'image d'entraînement sont fortement intriquées. Par exemple, lors de l'application du transfert de modèle CLIP au scénario en aval de « ferme », de nombreuses images de formation montrent des « vaches » dans l'herbe. À ce stade, un apprentissage plus fin peut permettre au modèle d'apprendre à s'appuyer sur la représentation sémantique non « vache » de l'herbe pour prédire la sémantique de l'image. Cependant, cette corrélation n'est pas nécessairement vraie, par exemple des « vaches » peuvent également apparaître sur la route. Par conséquent, une fois le modèle affiné et entraîné, sa robustesse sera réduite et les résultats de sortie pendant l'application peuvent devenir extrêmement instables et manquer de contrôlabilité.

Basé sur les années d'expérience de l'équipe dans la construction et la formation de grands modèles, ce travail réexamine le problème de la robustesse réduite causée par le réglage fin des modèles pré-entraînés du point de vue de la causalité. Basé sur la modélisation et l'analyse causales, ce travail propose une méthode de formation affinée qui construit des échantillons contrefactuels basés sur des masques d'image et améliore la robustesse du modèle grâce à l'apprentissage d'images de masques.

Plus précisément, afin de briser la corrélation parasite dans les images de formation en aval, ce travail propose une méthode basée sur la carte d'activation de classe (CAM) pour masquer et remplacer le contenu de zones spécifiques de l'image afin de manipuler les éléments non sémantiques. signification de l’image. Les représentations, ou représentations sémantiques, produisent des échantillons contrefactuels. Le modèle affiné peut apprendre à imiter la représentation de ces échantillons contrefactuels par le modèle pré-entraîné par distillation, découplant ainsi mieux l'influence des facteurs sémantiques et des facteurs non sémantiques, et améliorant l'adaptabilité aux changements de distribution dans les domaines en aval.

Les expériences montrent que cette méthode peut améliorer considérablement les performances des modèles pré-entraînés dans les tâches en aval, et présente en même temps des avantages significatifs en termes d'amélioration de la robustesse par rapport aux méthodes d'entraînement de réglage fin des grands modèles existantes.

L'importance importante de ce travail est que, dans une certaine mesure, il ouvre la « boîte noire » que les grands modèles pré-entraînés héritent du paradigme de l'apprentissage profond et résout les problèmes d'« interprétabilité » et de « contrôlabilité » de grands modèles. Une exploration importante nous rapproche des améliorations tangibles de la productivité induites par les grands modèles pré-entraînés.

L'équipe HCP de l'Université Sun Yat-sen est engagée dans la recherche sur les paradigmes technologiques des grands modèles depuis de nombreuses années depuis l'avènement du mécanisme Transformer. Elle s'engage à améliorer l'efficacité de la formation des grands modèles et à introduire des modèles causals. résoudre le problème de « contrôlabilité » des grands modèles. Au fil des années, l'équipe a recherché et développé de manière indépendante plusieurs grands modèles de pré-formation pour la vision, le langage, la parole et la cross-modalité. Le grand modèle multimodal « Wukong » développé conjointement avec le laboratoire Noah's Ark de Huawei (lien : https :/). /arxiv .org/abs/2202.06767) est un cas typique.

Présentation de l'équipe

Le laboratoire de convergence de l'intelligence humaine-machine (HCP Lab) de l'Université Sun Yat-sen est engagé dans l'informatique cognitive multimodale, la robotique et les systèmes embarqués, les métaverses et les humains numériques, la génération de contenu contrôlable, etc. Réaliser des recherches systématiques sur le terrain, créer des prototypes de produits, des scénarios d'application approfondis, exporter un grand nombre de technologies originales et incuber des équipes entrepreneuriales. Le laboratoire a été fondé en 2010 par le professeur Lin Liang, membre de l'IAPR. Il a remporté le premier prix du prix scientifique et technologique de la China Image and Graphics Society, le prix Wu Wenjun des sciences naturelles, le premier prix provincial des sciences naturelles et d'autres distinctions ; il a formé de jeunes talents de niveau national tels que Liang Xiaodan et Wang Keze.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Explication détaillée de la commande nohup

Explication détaillée de la commande nohup

Comment acheter et vendre du Bitcoin sur okex

Comment acheter et vendre du Bitcoin sur okex

Raisons pour lesquelles phpstudy ne peut pas être ouvert

Raisons pour lesquelles phpstudy ne peut pas être ouvert

Utilisation de la fonction urlencode

Utilisation de la fonction urlencode

À quel point Dimensity 9000 équivaut-il à Snapdragon ?

À quel point Dimensity 9000 équivaut-il à Snapdragon ?

Comment configurer Douyin pour empêcher tout le monde de voir l'œuvre

Comment configurer Douyin pour empêcher tout le monde de voir l'œuvre

SQL dans l'utilisation de l'opérateur

SQL dans l'utilisation de l'opérateur

Quel est le format du papier A5

Quel est le format du papier A5