La génération d'images est l'une des directions les plus en vogue dans le domaine actuel de l'AIGC. Les modèles de génération d'images récemment publiés tels que DALL・E 2, Imagen, Stable Diffusion, etc. ont inauguré une nouvelle ère de génération d'images, atteignant des niveaux sans précédent de qualité d'image et de flexibilité des modèles. Le modèle de diffusion est également devenu le paradigme dominant à l'heure actuelle. Cependant, les modèles de diffusion reposent sur l'inférence itérative, ce qui est une arme à double tranchant car les méthodes itératives peuvent réaliser une formation stable avec des objectifs simples, mais le processus d'inférence nécessite un coût de calcul élevé.

Avant les modèles de diffusion, les réseaux contradictoires génératifs (GAN) étaient une infrastructure couramment utilisée dans les modèles de génération d'images. Par rapport aux modèles de diffusion, les GAN génèrent des images via un seul passage direct et sont donc intrinsèquement plus efficaces, mais en raison de l'instabilité du processus de formation, la mise à l'échelle des GAN nécessite un réglage minutieux de l'architecture du réseau et des facteurs de formation. Par conséquent, les GAN sont efficaces pour modéliser une ou plusieurs classes d’objets, mais sont extrêmement difficiles à adapter à des ensembles de données complexes (sans parler du monde réel). En conséquence, de très grands modèles, données et ressources informatiques sont désormais dédiés aux modèles de diffusion et autorégressifs.

Mais en tant que méthode de génération efficace, de nombreux chercheurs n'ont pas complètement abandonné la méthode GAN. Par exemple, NVIDIA a récemment proposé le modèle StyleGAN-T ; les Chinois de Hong Kong et d'autres ont utilisé des méthodes basées sur le GAN pour générer des vidéos fluides. Il s'agit d'autres tentatives des chercheurs CV sur le GAN.

Maintenant, dans un article CVPR 2023, des chercheurs de POSTECH, de l'Université Carnegie Mellon et de l'Adobe Research Institute ont exploré conjointement plusieurs questions importantes concernant le GAN, notamment :

Il convient de noter que Zhu Junyan, l'auteur principal de CycleGAN et lauréat du prix ACM SIGGRAPH de la meilleure thèse de doctorat 2018, est le deuxième auteur de cet article CVPR.

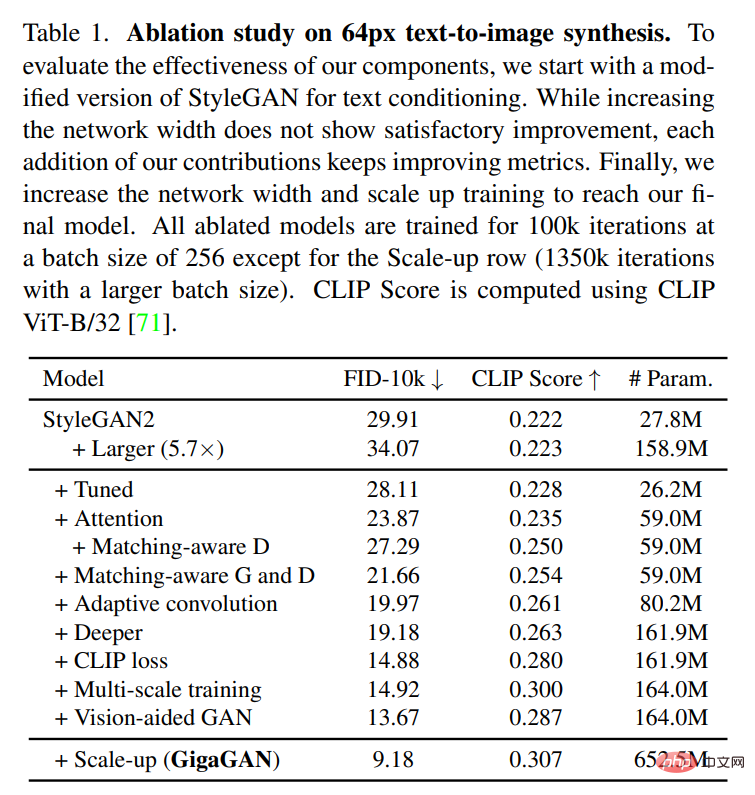

L'étude a d'abord mené des expériences en utilisant StyleGAN2 et a observé que la simple extension du réseau fédérateur entraînait une formation instable. Sur cette base, les chercheurs ont identifié plusieurs problèmes clés et ont proposé une technique pour stabiliser la formation tout en augmentant la capacité du modèle.

Premièrement, cette étude augmente efficacement la capacité du générateur en conservant un ensemble de filtres et en employant des combinaisons linéaires spécifiques à des échantillons. L'étude a également adopté plusieurs techniques couramment utilisées dans un contexte de diffusion et a confirmé qu'elles apportent des avantages similaires aux GAN. Par exemple, l’entrelacement de l’attention personnelle (image uniquement) et de l’attention croisée (image-texte) avec des couches convolutives peut améliorer les performances du modèle.

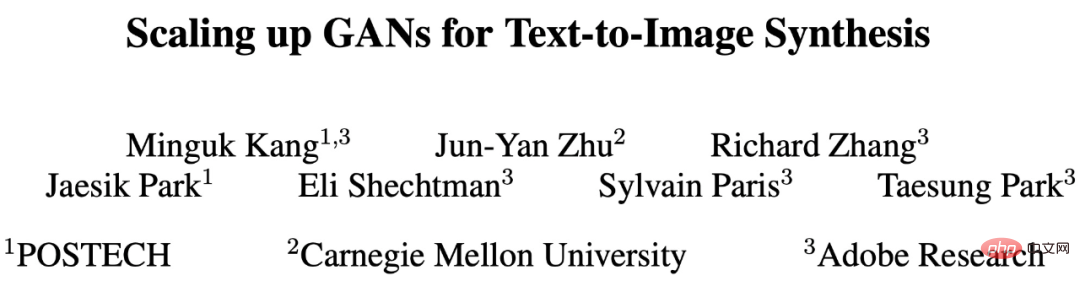

La recherche réintroduit également la formation multi-échelle et propose un nouveau schéma pour améliorer l'alignement image-texte et générer des détails basse fréquence du résultat. La formation multi-échelle permet aux générateurs basés sur GAN d'utiliser plus efficacement les paramètres des blocs basse résolution, ce qui entraîne un meilleur alignement image-texte et une meilleure qualité d'image. Après un ajustement minutieux, cette étude propose un nouveau modèle GigaGAN avec un milliard de paramètres et réalise une formation stable et évolutive sur de grands ensembles de données (tels que LAION2B-en). Les résultats expérimentaux sont présentés dans la figure 1 ci-dessous.

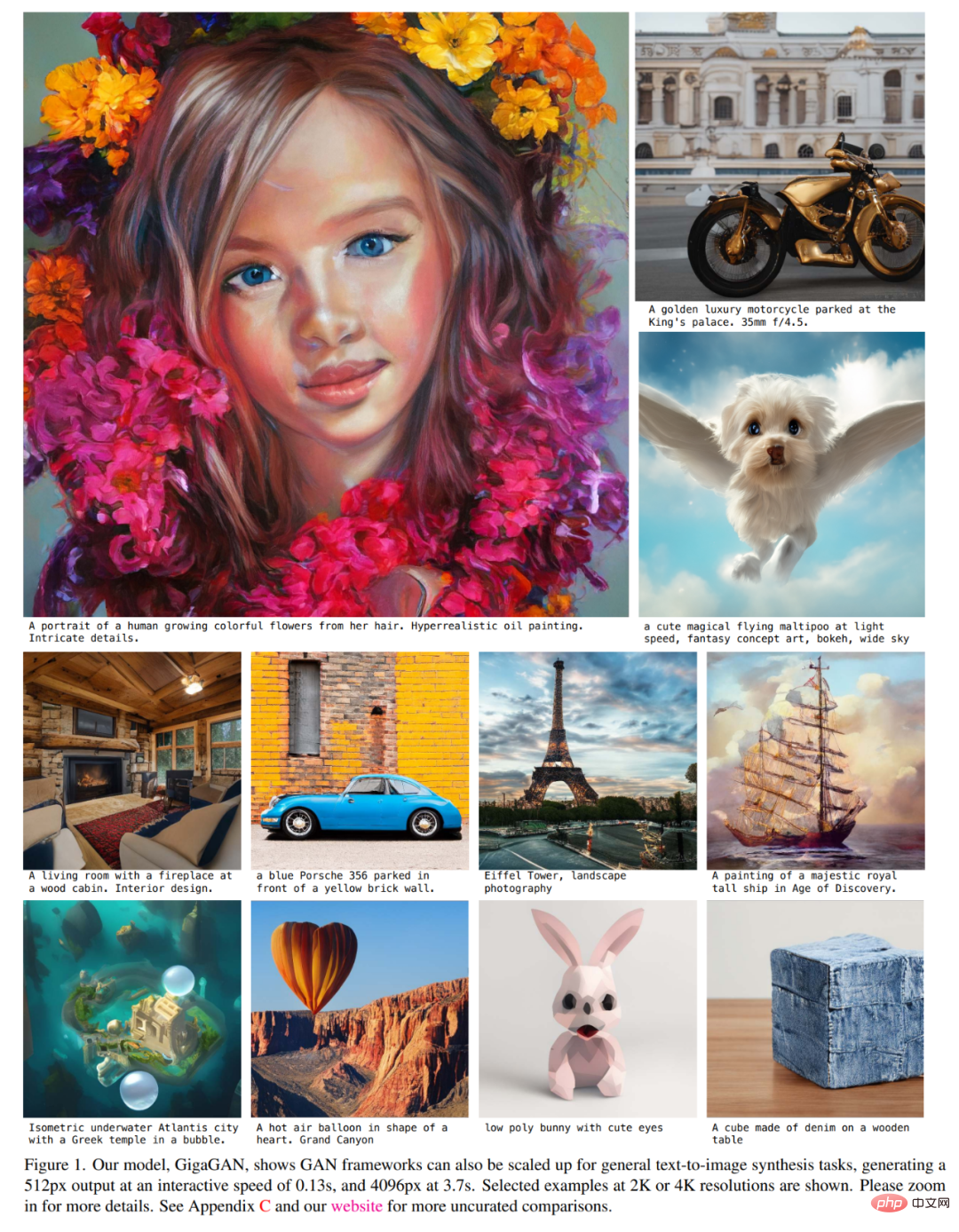

De plus, cette étude a adopté une approche en plusieurs étapes [14, 104], générant d'abord des images à basse résolution de 64 × 64, puis un suréchantillonnage à une résolution de 512 × 512. Les deux réseaux sont suffisamment modulaires et puissants pour être utilisés de manière plug-and-play.

Cette étude montre que le réseau de suréchantillonnage GAN conditionné par le texte peut être utilisé comme suréchantillonneur efficace et de meilleure qualité pour le modèle de diffusion sous-jacent, comme le montrent les figures 2 et 3 ci-dessous.

Les améliorations ci-dessus rendent GigaGAN bien au-delà des GAN précédents : 36 fois plus grand que StyleGAN2 et 6 fois plus grand que StyleGAN-XL et XMC-GAN. Bien que le nombre de paramètres de GigaGAN d'un milliard (1B) soit encore inférieur à celui des grands modèles synthétiques récents tels que Imagen (3,0B), DALL・E 2 (5,5B) et Parti (20B), les chercheurs affirment qu'ils n'ont pas encore observé des changements dans la qualité de la taille du modèle est saturée.

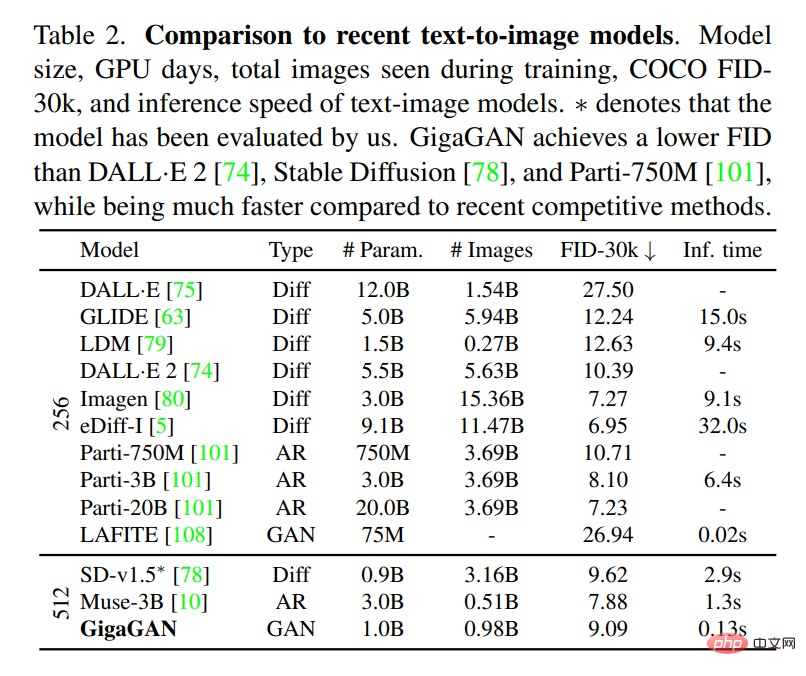

GigaGAN atteint un FID à échantillon nul de 9,09 sur l'ensemble de données COCO2014, ce qui est inférieur à DALL・E 2, Parti-750M et Stable Diffusion.

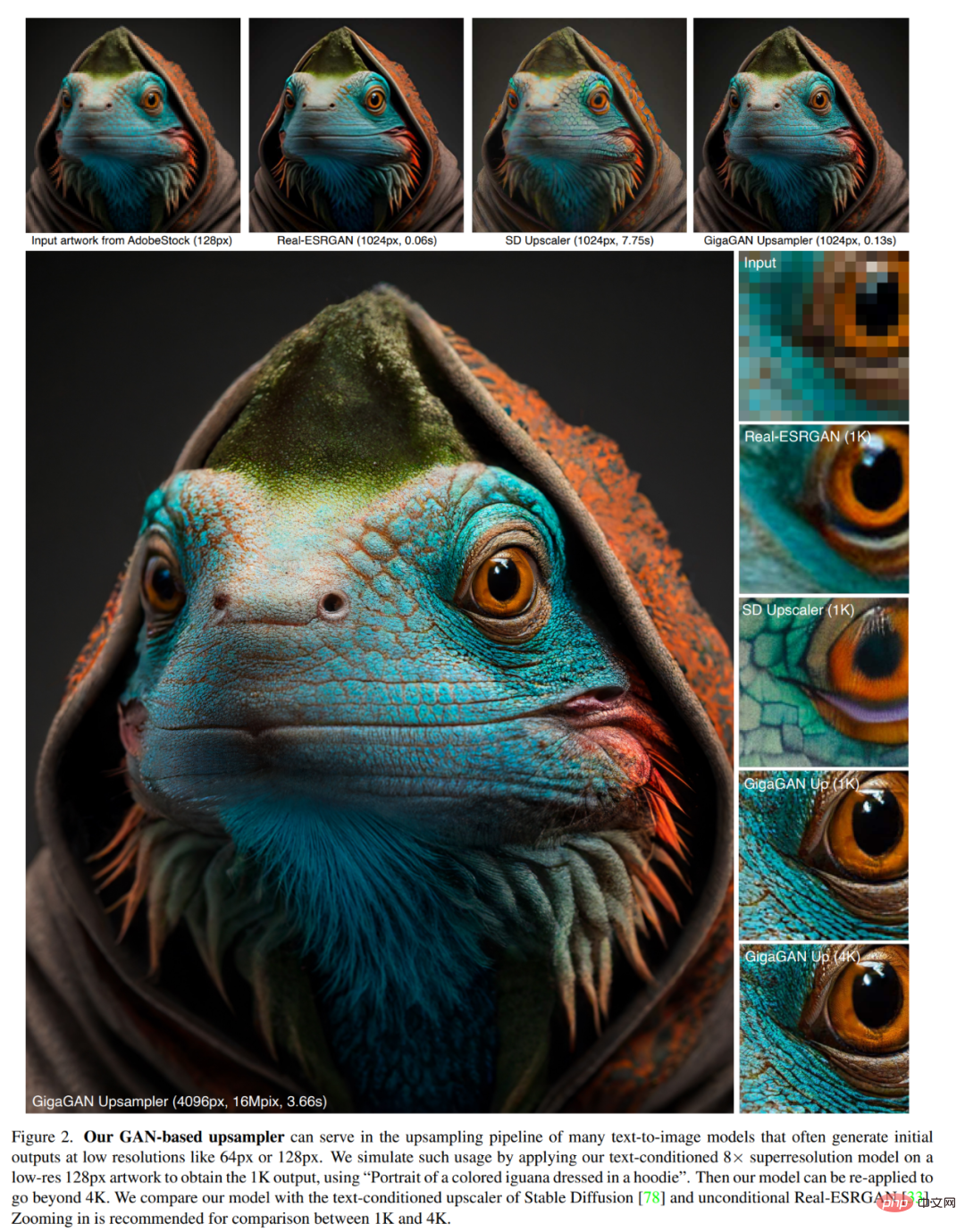

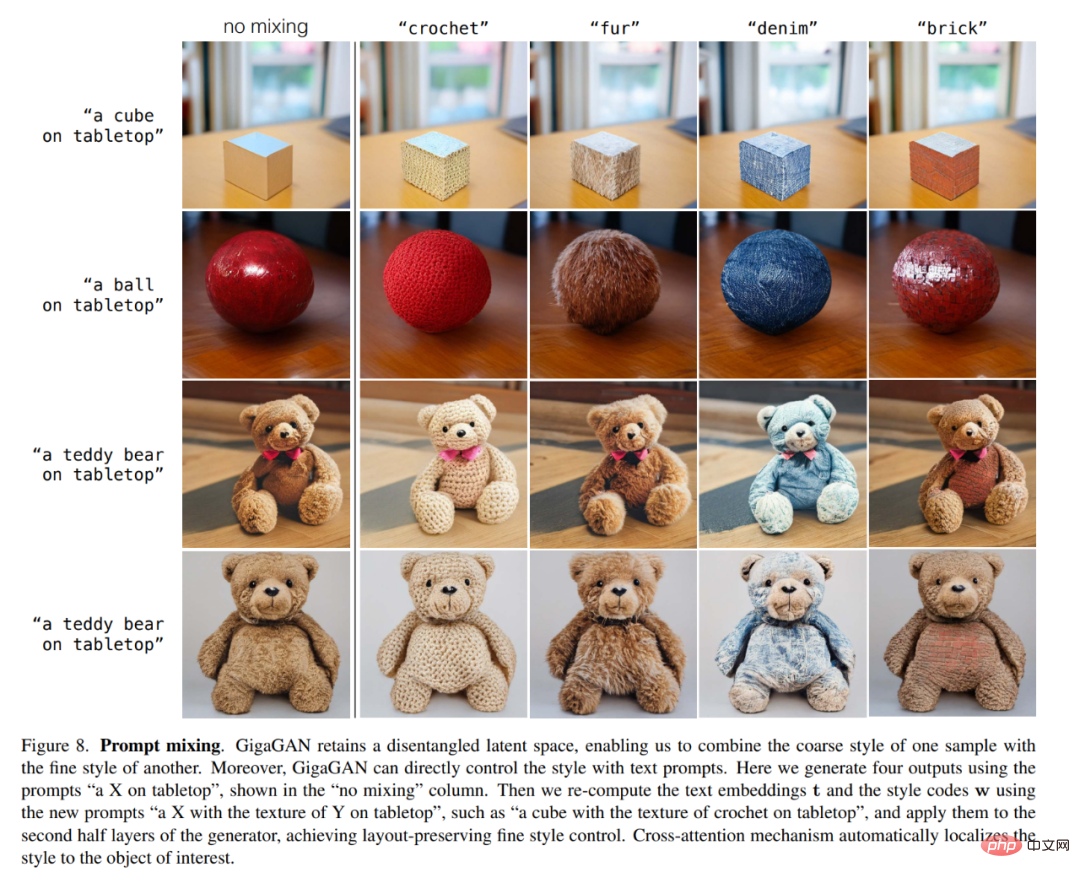

De plus, par rapport aux modèles de diffusion et aux modèles autorégressifs, GigaGAN présente trois avantages pratiques majeurs. Premièrement, il est des dizaines de fois plus rapide, produisant une image de 512 pixels en 0,13 seconde (Figure 1). Deuxièmement, il peut synthétiser des images ultra haute résolution en résolution 4K en seulement 3,66 secondes. Troisièmement, il dispose d'un espace vectoriel latent contrôlable qui convient aux applications de synthèse d'images contrôlables bien étudiées, telles que le mélange de styles (Figure 6), l'interpolation rapide (Figure 7) et le mélange rapide (Figure 8). La recherche a réussi à former un modèle à l'échelle d'un milliard de paramètres basé sur le GAN, GigaGAN, sur des milliards d'images du monde réel. Cela suggère que les GAN restent une option viable pour la synthèse texte-image et que les chercheurs devraient les envisager pour une expansion future agressive.

Aperçu de la méthode

Les chercheurs ont entraîné un générateur G (z, c) pour prédire, étant donné un codage latent z∼N (0, 1)∈R^128 et un signal de conditionnement de texte c, une image x∈ R^(H×L×3). Ils utilisent un discriminateur D (x, c) pour juger de l'authenticité des images générées par rapport aux échantillons d'une base de données de formation D, qui contient des paires image-texte.

Le générateur génère une pyramide d'images en convertissant les caractéristiques intermédiaires en images RVB. Pour atteindre une capacité plus élevée, nous utilisons plusieurs couches d'attention et de convolution à chaque échelle (Annexe A2). Ils ont également utilisé un modèle de suréchantillonnage distinct, qui n’est pas illustré sur cette figure.

Le discriminateur se compose de deux branches de traitement d'image et de conditionnement de texte t_D. La branche texte gère le texte de la même manière que le générateur (Figure 4). La branche d'images reçoit une pyramide d'images et effectue des prédictions indépendantes pour chaque échelle d'image. De plus, des prédictions sont effectuées à toutes les échelles ultérieures de la couche de sous-échantillonnage, ce qui en fait un discriminateur d'entrée et de sortie multi-échelle (MS-I/O).

Résultats expérimentaux

Dans l'article, l'auteur a enregistré cinq expériences différentes.

Dans la première expérimentation, ils ont démontré l'efficacité de la méthode proposée en incorporant chaque composante technique une à une.

Dans la deuxième expérience, ils ont testé la capacité du modèle à générer des graphiques, et les résultats ont montré que GigaGAN a réalisé un FID comparable à la diffusion stable (SD-v1.5), tout en produisant des résultats meilleurs que Les modèles de diffusion ou autorégressifs sont beaucoup plus rapides.

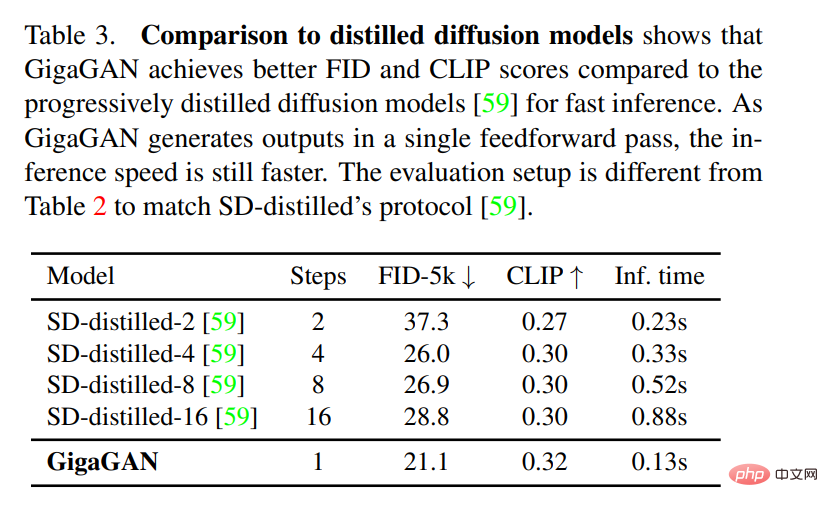

Dans la troisième expérience, ils ont comparé GigaGAN avec un modèle de diffusion basé sur la distillation, et les résultats ont montré que GigaGAN peut synthétiser des images de meilleure qualité plus rapidement qu'un modèle de diffusion basé sur la distillation.

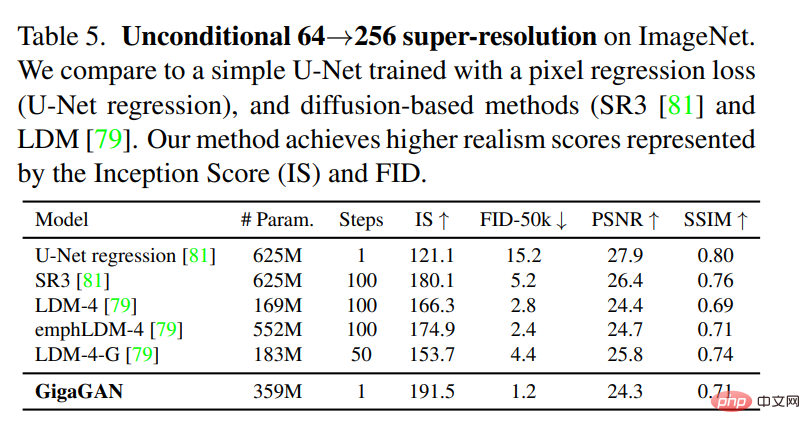

Dans la quatrième expérience, ils ont vérifié les avantages du suréchantillonneur de GigaGAN par rapport aux autres suréchantillonneurs dans les tâches de super-résolution conditionnelle et inconditionnelle.

Enfin, ils ont montré que leur modèle GAN à grande échelle proposé bénéficie toujours des opérations spatiales latentes continues et démêlées du GAN, permettant ainsi un nouveau mode d'édition d'image. Voir les figures 6 et 8 ci-dessus pour les diagrammes.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Convertir le texte en valeur numérique

Convertir le texte en valeur numérique

Méthode de détection des liens morts d'un site Web

Méthode de détection des liens morts d'un site Web

que signifie l'élément

que signifie l'élément

Graphique des prix historiques du Bitcoin

Graphique des prix historiques du Bitcoin

Où se trouve l'interface audio sur la carte mère ?

Où se trouve l'interface audio sur la carte mère ?

Solution aux caractères tronqués lors de l'ouverture d'Excel

Solution aux caractères tronqués lors de l'ouverture d'Excel

Que signifie Chrome ?

Que signifie Chrome ?

Que peuvent faire les amis de TikTok ?

Que peuvent faire les amis de TikTok ?