De nombreux modèles d'applications d'IA doivent désormais mentionner une structure de modèle :

Transformer.

Il abandonne les CNN et RNN traditionnels et est entièrement composé d'un mécanisme d'attention.

Transformer donne non seulement à divers modèles d'applications d'IA la possibilité d'écrire des articles et des poèmes, mais brille également dans les aspects multimodaux.

Surtout après la sortie de ViT (Vision Transformer), la barrière du modèle entre CV et NLP a été brisée, et un seul modèle Transformer peut gérer des tâches multimodales.

(Qui ne peut pas soupirer devant sa puissance après avoir lu ceci ?)

Bien que Transformer ait été conçu à l'origine pour des tâches linguistiques, il a également un grand potentiel pour imiter le cerveau.

Non, un écrivain scientifique a écrit un blog sur la façon dont Transformer modélise le cerveau.

Qu'a-t-il dit quand je suis arrivé à Kangkang ?

Tout d'abord, nous devons trier son processus d'évolution.

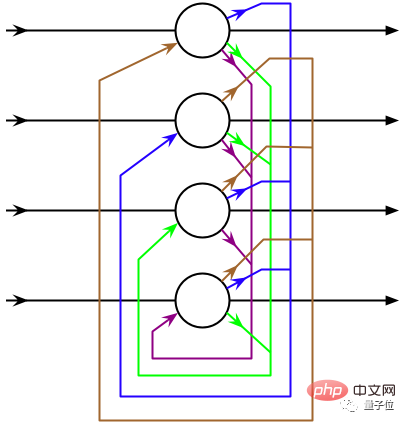

Le mécanisme Transformateur est apparu pour la première fois il y a 5 ans. Sa capacité à fonctionner avec une telle puissance est en grande partie due à son mécanisme d'auto-attention.

Quant à la façon dont Transformer imite le cerveau, continuez à lire ci-dessous.

En 2020, l'équipe de recherche de l'informaticien autrichien Sepp Hochreiter a utilisé Transformer pour réorganiser le réseau neuronal Hopfield (un modèle de récupération de mémoire, HNN).

En fait, le réseau de neurones Hopfield a été proposé il y a 40 ans, et la raison pour laquelle l'équipe de recherche a choisi de réorganiser ce modèle après des décennies est la suivante :

Premièrement, ce réseau suit une règle universelle : les réseaux de neurones qui sont actifs à en même temps, les éléments établiront des liens solides les uns avec les autres.

Deuxièmement, le processus de récupération de mémoire par le réseau neuronal Hopfield présente certaines similitudes avec la mise en œuvre par le Transformateur du mécanisme d'auto-attention.

L'équipe de recherche a donc réorganisé HNN pour établir de meilleures connexions entre les neurones afin que davantage de souvenirs puissent être stockés et récupérés.

Le processus de réorganisation, en termes simples, consiste à intégrer le mécanisme d'attention de Transformer dans HNN, de sorte que le HNN discontinu d'origine devienne un état continu.

Le réseau Hopfield réorganisé peut être intégré dans l'architecture de deep learning en tant que couche pour permettre le stockage et l'accès aux données d'entrée originales, aux résultats intermédiaires, etc.

Par conséquent, Hopfield lui-même et Dmitry Krotov du laboratoire d'intelligence artificielle du MIT Watson ont déclaré :

Le réseau neuronal Hopfield basé sur un transformateur est biologiquement raisonnable.

Bien que cela soit similaire dans une certaine mesure au principe de fonctionnement du cerveau, il n'est pas assez précis à certains égards.

Les neuroscientifiques informatiques Whittington et Behrens ont donc adapté la méthode de Hochreiter et apporté quelques corrections au réseau Hopfield réorganisé, améliorant ainsi les performances du modèle dans les tâches de neurosciences (réplication des schémas de déclenchement neuronaux dans le cerveau).

En termes simples, lors de l'encodage-décodage, le modèle n'encode plus la mémoire comme une séquence linéaire, mais l'encode comme des coordonnées de haut niveau dans espace dimensionnel.

Plus précisément, TEM (Tolman-Eichenbaum Machine) est introduit dans le modèle.

TEM est un système de mémoire associative conçu pour imiter la fonction de navigation spatiale de l'hippocampe.

Il est capable de généraliser les connaissances structurelles spatiales et non spatiales, de prédire les performances neuronales observées dans les tâches de mémoire spatiale et associative et d'expliquer les phénomènes de remappage dans l'hippocampe et le cortex entorhinal.

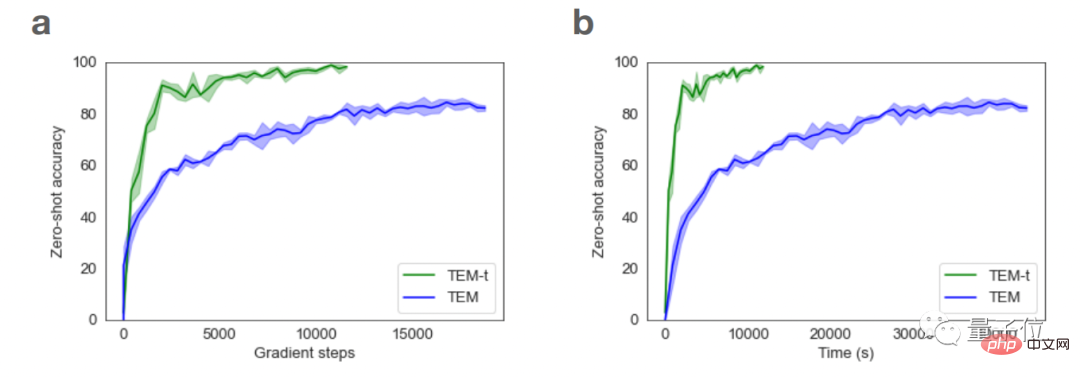

Fusion de TEM et Transformer, qui ont tant de fonctions, pour former TEM-transformer (TEM-t).

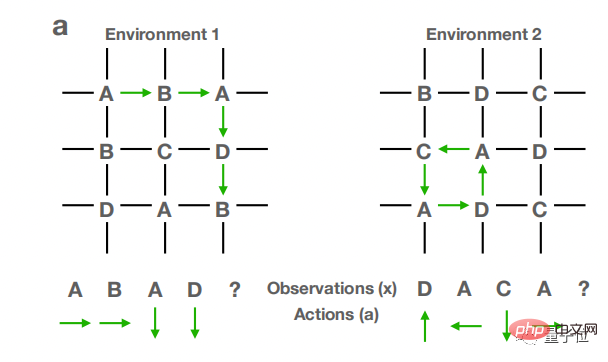

Ensuite, laissez le modèle TEM-t être formé dans plusieurs environnements spatiaux différents. La structure de l'environnement est comme indiqué dans la figure ci-dessous.

Dans TEM-t, il dispose toujours du mécanisme d'auto-attention de Transformer. De cette manière, les résultats d'apprentissage du modèle peuvent être transférés vers de nouveaux environnements et utilisés pour prédire de nouvelles structures spatiales.

La recherche montre également que par rapport au TEM, le TEM-t est plus efficace dans l'exécution de tâches de neurosciences et peut également traiter plus de problèmes avec moins d'échantillons d'apprentissage.

Transformer imite de plus en plus profondément les modèles cérébraux. En d'autres termes, le développement des modèles Transformer favorise également constamment notre compréhension des principes de fonctionnement des fonctions cérébrales.

Non seulement cela, à certains égards, Transformer peut également améliorer notre compréhension d'autres fonctions du cerveau.

Par exemple, l'année dernière, le neuroscientifique informatique Martin Schrimpf a analysé 43 modèles de réseaux neuronaux différents pour voir comment ils affectaient les mesures de l'activité neuronale humaine : imagerie par résonance magnétique fonctionnelle (IRMf) et cerveau cortical. Pouvoir prédictif de l'électrogramme (EEG).

Parmi eux, le modèle Transformer peut prédire presque tous les changements observés en imagerie.

Avec le recul, nous pouvons peut-être également prédire le fonctionnement des fonctions cérébrales correspondantes à partir du modèle Transformer.

De plus, les informaticiens Yujin Tang et David Ha ont récemment conçu un modèle capable d'envoyer consciemment de grandes quantités de données de manière aléatoire et désordonnée via le modèle Transformer, simulant la façon dont le corps humain transmet des observations sensorielles au cerveau.

Ce Transformer est comme le cerveau humain et peut gérer avec succès un flux d'informations désordonné.

Bien que le modèle Transformer s'améliore constamment, ce n'est qu'un petit pas vers un modèle cérébral précis, et des recherches plus approfondies sont nécessaires pour atteindre le point final.

Si vous souhaitez en savoir plus sur la façon dont Transformer imite le cerveau humain, vous pouvez cliquer sur le lien ci-dessous~

[1]https://www.quantamagazine.org/how-ai-transformers- mimic-parts-of-the-brain-20220912/

[2]https://www.pnas.org/doi/10.1073/pnas.2105646118

[3]https://openreview.net/forum? identifiant=B8DVo9B1YE0

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Comment utiliser la fonction de tri

Comment utiliser la fonction de tri

Qu'est-ce que CONNECTION_REFUSED ?

Qu'est-ce que CONNECTION_REFUSED ?

Huobi.com

Huobi.com

Introduction aux touches de raccourci de capture d'écran dans Win10

Introduction aux touches de raccourci de capture d'écran dans Win10

Le jeton de connexion n'est pas valide

Le jeton de connexion n'est pas valide

Introduction au code d'effets spéciaux javascript

Introduction au code d'effets spéciaux javascript

Solution à l'échec de la mise à jour WIN10

Solution à l'échec de la mise à jour WIN10

Commandes communes OGG

Commandes communes OGG