La segmentation panoramique est une tâche de vision fondamentale qui vise à attribuer des étiquettes sémantiques et des étiquettes d'instance à chaque pixel d'une image. Les étiquettes sémantiques décrivent la catégorie de chaque pixel (par exemple ciel, objet vertical, etc.) et les étiquettes d'instance fournissent un identifiant unique pour chaque instance de l'image (pour distinguer différentes instances de la même catégorie). Cette tâche combine la segmentation sémantique et la segmentation d'instance pour fournir des informations sémantiques riches sur la scène.

Bien que les catégories d'étiquettes sémantiques soient fixées a priori, les identifiants d'instance attribués aux objets dans l'image peuvent être interchangés sans affecter la reconnaissance. Par exemple, l'échange des ID d'instance de deux véhicules n'affecte pas les résultats. Par conséquent, un réseau neuronal entraîné à prédire les ID d’instance devrait être capable d’apprendre un mappage un-à-plusieurs à partir d’une seule image vers plusieurs attributions d’ID d’instance. L'apprentissage des mappages un-à-plusieurs est un défi, et les méthodes traditionnelles utilisent souvent des pipelines en plusieurs étapes, notamment la détection d'objets, la segmentation et la fusion de plusieurs prédictions. Récemment, sur la base de la correspondance de graphes bipartis différenciables, certains chercheurs ont proposé des méthodes de bout en bout capables de convertir efficacement le mappage un-à-plusieurs en un mappage un-à-un basé sur la correspondance de reconnaissance. Cependant, ces méthodes nécessitent toujours des architectures personnalisées et des fonctions de perte spécialisées, ainsi que des biais inductifs intégrés pour les tâches de segmentation panoramique.

Les modèles de vision généraux récents, tels que Pix2Seq, OFA, UViM et Unified I/O, préconisent des cadres généraux et sans tâches pour réaliser des tâches de généralisation tout en étant beaucoup plus simples que les modèles précédents. Par exemple, Pix2Seq génère une série de séquences sémantiquement significatives basées sur des images pour accomplir certaines tâches visuelles de base, et ces modèles sont basés sur des Transformers pour former des modèles autorégressifs.

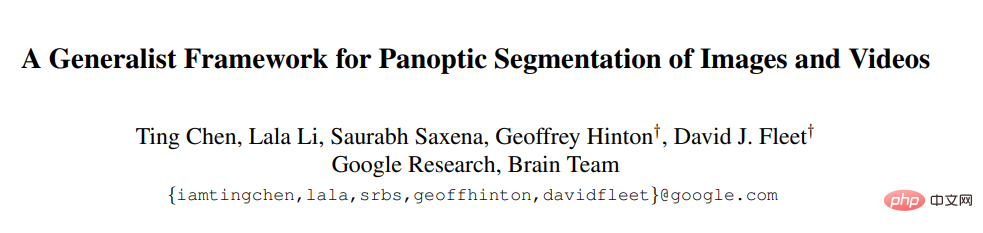

Dans un nouvel article, des chercheurs tels que Ting Chen et Geoffrey Hinton de Google Brain suivent le même concept et comprennent le problème de la tâche de segmentation panoramique du point de vue de la génération de données discrètes conditionnelles.

Lien papier https://arxiv.org/pdf/2210.06366.pdf

Comme le montre la figure 1, le chercheur a conçu un modèle génératif pour les masques panoramiques et a entré chaque image du Le modèle génère un ensemble de jetons discrets. Les utilisateurs peuvent appliquer ce modèle aux données vidéo (données en ligne/médias en streaming) simplement en utilisant les prédictions des images passées comme signaux conditionnels supplémentaires. De cette façon, le modèle apprend automatiquement à suivre et segmenter les objets.

La modélisation générative de la segmentation panoramique est très difficile car les masques panoramiques sont discrets, ou catégoriques, et le modèle peut être très grand. Par exemple, pour générer un masque panoramique 512 × 1024, le modèle doit générer plus de 1 million de balises discrètes (étiquettes sémantiques et d'instance). Cela reste relativement coûteux pour les modèles autorégressifs car les jetons sont de nature séquentielle et difficiles à modifier à mesure que l'échelle des données d'entrée change. Les modèles de diffusion sont plus efficaces pour gérer les données de grande dimension, mais ils sont le plus souvent appliqués dans des domaines continus plutôt que discrets. En représentant des données discrètes avec des bits analogiques, les auteurs montrent que les modèles de diffusion peuvent être entraînés directement sur de grands masques panoramiques sans avoir besoin d'apprendre un espace latent.

Grâce à des expériences approfondies, les chercheurs ont démontré que leur méthode générale peut rivaliser avec les méthodes expertes de pointe dans des environnements similaires.

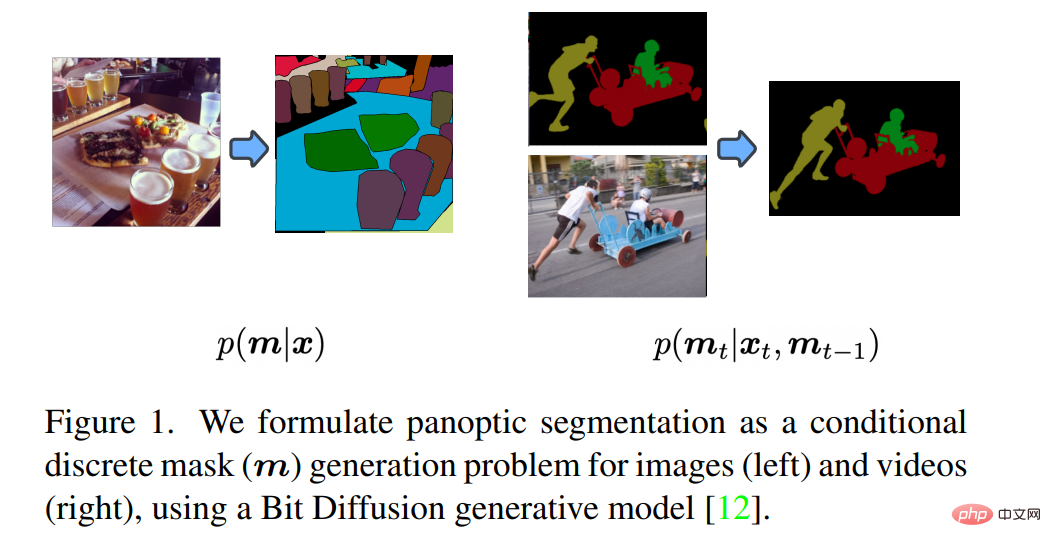

L'échantillonnage du modèle de diffusion est effectué de manière itérative, de sorte que la transmission directe du réseau doit être exécutée plusieurs fois pendant l'inférence. Par conséquent, comme le montre la figure 2, les chercheurs ont intentionnellement divisé le réseau en deux composants : 1) encodeur d’image 2) décodeur de masque ; Le premier mappe les données brutes de pixels sur des vecteurs de représentation de haut niveau, puis le décodeur de masque lit de manière itérative le masque panoramique.

Encodeur de pixels/images

L'encodeur est un réseau qui mappe l'image originale  à la carte des caractéristiques dans

à la carte des caractéristiques dans  , où H' et w' sont la hauteur et la largeur du masque panoramique. Le masque panoramique peut être de la même taille que l'image originale ou plus petit. Dans ce travail, les chercheurs ont utilisé ResNet comme réseau fédérateur, puis la couche d’encodeur de Transformer comme extracteur de fonctionnalités. Afin de garantir que la carte des caractéristiques de sortie a une résolution suffisante et contient des caractéristiques à différentes échelles, inspirées de l'U-Net et du réseau pyramidal des caractéristiques, les chercheurs ont utilisé la convolution avec des connexions bilatérales et des opérations de suréchantillonnage pour fusionner des caractéristiques de différentes résolutions. Bien que des encodeurs plus complexes puissent être utilisés, qui peuvent utiliser certaines des dernières avancées en matière de conception architecturale, ce n'est pas l'objectif principal du modèle de réseau. Les chercheurs utilisent donc simplement des extracteurs de fonctionnalités plus simples pour illustrer son rôle dans le modèle.

, où H' et w' sont la hauteur et la largeur du masque panoramique. Le masque panoramique peut être de la même taille que l'image originale ou plus petit. Dans ce travail, les chercheurs ont utilisé ResNet comme réseau fédérateur, puis la couche d’encodeur de Transformer comme extracteur de fonctionnalités. Afin de garantir que la carte des caractéristiques de sortie a une résolution suffisante et contient des caractéristiques à différentes échelles, inspirées de l'U-Net et du réseau pyramidal des caractéristiques, les chercheurs ont utilisé la convolution avec des connexions bilatérales et des opérations de suréchantillonnage pour fusionner des caractéristiques de différentes résolutions. Bien que des encodeurs plus complexes puissent être utilisés, qui peuvent utiliser certaines des dernières avancées en matière de conception architecturale, ce n'est pas l'objectif principal du modèle de réseau. Les chercheurs utilisent donc simplement des extracteurs de fonctionnalités plus simples pour illustrer son rôle dans le modèle.

Mask Decoder

Le décodeur affine de manière itérative le masque panoramique en fonction des caractéristiques de l'image lors de l'inférence du modèle. Plus précisément, le décodeur de masques utilisé par les chercheurs est TransUNet. Le réseau prend en entrée la concaténation d'une carte de caractéristiques d'image provenant du codeur et d'un masque de bruit (soit initialisé de manière aléatoire, soit de manière itérative à partir du processus de codage) et génère une prédiction précise du masque. Une différence entre le décodeur et l'architecture U-Net standard pour la génération d'images et la conversion image à image est que l'U-Net utilisé dans cet article utilise une couche de décodeur de transformateur avec une couche d'attention croisée au-dessus avant le suréchantillonnage pour fusionner. caractéristiques de l'image codée.

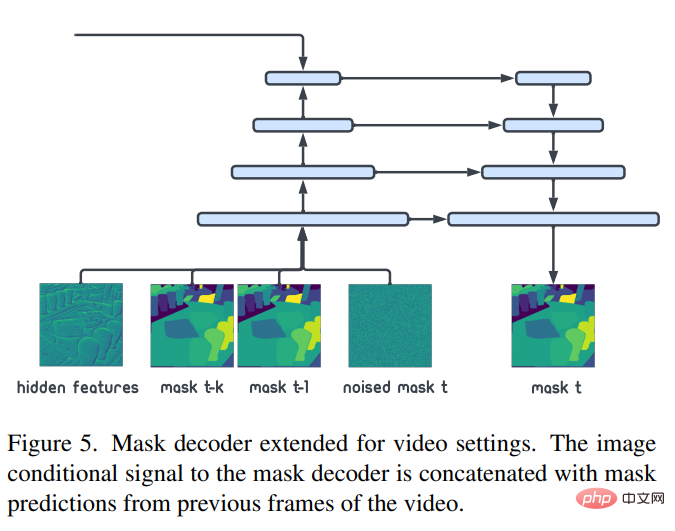

Application en mode vidéo

Le chercheur modélise le masque panoramique dans les conditions d'image telles que : p(m|x). Basé sur le masque tridimensionnel d'une vidéo donnée (avec une dimension temporelle supplémentaire), notre modèle peut être directement appliqué à la segmentation vidéo panoramique. Afin de s'adapter aux paramètres vidéo en ligne/streaming, la modélisation p(m_t|x_t,m_(t-1),m_(t-k)) peut être utilisée à la place pour générer un nouveau panorama basé sur l'image actuelle et le masque de la précédente. moment masque. Comme le montre la figure 5, ce changement peut être obtenu en concaténant le masque panoramique passé (m_(t-1), m_(t-k)) avec le masque de bruit existant. Hormis ce changement mineur, tout le reste est identique au modèle de base vidéo (p(m|x)). Ce modèle est très simple et peut être appliqué aux scènes vidéo en affinant le modèle de panorama d'image.

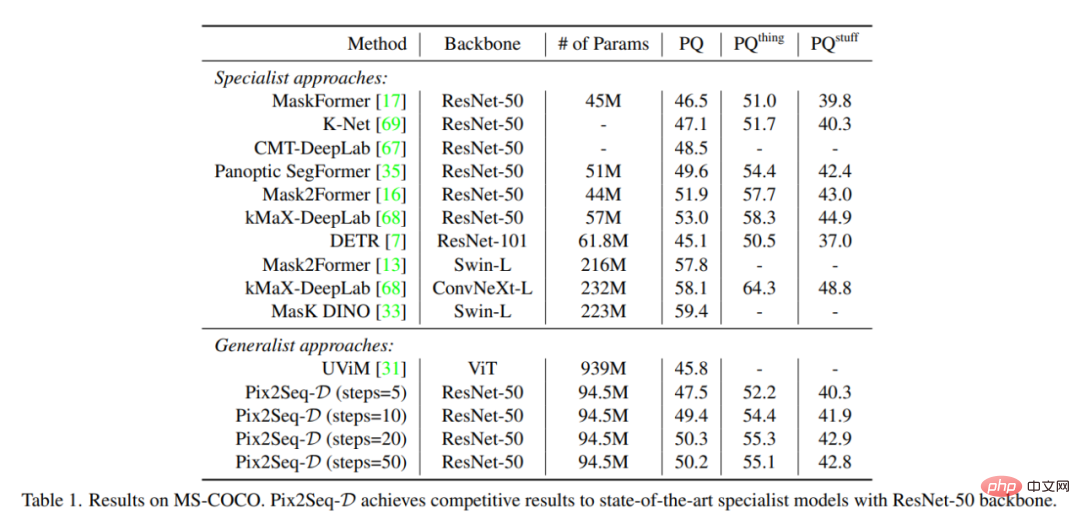

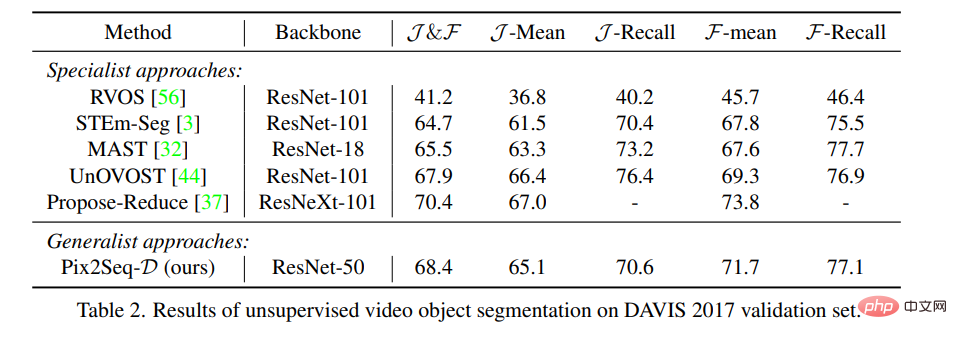

Cet article compare avec deux séries de méthodes de pointe, à savoir les méthodes expertes et les méthodes générales. Le tableau 1 résume les résultats sur l'ensemble de données MS-COCO. La qualité de généralisation (PQ) de Pix2Seq-D sur le squelette basé sur ResNet-50 est compétitive par rapport aux méthodes de pointe. Comparé à d’autres modèles récents à usage général tels que UViM, notre modèle est nettement plus performant tout en étant plus efficace.

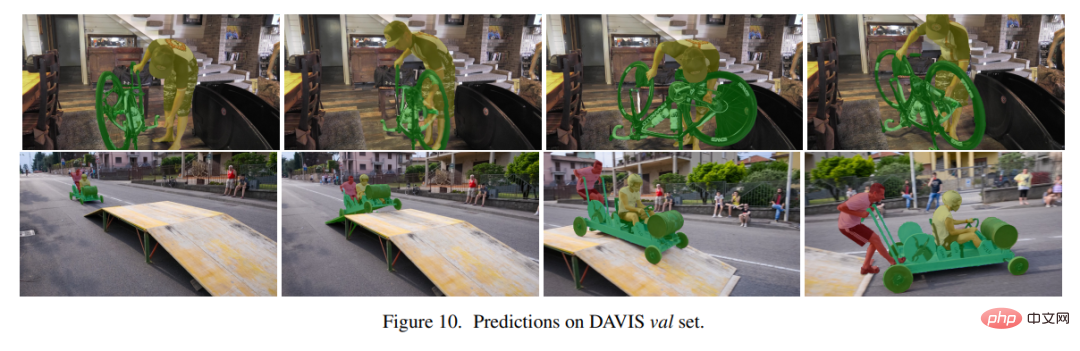

Le Tableau 2 compare Pix2Seq-D avec les méthodes de pointe pour la segmentation d'objets vidéo non supervisée sur l'ensemble de données DAVIS, en utilisant les métriques J&F standard. Il convient de noter que la référence n’inclut pas d’autres modèles généraux puisqu’ils ne sont pas directement applicables à la tâche. Notre méthode permet d’obtenir les mêmes résultats que les méthodes de pointe sans conception particulière.

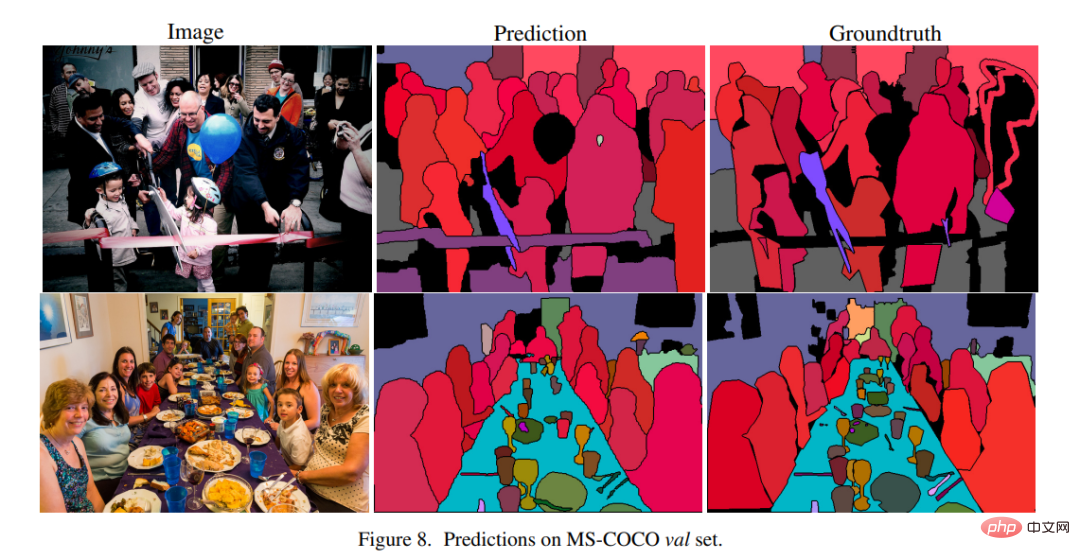

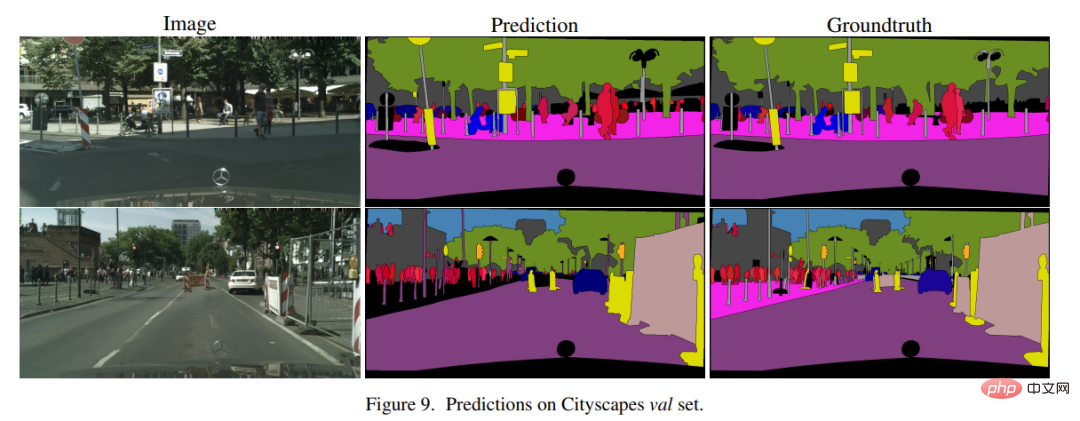

Les figures 8, 9 et 10 montrent des exemples de résultats de Pix2Seq-D sur MS-COCO, Cityscape et DAVIS.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Recommandation de classement des logiciels de détection de matériel informatique

Recommandation de classement des logiciels de détection de matériel informatique

Solution d'erreur HTTP 503

Solution d'erreur HTTP 503

Comment résoudre les caractères chinois tronqués devc

Comment résoudre les caractères chinois tronqués devc

Comment résoudre l'erreur d'analyse syntaxique

Comment résoudre l'erreur d'analyse syntaxique

La différence entre une pression sur une touche et une touche enfoncée

La différence entre une pression sur une touche et une touche enfoncée

Pièce de dragon d'inscription Bitcoin

Pièce de dragon d'inscription Bitcoin

Introduction aux modificateurs de contrôle d'accès Java

Introduction aux modificateurs de contrôle d'accès Java

Commande de fermeture du port CMD

Commande de fermeture du port CMD