Dans les tests standardisés et autres benchmarks, GPT-4 surpasse les modèles précédents, fonctionne dans des dizaines de langues et peut également prendre des images comme objets d'entrée, ce qui signifie qu'il peut comprendre les photos ou l'intention et la logique du diagramme.

Depuis que Microsoft a publié le modèle multimodal Kosmos-1 début mars, la société a testé et ajusté le modèle multimodal d'OpenAI et l'a rendu plus compatible avec les propres produits de Microsoft.

Effectivement, profitant de la sortie de GPT-4, Microsoft a également officiellement montré sa main. New Bing a déjà utilisé GPT-4.

Le modèle de langage utilisé par ChatGPT est GPT-3.5 En parlant de la façon dont GPT-4 est plus puissant que la version précédente, OpenAI a déclaré que même si les deux versions se ressemblent dans une conversation informelle, " " La différence apparaît lorsque. la complexité de la tâche atteint un seuil suffisant. » GPT-4 est plus fiable, plus créatif et capable de gérer des instructions plus nuancées.

1. Encore une fois époustouflant, meilleur que les humains

Si les modèles de la série GPT-3 prouvent à tout le monde que l'IA peut effectuer plusieurs tâches dans un seul modèle et indiquent le chemin pour atteindre l'AGI, GPT-4. a atteint des performances de niveau humain dans de nombreuses tâches, voire est plus performant que les humains. GPT-4 a dépassé 90 % des humains dans de nombreux examens académiques professionnels. Par exemple, lors de l'examen simulé du barreau, son score se situe dans les 10 % des meilleurs candidats. Comment les différentes écoles primaires et secondaires, les universités et les formations professionnelles doivent-elles réagir à cette situation ?

2. Alchimie "scientifique"

Bien qu'OpenAI n'ait pas annoncé de paramètres spécifiques cette fois, vous pouvez deviner que le modèle GPT-4 doit être assez grand. Trop de modèles signifie des coûts de formation élevés. Dans le même temps, former un modèle est également très similaire au « raffinage d'un élixir » et nécessite de nombreuses expériences. Si ces expériences sont formées dans un environnement réel, tout le monde ne peut pas supporter la pression élevée des coûts.

À cette fin, OpenAI a ingénieusement développé une « mise à l'échelle prévisible ». En bref, il utilise un dix millième du coût pour prédire les résultats de chaque expérience (perte et évaluation humaine). De cette façon, la formation originale à grande échelle en alchimie « chanceuse » a été améliorée en une formation en alchimie « semi-scientifique ».

3. Évaluation participative, faites d'une pierre deux coups

Cette fois, nous proposons des évaluations OpenAI open source de manière très "intelligente", ouverte à tous les développeurs ou passionnés via le crowdsourcing, et invitons tout le monde à utiliser Evals pour modèle de test tout en attirant l’écosystème des développeurs. Cette méthode donne non seulement à chacun un sentiment de participation, mais permet également à chacun de contribuer à évaluer et à améliorer le système gratuitement. OpenAI obtient directement des questions et des commentaires, faisant d'une pierre deux coups.

4. Réparation des fuites d'ingénierie

Cette fois, nous avons également publié une carte système, qui est un outil de « correctif » ouvert qui peut trouver des failles et réduire le problème de « non-sens » du modèle de langage. Divers correctifs ont été appliqués au système pour le pré-traitement et le post-traitement, et le code sera ouvert plus tard pour fournir les capacités de correctifs à tout le monde. OpenAI pourra peut-être permettre à tout le monde de l'aider à l'avenir. Cela marque que LLM est enfin passé d'une tâche de prédiction de prochain jeton élégante et simple à divers hacks d'ingénierie compliqués.

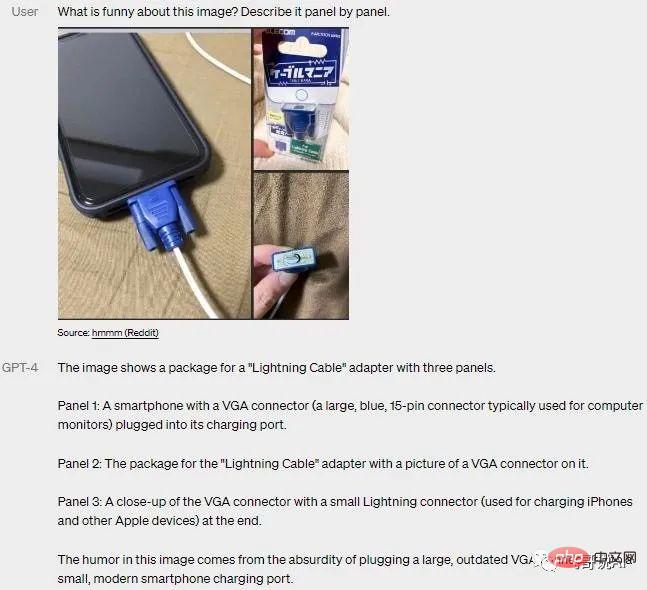

5. Multimodal

Depuis que Microsoft en Allemagne a révélé la semaine dernière que GPT-4 est multimodal, le public est très attendu.

GPT-4 existe depuis longtemps. La multimodalité, connue sous le nom de « comparable au cerveau humain », n'est en fait pas très différente des capacités multimodales décrites dans de nombreux articles actuels. La principale différence est qu'elles sont rares. du modèle de texte -shot est combiné avec une chaîne logique (COT). Le principe ici est qu'un LLM de texte avec de bonnes capacités de base et multimodalité est requis, ce qui produira de bons résultats.

6. Sortez "King Explosion" de manière planifiée

Selon la vidéo de démonstration d'OpenAI démontrant GPT-4, GPT-4 avait terminé sa formation dès août de l'année dernière, mais il n'a été publié que aujourd'hui, le reste du temps est consacré à des tests approfondis, à diverses corrections de bugs et, surtout, à la suppression de la génération de contenu dangereux.

Alors que tout le monde est encore immergé dans les incroyables capacités de génération de ChatGPT, OpenAI a déjà résolu GPT-4. Cette vague d'ingénieurs Google devra probablement veiller tard pour rattraper son retard ?

7. OpenAI n'est plus Open

OpenAI ne mentionne aucun paramètre de modèle ni échelle de données dans le document public (les paramètres GPT-4 transmis en ligne ont atteint 100 000 milliards), et il n'y a aucun principe technique. a expliqué que c'est dans l'intérêt du public, et j'ai peur qu'une fois que tout le monde aura appris à créer GPT-4, ils l'utiliseront pour faire le mal et déclencher des choses incontrôlables. Personnellement, je ne suis pas d'accord avec ce genre de choses. approche sans argent du tout.

8. Concentrez vos efforts sur les grandes choses

En plus de diverses « démonstrations de compétences », le journal utilise également trois pages pour répertorier toutes les personnes qui ont contribué aux différents systèmes de GPT-4. Une estimation approximative devrait être de plus d'une centaine de personnes, ce qui reflète une fois de plus l'unité. et un degré élevé de collaboration entre les membres de l'équipe interne d'OpenAI. En comparant cela aux capacités de combat en équipe d’autres sociétés, est-ce un peu en retard en termes d’efforts unis ?

Actuellement, les grands modèles multimodaux sont devenus la tendance et une direction importante pour le développement de l'ensemble du grand modèle d'IA. Dans cette « course aux armements » d'IA à grand modèle, des géants de la technologie tels que Google, Microsoft et DeepMind se lancent activement. grands modèles multimodaux (MLLM) ou grand modèle (LLM).

Microsoft : Kosmos-1

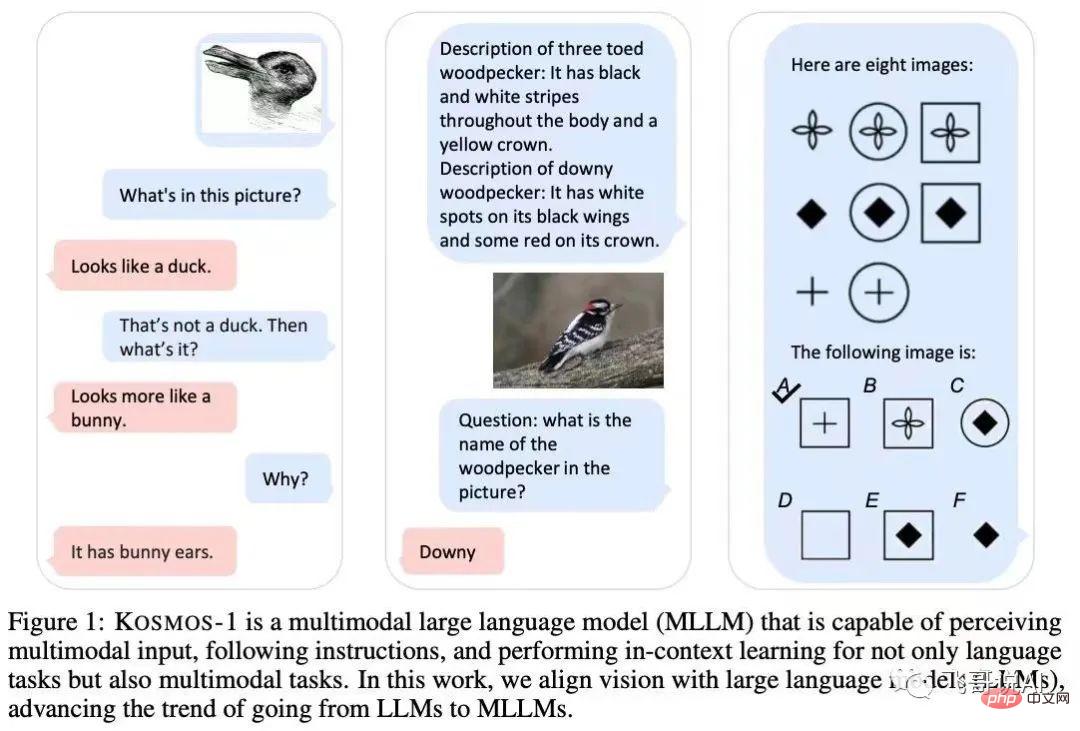

Microsoft a publié début mars le modèle multimodal Kosmos-1 avec 1,6 milliard de paramètres. est basé sur le modèle de langage causal Transformer. Parmi eux, le décodeur Transformer est utilisé comme interface universelle pour l’entrée multimodale.

En plus de diverses tâches en langage naturel, le modèle Kosmos-1 est capable de gérer nativement un large éventail de tâches à forte intensité de perception, telles que le dialogue visuel, l'explication visuelle, la réponse visuelle aux questions, les sous-titres d'images, les équations mathématiques simples, l'OCR et le zéro. -classification d'images prises avec description.

Google : PaLM-E

Début mars, l'équipe de recherche de Google et de l'Université technique de Berlin a lancé le plus grand modèle de langage visuel actuellement disponible, PaLM-E, avec un volume de paramètres allant jusqu'à 562. milliards (PaLM-540B+ViT-22B).

PaLM-E est un grand modèle uniquement de décodeur capable de générer des complétions de texte de manière autorégressive à partir d'un préfixe ou d'une invite. En ajoutant un encodeur au modèle, le modèle peut encoder des données d'image ou sensorielles dans une série de vecteurs de la même taille que les balises de langue, et les utiliser comme entrée pour la prochaine prédiction de jeton pour un entraînement de bout en bout.

DeepMind : Flamingo

DeepMind a lancé le modèle de langage visuel Flamingo en avril de l'année dernière. Le modèle utilise des images, des vidéos et des textes comme invites (invites) et génère des langages pertinents. Il n'a besoin que d'un petit nombre d'exemples spécifiques pour être résolu. de nombreux problèmes sans formation supplémentaire.

Entraînez le modèle en saisissant des images (vidéos) et du texte de manière croisée, afin que le modèle ait des capacités de raisonnement de séquence multimodale à quelques prises de vue et accomplisse diverses tâches telles que "la complétion de la description du texte, VQA / Text-VQA".

Actuellement, les grands modèles multimodaux ont montré davantage de possibilités d'application. En plus du diagramme vincentien relativement mature, un grand nombre d'applications telles que l'interaction homme-machine, le contrôle de robots, la recherche d'images et la génération de parole ont émergé les unes après les autres. .

Dans l'ensemble, GPT-4 ne sera pas AGI, mais les grands modèles multimodaux constituent déjà une direction de développement claire et définie. L'établissement d'un modèle de base multimodal unifié, multi-scénarios et multitâches deviendra l'une des tendances dominantes dans le développement de l'intelligence artificielle.

Hugo a déclaré : « La science rencontre l'imagination dans sa phase finale. » L'avenir des grands modèles multimodaux pourrait dépasser l'imagination humaine.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Quelles sont les techniques de test courantes ?

Quelles sont les techniques de test courantes ?

Utilisation de l'ordinateur Alibaba Cloud

Utilisation de l'ordinateur Alibaba Cloud

À quelle devise appartient l'USDT ?

À quelle devise appartient l'USDT ?

Comment utiliser les bugs de recherche

Comment utiliser les bugs de recherche

Solution pour diviser le tableau de mots en deux pages

Solution pour diviser le tableau de mots en deux pages

Comment ouvrir php dans une page Web

Comment ouvrir php dans une page Web

orientéb

orientéb

python configurer les variables d'environnement

python configurer les variables d'environnement