Les outils d'IA sont révolutionnaires et peuvent désormais tenir des conversations, générer du texte de type humain et créer des images basées sur un seul mot. Cependant, les données de formation utilisées par ces outils d'IA proviennent souvent de sources protégées par le droit d'auteur, en particulier lorsqu'il s'agit de générateurs de texte en image comme DALL-E, Midjourney et autres.

Il est difficile d'arrêter les outils d'IA générative utilisant des images protégées par le droit d'auteur pour s'entraîner, et les artistes de tous horizons ont eu du mal à protéger leur travail des ensembles de données d'entraînement de l'IA. Mais maintenant, tout change avec l'avènement de Nightshade, un outil d'IA gratuit conçu pour empoisonner le résultat des outils d'IA générative et permettre enfin aux artistes de reprendre un peu de pouvoir.

L'empoisonnement de l'IA est l'acte d'« empoisonner » l'ensemble de données d'entraînement d'un algorithme d'IA. Cela revient à fournir volontairement des informations erronées à l’IA, ce qui entraîne un dysfonctionnement de l’IA entraînée ou une incapacité à détecter une image. Des outils comme Nightshade modifient les pixels d'une image numérique de telle manière qu'elle semble complètement différente de la formation de l'IA sur celle-ci, mais en grande partie inchangée par rapport à l'original pour l'œil humain.

Par exemple, si vous téléchargez une image empoisonnée d'une voiture sur Internet, elle ressemblera à nous, les humains, mais une IA essayant de s'entraîner à identifier les voitures en regardant des images de voitures sur Internet verra quelque chose complètement différent.

Un échantillon suffisamment grand de ces images fausses ou empoisonnées dans les données d'entraînement d'une IA peut nuire à sa capacité à générer des images précises à partir d'une invite donnée, car la compréhension de l'objet par l'IA est compromise.

Il reste encore quelques questions sur ce que l'avenir réserve à l'IA générative, mais la protection des œuvres numériques originales est une priorité absolue. Cela peut même endommager les futures itérations du modèle, car les données d'entraînement sur lesquelles repose la base du modèle ne sont pas correctes à 100 %.

Grâce à cette technique, les créateurs numériques qui n'acceptent pas que leurs images soient utilisées dans des ensembles de données d'IA peuvent les empêcher d'être transmises à l'IA générative sans autorisation. Certaines plates-formes offrent aux créateurs la possibilité de refuser d’inclure leurs œuvres dans les ensembles de données de formation à l’IA. Cependant, ces listes de non-participation ont été ignorées par les formateurs de modèles d’IA dans le passé et continuent de l’être avec peu ou pas de conséquences.

Comparé à d'autres outils de protection d'œuvres d'art numériques comme Glaze, Nightshade est offensant. Glaze empêche les algorithmes d'IA d'imiter le style d'une image particulière, tandis que Nightshade modifie l'apparence de l'image selon celle de l'IA. Les deux outils sont conçus par Ben Zhao, professeur d'informatique à l'Université de Chicago.

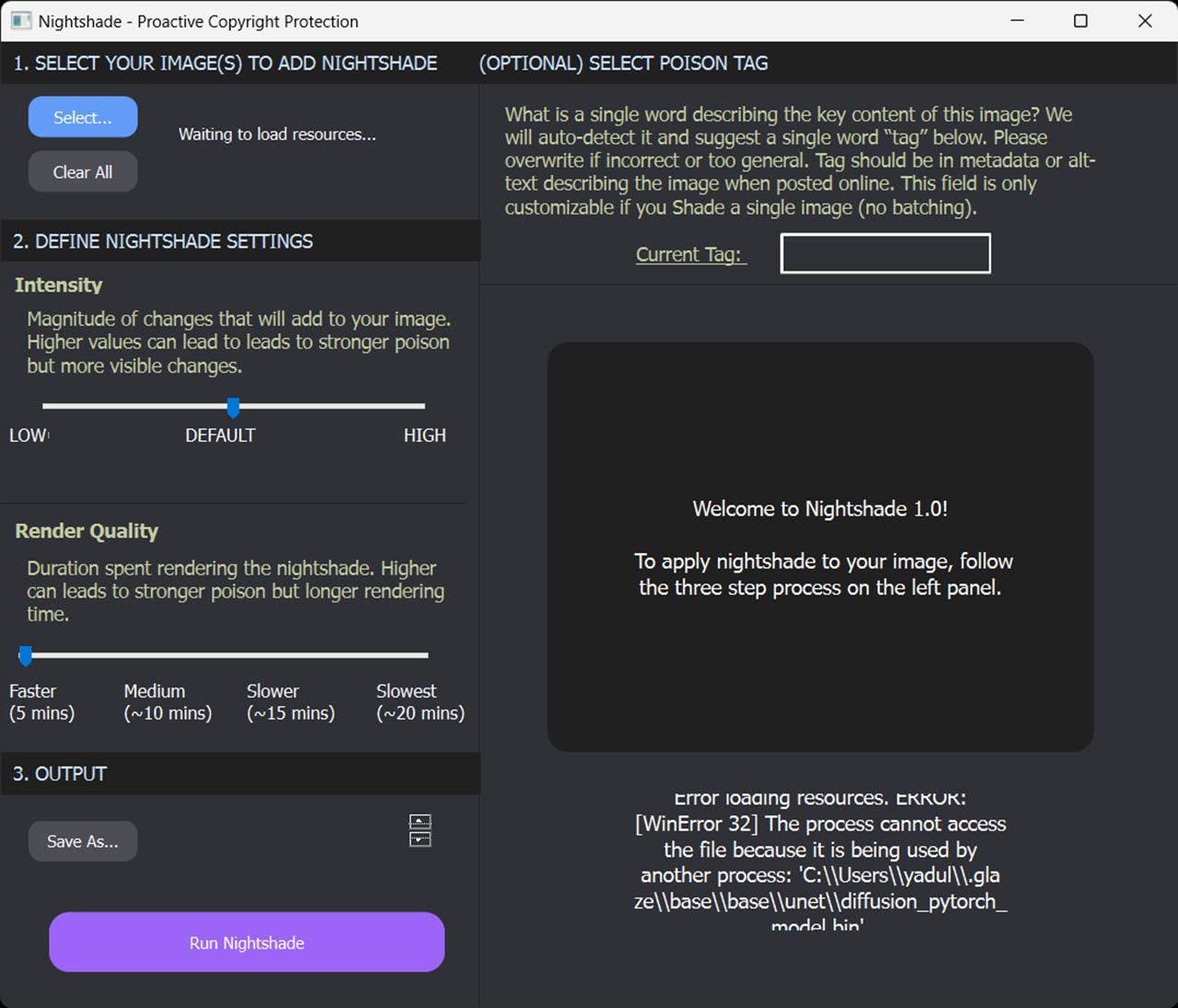

Bien que le créateur de l'outil recommande d'utiliser Nightshade avec Glaze, il peut également être utilisé comme un outil autonome pour protéger vos œuvres d'art. L'utilisation de l'outil est également assez simple, étant donné qu'il n'y a que trois étapes pour protéger vos images avec Nightshade.

Cependant, il y a quelques points que vous devez garder à l'esprit avant de vous lancer.

Nightshade est uniquement disponible pour Windows et MacOS avec une prise en charge GPU limitée et un minimum de 4 Go de VRAM requis. Les GPU non Nvidia et les Mac Intel ne sont pas pris en charge pour le moment. Voici une liste des GPU Nvidia pris en charge selon l'équipe Nightshade (les GPU GTX et RTX se trouvent dans la section "Produits GeForce et TITAN compatibles CUDA"). Alternativement, vous pouvez exécuter Nightshade sur votre processeur, mais cela entraînera des performances plus lentes. Si vous possédez une GTX 1660, 1650 ou 1550, un bug dans la bibliothèque PyTorch peut vous empêcher de lancer ou d'utiliser correctement Nightshade. L'équipe derrière Nightshade pourrait résoudre ce problème à l'avenir en passant de PyTorch à Tensorflow, mais il n'existe aucune solution de contournement pour le moment. Le problème s’étend également aux variantes Ti de ces cartes. J'ai lancé le programme en fournissant un accès administrateur sur mon PC Windows 11 et en attendant quelques minutes qu'il s'ouvre. Votre kilométrage peut varier. Si votre œuvre comporte de nombreuses formes ou arrière-plans solides, vous risquez de rencontrer des artefacts. Ceci peut être contré en utilisant une intensité « d’empoisonnement » plus faible.En ce qui concerne la protection de vos images avec Nightshade, voici ce que vous devez faire. Gardez à l'esprit que ce guide utilise la version Windows, mais ces étapes s'appliquent également à la version macOS.

Téléchargez la version Windows ou macOS à partir de la page de téléchargement de Nightshade. Nightshade se télécharge sous forme de dossier archivé sans aucune installation requise. Une fois le téléchargement terminé, extrayez le dossier ZIP et double-cliquez sur Nightshade.exe pour exécuter le programme. Sélectionnez l'image que vous souhaitez protéger en cliquant sur le bouton Sélectionner en haut à gauche. Vous pouvez également sélectionner plusieurs images à la fois pour un traitement par lots. Ajustez les molettes d'intensité et de qualité de rendu selon vos préférences. Des valeurs plus élevées ajoutent un empoisonnement plus fort mais peuvent également introduire des artefacts dans l'image de sortie. Ensuite, cliquez sur le bouton Enregistrer sous sous la section Sortie pour sélectionner une destination pour le fichier de sortie. Cliquez sur le bouton Exécuter Nightshade en bas pour exécuter le programme et empoisonner vos images.

Ajustez les molettes d'intensité et de qualité de rendu selon vos préférences. Des valeurs plus élevées ajoutent un empoisonnement plus fort mais peuvent également introduire des artefacts dans l'image de sortie. Ensuite, cliquez sur le bouton Enregistrer sous sous la section Sortie pour sélectionner une destination pour le fichier de sortie. Cliquez sur le bouton Exécuter Nightshade en bas pour exécuter le programme et empoisonner vos images. En option, vous pouvez également sélectionner une étiquette empoisonnée. Nightshade détectera et suggérera automatiquement une balise de mot unique si vous ne le faites pas, mais vous pouvez la modifier si elle est incorrecte ou trop générale. Gardez à l’esprit que ce paramètre n’est disponible que lorsque vous traitez une seule image dans Nightshade.

Si tout se passe bien, vous devriez obtenir une image identique à l'originale à l'œil humain, mais complètement différente d'un algorithme d'IA, protégeant ainsi votre œuvre de l'IA générative.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Tutoriel PHP

Tutoriel PHP

Erreur d'application plugin.exe

Erreur d'application plugin.exe

diablotin oracle

diablotin oracle

Quelles sont les méthodes pour implémenter la surcharge d'opérateurs en langage Go ?

Quelles sont les méthodes pour implémenter la surcharge d'opérateurs en langage Go ?

Comment configurer l'environnement pycharm

Comment configurer l'environnement pycharm

Comment écrire un triangle en CSS

Comment écrire un triangle en CSS

Comment définir le retour à la ligne automatique dans Word

Comment définir le retour à la ligne automatique dans Word

La différence entre maître et hôte

La différence entre maître et hôte