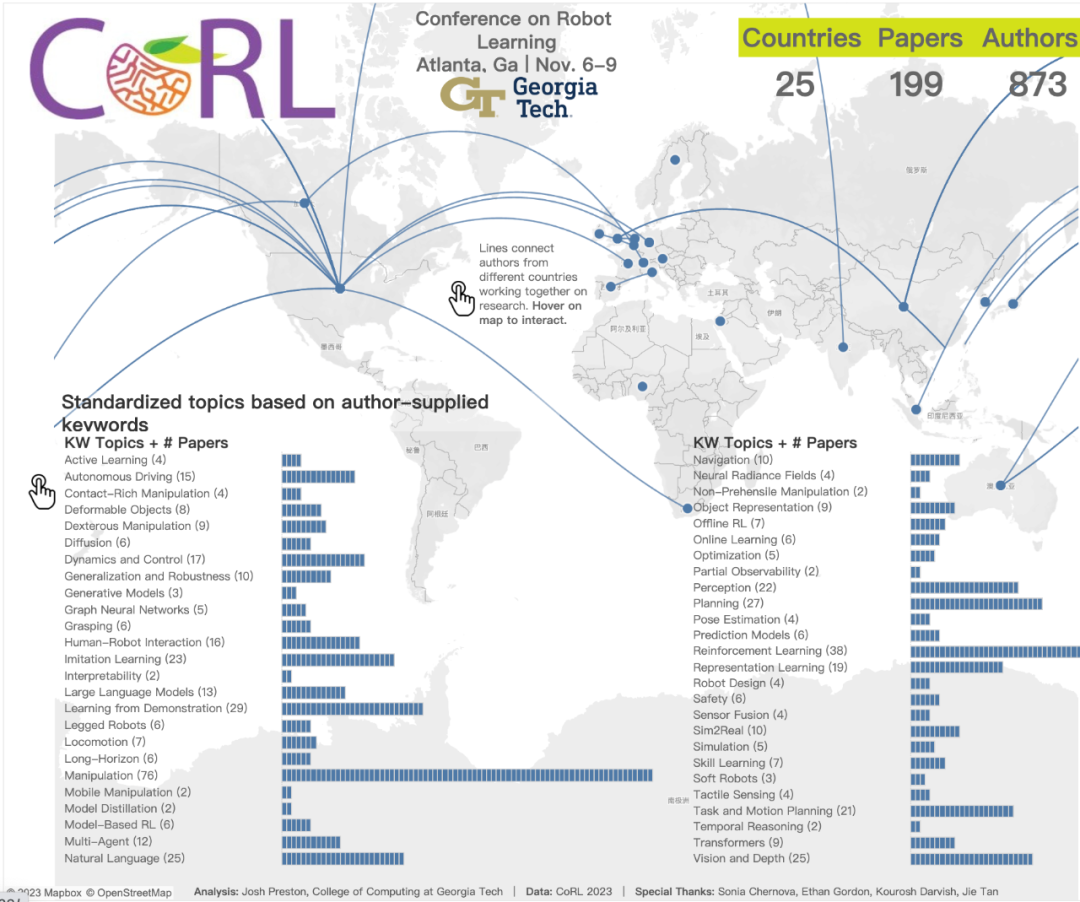

Seit der ersten Veranstaltung im Jahr 2017 hat sich CoRL zu einer der weltweit führenden akademischen Konferenzen an der Schnittstelle von Robotik und maschinellem Lernen entwickelt. CoRL ist eine Ein-Themen-Konferenz für Roboterlernforschung, die mehrere Themen wie Robotik, maschinelles Lernen und Steuerung, einschließlich Theorie und Anwendung, abdeckt. Die CoRL-Konferenz 2023 wird vom 6. bis 9. November in Atlanta, USA, stattfinden. Nach offiziellen Angaben wurden in diesem Jahr 199 Arbeiten aus 25 Ländern für CoRL ausgewählt. Beliebte Themen sind Operationen, Reinforcement Learning und mehr. Obwohl CoRL kleiner ist als große akademische KI-Konferenzen wie AAAI und CVPR, werden Konzepte wie große Modelle, verkörperte Intelligenz und humanoide Roboter in diesem Jahr immer beliebter. Auf der CoRL-Konferenz werden auch relevante Forschungsergebnisse vorgestellt, die Aufmerksamkeit verdienen

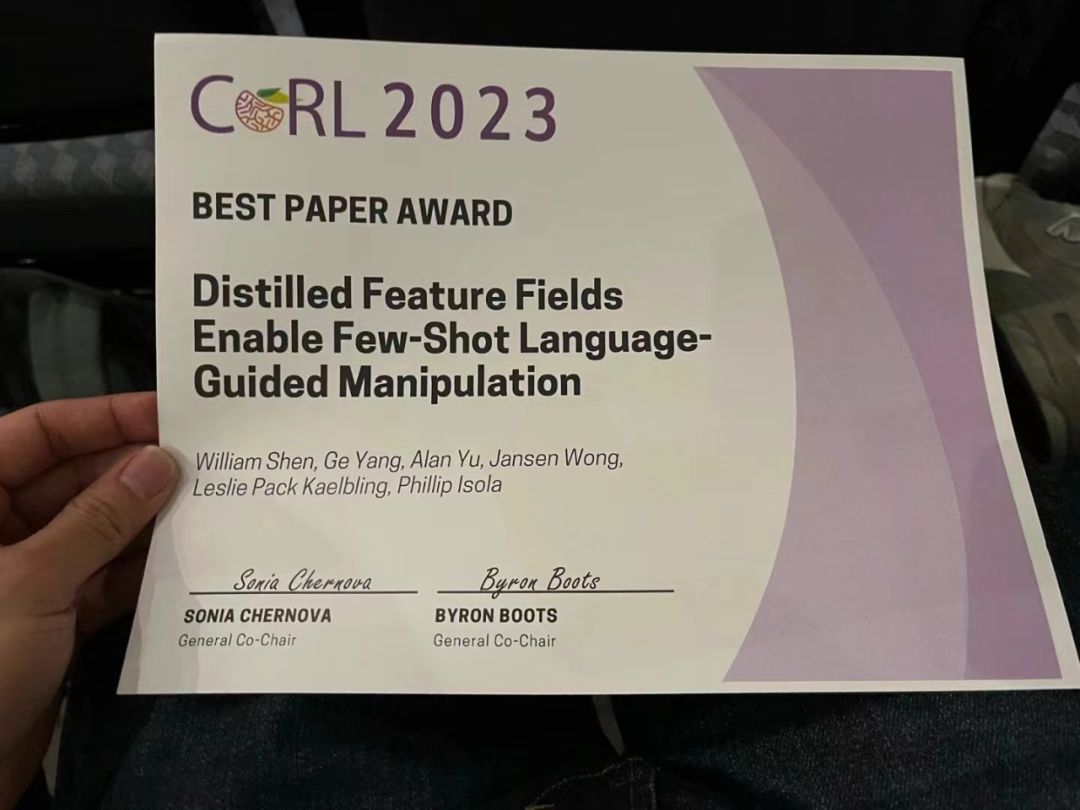

Derzeit hat CoRL 2023 den Best Paper Award, den Best Student Paper Award, den Best System Paper Award und andere Auszeichnungen offiziell bekannt gegeben. Als nächstes stellen wir Ihnen diese preisgekrönten Arbeiten vor.

Bester Aufsatz

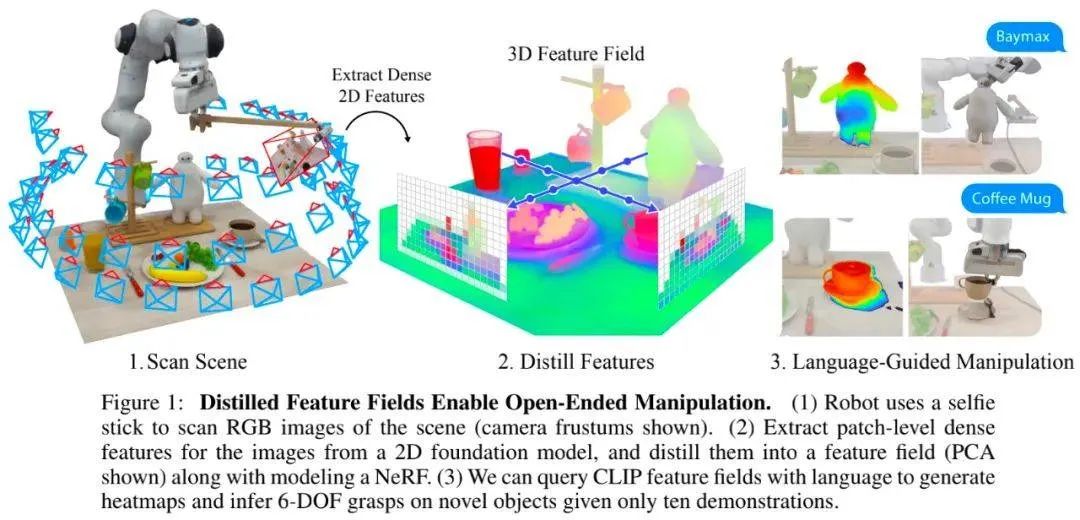

Aufsatz: Destillierte Funktionsfelder ermöglichen sprachgesteuerte Few-Shot-Manipulation

Aufsatz: Destillierte Funktionsfelder ermöglichen sprachgesteuerte Few-Shot-Manipulation

Durch die Verwendung von Distilled Feature Field (DFF) kombiniert diese Forschung präzise dreidimensionale Geometrie Umfangreiche Semantik aus dem 2D-Basismodell, um es dem Roboter zu ermöglichen, die umfangreichen visuellen und sprachlichen Prioritäten im 2D-Basismodell zu nutzen, um sprachgesteuerte Operationen abzuschließen. Das Erfassen und Platzieren des DOF wird vorgeschlagen und unter Verwendung starker räumlicher und semantischer Prioritäten auf unsichtbare Objekte verallgemeinert. Unter Verwendung von Merkmalen, die aus dem visuellen Sprachmodell CLIP extrahiert wurden, schlägt diese Studie eine offene Anweisung in natürlicher Sprache für die Bearbeitung neuer Objekte vor und demonstriert die Fähigkeit der Methode, auf unsichtbare Ausdrücke und neuartige Objekte zu verallgemeinern.

Die beiden Co-Autoren dieses Papiers sind William Shen und Yang Ge, Mitglieder des CSAIL „Embodied Intelligence“-Teams. Yang Ge ist Mitorganisator des CSAIL Embodied Intelligence Symposiums.

Ich habe erfahren, dass „Heart of the Machine“ diese Forschung im Detail vorgestellt hat. Bitte lesen Sie „Wie leistungsfähig sind Roboter, die von großen Modellen unterstützt werden? MIT CSAIL&IAIFI verwendet natürliche Sprache, um Roboter zum Greifen von Objekten zu führen.“

Ich habe erfahren, dass „Heart of the Machine“ diese Forschung im Detail vorgestellt hat. Bitte lesen Sie „Wie leistungsfähig sind Roboter, die von großen Modellen unterstützt werden? MIT CSAIL&IAIFI verwendet natürliche Sprache, um Roboter zum Greifen von Objekten zu führen.“

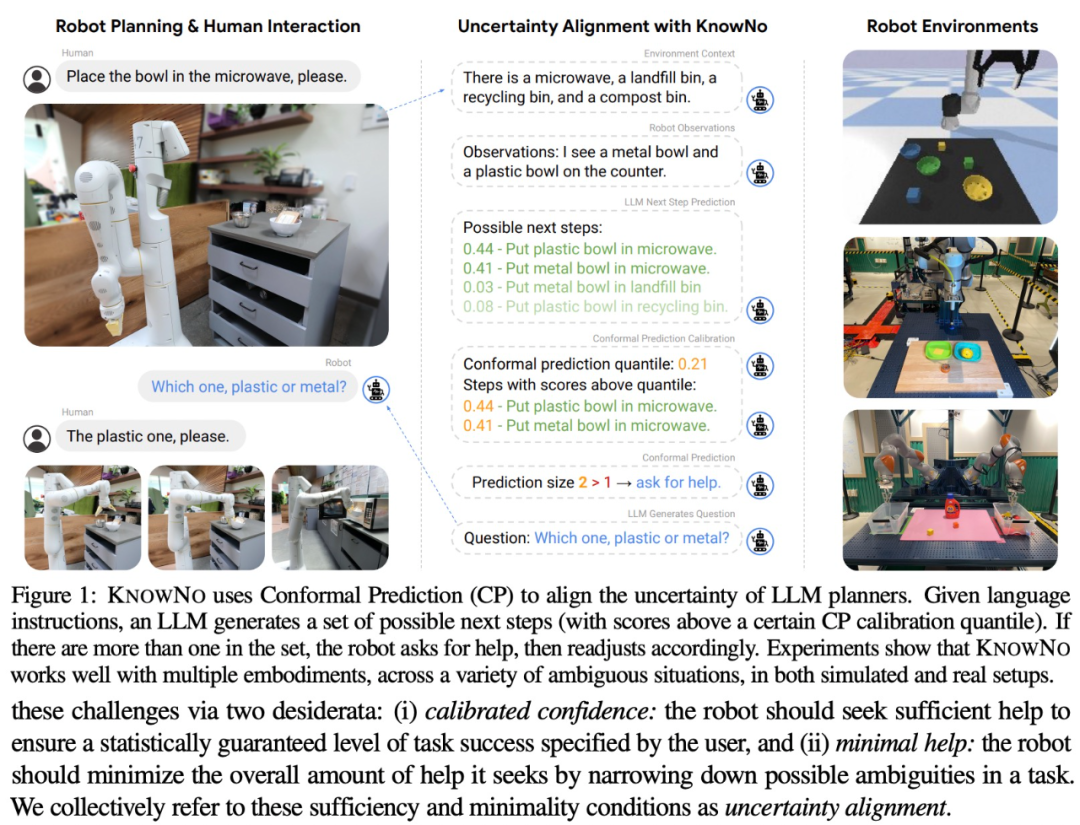

Bester Student Paper

Paper: Robots That Ask For Help: Uncertainty Alignment for Large Language Model Planners

Autor: Allen Z. Ren, Anushri Dixit, Alexandra Bodrova, Sumeet Singh, Stephen Tu, Noah Brown, Peng Xu, Leila Takayama, Fei Xia, Jake Varley, Zhenjia Xu, Dorsa Sadigh, Andy Zeng, Anirudha Majumdar.

KnowNo basiert auf der konformen Vorhersagetheorie, die statistische Garantien für die Erledigung von Aufgaben bietet und in der Lage ist, menschliche Eingriffe bei mehrstufigen Planungsaufgaben zu minimieren.

Die Forschung wurde an verschiedenen simulierten und realen Robotern durchgeführt Im Experiment wurde KnowNo mit verschiedenen Arten von Unsicherheitsaufgaben getestet (einschließlich räumlicher Unsicherheit, numerischer Unsicherheit usw.). Experimentelle Ergebnisse zeigen, dass KnowNo bei der Verbesserung von Effizienz und Autonomie gut abschneidet, die Basiswerte übertrifft und sicher und vertrauenswürdig ist. KnowNo kann direkt in LLM ohne Feinabstimmung des Modells verwendet werden, bietet eine effektive, leichtgewichtige Lösung für Modellunsicherheiten und ergänzt die zunehmenden Fähigkeiten des zugrunde liegenden Modells.

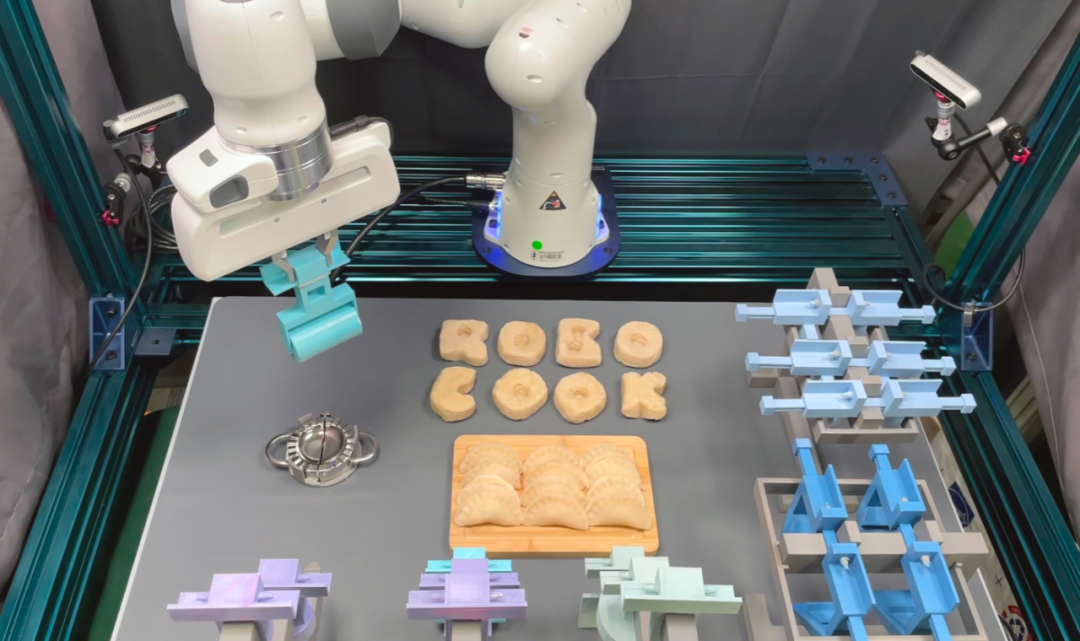

Papiereinführung: Menschen sind gut darin, verschiedene Werkzeuge herzustellen und zu verwenden. Für Roboter ist es jedoch immer noch eine große Herausforderung, zu verstehen, wie sie Werkzeuge effektiv nutzen und Vorgänge an entsprechenden Objekten durchführen können. Diese Forschung baute ein intelligentes Robotersystem namens RoboCook auf, das elastoplastische Objekte mithilfe verschiedener Werkzeuge erfassen, modellieren und manipulieren kann und kombinieren Sie die Tool-Klassifizierung mit selbstüberwachtem Policy-Lernen, um Aktionspläne zu entwickeln.

Diese Studie zeigt, dass RoboCook mit nur 20 Minuten realer Interaktionsdaten für jedes Werkzeug den Roboterarm erlernen und manipulieren kann, um einige komplexe, langfristige Aufgaben zur Manipulation elastisch-plastischer Objekte zu erledigen, wie zum Beispiel die Herstellung von Knödeln, Alphabetkekse usw.

Diese Studie zeigt, dass RoboCook mit nur 20 Minuten realer Interaktionsdaten für jedes Werkzeug den Roboterarm erlernen und manipulieren kann, um einige komplexe, langfristige Aufgaben zur Manipulation elastisch-plastischer Objekte zu erledigen, wie zum Beispiel die Herstellung von Knödeln, Alphabetkekse usw.

Den experimentellen Ergebnissen zufolge ist die Leistung von RoboCook deutlich besser als die der bestehenden SOTA-Methode, und es kann auch bei starken externen Störungen Stabilität zeigen, und seine Anpassungsfähigkeit an verschiedene Materialien ist ebenfalls besser

Es lohnt sich Erwähnung, dass die Co-Autoren dieses Papiers Haochen Shi, ein Doktorand der Stanford University, und Huazhe Xu, ein ehemaliger Postdoktorand an der Stanford University und jetzt Assistenzprofessor am Institut für interdisziplinäre Informationswissenschaft der Tsinghua University, sind Der Autor des Papiers ist Yao Ban Alumnus Wu Jiajun, Assistenzprofessor an der Stanford University.

Die Shortlist der Gewinnerbeiträge wurde bekannt gegeben

Das obige ist der detaillierte Inhalt vonDas chinesische Team gewann die Auszeichnungen „Best Paper' und „Best System Paper' und die CoRL-Forschungsergebnisse wurden bekannt gegeben.. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

Teambition

Teambition

Verwendung der Schreibfunktion

Verwendung der Schreibfunktion

Was sind die Voraussetzungen für eine Douyin-Liveübertragung?

Was sind die Voraussetzungen für eine Douyin-Liveübertragung?

Der Unterschied zwischen UCOS und Linux

Der Unterschied zwischen UCOS und Linux

Was sind die am häufigsten verwendeten Anweisungen in Vue?

Was sind die am häufigsten verwendeten Anweisungen in Vue?

So lösen Sie das Problem, dass JS-Code nach der Formatierung nicht ausgeführt werden kann

So lösen Sie das Problem, dass JS-Code nach der Formatierung nicht ausgeführt werden kann

So springen Sie mit Parametern in vue.js

So springen Sie mit Parametern in vue.js

Was bedeutet Handy-HD?

Was bedeutet Handy-HD?