在时间序列预测中,Transformer已经展示出了强大的能力,可以用来描述依赖关系和提取多层次表示。然而,一些研究人员对基于Transformer的预测器的有效性提出了质疑。这种预测器通常将同一时间戳的多个变量嵌入到不可区分的通道中,并关注这些时间标记,以捕捉时间依赖性。研究人员发现,考虑数字关系而非语义关系的简单线性层在性能和效率上都超过了复杂的Transformer。与此同时,确保变量的独立性和利用互信息的重要性越来越受到最新研究的关注。这些研究明确建立了多变量相关性模型,以实现精确的预测。然而,在不颠覆常见的Transformer架构的情况下,实现这一目标仍然具有一定的难度

在考虑到基于Transformer的预测器引起的争议时,研究人员们正在思考为什么Transformer在时间序列预测方面的表现甚至不如线性模型,而在许多其他领域却占据主导地位

近日,来自清华大学的一篇新论文提出了一个不同的视角 ——Transformer 的性能不是固有的,而是由于将架构不当地应用于时间序列数据造成的。

论文的链接是:https://arxiv.org/pdf/2310.06625.pdf

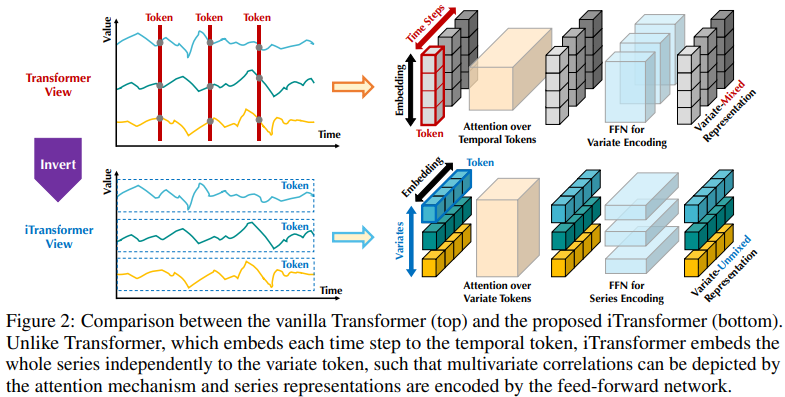

基于Transformer的预测器的现有结构可能不适合多变量时间序列预测。图2左侧显示,同一时间步长的点代表不同的物理意义,但测量结果不一致,这些点被嵌入到一个令牌中,多变量相关性被忽略。此外,在现实世界中,由于多变量时间点的局部感受野和时间戳不对齐,单个时间步鲜有有益信息的标记。另外,尽管序列变化受到序列顺序的重大影响,但时间维度上的变体注意力机制并未得到充分采用。因此,Transformer在捕捉基本序列表示和描述多元相关性方面的能力受到削弱,限制了其在不同时间序列数据上的能力和泛化能力

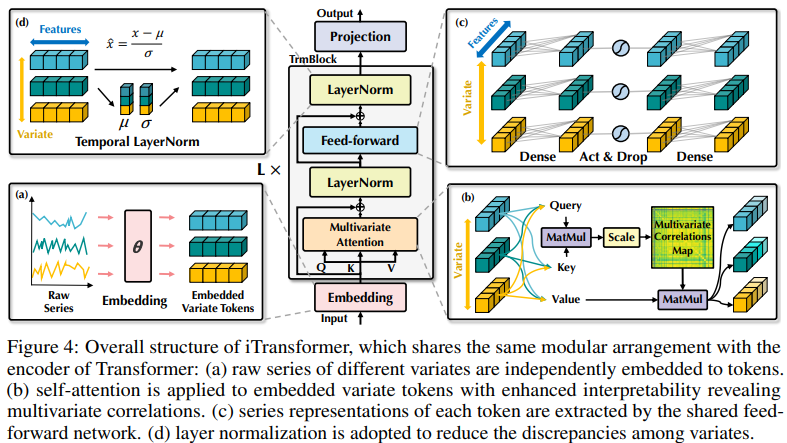

关于将每个时间步的多变量点嵌入一个(时间)token 的不合理性,研究者从时间序列的反向视角出发,将每个变量的整个时间序列独立嵌入一个(变量)token,这是扩大局部感受野的 patching 的极端情况。通过倒置,嵌入的 token 聚集了序列的全局表征,可以更加以变量为中心,更好地利用注意力机制进行多变量关联。同时,前馈网络可以熟练地学习任意回溯序列编码的不同变量的泛化表征,并解码以预测未来序列。

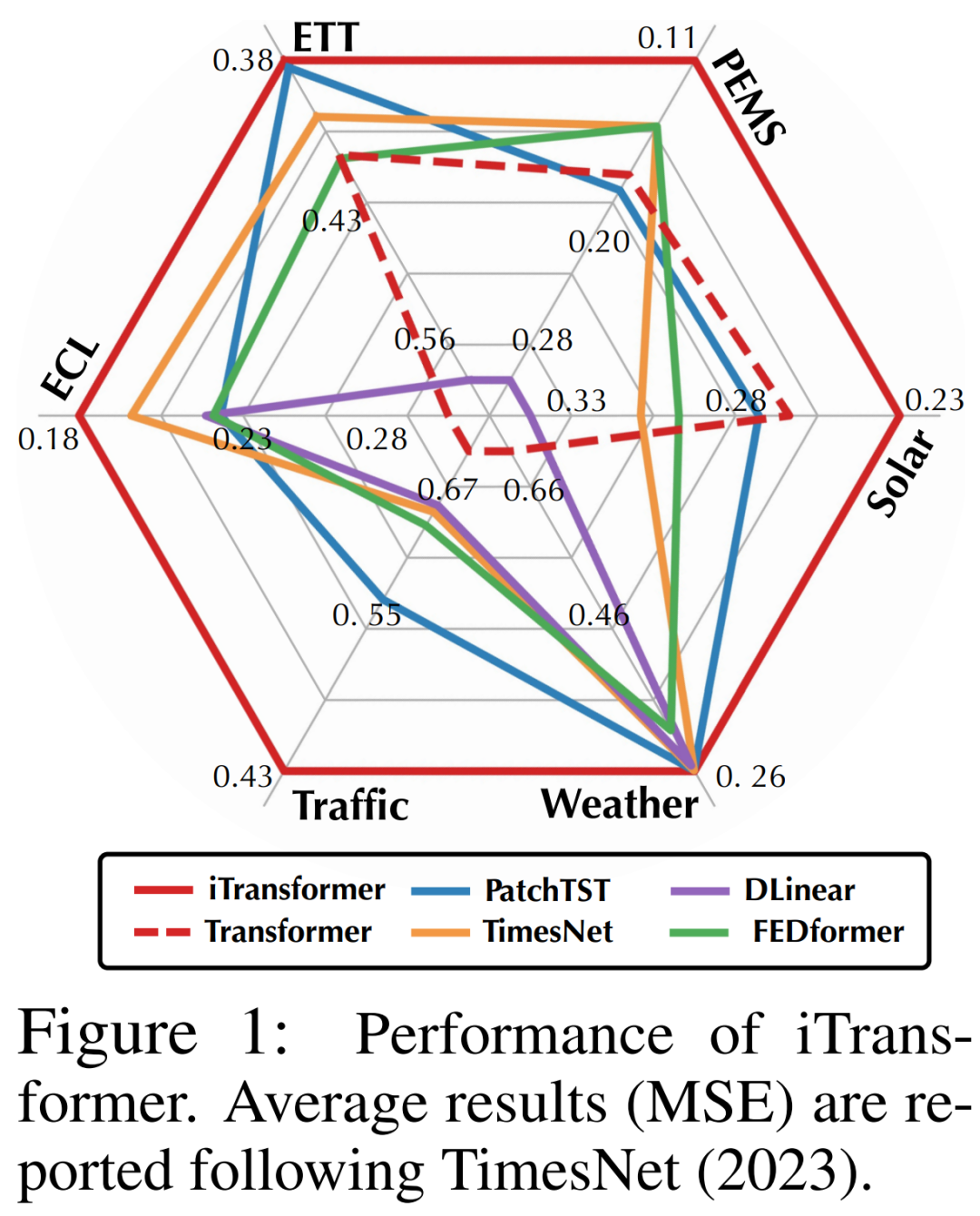

研究者指出,对于时间序列预测来说,Transformer并非无效,而是其使用方式不当。在这篇论文中,研究者对Transformer的结构进行了重新审视,并推崇将iTransformer作为时间序列预测的基础支柱。他们将每个时间序列嵌入为变量token,并采用多变量相关性关注机制,利用前馈网络进行序列编码。实验结果表明,所提出的iTransformer在实际预测基准图1中达到了最先进水平,并出人意料地解决了基于Transformer的预测器所面临的问题

总结来说,本文的贡献有以下三点:

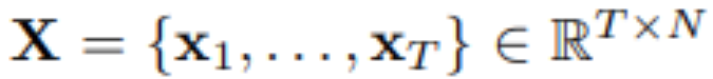

在多变量时间序列预测中,给定历史观测:

用 T 个时间步长和 N 个变量,研究者预测未来的 S 个时间步长: 。为方便起见,表示为

。为方便起见,表示为 为时间步 t 同时记录的多元变量,

为时间步 t 同时记录的多元变量, 为每个变量由 n 索引的整个时间序列。值得注意的是,在现实世界中,由于监视器的系统延迟和松散组织的数据集,

为每个变量由 n 索引的整个时间序列。值得注意的是,在现实世界中,由于监视器的系统延迟和松散组织的数据集, 可能不包含本质上相同时间戳的时间点。

可能不包含本质上相同时间戳的时间点。

的元素可以在物理测量和统计分布中彼此不同,变量

的元素可以在物理测量和统计分布中彼此不同,变量 通常共享这些数据。

通常共享这些数据。

本文所提出架构配备的 Transformer 变体,称为 iTransformer,基本上没有对 Transformer 变体提出更具体的要求,只是注意力机制应适用于多元相关性建模。因此,一组有效的注意力机制可以作为插件,降低变量数量增加时关联的复杂性。

iTransformer 在第四张图中展示,采用了更为简单的Transformer编码器架构,其中包括嵌入、投影和Transformer块

研究人员对iTransformer在各种时间序列预测应用中进行了全面评估,证实了该框架的通用性,并进一步研究了针对特定时间序列维度反转Transformer组件职责的效果

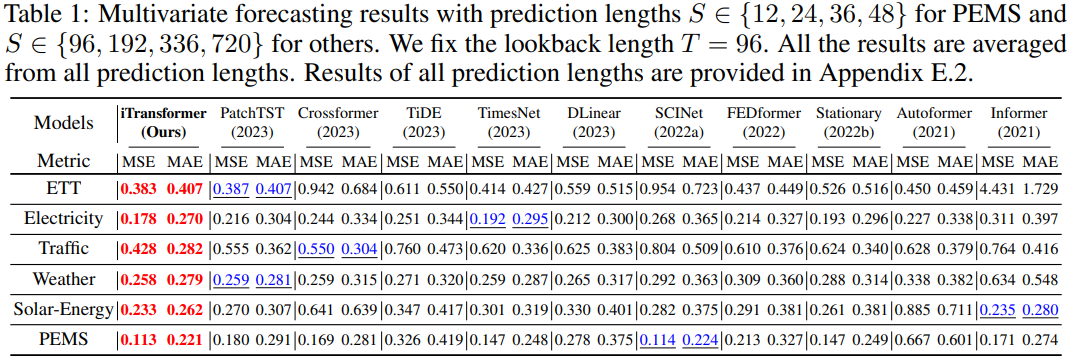

研究者在实验中广泛纳入了6个真实世界数据集,包括ETT、天气、电力、交通数据集、太阳能数据集以及PEMS数据集。详细的数据集信息请参考原文

重写的内容是:预测结果

如表 1 所示,用红色表示最优,下划线表示最优。MSE/MAE 越低,重写的内容是:预测结果越准确。本文所提出的 iTransformer 实现了 SOTA 性能。原生 Transformer 组件可以胜任时间建模和多元关联,所提出的倒排架构可以有效解决现实世界的时间序列预测场景。

需要改写的内容为:iTransformer 的普适性

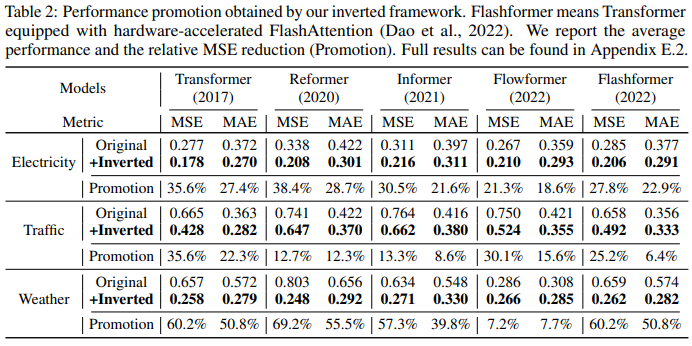

将该框架应用于Transformer及其变体来评估iTransformers的研究者发现,这些变体通常解决了self-attention机制的二次复杂性问题,包括Reformer、Informer、Flowformer和FlashAttention。研究者还发现,简单的倒置视角可以提高基于Transformer的预测器的性能,提高效率、泛化未见变量,并更好地利用历史观测数据

表 2 对 Transformers 和相应的 iTransformers 进行了评估。值得注意的是,该框架持续改进了各种 Transformer。总体而言,Transformer 平均提升了 38.9%,Reformer 平均提升了 36.1%,Informer 平均提升了 28.5%,Flowformer 平均提升了 16.8%,Flashformer 平均提升了 32.2%。

还有一个因素是,iTransformer 可以广泛应用于基于 Transformer 的预测器,因为它在变量维度上采用了注意力机制的倒置结构,引入了具有线性复杂性的高效注意力,从根本上解决了由于 6 个变量而引起的效率问题。这个问题在现实世界的应用中很常见,但对于 Channel Independent 来说可能会消耗资源

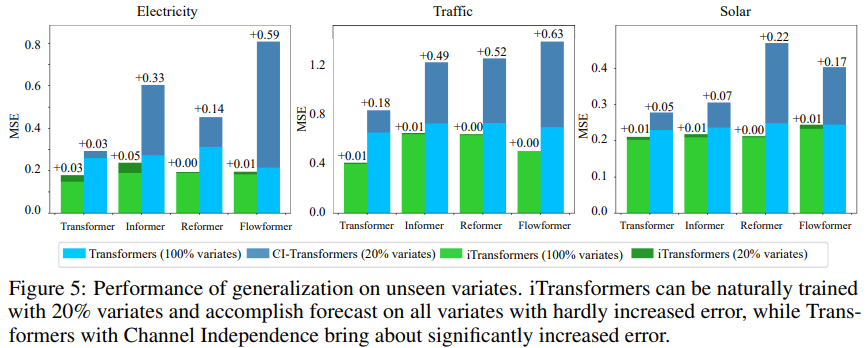

为了验证假设,研究者将 iTransformer 与另一种泛化策略进行了比较:Channel Independent 强制采用一个共享 Transformer 来学习所有变体的模式。如图 5 所示, Channel Independent(CI-Transformers)的泛化误差可能会大幅增加,而 iTransformer 预测误差的增幅要小得多。

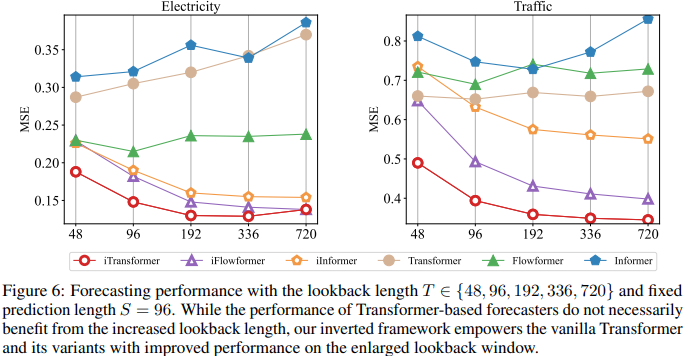

由于注意力和前馈网络的职责是倒置的,图 6 中评估了随着回视长度的增加,Transformers 和 iTransformer 的性能。它验证了在时间维度上利用 MLP 的合理性,即 Transformers 可以从延长的回视窗口中获益,从而获得更精确的预测。

模型分析

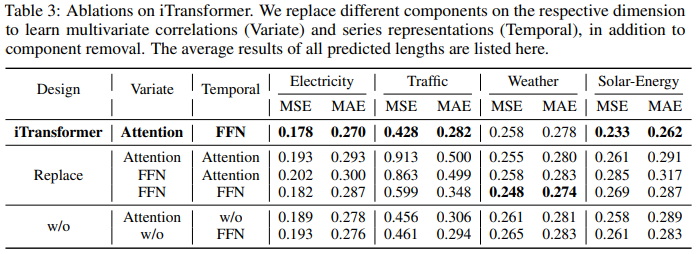

为了验证 Transformer 组件的合理性,研究者进行了详细的消融实验,包括替换组件(Replace)和移除组件(w/o)实验。表 3 列出了实验结果。

更多详细内容,请参考原文。

以上是重新审视Transformer:倒置更有效,真实世界预测的新SOTA出现了的详细内容。更多信息请关注PHP中文网其他相关文章!