大模型“识图”能力都这么强了,为啥还老找错东西?

例如,把长得不太像的蝙蝠和拍子搞混,又或是认不出一些数据集中的稀有鱼类……

这是因为,我们让大模型“找东西”时,往往输入的是文本。

如果描述有歧义或太偏门,像是“bat”(蝙蝠还是拍子?)或“魔鳉”(Cyprinodon diabolis),AI就会大为困惑。

这就导致用大模型做目标检测、尤其是开放世界(未知场景)目标检测任务时,效果往往没有想象中那么好。

现在,一篇被NeurIPS 2023收录的论文,终于解决了这个问题。

论文提出了一种基于多模态查询的目标检测方法MQ-Det,只需要给输入加上一个图片示例,就能让大模型找东西的准确率大幅提升。

在基准检测数据集LVIS上,无需下游任务模型微调,MQ-Det平均提升主流检测大模型GLIP精度约7.8%,在13个基准小样本下游任务上,平均提高了6.3%精度。

这究竟是怎么做到的?一起来看看。

以下内容转载自论文作者、知乎博主@沁园夏:

论文名称:Multi-modal Queried Object Detection in the Wild

论文链接://m.sbmmt.com/link/9c6947bd95ae487c81d4e19d3ed8cd6f

代码地址://m.sbmmt.com/link/2307ac1cfee5db3a5402aac9db25cc5d

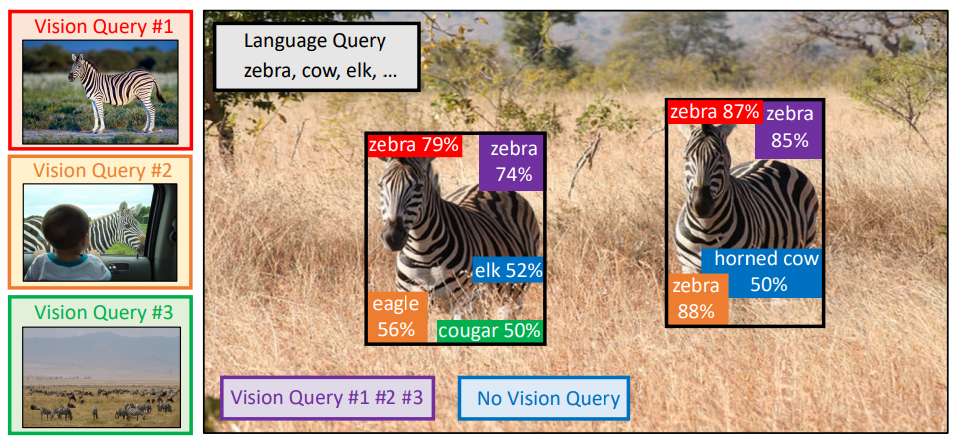

一图胜千言:随着图文预训练的兴起,借助文本的开放语义,目标检测逐渐步入了开放世界感知的阶段。为此,许多检测大模型都遵循了文本查询的模式,即利用类别文本描述在目标图像中查询潜在目标。然而,这种方式往往会面临“广而不精”的问题。

例如,(1)图1中的细粒度物体(鱼种)检测,往往很难用有限的文本来描述各种细粒度的鱼种,(2)类别歧义(“bat”既可指蝙蝠又可指拍子)。

然而,以上的问题均可通过图像示例来解决,相比文本,图像能够提供目标物体更丰富的特征线索,但同时文本又具备强大的泛化性。

由此,如何能够有机地结合两种查询方式,成为了一个很自然的想法。

获取多模态查询能力的难点:如何得到这样一个具备多模态查询的模型,存在三个挑战:(1)直接用有限的图像示例进行微调很容易造成灾难性遗忘;(2)从头训练一个检测大模型会具备较好的泛化性但是消耗巨大,例如,单卡训练GLIP 需要利用3000万数据量训练480 天。

多模态查询目标检测:基于以上考虑,作者提出了一种简单有效的模型设计和训练策略——MQ-Det。

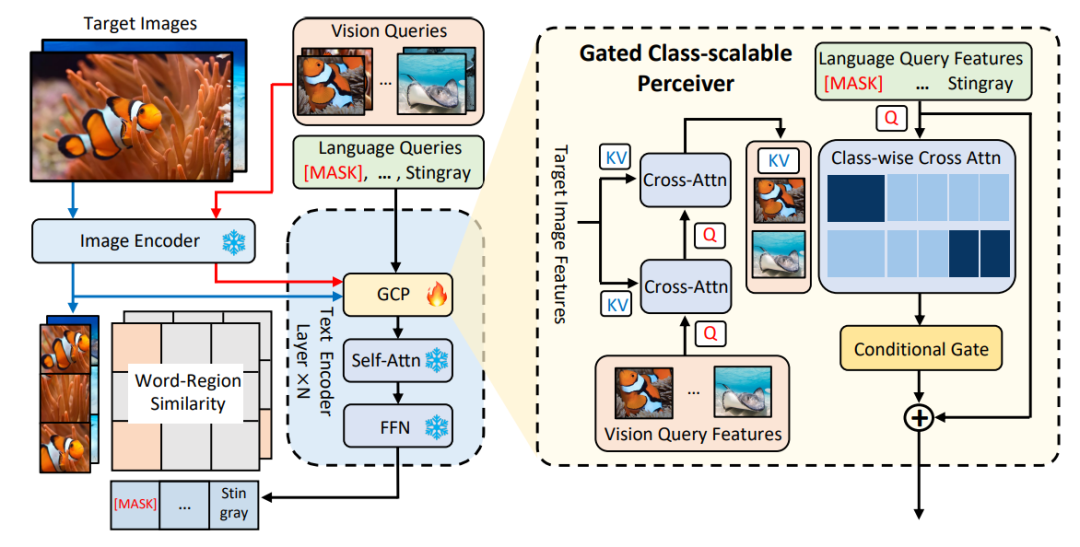

MQ-Det在已有冻结的文本查询检测大模型基础上插入少量门控感知模块(GCP)来接收视觉示例的输入,同时设计了视觉条件掩码语言预测训练策略高效地得到高性能多模态查询的检测器。

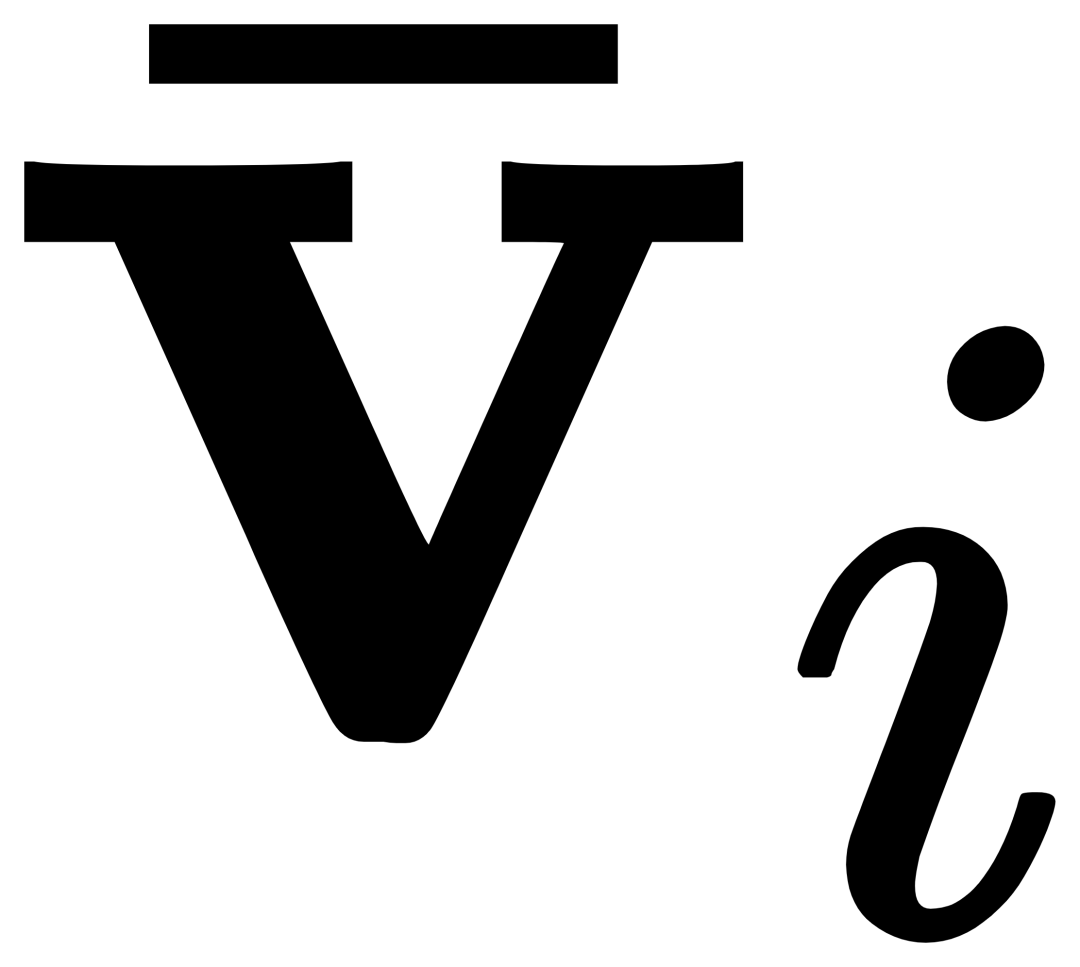

△图1 MQ-Det方法架构图

门控感知模块

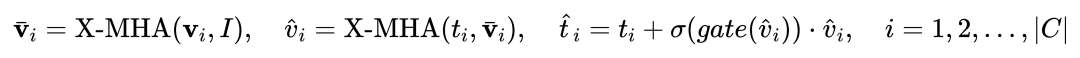

如图1所示,作者在已有冻结的文本查询检测大模型的文本编码器端逐层插入了门控感知模块(GCP),GCP的工作模式可以用下面公式简洁地表示:

对于第i个类别,输入视觉示例Vi,其首先和目标图像I进行交叉注意力(X-MHA)得到 以增广其表示能力,而后每个类别文本ti会和对应类别的视觉示例

以增广其表示能力,而后每个类别文本ti会和对应类别的视觉示例 进行交叉注意力得到

进行交叉注意力得到 ,之后通过一个门控模块gate将原始文本ti和视觉增广后文本

,之后通过一个门控模块gate将原始文本ti和视觉增广后文本 融合,得到当前层的输出

融合,得到当前层的输出 。这样的简单设计遵循了三点原则:(1)类别可扩展性;(2)语义补全性;(3)抗遗忘性,具体讨论可见原文。

。这样的简单设计遵循了三点原则:(1)类别可扩展性;(2)语义补全性;(3)抗遗忘性,具体讨论可见原文。

基于冻结语言查询检测器的调制训练

由于目前文本查询的预训练检测大模型本身就具备较好的泛化性,论文作者认为,只需要在原先文本特征基础上用视觉细节进行轻微地调整即可。

在文章中也有具体的实验论证发现,打开原始预训练模型参数后进行微调很容易带来灾难性遗忘的问题,反而失去了开放世界检测的能力。

由此,MQ-Det在冻结文本查询的预训练检测器基础上,仅调制训练插入的GCP模块,就可以高效地将视觉信息插入到现有文本查询的检测器中。

在论文中,作者分别将MQ-Det的结构设计和训练技术应用于目前的SOTA模型GLIP和GroundingDINO ,来验证方法的通用性。

以视觉为条件的掩码语言预测训练策略

作者还提出了一种视觉为条件的掩码语言预测训练策略,来解决冻结预训练模型带来的学习惰性的问题。

所谓学习惰性,即指检测器在训练过程中倾向于保持原始文本查询的特征,从而忽视新加入的视觉查询特征。

为此,MQ-Det在训练时随机地用[MASK] token来替代文本token,迫使模型向视觉查询特征侧学习,即:

这个策略虽然简单,但是却十分有效,从实验结果来看这个策略带来了显著的性能提升。

Finetuning-free:相比传统零样本(zero-shot)评估仅利用类别文本进行测试,MQ-Det提出了一种更贴近实际的评估策略:finetuning-free。其定义为:在不进行任何下游微调的条件下,用户可以利用类别文本、图像示例、或者两者结合来进行目标检测。

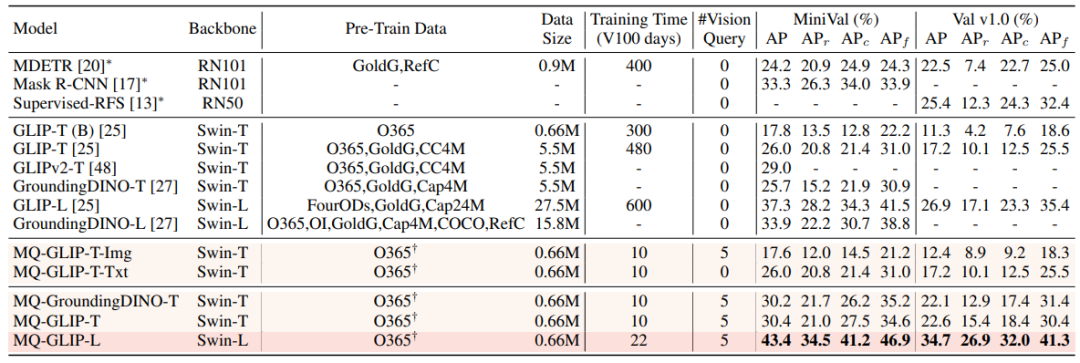

在finetuning-free的设定下,MQ-Det对每个类别选用了5个视觉示例,同时结合类别文本进行目标检测,而现有的其他模型不支持视觉查询,只能用纯文本描述进行目标检测。下表展示了在LVIS MiniVal和LVIS v1.0上的检测结果。可以发现,多模态查询的引入大幅度提升了开放世界目标检测能力。

△表1 各个检测模型在LVIS基准数据集下的finetuning-free表现

从表1可以看到,MQ-GLIP-L在GLIP-L基础上提升了超过7%AP,效果十分显着!

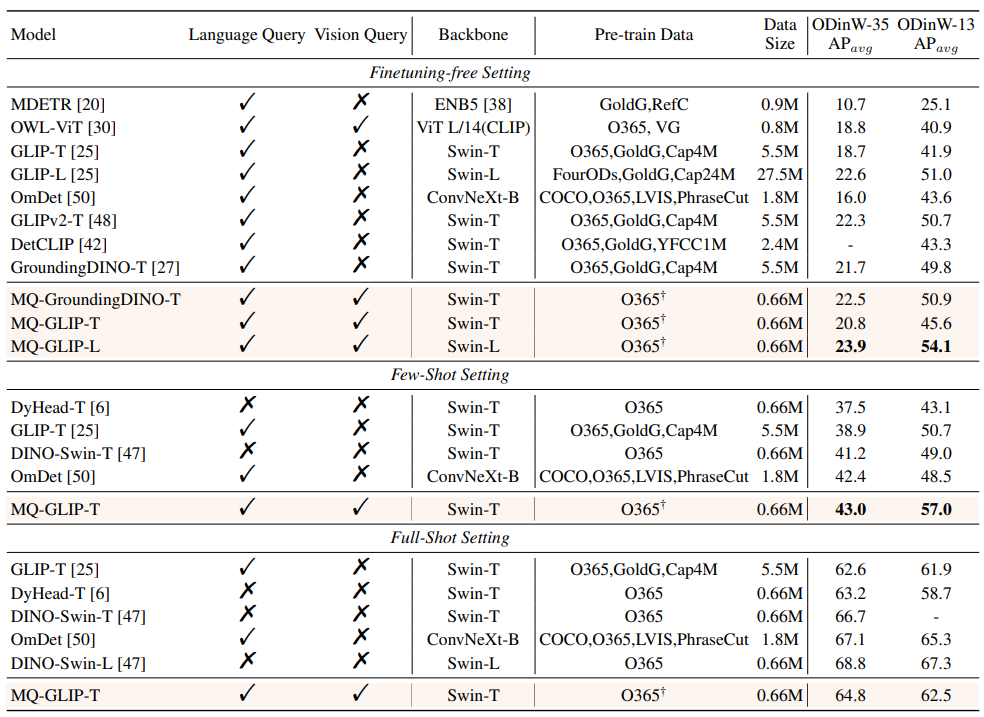

△表2 各个模型在35个检测任务ODinW-35以及其13个子集ODinW-13中的表现

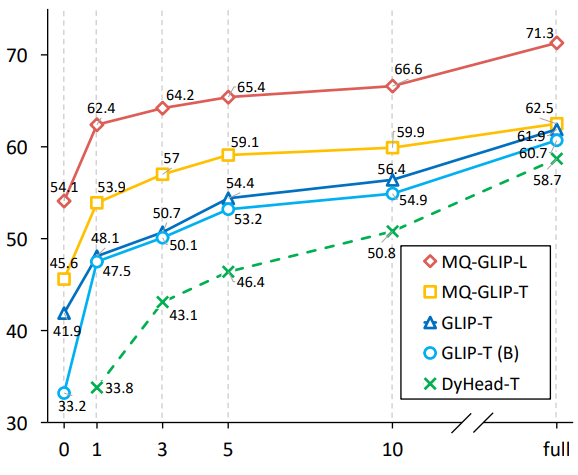

作者还进一步在下游35个检测任务ODinW-35中进行了全面的实验。由表2可以看到,MQ-Det除了强大的finetuning-free表现,还具备良好的小样本检测能力,进一步印证了多模态查询的潜力。图2也展示了MQ-Det对于GLIP的显着提升。

△图2 数据利用效率对比;横轴:训练样本数量,纵轴:OdinW-13上的平均AP

目标检测作为一个以实际应用为基础的研究领域,非常注重算法的落地。

尽管以往的纯文本查询目标检测模型展现出了良好的泛化性,但是在实际的开放世界检测中文本很难涵盖细粒度的信息,而图像中丰富的信息粒度完美地补全了这一环。

至此我们能够发现,文本泛而不精,图像精而不泛,如果能够有效地结合两者,即多模态查询,将会推动开放世界目标检测进一步向前迈进。

MQ-Det在多模态查询上迈出了第一步尝试,其显着的性能提升也昭示着多模态查询目标检测的巨大潜力。

同时,文本描述和视觉示例的引入为用户提供了更多的选择,使得目标检测更加灵活和用户友好。

以上是让大模型看图比打字管用!NeurIPS 2023新研究提出多模态查询方法,准确率提升7.8%的详细内容。更多信息请关注PHP中文网其他相关文章!