随着大型语言模型(LLM)、扩散(Diffusion)等技术的发展,ChatGPT、Midjourney等产品的诞生掀起了新一波的AI热潮,生成式AI也成为备受关注的话题。

与文本和图像不同,3D生成仍处于技术探索阶段。

2022年年底,Google、NVIDIA和微软相继推出了自己的3D生成工作,但大多基于先进的神经辐射场(NeRF)隐式表达,与工业界3D软件如Unity、Unreal Engine和Maya等的渲染管线不兼容。

即使通过传统方案将其转换为Mesh表达的几何和颜色贴图,也会造成精度不足和视觉质量下降,不能直接应用于影视制作和游戏生产。

项目网站:https://sites.google.com/view/dreamface

论文地址:https://arxiv.org/abs/2304.03117

Web Demo:https://hyperhuman.top

HuggingFace Space:https://huggingface.co/spaces/DEEMOSTECH/ChatAvatar

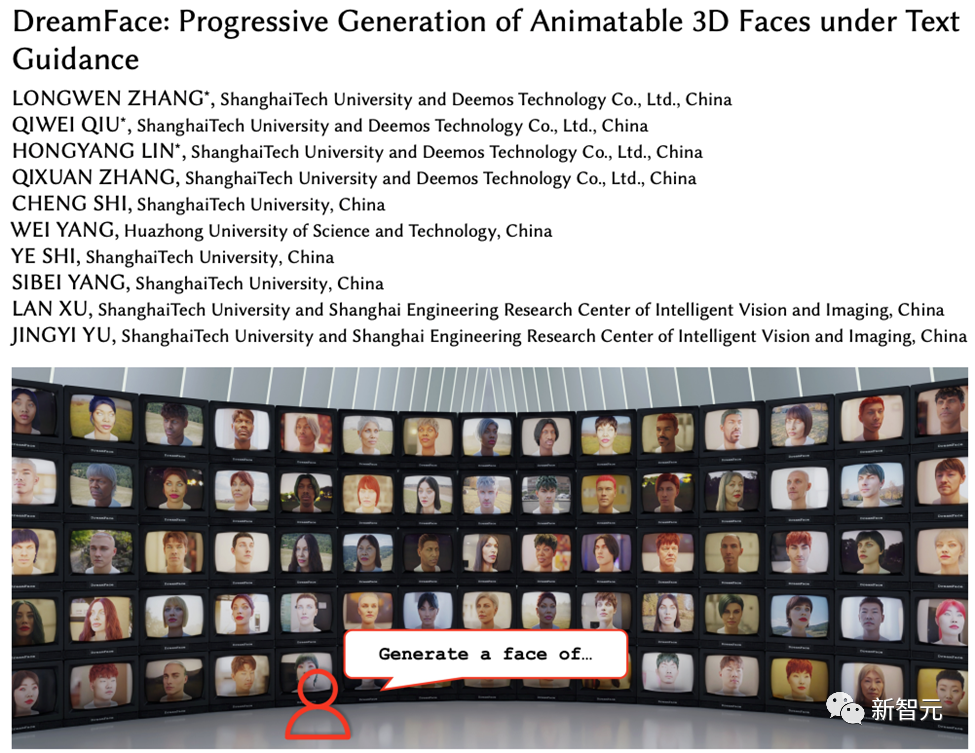

为了解决这些问题,来自影眸科技与上海科技大学的研发团队提出了一种文本指导的渐进式3D生成框架。

该框架引入符合CG制作标准的外部数据集(包含几何和PBR材质),可以根据文本直接生成符合该标准的3D资产,是首个支持Production-Ready 3D资产生成的框架。

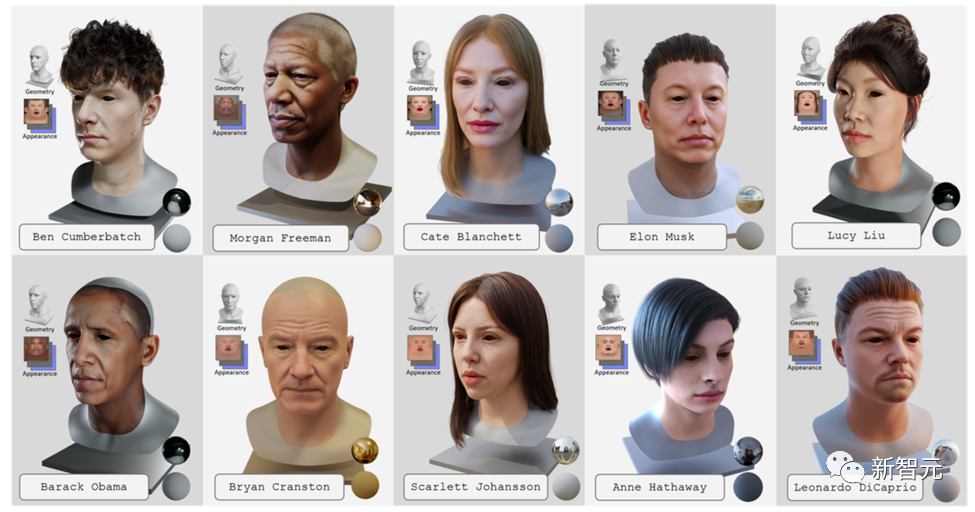

为了实现文本生成可驱动的3D超写实数字人,该团队将这个框架与产品级3D数字人数据集相结合。这项工作已经被计算机图形领域国际顶级期刊Transactions on Graphics接收,并将在国际计算机图形顶级会议SIGGRAPH 2023上展示。

DreamFace主要包括三个模块,几何体生成,基于物理的材质扩散和动画能力生成。

相比先前的3D生成工作,这项工作的主要贡献包括:

· 提出了DreamFace这一新颖的生成方案,将最近的视觉-语言模型与可动画和物理材质的面部资产相结合,通过渐进式学习来分离几何、外观和动画能力。

· 引入了双通道外观生成的设计,将一种新颖的材质扩散模型与预训练模型相结合,同时在潜在空间和图像空间进行两阶段优化。

· 使用BlendShapes或生成的Personalized BlendShapes的面部资产具备动画能力,并进一步展示了DreamFace在自然人物设计方面的应用。

几何体生成模块可以根据文本提示生成与之一致的几何模型。然而,在人脸生成方面,这可能难以监督和收敛。

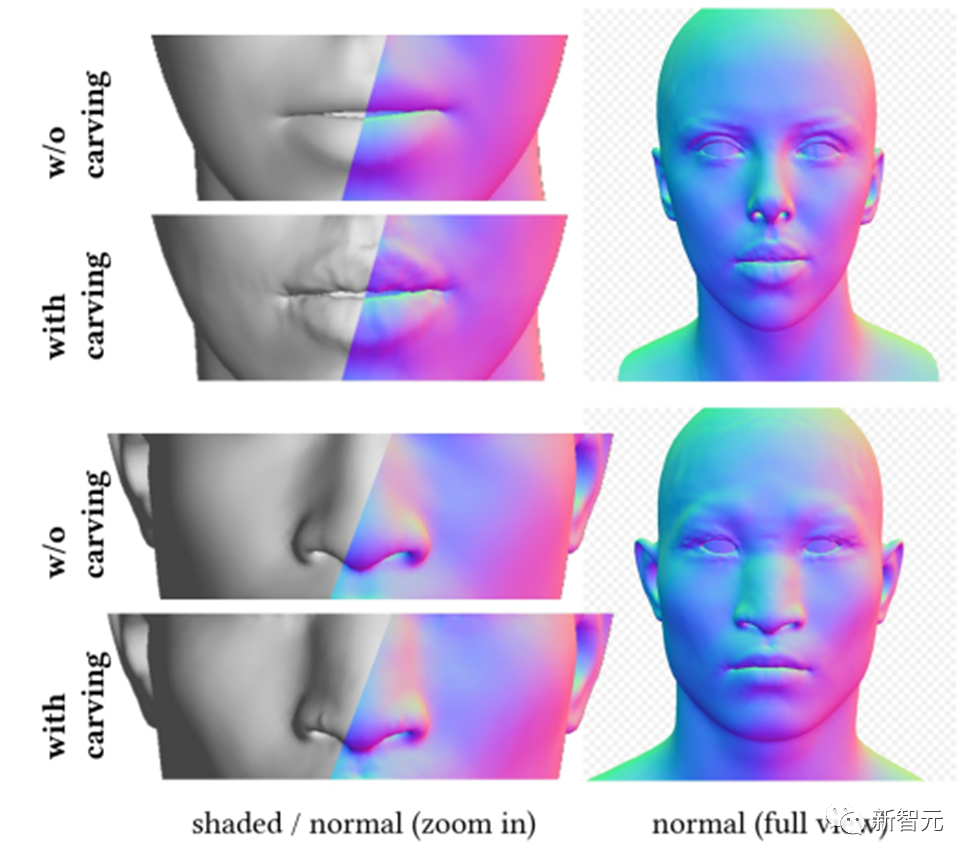

因此,DreamFace提出了一个基于CLIP(Contrastive Language-Image Pre-Training)的选择框架,首先从对人脸几何参数空间内随机采样的候选项中选择最佳的粗略几何模型,然后雕刻几何细节,使头部模型更符合文本提示。

根据输入提示,DreamFace利用CLIP模型选择匹配得分最高的粗略几何候选项。接下来,DreamFace使用隐式扩散模型(LDM)在随机视角和光照条件下对渲染图像进行得分蒸馏采样(SDS)处理。

这使得DreamFace可以通过顶点位移和详细的法线贴图向粗略几何模型添加面部细节,从而得到高度精细的几何体。

与头部模型类似,DreamFace还基于该框架进行发型和颜色的选择。

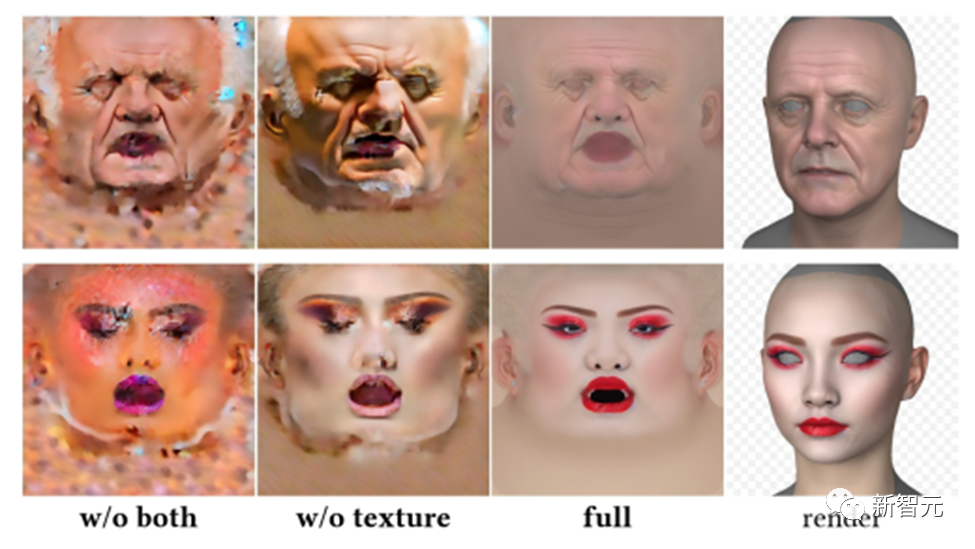

基于物理的材质扩散模块旨在预测与预测几何体和文本提示一致的面部纹理。

首先,DreamFace将预先训练的LDM在收集的大规模UV材质数据集上微调,得到两个LDM扩散模型。

DreamFace采用了一种联合训练方案,协调两个扩散过程,一个用于直接去噪UV纹理贴图,另一个用于监督渲染图像,以确保面部UV贴图和渲染图像的正确形成与文本提示一致。

为了减少生成时间,DreamFace采用了一个粗糙纹理潜在扩散阶段,为细节纹理生成提供先验潜在。

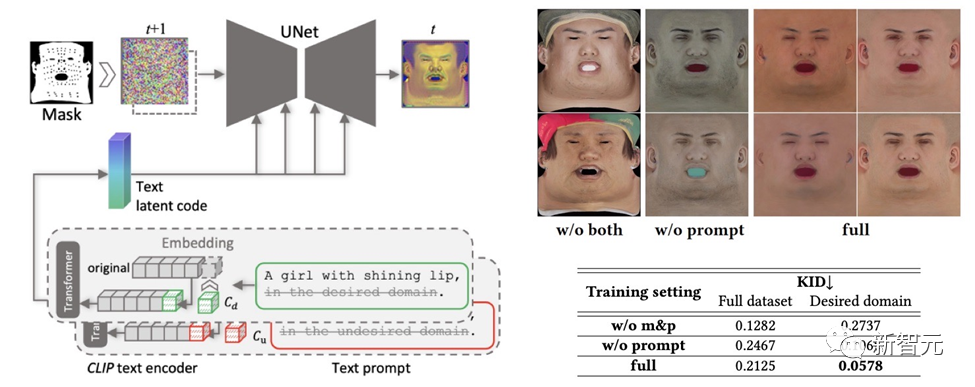

为了确保所创建的纹理地图不含有不良特征或照明情况,同时仍保持多样性,设计了一种提示学习策略。

团队利用两种方法生成高质量的漫反射贴图:

(1)Prompt Tuning。与手工制作的特定领域文本提示不同,DreamFace将两个特定领域的连续文本提示 Cd 和 Cu 与相应的文本提示结合起来,这将在U-Net去噪器训练期间进行优化,以避免不稳定和耗时的手工撰写提示。

(2)非面部区域遮罩。LDM去噪过程将额外地受到非面部区域遮罩的限制,以确保生成的漫反射贴图不含有任何不需要的元素。

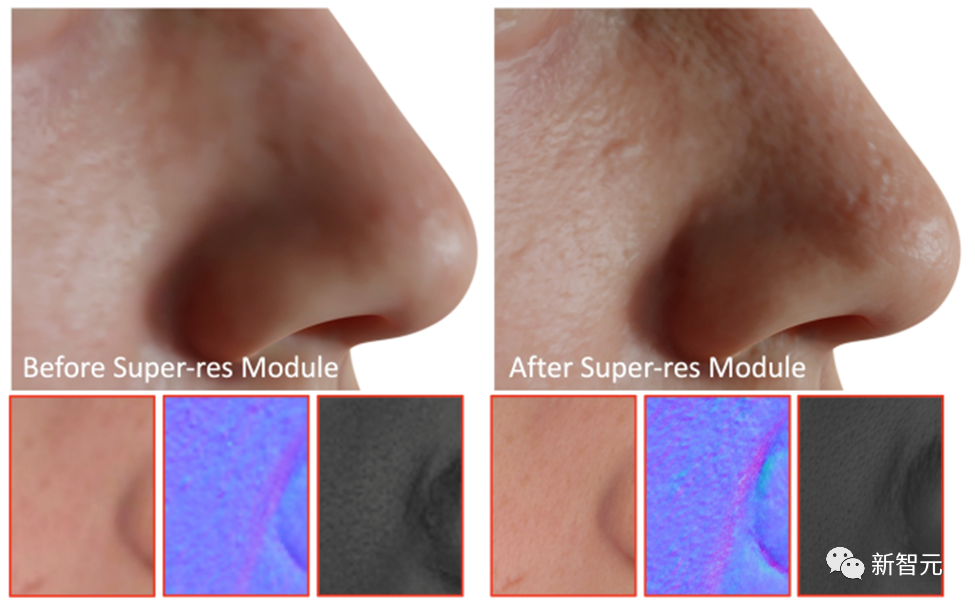

作为最后一步,DreamFace应用超分辨率模块生成4K基于物理的纹理,以进行高质量渲染。

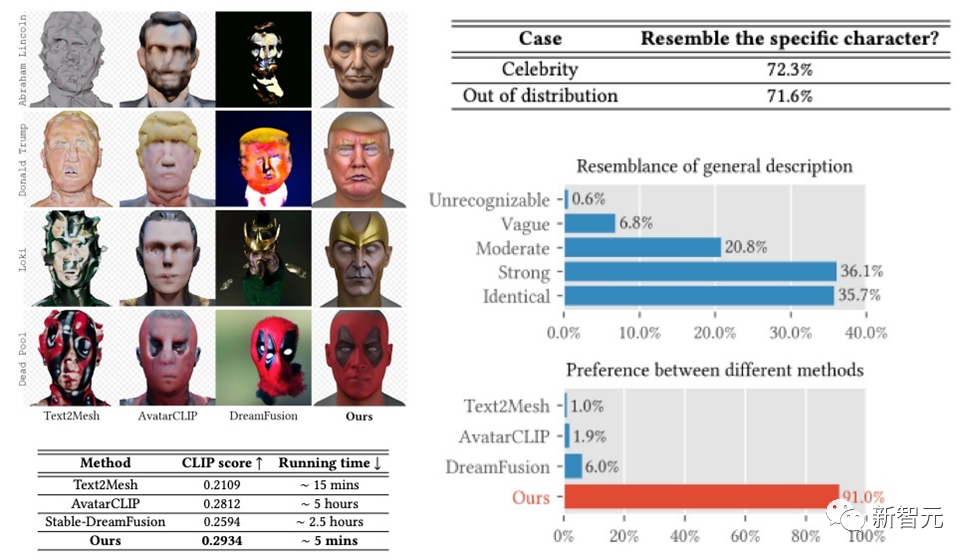

DreamFace框架在名人生成,根据描述生成角色上都取得了相当不错的效果,在User Study中获得了远超先前工作的成绩。相比先前的工作,在运行时间上也具备明显的优势。

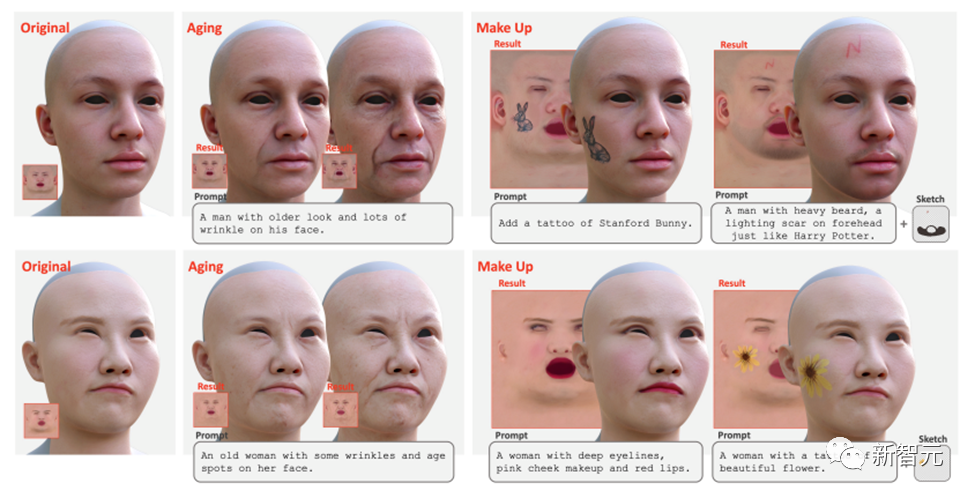

除此之外,DreamFace还支持使用提示和草图进行纹理编辑。通过直接使用微调的纹理LDM和提示,可以实现全局的编辑效果,如老化和化妆。通过进一步结合掩模或草图,可以创建各种效果,如纹身、胡须和胎记。

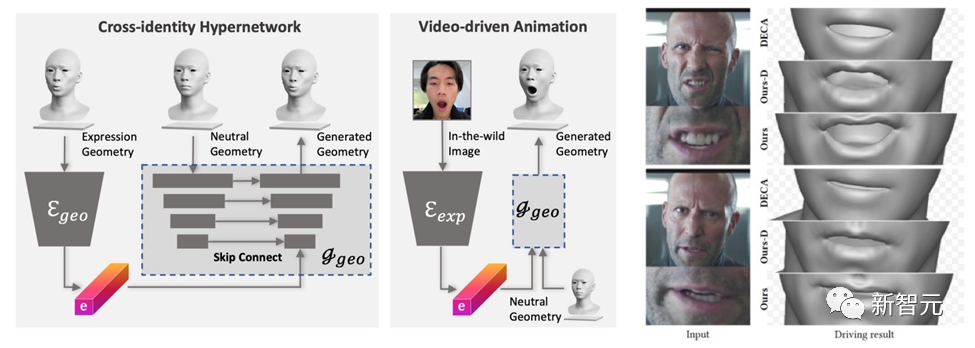

DreamFace生成的模型具备动画能力。与基于BlendShapes的方法不同,DreamFace的神经面部动画方法通过预测独特的变形来为生成的静息(Neutral)模型赋予动画效果,从而产生个性化的动画。

首先,训练一个几何生成器,学习表情的潜在空间,其中解码器被扩展为以中性几何形状为条件。接着,进一步训练表情编码器,从RGB图像中提取表情特征。因此,DreamFace能够通过使用单目RGB图像以中性几何形状为条件来生成个性化的动画。

与使用通用BlendShapes进行表情控制的DECA相比,DreamFace的框架提供了细致的表情细节,并且能够精细地捕捉表演。

本文介绍了DreamFace,一种文本指导的渐进式3D生成框架,它结合了最新的视觉-语言模型、隐式扩散模型,以及基于物理的材质扩散技术。

DreamFace的主要创新包括几何体生成、基于物理的材质扩散生成和动画能力生成。与传统的3D生成方法相比,DreamFace具有更高的准确性、更快的运行速度和较好的CG管线兼容性。

DreamFace的渐进式生成框架为解决复杂的3D生成任务提供了一种有效的解决方案,有望推动更多类似的研究和技术发展。

此外,基于物理的材质扩散生成和动画能力生成将推动3D生成技术在影视制作、游戏开发和其他相关行业的应用。

以上是上科大等发布DreamFace:只需文本即可生成「超写实3D数字人」的详细内容。更多信息请关注PHP中文网其他相关文章!