作者 | 云昭

一开始据说是本周四发布,结果en~~周三凌晨就发布了,果真,OpenAI向来喜欢提前给人们制造惊喜!

废话不多说,先上GPT4的硬技能。

首先,是长文本处理的能力,OpenAI官网上是这么描述的:“GPT4 能够处理超过25,000个单词的文本,允许使用长格式内容创建、扩展对话以及文档搜索和分析等用例。”

OpenAI怕大家不能很形象的理解,干脆用一篇维基百科的长文举了个例子,这个文本有多长呢?小编实际点开了链接(见下图),要比目前ChatGPT(GPT3.5)能处理的文本长出一倍去。不信的朋友可以去这个链接:https://en.wikipedia.org/wiki/Rihanna看一看实际长度。

对于文本对话任务,两者表现几何?OpenAI官方是这样说的。

在随意的交谈中,GPT3.5和GPT4之间的区别可能很细微。当任务的复杂性达到足够的阈值时,差异就会显现出来。GPT4比GPT3.5更可靠、更具创造力,并且能够处理更细微的指令。

GPT4的上下文长度为8192个令牌。OpenAI还提供了对32768上下文(约50页文本)版本gpt-4-32k的有限访问,该版本也将随着时间的推移自动更新(当前版本gpt-4-22k-0314,也支持到6月14日)。定价为每1K提示令牌0.06美元,每1K完成令牌0.12美元。

OpenAI仍在改进长期环境下的模型质量,并希望得到有关它在的用例中表现如何的反馈。OpenAI根据容量以不同的速率处理8K和32K引擎的请求,因此可以在不同的时间访问它们。

第二个,对图像的识别能力:接受图像作为输入。

GPT4可以接受文本和图像的提示,这与纯文本设置并行,允许用户指定任何视觉或语言任务。具体来说,它生成文本输出(自然语言、代码等),给定由穿插的文本和图像组成的输入。在一系列领域,包括带有文本和照片的文档、图表或屏幕截图,GPT4表现出与纯文本输入类似的功能。此外,它还可以通过为纯文本语言模型开发的测试时间技术来增强,包括少量镜头和思维链提示。遗憾的是,图像输入仍然只是研究预览阶段,暂时没有公开。

(问题和答案都是英文:为了便于理解,已翻译为中文)

图片上给出了一些食材,问GPT4可以根据图片上的食材做哪些美食。可以看出GPT4正式跨界了!

第三个,更靠谱的推理能力。

GPT4较之前的模型,更具有创造性和协作性。它不仅能够完成许多创意和基础写作,而且还能创作歌曲、剧本,重要的是还能学习用户的写作风格。

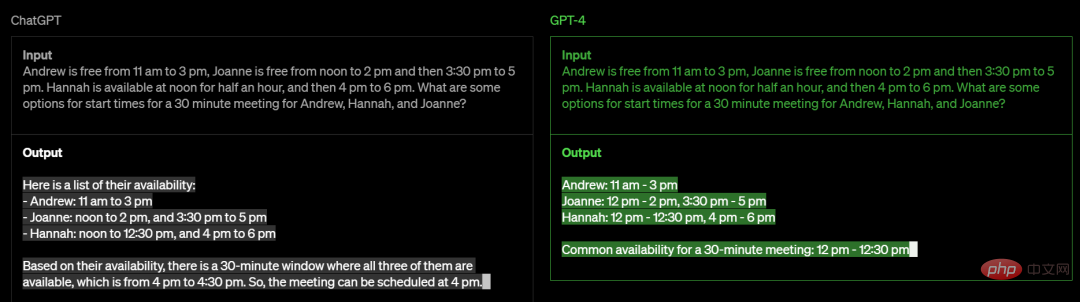

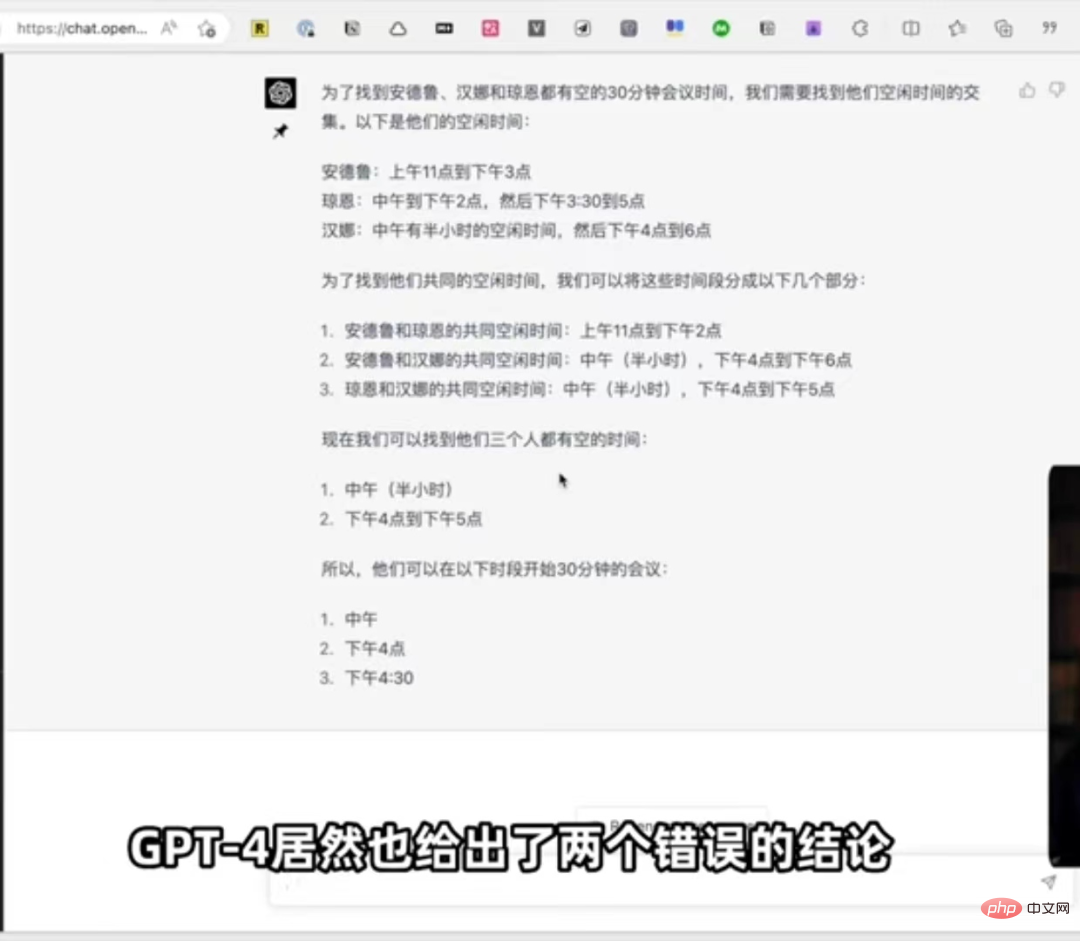

关于推理能力这块,OpenAI还给出了一个让GPT4预定会议室的例子:

问题大致是这样的:三个人在每一天的空闲时间不一样,让GPT找出一个30分钟会议的合适时间。

可以看出ChatGPT的逻辑思路和文本分析的都没毛病,但给出的答案全错。而GPT4则给出了正确的答案。

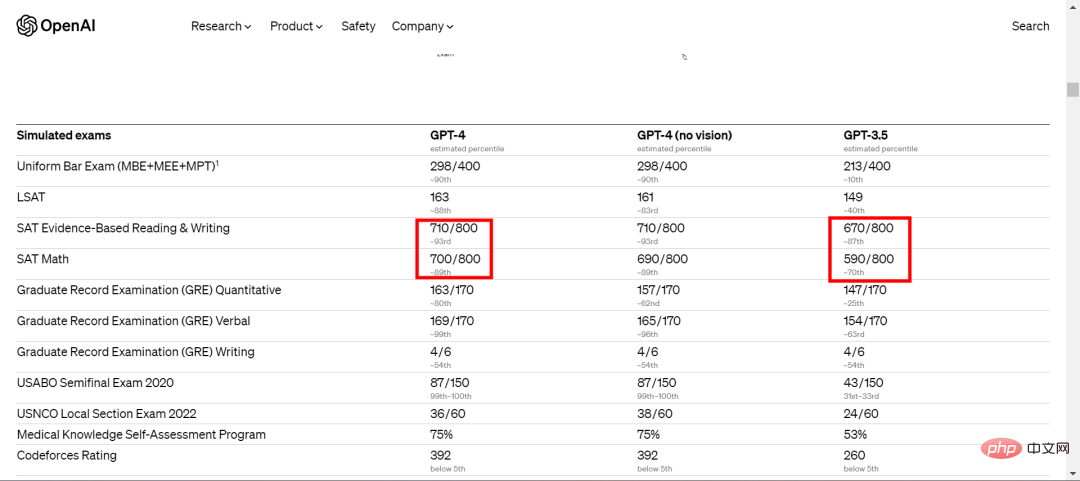

GPT4还有一个更强的BUFF,让它参加考试,会碾压不少学霸!而ChatGPT则弱爆了!

在统一律师考试中取得了前10%的成绩,而ChatGPT获得了倒数10%。

除此之外,OpenAI还给出了SAT等其他考试的排名,均比ChatGPT能扛能打!

与ChatGPT比起来,还有哪些硬货?

GPT4的可操作性更加灵活。使用过ChatGPT的朋友都知道,如果用API提交请求的话,一般有两个消息:系统消息(规定的AI风格和角色)和用户消息(具体提出的问题)。之前的ChatGPT对于系统消息不太看重,风格、语调比较固定。

而GPT4则不然,开发人员(以及很快的ChatGPT用户)现在可以通过在“系统”消息中描述这些方向来规定他们的AI风格和任务,系统消息允许API用户在一定范围内显着自定义用户体验。 OpenAI将继续在这里进行改进(尤其要知道,系统消息是“越狱”当前模型的最简单方法,即,对边界的遵守不再那么死板),OpenAI也非常鼓励让他们知道用户想要尝试这些ideas 。

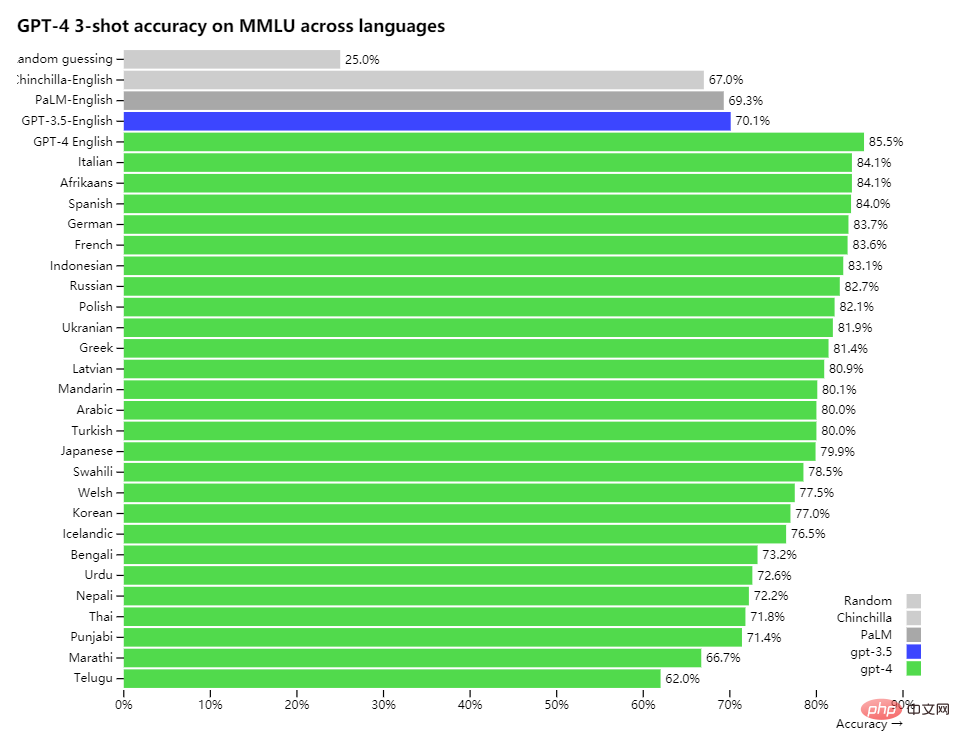

还有对多语种的支持能力也更强。测试的26种语言当中,有24种要比GPT3.5和其他的语言模型的精确度都要强。

小编瞪大眼睛瞅来瞅去,也没有看见中文。果断就去找了相关中文测试的效果究竟如何,结果呵呵了。不仅速度慢,一样也是给出了错误的答案!

ChatGPT有没有比GPT4领先的地方?

有!那就是生成文本的速度,GPT4生成答案的速度明显慢于ChatGPT。看来能力越强,回答问题就会越慎重!

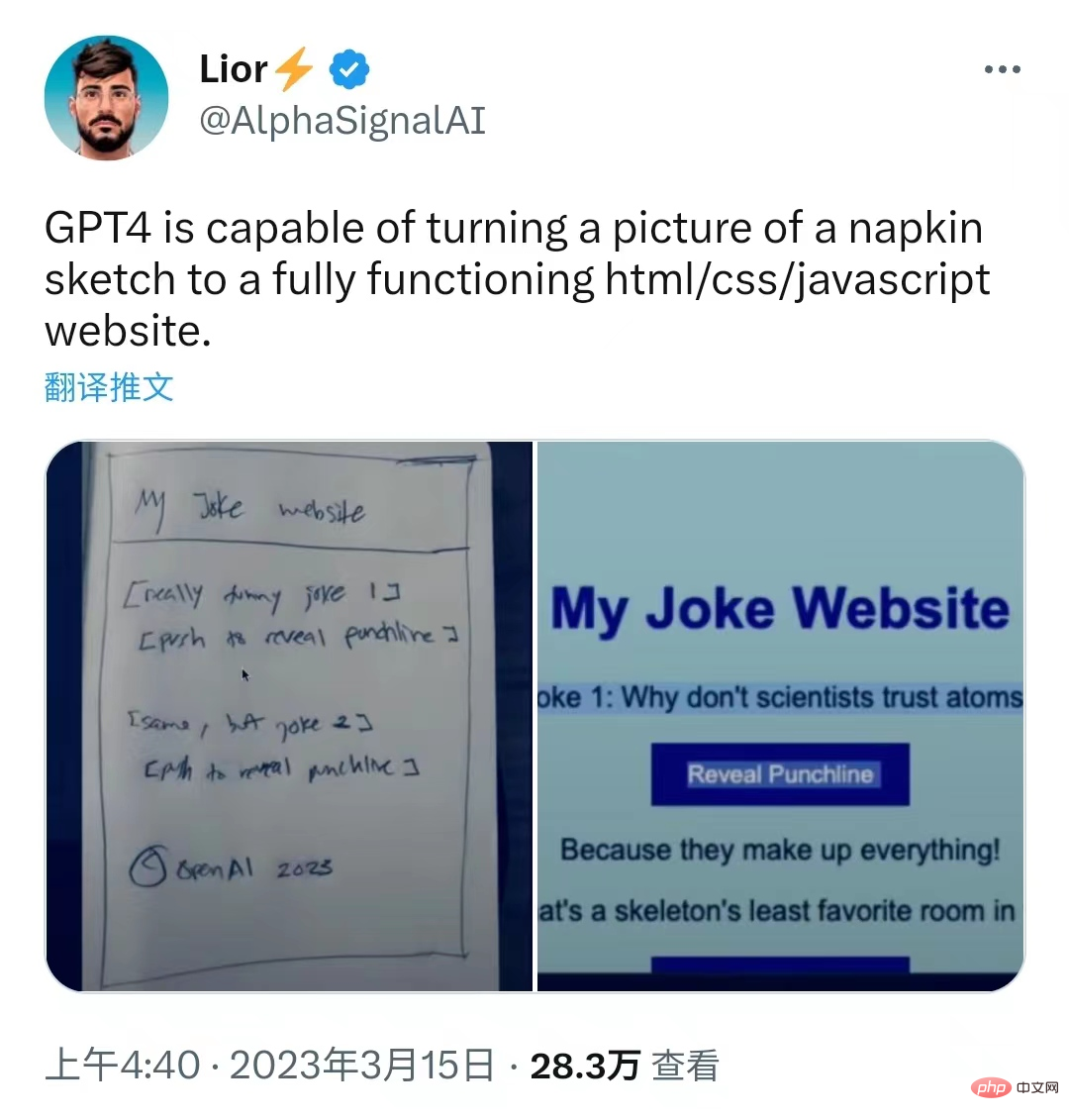

第一个例子是:餐巾纸上的草图都能让GPT4魔法一样生成个网页图!

图源:推特

真实例子,推特上一位用户将一张餐巾纸上的草纸图拍完照后,交给GPT4,结果真的变成一张功能齐全的html/css/JavaScript网站。

网友惊呼:这模型竟然能够阅读和解释餐巾纸上写的任何内容!

还有位网友脑洞大开:那是不是基于GPT4的应用程序,将我的书面处方变成药剂师可以实际阅读的东西,就可以成为下一个美国生物技术亿万富翁。

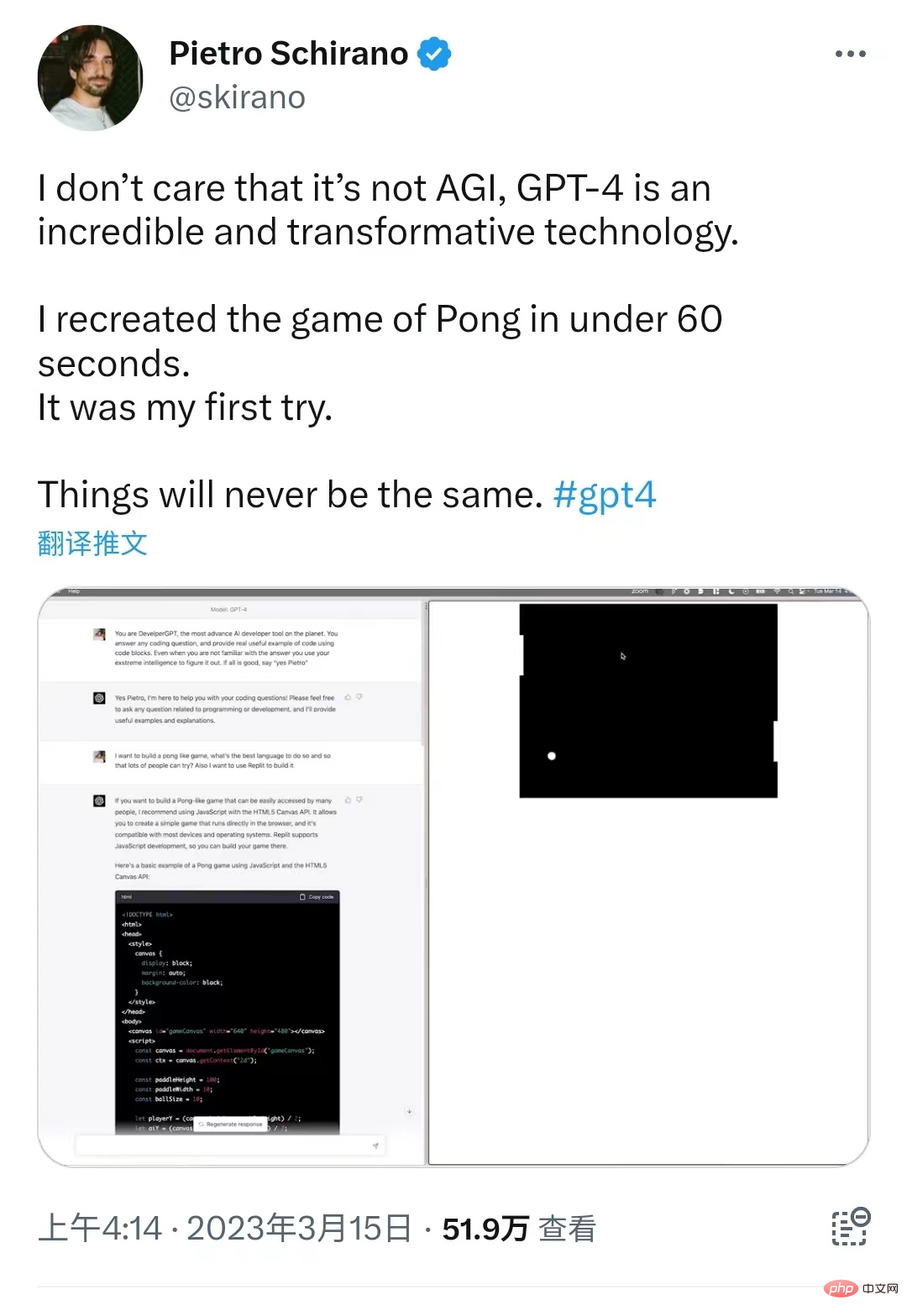

第二个例子:用GPT4重建游戏。

一位叫Pietro的用户在60s内重建了Pong游戏,而且分数还不错。

图源:推特

图源:推特

GPT4由于其广泛的通用知识和解决问题的能力,可以更准确地解决难题。 GPT4的创造性恐怖如斯。

GPT4虽然能力比ChatGPT更强,但局限性依旧与早期GPT模型相似。最重要的是,它仍然不完全可靠(它依旧会编造事实,并会犯推理错误)。在使用语言模型输出时,尤其是在高风险上下文中,应非常小心,使用与特定用例需求匹配的精确协议(如人工审查、附加上下文基础或完全避免高风险使用)。

在OpenAI的内部对抗性真实性评估中,GPT4的得分比我们最新的GPT3.5高40%。也就是说,即便GPT4生成的答案更准确,但也只是比GPT4更加可信了40%而已!

ChatGPT Plus用户可以从chat.openai.com上获得GPT4访问权限。同时,OpenAI将根据实际需求和系统性能调整确切的使用上限,但OpenAI预计会产生严重的容量限制(尽管OpenAI将在未来几个月内进行扩展和优化)。

根据OpenAI看到的流量模式,OpenAI可能会为更高容量的GPT4使用量引入新的订阅级别;OpenAI还希望在某个时候提供一些免费的GPT4查询,这样那些没有订阅的用户也可以尝试。

要访问GPT-4 API(它使用与GPT-3.5-turbo相同的ChatCompletions API),还需要注册OpenAI的等待名单。

OpenAI从今天开始,将邀请一些开发商,并逐步扩大规模,以平衡容量和需求。如果是有社会影响的研究人员,也可以通过OpenAI的研究人员准入计划申请使用。

OpenAI在内部使用GPT4,对支持、销售、内容管理和编程等功能产生了巨大影响。OpenAI还使用它来帮助人类评估人工智能输出,开始OpenAI对齐策略的第二阶段。

OpenAI期待GPT4通过为许多应用程序提供动力,成为改善人们生活的宝贵工具。还有很多工作要做,OpenAI期待着通过社区建设的集体努力来改进这一模式,探索并为这一模式做出贡献。小编注意到OpenAI已经和一家虚拟志愿者工具的公司达成合作。

Be My Eyes的合作伙伴。通过世界各地的事实视频将需要视力支持的人与志愿者和住院者和公司联系起来。

简化低视力人群的任务

借助Be My Eyes应用程序,可以支持视障人群并帮助他们实现独立。盲人或低视力用户可能需要的支持包括:检查有效期、区分颜色、阅读说明或在新环境中导航。

OpenAI称GPT4是努力扩展深度学习的最新里程碑。GPT4作为一个大型多模态模型(接受图像和文本输入,发出文本输出),在各种专业和学术基准上表现出人类水平的表现。

虽然跟我们之前做出的多模态能力预测(文本、图像、音频、视频等输入)有较大的差距,但可以看出GPT模型的演进正在扎实推进,尤其是通用知识的理解能力和更难问题的处理上,着实惊艳到了!

以上是AI大比拼:GPT4和ChatGPT能否帮助我们创建更好的中文网站?的详细内容。更多信息请关注PHP中文网其他相关文章!