ChatGPT 的發布及其提供的回應將 Conversation AI 帶回了最前沿,並透過簡單的 Web 介面讓每個人都可以使用 Conversation AI。我們看到了許多創意的方式來使用 ChatGPT 以及它可能如何影響未來以及圍繞它是否會取代 Google 搜尋引擎和工作的問題。

好吧,讓我們透過以下分析來解決這個問題。

從早期的Watson 系統到ChatGPT,對話式 AI 仍然存在一個基本問題。

缺乏領域智能。

雖然 ChatGPT 在對話式 AI 領域無疑取得了進步,但我想從我的書中提到以下內容——真正的 AI:聊天機器人(2019 年出版)。

「人工智慧可以學習,但不能思考。」

關於如何使用人工智慧系統的輸出,思考總是留給人類。人工智慧系統及其知識將始終局限在它所學的知識範圍內,但永遠不能在需要領域專業知識和智慧的地方進行泛化(像人類一樣)。

領域智能的例子是什麼?

舉一個簡單的例子,您要求對話式人工智慧代理商「為短褲和紗麗推薦服裝」。

從根本上說,任何技術人員都會將它們視為兩種不同的選擇——將服裝與短褲搭配,將服裝與紗麗搭配,或者提出澄清問題,或者暗示這些選項是不相交的,不能組合。

但是對於 ChatGPT(或任何通用對話式 AI),回應如下所示。顯然,在不了解領域和上下文的情況下,試圖填寫一些回應。這是一個非常簡單的例子,但複雜性呈指數級增長,因為需要深厚的專業知識和相關性——就像醫生推薦治療方案一樣。這正是我們在使用 AI 代理解決健康問題時看到許多失敗的確切原因。他們試圖訓練通用人工智慧,而不是建構領域專家人工智慧系統。

這個生成式對話 AI 系統的另一個問題如下:

#可解釋性-讓 AI 輸出可以解釋它是如何到達的。我在我之前的部落格中對此進行了描述 – Responsible And Ethical AI

信任和推薦偏差——正確的推薦和適應性。我已經在我之前的部落格中對此進行了解釋。

有關更多詳細信息,我在我的簡短電子書 –真正的人工智慧:聊天機器人(2019)中解釋了這個概念。

您可以在我的網站上在線找到這本書或註冊免費影片課程。

此部落格的目的是讓人們了解 ChatGPT 及其當前的限制。任何技術通常都有一系列限制,了解這些限制將有助於您在設計和開發解決方案時牢記這些限制。

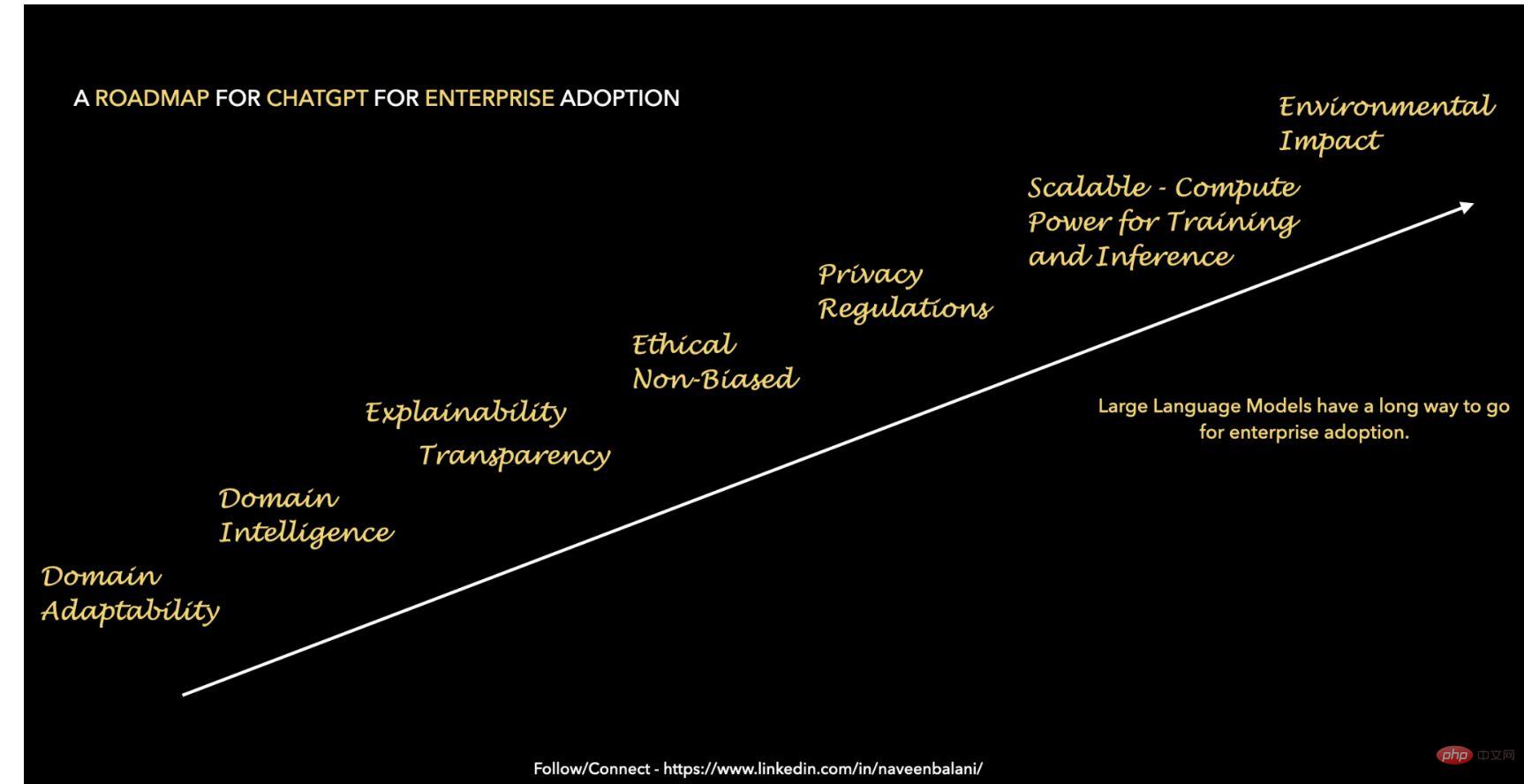

ChatGPT 無疑會推動對話人工智慧的發展,而建構它需要花費大量的時間和精力。然而,企業採用它還有很長的路要走。

為了讓ChatPT 與企業採用相關,我們需要以下內容:

在我看來,ChatGPT 和其他AI 聊天機器人將類似於任何其他工具來幫助您獲取所需信息,您將利用您的思維和智慧來完成工作。

所以,高枕無憂;目前版本的 ChatGPT 不會取代任何需要思考和深厚專業知識的東西! !

以上是從 Watson 到 ChatGPT:AI 聊天機器人和局限性的詳細內容。更多資訊請關注PHP中文網其他相關文章!