Hari ini, Google mengumumkan pelancaran Gemini 1.5.

Gemini 1.5 dibangunkan berdasarkan penyelidikan dan inovasi kejuruteraan Google dalam model asas dan infrastruktur. Keluaran ini memperkenalkan seni bina Campuran Pakar (MoE) baharu untuk meningkatkan kecekapan latihan dan menyediakan Gemini 1.5.

Apa yang telah dilancarkan oleh Google ialah versi pertama Gemini 1.5 untuk ujian awal iaitu Gemini 1.5 Pro. Ia adalah model multimodal bersaiz sederhana yang berskala dan dioptimumkan untuk pelbagai tugas. Berbanding dengan model terbesar Google, 1.0 Ultra, Gemini 1.5 Pro menyampaikan tahap prestasi yang serupa dan memperkenalkan ciri percubaan yang tercanggih untuk memahami konteks yang panjang dengan lebih baik.

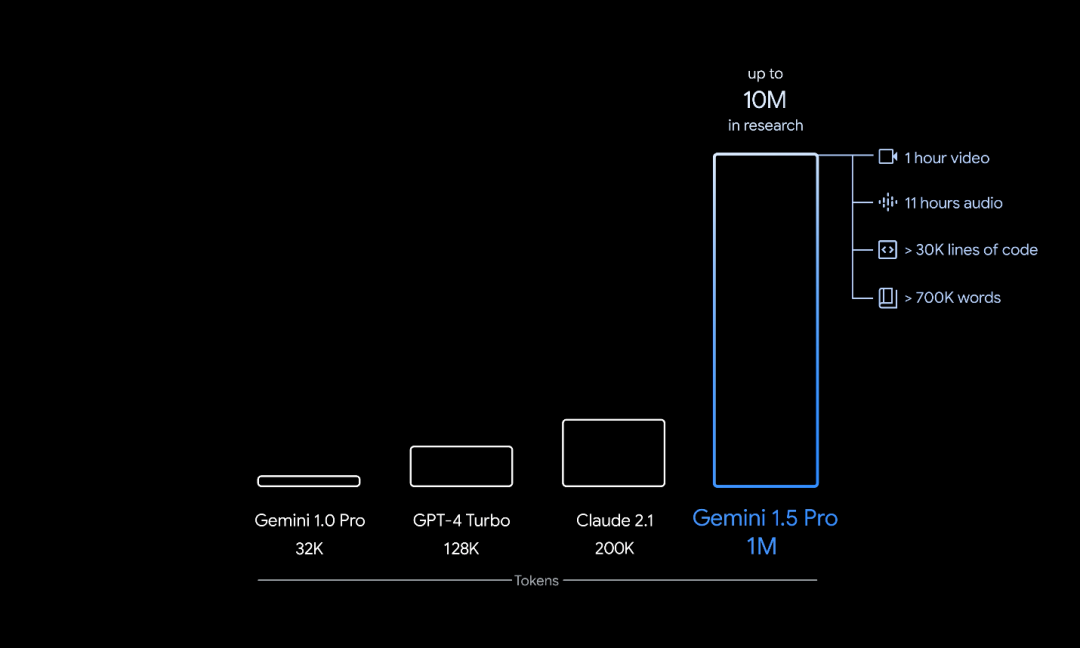

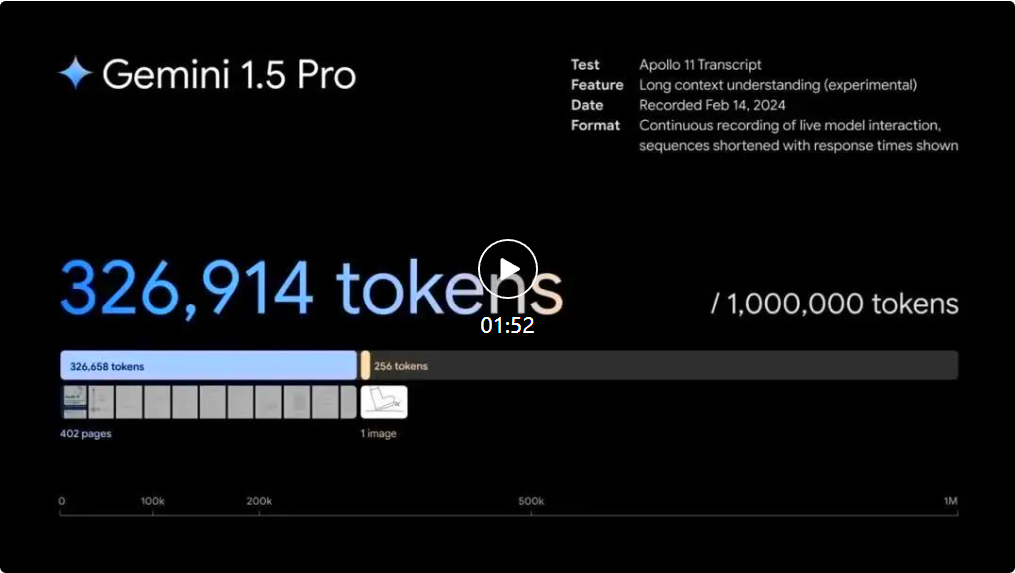

Bilangan tetingkap konteks token untuk Gemini 1.5 Pro ialah 128,000. Walau bagaimanapun, mulai hari ini, Google menawarkan pratonton peribadi AI Studio dan Vertex AI kepada sebilangan terhad pembangun dan pelanggan perusahaan, membolehkan mereka mencubanya dalam tetingkap kontekstual sehingga 1,000,000 token. Selain itu, Google telah membuat beberapa pengoptimuman yang bertujuan untuk meningkatkan kependaman, mengurangkan keperluan pengkomputeran dan meningkatkan pengalaman pengguna.

Ketua Pegawai Eksekutif Google Sundar Pichai dan Ketua Pegawai Eksekutif Google DeepMind Demis Hassabis memberikan pengenalan istimewa kepada model baharu itu.

的 Panjang konteks model asas terkemuka

Seni bina kecekapan tinggi Gemini 1.5 adalah berdasarkan penyelidikan terkemuka Google tentang seni bina Transformer dan MOE. Transformer tradisional bertindak sebagai satu rangkaian neural yang besar, manakala model MoE dibahagikan kepada rangkaian neural "pakar" yang lebih kecil. Bergantung pada jenis input yang diberikan, model KPM belajar untuk mengaktifkan secara terpilih hanya laluan pakar yang paling relevan dalam rangkaian neuralnya. Pengkhususan ini sangat meningkatkan kecekapan model. Google telah menjadi pengguna awal dan perintis teknologi pembelajaran mendalam MoE melalui penyelidikan mengenai MoE berpagar jarang, GShard-Transformer, Switch-Transformer, M4 dan banyak lagi.

Inovasi terbaharu Google dalam seni bina model membolehkan Gemini 1.5 mempelajari tugas yang kompleks dengan lebih pantas dan mengekalkan kualiti, sambil melatih dan berkhidmat dengan lebih cekap. Kecekapan ini membantu pasukan Google melatih, melatih dan menyampaikan versi Gemini yang lebih maju dengan lebih pantas berbanding sebelum ini dan sedang mengusahakan pengoptimuman selanjutnya.

Konteks yang lebih panjang, ciri yang lebih berguna"Tetingkap konteks" model kecerdasan buatan terdiri daripada token, yang merupakan blok bangunan untuk memproses maklumat. Token boleh menjadi keseluruhan bahagian atau subbahagian teks, imej, video, audio atau kod. Lebih besar tetingkap konteks model, lebih banyak maklumat yang boleh diterima dan diproses dalam gesaan tertentu, menjadikan outputnya lebih konsisten, relevan dan berguna. Melalui siri inovasi pembelajaran mesin, Google telah meningkatkan kapasiti tetingkap konteks sebanyak 1.5 Pro jauh melebihi 32,000 token awal Gemini 1.0. Model besar kini boleh dijalankan dalam pengeluaran dengan sehingga 1 juta token.

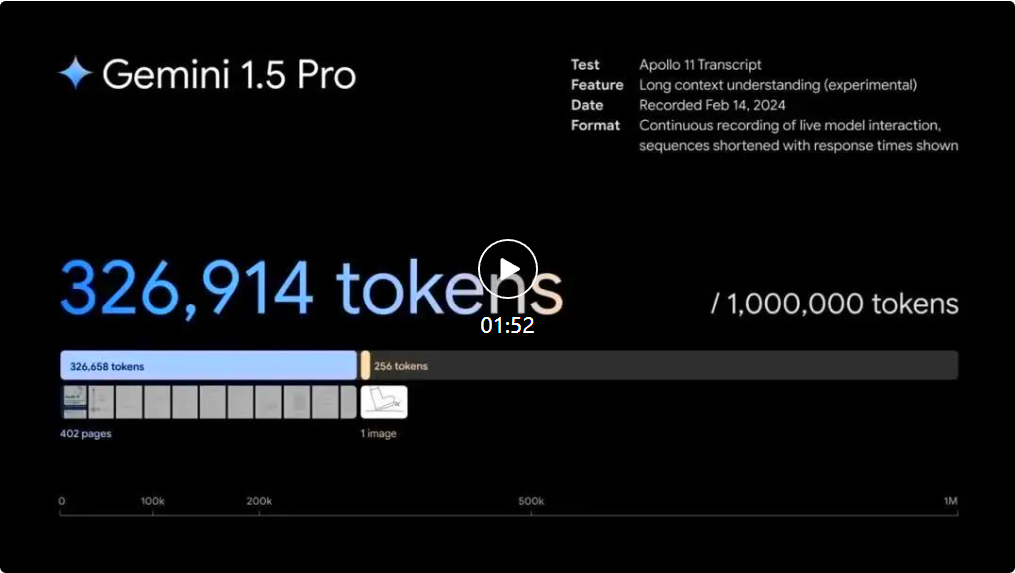

Ini bermakna 1.5 Pro boleh mengendalikan banyak maklumat serentak, termasuk 1 jam video, 11 jam audio, lebih 30,000 baris kod atau pangkalan kod lebih 700,000 perkataan. Dalam penyelidikan Google, sehingga 10 juta token juga berjaya diuji. . Contohnya, apabila diberi transkrip 402 halaman misi pendaratan bulan Apollo 11, ia boleh membuat alasan tentang dialog, peristiwa dan butiran di seluruh dokumen.

Pemahaman dan penaakulan yang lebih baik merentas modaliti  1.5 Pro boleh melaksanakan tugas pemahaman dan penaakulan yang sangat kompleks untuk modaliti yang berbeza termasuk video. Sebagai contoh, apabila diberikan filem senyap selama 44 minit oleh Buster Keaton, model itu boleh menganalisis dengan tepat pelbagai titik plot dan peristiwa, malah memberi alasan tentang butiran kecil dalam filem yang mudah diabaikan. Gemini 1.5 Pro boleh memahami, menaakul dan mengenal pasti butiran aneh dalam rekod 402 halaman misi pendaratan bulan Apollo 11.

1.5 Pro boleh melaksanakan tugas pemahaman dan penaakulan yang sangat kompleks untuk modaliti yang berbeza termasuk video. Sebagai contoh, apabila diberikan filem senyap selama 44 minit oleh Buster Keaton, model itu boleh menganalisis dengan tepat pelbagai titik plot dan peristiwa, malah memberi alasan tentang butiran kecil dalam filem yang mudah diabaikan. Gemini 1.5 Pro boleh memahami, menaakul dan mengenal pasti butiran aneh dalam rekod 402 halaman misi pendaratan bulan Apollo 11. Pemahaman dan penaakulan yang lebih baik merentas modaliti

1.5 Pro boleh melaksanakan tugas pemahaman dan penaakulan yang sangat kompleks untuk modaliti yang berbeza termasuk video. Sebagai contoh, apabila diberikan filem senyap selama 44 minit oleh Buster Keaton, model itu boleh menganalisis dengan tepat pelbagai titik plot dan peristiwa, malah memberi alasan tentang butiran kecil dalam filem yang mudah diabaikan. Gemini 1.5 Pro boleh memahami, menaakul dan mengenal pasti butiran aneh dalam rekod 402 halaman misi pendaratan bulan Apollo 11.

Pemahaman dan penaakulan yang lebih baik merentas modaliti

1.5 Pro boleh melaksanakan tugas pemahaman dan penaakulan yang sangat kompleks untuk modaliti yang berbeza termasuk video. Sebagai contoh, apabila diberikan filem senyap selama 44 minit oleh Buster Keaton, model itu boleh menganalisis pelbagai titik plot dan peristiwa dengan tepat, malah membuat alasan tentang butiran kecil dalam filem yang mudah diabaikan. Apabila diberi lukisan garisan ringkas sebagai bahan rujukan untuk objek kehidupan sebenar, Gemini 1.5 Pro boleh mengenal pasti 44 minit adegan daripada filem senyap Buster Keaton.

Gunakan blok kod yang lebih panjang untuk menyelesaikan masalah berkaitan 1.5 Pro boleh melaksanakan tugas penyelesaian masalah yang lebih relevan merentas blok kod yang lebih panjang. Apabila diberi petunjuk pada lebih daripada 100,000 baris kod, ia boleh membuat alasan yang lebih baik melalui contoh, mencadangkan pengubahsuaian yang berguna dan menerangkan cara bahagian kod yang berlainan berfungsi. . Gemini 1.5 Pro boleh menaakul 100,000 baris kod, menyediakan penyelesaian yang berguna, pengubahsuaian dan anotasi  Prestasi yang dipertingkatkan

Prestasi yang dipertingkatkan

panel audio yang komprehensif, kod komprehensif, kod teks yang komprehensif pada Windows Phone, 1.5 Pro mengatasi 1.0 Pro pada 87% penanda aras yang digunakan untuk membangunkan model bahasa besar (LLM). Berbanding dengan 1.0 Ultra dalam penanda aras yang sama, ia menunjukkan prestasi yang hampir sama.

Walaupun tetingkap konteks meningkat, Gemini 1.5 Pro mengekalkan tahap prestasi yang tinggi.

Dalam penilaian NIAH, sekeping kecil teks yang mengandungi fakta atau pernyataan tertentu sengaja diletakkan dalam blok teks yang sangat panjang, 1.5 Pro menemui teks terbenam 99% pada masa itu, dalam blok data seperti berikut untuk hanya 100 Sepuluh ribu token.

Gemini 1.5 Pro juga menunjukkan kemahiran "pembelajaran dalam konteks" yang mengagumkan, bermakna ia boleh mempelajari kemahiran baharu daripada maklumat yang diberikan dalam gesaan yang panjang tanpa memerlukan penalaan halus tambahan. Google menguji kemahiran ini pada penanda aras MTOB (Terjemahan dari Satu Buku), yang menunjukkan keupayaan model untuk belajar daripada maklumat yang tidak pernah dilihat sebelum ini. Apabila diberikan manual tatabahasa untuk Kalamang, bahasa dengan kurang daripada 200 penutur di seluruh dunia, model itu boleh belajar menterjemah bahasa Inggeris ke dalam Kalamang pada tahap yang serupa dengan manusia yang mempelajari kandungan yang sama.

Memandangkan tetingkap konteks panjang 1.5 Pro adalah yang pertama untuk model besar, Google sentiasa membangunkan penilaian dan penanda aras baharu untuk menguji ciri baharunya.

Untuk butiran lanjut, lihat laporan teknikal Gemini 1.5 Pro.

Alamat laporan teknikal: https://storage.googleapis.com/deepmind-media/gemini/gemini_v1_5_report.pdf

Membina dan bereksperimen dengan model Gemini

komited untuk Google Bertanggungjawab membawa setiap generasi baharu model Gemini kepada berbilion orang, pembangun dan pengguna perusahaan di seluruh dunia. Mulai hari ini, Google menyediakan pratonton 1.5 Pro kepada pembangun dan pelanggan perusahaan melalui AI Studio dan Vertex AI. Pada masa hadapan, apabila model itu pergi ke keluaran yang lebih luas, Google akan melancarkan 1.5 Pro dengan tetingkap konteks token standard 128,000. Tidak lama lagi, Google merancang untuk memperkenalkan peringkat harga bermula dengan tetingkap konteks standard 128,000 dan menskalakan sehingga 1 juta token kerana ia menambah baik model. Penguji awal boleh mencuba 1 juta tetingkap konteks token secara percuma semasa ujian dan peningkatan kelajuan yang ketara akan datang tidak lama lagi. Pembangun yang berminat untuk menguji 1.5 Pro boleh mendaftar sekarang di AI Studio, manakala pelanggan perusahaan boleh menghubungi pasukan akaun Vertex AI mereka. Pautan rujukan: https://blog.google/technology/ai/google-gemini-next-generation-model-february-2024/#sundar-note

Atas ialah kandungan terperinci Google Gemini 1.5 dilancarkan dengan cepat: seni bina MoE, 1 juta konteks. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

1.5 Pro boleh melaksanakan tugas pemahaman dan penaakulan yang sangat kompleks untuk modaliti yang berbeza termasuk video. Sebagai contoh, apabila diberikan filem senyap selama 44 minit oleh Buster Keaton, model itu boleh menganalisis dengan tepat pelbagai titik plot dan peristiwa, malah memberi alasan tentang butiran kecil dalam filem yang mudah diabaikan.

1.5 Pro boleh melaksanakan tugas pemahaman dan penaakulan yang sangat kompleks untuk modaliti yang berbeza termasuk video. Sebagai contoh, apabila diberikan filem senyap selama 44 minit oleh Buster Keaton, model itu boleh menganalisis dengan tepat pelbagai titik plot dan peristiwa, malah memberi alasan tentang butiran kecil dalam filem yang mudah diabaikan.