CPM-1 yang dikeluarkan pada Disember 2020 ialah model besar China yang pertama di China; CPM-Ant yang dikeluarkan pada September 2022 boleh mengatasi kesan penalaan halus parameter penuh dengan hanya memperhalusi 0.06% daripada parameter WebCPM yang dikeluarkan pada Mei 2023 ialah Bahasa Cina Model Soal Jawab berasaskan carian sumber terbuka pertama. Model besar CPM-Bee 10 bilion ialah model asas terbaru yang dikeluarkan oleh pasukan Kebolehannya dalam bahasa Cina mendahului senarai berwibawa ZeroCLUE, dan kebolehan bahasa Inggerisnya menyamai LLaMA.

Berulang kali membuat pencapaian cemerlang, siri CPM model besar telah mendahului model besar domestik untuk naik ke puncak, dan VisCPM yang dikeluarkan baru-baru ini adalah satu lagi bukti! VisCPM ialah siri model besar berbilang modal yang disumberkan secara terbuka bersama oleh Wallface Intelligence, Makmal NLP Universiti Tsinghua dan Zhihu dalam OpenBMB Antaranya, model VisCPM-Chat menyokong keupayaan dialog multi-modal dwibahasa Cina dan Inggeris, dan VisCPM-Paint. model menyokong teks kepada keupayaan penjanaan Graf, penilaian menunjukkan bahawa VisCPM mencapai tahap terbaik dalam kalangan model sumber terbuka berbilang mod Cina.

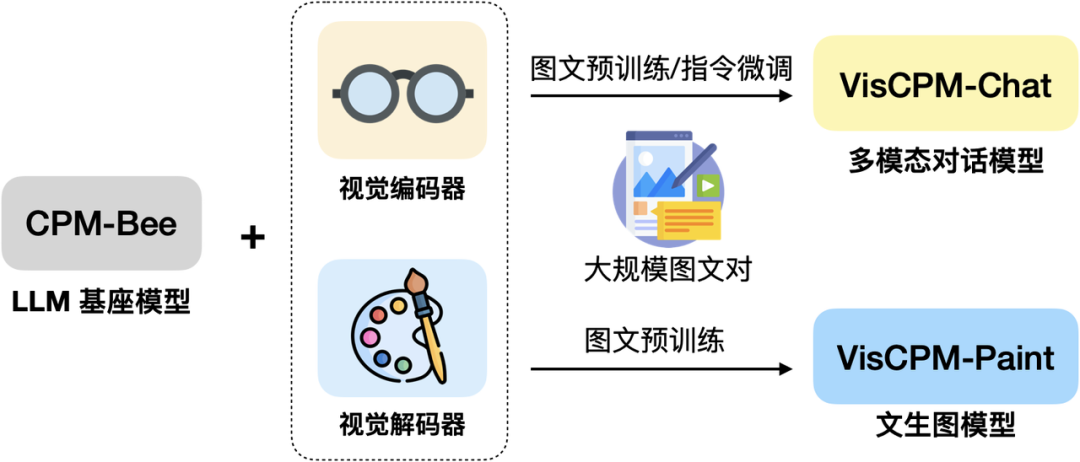

VisCPM dilatih berdasarkan berpuluh bilion model asas parameter CPM-Bee, dan menyepadukan pengekod visual (Q-Former dan penyahkod visual (Diffusion-UNet) untuk menyokong input dan output isyarat visual. Terima kasih kepada CPM-Bee Dengan keupayaan dwibahasa yang sangat baik di pangkalan, VisCPM boleh dilatih terlebih dahulu dengan hanya data berbilang modal Bahasa Inggeris dan digeneralisasikan untuk mencapai keupayaan berbilang modal bahasa Cina yang sangat baik

Rajah seni bina ringkas VisCPM

Rajah seni bina ringkas VisCPM

Mari lihat lebih dekat VisCPM-Chat. Di manakah lembu dengan VisCPM-Paint

Pictures

Pictures

VisCPM-Paint: https://gitBMB.com

VisCPM-Chat menyokong pemprosesan dwibahasa berorientasikan imej dalam dialog berbilang modal Model menggunakan Q-Former sebagai pengekod visual, menggunakan CPM-Bee (10B) sebagai model asas interaksi bahasa dan menggabungkan visual. dan model bahasa melalui sasaran latihan model bahasa termasuk latihan pra-latihan dan penalaan halus arahan

Pasukan menggunakan kira-kira100M data imej dan teks bahasa Inggeris untuk pra-latihan VisCPM-Chat. , CC12M, COCO, Genom Visual, Laion, dsb. dalam pra-latihan Dalam peringkat ini, parameter model bahasa kekal dan hanya beberapa parameter Q-Former dikemas kini untuk menyokong penjajaran yang cekap bagi perwakilan bahasa visual berskala besar. . Pasukan itu kemudiannya memperhalusi arahan VisCPM-Chat,

menggunakan LLaVA-150K English data penalaan halus, dan mencampurkan data terjemahan bahasa Cina yang sepadan untuk memperhalusi model untuk menyelaraskan berbilang model. -keupayaan asas mod dan niat penggunaan pengguna Dalam peringkat penalaan halus, mereka mengemas kini semua parameter model untuk meningkatkan kecekapan penggunaan data penalaan halus. data digunakan untuk penalaan halus arahan, model itu boleh memahami soalan bahasa Cina, tetapi hanya boleh menjawab dalam bahasa Inggeris Ini menunjukkan bahawa model itu berbilang bahasa Keupayaan modal telah digeneralisasikan dengan baik dalam peringkat penalaan halus arahan, bahasa respons model dan bahasa soalan pengguna boleh diselaraskan dengan set ujian Bahasa Inggeris LLaVA dan ujian Bahasa Cina yang diterjemahkan Penanda aras penilaian mengkaji prestasi model dalam dialog domain terbuka, penerangan terperinci imej dan penaakulan yang kompleks, dan menggunakan GPT-4 untuk pemarkahan Dapat diperhatikan bahawa VisCPM-Chat mempunyai keupayaan berbilang modal Cina yang sangat baik Mencapai prestasi purata terbaik , berprestasi baik dalam dialog domain umum dan penaakulan yang kompleks, dan juga menunjukkan bahasa Inggeris yang baik. keupayaan pelbagai modal

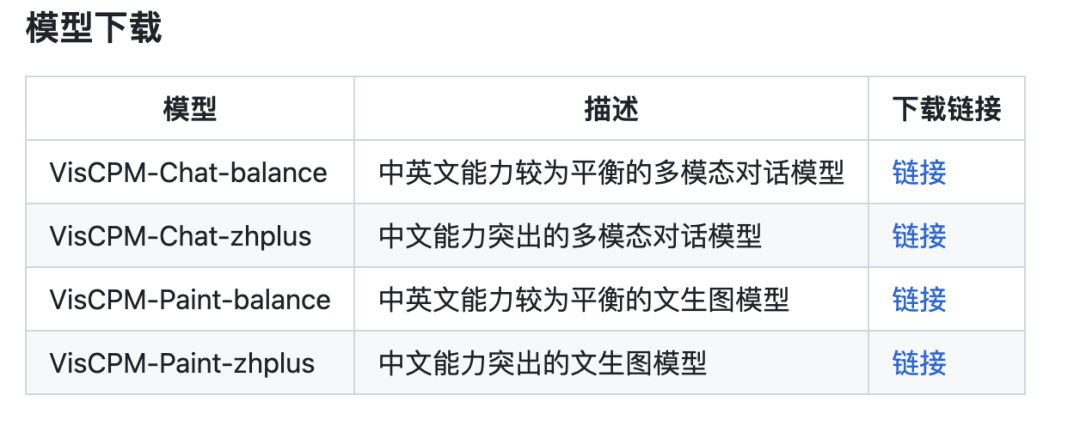

VisCPM-Chat menyediakan dua versi model, masing-masing VisCPM -Chat-balance dan VisCPM-Chat-zhplus, Yang pertama mempunyai keupayaan yang lebih seimbang dalam bahasa Inggeris dan Cina, manakala yang kedua lebih menonjol dalam. kebolehan Cina. Kedua-dua model menggunakan data yang sama dalam fasa penalaan halus arahan VisCPM-Chat-zhplus menambah data pasangan imej-teks Cina asli yang dibersihkan dan 120M diterjemahkan data pasangan teks-imej dalam fasa pra-latihan.

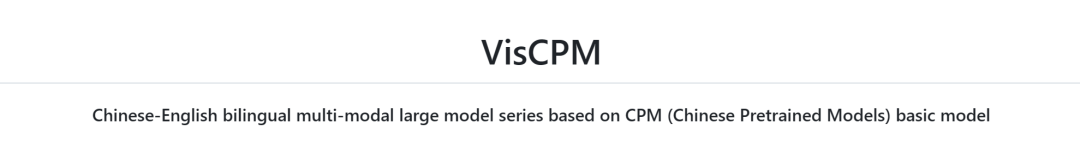

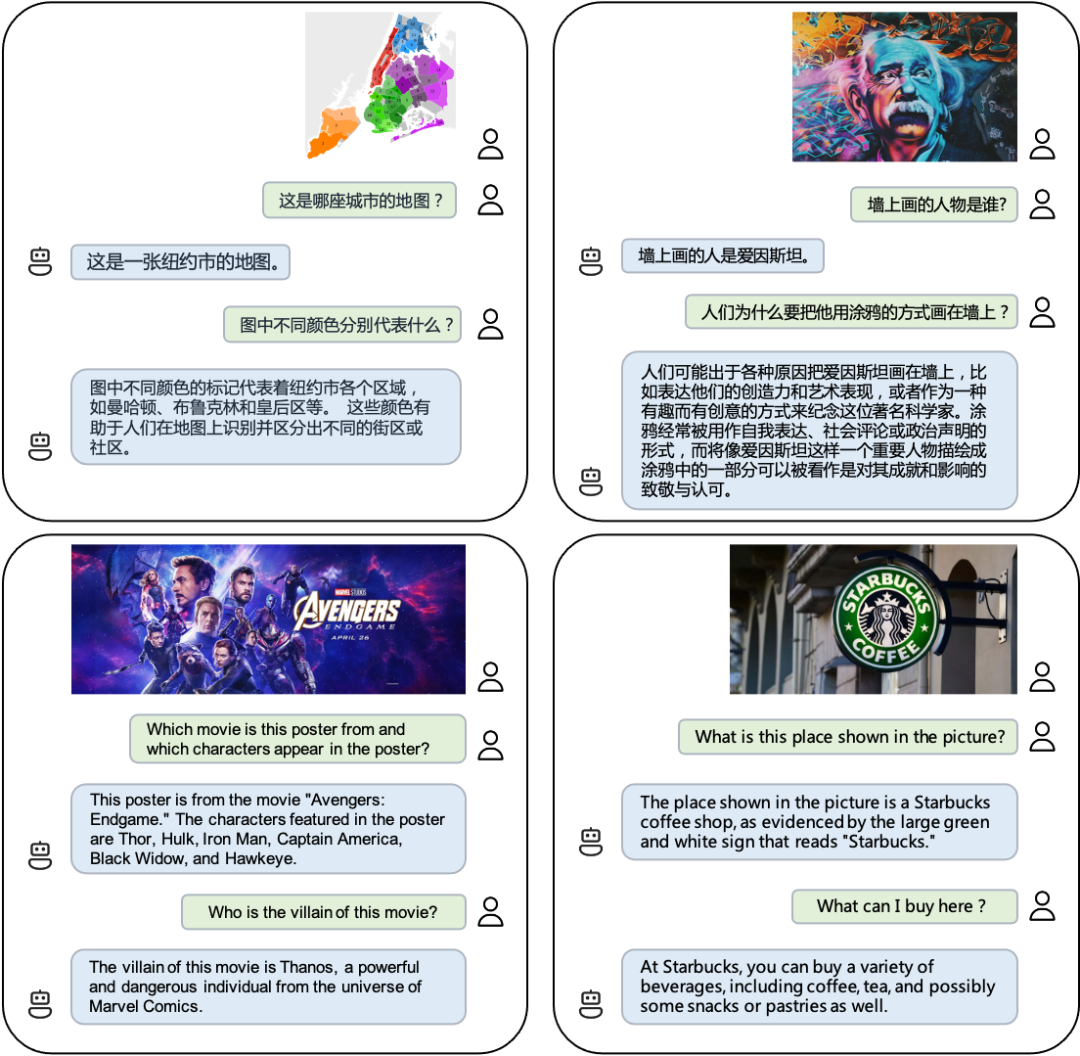

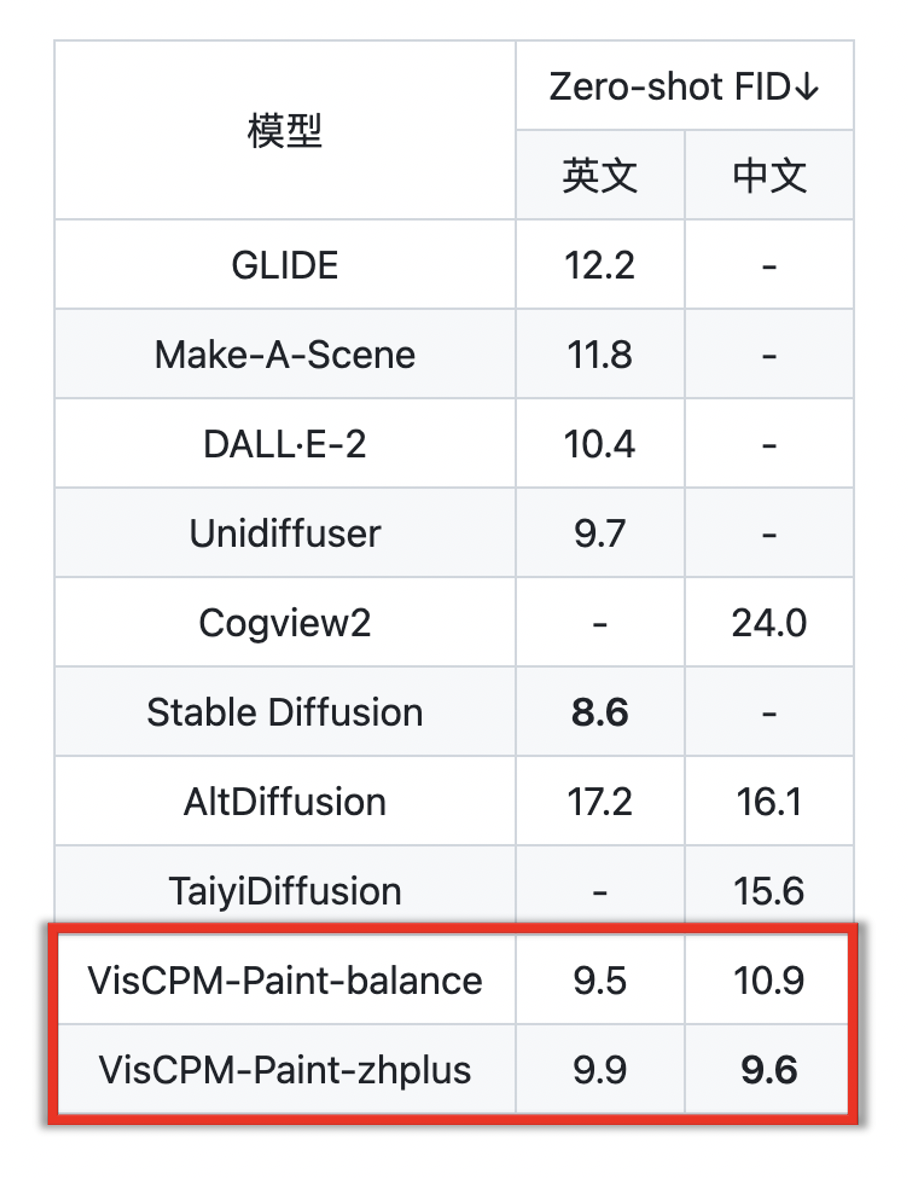

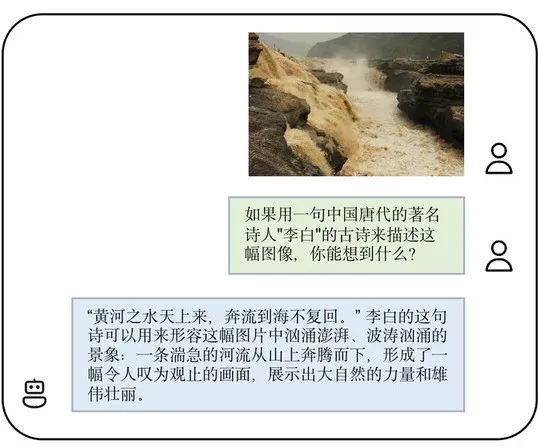

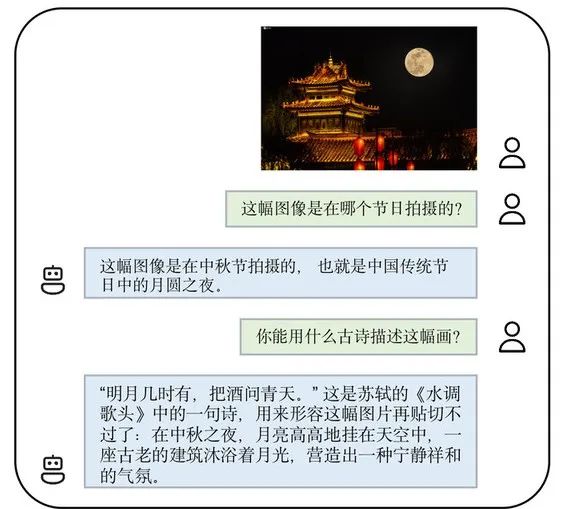

Gambar Berikut ialah demonstrasi keupayaan dialog pelbagai mod VisCPM-Chat Ia bukan sahaja dapat mengenali peta kawasan tertentu, tetapi juga membaca grafiti dan poster filem, malah mengenali logo Starbucks. Lebih-lebih lagi, saya sangat dwibahasa dalam bahasa Cina dan Inggeris! Mari lihat VisCPM-Paint, yang menyokong penjanaan teks-ke-imej dwibahasa dalam bahasa Cina dan Inggeris. Model menggunakan CPM-Bee (10B) sebagai pengekod teks, UNet sebagai penyahkod imej, dan menyasarkan bahasa bercantum dan model visual melalui latihan model penyebaran. Semasa proses latihan, parameter model bahasa sentiasa kekal tetap. Mulakan penyahkod visual menggunakan parameter UNet bagi Stable Diffusion 2.1 dan gabungkannya dengan model bahasa dengan secara beransur-ansur menyahbekukan parameter penyambung utamanya: mula-mula melatih lapisan linear pemetaan perwakilan teks kepada model visual, dan kemudian menyahbekukan perhatian silang. lapisan UNet. Model ini dilatih pada data teks imej Inggeris Laion 2B. Sama seperti VisCPM-Paint, terima kasih kepada keupayaan dwibahasa model asas CPM-Bee, VisCPM-Paint boleh dilatih hanya melalui pasangan imej dan teks bahasa Inggeris dan digeneralisasikan untuk mencapai keupayaan penjanaan teks-ke-imej Cina yang baik , mencapai model sumber Terbuka Cina pada tahap terbaik mereka. Dengan menambahkan lagi 20M data pasangan imej-teks Cina asli yang telah dibersihkan dan 120M data pasangan teks-imej yang diterjemahkan ke dalam bahasa Cina, keupayaan penjanaan teks-ke-imej Cina model itu telah dipertingkatkan lagi. Begitu juga, VisCPM-Paint mempunyai dua versi berbeza: keseimbangan dan zhplus. Mereka mengambil sampel 30,000 imej pada set ujian penjanaan imej standard MSCOCO, dan mengira metrik penjanaan imej penilaian yang biasa digunakan FID (Jarak Permulaan Fréchet) untuk menilai kualiti imej yang dijana. Masukkan dua gesaan ke dalam model VisCPM-Paint: "Bulan terang terbit di laut, dunia pada masa ini, gaya estetik, gaya abstrak" dan "Orang terbiar, osmanthus jatuh, bulan sunyi di langit musim bunga", dan dua berikut dihasilkan. Gambar: (masih ada ruang untuk penambahbaikan dalam kestabilan kesan penjanaan) agak menakjubkan. Boleh jadi mengatakan bahawa ia dengan tepat memahami konsep seni puisi kuno Jika anda tidak memahami puisi pada masa hadapan, anda boleh terus menjana gambar untuk difahami. Jika digunakan dalam reka bentuk, ia boleh menjimatkan banyak tenaga kerja. Bukan sahaja anda boleh "melukis", menggunakan VisCPM-Chat, anda juga boleh "mendeklamasikan puisi": Gunakan gambar untuk mencari puisi secara terbalik. Sebagai contoh, saya boleh menggunakan puisi Li Bai untuk menerangkan dan mentafsir pemandangan Sungai Kuning, dan saya juga boleh menggunakan "Shui Tiao Ge Tou" Su Shi untuk meluahkan emosi saya apabila menghadapi Malam Bulan Pertengahan Musim Luruh. VisCPM bukan sahaja mempunyai hasil penjanaan yang baik, tetapi versi muat turun direka dengan teliti dan juga sangat mudah untuk dipasang dan digunakan. VisCPM menyediakan versi model dengan keupayaan berbilang bahasa Cina dan Inggeris untuk semua orang memuat turun dan memilih, dan langkah pemasangan adalah mudah boleh dilaksanakan dengan beberapa baris kod semasa penggunaan dialog Dinamik, dan semakan keselamatan untuk teks input dan imej output didayakan secara lalai dalam kod. (Lihat README untuk tutorial khusus) Pada masa hadapan, pasukan itu juga akan menyepadukan VisCPM ke dalam rangka kerja kod muka peluk, dan akan menambah baik model keselamatan secara beransur-ansur, menyokong penggunaan halaman web yang pantas, menyokong fungsi pengkuantifikasian model, menyokong penalaan halus dan lain-lain. Nantikan kemas kini! Perlu dinyatakan bahawa Model siri VisCPM sangat dialu-alukan untuk kegunaan peribadi dan tujuan penyelidikan. Jika anda ingin menggunakan model untuk tujuan komersial, anda juga boleh menghubungi cpm@modelbest.cn untuk membincangkan hal pelesenan komersial. Model tradisional memfokuskan pada pemprosesan data modal tunggal Maklumat dalam dunia nyata selalunya model besar berbilang modal meningkatkan keupayaan interaksi persepsi sistem kecerdasan buatan dan menyelesaikan masalah persepsi dan interaksi yang kompleks di dunia nyata. untuk AI. Memahami tugas membawa peluang baharu. Perlu dikatakan bahawa syarikat model besar yang berpangkalan di Tsinghua mempunyai keupayaan penyelidikan dan pembangunan perisikan yang menghadap ke dinding VisCPM model besar berbilang modal yang dikeluarkan bersama adalah hebat dan berprestasi hebat Kami menantikan hasil keluaran mereka yang seterusnya.

VisCPM menyediakan versi model dengan keupayaan bahasa Cina dan Inggeris yang berbeza

VisCPM menyediakan versi model dengan keupayaan bahasa Cina dan Inggeris yang berbeza

Atas ialah kandungan terperinci VisCPM model besar berbilang modal Cina yang menghadap dinding menghadap dinding Universiti Tsinghua: menyokong teks dan imej dialog generasi dua hala, serta mempunyai keupayaan puisi dan lukisan yang menakjubkan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Bagaimana untuk menerangi Douyin kawan rapat

Bagaimana untuk menerangi Douyin kawan rapat

Apakah yang perlu saya lakukan jika komputer saya dimulakan dan skrin menunjukkan skrin hitam tanpa isyarat?

Apakah yang perlu saya lakukan jika komputer saya dimulakan dan skrin menunjukkan skrin hitam tanpa isyarat?

Tembok api Kaspersky

Tembok api Kaspersky

ralat aplikasi plugin.exe

ralat aplikasi plugin.exe

nvidia geforce 940mx

nvidia geforce 940mx

Adakah anda tahu jika anda membatalkan orang lain sejurus selepas mengikuti mereka di Douyin?

Adakah anda tahu jika anda membatalkan orang lain sejurus selepas mengikuti mereka di Douyin?

Bagaimana untuk mengira bayaran pengendalian bayaran balik keretapi 12306

Bagaimana untuk mengira bayaran pengendalian bayaran balik keretapi 12306

Sepuluh pertukaran mata wang digital teratas

Sepuluh pertukaran mata wang digital teratas