ChatGPT, alat penjanaan teks yang dikeluarkan baru-baru ini, telah menyebabkan perbincangan hangat dalam komuniti penyelidikan. Ia boleh menulis esei pelajar, meringkaskan kertas penyelidikan, menjawab soalan, menjana kod komputer yang boleh digunakan, malah cukup untuk lulus peperiksaan perubatan, peperiksaan MBA, peperiksaan kehakiman...

Salah satu daripada soalan utama Ya: Bolehkah ChatGPT dinamakan sebagai pengarang pada kertas penyelidikan?

Kini, jawapan jelas rasmi daripada arXiv, platform penerbitan pracetak terbesar di dunia, ialah: "Tidak".

Sebelum ChatGPT, penyelidik telah lama menggunakan chatbots sebagai pembantu penyelidik untuk membantu mengatur pemikiran mereka dan menjana cerapan tentang kerja mereka. maklum balas, bantuan dengan pengekodan, dan meringkaskan literatur penyelidikan.

Kerja-kerja bantu ini nampaknya diiktiraf, tetapi apabila bercakap mengenai "tandatangan", ia adalah perkara lain sama sekali. "Jelas sekali, program komputer tidak boleh bertanggungjawab ke atas kandungan kertas. Ia juga tidak boleh bersetuju dengan terma dan syarat arXiv." telah rasmi Pengarang diberikan kepada ChatGPT. Untuk menangani isu ini, arXiv telah menerima pakai dasar baharu untuk pengarang berkenaan penggunaan alat bahasa AI generatif.

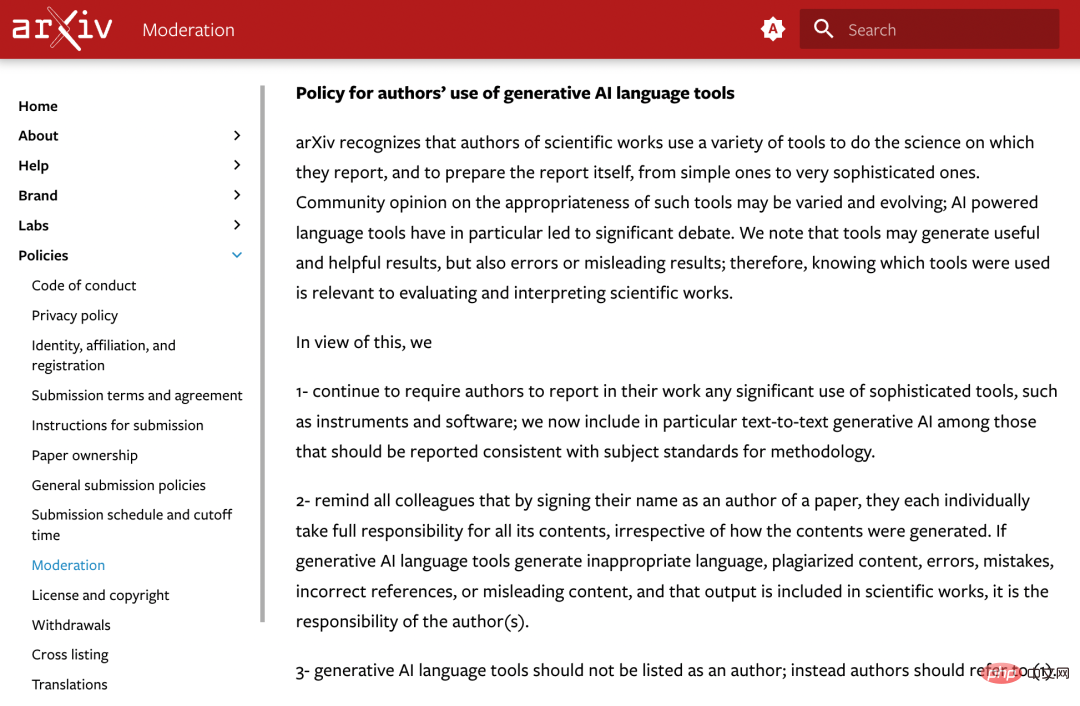

Kenyataan rasmi adalah seperti berikut:

arXiv mengiktiraf bahawa saintis menggunakan pelbagai alat untuk menjalankan kerja saintifik yang mereka laporkan dan untuk sediakan laporan itu sendiri, daripada alat mudah kepada alat yang sangat kompleks.

Pandangan komuniti tentang kesesuaian alatan ini mungkin berbeza-beza dan sentiasa berubah-ubah alatan bahasa dipacu AI mencetuskan perdebatan tertumpu. Kami ambil perhatian bahawa alat mungkin menghasilkan hasil yang berguna dan membantu, tetapi mungkin juga menghasilkan keputusan yang salah atau mengelirukan oleh itu, pemahaman alat yang digunakan adalah relevan untuk menilai dan mentafsir karya saintifik.

Berdasarkan perkara ini, arXiv memutuskan:

Berdasarkan perkara ini, arXiv memutuskan:

1 permintaan pengarang Laporkan penggunaan mana-mana alat yang kompleks, seperti instrumen dan perisian, dalam kerja mereka, kami kini secara khusus menyertakan "kecerdasan buatan generatif teks-ke-teks" antara alat yang harus dilaporkan yang memenuhi kriteria topik metodologi.

2. Ingatkan semua rakan sekerja bahawa dengan menandatangani nama mereka pada kertas itu, mereka masing-masing bertanggungjawab sepenuhnya ke atas semua kandungan kertas itu, tidak kira bagaimana ia dihasilkan. Jika alat bahasa AI generatif menghasilkan bahasa yang tidak sesuai, kandungan yang diciplak, kandungan yang salah, rujukan yang salah atau kandungan yang mengelirukan, dan output ini digabungkan ke dalam karya saintifik, ini adalah tanggungjawab pengarang.

3 Alat bahasa kecerdasan buatan generatif tidak boleh disenaraikan sebagai pengarang, sila rujuk 1.

Maksud "peraturan"

Beberapa hari lalu, majalah "Nature" secara terbuka menyatakan bahawa ia telah bersama-sama merumuskan dua prinsip dengan semua jurnal Springer Nature, dan ini Prinsip telah ditambahkan pada garis panduan pengarang sedia ada:Pertama, sebarang alat pemodelan bahasa yang besar tidak akan diterima sebagai pengarang bernama pada kertas penyelidikan. Ini kerana mana-mana pengarang datang dengan tanggungjawab untuk kerja itu, dan alatan AI tidak boleh memikul tanggungjawab itu.

Kedua, penyelidik yang menggunakan alat pemodelan bahasa yang besar harus mendokumentasikan penggunaan ini dalam bahagian Kaedah atau Penghargaan. Jika kertas itu tidak termasuk bahagian ini, gunakan pengenalan atau bahagian lain yang sesuai untuk mendokumentasikan penggunaan model bahasa yang besar.

Peraturan ini hampir sama dengan prinsip terkini yang dikeluarkan oleh arXiv Nampaknya organisasi dalam bidang penerbitan akademik telah mencapai kata sepakat.

Walaupun ChatGPT mempunyai keupayaan hebat, penyalahgunaannya dalam tugasan sekolah, penerbitan kertas dan bidang lain telah menimbulkan kebimbangan yang meluas.

Persidangan pembelajaran mesin ICML menyatakan: "ChatGPT dilatih mengenai data awam, yang sering dikumpulkan tanpa persetujuan, yang membawa satu siri tanggungjawab."

Oleh itu, komuniti akademik mula meneroka kaedah dan alat untuk mengesan teks yang dihasilkan oleh model bahasa besar (LLM) seperti ChatGPT. Pada masa hadapan, mengesan sama ada kandungan dijana oleh AI boleh menjadi "bahagian penting dalam proses semakan."

Atas ialah kandungan terperinci Mengikut peraturan rasmi arXiv, menggunakan alat seperti ChatGPT sebagai pengarang adalah tidak dibenarkan. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!

Bagaimana untuk menukar warna berus PS

Bagaimana untuk menukar warna berus PS

Apakah kitaran hayat vue3

Apakah kitaran hayat vue3

Bagaimana untuk membeli Bitcoin

Bagaimana untuk membeli Bitcoin

Analisis perbandingan iqooneo8 dan iqooneo9

Analisis perbandingan iqooneo8 dan iqooneo9

Perbezaan dan hubungan antara bahasa c dan c++

Perbezaan dan hubungan antara bahasa c dan c++

Bagaimana untuk menyelesaikan ralat yang dihadapi dalam pengalaman geforce

Bagaimana untuk menyelesaikan ralat yang dihadapi dalam pengalaman geforce

Bagaimana untuk membuka format TIF dalam tingkap

Bagaimana untuk membuka format TIF dalam tingkap

Komputer menggesa bahawa msvcr110.dll tiada dan cara menyelesaikannya

Komputer menggesa bahawa msvcr110.dll tiada dan cara menyelesaikannya