OpenAI melancarkan ChatGPT pada penghujung tahun 2022, dan popularitinya berterusan hingga ke hari ini Model ini berjalan dengan lancar, dan ia pasti akan menyebabkan kegilaan perbincangan ke mana-mana sahaja.

Syarikat teknologi utama, institusi, malah individu telah meningkatkan usaha mereka untuk membangunkan produk seperti ChatGPT. Pada masa yang sama, Microsoft menyambungkan ChatGPT ke Bing, dan Google mengeluarkan Bard untuk menghidupkan enjin carian. Ketua Pegawai Eksekutif NVIDIA Jensen Huang memberi penilaian tinggi kepada ChatGPT. Beliau berkata ChatGPT ialah detik iPhone dalam bidang kecerdasan buatan dan salah satu teknologi terhebat dalam sejarah pengkomputeran.

Ramai orang yakin bahawa AI perbualan telah tiba, tetapi adakah model ini benar-benar sempurna? Tidak semestinya, akan sentiasa ada beberapa detik luar biasa dalam mereka, seperti membuat kenyataan tanpa henti sesuka hati, atau berbual tentang rancangan untuk mengambil alih dunia.

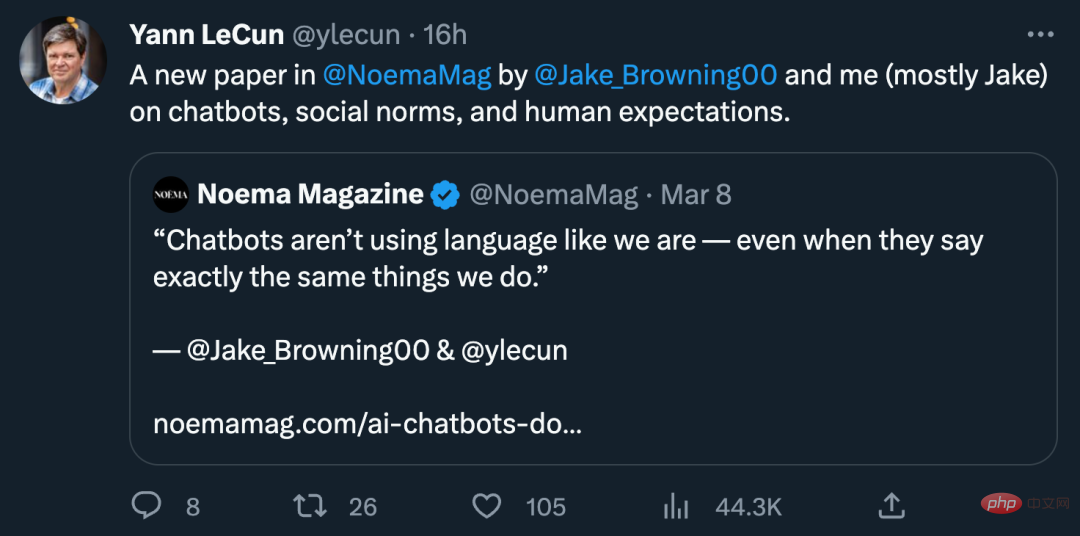

Untuk memahami detik-detik percakapan AI yang tidak masuk akal ini, Yann LeCun, salah satu daripada tiga gergasi pembelajaran mendalam, dan Jacob Browning, seorang felo pasca doktoral di Jabatan Sains Komputer di Universiti New York, bersama-sama menulis artikel "AI Chatbots Don't Care About Your Social Norma", yang membincangkan tiga aspek AI perbualan: chatbots, norma sosial dan jangkaan manusia.

Artikel tersebut menyebut bahawa manusia sangat pandai mengelak daripada tergelincir lidah dan mengelakkan diri daripada melakukan kesilapan serta perkataan dan perbuatan yang kesat. Sebaliknya, chatbots sering membuat kesilapan. Oleh itu, memahami sebab manusia begitu pandai mengelak kesilapan boleh membantu kita memahami dengan lebih baik mengapa chatbot tidak boleh dipercayai pada masa ini.

Untuk GPT-3, cara untuk membuat kesilapan termasuk statistik model yang tidak tepat. GPT-3 lebih bergantung pada gesaan pengguna Pemahamannya tentang konteks, situasi, dsb. hanya menumpukan pada perkara yang boleh diperoleh daripada gesaan pengguna. Begitu juga dengan ChatGPT, tetapi sedikit diubah suai dengan cara yang baru dan menarik. Sebagai tambahan kepada statistik, respons model juga diperkukuh oleh penilai manusia. Untuk output sistem, penilai manusia akan mengukuhkannya supaya ia menghasilkan respons yang baik. Hasil akhirnya ialah sistem itu bukan sahaja mengatakan sesuatu yang munasabah, tetapi (sebaik-baiknya) juga mengatakan sesuatu yang akan dinilai oleh manusia sebagai sesuai—walaupun model itu mengatakan sesuatu yang salah, sekurang-kurangnya ia tidak akan menyinggung perasaan orang lain.

Tetapi kaedah ini terasa terlalu mekanikal. Terdapat banyak cara untuk mengatakan perkara yang salah dalam perbualan manusia: Kita boleh mengatakan sesuatu yang tidak sesuai, tidak jujur, mengelirukan, atau benar-benar bodoh. Kita juga dikritik kerana mengucapkan nada atau intonasi yang salah apabila kita bercakap perkara yang betul. Dalam proses berurusan dengan orang lain, kita akan melalui "medan ranjau perbualan" yang tidak terkira banyaknya. Menjaga diri anda daripada mengatakan perkara yang salah bukan hanya bahagian penting dalam perbualan, ia selalunya lebih penting daripada perbualan itu sendiri. Kadangkala, menutup mulut mungkin satu-satunya tindakan yang betul.

Ini membawa kepada dua soalan: Bagaimanakah kita boleh mengawal situasi berbahaya model tidak mengatakan perkara yang salah? Dan mengapakah bot sembang tidak dapat mengawal diri mereka daripada mengatakan perkara yang salah dengan berkesan?

Perbualan manusia boleh mengenai apa-apa topik, seolah-olah ia ditulis: pesanan restoran, ceramah kecil, meminta maaf kerana terlambat, dsb. Walau bagaimanapun, ini bukan skrip bertulis, dan penuh dengan improvisasi Oleh itu, model perbualan manusia ini adalah model yang lebih umum, dan peraturannya tidak begitu ketat.

Pertuturan dan tingkah laku manusia yang berskrip ini tidak dibatasi oleh kata-kata. Walaupun anda tidak memahami bahasa, skrip yang sama boleh berfungsi, seperti membuat gerak isyarat untuk mengetahui perkara yang dikehendaki oleh orang lain. Norma sosial mengawal skrip ini dan membantu kita menavigasi kehidupan. Kod ini menentukan cara setiap orang harus berkelakuan dalam situasi tertentu, memberikan peranan kepada setiap orang dan memberi panduan luas tentang cara bertindak. Mematuhi norma berguna: ia memudahkan interaksi kita dengan menyeragamkan dan menyelaraskannya, menjadikannya lebih mudah untuk satu sama lain meramalkan niat masing-masing.

Manusia telah membangunkan rutin dan norma yang mengawal setiap aspek kehidupan sosial kita, daripada garpu yang hendak digunakan sehinggalah berapa lama anda perlu menunggu sebelum membunyikan hon anda. Ini adalah penting untuk kelangsungan hidup dalam dunia berbilion-bilion orang, di mana kebanyakan orang yang kita temui adalah orang asing yang kepercayaan mereka mungkin tidak sejajar dengan kita. Meletakkan norma yang dikongsi ini bukan sahaja membolehkan perbualan tetapi juga membuahkan hasil, membentangkan perkara yang patut kita bincangkan—dan semua perkara yang tidak sepatutnya kita bincangkan.

Manusia cenderung untuk menghukum mereka yang melanggar norma, kadang-kadang secara terbuka dan kadang-kadang secara rahsia. Norma sosial menjadikannya sangat mudah untuk menilai orang yang tidak dikenali, sebagai contoh, pada tarikh pertama melalui perbualan dan soalan, kedua-dua pihak akan menilai tingkah laku masing-masing dan jika orang lain melanggar salah satu norma - contohnya, jika mereka berkelakuan dalam sesuatu. Kasar atau tidak sesuai – kita sering menilai mereka dan menolak tarikh kedua.

Bagi manusia, penilaian ini bukan sahaja berdasarkan analisis yang tenang, tetapi selanjutnya berdasarkan tindak balas emosi kita terhadap dunia. Sebahagian daripada pendidikan kita sebagai kanak-kanak adalah latihan emosi untuk memastikan kita memberikan emosi yang betul pada masa yang sesuai dalam perbualan: kemarahan apabila seseorang melanggar norma etika, rasa meluat apabila seseorang berkata sesuatu yang menyakitkan hati, rasa meluat apabila kita bercakap bohong berasa malu. Hati nurani moral kita membolehkan kita bertindak balas dengan cepat terhadap apa-apa yang tidak sesuai dalam perbualan dan menjangka bagaimana orang lain akan bertindak balas terhadap kata-kata kita.

Tetapi lebih daripada itu, keseluruhan watak seseorang dipersoalkan jika dia melanggar norma mudah. Jika dia berbohong tentang satu perkara, adakah dia akan berbohong tentang perkara lain? Oleh itu, pendedahan bertujuan untuk memalukan orang lain dan, dalam proses itu, memaksa orang lain untuk meminta maaf atas (atau sekurang-kurangnya mempertahankan) tingkah laku mereka. Norma juga telah diperkukuh.

Ringkasnya, manusia harus mematuhi norma sosial dengan tegas, jika tidak terdapat risiko tinggi untuk mengatakan sesuatu. Kami bertanggungjawab untuk apa sahaja yang kami katakan, jadi pilih apa yang kami katakan dengan berhati-hati dan harapkan orang di sekeliling kami melakukan perkara yang sama.

Pertaruhan tinggi perbualan manusia mendedahkan perkara yang membuatkan chatbots sangat mengganggu. Dengan hanya meramalkan bagaimana perbualan akan berlaku, mereka akhirnya mematuhi norma manusia secara longgar, tetapi mereka tidak terikat dengan norma tersebut. Apabila kita berbual dengan chatbot secara santai atau menguji keupayaan mereka untuk menyelesaikan teka-teki bahasa, mereka sering memberikan jawapan yang munasabah dan berkelakuan seperti manusia biasa. Seseorang mungkin tersilap chatbot sebagai manusia.

Namun, jika kita menukar sedikit gesaan atau menggunakan skrip yang berbeza, chatbot tiba-tiba akan mengeluarkan teori konspirasi, omelan perkauman atau karut. Ini mungkin kerana mereka dilatih mengenai kandungan yang ditulis oleh ahli teori konspirasi, troll, dsb. di Reddit dan platform lain.

Mana-mana seorang daripada kita boleh mengatakan sesuatu seperti troll, tetapi kita tidak sepatutnya kerana perkataan troll dipenuhi dengan karut, kenyataan yang menyinggung perasaan, kekejaman dan ketidakjujuran. Kebanyakan kita tidak mengatakan perkara ini kerana kita tidak mempercayainya. Norma kesopanan telah menolak tingkah laku yang menyinggung perasaan masyarakat, jadi kebanyakan kita tidak berani mengatakannya.

Sebaliknya, chatbots tidak menyedari bahawa ada perkara yang tidak sepatutnya mereka katakan, tidak kira seberapa besar kemungkinan perkara tersebut. Mereka tidak menyedari norma sosial yang menentukan sempadan antara apa yang diperkatakan dan tidak, dan tidak menyedari tekanan sosial yang mendalam yang mempengaruhi penggunaan bahasa kita. Walaupun chatbots mengakui mereka melakukan kesalahan dan meminta maaf, mereka tidak faham mengapa. Jika kami menunjukkan bahawa mereka salah, chatbot akan meminta maaf untuk mendapatkan jawapan yang betul.

Ini menggambarkan isu yang lebih mendalam: Kami menjangkakan penceramah manusia akan benar dengan apa yang mereka katakan, dan kami bertanggungjawab ke atasnya. Kita tidak perlu memeriksa otak mereka atau memahami apa-apa tentang psikologi untuk melakukan ini, kita hanya perlu tahu bahawa mereka boleh dipercayai secara konsisten, mengikut peraturan, dan berkelakuan dengan hormat untuk mempercayai mereka. Masalah dengan chatbots bukanlah kerana mereka adalah "kotak hitam" atau tidak biasa dengan teknologi, tetapi mereka telah lama tidak boleh dipercayai dan tidak berdaya, dan tiada usaha telah dibuat untuk menambah baik atau menyedari terdapat masalah. .

Sudah tentu pembangun menyedari isu ini. Mereka, dan syarikat yang mahu teknologi AI mereka digunakan secara meluas, bimbang tentang reputasi chatbot mereka dan menghabiskan banyak masa untuk menstruktur semula sistem untuk mengelakkan perbualan yang sukar atau menghapuskan respons yang tidak sesuai. Walaupun ini membantu menjadikan chatbots lebih selamat, pembangun perlu bekerja keras untuk kekal di hadapan orang yang cuba memecahkannya. Akibatnya, pendekatan pembangun adalah reaktif dan sentiasa ketinggalan: terdapat terlalu banyak cara untuk meramalkan perkara yang salah.

Ini seharusnya tidak membuatkan kita leka tentang betapa pintarnya manusia dan betapa bodohnya chatbots. Sebaliknya, kebolehan mereka untuk bercakap tentang apa-apa sahaja mendedahkan pemahaman yang mendalam (atau dangkal) tentang kehidupan sosial manusia dan dunia pada umumnya. Chatbots cukup pintar untuk sekurang-kurangnya berjaya dalam ujian atau memberikan maklumat yang berguna. Kepanikan yang ditimbulkan oleh chatbot dalam kalangan pendidik menunjukkan keupayaan mengagumkan mereka untuk belajar daripada pembelajaran berasaskan buku.

Tetapi masalahnya ialah chatbots tidak peduli. Mereka tidak mempunyai matlamat intrinsik yang ingin dicapai melalui dialog dan tidak didorong oleh pemikiran atau reaksi orang lain. Mereka tidak berasa buruk tentang berbohong, dan kejujuran mereka tidak dihargai. Mereka tidak tahu malu dengan cara yang walaupun Trump cukup mengambil berat tentang reputasinya untuk sekurang-kurangnya mengaku jujur.

Oleh itu, perbualan chatbot tidak bermakna. Bagi manusia, perbualan ialah cara untuk mendapatkan apa yang kita mahu, seperti membuat sambungan, mendapatkan bantuan untuk projek, meluangkan masa atau mempelajari sesuatu. Perbualan memerlukan kita berminat, dan secara idealnya mengambil berat tentang orang yang kita bercakap.

Walaupun kita tidak mengambil berat tentang orang yang kita bercakap, sekurang-kurangnya kita mengambil berat tentang pendapat orang lain tentang kita. Kami amat memahami bahawa kejayaan dalam hidup (seperti mempunyai hubungan rapat, melakukan kerja yang baik, dll.) bergantung pada reputasi yang baik. Jika status sosial kita jatuh, kita berisiko kehilangan segala-galanya. Perbualan membentuk cara orang lain melihat kita, dan ramai di antara kita menggunakan monolog dalaman untuk membentuk persepsi kita terhadap diri kita sendiri.

Tetapi chatbots tidak mempunyai cerita mereka sendiri untuk diceritakan dan reputasi untuk dipertahankan, dan mereka tidak merasakan tarikan tindakan bertanggungjawab yang kami lakukan. Chatbots boleh dan berguna dalam banyak situasi berskrip tinggi, daripada bermain Dungeon Master, menulis salinan yang masuk akal, atau membantu pengarang meneroka idea, untuk menamakan beberapa. Tetapi mereka kurang pengetahuan tentang diri mereka atau orang lain untuk menjadi ejen sosial yang boleh dipercayai, jenis orang yang kita mahu bercakap dengan kebanyakan masa.

Jika anda tidak memahami norma mengenai kejujuran dan kesopanan serta tidak mengambil berat tentang reputasi anda, chatbots mempunyai kegunaan terhad dan bergantung padanya membawa bahaya sebenar.

Oleh itu, chatbots tidak bercakap dengan cara seperti manusia, dan mereka tidak boleh mencapai matlamat mereka dengan hanya bercakap dengan cara yang kelihatan boleh dipercayai secara statistik. Tanpa pemahaman sebenar tentang dunia sosial, sistem AI ini hanyalah kotak sembang yang membosankan, tidak kira betapa cerdik atau fasihnya ia kelihatan.

Ini membantu menggambarkan mengapa sistem AI ini hanyalah alat yang sangat menarik dan mengapa manusia tidak sepatutnya dapat membuat antropomorfismenya. Manusia bukan sahaja pemikir atau penceramah yang tidak memihak, tetapi pada dasarnya adalah makhluk yang mematuhi norma, berhubung secara emosi antara satu sama lain melalui jangkaan yang dikongsi dan dikuatkuasakan. Pemikiran dan pertuturan manusia berasal dari fitrah sosial mereka sendiri.

Dialog tulen dipisahkan daripada penyertaan dunia yang meluas dan tiada persamaan dengan manusia. Chatbots tidak menggunakan bahasa seperti kita, walaupun kadangkala mereka bercakap sama seperti kita. Tetapi akhirnya, mereka tidak faham mengapa kita bercakap seperti ini, itu jelas.

Atas ialah kandungan terperinci Yann LeCun: Tanpa mengira norma sosial, ChatGPT jauh daripada orang sebenar. Untuk maklumat lanjut, sila ikut artikel berkaitan lain di laman web China PHP!