현재 Transformers는 최첨단 자연어 처리(NLP) 및 컴퓨터 비전(CV) 아키텍처의 핵심 모듈입니다. 그러나 표 형식 데이터 분야는 여전히 GBDT(Gradient Boosted Decision Tree) 알고리즘이 지배하고 있습니다. 그래서 이 격차를 해소하려는 시도가 있었습니다. 그 중 최초의 변환기 기반 테이블 형식 데이터 모델링 논문은 2020년에 Huang 등이 출판한 논문 "TabTransformer: Tabular Data Modeling Using Context Embedding"입니다.

이 기사의 목적은 논문 내용의 기본 표시를 제공하는 동시에 TabTransformer 모델의 구현 세부 사항을 살펴보고 자체 데이터에 대해 TabTransformer를 사용하는 방법을 보여주는 것입니다.

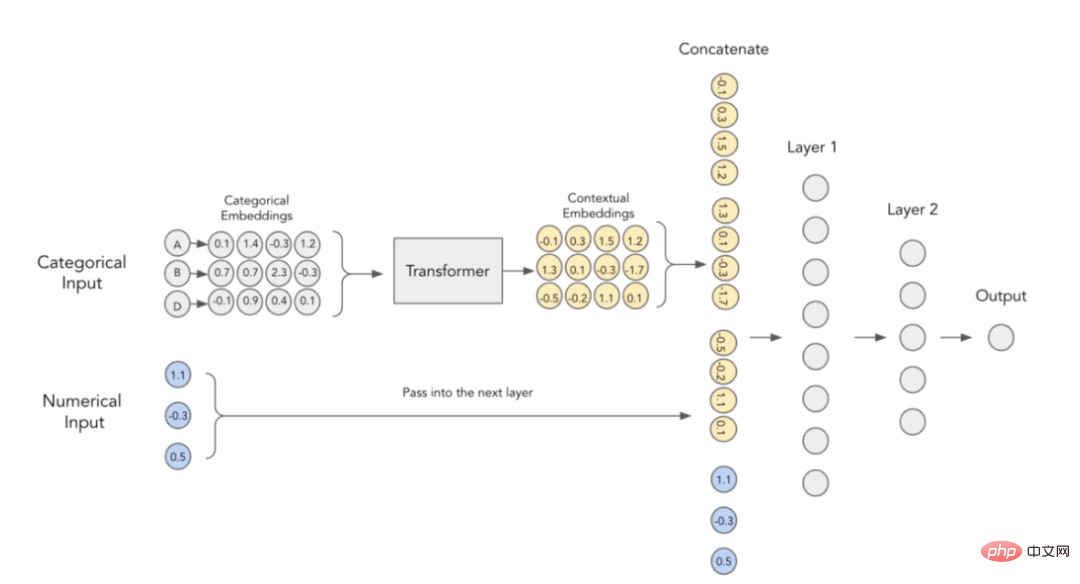

위 논문의 주요 아이디어는 변환기를 사용하여 일반 범주형 임베딩을 상황별 임베딩으로 변환하면 일반 다층 퍼셉트론(MLP)의 성능이 크게 향상된다는 것입니다. 향상 . 다음으로 이 설명을 더 깊이 이해해 보겠습니다.

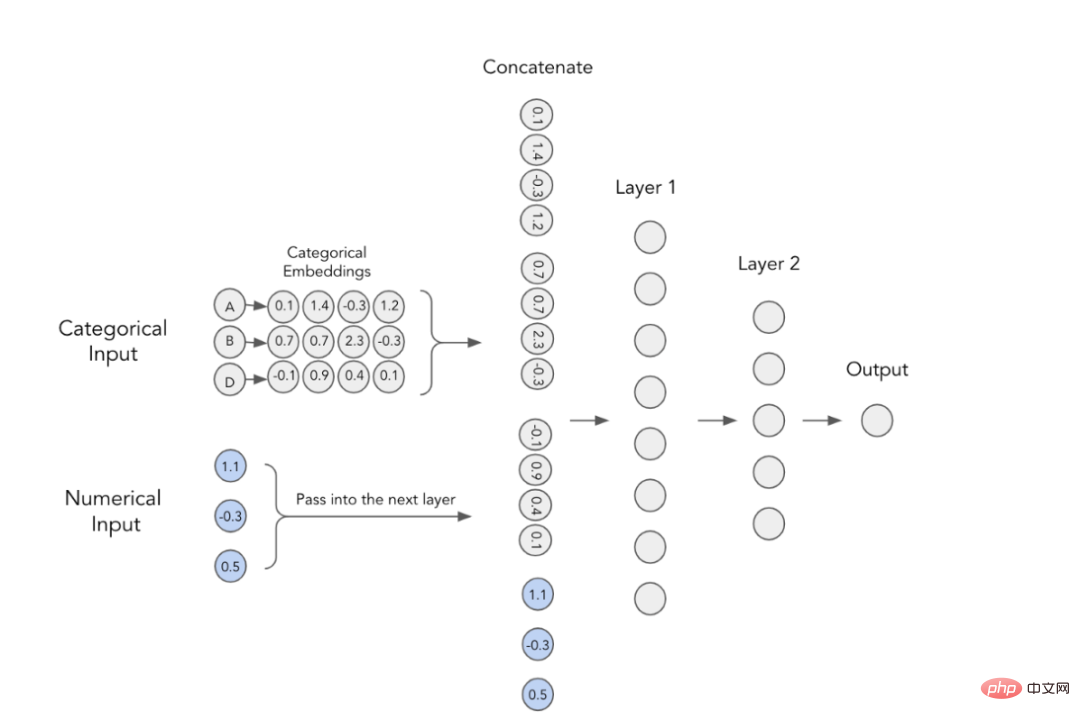

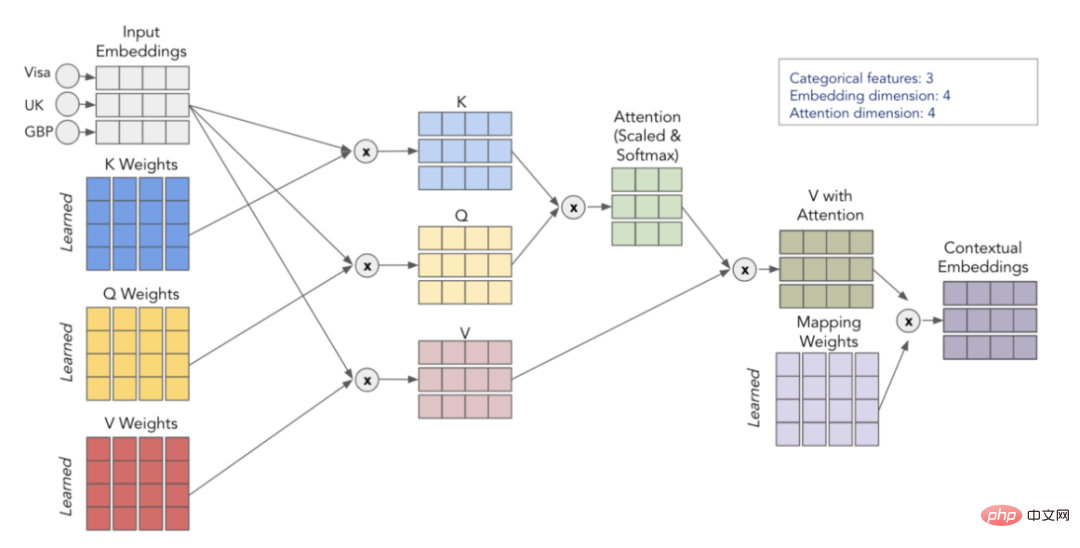

딥 러닝 모델에서 범주형 기능을 사용하는 고전적인 방법은 임베딩을 훈련하는 것입니다. 이는 각 카테고리 값이 고유한 밀집 벡터 표현을 가지며 다음 레이어로 전달될 수 있음을 의미합니다. 예를 들어, 아래 이미지에서 각 범주형 특성이 4차원 배열로 표현되는 것을 볼 수 있습니다. 그런 다음 이러한 임베딩은 숫자 특성과 연결되어 MLP에 대한 입력으로 사용됩니다.

범주형 임베딩이 있는 MLP

논문의 저자는 범주형 임베딩에는 상황적 의미가 부족하다고 믿습니다. 즉, 범주형 임베딩은 대화형 변수와 대화형 변수 사이에 아무런 관계가 없습니다. 관계 정보가 인코딩됩니다. 임베디드 콘텐츠를 보다 구체적으로 만들기 위해 현재 NLP 분야에서 사용되는 변환기를 이러한 목적으로 사용하는 것이 제안되었습니다.

TabTransformer의 컨텍스트 임베딩

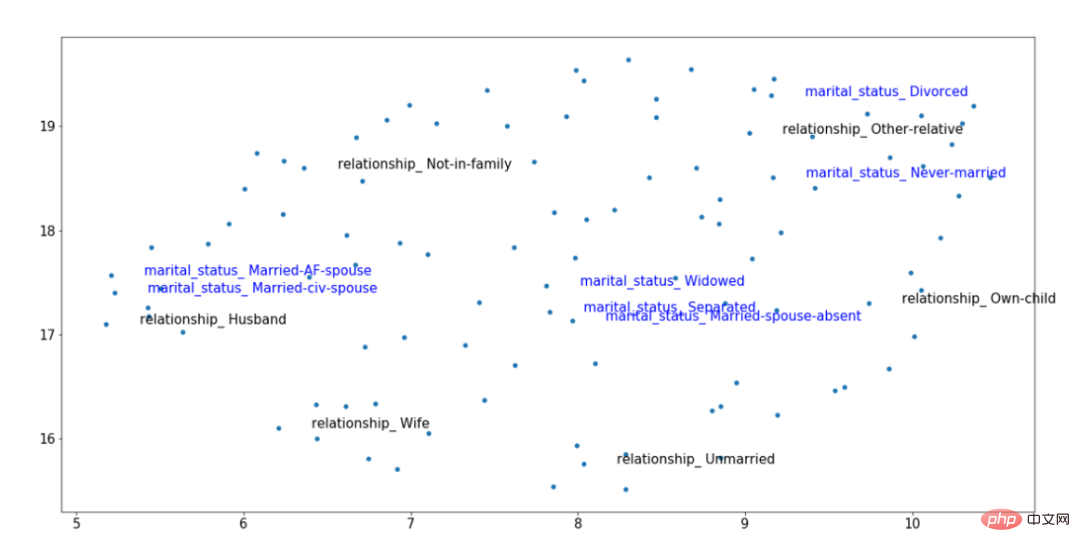

위 아이디어를 시각적으로 설명하기 위해 훈련 후 얻은 컨텍스트 임베딩에 대한 다음 이미지를 고려해 볼 수도 있습니다. 그 중 관계(검은색)와 결혼 여부(파란색)라는 두 가지 분류 기능이 강조 표시됩니다. 이러한 특징은 서로 연관되어 있으므로 "기혼", "남편" 및 "아내"에 대한 값은 서로 다른 변수에서 나오더라도 벡터 공간에서 서로 가까워야 합니다.

훈련된 TabTransformer 임베딩 결과의 예

위 그림의 훈련된 컨텍스트 임베딩 결과를 통해 "결혼"의 결혼 상태가 "남편"의 관계 수준에 더 가깝다는 것을 알 수 있습니다. 및 "아내"가 표시되는 반면 "미혼"에 대한 범주 값은 오른쪽의 별도 데이터 클러스터에서 가져옵니다. 이러한 유형의 컨텍스트는 이러한 임베딩을 더욱 유용하게 만들어주며, 이는 단순한 형태의 카테고리 임베딩 기술로는 불가능한 효과입니다.

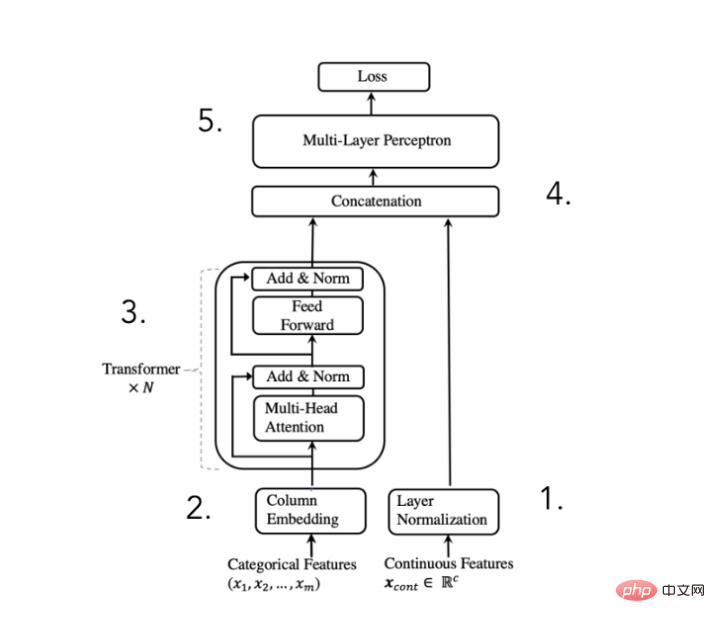

위의 목적을 달성하기 위해 논문의 저자는 다음 아키텍처를 제안했습니다. Huang et al.(2020년)

이 아키텍처를 5단계로 나눌 수 있습니다.

숫자 특성을 정규화하고 전달합니다.

범주형 특성 포함

포함은 N번의 변환기 블록으로 처리됩니다.

문맥 분류 임베딩을 수치 특징과 연결합니다.

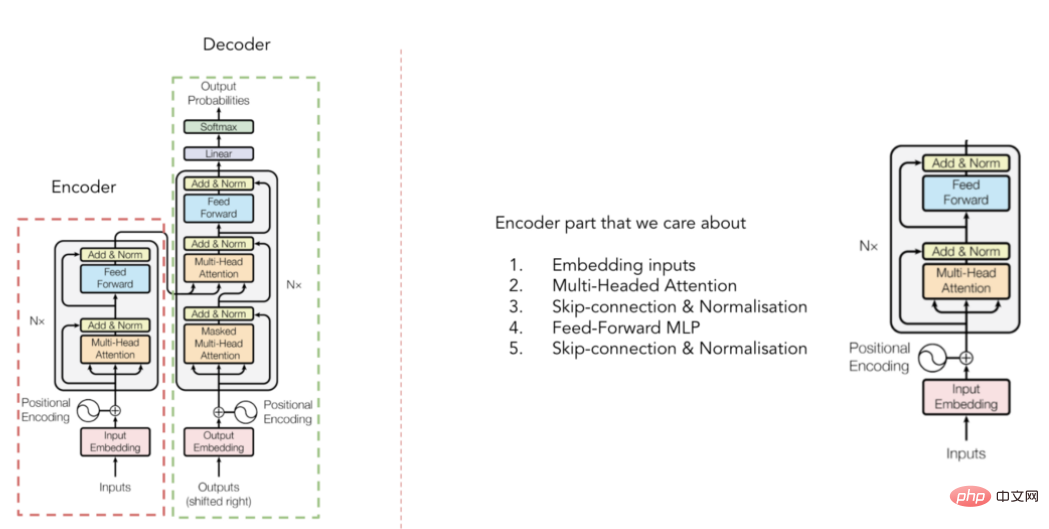

Transformer 아키텍처의 일러스트레이션

Transformer 아키텍처를 이전에 본 적이 있을 수도 있지만 간략한 소개를 위해 변환기는 인코더와 디코더의 두 부분으로 구성되어 있음을 기억하십시오(위 그림 참조). TabTransformer의 경우 입력 임베딩을 맥락화하는 인코더 부분에만 관심이 있습니다(디코더 부분은 이러한 임베딩을 최종 출력 결과로 변환합니다). 하지만 정확히 어떻게 이루어 집니까? 대답은 다중 헤드 주의 메커니즘입니다.

Attention 메커니즘에 대해 제가 가장 좋아하는 기사의 설명을 인용하면 다음과 같습니다.

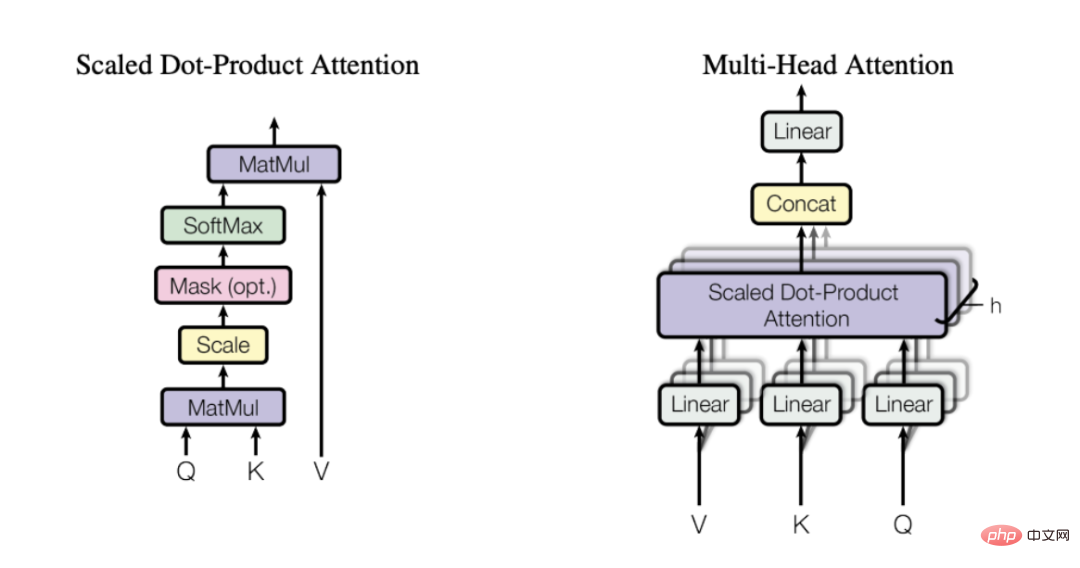

“Self attention의 핵심 개념은 이 메커니즘을 통해 신경망이 입력 시퀀스의 개별 부분에 대해 작동하는 방법을 학습할 수 있다는 것입니다. 즉, self-attention은 모델이 특정 단어/범주를 나타낼 때 입력의 어떤 부분이 상대적으로 중요하지 않은지 파악하는 데 도움이 됩니다. 이를 위해 위에 언급된 기사를 읽고 자기 집중이 왜 그렇게 효과적인지 더 직관적으로 이해하는 것이 좋습니다. ( 쿼리), 키(Key), 값(Value)입니다. 먼저, 행렬 Q와 K를 곱하여 어텐션 행렬을 얻습니다. 이 행렬은 스케일링되어 소프트맥스 레이어를 통과합니다. 그런 다음 여기에 V 행렬을 곱하여 최종 값을 얻습니다. 보다 직관적인 이해를 위해 행렬 Q, K 및 V를 사용하여 입력 임베딩에서 컨텍스트 임베딩으로의 변환을 구현하는 방법을 보여주는 아래 회로도를 고려하십시오.

self-attention 프로세스의 시각화

이 프로세스를 h번 반복함으로써(다른 Q, K, V 행렬 사용) 최종 다중 헤드를 형성하는 다중 컨텍스트 임베딩을 얻을 수 있습니다. 주목 .

6. 간략한 검토

위에서 다룬 내용을 요약해 보겠습니다.

간단한 범주형 임베딩에는 문맥 정보가 포함되어 있지 않습니다.

범주형 임베딩을 변환기 인코더를 통해 전달하면 임베딩이 가능합니다. 상황화

변환기 부분은 다중 헤드 어텐션 메커니즘을 사용하기 때문에 임베딩을 상황화할 수 있습니다

멀티 헤드 어텐션 메커니즘은 행렬 Q, K 및 V를 사용하여 변수를 인코딩할 때 유용한 상호 작용 및 상관 정보를 찾습니다

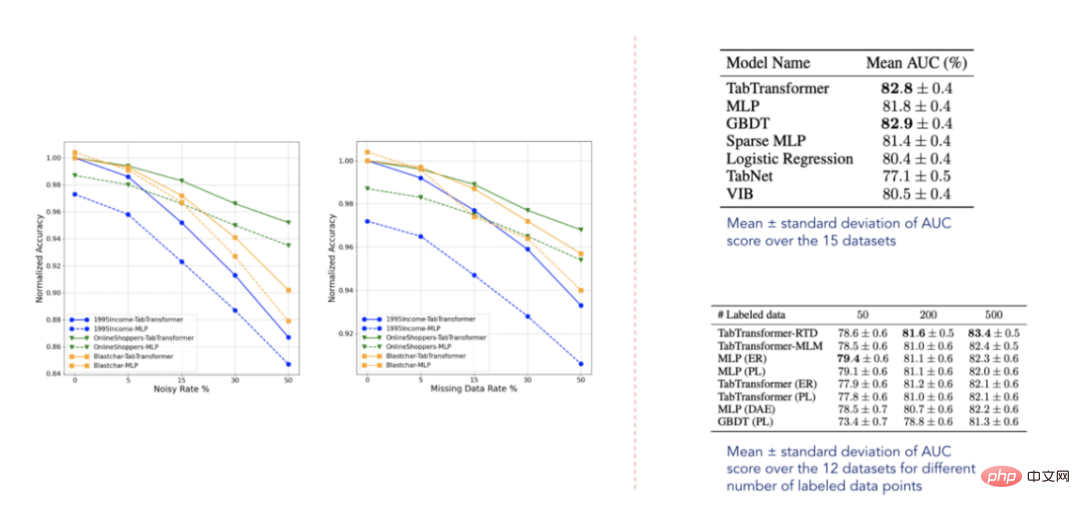

보고된 결과에 따르면 TabTransformer 변환기는 다른 모든 딥 러닝보다 성능이 뛰어납니다. 테이블 형식 모델, 게다가 GBDT의 성능 수준에 가깝다는 점은 매우 고무적입니다. 또한 이 모델은 누락된 데이터와 잡음이 있는 데이터에 대해 상대적으로 견고하며 준지도 설정에서 다른 모델보다 성능이 뛰어납니다. 그러나 이러한 데이터 세트는 분명히 완전한 것은 아니며 향후 발표될 수많은 관련 논문에서 확인되는 것처럼 여전히 개선의 여지가 상당히 많습니다.

2. 자체 샘플 프로그램 구축

이제 최종적으로 모델을 자체 데이터에 어떻게 적용할지 결정해 보겠습니다. 다음 예제 데이터는 유명한 Tabular Playground Kaggle 대회에서 가져온 것입니다. TabTransformer 변환기를 쉽게 사용하기 위해 tabtransformertf 패키지를 만들었습니다.

pip install tabtransformertf

와 같이 pip 명령을 사용하여 설치할 수 있으며 광범위한 전처리 없이 모델을 사용할 수 있습니다.

from tabtransformertf.utils.preprocessing import df_to_dataset, build_categorical_prep # 设置数据类型 train_data[CATEGORICAL_FEATURES] = train_data[CATEGORICAL_FEATURES].astype(str) val_data[CATEGORICAL_FEATURES] = val_data[CATEGORICAL_FEATURES].astype(str) train_data[NUMERIC_FEATURES] = train_data[NUMERIC_FEATURES].astype(float) val_data[NUMERIC_FEATURES] = val_data[NUMERIC_FEATURES].astype(float) # 转换成TF数据集 train_dataset = df_to_dataset(train_data[FEATURES + [LABEL]], LABEL, batch_size=1024) val_dataset = df_to_dataset(val_data[FEATURES + [LABEL]], LABEL, shuffle=False, batch_size=1024)

from tabtransformertf.utils.preprocessing import build_categorical_prep

category_prep_layers = build_categorical_prep(train_data, CATEGORICAL_FEATURES)

# 输出结果是一个字典结构,其中键部分是特征名称,值部分是StringLookup层

# category_prep_layers ->

# {'product_code': <keras.layers.preprocessing.string_lookup.StringLookup at 0x7f05d28ee4e0>,

#'attribute_0': <keras.layers.preprocessing.string_lookup.StringLookup at 0x7f05ca4fb908>,

#'attribute_1': <keras.layers.preprocessing.string_lookup.StringLookup at 0x7f05ca4da5f8>}from tabtransformertf.models.tabtransformer import TabTransformer tabtransformer = TabTransformer( numerical_features = NUMERIC_FEATURES,# 带有数字特征名称的列表 categorical_features = CATEGORICAL_FEATURES, # 带有分类特征名称的列表 categorical_lookup=category_prep_layers, # 带StringLookup层的Dict numerical_discretisers=None,# None代表我们只是简单地传递数字特征 embedding_dim=32,# 嵌入维数 out_dim=1,# Dimensionality of output (binary task) out_activatinotallow='sigmoid',# 输出层激活 depth=4,# 转换器块层的个数 heads=8,# 转换器块中注意力头的个数 attn_dropout=0.1,# 在转换器块中的丢弃率 ff_dropout=0.1,# 在最后MLP中的丢弃率 mlp_hidden_factors=[2, 4],# 我们为每一层划分最终嵌入的因子 use_column_embedding=True,#如果我们想使用列嵌入,设置此项为真 ) # 模型运行中摘要输出: # 总参数个数: 1,778,884 # 可训练的参数个数: 1,774,064 # 不可训练的参数个数: 4,820

LEARNING_RATE = 0.0001 WEIGHT_DECAY = 0.0001 NUM_EPOCHS = 1000 optimizer = tfa.optimizers.AdamW( learning_rate=LEARNING_RATE, weight_decay=WEIGHT_DECAY ) tabtransformer.compile( optimizer = optimizer, loss = tf.keras.losses.BinaryCrossentropy(), metrics= [tf.keras.metrics.AUC(name="PR AUC", curve='PR')], ) out_file = './tabTransformerBasic' checkpoint = ModelCheckpoint( out_file, mnotallow="val_loss", verbose=1, save_best_notallow=True, mode="min" ) early = EarlyStopping(mnotallow="val_loss", mode="min", patience=10, restore_best_weights=True) callback_list = [checkpoint, early] history = tabtransformer.fit( train_dataset, epochs=NUM_EPOCHS, validation_data=val_dataset, callbacks=callback_list )

val_preds = tabtransformer.predict(val_dataset)

print(f"PR AUC: {average_precision_score(val_data['isFraud'], val_preds.ravel())}")

print(f"ROC AUC: {roc_auc_score(val_data['isFraud'], val_preds.ravel())}")

# PR AUC: 0.26

# ROC AUC: 0.58您也可以自己给测试集评分,然后将结果值提交给Kaggle官方。我现在选择的这个解决方案使我跻身前35%,这并不坏,但也不太好。那么,为什么TabTransfromer在上述方案中表现不佳呢?可能有以下几个原因:

本文探讨了TabTransformer背后的主要思想,并展示了如何使用Tabtransformertf包来具体应用此转换器。

归纳起来看,TabTransformer的确是一种有趣的体系结构,它在当时的表现明显优于大多数深度表格模型。它的主要优点是将分类嵌入语境化,从而增强其表达能力。它使用在分类特征上的多头注意力机制来实现这一点,而这是在表格数据领域使用转换器的第一个应用实例。

TabTransformer体系结构的一个明显缺点是,数字特征被简单地传递到最终的MLP层。因此,它们没有语境化,它们的价值也没有在分类嵌入中得到解释。在下一篇文章中,我将探讨如何修复此缺陷并进一步提高性能。

朱先忠,51CTO社区编辑,51CTO专家博客、讲师,潍坊一所高校计算机教师,自由编程界老兵一枚。

原文链接:https://towardsdatascience.com/transformers-for-tabular-data-tabtransformer-deep-dive-5fb2438da820?source=collection_home---------4----------------------------

위 내용은 TabTransformer 변환기는 다층 퍼셉트론 성능 심층 분석을 향상시킵니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!