python 동영상 튜토리얼이 칼럼에서는 빅데이터 분석 아티팩트를 소개합니다

권장(무료): python 동영상 튜토리얼

Pandas의 실행 속도를 향상시키는 방법 code>는 이전에 여러 번 소개되었으며 <code>Dask가 자주 언급됩니다. 한번도 접해보지 않은 많은 친구들은 이에 대해 잘 알지 못할 수도 있습니다. 오늘은 이 아티팩트를 추천하겠습니다. Pandas运行速度的提升方法,之前已经介绍过很多回了,里面经常提及Dask,很多朋友没接触过可能不太了解,今天就推荐一下这个神器。

1、什么是Dask?

Pandas和Numpy大家都不陌生了,代码运行后数据都加载到RAM中,如果数据集特别大,我们就会看到内存飙升。但有时要处理的数据并不适合RAM,这时候Dask来了。

Dask是开源免费的。它是与其他社区项目(如Numpy,Pandas和Scikit-Learn)协调开发的。

官方:https://dask.org/

Dask支持Pandas的DataFrame和NumpyArray的数据结构,并且既可在本地计算机上运行,也可以扩展到在集群上运行。

基本上,只要编写一次代码,使用普通的Pythonic语法,就可在本地运行或部署到多节点集群上。这本身就是一个很牛逼的功能了,但这还不是最牛逼的。

我觉得Dask的最牛逼的功能是:它兼容大部分我们已经在用的工具,并且只需改动少量的代码,就可以利用自己笔记本电脑上已有的处理能力并行运行代码。而并行处理数据就意味着更少的执行时间,更少的等待时间和更多的分析时间。

下面这个就是Dask进行数据处理的大致流程。

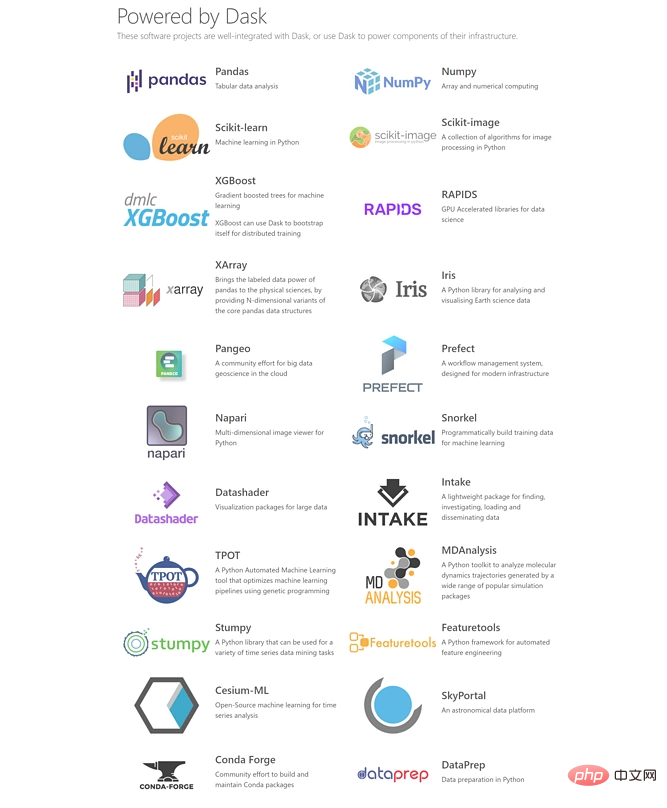

2、Dask支持哪些现有工具?

这一点也是我比较看中的,因为Dask可以与Python数据处理和建模的库包兼容,沿用库包的API,这对于Python使用者来说学习成本是极低的。而像Hadoop、Spark这种大数据处理是有很高的学习门槛和时间成本的。

目前,Dask可支持pandas、Numpy、Sklearn、XGBoost、XArray、RAPIDS等等,光是这几项我觉得就足够用了,至少对于常用的数据处理、建模分析是完全覆盖得掉的。

3、Dask安装

可以使用 conda 或者 pip,或从源代码安装dask 。

conda install dask

因为dask有很多依赖,所以为了快速安装也可用下面代码,将安装运行Dask所需的最少依赖关系集。

conda install dask-core

再有就是通过源来安装。

git clone https://github.com/dask/dask.git cd dask python -m pip install .

4、Dask如何使用?

Numpy、pandas

Dask引入了3个并行集合,它们可以存储大于RAM的数据,这些集合有DataFrame、Bags、Arrays。这些集合类型中的每一个都能够使用在RAM和硬盘之间分区的数据,以及分布在群集中多个节点上的数据。

Dask的使用是非常清晰的,如果你使用NumPy数组,就从Dask数组开始,如果你使用Pandas DataFrame,就从Dask DataFrame开始,依此类推。

import dask.array as da

x = da.random.uniform(low=0, high=10, size=(10000, 10000), # normal numpy code

chunks=(1000, 1000)) # break into chunks of size 1000x1000

y = x + x.T - x.mean(axis=0) # Use normal syntax for high level algorithms

# DataFrames

import dask.dataframe as dd

df = dd.read_csv('2018-*-*.csv', parse_dates='timestamp', # normal Pandas code

blocksize=64000000) # break text into 64MB chunks

s = df.groupby('name').balance.mean() # Use normal syntax for high level algorithms

# Bags / lists

import dask.bag as db

b = db.read_text('*.json').map(json.loads)

total = (b.filter(lambda d: d['name'] == 'Alice')

.map(lambda d: d['balance'])

.sum())这些高级接口在略微变化的情况下复制了标准接口。对于原始项目中的大部分API,这些接口会自动为我们并行处理较大的数据集,实现上不是很复杂,对照Dask的doc文档即可一步步完成。

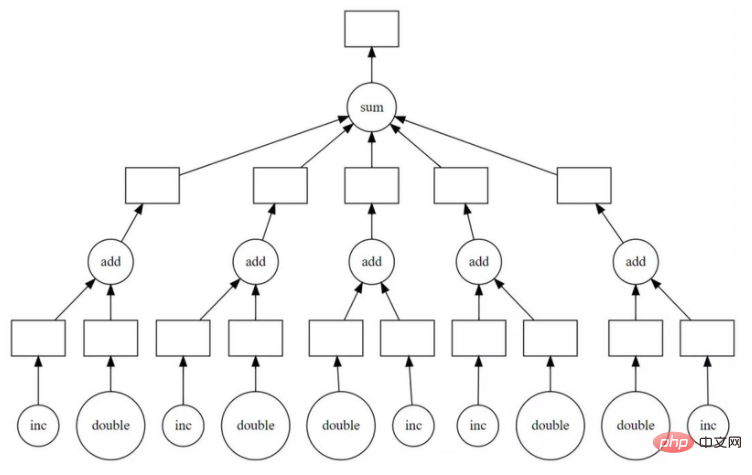

Delayed

下面说一下Dask的 Delay 功能,非常强大。

Dask.delayed是一种并行化现有代码的简单而强大的方法。之所以被叫做delayed是因为,它没有立即计算出结果,而是将要作为任务计算的结果记录在一个图形中,稍后将在并行硬件上运行。

有时问题用已有的dask.array或dask.dataframe可能都不适合,在这些情况下,我们可以使用更简单的dask.delayed

Pandas 및 Numpy는 모두에게 친숙합니다. 코드가 실행된 후 데이터 세트가 특히 큰 경우에는 데이터가 RAM에 로드됩니다. 기억이 솟아오른다. 하지만 처리할 데이터가 RAM에 맞지 않는 경우가 있는데, 여기에 Dask가 옵니다. 🎜🎜Dask는 오픈 소스이며 무료입니다. Numpy, Pandas 및 Scikit-Learn과 같은 다른 커뮤니티 프로젝트와 협력하여 개발되었습니다. 🎜공식: https://dask.org/🎜

Dask는 Pandas의 DataFrame 및 를 지원합니다. NumpyArray 의 데이터 구조이며 로컬 컴퓨터에서 실행되거나 클러스터에서 실행되도록 확장될 수 있습니다. 🎜🎜기본적으로 코드를 한 번 작성하고 일반 Pythonic 구문을 사용하여 로컬에서 실행하거나 다중 노드 클러스터에 배포하세요. 이것은 그 자체로 멋진 기능이지만 가장 멋진 기능은 아닙니다. 🎜🎜Dask의 가장 멋진 기능은 다음과 같습니다. 🎜우리가 이미 사용하고 있는 대부분의 도구와 호환되며, 약간의 코드 변경만으로 이미 사용하고 있는 도구를 사용할 수 있습니다. 노트북에 코드를 병렬로 실행할 수 있는 처리 능력이 있어야 합니다. 데이터를 병렬로 처리하면 실행 시간과 대기 시간이 줄어들고 분석 시간이 늘어납니다. 🎜🎜🎜다음은 Dask에서 데이터를 처리하는 일반적인 과정입니다.  🎜 🎜🎜2. Dask는 어떤 기존 도구를 지원하나요? 🎜🎜🎜이것도 제가 좋아하는 점인데,

🎜 🎜🎜2. Dask는 어떤 기존 도구를 지원하나요? 🎜🎜🎜이것도 제가 좋아하는 점인데, Dask는 Python 데이터 처리 및 모델링 라이브러리 패키지와 호환되고, 라이브러리 패키지의 API를 따르기 때문입니다. Python에 유용합니다. 사용자의 학습 비용은 매우 낮습니다. Hadoop 및 Spark와 같은 빅데이터 처리는 학습 임계값과 시간 비용이 높습니다. 🎜🎜현재 Dask는 pandas, Numpy, Sklearn, XGBoost를 지원할 수 있습니다. XArray, RAPIDS 등 적어도 일반적인 데이터 처리, 모델링 분석에는 충분하다고 생각합니다.  🎜 🎜3. Dask 설치🎜🎜🎜

🎜 🎜3. Dask 설치🎜🎜🎜conda 또는 pip를 사용하거나 소스 코드에서 dask를 설치할 수 있습니다. 🎜def inc(x): return x + 1 def double(x): return x * 2 def add(x, y): return x + y data = [1, 2, 3, 4, 5] output = [] for x in data: a = inc(x) b = double(x) c = add(a, b) output.append(c) total = sum(output) 45

dask에는 많은 종속성이 있으므로 빠른 설치를 위해 다음 코드를 사용할 수도 있습니다. 그러면 Dask를 실행하는 데 필요한 최소한의 종속성 세트가 설치됩니다. 🎜import dask output = [] for x in data: a = dask.delayed(inc)(x) b = dask.delayed(double)(x) c = dask.delayed(add)(a, b) output.append(c) total = dask.delayed(sum)(output)

total.visualize()

Dask에는 RAM보다 큰 데이터를 저장할 수 있는 3개의 병렬 컬렉션이 도입되었습니다. 이러한 컬렉션에는 DataFrame, Bags, <code>배열. 이러한 각 컬렉션 유형은 RAM과 하드 디스크 간에 분할된 데이터는 물론 클러스터의 여러 노드에 분산된 데이터로 작업할 수 있습니다. 🎜🎜Dask의 사용은 매우 명확합니다. NumPy 배열을 사용하는 경우 Pandas DataFrame을 사용하는 경우 시작하세요. , Dask DataFrame으로 시작 등. 🎜>>> total.compute() 45

Dask 문서를 참조하여 단계별로 완료할 수 있습니다. 코드>. 🎜🎜🎜Delayed🎜🎜🎜 매우 강력한 <code>Dask의 Delay 기능에 대해 이야기해보겠습니다. 🎜🎜Dask.delayed는 기존 코드를 병렬화하는 간단하고 강력한 방법입니다. 결과를 즉시 계산하지 않고 나중에 병렬 하드웨어에서 실행될 그래프에 작업으로 계산 결과를 기록하기 때문에 지연이라고 합니다. 🎜🎜때때로 기존 dask.array 또는 dask.dataframe이 문제에 적합하지 않을 수 있습니다. 이러한 경우에는 더 간단한 dask Delay인터페이스는 사용자 정의 알고리즘을 병렬화합니다. 다음 예를 예로 들어 보겠습니다. 🎜<div class="code" style="position:relative; padding:0px; margin:0px;"><div class="code" style="position:relative; padding:0px; margin:0px;"><pre class="brush:php;toolbar:false">def inc(x):

return x + 1

def double(x):

return x * 2

def add(x, y):

return x + y

data = [1, 2, 3, 4, 5]

output = []

for x in data:

a = inc(x)

b = double(x)

c = add(a, b)

output.append(c)

total = sum(output)

45</pre><div class="contentsignin">로그인 후 복사</div></div><div class="contentsignin">로그인 후 복사</div></div>

<p>上面代码在单个线程中按顺序运行。但是,我们看到其中很多可以并行执行。<code>Dask delayed函数可修饰inc、double这些函数,以便它们可延迟运行,而不是立即执行函数,它将函数及其参数放入计算任务图中。

我们简单修改代码,用delayed函数包装一下。

import dask output = [] for x in data: a = dask.delayed(inc)(x) b = dask.delayed(double)(x) c = dask.delayed(add)(a, b) output.append(c) total = dask.delayed(sum)(output)

代码运行后inc、double、add和sum都还没有发生,而是生成一个计算的任务图交给了total。然后我们用visualizatize看下任务图。

total.visualize()

上图明显看到了并行的可能性,所以毫不犹豫,使用compute进行并行计算,这时才完成了计算。

>>> total.compute() 45

由于数据集较小无法比较时间,这里只介绍下使用方法,具体可自己动手实践下。

Sklearn机器学习

关于机器学习的并行化执行,由于内容较多,东哥会在另一篇文章展开。这里简单说下一下dask-learn。

dask-learn项目是与Sklearn开发人员协作完成的。现在可实现并行化有Scikit-learn的Pipeline、GridsearchCV和RandomSearchCV以及这些的变体,它们可以更好地处理嵌套的并行操作。

因此,如果你将sklearn替换为dklearn,那么速度将会提升很多。

# from sklearn.grid_search import GridSearchCV

from dklearn.grid_search import GridSearchCV

# from sklearn.pipeline import Pipeline

from dklearn.pipeline import Pipeline

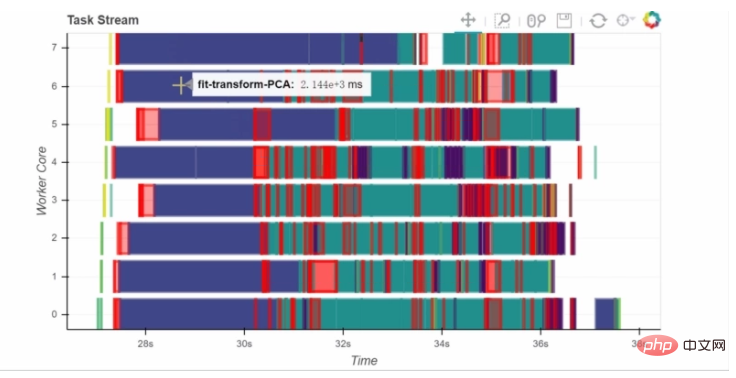

下面是一个使用Pipeline的示例,其中应用了PCA和逻辑回归。

from sklearn.datasets import make_classification

X, y = make_classification(n_samples=10000,

n_features=500,

n_classes=2,

n_redundant=250,

random_state=42)

from sklearn import linear_model, decomposition

from sklearn.pipeline import Pipeline

from dklearn.pipeline import Pipeline

logistic = linear_model.LogisticRegression()

pca = decomposition.PCA()

pipe = Pipeline(steps=[('pca', pca),

('logistic', logistic)])

grid = dict(pca__n_components=[50, 100, 150, 250],

logistic__C=[1e-4, 1.0, 10, 1e4],

logistic__penalty=['l1', 'l2'])

# from sklearn.grid_search import GridSearchCV

from dklearn.grid_search import GridSearchCV

estimator = GridSearchCV(pipe, grid)

estimator.fit(X, y)结果是:sklearn会在40秒钟左右执行此计算,而dask-learn替代品大约需要10秒钟。

另外,如果添加以下代码可以连接到集群,通过Client可以展示整个计算过程的dashboard,由Bokeh实现。

from dask.distributed import Client

c = Client('scheduler-address:8786')

5、总结

以上就是Dask的简单介绍,Dask的功能是非常强大的,且说明文档也非常全,既有示例又有解释。感兴趣的朋友可以自行去官网或者GitHub学习,东哥下次分享使用Dask进行机器学习的一些实例。

위 내용은 Amway 누구나 Python 빅데이터 분석 결과물을 갖고 있습니다.의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!