Python으로 크롤러를 작성할 때 html.getcode()는 웹사이트에서 자동화된 크롤러를 금지하는 403 액세스 금지 문제에 직면하게 됩니다. 이 글은 주로 Angular2 Advanced에서 크롤러의 403 문제를 해결하는 방법을 소개합니다. 편집자는 꽤 좋다고 생각해서 지금부터 공유하고 참고용으로 제공하겠습니다. 편집기를 따라 살펴보겠습니다

이 문제를 해결하려면 Python 모듈인 urllib2 모듈을 사용해야 합니다

urllib2 모듈은 고급 크롤러 크롤링 모듈입니다

예를 들어 연결 url=http://blog.csdn.net/qysh123

이 연결에 403 액세스 금지 문제가 있을 수 있습니다

이 문제를 해결하려면 다음 단계가 필요합니다.

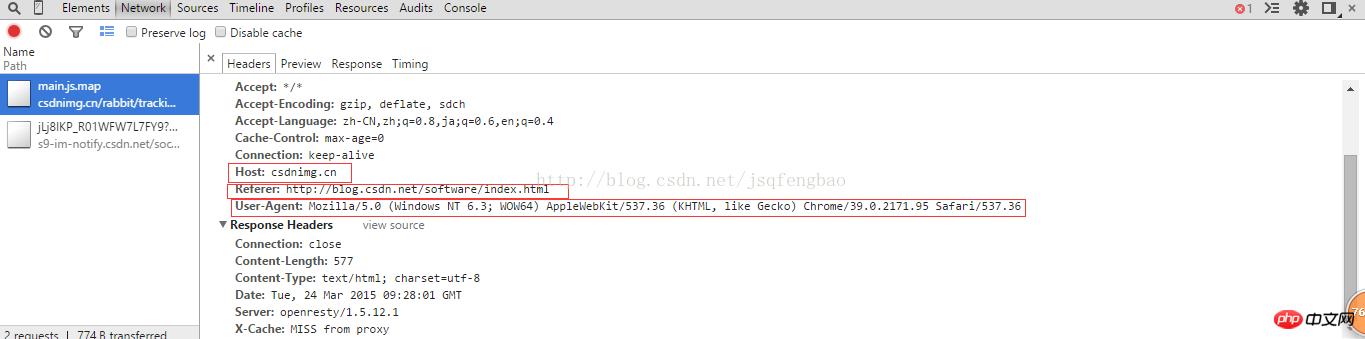

<span style="font-size:18px;">req = urllib2.Request(url)

req.add_header("User-Agent","Mozilla/5.0 (Windows NT 6.3; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/39.0.2171.95 Safari/537.36")

req.add_header("GET",url)

req.add_header("Host","blog.csdn.net")

req.add_header("Referer","http://blog.csdn.net/")</span>User-Agent는 브라우저별 속성입니다

그런 다음 html=urllib2.urlopen(req)

print html.read()

모든 웹페이지 코드를 다운로드 받을 수 있으며, 403 접근금지 문제도 없습니다.

위 문제의 경우 나중에 쉽게 사용할 수 있도록 함수로 캡슐화할 수 있습니다. 특정 코드:

#-*-coding:utf-8-*-

import urllib2

import random

url="http://blog.csdn.net/qysh123/article/details/44564943"

my_headers=["Mozilla/5.0 (Windows NT 6.3; WOW64) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/39.0.2171.95 Safari/537.36",

"Mozilla/5.0 (Macintosh; Intel Mac OS X 10_9_2) AppleWebKit/537.36 (KHTML, like Gecko) Chrome/35.0.1916.153 Safari/537.36",

"Mozilla/5.0 (Windows NT 6.1; WOW64; rv:30.0) Gecko/20100101 Firefox/30.0"

"Mozilla/5.0 (Macintosh; Intel Mac OS X 10_9_2) AppleWebKit/537.75.14 (KHTML, like Gecko) Version/7.0.3 Safari/537.75.14",

"Mozilla/5.0 (compatible; MSIE 10.0; Windows NT 6.2; Win64; x64; Trident/6.0)"

]

def get_content(url,headers):

'''''

@获取403禁止访问的网页

'''

randdom_header=random.choice(headers)

req=urllib2.Request(url)

req.add_header("User-Agent",randdom_header)

req.add_header("Host","blog.csdn.net")

req.add_header("Referer","http://blog.csdn.net/")

req.add_header("GET",url)

content=urllib2.urlopen(req).read()

return content

print get_content(url,my_headers)

임의 함수는 이미 작성된 브라우저를 자동으로 가져오는 데 사용됩니다. User-Agent 정보는 Custom 함수에 직접 Host, Referer, GET 정보 등을 작성해야 합니다. 이러한 문제를 해결한 후에는 원활하게 액세스할 수 있으며 더 이상 403 액세스 정보가 표시되지 않습니다.

물론 접속 빈도가 너무 빠르면 일부 웹사이트는 여전히 필터링됩니다. 이 문제를 해결하려면 프록시 IP 방식을 사용해야 합니다. . . 직접 해결하세요

관련 권장 사항:

403 금지된 액세스 오류를 해결하기 위한 Python 크롤러

위 내용은 크롤러에서 403 문제를 해결하는 방법의 상세 내용입니다. 자세한 내용은 PHP 중국어 웹사이트의 기타 관련 기사를 참조하세요!