ここ 2 年ほどで「テキスト生成画像の普及モデル」が非常に普及しており、DALL・E 2 と Imagen はどちらもこれに基づいて開発されたアプリケーションです。

この記事はAI New Media Qubit(公開アカウントID:QbitAI)の許可を得て転載しておりますので、転載については出典元にご連絡ください。

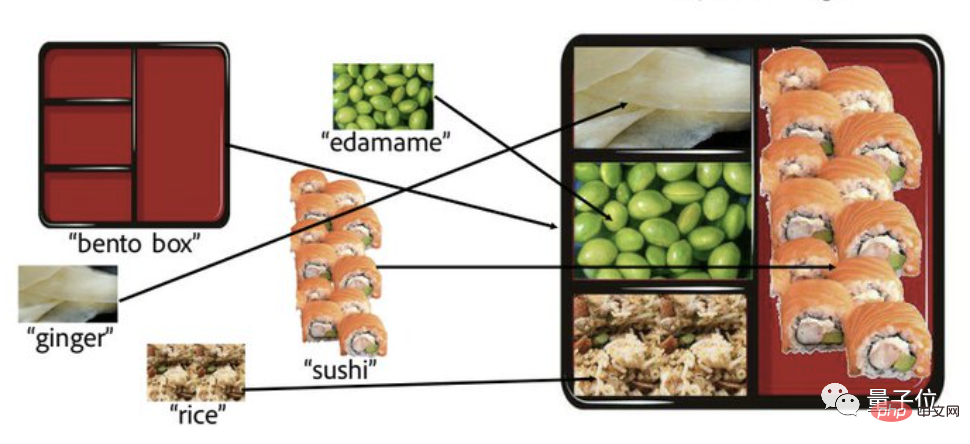

これは一見普通の日本のお弁当です。

しかし、信じられますか、実際、食べ物のすべてのグリッドには P 編集が施されており、元の写真はまだ江おばさんのものです:

△画像を直接切り取って貼り付けると、一見偽物に見える効果が得られます

背後にいるオペレーターはPSのボスではなく、非常に単純な操作性を備えたAIです名前:コラージュディフュージョン。

小さな写真をいくつか見つけて与えるだけで、AI が独自に写真の内容を理解し、要素を非常に自然に配置します。全体像を把握する - 一見したところ、偽りはありません。

その効果は多くのネチズンを驚かせました。

一部の PS 愛好家は直接こう言いました:

これは単なる天の恵みです...Automatic1111 ですぐに利用できるようになることを願っています (Stable Diffusion ユーザーが一般的に使用するネットワーク UI も統合される予定です) PS に挿入すると、 のプラグイン バージョンで表示されます。

実は、このAIが生成した「日本の弁当」にはいくつかのバージョンが生成されており、どれも自然で自然なものばかりです。

なぜ複数のバージョンがあるのでしょうか?なぜこんなことを聞くかというと、ユーザーがカスタマイズすることもできるので、全体の状況をあまり荒くすることなく、さまざまな細部を微調整することができます。

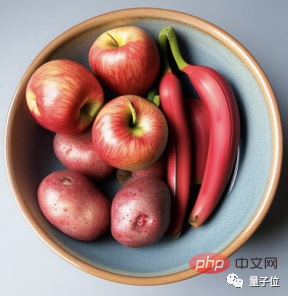

「日本の弁当」以外にも優れた作品が多数あります。

たとえば、これは AI に与えられた素材です。P 絵の痕跡は明らかです:

これは AI がまとめた絵です。どのような P ピクチャの痕跡があるか:

過去 2 年間で、「テキスト生成画像の普及モデル」は、 DALL・E 2 と Imagen は両方ともこの開発されたアプリケーションに基づいています。この拡散モデルの利点は、生成される画像が多様で高品質であることです。

しかし、textは、結局のところ、ターゲット画像に対して、せいぜい曖昧な規範的な役割しか果たせないため、ユーザーは通常、多くの時間を費やす必要があります。良好な結果を得るには、プロンプトを調整する必要があります。また、追加の制御コンポーネントと組み合わせる必要があります。

上記の日本のお弁当を例に挙げます。

ユーザーが「ご飯、枝豆、生姜、寿司が入ったお弁当」とだけ入力した場合、どのようなお弁当なのかは記述されていません。 . 食べ物がどこに置かれているか、それぞれの食べ物がどのようなものであるかの説明はありません。ただし、それを明確にする必要がある場合は、ユーザーが短いエッセイを書く必要がある場合があります...

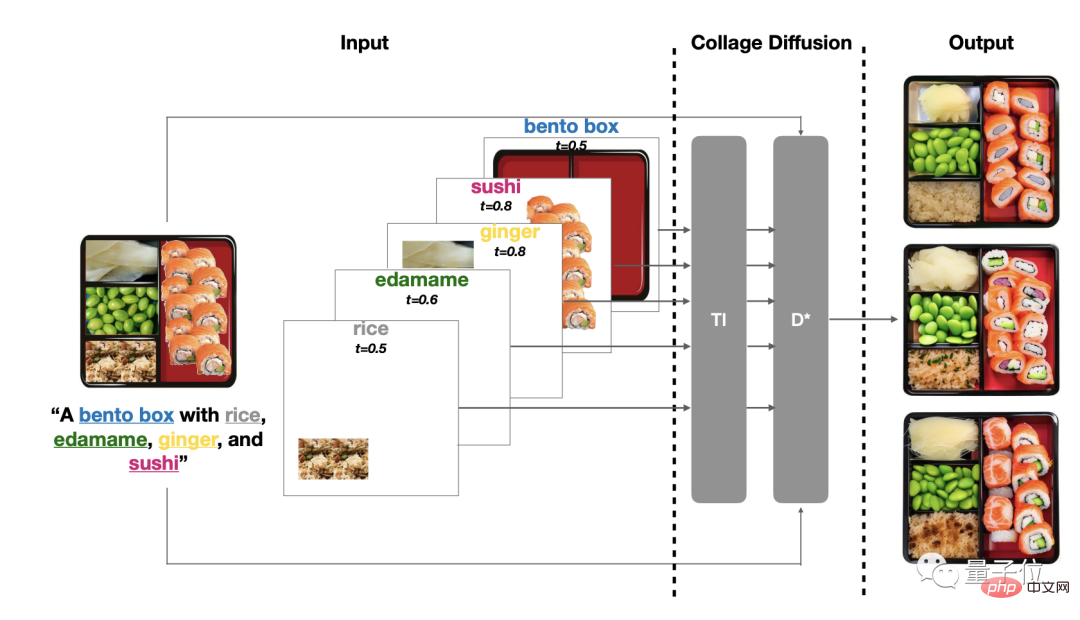

これを考慮して、スタンフォード大学のチームは別の角度から始めることにしました。

彼らは、伝統的なアイデアを参照し、パズルを通じて最終イメージを生成することを決定し、新しい普及モデルを開発しました。

興味深いのは、率直に言って、このモデルは古典的な手法を使用して「詳しく説明された」と考えることができることです。

最初の階層化です: レイヤーベースの画像編集 UI を使用して、ソース画像を RGBA レイヤーに分解します (R、G、B はそれぞれ赤、緑、青を表します)。透明性のため)、これらのレイヤーをキャンバス上に配置し、各レイヤーをテキスト プロンプトと組み合わせます。

レイヤー化により、画像内のさまざまな要素を変更できます。

これまで、レイヤー化はコンピュータ グラフィックスの分野では成熟した技術でしたが、以前はレイヤー化された情報が単一の画像出力結果として使用されるのが一般的でした。

この新しい「パズル拡散モデル」では、階層情報がその後の操作の入力となります。

レイヤー化に加えて、は既存の拡散ベースの画像調整テクノロジとも組み合わせて、画像の視覚的な品質を向上させます。

つまり、このアルゴリズムは、オブジェクトの特定の属性 (視覚的特徴など) の変更を制限するだけでなく、属性 (方向、照明、視点、オクルージョン) の変更も許可します。

——これにより、修復度と自然さの度合いのバランスがとれ、侵害感のない「精神的に似た」写真が生成されます。

操作手順も非常に簡単で、インタラクティブ編集モードでは数分でコラージュを作成できます。

シーン内の空間配置をカスタマイズする (つまり、他の場所から撮影した写真を適切な位置に配置する) だけでなく、画像を生成するさまざまなコンポーネントを調整することもできます。同じソース画像を使用すると、異なる効果が得られます。

△右端の列は、この AI の出力結果です。

非対話モード (つまり、ユーザーは困惑するのではなく、直接パズルに小さな絵をたくさん入れます) それを AI に投げます)、AI は取得した小さな絵に基づいて、自然な効果を持つ大きな絵を自動的に作成します。

最後に、その背後にある研究チームについて話しましょう. 彼らは、スタンフォード大学のコンピューター サイエンス学部の教師と学生のグループです。

この論文の筆頭著者であるヴィシュヌ サルッカイは現在、スタンフォード大学コンピュータ サイエンス学部の大学院生であり、修士号と博士号取得に向けて勉強中です。 .D.

彼の主な研究方向は、コンピュータ グラフィックス、コンピュータ ビジョン、機械学習です。

さらに、論文の共著者であるリンデン・リー氏もスタンフォード大学コンピューターサイエンス学部の大学院生です。

学校に通いながら、NVIDIA で 4 か月間インターンし、NVIDIA のディープ ラーニング研究チームと協力して、1 億個のパラメーターを追加したビジュアル コンバーター モデルのトレーニングに参加しました。

論文アドレス: https://arxiv.org/abs/2303.00262

以上がPS の使い方がわからなくても、AI パズル技術によりすでに偽物を本物のように見せることができます。の詳細内容です。詳細については、PHP 中国語 Web サイトの他の関連記事を参照してください。