Périphériques technologiques

Périphériques technologiques

IA

IA

NeRF et le passé et le présent de la conduite autonome, résumé de près de 10 articles !

NeRF et le passé et le présent de la conduite autonome, résumé de près de 10 articles !

NeRF et le passé et le présent de la conduite autonome, résumé de près de 10 articles !

Depuis que Neural Radiance Fields a été proposé en 2020, le nombre d'articles connexes a augmenté de façon exponentielle. Il est non seulement devenu une branche importante de la reconstruction tridimensionnelle, mais est également progressivement devenu actif à la frontière de la recherche en tant qu'outil important pour l'autonomie. conduite.

NeRF a soudainement émergé au cours des deux dernières années, principalement parce qu'il ignore l'extraction et la mise en correspondance des points caractéristiques, la géométrie et la triangulation épipolaires, le PnP plus l'ajustement du bundle et d'autres étapes du pipeline de reconstruction CV traditionnel, et ignore même la reconstruction, la cartographie et la cartographie du maillage. traçage de la lumière. Apprenez un champ de rayonnement directement à partir d'une image d'entrée 2D, puis produisez une image rendue à partir du champ de rayonnement qui se rapproche d'une vraie photo. En d’autres termes, laissez un modèle 3D implicite basé sur un réseau neuronal s’adapter à l’image 2D à partir d’une perspective spécifiée et lui donner à la fois de nouvelles synthèses de perspective et de nouvelles capacités. Le développement de NeRF est également étroitement lié à la conduite autonome, ce qui se reflète spécifiquement dans l'application de reconstruction de scènes réelles et de simulateurs de conduite autonome. NeRF est efficace pour restituer des images au niveau photo, de sorte que les scènes de rue modélisées avec NeRF peuvent fournir des données d'entraînement très réalistes pour la conduite autonome ; les cartes NeRF peuvent être modifiées pour combiner les bâtiments, les véhicules et les piétons dans divers coins difficiles à capturer dans la réalité. Ce cas peut être utilisé pour tester les performances d’algorithmes tels que la perception, la planification et l’évitement d’obstacles. NeRF est donc une branche de la reconstruction 3D et un outil de modélisation. La maîtrise de NeRF est devenue une compétence indispensable pour les chercheurs en reconstruction ou en conduite autonome.

Aujourd'hui, je vais trier le contenu lié au Nerf et à la conduite autonome Près de 11 articles vous emmèneront explorer le passé et le présent de Nerf et la conduite autonome

1 Le travail pionnier de Nerf

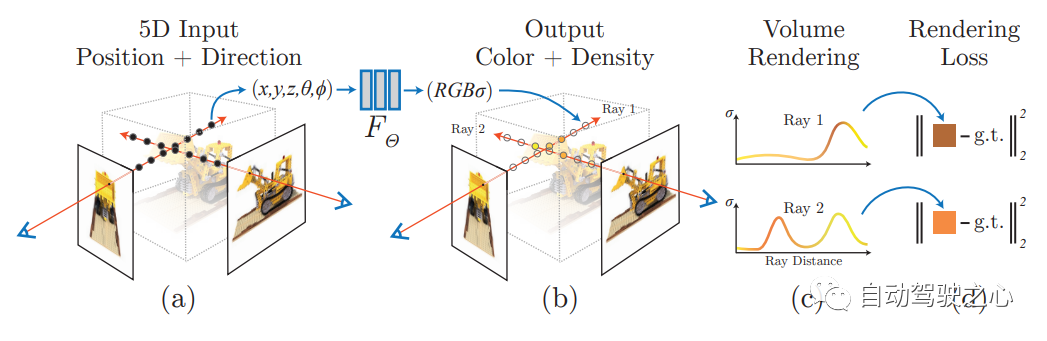

La réécriture ; le contenu est : NeRF : Représentation du champ de rayonnement neuronal des scènes pour la synthèse de vues. Dans le premier article d'ECCV2020

, une méthode Nerf est proposée, qui utilise un ensemble de vues d'entrée clairsemée pour optimiser la fonction de scène à volume continu sous-jacente, obtenant ainsi les derniers résultats de vue pour synthétiser des scènes complexes. Cet algorithme utilise un réseau profond entièrement connecté (non convolutif) pour représenter la scène. L'entrée est une seule coordonnée 5D continue (y compris la position spatiale (x, y, z) et la direction de visualisation (θ, ξ)), et la sortie. est la position spatiale de la densité volumique et du rayonnement d'émission lié à la vue

NERF utilise des images posées en 2D comme supervision. Il n'est pas nécessaire de convoluer l'image. Au lieu de cela, il apprend un ensemble de paramètres implicites en apprenant continuellement le codage de position et en utilisant la couleur de l'image. comme supervision, représentant des scènes 3D complexes. Grâce à la représentation implicite, le rendu sous n'importe quelle perspective peut être réalisé.

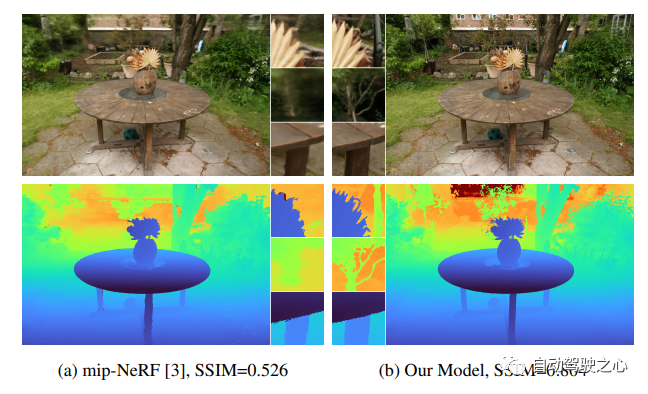

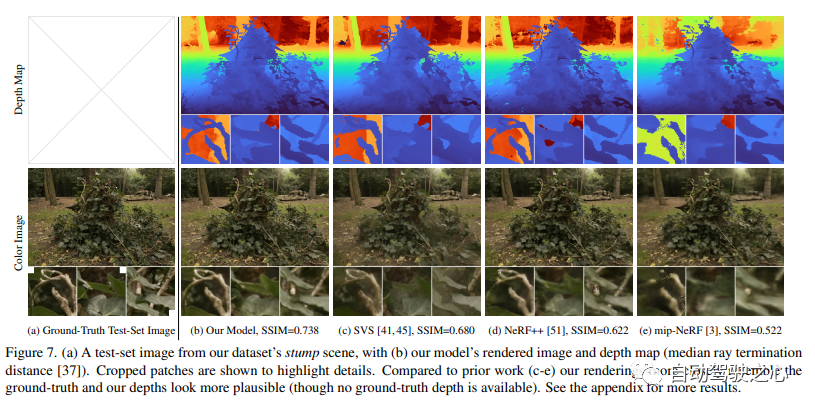

2.Mip-NeRF 360

Le contenu de recherche du CVPR2020 porte sur les scènes extérieures sans frontières. Parmi eux, Mip-NeRF 360 : le champ de rayonnement neuronal anti-aliasing sans limites est l'un des axes de recherche

Lien papier : https://arxiv.org/pdf/2111.12077.pdf

Bien que le champ de rayonnement neural (NeRF) soit déjà dans l'objet et montrent de bons résultats de composition de vue sur de petites régions délimitées de l'espace, mais ils sont difficiles à obtenir dans des scènes « sans bordure » où la caméra peut pointer dans n'importe quelle direction et le contenu peut exister à n'importe quelle distance. Dans ce cas, les modèles de type NeRF existants produisent souvent des rendus flous ou à faible résolution (en raison d'un déséquilibre dans les détails et à l'échelle des objets proches et distants), sont plus lents à s'entraîner et souffrent d'une mauvaise reconstruction à partir d'un ensemble de petites images. se produisent en raison de l’ambiguïté inhérente à la tâche dans les grandes scènes. Cet article propose une extension de mip-NeRF, une variante de NeRF qui résout les problèmes d'échantillonnage et d'alias, qui utilise le paramétrage de scène non linéaire, la distillation en ligne et un nouveau régulariseur basé sur la distorsion pour surmonter les problèmes causés par les défis illimités. Il permet une réduction de 57 % de l'erreur quadratique moyenne par rapport au mip-NeRF et est capable de générer des vues synthétiques réalistes et des cartes de profondeur détaillées pour des scènes du monde réel très complexes et sans frontières.

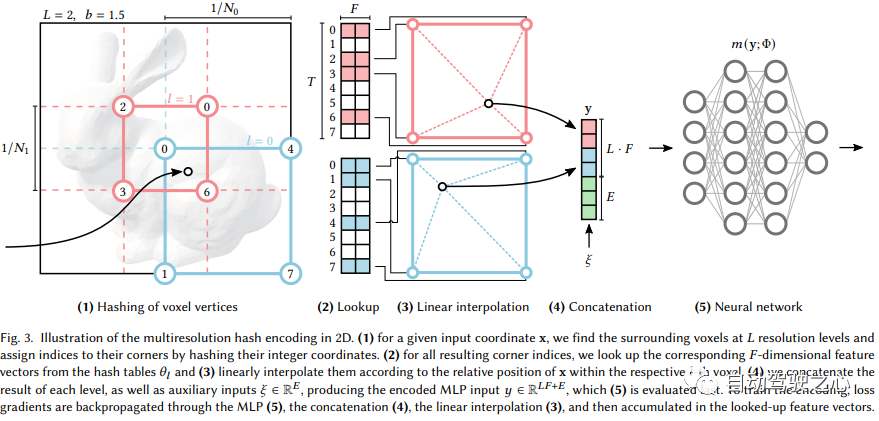

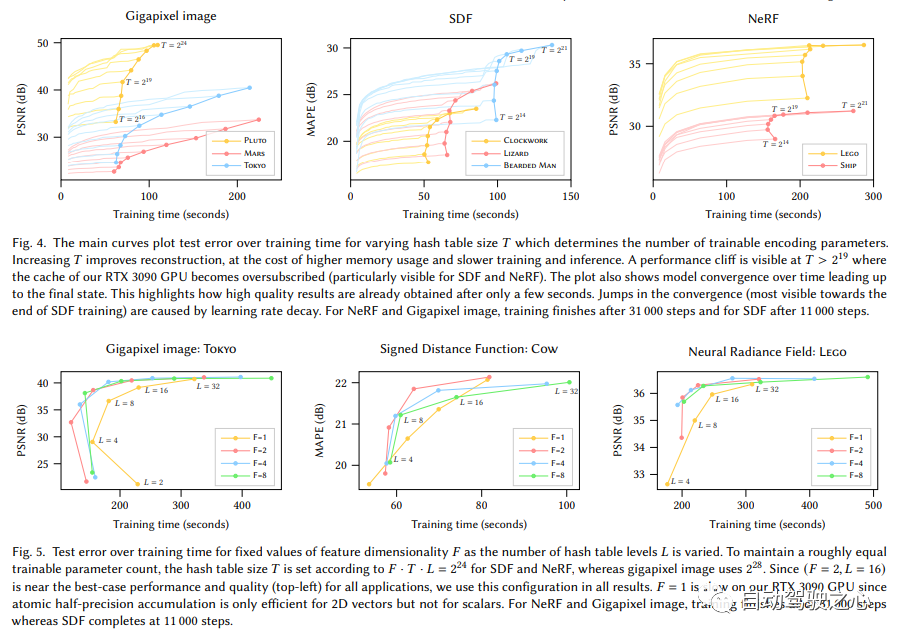

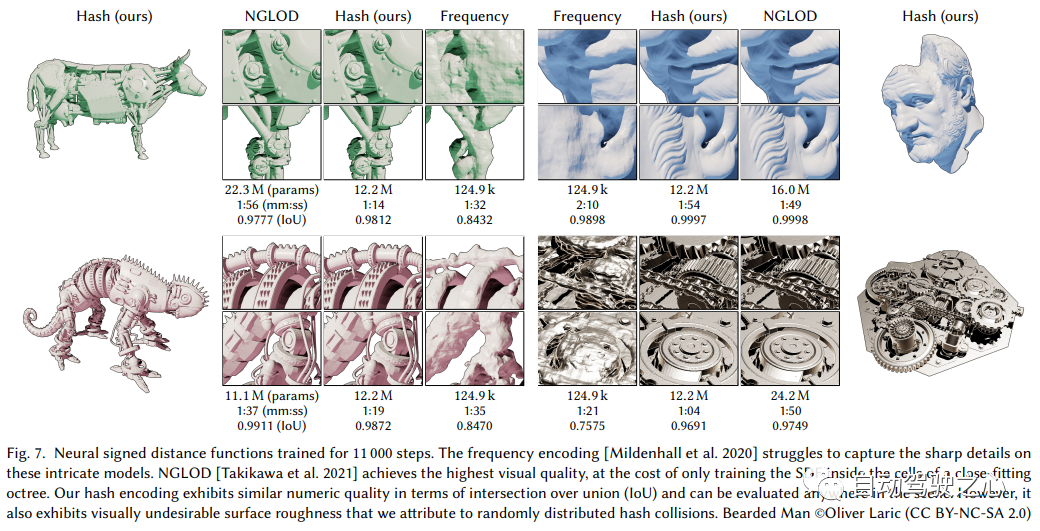

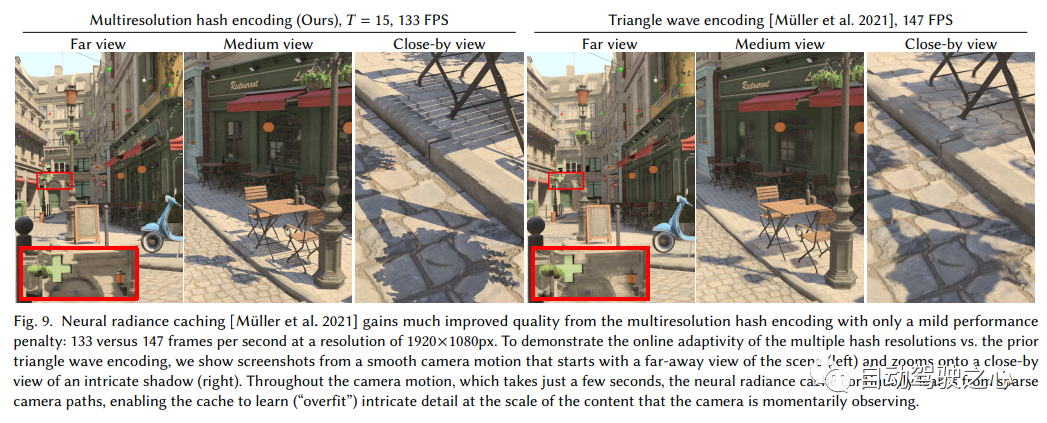

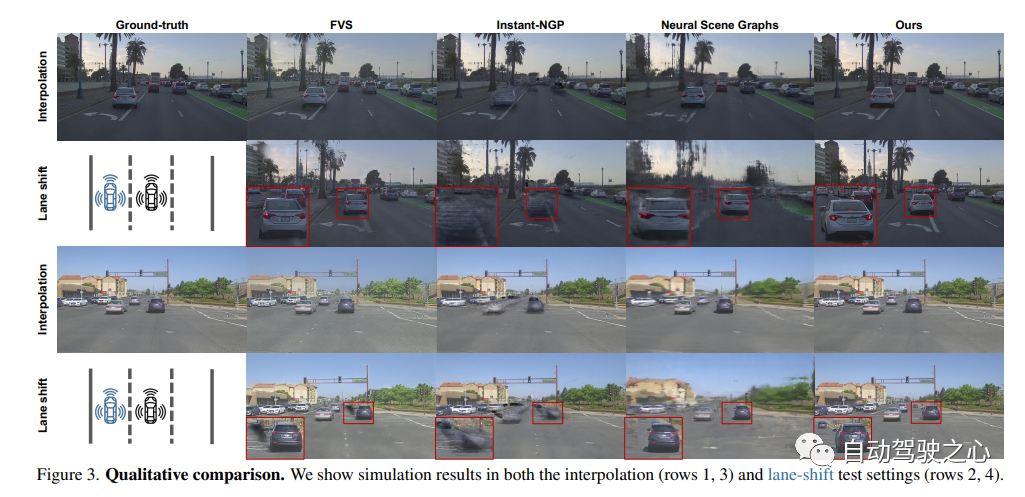

3.Instant-NGP

Le contenu qui doit être réécrit est : "Expression de scène hybride de voxels explicites et de fonctionnalités implicites (SIGGRAPH 2022)"

Utilisation d'un codage de hachage multi-résolution la primitive neurographique instantanée

doit être réécrite est : Lien : https://nvlabs.github.io/instant-ngp

Jetons d'abord un coup d'œil aux similitudes et aux différences entre Instant-NGP et NeRF :

- Également basé sur le rendu de volume

- Différent du MLP de NeRF, NGP utilise une grille de voxels paramétrée clairsemée comme expression de scène

- Basé sur les dégradés, il optimise la scène et le MLP en même temps (un MLP est utilisé comme décodeur) ; .

On peut voir que le grand framework est toujours le même. La différence la plus importante est que NGP a sélectionné la grille de voxels paramétrée comme expression de scène. Grâce à l'apprentissage, les paramètres enregistrés dans le voxel deviennent la forme de la densité de la scène. Le plus gros problème avec MLP est qu’il est lent. Afin de reconstruire la scène avec une haute qualité, un réseau relativement grand est souvent nécessaire, et il faudra beaucoup de temps pour parcourir le réseau pour chaque point d'échantillonnage. L'interpolation au sein de la grille est beaucoup plus rapide. Cependant, si la grille veut exprimer des scènes de haute précision, elle nécessite des voxels de haute densité, ce qui entraînera une utilisation extrêmement élevée de la mémoire. Considérant qu'il existe de nombreux endroits vides dans la scène, NVIDIA a proposé une structure clairsemée pour exprimer la scène. F2-NeRF

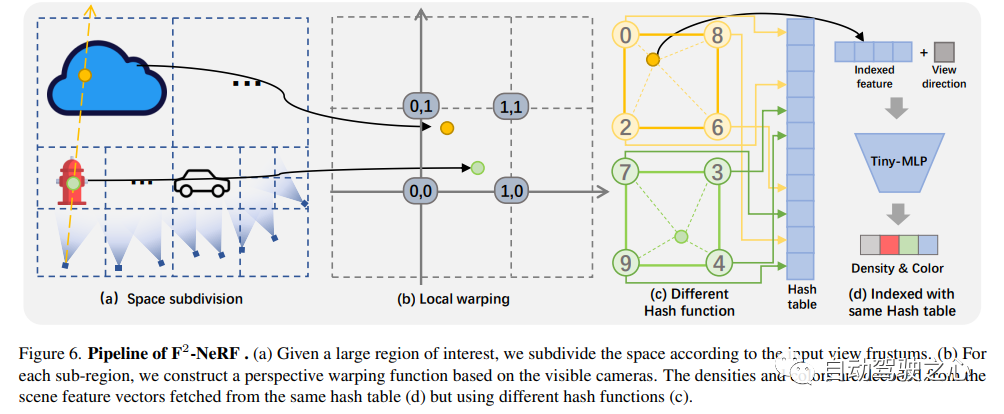

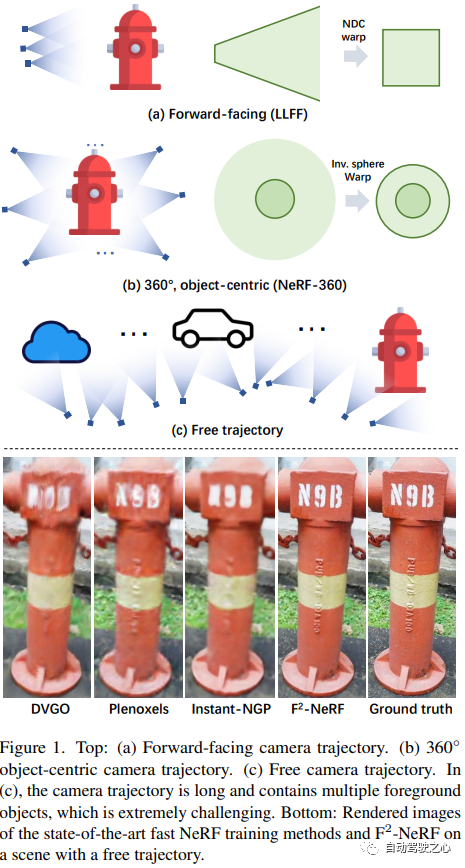

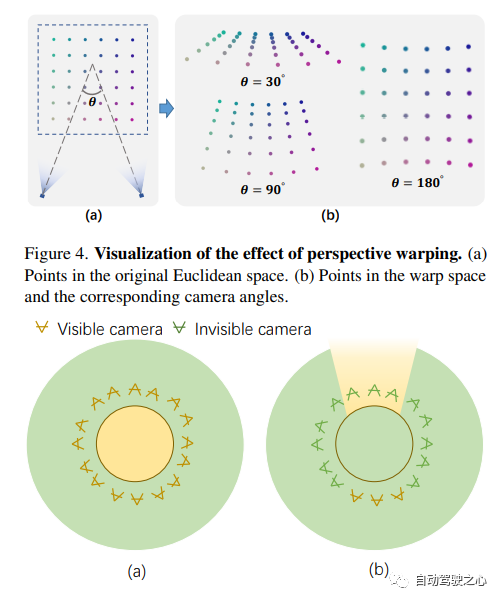

F2-NeRF : Entraînement rapide sur le terrain à rayonnement neuronal avec trajectoires de caméra gratuites

F2-NeRF : Entraînement rapide sur le terrain à rayonnement neuronal avec trajectoires de caméra gratuites

Lien papier : https://totoro97.github.io /projects/f2-nerf/

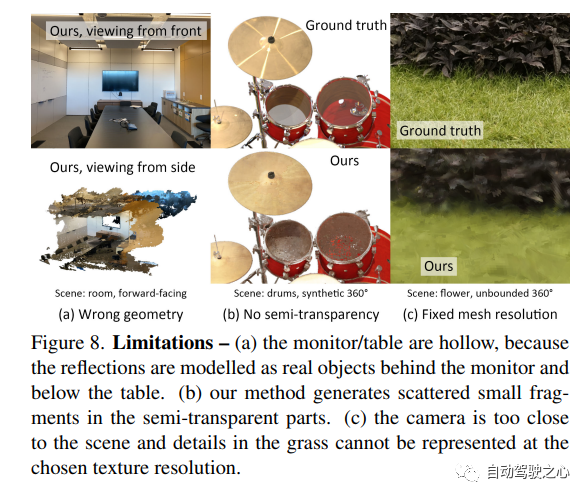

5.MobileNeRF

Application de rendu en temps réel côté mobile, réalisant la fonction de Nerf exportant Mesh, et cette technologie a été adoptée par la conférence CVPR2023 !

MobileNeRF : Exploiter le pipeline de rastérisation de polygones pour un rendu efficace du champ neuronal sur les architectures mobiles.

Le champ de rayonnement neuronal (NeRF) a été prouvé L'incroyable capacité à synthétiser des images de scènes 3D à partir de nouvelles vues. Cependant, ils s’appuient sur des algorithmes de rendu volumétrique spécialisés basés sur le ray marching qui ne correspondent pas aux capacités du matériel graphique largement déployé. Cet article présente une nouvelle représentation NeRF basée sur des polygones texturés qui peut synthétiser efficacement de nouvelles images via des pipelines de rendu standard. NeRF est représenté comme un ensemble de polygones dont la texture représente l'opacité binaire et les vecteurs de caractéristiques. Le rendu traditionnel des polygones à l'aide d'un tampon z produit une image dans laquelle chaque pixel possède des caractéristiques qui sont interprétées par un petit MLP dépendant de la vue exécuté dans le fragment shader pour produire la couleur finale du pixel. Cette approche permet à NeRF d'effectuer un rendu à l'aide d'un pipeline de rastérisation de polygones traditionnel qui fournit un parallélisme massif au niveau des pixels, permettant des fréquences d'images interactives sur diverses plates-formes informatiques, y compris les téléphones mobiles.

Le champ de rayonnement neuronal (NeRF) a été prouvé L'incroyable capacité à synthétiser des images de scènes 3D à partir de nouvelles vues. Cependant, ils s’appuient sur des algorithmes de rendu volumétrique spécialisés basés sur le ray marching qui ne correspondent pas aux capacités du matériel graphique largement déployé. Cet article présente une nouvelle représentation NeRF basée sur des polygones texturés qui peut synthétiser efficacement de nouvelles images via des pipelines de rendu standard. NeRF est représenté comme un ensemble de polygones dont la texture représente l'opacité binaire et les vecteurs de caractéristiques. Le rendu traditionnel des polygones à l'aide d'un tampon z produit une image dans laquelle chaque pixel possède des caractéristiques qui sont interprétées par un petit MLP dépendant de la vue exécuté dans le fragment shader pour produire la couleur finale du pixel. Cette approche permet à NeRF d'effectuer un rendu à l'aide d'un pipeline de rastérisation de polygones traditionnel qui fournit un parallélisme massif au niveau des pixels, permettant des fréquences d'images interactives sur diverses plates-formes informatiques, y compris les téléphones mobiles.

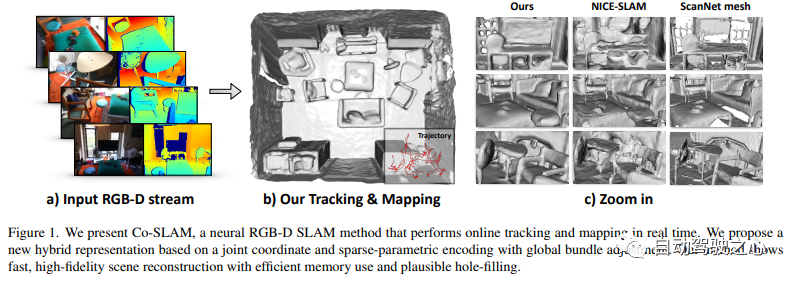

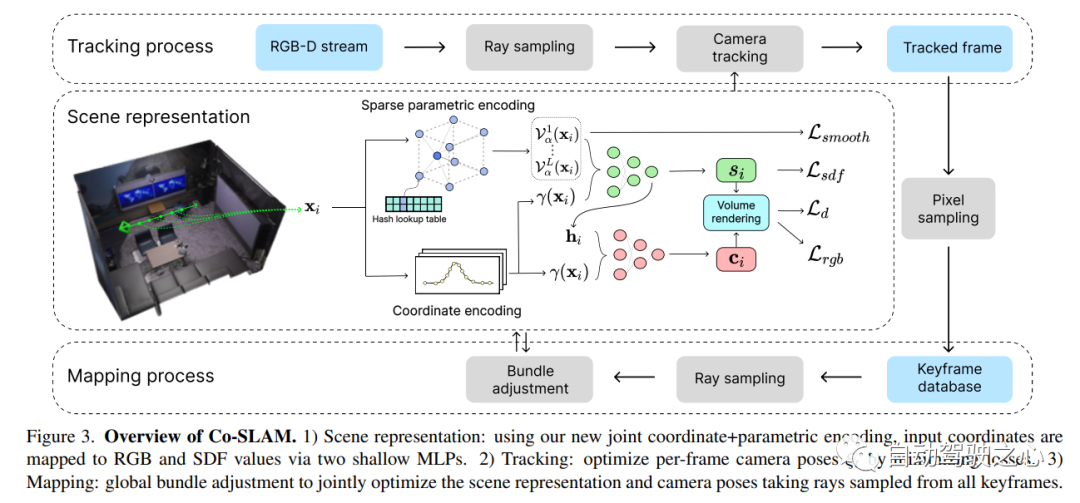

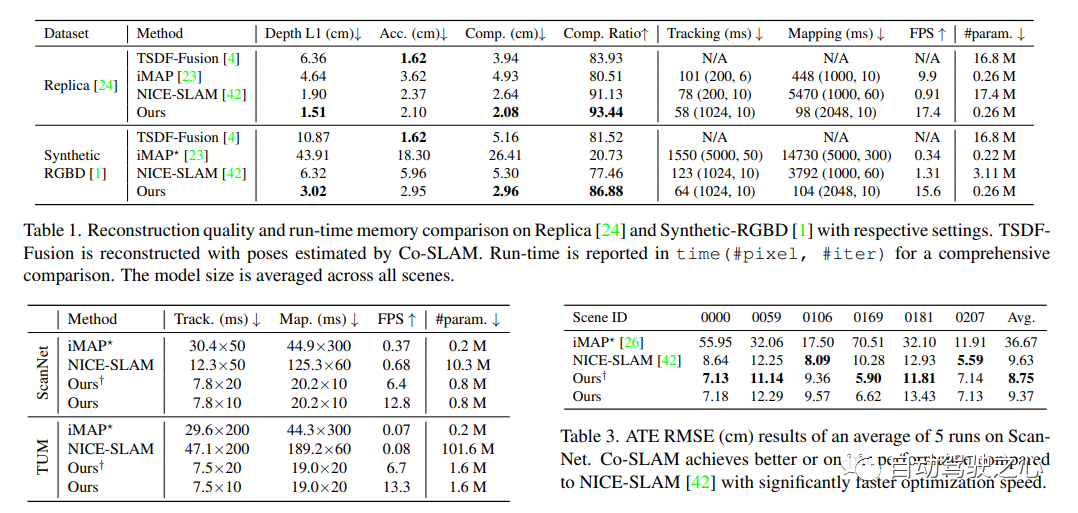

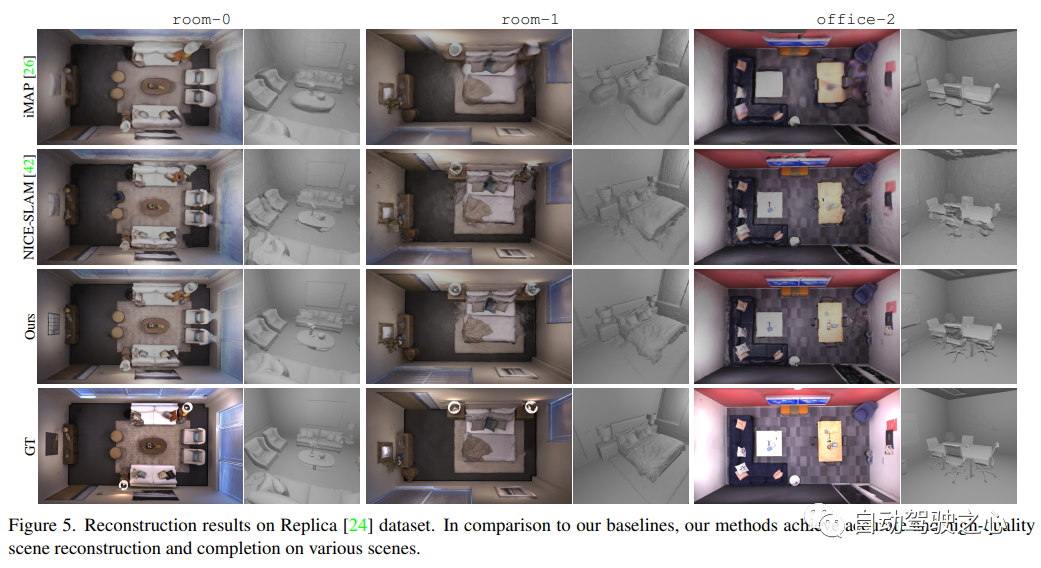

6.Co-SLAM

Notre travail de localisation visuelle en temps réel et de cartographie NeRF a été inclus dans CVPR2023

Co-SLAM : Coordonnées conjointes et codages paramétriques clairsemés pour le SLAM neuronal en temps réel

Lien papier : https://arxiv.org/pdf/2304.14377.pdf

Co-SLAM est un système SLAM RVB-D en temps réel qui utilise des représentations neuronales implicites pour le suivi de la caméra et la reconstruction de surface haute fidélité. Co-SLAM représente la scène sous la forme d'une grille de hachage multi-résolution pour exploiter sa capacité à converger rapidement et à représenter des caractéristiques locales. De plus, afin d’incorporer les a priori de cohérence de surface, Co-SLAM utilise une méthode de codage par blocs, ce qui prouve qu’il peut compléter efficacement une scène dans des zones non observées. Notre encodage conjoint combine les avantages de la vitesse, de la reconstruction haute fidélité et des a priori de cohérence de surface de Co-SLAM. Grâce à une stratégie d'échantillonnage de rayons, Co-SLAM est capable de regrouper globalement les ajustements de toutes les images clés !

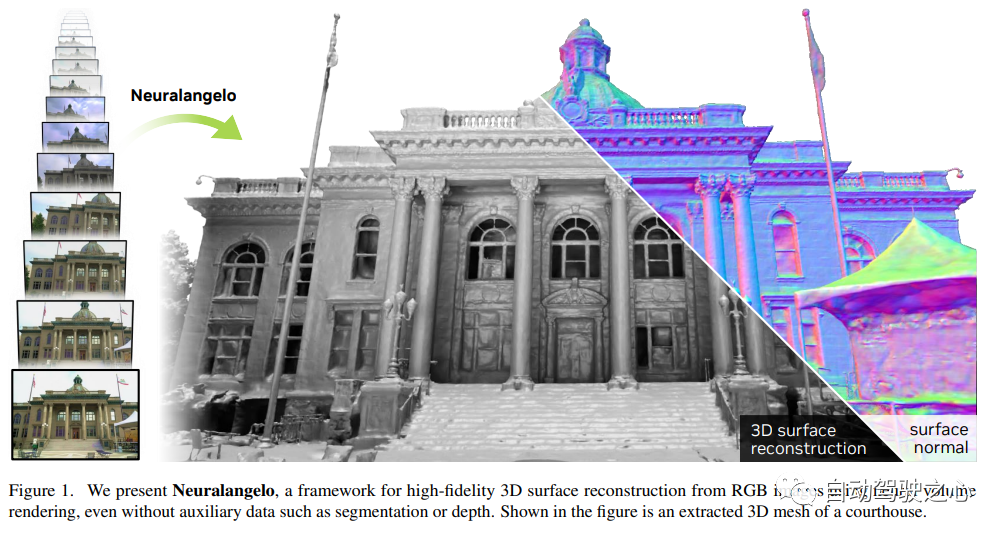

7.Neuralangelo

La meilleure méthode actuelle de reconstruction de surface NeRF (CVPR2023)

Le contenu réécrit est le suivant suit :

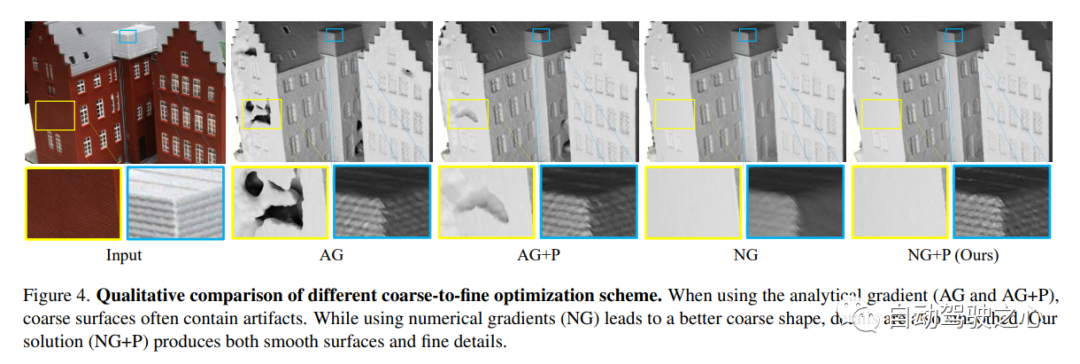

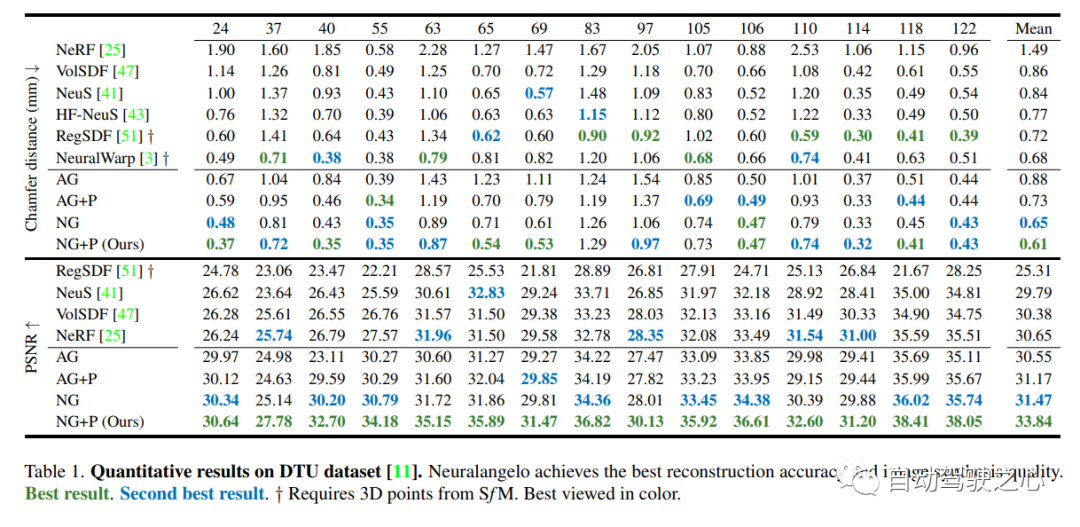

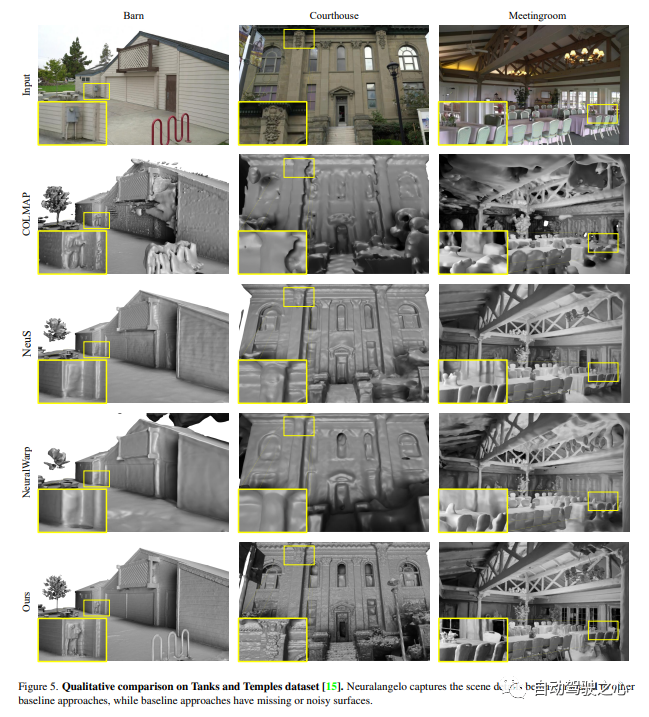

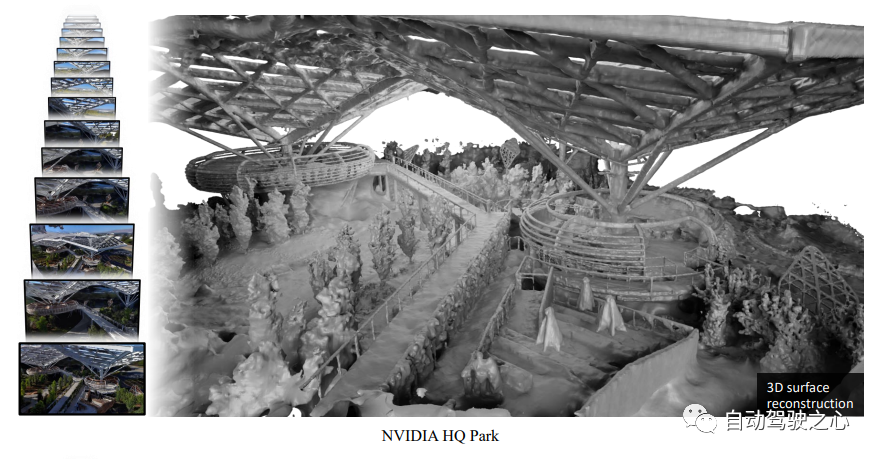

Il a été démontré que le rendu neuronal basé sur l’image est capable de reconstruire des surfaces neuronales pour récupérer des structures 3D denses. Cependant, les méthodes actuelles ont encore des difficultés à récupérer la structure détaillée des scènes du monde réel. Pour résoudre ce problème, cette étude propose une méthode appelée Neuralangelo, qui combine les capacités de représentation des grilles de hachage 3D multi-résolution avec le rendu de la surface neuronale. Deux éléments clés de cette approche sont :

(1) Les gradients numériques pour le calcul des dérivées d'ordre supérieur en tant qu'opérations de lissage, et (2) le contrôle de l'optimisation grossière à fine sur les grilles de hachage à différents niveaux de détail.

Même sans entrées auxiliaires telles que la profondeur, Neuralangelo est toujours capable de récupérer efficacement des structures de surface 3D denses à partir d'images multi-vues. La fidélité est grandement améliorée par rapport aux méthodes précédentes, permettant une reconstruction détaillée de scènes à grande échelle à partir de la capture vidéo RVB !

8.MARS

Le premier outil de simulation NeRF de conduite autonome open source.

Ce qui doit être réécrit est : https://arxiv.org/pdf/2307.15058.pdf

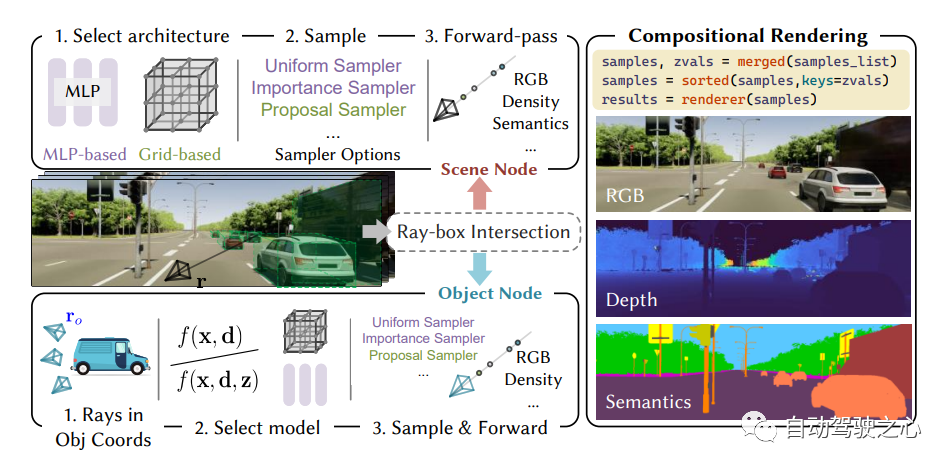

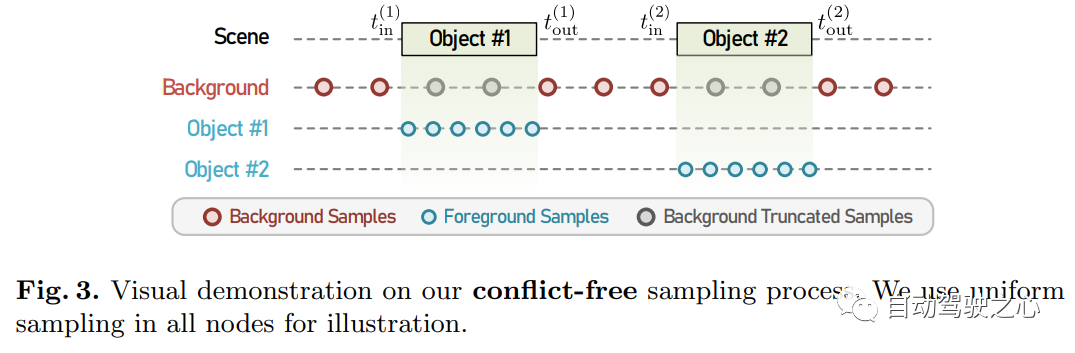

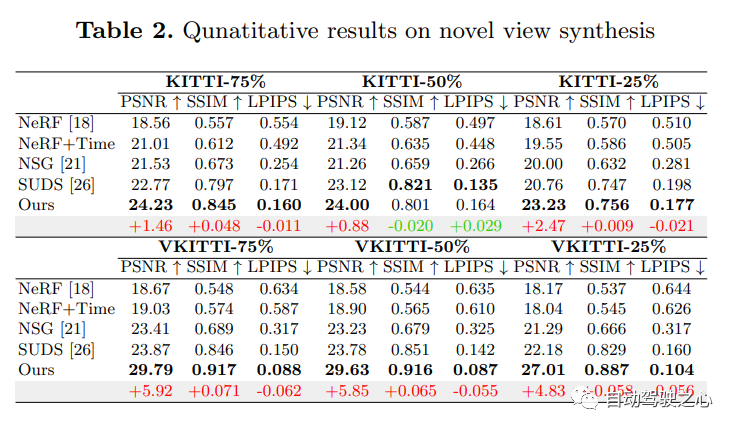

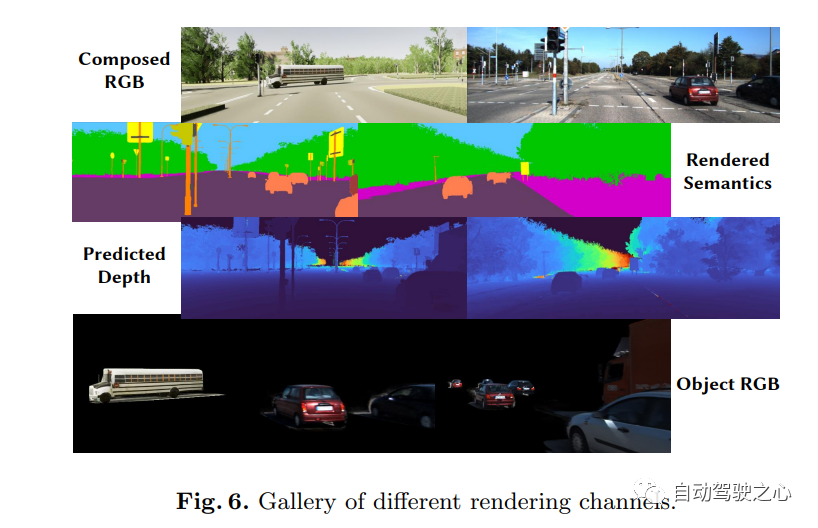

Les voitures autonomes peuvent rouler en douceur dans des situations ordinaires, et il est généralement admis qu'une simulation réaliste de capteurs jouera un rôle dans la résolution les situations de coin restantes jouent un rôle clé. À cette fin, MARS propose un simulateur de conduite autonome basé sur des champs de rayonnement neuronal. Par rapport aux travaux existants, MARS présente trois caractéristiques distinctives : (1) La connaissance des instances. Le simulateur modélise séparément les instances de premier plan et l'environnement d'arrière-plan à l'aide de réseaux distincts de sorte que les caractéristiques statiques (par exemple, taille et apparence) et dynamiques (par exemple, trajectoire) des instances peuvent être contrôlées séparément. (2) Modularité. Le simulateur permet une commutation flexible entre différents réseaux fédérateurs, stratégies d'échantillonnage, modes d'entrée, etc. modernes liés au NeRF. On espère que cette conception modulaire pourra promouvoir les progrès académiques et le déploiement industriel de simulations de conduite autonome basées sur NeRF. (3) Réel. Le simulateur est configuré pour des résultats photoréalistes de pointe avec une sélection de modules optimale.

Le point le plus important est : l'open source !

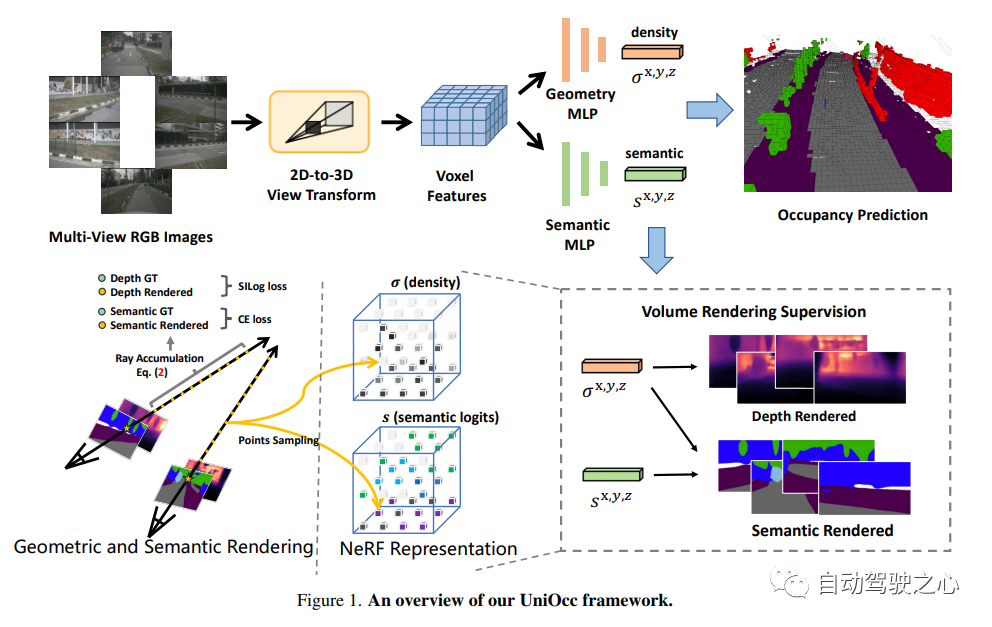

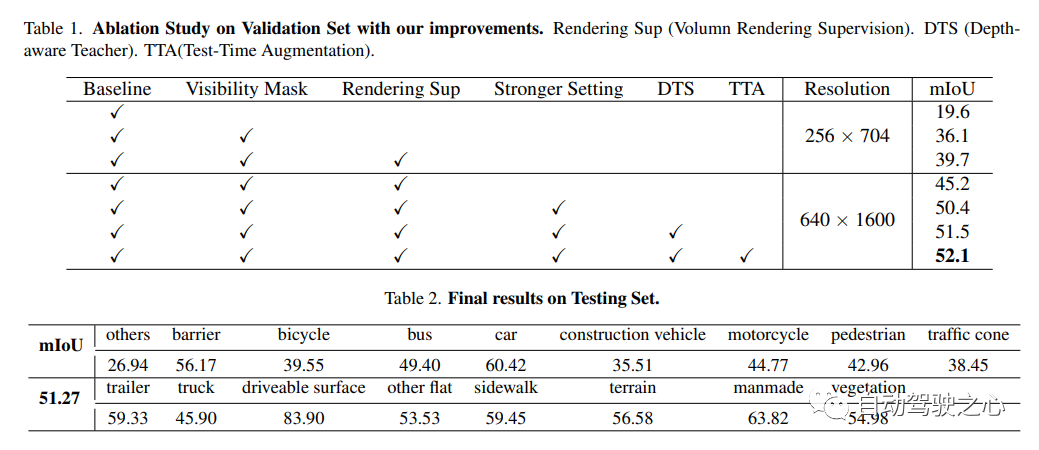

9.Uniocc

pour le contenu qui doit être réécrit, "Nerf et 3D Occupant Networks, AD2023 Challenge"

Uniocc: Unificant la prédiction d'occupation 3D centrée sur la vision avec rendu géométrique et sémantique.

Lien papier : https://arxiv.org/abs/2306.09117

UniOCC est une méthode de prédiction d'occupation 3D centrée sur la vision. Les méthodes traditionnelles de prédiction d'occupation utilisent principalement des étiquettes d'occupation 3D pour optimiser les caractéristiques de projection de l'espace 3D. Cependant, le processus de génération de ces étiquettes est complexe et coûteux, repose sur des annotations sémantiques 3D, est limité par la résolution des voxels et ne peut pas fournir un espace à granularité fine. .Sémantique. Pour résoudre ce problème, cet article propose une nouvelle méthode de prédiction d'occupation unifiée (UniOcc) qui impose explicitement des contraintes géométriques spatiales et complète la supervision sémantique fine via le rendu des rayons de volume. Cette approche améliore considérablement les performances du modèle et démontre le potentiel de réduction des coûts d'annotation manuelle. Compte tenu de la complexité de l’étiquetage de l’occupation 3D, nous introduisons en outre le cadre enseignant-élève (DTS) de détection de profondeur pour utiliser des données non étiquetées afin d’améliorer la précision des prédictions. Notre solution a obtenu un score mIoU de 51,27% sur le classement officiel d'un seul modèle, se classant troisième dans ce challenge

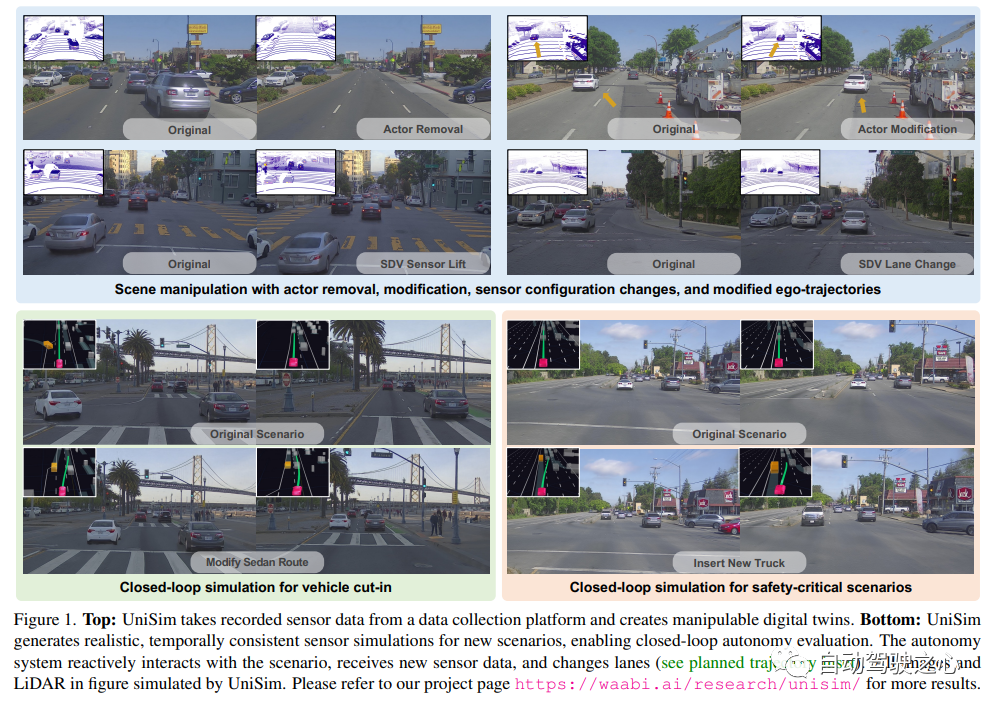

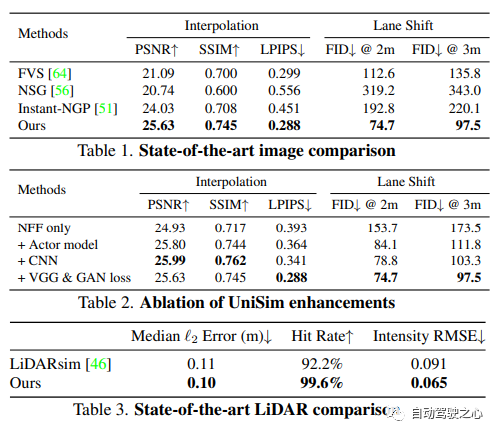

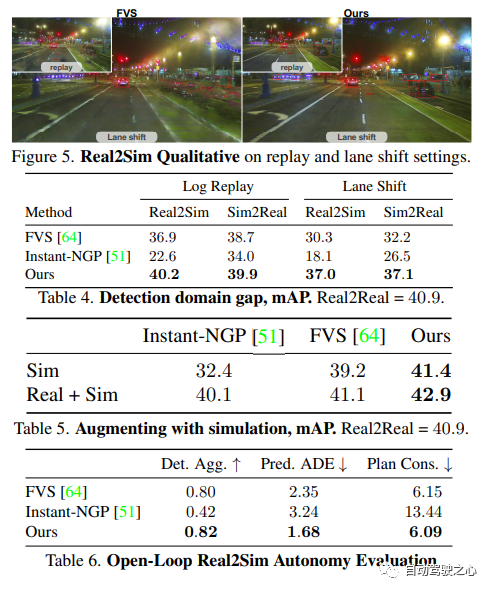

10 Unisim

produit par Wowaoao, absolument Excellent produit !

UniSim : Un simulateur de capteurs neuronaux en boucle fermée

Lien papier : https://arxiv.org/pdf/2308.01898.pdf

Une raison importante qui freine la vulgarisation de la conduite autonome est que la sécurité est encore insuffisante. Le monde réel est trop complexe, surtout avec l’effet longue traîne. Les scénarios de limites sont essentiels à une conduite sûre et sont divers mais difficiles à rencontrer. Il est très difficile de tester les performances des systèmes de conduite autonome dans ces scénarios car ces scénarios sont difficiles à rencontrer, et les tests dans le monde réel sont très coûteux et dangereux.

Pour résoudre ce défi, l'industrie et le monde universitaire ont commencé à y prêter attention. au développement de systèmes de simulation. Au début, le système de simulation se concentrait principalement sur la simulation du comportement de mouvement des autres véhicules/piétons et sur le test de la précision du module de planification de la conduite autonome. Ces dernières années, la recherche s'est progressivement déplacée vers la simulation au niveau des capteurs, c'est-à-dire la simulation pour générer des données brutes telles que des images lidar et des caméras, afin de réaliser des tests de bout en bout des systèmes de conduite autonome, de la perception à la prédiction en passant par la planification. .

Différent des travaux précédents, UniSim a réalisé les deux pour la première fois :

-

Haute réalisme : Peut simuler avec précision le monde réel (images et LiDAR) et réduire l'écart de domaine

-

Test en boucle fermée (fermé -simulation en boucle) :Peut générer des scènes dangereuses rares pour tester des véhicules sans pilote et permettre aux véhicules sans pilote d'interagir librement avec l'environnement

-

Évolutif (évolutif) :Peut être facilement étendu à d'autres Pour de nombreux scénarios, vous il suffit de collecter des données une seule fois pour reconstruire et simuler la mesure

Le contenu qui doit être réécrit est : la construction du système de simulation

UniSim commence d'abord à partir des données collectées dans le monde numérique Reconstruire scènes de conduite autonome, y compris les voitures, les piétons, les routes, les bâtiments et les panneaux de signalisation. Ensuite, contrôlez la scène reconstruite pour la simulation afin de générer des scènes clés rares.

Simulation en boucle fermée

UniSim peut effectuer des tests de simulation en boucle fermée. Premièrement, en contrôlant le comportement de la voiture, UniSim peut créer une scène dangereuse et rare, comme une voiture arrivant soudainement dans la voie actuelle. Ensuite, UniSim simule pour générer les données correspondantes ; puis exécute le système de conduite autonome et génère les résultats de la planification du chemin en fonction des résultats de la planification du chemin, le véhicule sans pilote se déplace vers l'emplacement désigné suivant et met à jour la scène (véhicule sans pilote et ; position des autres véhicules), puis nous continuons à simuler, à exécuter le système de conduite autonome et à mettre à jour l'état du monde virtuel... Grâce à ce test en boucle fermée, le système de conduite autonome et l'environnement de simulation peuvent interagir pour créer une scène qui est complètement différent des données originales

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Outils d'IA chauds

Undresser.AI Undress

Application basée sur l'IA pour créer des photos de nu réalistes

AI Clothes Remover

Outil d'IA en ligne pour supprimer les vêtements des photos.

Undress AI Tool

Images de déshabillage gratuites

Clothoff.io

Dissolvant de vêtements AI

AI Hentai Generator

Générez AI Hentai gratuitement.

Article chaud

Outils chauds

Bloc-notes++7.3.1

Éditeur de code facile à utiliser et gratuit

SublimeText3 version chinoise

Version chinoise, très simple à utiliser

Envoyer Studio 13.0.1

Puissant environnement de développement intégré PHP

Dreamweaver CS6

Outils de développement Web visuel

SublimeText3 version Mac

Logiciel d'édition de code au niveau de Dieu (SublimeText3)

Sujets chauds

Pourquoi le Gaussian Splatting est-il si populaire dans la conduite autonome que le NeRF commence à être abandonné ?

Jan 17, 2024 pm 02:57 PM

Pourquoi le Gaussian Splatting est-il si populaire dans la conduite autonome que le NeRF commence à être abandonné ?

Jan 17, 2024 pm 02:57 PM

Écrit ci-dessus et compréhension personnelle de l'auteur Le Gaussiansplatting tridimensionnel (3DGS) est une technologie transformatrice qui a émergé dans les domaines des champs de rayonnement explicites et de l'infographie ces dernières années. Cette méthode innovante se caractérise par l’utilisation de millions de gaussiennes 3D, ce qui est très différent de la méthode du champ de rayonnement neuronal (NeRF), qui utilise principalement un modèle implicite basé sur les coordonnées pour mapper les coordonnées spatiales aux valeurs des pixels. Avec sa représentation explicite de scènes et ses algorithmes de rendu différenciables, 3DGS garantit non seulement des capacités de rendu en temps réel, mais introduit également un niveau de contrôle et d'édition de scène sans précédent. Cela positionne 3DGS comme un révolutionnaire potentiel pour la reconstruction et la représentation 3D de nouvelle génération. À cette fin, nous fournissons pour la première fois un aperçu systématique des derniers développements et préoccupations dans le domaine du 3DGS.

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Comment résoudre le problème de la longue traîne dans les scénarios de conduite autonome ?

Jun 02, 2024 pm 02:44 PM

Hier, lors de l'entretien, on m'a demandé si j'avais posé des questions à longue traîne, j'ai donc pensé faire un bref résumé. Le problème à longue traîne de la conduite autonome fait référence aux cas extrêmes dans les véhicules autonomes, c'est-à-dire à des scénarios possibles avec une faible probabilité d'occurrence. Le problème perçu de la longue traîne est l’une des principales raisons limitant actuellement le domaine de conception opérationnelle des véhicules autonomes intelligents à véhicule unique. L'architecture sous-jacente et la plupart des problèmes techniques de la conduite autonome ont été résolus, et les 5 % restants des problèmes à longue traîne sont progressivement devenus la clé pour restreindre le développement de la conduite autonome. Ces problèmes incluent une variété de scénarios fragmentés, de situations extrêmes et de comportements humains imprévisibles. La « longue traîne » des scénarios limites dans la conduite autonome fait référence aux cas limites dans les véhicules autonomes (VA). Les cas limites sont des scénarios possibles avec une faible probabilité d'occurrence. ces événements rares

Choisir une caméra ou un lidar ? Une étude récente sur la détection robuste d'objets 3D

Jan 26, 2024 am 11:18 AM

Choisir une caméra ou un lidar ? Une étude récente sur la détection robuste d'objets 3D

Jan 26, 2024 am 11:18 AM

0. Écrit à l'avant&& Compréhension personnelle que les systèmes de conduite autonome s'appuient sur des technologies avancées de perception, de prise de décision et de contrôle, en utilisant divers capteurs (tels que caméras, lidar, radar, etc.) pour percevoir l'environnement et en utilisant des algorithmes et des modèles pour une analyse et une prise de décision en temps réel. Cela permet aux véhicules de reconnaître les panneaux de signalisation, de détecter et de suivre d'autres véhicules, de prédire le comportement des piétons, etc., permettant ainsi de fonctionner en toute sécurité et de s'adapter à des environnements de circulation complexes. Cette technologie attire actuellement une grande attention et est considérée comme un domaine de développement important pour l'avenir des transports. . un. Mais ce qui rend la conduite autonome difficile, c'est de trouver comment faire comprendre à la voiture ce qui se passe autour d'elle. Cela nécessite que l'algorithme de détection d'objets tridimensionnels du système de conduite autonome puisse percevoir et décrire avec précision les objets dans l'environnement, y compris leur emplacement,

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

Cet article vous suffit pour en savoir plus sur la conduite autonome et la prédiction de trajectoire !

Feb 28, 2024 pm 07:20 PM

La prédiction de trajectoire joue un rôle important dans la conduite autonome. La prédiction de trajectoire de conduite autonome fait référence à la prédiction de la trajectoire de conduite future du véhicule en analysant diverses données pendant le processus de conduite du véhicule. En tant que module central de la conduite autonome, la qualité de la prédiction de trajectoire est cruciale pour le contrôle de la planification en aval. La tâche de prédiction de trajectoire dispose d'une riche pile technologique et nécessite une connaissance de la perception dynamique/statique de la conduite autonome, des cartes de haute précision, des lignes de voie, des compétences en architecture de réseau neuronal (CNN&GNN&Transformer), etc. Il est très difficile de démarrer ! De nombreux fans espèrent se lancer dans la prédiction de trajectoire le plus tôt possible et éviter les pièges. Aujourd'hui, je vais faire le point sur quelques problèmes courants et des méthodes d'apprentissage introductives pour la prédiction de trajectoire ! Connaissances introductives 1. Existe-t-il un ordre d'entrée pour les épreuves de prévisualisation ? R : Regardez d’abord l’enquête, p

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

Le papier Stable Diffusion 3 est enfin publié, et les détails architecturaux sont révélés. Cela aidera-t-il à reproduire Sora ?

Mar 06, 2024 pm 05:34 PM

L'article de StableDiffusion3 est enfin là ! Ce modèle est sorti il y a deux semaines et utilise la même architecture DiT (DiffusionTransformer) que Sora. Il a fait beaucoup de bruit dès sa sortie. Par rapport à la version précédente, la qualité des images générées par StableDiffusion3 a été considérablement améliorée. Il prend désormais en charge les invites multithèmes, et l'effet d'écriture de texte a également été amélioré et les caractères tronqués n'apparaissent plus. StabilityAI a souligné que StableDiffusion3 est une série de modèles avec des tailles de paramètres allant de 800M à 8B. Cette plage de paramètres signifie que le modèle peut être exécuté directement sur de nombreux appareils portables, réduisant ainsi considérablement l'utilisation de l'IA.

Avez-vous vraiment maîtrisé la conversion des systèmes de coordonnées ? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Avez-vous vraiment maîtrisé la conversion des systèmes de coordonnées ? Des enjeux multi-capteurs indispensables à la conduite autonome

Oct 12, 2023 am 11:21 AM

Le premier article pilote et clé présente principalement plusieurs systèmes de coordonnées couramment utilisés dans la technologie de conduite autonome, et comment compléter la corrélation et la conversion entre eux, et enfin construire un modèle d'environnement unifié. L'objectif ici est de comprendre la conversion du véhicule en corps rigide de caméra (paramètres externes), la conversion de caméra en image (paramètres internes) et la conversion d'image en unité de pixel. La conversion de 3D en 2D aura une distorsion, une traduction, etc. Points clés : Le système de coordonnées du véhicule et le système de coordonnées du corps de la caméra doivent être réécrits : le système de coordonnées planes et le système de coordonnées des pixels Difficulté : la distorsion de l'image doit être prise en compte. La dé-distorsion et l'ajout de distorsion sont compensés sur le plan de l'image. 2. Introduction Il existe quatre systèmes de vision au total : système de coordonnées du plan de pixels (u, v), système de coordonnées d'image (x, y), système de coordonnées de caméra () et système de coordonnées mondiales (). Il existe une relation entre chaque système de coordonnées,

SIMPL : un benchmark de prédiction de mouvement multi-agents simple et efficace pour la conduite autonome

Feb 20, 2024 am 11:48 AM

SIMPL : un benchmark de prédiction de mouvement multi-agents simple et efficace pour la conduite autonome

Feb 20, 2024 am 11:48 AM

Titre original : SIMPL : ASimpleandEfficientMulti-agentMotionPredictionBaselineforAutonomousDriving Lien article : https://arxiv.org/pdf/2402.02519.pdf Lien code : https://github.com/HKUST-Aerial-Robotics/SIMPL Affiliation de l'auteur : Université des sciences de Hong Kong et technologie Idée DJI Paper : cet article propose une base de référence de prédiction de mouvement (SIMPL) simple et efficace pour les véhicules autonomes. Par rapport au cent agent traditionnel

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

NuScenes dernier SOTA SparseAD : les requêtes clairsemées contribuent à une conduite autonome efficace de bout en bout !

Apr 17, 2024 pm 06:22 PM

Écrit à l'avant et point de départ Le paradigme de bout en bout utilise un cadre unifié pour réaliser plusieurs tâches dans les systèmes de conduite autonome. Malgré la simplicité et la clarté de ce paradigme, les performances des méthodes de conduite autonome de bout en bout sur les sous-tâches sont encore loin derrière les méthodes à tâche unique. Dans le même temps, les fonctionnalités de vue à vol d'oiseau (BEV) denses, largement utilisées dans les méthodes de bout en bout précédentes, rendent difficile l'adaptation à davantage de modalités ou de tâches. Un paradigme de conduite autonome de bout en bout (SparseAD) centré sur la recherche clairsemée est proposé ici, dans lequel la recherche clairsemée représente entièrement l'ensemble du scénario de conduite, y compris l'espace, le temps et les tâches, sans aucune représentation BEV dense. Plus précisément, une architecture clairsemée unifiée est conçue pour la connaissance des tâches, notamment la détection, le suivi et la cartographie en ligne. De plus, lourd