Auteur | Wu Feining Li Shuiqing

Modifier | Xin Yuan

Ces derniers jours, de nouvelles arnaques à l’IA ont explosé à travers le pays.

Dans le passé, il y avait des journaux et des informations falsifiés sur AI. Plus tard, Yang Mi et Dilraba, soupçonnés d'avoir changé de visage par AI, sont apparus dans la salle de diffusion en direct pour vendre des marchandises. Hier, une « fraude aux télécommunications par l'IA a escroqué 4,3 millions de yuans en 10 minutes » à Baotou, en Mongolie intérieure, était à la mode sur Weibo et a attiré l'attention nationale.

Ce matin même, une série d'images de l'explosion du Pentagone qui a provoqué la chute du marché boursier américain a été officiellement confirmée comme étant fausse et soupçonnée d'avoir été synthétisée par l'IA.

Alors que la technologie de l'IA déclenche une nouvelle vague de mise en œuvre, le contenu deepfake de l'IA se propage de manière virale dans le monde entier, suscitant de vives inquiétudes dans l'industrie.

Dès 2019, Zhixixi a enquêté et a rendu compte du faux produit noir à changement de visage d'IA ("Produit noir à changement de visage d'IA : 100 yuans pour 200 films érotiques d'échange de visage, 5 photos peuvent personnaliser la vidéo"). années, deepfake La concurrence entre la technologie de contrefaçon et la technologie anti-deepfake se poursuit et les départements concernés améliorent progressivement les lois et réglementations réglementaires. À l’heure actuelle, avec l’évolution itérative de la technologie des grands modèles d’IA représentée par GPT-4, les faux contenus font leur retour, provoquant de plus grandes perturbations dans le monde.

Des articles aux images, des voix humaines aux effets dynamiques des vidéos, les effets dynamiques peuvent être restaurés au maximum. Ils peuvent tromper le public par toutes sortes d'astuces, et il existe divers stratagèmes frauduleux infinis et difficiles à détecter. . Il est difficile pour de nombreux jeunes de distinguer l’authenticité de ces contenus falsifiés par l’IA, tandis que les personnes âgées et les enfants sont plus susceptibles d’être trompés. Et une fois que les criminels utiliseront leur confiance pour commettre des crimes, les conséquences seront désastreuses.

Un expert en technologie d'intelligence artificielle a déclaré à Zhidongzhi qu'il est très difficile pour les gens ordinaires d'identifier à l'œil nu le contenu audio et vidéo généré par ces technologies actuelles de contrefaçon profonde d'IA.

L'arnaque traditionnelle a été recouverte d'une « nouvelle couche » enveloppée par l'IA, la rendant plus cachée et plus difficile à détecter. Comment fonctionnent ces nouvelles escroqueries basées sur l’IA ? Comment détecter les faux contenus d’IA difficiles à distinguer ? Quelles solutions face au chaos industriel ? En triant et en analysant diverses nouvelles escroqueries liées à l’IA sur le marché, cet article aborde en profondeur ces questions.

1. Une vidéo qui change de visage de 10 minutes a fraudé 4,3 millions de yuans. Méfiez-vous de ces quatre nouvelles arnaques à l'IA

.En mars de cette année, une lettre ouverte intitulée « Suspension de la recherche à grande échelle sur l'intelligence artificielle » a été publiée sur le site officiel du Future Life Institute, incluant le PDG de Tesla, Elon Musk, et le co-fondateur d'Apple, Steve. Des milliers de scientifiques et de dirigeants d'entreprise , dont Steve Wozniak et d'autres, ont signé une pétition appelant à un moratoire sur le développement de versions supérieures à GPT-4. Ils soulignent tous les possibles utilisations négatives de la puissante technologie d'IA.

Les usages négatifs de l’IA explosent bien plus vite qu’on ne l’imagine. À mesure que les capacités technologiques de l’IA accélèrent l’itération et la mise en œuvre, la falsification de l’IA devient plus facile et le contenu devient plus réaliste, suivi d’un flux incessant de fausses nouvelles et de fausses images provoquées par des changements de voix et de visage qui suscitent des inquiétudes sociales. Beaucoup de gens pensent que le sens commun « images et vérité » et « voir c'est croire » semble avoir reçu l'impact le plus violent de l'histoire.

1. Vidéo d'échange de visage : 4,3 millions de personnes escroquées en 10 minutes

Peut-être que de nombreux événements vicieux provoqués par le changement de visage de l’IA se sont déjà produits autour de nous, mais nous ne l’avons pas encore remarqué.

Récemment, le département d'enquête sur Internet du Bureau de la sécurité publique de la région autonome municipale de Baotou en Mongolie intérieure a détecté un cas de fraude aux télécommunications utilisant l'IA. Le criminel a affirmé qu'il avait un besoin urgent d'argent sous le couvert d'un ami et a appelé la victime. M. Guo via la vidéo WeChat.

Par confiance en son ami et après avoir vérifié l'identité de l'autre partie par chat vidéo, M. Guo a relâché sa vigilance et a transféré 4,3 millions sur la carte bancaire du criminel en deux versements, mais il ne s'attendait pas au soi-disant WeChat Les "amis " lors de l'appel vidéo sont effectués grâce à la technologie de changement de visage de l'IA. Les criminels ont utilisé la technologie de l'IA pour changer de visage pour se faire passer pour des amis et commettre une fraude télécom contre lui. À l'heure actuelle, 3,3684 millions de yuans ont été récupérés après avoir été interceptés par la police, et 931 600 yuans ont été transférés.

Le changement de visage par l'IA est le type de méthode de fraude le plus simple pour gagner la confiance de l'autre partie. Les fraudeurs utilisent souvent la technologie de l'IA pour changer le visage d'une personne familière à la victime, puis appellent l'autre partie pour confirmer l'information.

Face à ce nouveau type de fraude, premièrement, vous devez protéger vos informations personnelles, ne pas fournir facilement à autrui des informations impliquant la vie privée et ne pas cliquer sur des liens inconnus ni télécharger à volonté des logiciels inconnus. doit vérifier l'identité de l'autre partie par différents canaux , rester attentif aux risques potentiels.

La fonction "AI face changeing" est très similaire à la fonction "AI se déshabiller". Dès mars de cette année, une nouvelle selon laquelle « la photo d'une femme dans le métro a été diffusée par l'IA avec un clic de ses vêtements enlevés » a été publiée. Une photo d'une femme prenant le métro a été « déshabillée » en un seul clic. utilisant un logiciel d’IA et a été critiqué pour sa diffusion malveillante, les criminels ont également largement diffusé de fausses informations pour calomnier la femme.

Une telle technologie de « déshabillage en un clic » est apparue à l'étranger dès 2019, mais en raison d'une controverse et d'une condamnation publiques généralisées, le projet a été rapidement abandonné et retiré des étagères. Cette mauvaise tendance s’est encore une fois répandue en Chine lors de l’engouement pour l’IA cette année. Lors d’une recherche sur Internet avec des combinaisons de mots clés telles que « IA », « habillage » et « logiciel », de nombreux logiciels associés profondément cachés peuvent encore être trouvés. Ceux qui sont intéressés peuvent même l’utiliser pour produire et diffuser des vidéos pornographiques. Les services de travestissement vidéo IA sont devenus une industrie noire avec une chaîne complète.

« L'IA qui change de visage » a été largement utilisée dans la création secondaire de films et de séries télévisées, de vidéos amusantes parodies et dans la production de packs d'expressions, mais les risques juridiques cachés et les litiges pour contrefaçon ne peuvent être ignorés. Récemment, selon des informations publiées sur le site officiel de Qichacha, Shanghai Houttuynia Information Technology Co., Ltd. a été poursuivie en justice par de nombreux blogueurs célèbres sur Internet pour l'une de ses applications mobiles d'échange de visage.

▲Il existe près d’une centaine d’applications « AI qui changent le visage » dans l’App Store

Plus tôt, un blogueur vidéo nommé « Compositeur d'effets spéciaux Hong Liang » a remplacé le visage du protagoniste masculin Yang Yang dans la série télévisée « You Are My Glory » par le sien grâce à la technologie de changement de visage de l'IA dans sa vidéo. Son visage a finalement été attaqué. par les fans de l'acteur principal, ce qui a attiré l'attention de nombreux internautes.

▲ Quelques vidéos de changement de visage synthétisées par l'IA mises en ligne sur le compte de "Special Effects Synthesizer Hong Liang"

Ce blogueur vidéo a utilisé l'échange de visages de stars masculines comme un gadget, mais en fait c'était pour attirer du trafic vers son cours payant sur la production d'effets spéciaux pour le cinéma et la télévision. Cependant, son comportement a porté atteinte à des acteurs tels que Dilraba et Yang. Yang qui apparaît dans des séries télévisées. Après que "Kurst" soit devenu populaire, de nombreux fans l'ont également créé à nouveau en échangeant des extraits d'intrigue avec la version série télévisée de "Journey to the West", ce qui a contribué à une autre vague de popularité à la série télévisée en termes de diffusion et de discussion thématique, mais ils n'étaient pas satisfaits de la série télévisée. L'acteur a causé quelques problèmes.

Le comportement de siphonnage du trafic a eu un impact négatif et des problèmes à la fois sur les célébrités dont les visages ont été modifiés et sur le public curieux de technologie. La frontière entre divertissement et technologie ne doit pas être floue à ce point.

2. Synthèse sonore : Reproduisez la voix humaine pour cacher le mystère

Dans le passé, "AI Stefanie Sun" est devenu populaire, et plus tard, le clonage de la voix humaine de l'IA a fait irruption dans le cercle du doublage. La technologie de synthèse vocale de l'IA est devenue très populaire et a également engendré de nombreux incidents vicieux et victimes associées.

Un internaute a utilisé des extraits de chansons du célèbre chanteur américain Frank Ocean pour former des chansons qui imitent son style musical, et a publié ces "œuvres musicales" sur des forums de musique underground, et a également simulé ces chansons comme étant dans La version qui a été accidentellement divulguée pendant l'enregistrement a finalement été adopté et vendu pour près de 970 dollars (l'équivalent de 6 700 yuans).

Il n'y a pas si longtemps, Peabody Films, une société de production cinématographique espagnole, a également été victime d'une arnaque téléphonique par IA. L'escroc s'est fait passer pour le célèbre acteur Benedict Cumberbatch et a affirmé que les films de la société étaient illégaux et que j'avais l'intention de coopérer. , mais l'entreprise doit d'abord transférer un dépôt de 200 000 livres (équivalent à environ 1,7 million de yuans), puis nous pourrons discuter des détails spécifiques de la coopération.

La société cinématographique a réalisé que quelque chose n'allait pas et après avoir vérifié auprès de l'agence de l'acteur, elle a découvert qu'il s'agissait d'une arnaque à l'IA du début à la fin.

Il existe également de nombreuses informations à l'étranger sur l'utilisation de voix clonées par l'IA pour commettre des fraudes et des extorsions. Certains cas impliquent des montants faramineux pouvant atteindre un million de dollars américains. Ce type d'escroc extrait souvent la voix d'une personne à partir d'enregistrements téléphoniques et d'autres documents pour synthétiser la voix, puis utilise la voix falsifiée pour tromper ses connaissances. Cela oblige le public à être vigilant face aux appels étranges. Même les connaissances peuvent avoir leur voix falsifiée.

Dans son dernier épisode du 22 mai, le magazine d'information américain CBS TV, 60 Minutes, a montré en direct comment des pirates informatiques ont cloné des voix pour tromper leurs collègues et réussir à voler des informations sur les passeports.

▲60 Minutes a mis en ligne la vidéo complète sur Twitter

Il n'a fallu que 5 minutes au pirate informatique pour copier la voix de Sharyn via le clonage de l'IA et utiliser un outil pour remplacer le nom sur l'identification de l'appelant sur le téléphone. Il a réussi à tromper ses collègues et a facilement obtenu son nom, son numéro de passeport, etc. information.

3. Fausses photos : Trump a été « arrêté » et le pape portait une doudoune sur le podium

Avec la propagation massive des vidéos IA qui changent de visage, les fausses photos IA sont encore plus répandues.

Le 22 mai, heure de l'Est, une photo d'une explosion près du Pentagone est devenue virale sur les réseaux sociaux. La large diffusion de cette fausse photo a même fait chuter l'indice S&P 500 d'environ 0,3% à court terme jusqu'à un plus bas intrajournalier, passant d'une hausse à une baisse.

Par la suite, un porte-parole du ministère américain de la Défense a immédiatement confirmé qu'il s'agissait également d'une fausse image générée par l'IA. Cette image présentait des caractéristiques évidentes générées par l'IA, telles que les lampadaires un peu tordus et la clôture qui poussait sur le trottoir.

Les photos de couples dans les années 1990 générées par Midjourney ont rendu difficile aux internautes de déterminer si elles sont réelles ou fausses. En mars, plusieurs photos de l'ancien président américain Trump arrêté sont devenues virales sur Twitter.

Trump sur la photo a été encerclé par la police et poussé au sol, l'air embarrassé et paniqué. Durant l'audience, il a caché son visage et a pleuré amèrement, et a même enfilé l'uniforme de la prison dans la cellule humide et sombre. Les images ont été créées à l'aide de Midjounrney par Eliot Higgins, fondateur du site de journalisme citoyen Bellingcat. Après la publication de la photo, son compte a également été bloqué.

▲Un ensemble d'images de Trump « arrêté » générées par Midjounrney

Peu de temps après la publication de "Trump Arrest Picture", la photo du pape François portant une doudoune Paris World a provoqué un tollé sur Internet. Peu de temps après sa publication, elle a été vue plus de 28 millions de fois, faisant croire à de nombreux internautes. il.

▲Le Pape portait une doudoune Balenciaga sur le podium

Le créateur Pablo Xavier a déclaré qu'il n'avait aucune idée que cette série de photos deviendrait populaire. Il a tout d'un coup pensé aux doudounes Balenciaga, aux rues de Paris ou de Rome, etc.

Dans la section Midjourney du forum Reddit, un groupe de "Le tremblement de terre de Cascadia de magnitude 9,1 en 2001 a provoqué un tsunami qui a dévasté l'Oregon" a été largement diffusé. La scène de la catastrophe sur la photo était dans le chaos, avec des secouristes et des journalistes, des représentants du gouvernement et. d'autres sont apparus les uns après les autres et les gens avaient l'air inquiets, effrayés et paniqués. Mais en fait, il s’agit d’un « désastre » provoqué par une IA qui n’existe pas dans l’histoire. Ces images et scènes avec des éléments complets et des couleurs réelles rendent difficile la détermination de l'authenticité.

4. Compilation d'actualités : l'IA devient un moulin à rumeurs

Le 7 mai, la brigade de cybersécurité du bureau de la sécurité publique de la ville de Pingliang, province du Gansu, a détecté un cas d'IA concoctant de fausses informations.

Il a été rapporté que des criminels ont utilisé ChatGPT pour modifier et éditer les nouvelles sociales brûlantes qu'ils ont collectées sur l'ensemble d'Internet, et ont compilé une fausse nouvelle selon laquelle "un train a heurté un travailleur de la construction routière à Gansu ce matin, tuant 9 personnes" pour accéder à Internet Monétiser le trafic et l'attention.

Cette nouvelle a été vue plus de 15 000 fois dès sa publication. Heureusement, la police est intervenue dans l'enquête avant que l'opinion publique ne fermente davantage et a confirmé que le suspect avait utilisé la technologie de l'IA pour fabriquer des informations.

Non seulement les lecteurs doivent identifier les fausses nouvelles de l’IA sur les sites Web de phishing, mais les médias établis sont également parfois trompés par les fausses nouvelles de l’IA.

Le "Daily Mail" britannique (The Daily Mail) a publié une nouvelle le 24 avril disant qu'"un Canadien de 22 ans a subi 12 chirurgies plastiques pour faire ses débuts comme idole en Corée du Sud et est finalement décédé".

▲ Selon certaines informations, afin de jouer Jimin du groupe star de la K-pop BTS dans un prochain drame américain, l'acteur canadien de 22 ans a dépensé 22 000 $ US pour 12 chirurgies plastiques et est finalement décédé

La nouvelle a attiré l'attention de nombreux médias à travers le monde. Les chaînes de télévision telles que la chaîne d'information sud-coréenne YTN ont rapidement relayé les informations. Les internautes ont également exprimé leur sympathie et leurs regrets.

▲Les internautes ont exprimé leurs regrets à l'annonce de son décès

Cependant, les choses ont complètement changé après qu'un journaliste en Corée du Sud et la radio américaine iHeartRadio ont soulevé des questions : l'homme n'existe peut-être pas du tout. Les internautes ont apporté leurs photos sur le site Web de détection de contenu d'IA pour vérification et ont constaté qu'il y avait 75 % de chances que les photos aient été générées par AI. Après que la chaîne de télévision sud-coréenne MBC a vérifié auprès de la police, ils ont également reçu une réponse « non ». Des rapports de cas de décès similaires ont été reçus." Cette nouvelle a été immédiatement confirmée comme étant une "fausse nouvelle d'IA".

Mais l'affaire n'est pas encore terminée. Au début de ce mois, la famille de l'homme a décidé de poursuivre en justice les médias qui ont rapporté des « fausses nouvelles » et l'agence à laquelle appartenait l'homme, ainsi que le premier journaliste qui a annoncé que l'homme avait été tué. était mort. L’implication est que la photo n’a pas été générée par l’IA et que l’homme est décédé des suites de complications chirurgicales causées par une chirurgie plastique excessive.

Sans vérifier son identité et ne détenir aucune preuve substantielle, de nombreux médias ont affirmé que l’identité et les informations de l’homme avaient été compilées, transformant une farce provoquée par l’IA en une tragédie tragique.

Ces nouvelles compilées par l'IA non seulement confondent le public, mais font également perdre aux passants qui n'ont pas le temps et la patience de voir toute l'histoire la capacité de distinguer la vérité.

2. Célébrités qui ont été "AI" : "AI Stefanie Sun" est devenue un succès avec sa couverture, "AI Yang Mi" a changé de visage pour vendre des marchandises

Lorsque la technologie de l'IA devient endémique, les stars du divertissement deviennent les premières à être les plus durement touchées.

Stefanie Sun, devenue populaire récemment, a posté hier soir un long post en réponse à l'émergence de "AI Stefanie".

▲Stefanie Sun a répondu à l'émergence de "AI Stefanie Sun" (version traduite en chinois)

Elle a adopté une attitude plus tolérante envers l'émergence de "AI Stefanie Sun" et n'a pas engagé de poursuites judiciaires. Elle a déclaré : "Cela ne peut pas être comparé à un 'humain' qui peut sortir un nouvel album en quelques minutes seulement." Elle estime que même si (l'IA) n'a ni émotions ni changements de ton, quelle que soit la vitesse à laquelle les humains peuvent aller au-delà. il.

Il n'est pas difficile de voir d'après la réponse que même si Stefanie Sun n'apprécie pas la musique générée par l'IA, il est en effet difficile pour les humains de rattraper la capacité d'apprentissage des robots en peu de temps, elle a donc choisi de traiter ces chauds les vidéos de reprises de chansons avec indifférence.

La chanteuse Stefanie Sun a été la première à revenir sur le devant de la scène grâce aux reprises de l'IA. En raison de son timbre et de son style de chant uniques, elle a un haut degré d'adaptabilité à de nombreuses chansons populaires. Avec l'aide de la technologie d'IA des internautes. « couvert » « Des chansons telles que « My Hair is Like Snow », « Rainy Day » et « I Remember » ont toutes été vues plus d'un million de fois.

▲Les chansons les plus jouées de "AI Stefanie Sun"

Stefanie Sun n'est pas la seule chanteuse à être "recouverte" par AI, AI Jay Chou, AI Cyndi Wang, AI Tengger et d'autres sont également apparus les uns après les autres.

Bien que Stefanie Sun choisisse de ne pas engager de responsabilité juridique, lorsque la technologie de l'IA a été utilisée à mauvais escient au point de nuire aux intérêts commerciaux et de toucher aux lignes rouges juridiques, elle doit néanmoins protéger ses droits et intérêts légitimes en temps opportun.

Selon China News Network, récemment, de nombreuses salles de diffusion en direct ont commencé à utiliser l'IA pour changer les visages des célébrités afin de réaliser des émissions en direct. Des célébrités féminines telles que Yang Mi, Dilraba, Anglebaby et d'autres sont devenues l'objet d'échanges de visages. Visages de célébrités Les présentateurs transportant des marchandises peuvent obtenir de meilleurs effets de détournement de trafic et réduire les coûts de publicité. Les consommateurs ou les fans de célébrités peuvent être trompés en consommant sur la base de l'effet de célébrité.

Selon un site Internet qui propose des services de changement de visage, si vous achetez un modèle tout fait, et si vous disposez de suffisamment de matériel, vous pouvez directement synthétiser une vidéo de plusieurs heures avec seulement une demi-heure à quelques heures d'événements. Le prix d'achat d'un ensemble complet de modèles est de 35 000 yuans, bien inférieur au prix d'une invitation à une célébrité pour diffuser les marchandises en direct.

Sur plusieurs grandes plateformes de commerce électronique, des mots-clés tels que « changement de visage IA » et « changement de visage vidéo » sont bloqués par la plateforme, mais de nombreux produits associés peuvent toujours être trouvés en modifiant les mots-clés de recherche et d'autres méthodes.

La technologie qui change le visage de l’IA n’est pas un développement récent. Dès 2017, un internaute nommé DeepFake a changé le visage de l'héroïne d'un film érotique en star hollywoodienne Gal Gadot. C'était la première fois que la technologie de changement de visage de l'IA apparaissait aux yeux du public. Plus tard, en raison du mécontentement d'un grand nombre de plaignants, son compte a été officiellement interdit et la technologie de changement de visage de l'IA qui a suivi a été nommée « DeepFake » en son honneur.

Le changement de visage par l'IA est vraiment devenu populaire en Chine début 2019. Une vidéo dans laquelle le visage de Zhu Yin, l'acteur Huang Rong dans "La Légende des Héros Condor" a été remplacé par Yang Mi grâce à la technologie de l'IA, est devenue virale sur Internet. Certains internautes ont déclaré qu'il n'y avait pas de violation. Certains internautes ont également exprimé leur inquiétude quant au fait que cela pourrait porter atteinte aux droits de portrait de l'acteur original. Le producteur, M. Xiao, a répondu : Il est principalement adapté aux échanges techniques et ne sera pas utilisé. pour faire du profit.

▲Les internautes ont remplacé le rôle de "Huang Rong" joué par l'acteur Zhu Yin dans "La Légende des héros Condor" par le visage de l'acteur Yang Mi

C’est également le début de l’utilisation de l’IA pour la création secondaire de séries cinématographiques et télévisées en Chine.

La technologie de l'IA est depuis longtemps la cible des criminels et utilisée dans diverses astuces pour changer de visage. Non seulement les célébrités de l'industrie du divertissement, mais aussi de nombreuses personnes ordinaires ont été victimes de chantage au moyen de soi-disant « photos privées ». Plusieurs policiers du département de sécurité des réseaux ont déclaré que le manque de supervision de la technologie de synthèse profonde de l'IA entraînait de nombreux risques pour la sécurité de l'information et le chaos dans les communications réseau, et conduisait même indirectement à la survenance d'affaires pénales.

3. Un mouvement de vulgarisation à grande échelle du droit de l’IA a émergé. Quels comportements sont contrefaits et illégaux ?

De nombreux portraits et voix de personnes ont été diffusés sans autorisation, et des produits audio et vidéo ont été utilisés à des fins lucratives sans discuter du droit d'auteur. De plus, des contrevenants ont utilisé de fausses informations pour commettre une fraude immobilière ou même des enlèvements et des extorsions, causant des dommages personnels et personnels. droits et intérêts de propriété.

Face à ces situations plus graves, les gens doivent prendre les armes juridiques pour se protéger. S’ensuivra un mouvement de vulgarisation juridique à grande échelle de l’IA, propice au développement industriel.

La falsification de visages et de voix est monnaie courante, et le premier problème rencontré est la violation de la vie privée. Selon l'article 1019 du Code civil : « Aucune organisation ou individu ne peut porter atteinte aux droits au portrait d'autrui en diffamant, en dégradant ou en utilisant des moyens informatiques pour falsifier Sans le consentement du titulaire du droit au portrait, aucune organisation ou individu ne peut produire. ou porter atteinte aux droits au portrait d'autrui. Utiliser et divulguer le portrait de la personne ayant le droit au portrait, sauf disposition contraire de la loi "En même temps, "pour la protection de la voix des personnes physiques, se référer aux informations pertinentes. " Ce qui inquiète davantage les gens, c'est que si l'information est falsifiée. Si elle n'est pas entre les mains d'éléments, la confiance peut être davantage exploitée pour porter atteinte aux droits de propriété des personnes et même à leurs droits à la santé.

En plus des droits personnels, la question de la violation du droit d'auteur sur les matériaux audio et vidéo impliqués dans le contenu forgé par l'IA a également attiré beaucoup d'attention. Récemment, la chanteuse Stefanie Sun a publié un article déclarant qu'elle était indifférente à "AI Stefanie", mais de plus en plus de personnes forgées ont choisi de prendre des armes légales pour se protéger. Par exemple, selon les médias, Shanghai Houttuynia Information Technology. Co., Ltd. a été impliquée dans l'échange d'un certain modèle. Face mobile APP a été poursuivie par de nombreux blogueurs célèbres sur Internet.

You Yunting, associé principal et avocat en propriété intellectuelle du cabinet d'avocats Shanghai Dabang, a écrit que selon les lois sur la propriété intellectuelle, l'utilisation de voix de personnes réelles pour entraîner l'intelligence artificielle et générer des chansons ne constituera probablement pas une violation si elle n'est pas utilisée à des fins commerciales, mais il doit toujours être publié en ligne au préalable. Obtenez les autorisations appropriées pour les droits d'auteur de l'écriture de chansons, la musique d'accompagnement et le matériel vidéo. Les œuvres générées par l’intelligence artificielle présentent des défauts inhérents au droit d’auteur et ne devraient pas bénéficier du droit d’auteur ni facturer des frais de licence. Si les œuvres générées par les utilisateurs utilisant l'intelligence artificielle sont violées par des tiers, ils peuvent protéger leurs droits conformément à la loi anti-concurrence déloyale.

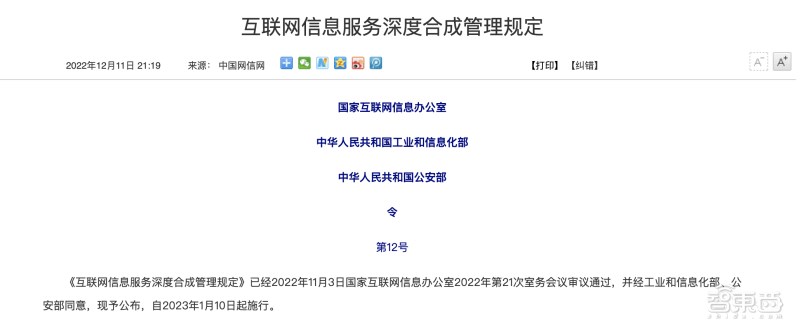

En fait, certaines réglementations particulières dans le domaine de l'intelligence artificielle dans notre pays ont également été stipulées. L'Administration chinoise du cyberespace et d'autres départements ont promulgué le « Règlement sur la gestion de la synthèse profonde des services d'information sur Internet » en décembre 2022, utilisant 25 règlements pour définir les spécifications d'utilisation de la technologie de synthèse profonde, y compris des lois et des applications telles que le interdiction d'utiliser des services de synthèse approfondie pour porter atteinte aux droits et intérêts légitimes d'autrui. Les plateformes de distribution devraient mettre en œuvre des réglementations telles que l'examen des stocks, la fourniture de services et les supports techniques devraient renforcer la gestion technique.

Le 11 avril, l'Administration du cyberespace de Chine a rapidement rédigé les « Mesures pour la gestion des services d'intelligence artificielle générative (projet pour commentaires) ». L'intelligence artificielle générative impliquée comprend la génération de textes, d'images et de sons basés sur des algorithmes, des modèles et règles, vidéos, codes et autres technologies de contenu, on peut dire que la contrefaçon actuelle de l'IA a été entièrement réglementée. ("Dernières nouvelles ! Le premier document réglementaire national AIGC, Mesures de gestion des services d'IA génératives publiées pour commentaires")

En outre, la « Loi sur la sécurité des réseaux de la République populaire de mon pays », la « Loi sur la sécurité des données de la République populaire de Chine », la « Loi sur la protection des informations personnelles de la République populaire de Chine », les « Mesures de gestion des services d'information Internet » et d'autres lois et réglementations juridiques et administratives promulguées par notre pays vont toutes dans ce sens. Il existe des dispositions qui peuvent devenir la base pertinente pour la sauvegarde des droits et intérêts légitimes.

4. Les gens ordinaires ont des « compétences de défense » en matière de reconnaissance de contenu IA et les plateformes doivent en assumer la responsabilité

La « contrefaçon » et la « contrefaçon » ne sont pas causées par l'IA, mais la technologie de l'IA d'aujourd'hui rend la « contrefaçon » plus facile et plus difficile à distinguer. Face aux contenus forgés par l’IA venant du marché, les gens ont-ils les compétences nécessaires pour les identifier eux-mêmes ?

Xiao Zihao, co-fondateur et algorithmiste de RealAI, une société de sécurité bien connue, a déclaré à Zhidongzhi que la technologie des deepfakes évolue constamment et que les sons et les vidéos générés deviennent de plus en plus réalistes, ce qui rend très difficile pour les gens ordinaires de identifier à l’œil nu.

"Si des gens ordinaires rencontrent ce genre de situation, ils peuvent consciemment guider l'autre personne pour qu'elle fasse certaines actions pendant la vidéo, comme secouer la tête ou ouvrir la bouche. Si les moyens techniques de l'escroc sont faibles, alors nous pouvons trouver les bords du visage ou des dents de l'autre personne Cependant, cette méthode est encore difficile à identifier les fraudeurs « de haut niveau ». De plus, vous pouvez également demander certaines informations privées que seuls vous et l'emprunteur connaissez. Vérifiez l'identité de l'autre partie.

"Tout en évitant d'être trompé, vous devez également faire attention à la protection de vos images personnelles et essayer d'éviter de publier un grand nombre de vos photos et vidéos sur des plateformes publiques pour faciliter la tâche des criminels. Parce que les matières premières pour la production de vidéos deepfake sont photos et vidéos personnelles "Plus nous disposons de données, plus les vidéos seront réalistes et plus difficiles à identifier", a ajouté Xiao Zihao.L’IA rend les escroqueries et la désinformation plus difficiles à détecter, et l’audit des entreprises technologiques et des plateformes de distribution de contenu devient plus important.

Le cofondateur d'Apple, Steve Wozniak, a récemment averti dans une interview que le contenu de l'IA devait être clairement étiqueté et que l'industrie devait être réglementée. Tout contenu généré par l'IA devrait être tenu responsable par l'éditeur, mais cela ne signifie pas que les grandes entreprises technologiques peuvent échapper aux sanctions juridiques. Wozniak estime que les agences de réglementation devraient demander des comptes aux grandes entreprises technologiques.

Selon le « Règlement sur la gestion de synthèse approfondie des services d'information Internet » promulgué par notre pays, les fournisseurs de contenu doivent étiqueter les images, vidéos et autres contenus générés conformément à la réglementation. En fait, nous avons déjà vu des plateformes sociales nationales telles que Xiaohongshu signaler des contenus suspectés générés par l’IA, qui peuvent jouer un certain rôle préventif. Mais le dernier obstacle au contenu généré par l’IA réside dans les utilisateurs eux-mêmes, et les plateformes médiatiques ne peuvent jouer qu’un rôle de filtrage.

Conclusion : Résistez aux applications négatives, la bataille offensive et défensive de l'IA commence

La technologie d'IA en constante évolution rend la génération de texte, d'images et de vidéos plus facile et plus réaliste. Dans le même temps, les faux contenus sont également monnaie courante. Les contenus profondément faux peuvent au moins dérouter les gens et être utilisés à des fins lucratives, ou au pire, ils peuvent être utilisés par des criminels pour commettre une fraude ou même du chantage, ce qui a attiré une attention urgente sur la supervision des contenus générés par l'IA.Alors que les nouvelles méthodes de fraude à l’IA causent des problèmes sociaux, les utilisateurs, les fournisseurs et opérateurs de technologie, les plateformes de distribution de contenu et les producteurs de contenu du secteur doivent tous renforcer leur autodiscipline. En fait, notre pays a promulgué à l'avance une série de lois et de réglementations pertinentes. La révélation des problèmes négatifs liés aux applications de l'IA devrait conduire à un mouvement de légalisation de la technologie à l'échelle nationale, favorisant ainsi un développement plus sain de l'industrie.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Tendances récentes du marché de Ripple

Tendances récentes du marché de Ripple

Inscription ChatGPT

Inscription ChatGPT

Les dix principaux échanges de devises numériques

Les dix principaux échanges de devises numériques

Quelles informations privées les amis proches de Douyin verront-ils ?

Quelles informations privées les amis proches de Douyin verront-ils ?

Le rôle de c++ce pointeur

Le rôle de c++ce pointeur

Qu'est-ce que le fil coin ?

Qu'est-ce que le fil coin ?

utilisation de l'épissure

utilisation de l'épissure

Douyin ne peut pas télécharger et enregistrer des vidéos

Douyin ne peut pas télécharger et enregistrer des vidéos