La version allégée de ChatGPT basée sur le modèle Meta est là ?

Trois jours seulement après que Meta a annoncé le lancement de LLaMA, l'industrie a déjà développé une méthode de formation open source qui la transforme en ChatGPT, qui serait jusqu'à 15 fois plus rapide que la formation ChatGPT.

LLaMA est un GPT-3 ultra-rapide et ultra-petit lancé par Meta. Le nombre de paramètres ne représente que 10 % de ce dernier, et il ne nécessite qu'un seul GPU pour fonctionner.

La méthode pour le transformer en ChatGPT s'appelle ChatLLaMA, qui est formée sur la base du RLHF (apprentissage par renforcement basé sur le feedback humain) et est rapidement devenue populaire sur Internet.

Alors, la version open source de ChatGPT de Meta arrive vraiment ?

Attendez une minute, les choses ne sont pas si simples.

Cliquez sur la page d'accueil du projet ChatLLaMA et vous constaterez qu'il intègre en fait quatre parties -

DeepSpeed, la méthode RLHF, LLaMA et l'ensemble de données généré sur la base de l'agent LangChain.

Parmi eux, DeepSpeed est une bibliothèque open source d'optimisation de formation d'apprentissage en profondeur, comprenant une technologie d'optimisation existante appelée Zero, qui est utilisée pour améliorer les capacités de formation de grands modèles. Plus précisément, elle fait référence à l'aide au modèle pour améliorer la vitesse de formation et réduire les coûts. , améliorer la disponibilité des modèles, etc.

RLHF utilisera le modèle de récompense pour affiner le modèle pré-entraîné. Le modèle de récompense utilise d'abord plusieurs modèles pour générer des questions et des réponses, puis s'appuie sur un tri manuel des questions et des réponses afin qu'il puisse apprendre à marquer. Ensuite, il note les réponses générées par le modèle sur la base de l'apprentissage des récompenses et améliore l'apprentissage. capacités du modèle grâce à l'apprentissage par renforcement.

LangChain est une grande bibliothèque de développement d'applications de modèles de langage qui espère intégrer divers grands modèles de langage et créer une application pratique combinée avec d'autres sources de connaissances ou puissance de calcul. L'agent LangChain libérera l'ensemble du processus de pensée GPT-3 comme une chaîne de pensée et enregistrera les opérations.

À ce stade, vous constaterez que la chose la plus critique reste le poids du modèle de LLaMA. D'où ça vient ?

Hé, va sur Meta et postule par toi-même, ChatLLaMA ne le fournit pas. (Bien que Meta prétende open source LLaMA, vous devez quand même postuler)

Donc essentiellement, ChatLLaMA n'est pas un projet open source ChatGPT, mais juste une méthode de formation basée sur LLaMA. Plusieurs projets intégrés dans sa bibliothèque étaient à l'origine All. sont open source.

En fait, ChatLLaMA n'a pas été construit par Meta, mais par une start-up d'IA appelée Nebuly AI.

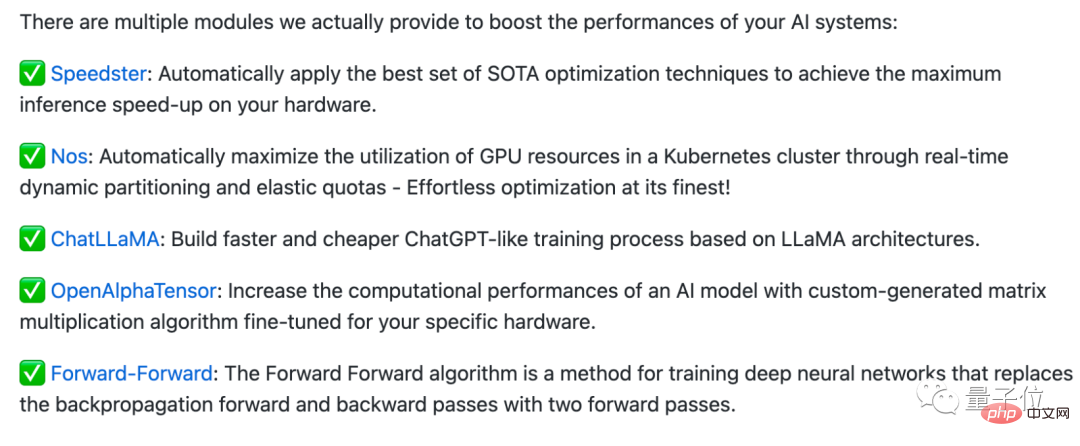

Nebuly AI a créé une bibliothèque open source appelée Nebullvm, qui intègre une série de modules d'optimisation plug-and-play pour améliorer les performances du système d'IA.

Par exemple, voici quelques modules actuellement inclus dans Nebullvm, dont OpenAlphaTensor basé sur l'algorithme open source AlphaTensor de DeepMind, des modules d'optimisation qui détectent automatiquement le matériel et l'accélèrent...

ChatLLaMA fait également partie de cette série de modules, Mais il faut préciser que sa licence open source n’est pas disponible dans le commerce.

Donc, si vous souhaitez utiliser directement le « ChatGPT auto-développé au niveau national », ce n'est peut-être pas si simple (doge).

Après avoir lu ce projet, certains internautes ont dit que ce serait formidable si quelqu'un pouvait vraiment obtenir les poids du modèle (code) de LLaMA...

Mais certains internautes ont souligné que c'est "15 fois plus rapide que la méthode de formation ChatGPT" Cette déclaration est purement trompeuse :

Le soi-disant 15 fois plus rapide est simplement dû au fait que le modèle LLaMA lui-même est petit et peut même fonctionner sur un seul GPU, mais cela ne devrait pas être dû à quelque chose de fait dans ce projet, non ?

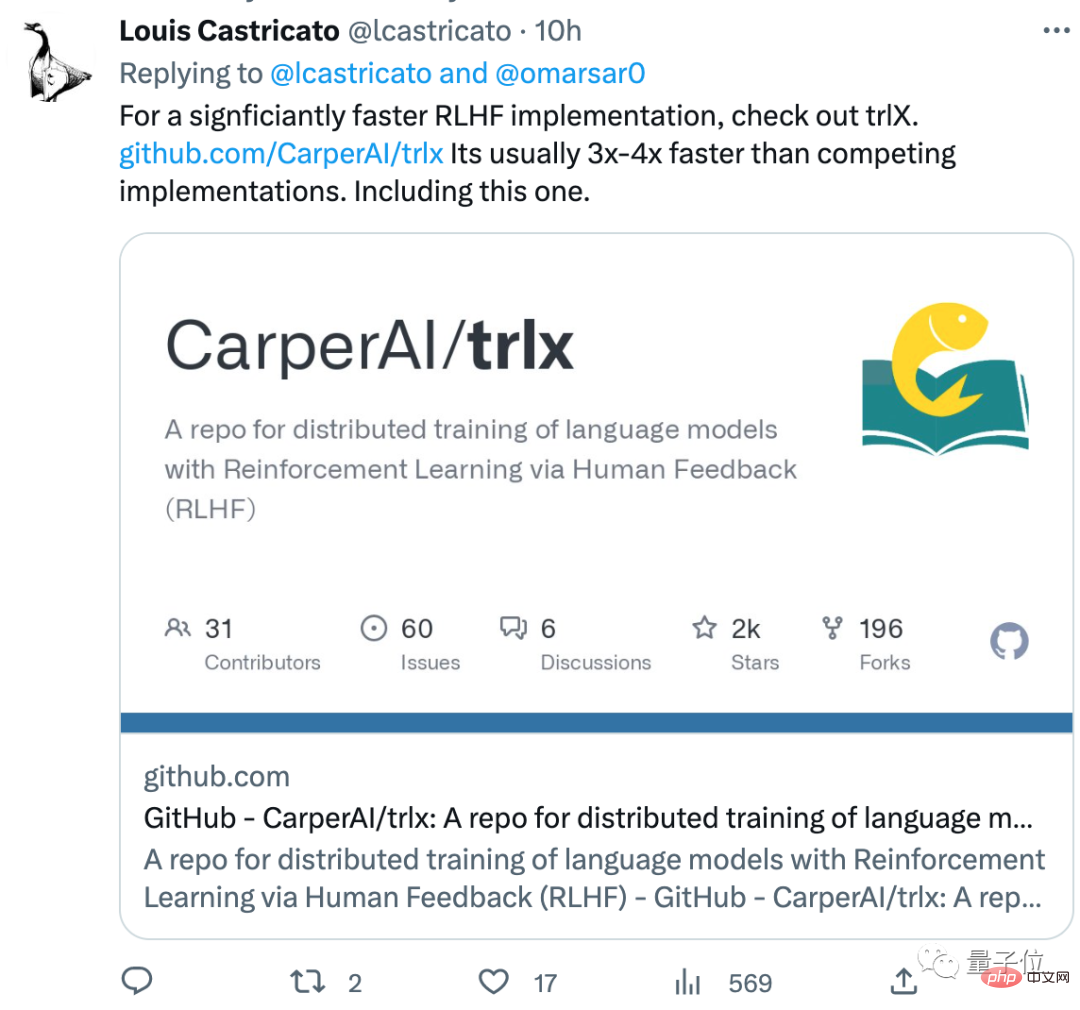

Cet internaute a également recommandé une méthode d'entraînement RLHF meilleure que celle de la bibliothèque, appelée trlx. La vitesse d'entraînement est 3 à 4 fois plus rapide que la méthode RLHF habituelle :

Vous la prenez. Vous avez le code pour LLaMA ? Que pensez-vous de cette méthode de formation ?

Adresse ChatLLaMA ://m.sbmmt.com/link/fed537780f3f29cc5d5f313bbda423c4

Lien de référence ://m.sbmmt.com/link/fe27f92b1e3f4997567807f38d567a35

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Introduction à l'utilisation du code complet VBS

Introduction à l'utilisation du code complet VBS

html en txt

html en txt

La visionneuse d'images Windows ne peut pas afficher une mémoire insuffisante

La visionneuse d'images Windows ne peut pas afficher une mémoire insuffisante

Programmation en langage de haut niveau

Programmation en langage de haut niveau

Comment modifier le registre

Comment modifier le registre

Est-il nécessaire de mettre à niveau Windows 11 ?

Est-il nécessaire de mettre à niveau Windows 11 ?

qu'est-ce que WeChat

qu'est-ce que WeChat

OnePlus ou Honor sont-ils meilleurs ?

OnePlus ou Honor sont-ils meilleurs ?