Lorsque vous observez une image, à quel contenu de l'image ferez-vous attention en premier, ou quelles zones de l'image attireront en premier votre attention ? La machine peut-elle apprendre cette forme d'attention humaine ? Dans une étude de Google, leur modèle de centre d'attention open source peut faire exactement cela. Et le modèle peut être utilisé au format d'image JPEG XL.

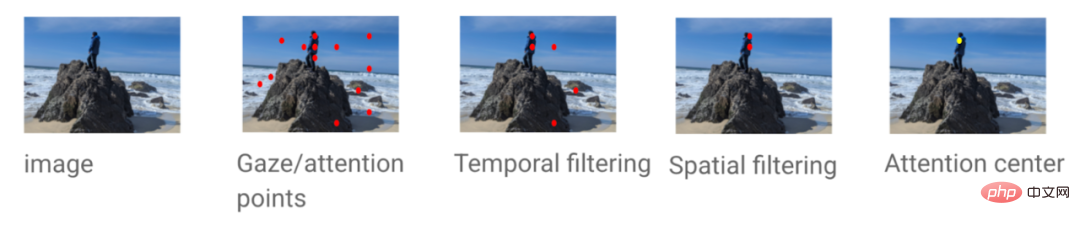

Par exemple, l'image ci-dessous présente quelques exemples de prédiction du modèle du centre d'attention, où le point vert est le point central d'attention prédit de l'image.

L'image provient de l'ensemble de données d'images Kodak : http://r0k.us/graphics/kodak/

La taille du modèle du centre d'attention est de 2 Mo et le format est TensorFlow Lite. Il prend une image RVB en entrée et génère un point 2D qui est le point central d'attention prévu sur l'image.

Afin de former un modèle pour prédire les centres d'attention, vous avez d'abord besoin de données réelles provenant des centres d'attention. Étant donné une image, certains points d'attention peuvent être collectés à l'aide d'un eye tracker ou approchés en cliquant sur l'image avec une souris. Cette étude effectue d'abord un filtrage temporel sur ces points d'attention, en ne conservant que les points d'attention initiaux, puis applique un filtrage spatial pour supprimer le bruit. Enfin, le centre des points d’attention restants est calculé comme le centre d’attention de la vérité terrain. Un exemple d’illustration du processus d’obtention de la valeur de vérité est présenté ci-dessous.

Adresse du projet : https://github.com/google/attention-center

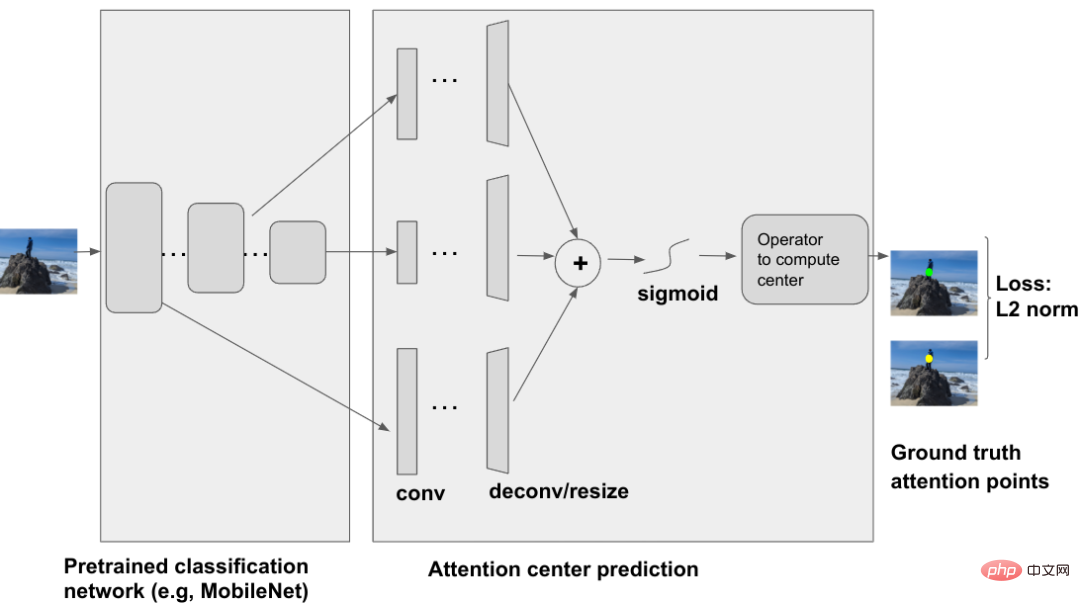

Le modèle de centre d'attention est un réseau neuronal profond avec une image An est pris en entrée et les réseaux de classification pré-entraînés tels que ResNet et MobileNet sont utilisés comme épine dorsale. Plusieurs couches intermédiaires issues du réseau fédérateur sont utilisées comme entrées dans le module de prédiction du centre d'attention. Ces différentes couches intermédiaires contiennent des informations différentes, par exemple, les couches peu profondes contiennent généralement des informations de niveau inférieur comme l'intensité/couleur/texture, tandis que les couches plus profondes contiennent généralement des informations plus élevées et plus sémantiques comme la forme/l'objet.

La prédiction du centre d'attention utilise des opérateurs d'ajustement de convolution et de déconvolution, combinés à des fonctions d'agrégation et sigmoïde, pour générer une carte de poids du centre d'attention. Ensuite, un opérateur (dans l'exemple l'opérateur de sommation d'Einstein) peut être utilisé pour calculer le centre à partir du graphique pondéré. La norme L2 entre le centre d’attention prédit et le véritable centre d’attention est utilisée comme perte d’entraînement.

De plus, JPEG XL est un nouveau format d'image qui permet aux utilisateurs d'encoder les images de telle manière que les parties intéressantes soient affichées en premier. L'avantage est que lorsque les utilisateurs parcourent des images en ligne, les parties attrayantes de l'image peuvent être affichées en premier, c'est-à-dire la partie que l'utilisateur voit en premier. Idéalement, une fois que l'utilisateur regarde le reste de l'image, la partie de l'image. l'image sera affichée en premier. D'autres parties sont déjà en place et décodées.

En JPEG XL, l'image est généralement divisée en une matrice de taille 256 x 256, l'encodeur JPEG XL sélectionnera un groupe de départ dans l'image puis générera des carrés concentriques autour de ce groupe. Chrome a ajouté le décodage progressif des images JPEG XL à partir de la version 107. Actuellement, JPEG XL est encore un produit expérimental et peut être activé en recherchant jxl dans chrome://flags.

Pour comprendre l'effet du chargement progressif des images JPEG XL, vous pouvez visiter l'URL pour voir :

https://google.github.io/attention-center/

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

tutoriel ajax

tutoriel ajax

Le WiFi ne montre aucun accès à Internet

Le WiFi ne montre aucun accès à Internet

Encyclopédie ChatGPT nationale gratuite

Encyclopédie ChatGPT nationale gratuite

Comment vérifier l'état du serveur

Comment vérifier l'état du serveur

bootmgr est manquant et ne peut pas démarrer

bootmgr est manquant et ne peut pas démarrer

Comment supprimer vos propres œuvres sur TikTok

Comment supprimer vos propres œuvres sur TikTok

La différence entre la grande fonction et la fonction maximale

La différence entre la grande fonction et la fonction maximale

Auto-apprentissage pour débutants en langage C sans fondement

Auto-apprentissage pour débutants en langage C sans fondement