Récemment, une vidéo de tournage d'une scène nocturne IA de Google est devenue virale !

La technologie présentée dans la vidéo s'appelle RawNeRF et, comme son nom l'indique, il s'agit d'une nouvelle variante de NeRF.

NeRF est un réseau neuronal entièrement connecté qui utilise les informations d'image 2D comme données d'entraînement pour restaurer des scènes 3D.

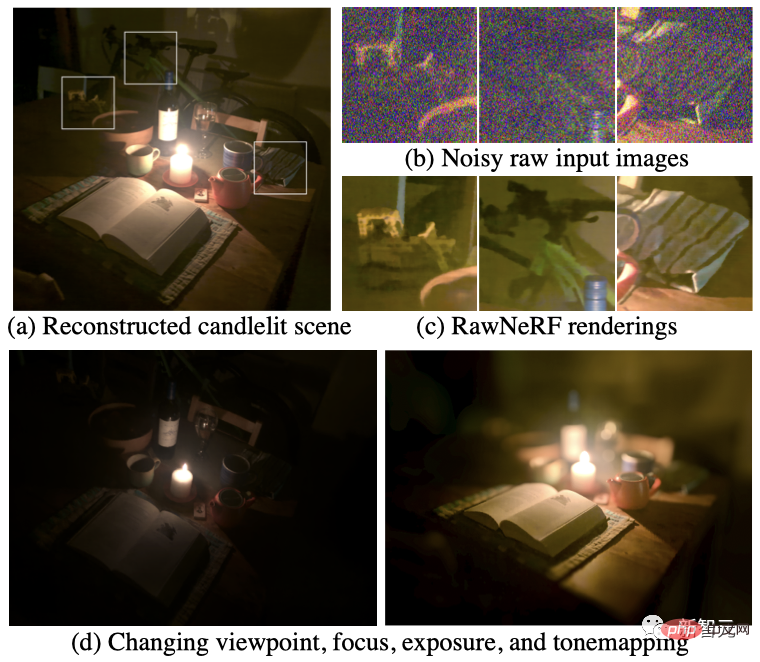

RawNeRF présente de nombreuses améliorations par rapport au NeRF précédent. Non seulement il réduit parfaitement le bruit, mais il modifie également la perspective de la caméra et ajuste la mise au point, l'exposition et le mappage des tons. Cet article de Google a été publié en novembre 2021 et inclus dans le CVPR 2022.

Adresse du projet : https://bmild.github.io/rawnerf/

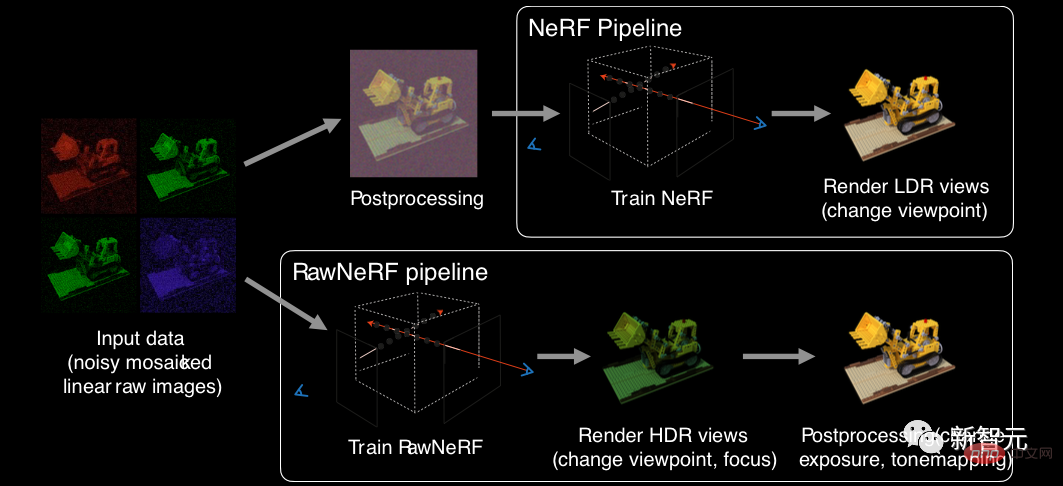

Auparavant, NeRF était une image LDR à faible plage dynamique utilisant le mappage de tons comme entrée .

RawNeRF de Google s'entraîne directement sur des images brutes linéaires, ce qui peut préserver toute la plage dynamique de la scène.

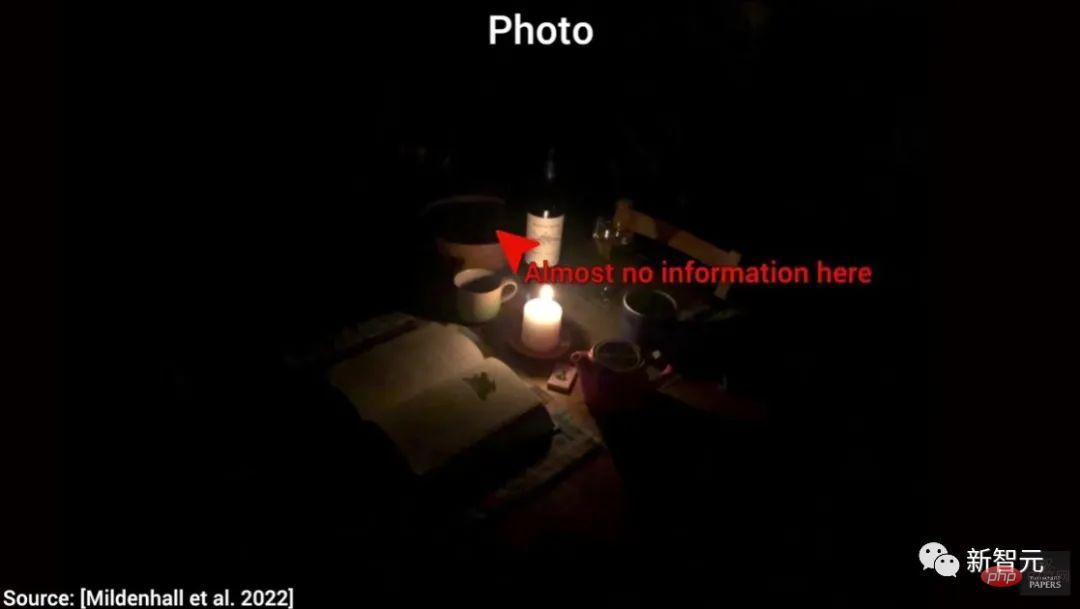

Dans le domaine des vues composites, gérer des photos sombres a toujours été un problème.

Parce que dans ce cas, il y a un minimum de détails dans l'image. Et ces images rendent difficile l’assemblage de nouvelles vues.

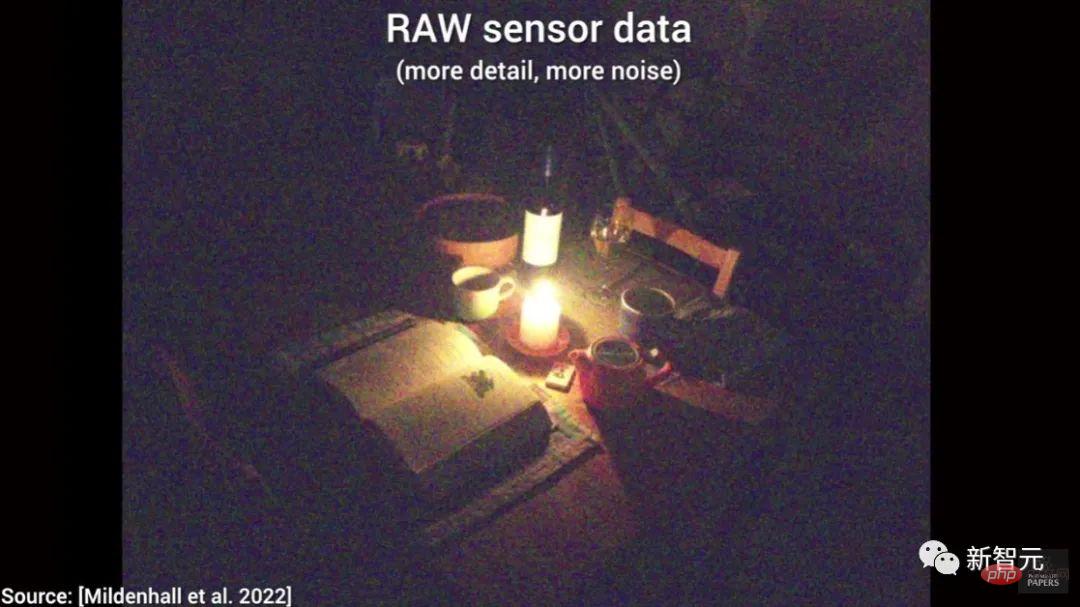

Heureusement, nous avons une nouvelle solution : utiliser les données brutes des capteurs.

C'est une photo comme celle-ci, donc nous avons plus de détails.

Cependant, il reste un problème : il y a trop de bruit.

Il faut donc faire un choix : moins de détails et moins de bruit, ou plus de détails et plus de bruit.

La bonne nouvelle est que nous pouvons utiliser la technologie de réduction du bruit de l'image.

Vous pouvez voir que l'effet d'image après réduction du bruit est bon, mais pour les vues composites, cette qualité n'est toujours pas suffisante.

Cependant, la technologie de débruitage d'images nous donne une idée : puisque nous pouvons débruiter une seule image, nous pouvons également débruiter un groupe d'images.

Jetons un coup d'œil à l'effet de RawNeRF.

Et il possède des fonctionnalités encore plus étonnantes : le mappage tonal des données sous-jacentes pour extraire plus de détails des images sombres.

Par exemple, changez la mise au point de l'image pour créer un grand effet de profondeur de champ.

Ce qui est encore plus étonnant, c'est que c'est en temps réel.

De plus, l'exposition de l'image changera également en conséquence à mesure que la mise au point change !

Ensuite, jetons un coup d'œil à cinq scénarios d'application classiques de RawNeRF.

1. Clarté de l'image

En regardant cette image, pouvez-vous voir les informations sur le panneau de signalisation ?

Vous pouvez constater qu'après le traitement RawNeRF, les informations sur les panneaux routiers sont beaucoup plus claires.

Dans l'animation suivante, nous pouvons clairement voir la différence de synthèse d'image entre la technologie NeRF originale et RawNeRF.

En fait, ce qu'on appelle le NeRF n'est pas une technologie si ancienne, cela ne fait que 2 ans...

On peut voir que RawNeRF fonctionne toujours très bien dans le traitement des hautes lumières Oui. , on peut même voir le changement de surbrillance autour de la plaque d'immatriculation dans le coin inférieur droit.

2. Faits saillants spéculaires

Les reflets spéculaires sont des objets très difficiles à capturer car ils changent beaucoup lorsque vous déplacez l'appareil photo et la distance relative entre les photos est également relativement grande. Ces facteurs constituent d’énormes défis pour les algorithmes d’apprentissage.

Comme vous pouvez le voir sur l'image ci-dessous, on peut dire que la surbrillance spéculaire générée par RawNeRF est assez restaurée.

3. Structure fine

Même dans un scénario bien éclairé, la technologie précédente n'affichait pas bien la clôture.

Et RawNeRF peut gérer les photos de nuit avec un tas de clôtures, et il peut tenir le coup.

Même là où la clôture chevauche la plaque d'immatriculation, l'effet est toujours très bon.

4. Réflexion spéculaire

La réflexion sur la route est un point culminant spéculaire plus stimulant. Comme vous pouvez le constater, RawNeRF le gère également de manière très naturelle et réaliste.

5. Changez la mise au point, ajustez l'exposition

Dans cette scène, essayons de changer la perspective, de changer constamment la mise au point et d'ajuster l'exposition en même temps.

Dans le passé, pour accomplir ces tâches, nous avions besoin d'une collection de 25 à 200 photos.

Maintenant, il ne nous faut plus que quelques secondes pour terminer le tournage.

Bien sûr, RawNeRF n'est pas parfait maintenant. Nous pouvons voir qu'il existe encore quelques différences entre l'image RawNeRF de gauche et la vraie photo de droite.

Cependant, RAWnerf a fait des progrès considérables depuis un ensemble d'images originales pleines de bruit jusqu'à l'effet actuel. Vous savez, il y a deux ans, la technologie était totalement incapable de faire cela.

Pour résumer brièvement, le pipeline de formation NeRF reçoit des images LDR traitées par la caméra, et la reconstruction de scène et le rendu de vue ultérieurs sont basés sur l'espace colorimétrique LDR. Par conséquent, la sortie de NeRF a en fait été post-traitée et il est impossible de la modifier et de l'éditer de manière significative.

En revanche, RawNeRF est formé directement sur les données d'entrée HDR brutes linéaires. Le rendu obtenu peut être modifié comme n'importe quelle photo originale, en modifiant la mise au point et l'exposition, etc.

Les principaux avantages apportés par cela sont deux points : la synthèse de vue HDR et le traitement de réduction du bruit.

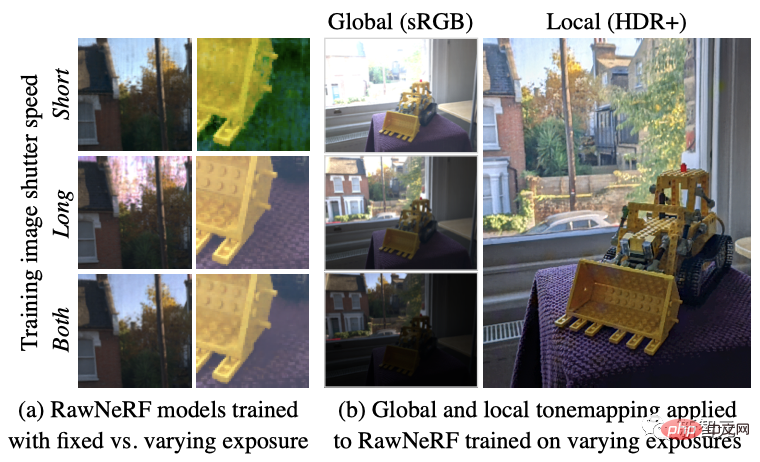

Dans les scènes présentant des changements extrêmes de luminosité, une vitesse d'obturation fixe ne suffit pas pour capturer toute la plage dynamique. Le modèle RawNeRF peut optimiser simultanément les expositions courtes et longues pour restaurer la plage dynamique complète.

Par exemple, la scène à grand rapport de lumière en (b) nécessite un algorithme de mappage de tons local plus complexe (tel que HDR + post-traitement) pour préserver les détails des parties sombres et des hautes lumières extérieures en même temps.

De plus, RawNeRF peut restituer des effets de défocalisation synthétiques avec des reflets « flous » correctement saturés en utilisant une couleur linéaire.

En termes de traitement du bruit d'image, l'auteur a entraîné RawNeRF sur des images originales linéaires HDR entièrement non traitées, le transformant en un algorithme capable de gérer des dizaines, voire des centaines d'images d'entrée.

Cette robustesse signifie que RawNeRF peut parfaitement accomplir la tâche de reconstruction de scènes dans l'obscurité.

Par exemple, dans (a) cette scène nocturne éclairée par une seule bougie, RawNeRF peut extraire des détails des données brutes bruyantes qui seraient autrement détruites par le post-traitement (b, c).

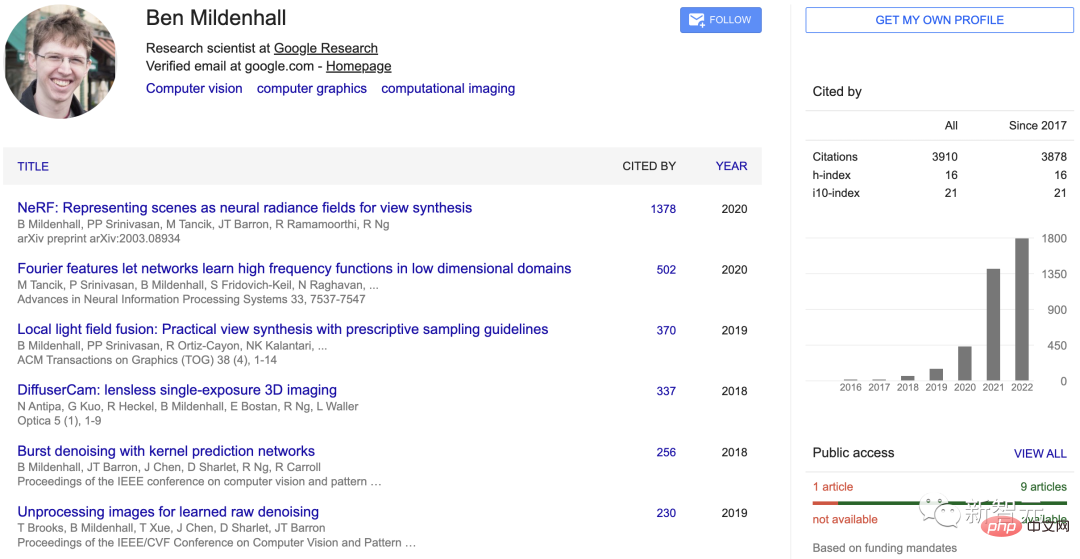

Introduction à l'auteur

Le premier auteur de l'article, Ben Mildenhall, est un chercheur scientifique chez Google Research, engagé dans les problèmes de vision par ordinateur et de graphisme.

Il a obtenu une licence en informatique et en mathématiques de l'Université de Stanford en 2015, et un doctorat en informatique de l'Université de Californie à Berkeley en 2020.

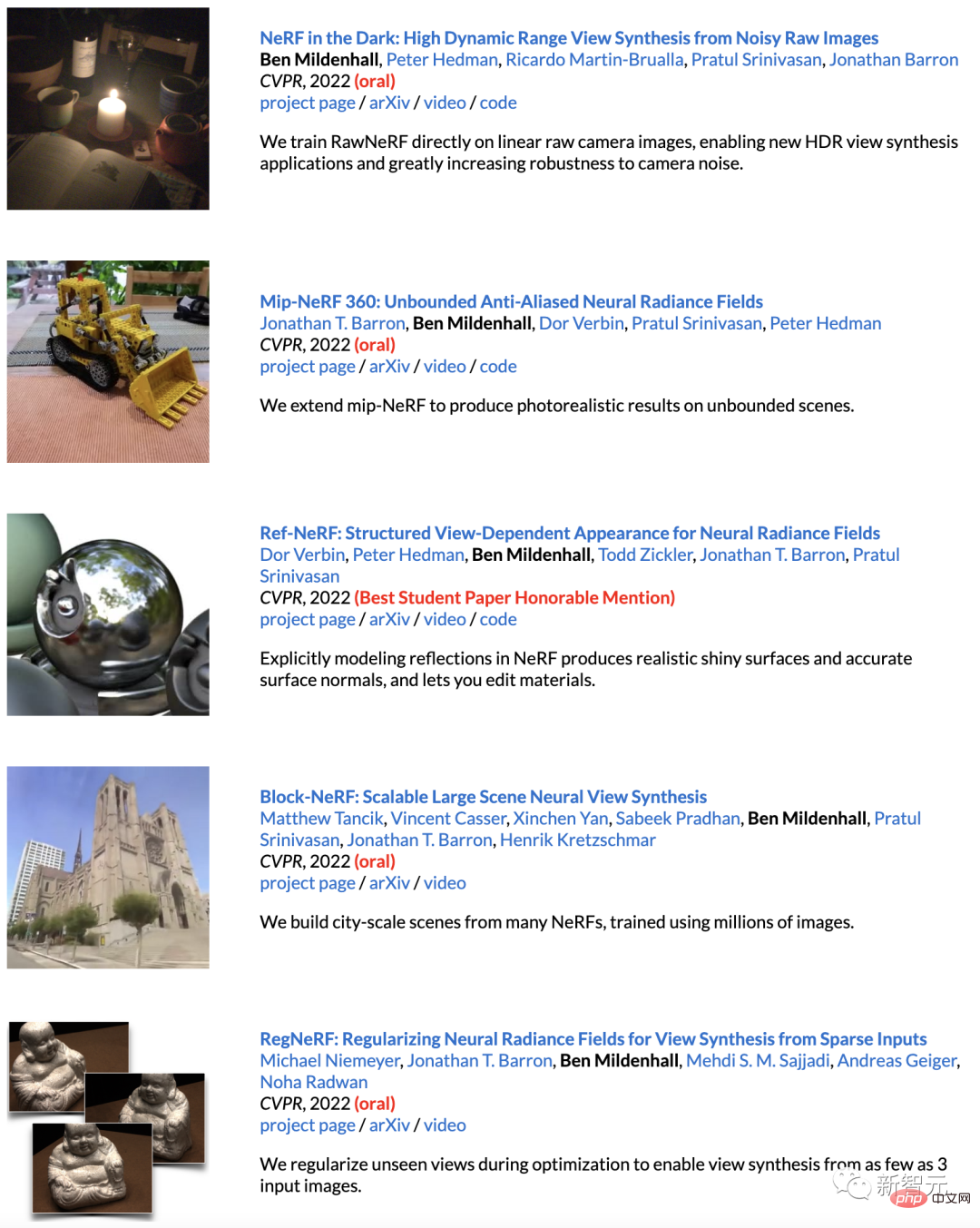

Le CVPR 2022 qui vient de se terminer peut être considéré comme le moment fort de Ben.

5 des 7 communications acceptées ont remporté l'Oral, et une a remporté la mention honorable pour la meilleure communication étudiante.

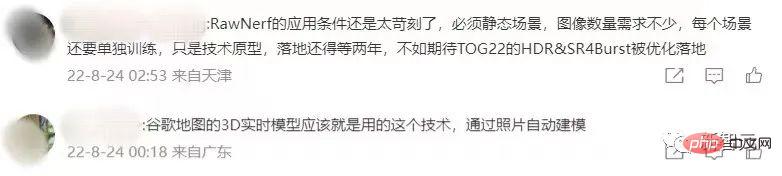

Dès que la vidéo est sortie, elle a immédiatement étonné tous les internautes. Amusons-nous tous ensemble.

Au vu de la vitesse des progrès technologiques, il ne faudra pas longtemps avant que vous n'ayez plus à vous soucier de prendre des photos de nuit~

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!