OpenAI est désormais devenue la cible de poursuites dans le domaine mondial de l’intelligence artificielle.

Après que Google ait présenté « Bard », le cercle technologique chinois a commencé à bouillir. L'équipe de recherche sur le traitement du langage naturel, à l'origine misérable, est maintenant devenue la préférée de tous. Une compétition pour les capitaux et les talents a commencé.

« Construire une version chinoise de ChatGPT » a été diffusé dans le message de héros de Wang Huiwen, et il s'est répandu auprès de dix personnes et de centaines de personnes, devenant ainsi l'objectif commun des praticiens chinois de l'IA.

Cependant, aussi brûlante que soit la discussion sur ChatGPT ces derniers jours, nous devons faire face à une cruelle réalité : dans la compétition pour poursuivre OpenAI, peu d'équipes peuvent enfin atteindre Guangmingding.

D'une part, le coût est élevé, et les fonds pour « affiner » les grands modèles ne sont que le ticket pour construire ChatGPT, d'autre part, il y a des talents limités qui peuvent former de grands modèles ; Les grands modèles sont la pierre angulaire technique de la création de ChatGPT par OpenAI, et trouver les bonnes personnes est également extrêmement critique.

Le grand modèle doit être une direction dans laquelle l'industrie, le monde universitaire et la recherche travaillent ensemble. Si les participants de ChatGPT veulent gagner, ils doivent non seulement avoir des scientifiques de haut niveau, mais également avoir besoin d'une équipe opérationnelle possédant une compréhension et une expérience dans les domaines politique et commercial. environnement, ainsi qu'une expérience sur le marché des capitaux. Des entrepreneurs vedettes dotés de charisme et de volonté de rejoindre All-in.

Cet article vise à faire le point sur les positions des principales forces potentielles nationales dans cette vague de concurrence ChatGPT du point de vue de la recherche universitaire.

L'Université Tsinghua est un centre de recherche universitaire dans le domaine du traitement du langage naturel (PNL) en Chine. Son histoire de recherche en PNL est profonde et son équipe de recherche est nombreuse. , Liu Zhiyuan et Huang Minlie. Ils ont fréquenté l'université de langues ces dernières années. Le travail dans le domaine de la modélisation est remarquable. De plus, de nombreux dirigeants de grands modèles chez de grands fabricants sont des descendants de l'Université Tsinghua, comme He Xiaodong, vice-président de JD.com, Tian Qi, scientifique en chef dans le domaine de l'intelligence artificielle de Huawei Cloud, etc.

Après avoir fait le tri, il existe trois forces principales potentielles pour que l'Université Tsinghua rattrape cette vague de ChatGPT : l'une est le Laboratoire d'ingénierie des connaissances (KEG), dirigé par Li Juanzi et son disciple Tang Jie ; Laboratoire de calcul du traitement du langage naturel et des humanités sociales (THUNLP), le responsable académique est Sun Maosong et le chef d'équipe Liu Zhiyuan est son disciple ; le troisième est le Groupe de recherche sur l'intelligence artificielle interactive (CoAI), co-dirigé par Zhu Xiaoyan et son étudiant Huang Minlie.

Tang Jie de l'Université Tsinghua

Tang Jie

Tang Jie

En même temps, Tang Jie est également un universitaire qui accorde une grande attention à l'intégration de l'industrie, du monde universitaire et de la recherche et à la construction d'un grand écosystème modèle. En 2019, s'appuyant sur le produit phare AMnier et les réalisations techniques du Laboratoire d'ingénierie des connaissances, Tang Jie et Li Juanzi ont dirigé la création de Zhipu AI. L'équipe actuelle de l'entreprise comprend de nombreux étudiants de Tang Jie, qui sont tous les principaux participants des « Lumières » 2.0.

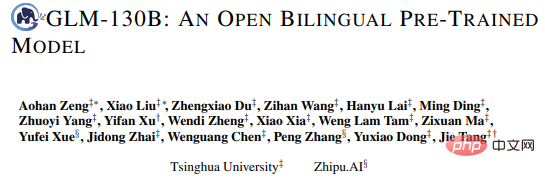

Tang Jie est issu du domaine de l'exploration de données et Li Juanzi est un célèbre chercheur dans le domaine des graphiques de connaissances. Cela détermine que la caractéristique du modèle à grande échelle de Wisdom Map AI est « données + connaissances ». L'année dernière, Zhipu AI a publié le modèle bilingue GLM-130B de 100 milliards, qui est open source et disponible en téléchargement gratuit par les instituts de recherche ou les particuliers.

GLM-130B adopte l'architecture du modèle GLM proposée par KEG Labs en 2021, qui fonctionne mieux que le modèle GPT-3 d'OpenAI sur plusieurs tâches. Grâce à la technologie de quantification de modèle, l'équipe de Tang Jie a également amélioré la facilité d'utilisation du modèle et réduit les coûts de calcul. Le GLM-130B peut effectuer des inférences sur un serveur A 100 ou V100.

De plus, l’équipe de Tangjie a également établi des échanges et des contacts avec de nombreuses grandes entreprises pour les accompagner dans le développement de grands modèles, comme le M6 d’Alibaba. Yang Zhilin, étudiant de Tang Jie, est le co-fondateur de la startup NLP Circular Intelligence et a également participé à la recherche et au développement du grand modèle « Pangu » de Huawei.

Selon des initiés, Zhipu AI recherche actuellement des produits de type ChatGPT et les lancera au cours des deux derniers mois.

Du point de vue de la direction thématique de la PNL, l'équipe la plus « enracinée et populaire » du département de Tsinghua est l'équipe de Sun Maosong et Liu Zhiyuan.

Le Laboratoire de traitement du langage naturel et de calcul des humanités sociales de l'Université Tsinghua (THUNLP) est la première et la plus influente unité de recherche scientifique en Chine à mener des recherches en PNL. Lorsque le laboratoire a été créé à la fin des années 1970, il était dirigé par Huang Changning, le pionnier de la PNL en Chine, Sun Maosong, qui était son élève, et Liu Zhiyuan était l'élève de Sun Maosong.

Sun Maosong (à gauche), Liu Zhiyuan (à droite)

THUNLP a accumulé une profonde expérience dans le domaine de la PNL. En 2015, il a publié le système de génération de poésie chinoise "Nine Songs". ", qui repose sur un grand nombre de créations humaines. La formation en poésie a attiré une large attention dans le monde universitaire et industriel.

En termes de grands modèles de langage, l'équipe de Sun Maosong et Liu Zhiyuan a suivi le paradigme de pré-formation en 2018. Début 2019, ils ont publié le modèle de langage ERNIE (du même nom que la version Baidu d'ERNIE en même temps), puis a développé le modèle CPM, qui est Zhiyuan Le prédécesseur de l'institut « Wudao·Wenyuan ».

Sun Maosong, Liu Zhiyuan et leurs étudiants diplômés ont incubé plusieurs entreprises dans les domaines de la PNL et des grands modèles. Y compris Power Law Intelligence, fondée par Tu Cunchao en 2017, qui se concentre sur l'application de la PNL dans le domaine juridique ; Shenyan Technology, fondée par Qi Fanchao en 2022, s'engage à construire un moteur de traitement de l'information chinois de qualité industrielle avec des outils chinois auto-développés. grands modèles.

De plus, il existe Wall-Facing Intelligence fondée l'année dernière par Zeng Guoyang, qui se concentre sur l'accélération et l'application de grands modèles. L'équipe de l'entreprise est le membre principal de « Wudao Wenyuan ». Ils ont lancé conjointement la communauté open source OpenBMB avec THUNLP et le Language Large Model Technology Innovation Center de l'Institut de recherche Zhiyuan, et ont lancé CPM-Live des dizaines de milliards de projets de formation en direct sur grands modèles chinois, ainsi que des outils d'accélération de processus complets sur grands modèles. .

Dans cette vague de ChatGPT, l'avantage de THUNLP réside dans ses nombreuses réalisations académiques en PNL et son expérience en R&D sur de grands modèles. Le défi réside dans l'ingénierie et la commercialisation.

ChatGPT En tant que robot de chat, il est soutenu par la technologie du système de dialogue Dans cette direction, les recherches du groupe de recherche sur l'intelligence artificielle interactive (CoAI) de l'Université Tsinghua sont très importantes.

CoAI est dirigée par Zhu Xiaoyan et son élève Huang Minlie. Huang Minlie est un expert dans le domaine de l'intelligence artificielle conversationnelle et l'auteur du livre « Modern Natural Language Generation ». Il a également déjà participé au développement du grand modèle de sagesse « Wudao ».

Huang Minlie

Huang Minlie est également membre des universitaires Tsinghua qui ont lancé leur propre entreprise. Il a fondé « Lingxin Intelligence » en 2021. Sur la base de la recherche sur les grands modèles et les systèmes de dialogue, Huang Minlie a choisi la piste du robot de chat de conseil psychologique. En 2022, son équipe a lancé un robot interactif appelé « AI Utopia » où les utilisateurs peuvent personnaliser les personnages de l'IA et avoir des conversations approfondies avec le robot.

En tant que l'une des rares équipes nationales capables de former de grands modèles, Huang Minlie a déclaré qu'après avoir récemment terminé le cycle de financement pré-A par rapport à ChatGPT, ils espèrent positionner « Lingxin Intelligence » comme « l'IA de caractère de la Chine » ——Fournir utilisateurs avec une camaraderie émotionnelle basée sur la génération de texte. Il est entendu que son équipe a accumulé une grande quantité de données de formation de haute qualité dans le domaine de la santé mentale, avec plus de 3 milliards de paramètres de modèle.

Certains initiés de l'industrie ont fait remarquer qu'actuellement, les indicateurs de certains grands fabricants, y compris 360 dans la technologie de type ChatGPT, ne peuvent atteindre qu'un niveau légèrement meilleur que GPT-2. Par rapport au ChatGPT actuel, il existe encore un écart de génération. Il s'agit d'une approche simple des grands modèles de langage (tels que Kuaishou, iFlytek, NetEase, etc.). Par conséquent, il existe des incertitudes majeures quant au moment de lancement et à l'effet réel de la version bêta de type ChatGPT.

BaiduWenxin Large Model

La recherche et le développement du grand modèle Baidu Wenxin sont dirigés par le CTO Wang Haifeng. Dans le projet "Wen Xin Yi Yan", Wang Haifeng est également le commandant général, et il y a également les membres principaux Wu Tian (vice-président du groupe Baidu et leader dans la recherche et le développement de la plateforme Flying Paddle) et Wu Hua ( Président du comité technique de Baidu et l'un des fondateurs de l'équipe de technologie de traduction de Baidu) 1).

Wang Haifeng

Wang Haifeng

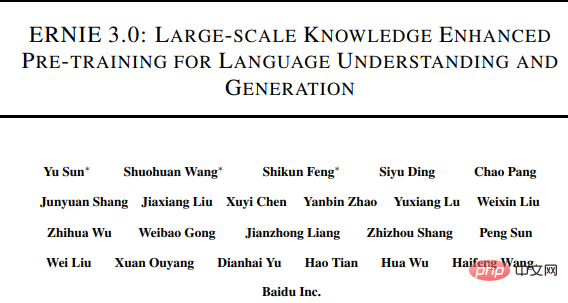

Baidu est l'une des premières équipes en Chine à approfondir le développement de modèles de pré-formation. En 2019, elle a publié les modèles ERNIE 1.0 et 2.0. Les effets chinois ont dépassé BERT ; juillet 2021. L'ERNIE 3.0 publié a dépassé GPT-3 dans SuperGLUE ; le "Pengcheng-Baidu Wenxin" (ERNIE 3.0 Titan) publié la même année a été le premier grand modèle de niveau 100 milliards amélioré en termes de connaissances.

« L'amélioration des connaissances » est la voie technique empruntée par la série Wenxin, c'est-à-dire l'introduction des connaissances linguistiques et des connaissances du monde, etc., et l'intégration de l'apprentissage à partir de graphiques de connaissances à grande échelle et de données massives pour améliorer l'apprentissage de grands modèles Efficacité et explicabilité.

En 2021, Baidu a également lancé un robot de conversation appelé PLATO. Le modèle est basé sur le modèle de génération de dialogue à grande échelle PLATO-XL avec des dizaines de milliards de paramètres.

L'avantage de Baidu réside dans la richesse de ses données de corpus de recherche, dans ses recherches approfondies sur les données des utilisateurs au cours de nombreuses années de recherche sur l'IA, et dans la bénédiction de la plateforme d'apprentissage en profondeur Baidu Fei Paddle et des puces auto-développées.

Après la guerre acharnée entre Microsoft et Google, Baidu a été l'une des premières équipes en Chine à annoncer son projet de développer un produit ChatGPT ("Wen Xin Yi Yan"). Les initiés ont révélé que son produit pourrait être un portail indépendant, ou qu'il pourrait imiter Microsoft Bing et être connecté au portail de recherche Baidu.

AlibabaTongyi Large Model

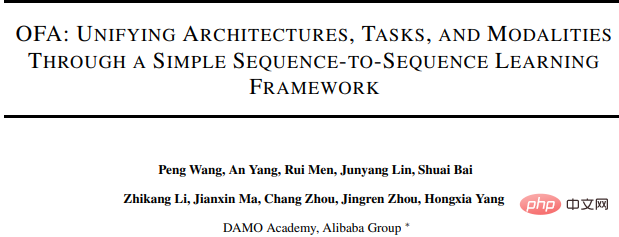

La série grand modèle multimodale M6 développée par Yang Hongxia, ancien membre du laboratoire de calcul intelligent de l'Académie DAMO (qui a démissionné l'année dernière) et de l'équipe de Tang Jie à l'Université Tsinghua, a également augmenté ses paramètres de 10 milliards à 10 000 milliards.

Sous la direction de Zhou Jingren, l'actuel directeur adjoint de la DAMO Academy, la DAMO Academy a lancé le grand modèle « Tongyi », qui est le point culminant des résultats actuels du modèle Alibaba, en septembre de l'année dernière.

Jingren Zhou

Le grand modèle de « signification générale » unifie pour la première fois la modalité, l'architecture et les tâches, et le support technique derrière lui est le paradigme d'apprentissage unifié OFA.

L'année dernière, afin de promouvoir la construction écologique open source de grands modèles chinois, DAMO Academy a également lancé la communauté open source de modèles d'IA "Model Scope" (Model Scope), ce qui a provoqué un énorme réponse dans l’industrie.

Il y a quelques jours, DAMO Academy a confirmé qu'elle développait la version Alibaba de ChatGPT basée sur le grand modèle "Tongyi". En plus de la génération de texte, elle dispose également de fonctions de peinture. Il est entendu que ses produits de type ChatGPT seront profondément intégrés à DingTalk.

JD.com a commencé à rechercher la génération de texte IA en 2020 pour prendre en charge la génération de descriptions de pages de produits JD.com. Il est rapporté que 20 % des introductions de produits sur les pages du centre commercial de JD.com sont générées par l’équipe d’IA utilisant la technologie NLP. Au cours de cette période, en raison de la dépression générale de la technologie PNL, la recherche et le développement ont été entravés, mais plus tard, JD.com y a de nouveau prêté attention et a lancé le grand modèle Yanxi.

He Xiaodong, qui a quitté Microsoft pour rejoindre JD.com en 2018, est actuellement vice-président du groupe JD.com, directeur exécutif du JD.com AI Research Institute et leader de la recherche sur les grands modèles de JD.com. l'équipe aujourd'hui.

He Xiaodong

En 2021, lui et l'ancien directeur de JD AI Zhou Bowen (qui a démissionné en novembre 2021) ont dirigé une équipe pour développer la plateforme d'IA sur le domaine JD Yanxipian. modèle K-PLUG. Ce modèle est étroitement intégré au scénario de commerce électronique de JD.com, tire des enseignements de connaissances spécifiques dans le domaine du commerce électronique et peut générer automatiquement la rédaction de produits.

JD.com n'a actuellement pas de grand modèle avec des centaines de milliards de paramètres, et K-PLUG n'a que 1 milliard de paramètres. Cependant, cette fois, JD.com Cloud Yanxi Platform a également annoncé son entrée. dans le jeu et lancera le produit ChatGPT "ChatJD". Et soulignera sa couleur "version industrielle".

Les ressources informatiques de Huawei constituent un avantage naturel pour ses recherches sur les grands modèles.

Huawei a commencé à présenter de grands modèles en 2020, et le leader est Tian Qi (IEEE Fellow, académicien de l'Académie internationale eurasienne des sciences).

Tian Qi

En mars 2020, il a rejoint Huawei Cloud en tant que scientifique en chef dans le domaine de l'intelligence artificielle dans Huawei Cloud après la sortie de GPT-3 au cours de l'été suivant. L'année suivante, il forme immédiatement une équipe et commence à développer le grand modèle de Pangu. Huawei est ainsi devenu l'un des premiers grands constructeurs à participer au concours des grands modèles en 2020.

Basé sur Ascend AI, en coopération avec Pengcheng Laboratory et Circular Intelligence, Huawei a publié la série de grands modèles « Pangu » en avril 2021, comprenant quatre grands modèles de langue chinoise, de vision, de multimodalité et de calcul scientifique.

Le grand modèle Pangu NLP est le premier grand modèle de l'industrie qui génère et comprend le chinois à l'échelle de 100 milliards. Au cours de la phase de pré-formation, 40 To de données textuelles chinoises ont été apprises, y compris de petits échantillons de données de segments industriels. En termes de structure du modèle, Pangu adopte l'architecture Encode et Decode pour garantir ses performances en matière de génération et de compréhension.

Huawei possède une expérience en R&D dans des centaines de milliards de modèles et des ressources informatiques puissantes, mais il a fait peu de bruit cette fois et n'a pas encore précisé s'il développerait des produits de type ChatGPT.

Zhou Ming, fondateur de Rulanzhou Technology, Zhang Jiaxing, scientifique président de l'Institut de recherche IDEA, Xihu Xinchen Lan Zhenzhong, Zhou Bowen, fondateur de Xianyuan Technology, et d'autres sont tous des représentants de l'école universitaire de start-up.

Pour eux, pour gagner dans la future guerre commerciale ChatGPT, ils doivent également renforcer leurs capacités d'ingénierie et d'exploitation du marché. Comme Zhang Jiaxing et Lan Zhenzhong, ils recherchent déjà un PDG pour leur équipe R&D.

De plus, on peut également observer deux modes d'entrée : l'un repose sur de fortes capacités techniques pour combler les lacunes de commercialisation ; l'autre est la fin d'un patron avec une riche expérience en commercialisation, attirant des talents techniques formés ; une équipe.

Quel modèle aura le plus de succès au final, nous attendrons de voir.

Lanzhou TechnologyZhou Ming

En juin 2021, Zhou Ming a créé Lanzhou Technology. En juillet suivant, son équipe a publié le modèle « Mencius » avec un milliard de paramètres, qui était aussi efficace qu'un grand modèle avec un milliard de paramètres.

C’est le résultat de l’épanouissement de Zhou Ming tant dans le monde universitaire que dans l’industrie.

Zhou Ming

Zhou Ming

Zhou Ming est l'un des scientifiques chinois les plus influents dans le domaine de la PNL. Il a obtenu un doctorat de l'Institut de technologie de Harbin en 1991. Il est un camarade de classe du directeur technique de Baidu, Wang Haifeng, et un disciple du professeur de l'Institut de technologie de Harbin et maître en PNL, Li Sheng. Au cours de son doctorat, Zhou Ming a développé le premier système de traduction chinois-anglais de Chine.

Après avoir obtenu son diplôme, Zhou Ming est entré pour la première fois à l'Université Tsinghua en tant qu'enseignant en 1999, il a été débauché par Kaifu Lee, le doyen fondateur de Microsoft Research Asia (MSRA). a ensuite été promu doyen adjoint de Microsoft Research Asia.

Au cours de MSRA, Zhou Ming a réalisé de nombreuses réalisations dans l'industrialisation de la technologie PNL. Il a participé et dirigé plus de 100 articles à la conférence ACL. Les technologies associées ont également été appliquées à des applications de classe mondiale telles que Windows et Office. , Azure et Microsoft Xiaoice dans le produit.

En 2020, Zhou Ming était déterminé à rechercher une nouvelle coopération entre le monde universitaire et l'industrie. Il a donc mis fin à sa carrière de 21 ans chez Microsoft et a rejoint le Sinovation Ventures Artificial Intelligence Engineering Institute fondé par Kai-fu Lee en tant que chef. scientifique et a commencé à incuber une équipe entrepreneuriale, créant finalement Lanzhou Technology.

Selon les informations officielles, Lanzhou Technology s'appuiera sur son grand modèle linguistique similaire à la technologie sous-jacente de ChatGPT pour coopérer avec Chinese Online, qui dispose de données massives, afin de créer un ChatGPT national. On ne sait pas encore si l’équipe de Zhou Ming continuera à emprunter la voie des modèles légers ou se tournera vers la création de grands modèles de plus de 100 milliards de niveaux comme support technique.

Xianyuan Technology Zhou Bowen

En même temps, Zhou Bowen est toujours un nouvel entrepreneur. Fin 2021, il a démissionné de son poste de vice-président senior de JD.com et est parti fonder Xianyuan Technology.

Zhou Bowen

Zhou Bowen est diplômé de la classe junior de l'Université des sciences et technologies de Chine et a étudié pour son doctorat à l'Université du Colorado à Boulder. Après avoir obtenu son diplôme, il a travaillé chez IBM et a été doyen d'IBM Research Artificial Intelligence Foundations (AI Foundations), scientifique en chef d'IBM Watson Group et IBM Distinguished Engineer. En 2017, Zhou Bowen a rejoint JD.com en tant que vice-président du groupe JD.com et était responsable de la recherche sur l'IA de JD.com.

PNL, multimodalité, dialogue homme-machine, etc. sont autant de domaines dans lesquels Zhou Bowen est impliqué depuis de nombreuses années. Le mécanisme de représentation du langage naturel du mécanisme multi-têtes de fusion d'auto-attention qu'il a proposé est devenu plus tard l'une des idées centrales de l'architecture Transformer. Il a également proposé deux architectures et algorithmes de modèles de génération de langage naturel dans le domaine de l'AIGC. En 2020, il a été élu IEEE Fellow.

De l'avis de Zhou Bowen, le principal progrès de ChatGPT est l'amélioration de la collaboration humaine et de l'apprentissage interactif plutôt que l'élargissement du modèle. De plus, ChatGPT évoluera certainement vers la multimodalité à l'avenir, ce qui est exactement le collaboratif. intelligence interactive qu'il dirige. Les principales orientations de recherche du centre de recherche.

Chez Xianyuan Technology, Zhou Bowen a également mis en œuvre certaines applications AIGC, telles que l'utilisation de l'intelligence artificielle générative pour accélérer l'innovation en temps réel centrée sur les consommateurs et le marché, et l'amélioration du taux de réussite de l'innovation SKU.

Dans la région de la Grande Baie Guangdong-Hong Kong-Macao, outre le laboratoire Pengcheng et Tencent, il existe un autre grand acteur modèle, à savoir l'IDEA Research Institute (nom complet "Guangdong- Institut de recherche sur l'économie numérique de la région de la Grande Baie de Hong Kong-Macao " ", fondé en 2020 par des scientifiques de renom en IA tels que Shen Xiangyang. Le grand leader modèle de l'IDEA Research Institute est Zhang Jiaxing, qui est également un scientifique en IA issu de l'IDEA. MSRA Zhang Jiaxing

Zhang Jiaxing est diplômé du département d'électronique de l'université de Pékin avec un doctorat en 2006, étudiant sous la direction de Hou Shimin (maintenant professeur du département d'électronique de l'université de Pékin). il est d'abord resté chez Baidu pendant un certain temps, puis a rejoint l'équipe de recherche Bing de Microsoft, travaillant avec lui. Plus tard, à MSRA, Zhang Jiaxing s'est engagé dans des recherches orientées système et est passé à l'apprentissage profond en 2012. En 2014, Zhang Jiaxing a rejoint l'équipe d'Alibaba iDST (le prédécesseur de la Damo Academy), et un an plus tard, il a rejoint Ant Financial Services, dirigeant l'équipe technique NLP pour appliquer les robots conversationnels aux scénarios financiers. par Wu Haisheng, PDG de 360 Digital, pour rejoindre 360 Digital en tant que scientifique en chef, et est parti après seulement un an et demi. Sur la recommandation du doyen de la MSRA Zhou Lidong, Zhang Jiaxing a rejoint l'Institut de recherche IDEA en tant que scientifique titulaire de la chaire et est responsable du domaine cognitif. Centre de recherche en informatique et en langage naturel.

L'équipe de Zhang Jiaxing a dirigé la vague AIGC et il dirige la recherche et le développement de la série de modèles open source « Fengshenbang » et de la première version chinoise du modèle de diffusion stable. Taiyi" a été lancé l'année dernière. Après l'avènement de ChatGPT, Zhang Jiaxing a rapidement transféré la recherche et le développement de grands modèles de l'équipe vers ChatGPT à la fin de l'année dernière. Selon lui, le modèle de type ChatGPT développé par son équipe est aussi efficace que ChatGPT et ne dispose que de 5 milliards de paramètres. La vitesse de génération de texte est également très rapide. Il est actuellement en test interne et sera mis à la disposition du public dans un avenir proche. Bien que le modèle actuel de 5 milliards de paramètres fonctionne déjà très bien, Zhang Jiaxing. envisage de développer un produit de type ChatGPT soutenu par un modèle de 100 milliards et de promouvoir sa commercialisation. C'est pourquoi il se prépare actuellement à lever des fonds et à trouver un PDG

L'équipe de Zhang Jiaxing a dirigé la vague AIGC et il dirige la recherche et le développement de la série de modèles open source « Fengshenbang » et de la première version chinoise du modèle de diffusion stable. Taiyi" a été lancé l'année dernière. Après l'avènement de ChatGPT, Zhang Jiaxing a rapidement transféré la recherche et le développement de grands modèles de l'équipe vers ChatGPT à la fin de l'année dernière. Selon lui, le modèle de type ChatGPT développé par son équipe est aussi efficace que ChatGPT et ne dispose que de 5 milliards de paramètres. La vitesse de génération de texte est également très rapide. Il est actuellement en test interne et sera mis à la disposition du public dans un avenir proche. Bien que le modèle actuel de 5 milliards de paramètres fonctionne déjà très bien, Zhang Jiaxing. envisage de développer un produit de type ChatGPT soutenu par un modèle de 100 milliards et de promouvoir sa commercialisation. C'est pourquoi il se prépare actuellement à lever des fonds et à trouver un PDG

西湖Xinchen Lan Zhenzhong

Recherche également. le PDG de l'équipe est Lan Zhenzhong, le fondateur de Xihu Xinchen

.

Lan Zhenzhong

L'année dernière, le "Dream Stealer" (maintenant rebaptisé "Dream Diary") qui s'est démarqué parmi de nombreux produits de peinture IA nationaux est venu de l'équipe de Lan Zhenzhong.

Lan Zhenzhong est diplômé de l'Université Sun Yat-sen avec un baccalauréat et a étudié la vision par ordinateur à l'Université Carnegie Mellon pour son doctorat, puis s'est tourné vers le traitement du langage naturel lorsqu'il est allé travailler chez Google. Grâce aux ressources du TPU, il développe le célèbre grand modèle quantitatif lumineux « ALBERT ».

En juin 2020, Lan Zhenzhong est retournée en Chine pour rejoindre l'Université de Westlake, a fondé un laboratoire d'apprentissage profond et a commencé des recherches multimodales sur la combinaison du langage et de la vision.

S'appuyant sur les ressources de recherche scientifique de l'Université de West Lake et du « Qingyuan Club » de Zhiyuan précédemment rejoint, Lan Zhenzhong a lancé le modèle industrie-université-recherche et a fondé West Lake Xinchen. Il a d'abord développé le robot de chat de conseil psychologique « Xiaotian ». " basé sur un grand modèle , puis a lancé le produit de peinture national "Dream Stealer" dans la vague Stable Diffusion en août 2022.

Peu de temps après la sortie de ChatGPT, Xihu Xinchen a lancé un produit de génération de texte similaire "Xinchen Chat". La différence est qu'il peut accéder à Internet et est interactif multimodal. Il peut non seulement générer du texte mais également produire des images.

Comme beaucoup de personnes qui ont débuté comme universitaires puis se sont lancées dans l'entrepreneuriat, Lan Zhenzhong a également profondément ressenti que l'équipe avait besoin d'un PDG possédant une expérience en gestion et de solides capacités d'intégration des ressources pour construire la version chinoise d'OpenAI. Veuillez prêter attention à la revue de la technologie de l'IA de demain : "Lan Zhenzhong a également publié un "post de héros", la version chinoise de la société star ChatGPT recherche un PDG"

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Inscription ChatGPT

Inscription ChatGPT

Encyclopédie ChatGPT nationale gratuite

Encyclopédie ChatGPT nationale gratuite

Quelles compétences sont nécessaires pour travailler dans l'industrie PHP ?

Quelles compétences sont nécessaires pour travailler dans l'industrie PHP ?

Comment installer chatgpt sur un téléphone mobile

Comment installer chatgpt sur un téléphone mobile

Chatgpt peut-il être utilisé en Chine ?

Chatgpt peut-il être utilisé en Chine ?

Comment activer le service de stockage cloud

Comment activer le service de stockage cloud

Comment utiliser chaque fonction dans js

Comment utiliser chaque fonction dans js

Logiciel de partition de disque dur mobile

Logiciel de partition de disque dur mobile