ChatGPT a déclenché un engouement pour les grands modèles de langage. À quand le moment GPT pour un autre domaine majeur de l'IA : la vision ?

Il y a deux jours, Machine Heart a présenté les derniers résultats de recherche de Meta, Segment Anything Model (SAM). Cette recherche a suscité de larges discussions au sein de la communauté de l’IA.

Pour autant que nous le sachions, presque au même moment, l'équipe de vision de l'Institut de recherche sur la propriété intellectuelle a également lancé le modèle de segmentation générale SegGPT (Segment Everything In Context) - un modèle visuel général qui utilise des invites visuelles pour compléter tout tâche de segmentation.

SegGPT a été publié en même temps que le modèle de base de segmentation d'images Meta AI SAM. La différence entre les deux est :

Que ce soit « une touche et tout » ou « une touche et tout », cela signifie que le modèle visuel a « compris » la structure de l'image. La combinaison des capacités d'annotation fine de SAM et des capacités d'annotation de segmentation universelle de SegGPT permet d'analyser n'importe quelle image d'un tableau de pixels en une unité structurelle visuelle et de comprendre n'importe quelle scène comme la vision biologique. L'aube du GPT visuel universel est là.

SegGPT est un modèle dérivé du modèle de vision générale Intelligent Source Painter (CVPR 2023), optimisé dans le but de segmenter tous les objets. Une fois la formation SegGPT terminée, aucun réglage fin n'est requis. Fournissez simplement des exemples pour raisonner et effectuer automatiquement les tâches de segmentation correspondantes, y compris les instances, les catégories, les composants, les contours, le texte, les visages, etc. dans les images et les vidéos.

Le modèle présente les avantages et les capacités suivants :

1. Capacités générales : SegGPT a des capacités de raisonnement contextuel et le modèle peut ajuster les prédictions de manière adaptative en fonction des exemples de segmentation fournis (invite) , réaliser la segmentation de « tout », y compris les instances, catégories, composants, contours, textes, visages, images médicales, images de télédétection, etc.

2. Capacité de raisonnement flexible : prend en charge n'importe quel nombre d'invites ; prend en charge des invites optimisées pour des scénarios spécifiques ; peut être utilisé pour représenter différentes cibles afin d'obtenir un raisonnement de segmentation parallèle.

3. Capacités de segmentation et de suivi vidéo automatiques : En prenant la première image d'image et le masque d'objet correspondant comme exemple de contexte, SegGPT peut segmenter automatiquement les images vidéo suivantes et peut utiliser une couleur masquée. comme ID de l'objet pour obtenir un suivi automatique.

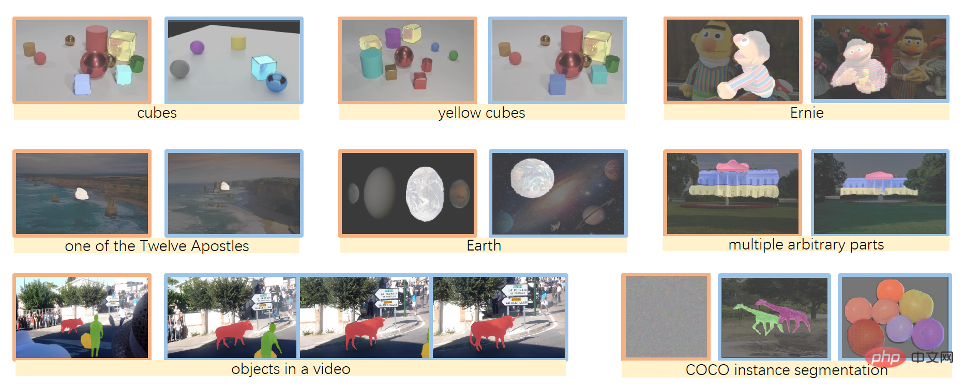

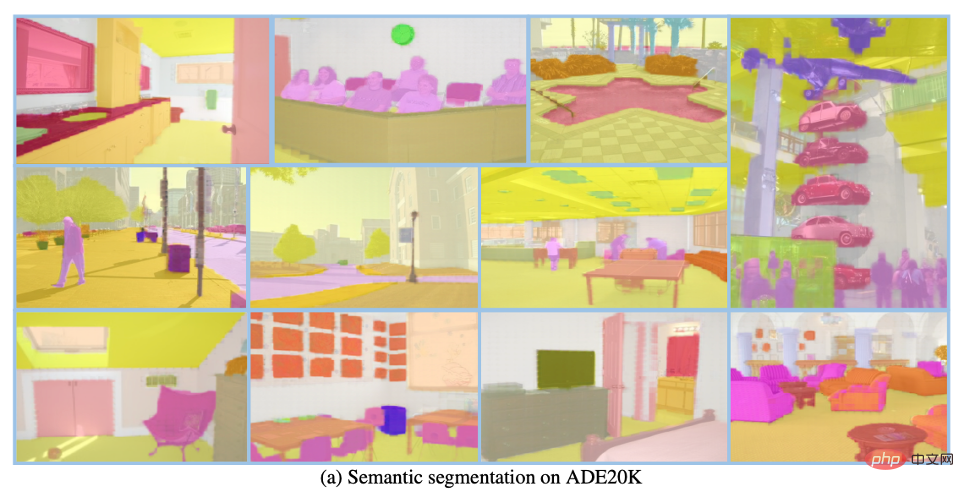

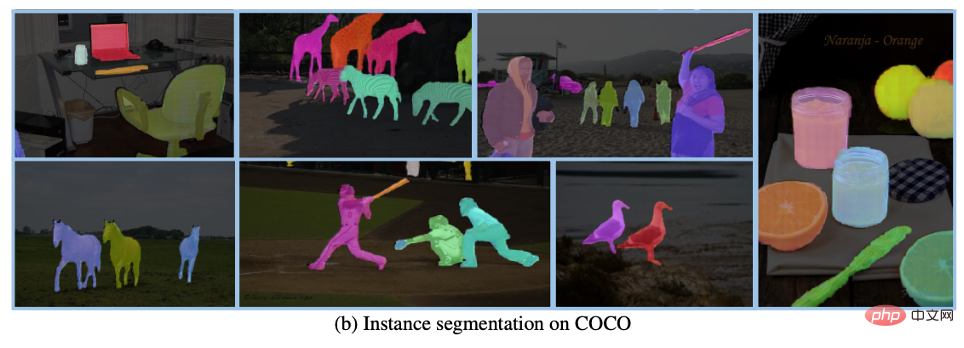

Présentation de cas1. Les auteurs ont évalué SegGPT sur un large éventail de tâches, notamment la segmentation sémantique en quelques plans, la segmentation d'objets vidéo, la segmentation sémantique et la segmentation panoramique. La figure ci-dessous montre spécifiquement les résultats de segmentation de SegGPT sur les instances, les catégories, les composants, les contours, le texte et les objets de forme arbitraire.

2. Marquez l'arc-en-ciel sur une image (image ci-dessus) et divisez les arcs-en-ciel dans d'autres images par lots (image ci-dessous)

3. Utilisez un pinceau pour encercler grossièrement le. ceinture d'anneaux planétaires (image du haut) et affichez avec précision la ceinture d'anneaux planétaires dans l'image cible (image du bas) dans la carte de prédiction.

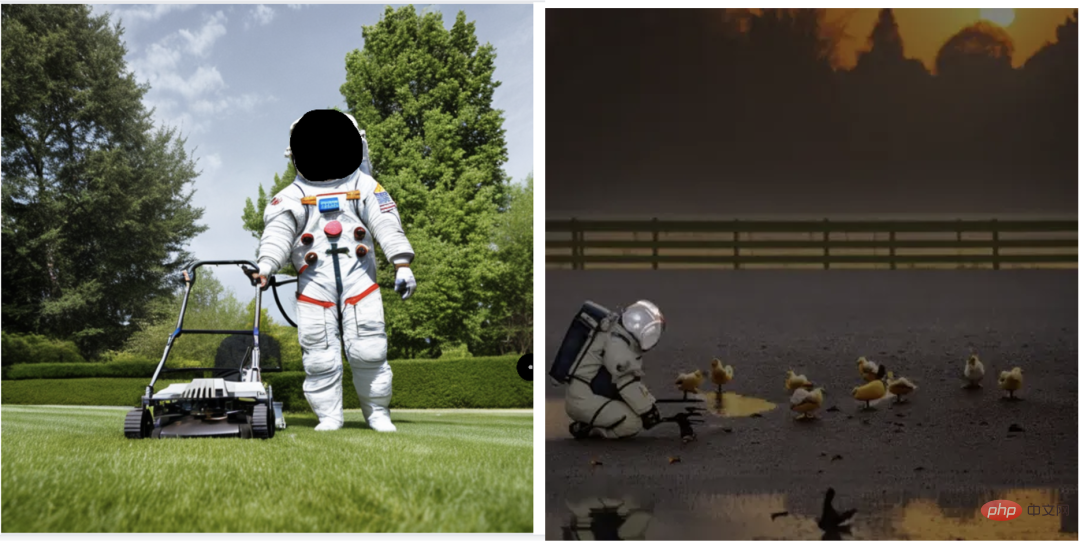

4. SegGPT peut prédire la zone du casque d'astronaute correspondante dans la nouvelle image (à droite) en fonction du contexte du masque du casque d'astronaute fourni par l'utilisateur (image de gauche) .

SegGPT unifie différentes tâches de segmentation dans un cadre d'apprentissage de contexte commun, unifiant diverses formes de données en convertissant diverses données de segmentation en images du même format.

Plus précisément, la formation de SegGPT est définie comme un problème de coloration contextuelle, avec un mappage de couleurs aléatoire pour chaque échantillon de données. L'objectif est d'accomplir une variété de tâches en fonction du contexte, plutôt que de s'appuyer sur des couleurs spécifiques. Après la formation, SegGPT peut effectuer des tâches de segmentation arbitraires dans des images ou des vidéos grâce à un raisonnement contextuel, tel que des instances, des catégories, des composants, des contours, du texte, etc.

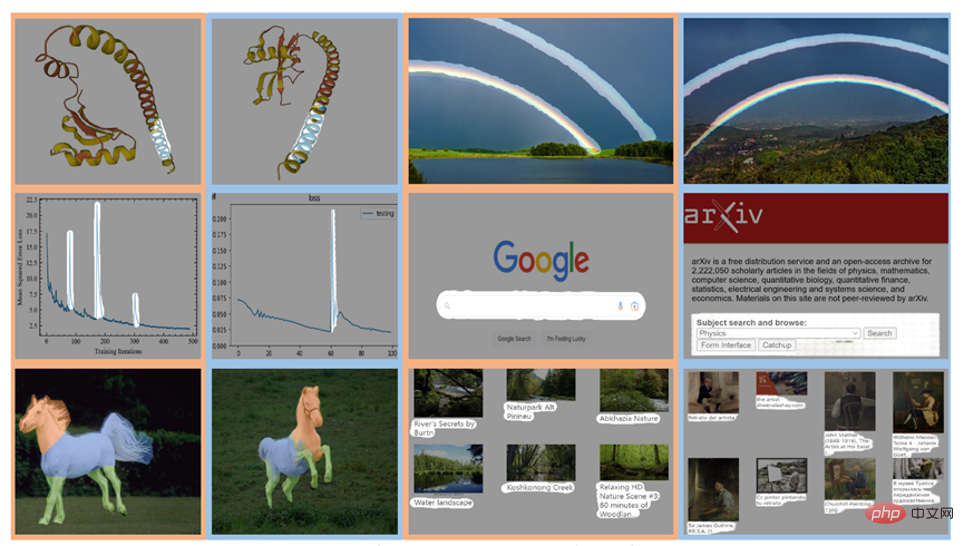

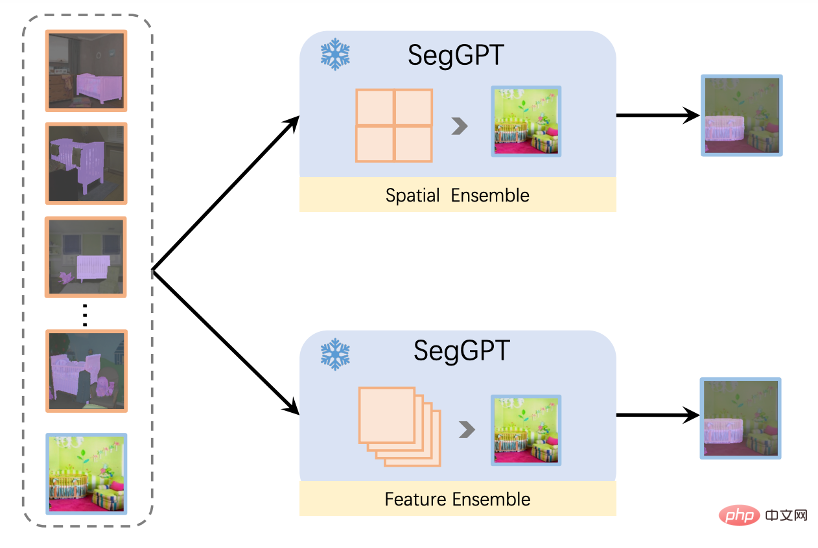

Comment débloquer diverses capacités grâce à des techniques de test est l'un des points forts du modèle universel. Le document SegGPT propose plusieurs technologies pour débloquer et améliorer diverses capacités de segmentation, telles que les différentes méthodes d'ensemble de contexte présentées dans la figure ci-dessous. La méthode Feature Ensemble proposée peut prendre en charge un certain nombre d’exemples rapides pour obtenir un effet de raisonnement convivial.

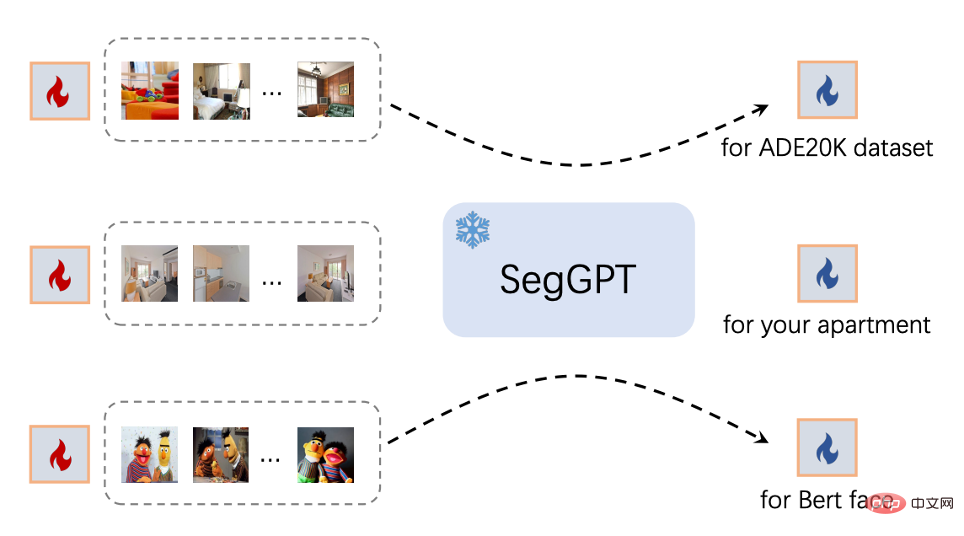

De plus, SegGPT prend également en charge des invites dédiées optimisées pour des scénarios spécifiques. Pour les scénarios d'utilisation ciblés, SegGPT peut obtenir les invites correspondantes via un réglage des invites sans mettre à jour les paramètres du modèle pour s'adapter à des scénarios spécifiques. Par exemple, créez automatiquement une invite correspondante pour un certain ensemble de données ou créez une invite dédiée pour une pièce. Comme le montre la figure ci-dessous :

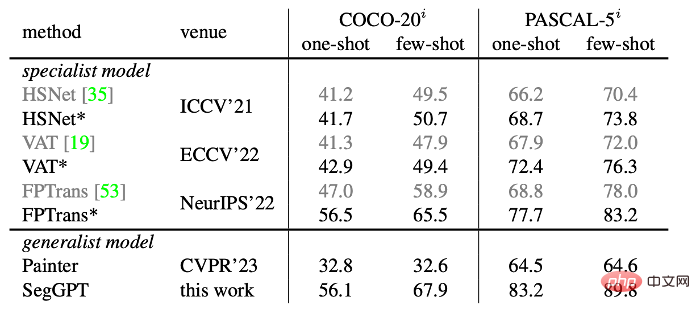

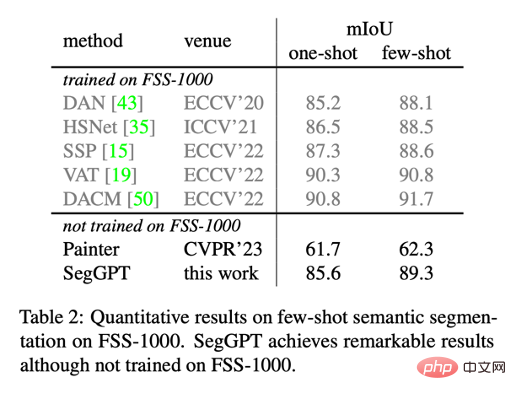

Le modèle ne nécessite que quelques exemples rapides et atteint des performances optimales sur les ensembles de données COCO et PASCAL. SegGPT présente de solides capacités de transfert de scène sans prise de vue, telles que l'obtention de performances de pointe sur l'ensemble de tests de segmentation sémantique en quelques prises de vue FSS-1000 sans formation.

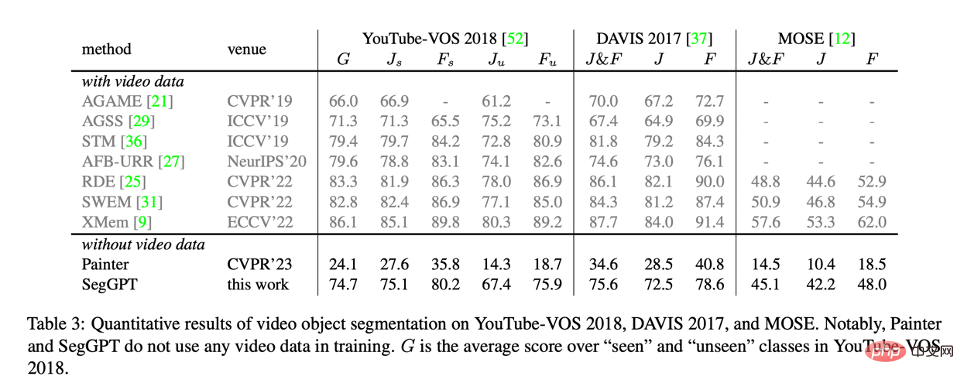

Sans données de formation vidéo, SegGPT peut effectuer directement la segmentation d'objets vidéo et atteindre des performances comparables aux modèles spécifiquement optimisés pour la segmentation d'objets vidéo.

Ce qui suit est une démonstration de l'effet de l'invite optimisée sur les tâches de segmentation sémantique et de segmentation d'instance :

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Pourquoi Webstorm ne peut pas exécuter le fichier

Pourquoi Webstorm ne peut pas exécuter le fichier

Comment lire les données de contrôle de macro en javascript

Comment lire les données de contrôle de macro en javascript

Quelle est la fonction du Huawei NFC ?

Quelle est la fonction du Huawei NFC ?

Comment créer du HTML avec Webstorm

Comment créer du HTML avec Webstorm

js obtient l'heure actuelle

js obtient l'heure actuelle

La différence entre serveur et hôte cloud

La différence entre serveur et hôte cloud

Explication détaillée de la commande Linux dd

Explication détaillée de la commande Linux dd

Index MySQL

Index MySQL