Bien que « piloté par les données » ait longtemps été le consensus de base de l'industrie de la conduite autonome, en fait, jusqu'à présent, les algorithmes d'apprentissage profond basés sur les données sont encore principalement utilisés dans le module de perception, mais rarement utilisés dans la régulation et le contrôle

Obtenir au sujet de l'article Avant, nous devons expliquer brièvement ce qu'est la « réglementation » mentionnée dans cet article.

Je crois que tout le monde dans l'industrie de la conduite autonome doit connaître les principaux modules de perception, de positionnement, de prise de décision, de planification et de contrôle. Bien que tout le monde fasse de telles distinctions dans la communication quotidienne, ce serait un peu un problème s'ils le faisaient. encore classés de cette manière dans des travaux spécifiques.

Le problème ici réside dans la prise de décision. D'une manière générale, la prise de décision inclut la prédiction, et la division de la prédiction est très délicate - la prédiction elle-même est étroitement liée à la perception, mais la prédiction est l'étape préalable à la prise de décision. -la création ne peut être faite qu'après prédiction.

Nous pouvons appeler tous les faits établis qui se sont déjà produits T0+, et la perception est constituée des faits établis qui se sont déjà produits. Par exemple, la manière dont le véhicule devrait se déplacer dans le futur et ce que les autres pourraient faire sont autant de choses qui se produiront dans le futur. Nous pouvons l'appeler T0-.

Il y a un avantage à utiliser T0 comme tournant : le lien de perception n'a besoin de se soucier que des faits établis qui se sont produits sur la route, et toutes les inférences basées sur ces faits établis peuvent être directement intégrées dans la partie prise de décision.

Une telle classification peut combiner plus étroitement les résultats de la prédiction avec la partie prise de décision, « affaiblissant » ainsi artificiellement la relation entre prédiction et perception, et « renforçant » la relation entre prédiction et prise de décision. Reflétée dans le travail réel, cette division permet de mieux déterminer ce qui doit être prédit et comment mieux utiliser les résultats des prédictions pour servir la prise de décision. (Le contenu ci-dessus est résumé par l'auteur après avoir communiqué avec le Dr Yang Wenli, PDG de Leadjun Technology)

Sur la base de la logique ci-dessus, les entreprises de conduite autonome ont généralement un groupe PNC, et la tâche principale du groupe PNC est d'être responsable du travail réglementaire. Après que tout le monde ait travaillé pendant une longue période dans le groupe PNC, ils feront collectivement référence à la prévision, à la prise de décision, à la planification et au contrôle sous le nom de « régulation et contrôle ».

Ensuite, cette « régulation et contrôle » est ce qu'on appelle « régulation et contrôle » dans cet article.

Ensuite, combinons « data-driven » et « régulation et contrôle ».

Bien que « piloté par les données » soit depuis longtemps devenu le consensus de base de l'industrie de la conduite autonome, en fait, jusqu'à présent, les algorithmes d'apprentissage profond basés sur les données sont encore principalement utilisés dans le module de perception, mais sont rarement utilisés dans la régulation et le contrôle - Actuellement, les algorithmes liés à la réglementation dans l'industrie sont principalement fondés sur des règles.

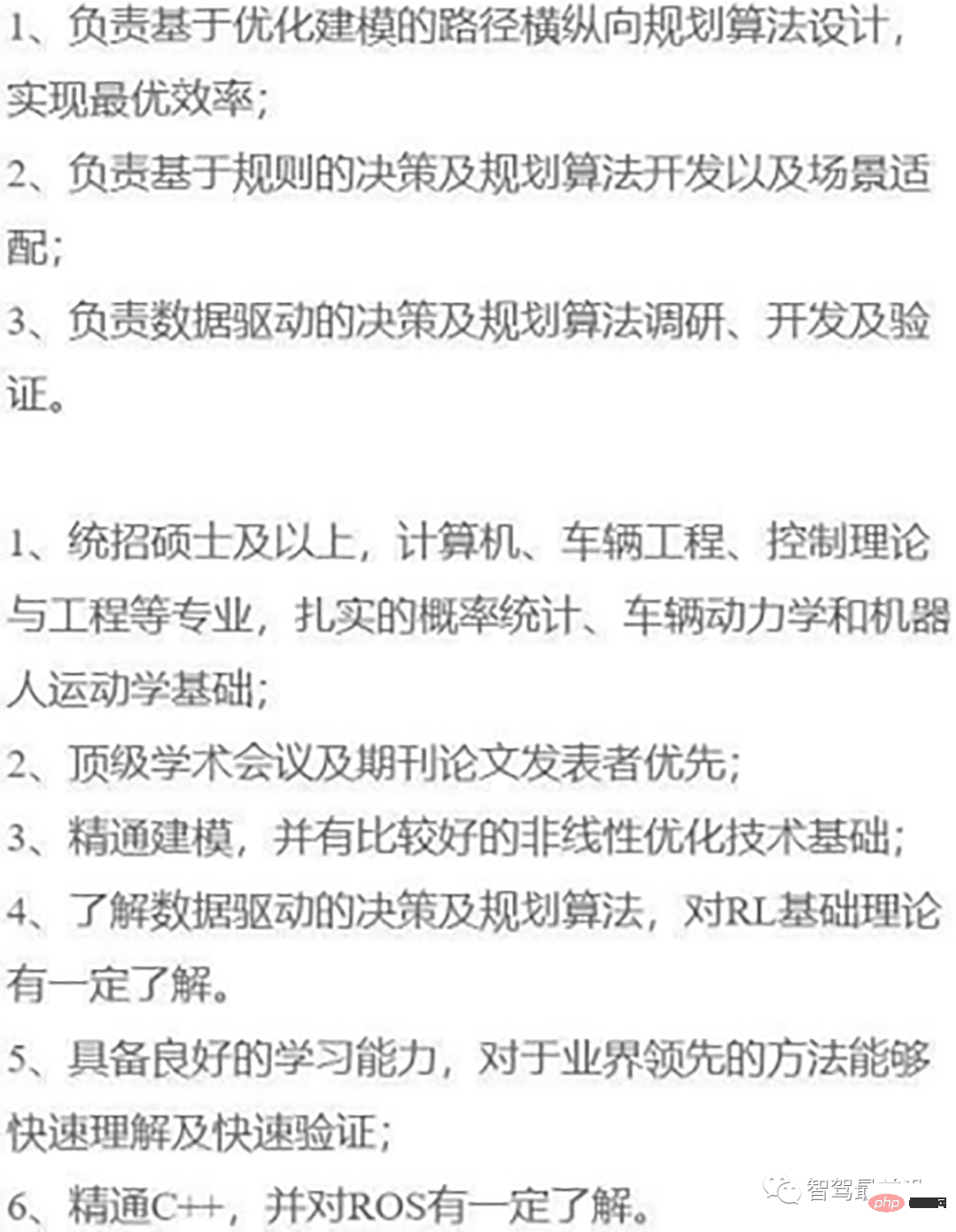

Bien que les informations actuellement publiées sur les algorithmes de contrôle de la conduite autonome concernent principalement les algorithmes basés sur des règles, lorsque j'ouvre le logiciel de recrutement, je constate souvent que lorsque les entreprises de conduite autonome recrutent des ingénieurs en algorithmes de contrôle, elles exigent que les candidats comprennent les algorithmes d'apprentissage en profondeur. Dans une certaine mesure, cela montre également que de nombreuses entreprises « marchent » actuellement vers des algorithmes de prise de décision hybrides.

L'image vient des exigences de recrutement d'une entreprise de conduite autonome

Il existe actuellement peu d'articles qui expliquent de manière complète et détaillée l'application des algorithmes d'apprentissage profond dans le contrôle de la conduite autonome. Par conséquent, cet article discutera des limites des règles et des avantages potentiels des algorithmes d'apprentissage profond, pourquoi les algorithmes d'apprentissage profond ne peuvent pas encore être appliqués aux algorithmes de contrôle à grande échelle à ce stade, et si les futurs algorithmes de contrôle seront basés sur des règles ou sur l'apprentissage profond. . Développons trois aspects.

1 Les algorithmes basés sur des règles ont des limites

À l'heure actuelle, les algorithmes liés à la réglementation sont principalement basés sur des règles, mais avec l'amélioration et l'application des niveaux de conduite autonome. À mesure que les scénarios continuent de se développer, les algorithmes de contrôle basés sur des règles exposeront leurs limites dans les tests réels.

Les lacunes des algorithmes de régulation et de contrôle basés sur des règles sont exposées principalement dans les trois catégories de cas extrêmes : les scénarios non déterministes, les scénarios d'interaction forte et les scénarios fortement subjectifs :

(1) Scénarios non déterministes

Les scénarios non déterministes sont relatifs aux scénarios déterministes. Le scénario déterministe le plus simple consiste à s'arrêter à un feu rouge et à partir lorsque le feu vert est allumé. Vous pouvez changer de voie sur la ligne pointillée blanche, mais vous ne pouvez pas changer de voie sur la ligne continue blanche. que ce type de scène, on peut le considérer comme un « scénario non déterministe ».

Par exemple, dans la plupart des cas, les voitures circulent sur des routes avec des lignes de voie, mais dans un cas, la route actuelle est composée de trois routes principales plus une route auxiliaire, et il n'y a que des lignes de voie et aucune ceinture verte entre les routes auxiliaires et la route auxiliaire. route principale, ce qui signifie que les véhicules sur la route auxiliaire peuvent fusionner avec la route principale en toutes circonstances. Il s'agit d'un scénario non déterministe typique. Parce que la plupart des conducteurs ne se soucient pas du tout des lignes pleines et pointillées, vous ne savez pas quand une voiture apparaîtra soudainement autour de vous et quelle est la probabilité qu'elle change directement de voie.

Les trajectoires des autres véhicules sur la route étant probabilistes, les algorithmes basés sur des règles sont difficiles à gérer.

(2) Scène d'interaction forte

La scène la plus typique est l'intersection. Les itinéraires de plusieurs objets dans une scène vont interagir et s'influencer mutuellement, il y a donc un certain jeu dans l'interaction.

Dans une scène routière très complexe, prévoir constamment les voitures environnantes puis ajuster le plan en fonction des résultats de l'interaction ne peut pas être clairement décrit par les règles humaines.

(3) Scène subjective forte

En termes simples, dans différentes conditions routières, les gens ajusteront inconsciemment la distance entre leur propre voiture et la voiture qui les précède en fonction de l'environnement. Parce qu'il peut y avoir un ensemble de règles qui régissent le cerveau humain, mais ces règles sont très abstraites et ne peuvent pas être claires. Elles ne peuvent comprendre que l'ineffable, comme le timing des changements de voie, les réactions aux autres véhicules aux intersections, etc.

Dans certains scénarios, bien que les algorithmes de règles puissent être utilisés pour imiter certains comportements et styles de conduite des propriétaires de voitures, les habitudes subjectives humaines sont difficiles à résoudre à l'aide de règles, et même si elles peuvent être résolues, cela nécessitera beaucoup de main-d'œuvre.

En utilisant des algorithmes basés sur des règles pour traiter les cas extrêmes, la partie la plus difficile est l'étape de prédiction. Parce qu'en plus de prédire la trajectoire de son propre véhicule, les véhicules autonomes doivent également prédire les trajectoires des « autres usagers de la route », et il y a souvent plus d'un « autre usager de la route » sur la route, et ils interagiront les uns avec les autres, il est donc difficile de prédire leur trajectoire.

Lors de leurs prédictions, les conducteurs humains prendront des décisions basées sur « l'expérience » et « l'intuition » en observant la trajectoire historique de la voiture et le style de conduite du conducteur, c'est-à-dire qu'ils pourront choisir la stratégie de leur propre voiture en fonction du fait que d'autres véhicules le soient. conservateur Cependant, il est difficile pour les algorithmes basés sur des règles d'obtenir des effets de prédiction similaires à ceux des humains.

De plus, lorsque le véhicule rencontre des virages et doit freiner, il est difficile pour le système de contrôle basé sur des règles de garantir que la courbe est fluide à tout moment.

Par exemple, s'il y a devant vous une voiture qui roule à très basse vitesse et que le système de conduite autonome émet une instruction de "changer de voie à droite pour dépasser", mais juste à mi-chemin du changement de voie, tout à coup, il y a une voiture à côté de vous qui tourne à droite. Lors d'un dépassement sur la voie latérale à grande vitesse, le système de prise de décision annule immédiatement la décision de changement de voie et régénère une courbe douce pour permettre au véhicule de revenir à l'original. voie.

La difficulté ici est de savoir comment équilibrer des éléments tels que le confort, la sécurité, l'efficacité et la réalisabilité du modèle de puissance, et garantir que le chemin de planification de trajectoire généré à ce moment est fluide ?

En prenant toujours l'exemple ci-dessus comme exemple, si le chemin généré à ce moment ne peut pas être garanti comme étant fluide, alors le véhicule conduira très "dur" et deviendra très inconfortable pendant la conduite. Si le conducteur/passager peut voir une urgence se produire autour de lui à ce moment-là et que le système l'aide à éviter l'accident à temps, il pensera que le système est très fiable. Même s'il freine brusquement, le passager pensera que le système est automatique. système de conduite "m'a aidé à éviter un ACCIDENT".

Mais la réalité est que dans la plupart des cas, le système a déjà découvert le problème et pris une décision, directement « le tuer dans l'œuf ». Mais le problème est que la plupart des conducteurs/passagers ne sauront pas qu'un changement de voie « en apparence ordinaire » a simplement « presque provoqué un accident », et ils ne remarqueront peut-être même pas qu'il y a une voiture qui arrive par derrière. Par conséquent, si le système de contrôle ne peut pas générer une courbe douce à ce moment-là, le conducteur/passager pensera non seulement que le système « m'a aidé à éviter un accident », mais reprochera au système d'être « trop rigide » et de « se balancer ». en changeant de voie.

Bien que ce type de problème puisse également être résolu à l'aide d'algorithmes basés sur des règles, le processus de résolution est très fastidieux.

De plus, bien qu'en théorie certains scénarios à longue traîne puissent également être résolus avec des algorithmes basés sur des règles, dans la réalité, il est difficile pour les ingénieurs de garantir que ces codes complexes peuvent résoudre le problème sans utiliser trop de ressources informatiques. . Ces codes peuvent être facilement exécutés sur un système hors ligne, mais une fois dans la voiture, la puce embarquée peut-elle supporter une consommation aussi énorme de puissance de calcul ? La résolution de ces problèmes met grandement à l’épreuve le niveau de codage et les capacités d’ingénierie des ingénieurs.

De plus, certains ingénieurs ont peut-être écrit des milliers de lignes de code et ont oublié ce qu'ils ont écrit. Il y a de plus en plus de règles et une logique de plus en plus confuse. Lorsqu'une nouvelle exigence est ajoutée à un moment donné dans le « futur », le système deviendra difficile à maintenir.

2. Les algorithmes d'apprentissage en profondeur peuvent améliorer l'anthropomorphisme du système dans des scénarios appropriés

Les nombreuses limitations mentionnées ci-dessus des algorithmes de règles, mais en fait, les limites des algorithmes de règles vont au-delà de cela. Si nous examinons tous les problèmes ensemble, nous pouvons les appeler collectivement le « faible anthropomorphisme » des algorithmes de règles.

Le soi-disant anthropomorphisme fait référence au fait que le système ressemble à un « vieux conducteur » pendant la conduite. Un expert en algorithmes de contrôle de Hao Mo Zhixing a déclaré : « La capacité principale du conducteur vétéran anthropomorphe est de s'adapter aux changements, et l'utilisation d'un système basé sur des règles nécessite de définir de nombreuses règles pour distinguer les scénarios et de définir un grand nombre de paramètres environnementaux. et les fonctions de coût. La recherche constante de la solution optimale est difficile à réaliser mathématiquement en temps réel. "

Actuellement, les véhicules autonomes qui peuvent être testés sur route s'apparentent dans la plupart des cas davantage à des "conducteurs novices" et à des "conducteurs expérimentés". " sont différents des " conducteurs novices ". " La plus grande différence est que les " conducteurs expérimentés " ont de plus fortes capacités prédictives et sont mieux à même de s'adapter aux scénarios à longue traîne.

Comparé entre les deux, bien que la plupart des « conducteurs novices » soient également très sûrs, les « conducteurs novices » seront « idiots » lorsqu'ils conduisent sur la route, tandis que les « conducteurs expérimentés » peuvent fonctionner plus facilement tout en assurant la sécurité et une plus grande efficacité. Cette différence est appelée « expérience de libération conditionnelle ».

Essentiellement, les « conducteurs novices » s'appuient davantage sur le « matériel pédagogique des écoles de conduite » sur la route, et leurs méthodes de prise de décision et de planification ressemblent davantage à des algorithmes de règles, tandis que les « conducteurs expérimentés » s'appuient sur l'expérience et jugement subjectif lors de la prise de décision. La méthode de prise de décision et de planification est relativement abstraite et ressemble davantage à un « algorithme d'apprentissage en profondeur ».

En résumé, en introduisant des algorithmes d'apprentissage profond dans le processus de régulation et de contrôle, en apprenant autant que possible de l'expérience des conducteurs humains et en affinant automatiquement les caractéristiques pour trouver des modèles, « l'anthropomorphisme » de l'algorithme de régulation et de contrôle peut être amélioré.

Le moteur de données mentionné par Tesla lors de cet AI Day améliorera la certitude en saisissant des données dans des réseaux de neurones pour mieux résoudre les problèmes de prédiction du monde réel.

Le responsable de l'algorithme de planification et de contrôle de Qingzhou Zhihang estime que la prédiction (juger des trajectoires futures d'autres véhicules) est la première étape la plus appropriée pour appliquer des algorithmes d'apprentissage profond à grande échelle. Il a déclaré : « L'algorithme de prédiction de Qingzhou Zhihang utilise l'apprentissage profond. »

Plus précisément en termes de scénarios, il estime que les scénarios qui dépendent fortement du jugement subjectif humain doivent être guidés par des algorithmes d'apprentissage profond.

« Par exemple, vous pouvez utiliser des modèles d'IA de classification traditionnels (qui peuvent être des modèles de classification d'apprentissage profond ou d'apprentissage automatique traditionnels) pour la prise de décision, utiliser l'apprentissage profond pour la génération de trajectoires afin de guider la planification du chemin et utiliser l'apprentissage par renforcement de bout en bout. pour donner L'action actuelle qui devrait être effectuée pour guider la planification du mouvement (planification finale de la trajectoire) »

Cet expert estime également que les scènes structurées à grande vitesse peuvent être plus faciles à résoudre par les algorithmes traditionnels, tandis que les scènes urbaines non structurées peuvent avoir des problèmes spatiaux plus importants. tire parti des modèles d’IA.

Zhitu utilise des algorithmes d'apprentissage par renforcement dans le processus décisionnel des scénarios d'intersection de rampes à grande vitesse.

Le Dr Yang Wenli, PDG de Lingjun Technology, estime que l'importance et l'applicabilité des algorithmes d'apprentissage profond ne sont pas exactement les mêmes dans les différents modules de conduite autonome.

« Dans le processus de perception-fusion-prédiction-décision-planification-contrôle, plus la partie est précoce, meilleur est l'effet de l'algorithme d'apprentissage profond. "

Le Dr Yang Wenli a déclaré : "Le système de perception a un large impact. quantité de traitement de données. Cependant, les erreurs sont autorisées et il existe une certaine tolérance en matière d'exactitude et de rappel (car la fusion et la prise de décision ultérieures peuvent corriger les erreurs de perception), donc la méthode d'apprentissage en profondeur est plus adaptée

"Dans la prise de décision. En partie, les règles et l'apprentissage ont chacun leurs propres atouts, nous utilisons donc une architecture hybride qui utilise des méthodes d'apprentissage en profondeur pour améliorer les performances et des méthodes de règles pour garantir la sécurité.

« Le système de contrôle a une petite quantité de données, des exigences élevées en matière de fiabilité et absolument aucune marge d'erreur. Cependant, l'utilisation d'algorithmes d'apprentissage en profondeur non seulement ne peut pas améliorer les performances, mais peut également introduire des incertitudes et des facteurs peu fiables, ce n'est donc pas le cas. "

De plus, en cas d'erreurs de planification, la preuve mathématique est parfaite. algorithme, l'algorithme de contrôle doit également être sûr. Dans le PID de l'algorithme de contrôle classique, afin d'assurer la sécurité, la couche de contrôle peut refuser d'exécuter les « mauvaises instructions » émises par la couche de planification. Par exemple, si le plan donne une instruction pour conduire le véhicule à 120 km/h, mais que le matériel du véhicule ne peut pas prendre en charge la vitesse de 120 km/h, à ce moment-là, l'algorithme de contrôle peut effectuer une vérification et refuser directement d'exécuter. l'instruction pour s'assurer que le véhicule peut fonctionner normalement sans se renverser.

Si l'algorithme de contrôle veut couvrir toutes les erreurs, il doit utiliser un algorithme basé sur des règles pour garantir la fiabilité.

Sur cette base, lorsqu'il s'agit de « les algorithmes d'apprentissage profond sont appliqués à la régulation et au contrôle », ce que tout le monde appelle « régulation et contrôle » fait en fait principalement référence à la prédiction, à la prise de décision et à la planification, et n'inclut pas le contrôle.

En plus de résoudre des problèmes techniques pratiques, les algorithmes d'apprentissage en profondeur présentent également un énorme avantage incontournable, celui d'utiliser pleinement les processeurs dédiés au GPU ou au réseau neuronal pour réduire la consommation d'énergie de calcul du CPU.

Afin de réaliser certaines fonctions, les codes de règles complexes utilisés dans les premières étapes du développement de la conduite autonome consommeront beaucoup de puissance de calcul du processeur. Cependant, la conception des puces embarquées tend généralement à augmenter la puissance de calcul de l'apprentissage profond. , et la puissance de calcul de la partie CPU est limitée. Les ingénieurs doivent trouver des moyens d'économiser . En remplaçant un grand nombre d’algorithmes complexes basés sur des règles par des algorithmes d’apprentissage en profondeur, une grande quantité de puissance de calcul du processeur peut être économisée.

Les experts en algorithmes de planification et de contrôle de Qingzhou Zhihang estiment que les véhicules urbains de production de masse NOA utilisent généralement des puces intégrées et que les processeurs sont basés sur l'architecture ARM. Les ressources de puissance de calcul du processeur ne peuvent donc pas être comparées aux véhicules de démonstration L4 basés sur l'architecture X86. vous voulez Pour obtenir une expérience de conduite proche du L4, il est nécessaire que les fournisseurs essaient d'introduire des algorithmes d'apprentissage profond dans le processus de régulation et de contrôle et de placer la charge de calcul sur des processeurs dédiés au deep learning.

Puisque les algorithmes d'apprentissage profond semblent si "cool", pourquoi les algorithmes de régulation et de contrôle dans la pratique sont-ils toujours basés sur des règles plutôt que sur l'apprentissage profond ? Et les algorithmes ?

C'est parce que l'algorithme d'apprentissage profond présente également de nombreuses lacunes. Ce sont ces lacunes qui rendent l'algorithme d'apprentissage profond moins efficace que les règles à court terme.

1. Il est difficile de juger si le comportement de conduite des conducteurs humains « vaut la peine d'être appris »

Dans un monde idéal, plus les données utilisées pour la formation sont nombreuses, plus l'algorithme d'apprentissage profond fonctionnera, mais dans certains cas , à mesure que la quantité de données augmente, l'effet de l'algorithme peut diminuer. Pourquoi est-ce ?

Les algorithmes d'apprentissage profond doivent d'abord apprendre les comportements de conduite d'un grand nombre de conducteurs humains avant de pouvoir être appliqués aux algorithmes de contrôle. Cependant, le problème est que différents conducteurs ont des styles de conduite différents, et le style de conduite du même conducteur dans différentes situations ne l'est pas. Cohérent, alors comment s'assurer que le comportement de conduite des conducteurs humains est de bonnes données qui méritent d'être apprises ?

Par exemple, lors d'un changement de voie aux intersections, nous ne pouvons pas appuyer sur la ligne continue pour changer de voie lorsque nous conduisons normalement, mais de nombreux conducteurs aiment souvent changer de voie en appuyant sur la ligne continue. L'expert en algorithmes de contrôle de

Pony.ai a déclaré : « Les conducteurs humains ont également de nombreuses mauvaises habitudes lorsqu'ils conduisent. Si vous poursuivez aveuglément l'anthropomorphisme et ignorez les trois principaux objectifs d'optimisation du système de conduite autonome : la sécurité, le confort et l'efficacité, alors vous mettez la charrue avant les boeufs. En fait, même si les modèles d'IA sont utilisés pour combler les lacunes des algorithmes traditionnels, ils devraient être améliorés autour de ces trois dimensions "

Par conséquent, dans de nombreux cas, les données ne peuvent être que ". nettoyé" à l'avance. Ce n'est que lorsque l'algorithme d'apprentissage sera efficace qu'il sera meilleur. Cependant, comment garantir l’efficacité et la qualité d’un nettoyage des données en temps réel à grande échelle ? C'est un problème.

En réponse à ce problème, certaines entreprises ont fixé artificiellement certaines règles pour évaluer si le conducteur conduit bien ou non, puis filtrer celles qui semblent mauvaises, mais il s'agit d'utiliser des règles pour ""Contraindre" l'apprentissage en profondeur ; de plus , cette approche est trop simple et grossière, et peut consister à « jeter le bébé avec l'eau du bain » et à supprimer accidentellement certaines données utiles sur le comportement de conduite.

2. Les algorithmes d'apprentissage profond sont plus difficiles à faire face aux changements de demande que les règles

L'algorithme d'une certaine entreprise de conduite autonome stipule que la distance de sécurité par rapport au véhicule qui précède ne doit pas être inférieure à cinq mètres lors de la conduite sur le véhicule. route. Un jour, le chef de produit a proposé une nouvelle exigence : lors d'une conduite normale sur route, la distance de sécurité avec le véhicule qui précède doit passer d'au moins cinq mètres à au moins dix mètres.

Cette situation exposera un problème des algorithmes d'apprentissage profond : si les ingénieurs veulent modifier le modèle en fonction des besoins, ils doivent recycler le modèle, ce qui est très coûteux. Mais si vous utilisez un algorithme basé sur des règles, c'est très simple pour le moment et le problème peut être résolu avec quelques lignes de code.

Et, si un accident survient, il est difficile pour l'algorithme d'apprentissage profond de découvrir rapidement où se situe le problème dans les plus brefs délais comme l'algorithme de règles.

3. L'effet de l'algorithme d'apprentissage en profondeur peut ne pas être aussi bon que les règles

L'expert en algorithme de contrôle de Qingzhou Zhihang a déclaré : Si le modèle d'IA est introduit lorsque l'infrastructure de données est imparfaite, les performances de l'IA Le modèle sera difficile à répondre aux attentes.

Par exemple, la distance de suivi de l'ACC peut être déterminée grâce à un simple test d'étalonnage, mais il peut être difficile d'obtenir le même effet grâce à un modèle d'IA. La raison principale est que l'infrastructure de données de nombreuses entreprises est imparfaite et qu'il n'existe aucun moyen de trouver des données diverses dans différents scénarios de suivi de voiture, ce qui rend difficile la formation d'un modèle qui respecte ou dépasse les performances des règles.

L'expert en algorithmes de contrôle de Haomo Zhixing a également déclaré : « L'effet actuel du modèle d'IA n'a pas complètement vaincu les règles. Il essaie de personnifier les gens, mais l'effet n'est pas assez bon, car l'architecture du modèle, les définitions d'entrée et de sortie et la préparation des données "Ce type de réseau cognitif est encore incomplet. Ce n'est pas complètement fait, et cela n'a pas atteint le niveau d'un modèle perceptuel. Tout le monde est encore en train d'explorer (mais je pense qu'il y aura une avancée majeure d'ici un an"

). 4. Les algorithmes d'apprentissage profond ont encore besoin de règles pour comprendre

Lorsqu'un véhicule est sur la route, les erreurs dans l'algorithme de prise de décision ne peuvent pas être complètement évitées. Car même si une personne conduit, quel que soit le niveau de conduite d'un conducteur expérimenté, il est impossible de garantir que sa prise de décision sera toujours tout à fait correcte, et il en va de même pour les algorithmes de prise de décision basés sur des modèles d'apprentissage profond.

Par conséquent, lors de la conception du système, les développeurs doivent considérer la possibilité que « l'algorithme de prise de décision fasse des erreurs » et être « psychologiquement préparés » à « accepter » le fait potentiel que l'algorithme de prise de décision fasse des erreurs.

À cet égard, Lingjun Technology adopte une architecture de prise de décision hybride. Le PDG de l'entreprise, le Dr Yang Wenli, a déclaré que « les algorithmes d'apprentissage en profondeur sont principalement utilisés pour améliorer les performances car ils sont efficaces pour apprendre de l'expérience de conduite humaine et des règles conçues. par les programmeurs ont été Ceux qui ont été entièrement testés et démontrés sont utilisés pour garantir la sécurité et ont une priorité plus élevée. » En regardant plus bas, la couche de planification peut également rejeter les « mauvaises instructions » de la prise de décision. Par exemple, la vitesse d'entrée et la taille des obstacles doivent être dans une certaine plage (par exemple, il ne peut pas y avoir une voiture avec une vitesse de 100 m/s comme « décoller ») ; un autre exemple est que la couche de prise de décision donne la valeur ; instruction "changer de voie à gauche", mais ceci Lorsqu'il y a des voitures à gauche, parce qu'il n'y a pas de solution complète à la planification de l'espace lors du changement de voie à ce moment, la planification peut directement "refuser d'exécuter l'instruction".

L'algorithme de planification mentionné ici qui rejette les « mauvaises instructions » du lien précédent ne peut être basé que sur des règles.

Sur la base de ce qui précède, nous pouvons voir que dans les scénarios où des algorithmes d'apprentissage profond peuvent être utilisés, les règles pour jouer le rôle de « dissimulation » sont toujours essentielles.

5. L'introduction d'algorithmes d'apprentissage profond signifie qu'une grande quantité de code doit être remplacéeIl existe également un problème très difficile pour les entreprises de conduite autonome : si vous souhaitez utiliser un algorithme de contrôle hybride, vous le ferez inévitablement faire face au problème d'une grande quantité de code devant être remplacé, et cela nécessitera inévitablement « d'empiler des personnes ».

Les experts en algorithmes de contrôle de Qingzhou ont déclaré que les systèmes traditionnels basés sur des règles n'envisageaient pas l'ajout d'interfaces liées à l'apprentissage profond lors de la conception, et que la base de code a été relativement solidifiée après des années de développement. La refactorisation du code pour introduire l'apprentissage profond est très coûteuse

. « Cependant, Qingzhou Zhihang a pris en compte l'utilisation généralisée de l'IA lorsqu'elle a commencé à construire la pile d'algorithmes de planification décisionnelle en 2019, et a examiné à l'avance la situation après l'introduction du modèle à chaque niveau d'interface et a procédé à des ajustements architecturaux ciblés. "

Selon un expert senior qui a autrefois été responsable de l'algorithme de régulation dans une entreprise leader de Robotaxi, après l'introduction de l'apprentissage profond dans la régulation, la charge de travail de réécriture de code est très importante, car elle implique en ligne, hors ligne, simulation, etc. transformation d'un système.

L'auteur a entendu à plusieurs reprises des plaintes d'utilisateurs de l'industrie Internet, expliquant pourquoi les programmeurs d'un certain logiciel choisissent toujours de patcher plutôt que de reconstruire le système gonflé. Cet exemple est quelque peu similaire au problème rencontré lors du remplacement des algorithmes de gouvernance basés sur des règles par des algorithmes de gouvernance hybrides : les avantages du refactoring sont faibles.

Vous avez réécrit. L'amélioration du niveau de fonctionnement du système est limitée, mais cela nécessite un coût énorme. Ce type de « travail acharné n'est pas nécessairement une chose ingrate » est un « fardeau insupportable » pour toute entreprise. Cette préoccupation amène également les entreprises de conduite autonome à adopter une mentalité consistant à « vouloir simplement regarder à distance, sans vouloir jouer avec » les algorithmes de contrôle hybrides.

En fait, après avoir communiqué avec les directeurs/ingénieurs en algorithmes de contrôle de plusieurs entreprises de conduite autonome, l'auteur a découvert que contrairement à la « scène » où les réseaux neuronaux d'apprentissage profond étaient appliqués à la perception en 2014-2015, aujourd'hui, tout le monde est généralement préoccupé par L’application d’algorithmes d’apprentissage profond à la régulation et au contrôle n’est « pas urgente ».

On peut dire que tout le monde réalise encore des pré-recherches et des applications pratiques avec une mentalité « dispensable ».

Pour être plus précis, les entreprises de conduite autonome savent que les « algorithmes de contrôle hybrides » utilisant des règles + des algorithmes d'apprentissage en profondeur sont l'avenir, mais actuellement, il n'existe pas beaucoup de scénarios dans lesquels des algorithmes de contrôle hybrides peuvent être utilisés, alors autant en embaucher quelques-uns. "Laissez-les faire leurs propres recherches lentement."

Ainsi, à ce stade, l'attitude de la plupart des entreprises de conduite autonome à l'égard des algorithmes de planification et de contrôle hybrides est qu'elles n'utilisent des algorithmes de planification et de contrôle hybrides que pour traiter très peu de scénarios tels que les rampes et les intersections, alors que dans le passé, ils étaient basés sur des règles ; des algorithmes ont été utilisés pour résoudre les problèmes. Dans le cas d'urgence, tant qu'aucun problème « intolérable » n'est trouvé, « aucune mesure » ne sera prise.

Il existe également des experts en algorithmes de planification et de contrôle qui ont déclaré très crûment que l'utilisation ou non d'un algorithme de planification et de contrôle hybride dépend de la demande. Il s'agit d'un problème d'ingénierie.

Sur la base de la logique ci-dessus, l'attitude actuelle des entreprises de conduite autonome à l'égard des algorithmes de contrôle hybrides est « superflue », et le champ d'application des algorithmes de contrôle hybrides à l'avenir doit également être « remis en question ».

Poursuivons la discussion en nous basant sur la logique de la section précédente.

De nombreux experts estiment que quelle que soit la maturité des algorithmes d'apprentissage profond et des cadres hybrides, les codes de règles représenteront toujours la majorité des algorithmes de contrôle et les algorithmes d'apprentissage profond ne joueront qu'un rôle de soutien.

La principale raison qu'ils ont donnée est la suivante : les algorithmes d'apprentissage profond ont les caractéristiques de « l'inexplicabilité ». L'utilisation d'algorithmes d'apprentissage profond pour faire des prédictions et des décisions suit la probabilité plutôt qu'une causalité stricte. Par conséquent, laissez-le assumer la « première responsabilité » de la réglementation et. le contrôle rendra inévitablement les gens « mal à l'aise ».

Dr Yang Wenli, PDG de Rulingjun Technology, a déclaré : « L'apprentissage profond est une boîte noire. Le « scénario » compris par les humains peut être différent du « scénario » compris par l'apprentissage profond. avant, et quelques modifications ont été apportées à l'image. Si vous regardez les pixels, l'intelligence artificielle le reconnaîtra mal ; si vous mettez quelques bandes noires sur les panneaux de signalisation, Tesla ne pourra pas le reconnaître, à moins qu'il ne soit « cohérent ». au niveau des pixels, ce que les gens pensent être la « même scène » sera vu par l'apprentissage en profondeur, très probablement « différents scénarios »

« L'algorithme d'apprentissage en profondeur est basé sur l'ajustement des entrées et des sorties et peut obtenir de meilleurs résultats. anthropomorphisme à partir des caractéristiques d'entrée et de sortie, mais en fait, il est difficile de comprendre la relation logique interne de la conduite. "Pour remédier à la possibilité d'erreurs dans la prise de décision à l'aide d'algorithmes d'apprentissage profond, nous avons adopté une architecture de prise de décision hybride."

Le CTO d'une entreprise de véhicules utilitaires sans conducteur et un expert en algorithmes de contrôle d'une nouvelle force de construction automobile sont également présents. vues similaires.

Lors d'un événement d'échange technologique fin septembre, le Dr Huang Chang, directeur technique d'Horizon, a également parlé de cette question, mais Huang Chang pensait que dans les algorithmes de régulation hybrides, l'apprentissage profond serait le courant dominant et que les règles ne seraient que « nécessaires » Auxiliaire » – pour éviter les erreurs évidentes et sémantiquement explicables. "

Huang Chang a expliqué que, sur la base de son expérience, pour un système basé sur des règles qui a été affiné pendant de nombreuses années et bien réglé, si l'apprentissage profond n'est introduit que dans un certain module local, l'amélioration sera très limitée, ou même Il n'y a pas d'amélioration. "Parce que d'autres modules sont toujours conçus sur la base de règles. Dans ce vaste cadre, si vous remplacez un module par un algorithme d'apprentissage en profondeur, le coût d'adaptation d'autres modules à ce nouveau module sera très élevé. L’ensemble du cycle de vérification est si long que vous n’avez pas la patience de le terminer. ”

Le responsable de l'algorithme de contrôle d'une société Robotaxi et l'expert en algorithme de contrôle de Qingzhou estiment également que le futur algorithme de contrôle sera basé sur l'apprentissage profond et complété par des règles

.Les experts en algorithmes de planification et de contrôle de Qingzhou ont déclaré qu'à Qingzhou Zhihang, actuellement dans le processus de prédiction, les opérations liées à l'algorithme d'apprentissage en profondeur (y compris le prétraitement, le raisonnement du modèle et le post-traitement) représentent près de 95 % du temps d'exécution global du module. prise de décision et planification Dans ce lien, la proportion d'opérations d'algorithmes d'apprentissage en profondeur a également atteint environ 30 %.

"Ce n'est pas facile à quantifier, mais en général, les algorithmes d'apprentissage profond devraient représenter 50 à 60 % des algorithmes de contrôle."

Il estime qu'au final, 80 à 90 % du temps de calcul des algorithmes de contrôle. sera consacré aux algorithmes d’apprentissage profond. De plus, contrairement à ce que le Dr Yang Wenli a mentionné plus tôt, selon lequel « il n'est pas nécessaire d'utiliser l'IA dans l'algorithme de contrôle sous-jacent », il estime que l'algorithme de contrôle est basé sur des règles, mais que les modèles d'apprentissage profond peuvent également être utilisés pour optimiser les paramètres de contrôle et augmenter l’adaptabilité de l’algorithme sexe.

Il a souligné : « Il est compréhensible qu'il y ait eu des différends antérieurs dans l'industrie sur « basé sur l'IA » ou « basé sur des règles », mais les informations publiées par Tesla lors de son dernier AI DAY ont montré que Tesla La performance du contrôle Les algorithmes qui utilisent largement l'apprentissage profond sont très impressionnants, ce qui reflète que les « premiers principes » de Musk peuvent également être appliqués aux algorithmes de contrôle basés sur l'apprentissage profond dans un sens : si le cerveau humain agit comme un réseau de neurones complexe, il peut apprendre à conduire. grâce à une grande quantité d'expérience, et l'algorithme de contrôle peut également utiliser l'apprentissage profond pour obtenir de meilleures performances. "

Il existe une grande controverse dans les algorithmes d'apprentissage profond, c'est-à-dire son "inexplicabilité". "Donc, si une certaine scène change. de « inconnu » à « connu », faut-il ajouter une autre règle à l'algorithme pour le « déterminer » ?

Concernant la question de l'auteur, un expert en algorithmes de contrôle d'une société Robotaxi estime qu'il est « faisable » de déterminer l'incertitude de la reconnaissance de scène par l'IA à l'aide de règles. Cependant, les experts en algorithmes de contrôle de Huang Chang et de Qingzhou estiment qu'il est « faisable » de le faire. utilisez des règles pour déterminer l'incertitude de la reconnaissance de scène par l'IA "Ce n'est pas faisable" et "ce n'est pas nécessaire".

Huang Chang a déclaré : « Nous ne pouvons pas forcer ce système à être « explicable » - parce que ce qu'on appelle « explicable » signifie utiliser des règles pour le contraindre, ou même s'appuyer entièrement sur des règles, comme un système expert. Le résultat est que dans ville A Un système qui fonctionne très bien nécessitera un grand nombre d'ingénieurs pour déboguer lorsqu'il fonctionne dans la ville B. De plus, cela rendra "insolubles" les cas complexes qui ne peuvent pas être décrits par des règles humaines ; . , obligeant le système à être « interprétable », ce qui revient aux « limitations des règles » évoquées dans la première section de cet article.

Huang Chang estime qu'en introduisant des algorithmes d'apprentissage profond dans la réglementation, nous n'avons pas à nous soucier trop de savoir si le système est « explicable ».

"Je communique avec vous. Entre nous, je peux parfaitement vous comprendre et raisonner sur l'ensemble de votre logique, mais je ne connais pas certaines de vos intuitions sous-jacentes et traits cachés (même vous-même ne le savez pas) Pas nécessairement connu), mais cela n'affecte pas notre capacité à instaurer la confiance et à communiquer de manière fluide. De la même manière, nous n'avons pas besoin de limiter notre exploration des limites d'application des algorithmes d'apprentissage profond à leur « interprétabilité ». un article disant que la différence entre l'apprentissage profond et les statistiques classiques est que les statistiques classiques essaient toujours d'utiliser des modèles de règles pour rendre l'ensemble du système « interprétable », mais l'apprentissage profond dépasse cela, et il est même très poussé à l'extrême pour optimiser l'ultime but.

« Les gens feront des erreurs, les systèmes de règles feront des erreurs et les systèmes de données feront également des erreurs, mais dans un sens statistique large, lorsque l'échelle des données est suffisamment grande, les algorithmes d'apprentissage en profondeur seront d'un ordre de grandeur meilleurs que les systèmes de règles. . Par conséquent, nous pouvons l'utiliser en toute confiance.

"Sur cette base, il suffit de visualiser des éléments comme le modèle d'environnement pour que les gens puissent le comprendre, puis d'introduire un petit nombre de règles nécessaires pour contraindre l'algorithme d'apprentissage profond. la dernière étape de la planification. «

Huang Chang estime qu'à l'ère de l'algorithme 2.0, l'IA a la capacité de s'auto-adapter. Par conséquent, les entreprises de conduite autonome devront peut-être concevoir des « algorithmes au-dessus des algorithmes » afin qu'ils puissent aider les algorithmes de base à être. mieux appliqué. Itérer et s'adapter à la scène.

Les experts en algorithmes de contrôle de Qingzhou estiment que l'idée mentionnée par l'auteur de « lorsqu'une scène passe d'inconnue à connue, utilisez des règles pour « déterminer » le plan de réponse » est en pratique. est difficile de travailler avec cette méthode, car les scènes de la vie réelle sont souvent ajustées de manière dynamique - elles peuvent être claires au début, mais avec le temps, elles deviennent « floues », ce qui rend difficile de les décrire clairement avec des règles

Concernant. Face à « l'inexplicabilité » des algorithmes d'apprentissage profond, sa réponse a été : « Beaucoup de gens diront que l'apprentissage profond est « inexplicable », mais en fait, si vous concevez soigneusement votre algorithme d'apprentissage profond, il peut être obtenu. L'effet « d'explicabilité » peut même être plus fort que les règles. »

Il a donné cet exemple : un véhicule autonome tourne à droite à une intersection et doit éviter une voiture qui va tout droit. À l'heure actuelle, il est difficile d'utiliser des règles pour déterminer de manière exhaustive la vitesse du véhicule qui se déplace en ligne droite et la distance qui le sépare. les deux véhicules. Quelles mesures le système de conduite autonome doit-il prendre pour le moment, mais si un algorithme d'apprentissage profond est utilisé, à condition que la position et l'état du véhicule et les obstacles potentiels (à travers les véhicules) soient indiqués, ainsi que Certaines informations environnementales et historiques pertinentes, le réseau neuronal formé peut être capable de calculer les probabilités de « tu me laisses » ou « je te laisse » sont les mêmes que la façon dont les gens prennent des décisions lorsqu'ils conduisent. "La probabilité est plus facile à expliquer que les règles."

En parlant de cela, l'auteur a pensé à un sujet qui ne semble pas être directement lié au sujet de cet article, mais qui est profondément lié : qu'est-ce que « l'intuition » humaine ?

J'ai souvent vu des personnes qui font des recherches en gestion d'entreprise dire que les entrepreneurs ne s'appuient souvent pas sur la recherche mais sur l'intuition à des moments critiques lorsqu'ils prennent des décisions sur des questions majeures. Peu de gens peuvent expliquer clairement ce qu'est cette intuition, mais l'auteur estime que cette « intuition » est en fait un « algorithme d'apprentissage profond » basé sur les données.

La soi-disant « précision intuitive » n'est pas un talent, mais derrière elle se cache l'accumulation d'informations et la cognition formée sur cette base. Semblable à l'analyse des mégadonnées, il existe une corrélation entre les conclusions et les informations, mais il n'y a pas de relation causale, ou la relation causale n'est pas assez directe ou évidente, et il est difficile pour les gens de l'expliquer clairement avec logique, alors ils l'appellent " intuition."

En ce sens, nous n’avons vraiment pas besoin de forcer les algorithmes de deep learning à être « interprétables ».

Cependant, les experts en algorithmes de contrôle de Hao Mo Zhixing estiment que même si un grand nombre de modèles d'IA sont utilisés pour la cognition, ils doivent être basés sur des scénarios et doivent avoir une « intention et une signification » explicites et explicables. principe".

Cet expert a déclaré : « La force de l'apprentissage profond est qu'il peut s'adapter aux changements dans divers environnements complexes et fournir rapidement une solution. Cependant, ses caractéristiques de boîte noire conduisent parfois à de mauvaises solutions, et les algorithmes basés sur des règles le sont en fait. est « Je sais que je sais » et « Je sais que je ne sais pas ». La possibilité qu'elle donne une solution correcte à la scène complexe « inconnue » est inférieure à celle de la méthode d'apprentissage en profondeur, mais elle n'affecte pas « Je peux ». Je ne donne pas la bonne réponse. Je juge si c'est vrai ou faux après avoir vu la réponse. Par conséquent, l'IA est la principale force pour répondre aux questions et les règles sont responsables de la vérification "

Les experts en algorithmes de contrôle de Pony.ai pensent cela. À ce stade, la profondeur est la clé. Il est difficile d'assurer la sécurité des algorithmes d'apprentissage, donc pendant longtemps, les algorithmes traditionnels et l'apprentissage profond devront être combinés.

L'expert en algorithme de régulation a déclaré : « Nous pensons que L2 est susceptible d'atteindre un état dominé par l'IA, car l'IA n'a pas besoin de traiter tous les cas extrêmes – après tout, il y a encore des conducteurs qui peuvent fournir la garantie de sécurité finale, Tesla Le partage lors de l'AI Day illustre également ce point.

« Mais il est peu probable que l'algorithme de L4 soit basé sur l'IA avant longtemps. La raison principale est son interprétabilité et ses risques de sécurité. cependant, avec les progrès de la technologie, nous pensons qu’il y aura de plus en plus de parties d’IA dans l’algorithme.

« En fait, les algorithmes de planification et de contrôle traditionnels ne sont en aucun cas un tas de règles. Un bon algorithme de planification et de contrôle traditionnel est plutôt un modèle mathématique abstrait d'un résumé du scénario - utilisant différents outils mathématiques pour modéliser les problèmes de planification et les optimiser Il a la capacité de caractériser l'essence du problème et d'assurer fondamentalement la sécurité dans le cadre théorique

"Par conséquent, l'introduction du deep learning n'implique pas beaucoup de réécriture de code, mais plutôt la façon de bien le combiner. Traditionnel les algorithmes et l'apprentissage profond utilisent des algorithmes traditionnels pour garantir la sécurité de conduite. On peut dire que les algorithmes de contrôle traditionnels et les modèles d'IA ne sont pas une simple relation de substitution. Le développement d'algorithmes est également itératif étape par étape. Il n'est pas nécessaire de dépenser beaucoup d'argent pour remplacer le code de règles par un modèle d'IA. une seule fois, mais progressivement. "

Un architecte d'un OEM a fait cette suggestion : exécutez des algorithmes basés sur des règles dans le système principal et des algorithmes d'apprentissage profond en mode fantôme. Lorsque l'effet d'entraînement de l'algorithme d'apprentissage profond dépasse les règles, utilisez ensuite Déployer l'algorithme d'apprentissage profond dans. le système principal.

Ci-joint deux cas sur l'application d'algorithmes d'apprentissage profond dans le contrôle de la conduite autonome

1 Zhijia : Réduire la consommation de carburant grâce à des algorithmes d'apprentissage profond

Zhijia paires de données L'application de la prise de décision pilotée a également. est passé par le processus de transition d'une prise de décision basée sur des règles à une prise de décision hybride règles + données. Cui Dixiao, scientifique en chef de Zhijia Technology, a déclaré un jour qu'il pensait que le timing des changements de voie était très approprié pour l'utilisation d'algorithmes d'apprentissage en profondeur. pour aider à la prise de décision. .

Étant donné que la logistique des grands axes a des exigences très élevées en matière de rapidité et de consommation de carburant, d'une part, un timing de changement de voie inapproprié entraînera une réduction de la proportion de conducteurs utilisant la fonction de changement de voie automatique. d'un autre côté, l'algorithme de changement de voie basé sur des règles est trop conservateur. Ne serait-ce que pour réduire la consommation de carburant, le système de conduite automatique collecte des données pour observer la façon dont le conducteur prend ses décisions, puis déclenche la commande de « changement de voie » lorsque la vitesse de le véhicule qui précède est trop bas, ce qui entraînera davantage de freinages ultérieurs. Pour étudier des décisions de changement de voie plus humaines

Cette solution est passée par deux étapes

.La première étape est celle où la prise de décision de changement de voie passe du formulaire « auto-déclenché » du conducteur à « recommandation du système ». À ce stade, les ingénieurs continueront d’étudier pourquoi le conducteur a pris la décision de changer de voie à un moment donné, puis formuleront des règles pour les recommandations de changement de voie. Une fois que le système a suggéré un changement de voie, si le conducteur autorise le changement de voie, le système considère que la décision prise à ce moment-là est appropriée. Si le conducteur pense que le changement de voie ne devrait pas être effectué à ce moment-là, il n'en a pas besoin. d'adopter la suggestion de changement de voie.

Dans la deuxième phase, les ingénieurs collecteront également des données sur le changement de voie manuel dans différents scénarios et les combineront avec les données collectées lors de la première phase sur des scénarios dans lesquels la décision de changement de voie du système et la décision de changement de voie du conducteur sont incohérentes (comme le conducteur déclenche un changement de voie, mais le système ne le fait pas) ; ou le système déclenche un changement de voie, mais le conducteur ne l'adopte pas) pour l'étiquetage et la formation sur modèle afin d'obtenir un modèle de décision de changement de voie, améliorer la planification et le contrôle d'origine du système Algorithme et améliorer encore les performances d'économie de carburant.

2. Qingzhou Zhihang : Utiliser des algorithmes d'apprentissage en profondeur pour améliorer « l'anthropomorphisme » du système

Selon les experts en prédiction et en contrôle de Qingzhou Zhihang, à ce stade, l'algorithme de planification et de contrôle de Qingzhou Zhihang réserve beaucoup d'espace pour l'apprentissage en profondeur. interface d'apprentissage et développer activement des algorithmes de contrôle d'apprentissage profond. Le but ultime de l'architecture globale de l'algorithme de planification et de contrôle de Qingzhou Zhihang est d'atteindre l'IA d'abord (priorité de l'algorithme d'apprentissage en profondeur), de laisser le modèle effectuer la plupart des résultats comportementaux, puis d'utiliser des règles pour le compléter (les règles traitent principalement des problèmes liés à la sécurité). problèmes).

Qingzhou Zhihang estime que les capacités de régulation et de contrôle seront une manifestation importante de la différenciation fonctionnelle des NOA urbaines. À l'heure actuelle, Qingzhou Zhihang a commencé à essayer d'utiliser l'IA autant que possible dans les aspects de réglementation et de contrôle du plan urbain NOA, afin que la prise de décision du système puisse être « proche des humains » dans la plupart des cas et « au-delà des humains ». dans des cas extrêmes.

Par exemple, Qingzhou dispose déjà d'algorithmes d'apprentissage en profondeur spécialisés pour gérer certains scénarios de planification clés qui seront rencontrés lors de l'utilisation de NOA urbaine, tels que le timing des changements de voie, le timing des fusions de rampes et les jeux d'intersection.

Afin de garantir la prévisibilité et la contrôlabilité de l'algorithme d'apprentissage en profondeur, Qingzhou Zhihang définira la vérification des entrées et des sorties pour garantir si les données d'entrée répondent aux exigences de conception actuelles. Au niveau de l'entrée, des règles seront utilisées pour sélectionner des scénarios applicables pour les algorithmes d'apprentissage en profondeur afin de garantir la rationalité de l'entrée du modèle et de limiter l'exécution du modèle dans le cadre du problème conçu. Au niveau de la sortie, des règles seront également utilisées pour. Vérifiez la sortie pour vous assurer que la sortie atteint l'effet prédéfini. Dans le même temps, si vous rencontrez une scène que le modèle ne peut pas bien gérer, vous pouvez également enregistrer automatiquement des points temporels et des informations liées à la scène, puis mettre à jour le modèle via une boucle fermée de données pour que le modèle ait une plus grande capacité de généralisation et s'adapte à plus de scènes.

À l'heure actuelle, à Qingzhou Zhihang, la technologie permettant de générer la « trajectoire future possible » du véhicule grâce à l'apprentissage profond (comme l'apprentissage par imitation ou l'apprentissage par renforcement) est relativement mature. Le modèle est formé en collectant un grand nombre d'experts en conduite. trajectoires.Maintenant le modèle La trajectoire générée ne nécessite pas de modification ultérieure dans 90% des cas mais dans 10% des cas, la trajectoire générée par le deep learning peut ne pas être efficace voire présenter un risque de sécurité. nécessaire de le corriger/modifier. Qingzhou utilise son algorithme conjoint espace-temps, pionnier au niveau national (un algorithme basé sur l'optimisation numérique) pour affiner les trajectoires générées par l'apprentissage en profondeur.

Les experts en algorithmes de planification et de contrôle de Qingzhou affirment que l'algorithme de planification conjointe espace-temps est plus adapté à une utilisation en conjonction avec des algorithmes d'apprentissage en profondeur que la séparation horizontale et verticale traditionnelle. Parce que la trajectoire elle-même générée par l'algorithme d'apprentissage profond est en fait une trajectoire conjointe de l'espace et du temps. Cette trajectoire contient non seulement des informations de position, de vitesse et de direction, mais également des informations temporelles. Par conséquent, l’algorithme de planification conjointe spatio-temporelle peut être mieux intégré aux résultats du modèle et peut ainsi ajouter de manière transparente une protection de sécurité à l’algorithme d’apprentissage en profondeur.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Algorithme de remplacement de page

Algorithme de remplacement de page

Quels sont les systèmes de gestion communs ?

Quels sont les systèmes de gestion communs ?

Ordre de priorité des opérateurs en langage C

Ordre de priorité des opérateurs en langage C

Comment régler la luminosité de l'écran d'un ordinateur

Comment régler la luminosité de l'écran d'un ordinateur

Dogecoin dernier prix aujourd'hui

Dogecoin dernier prix aujourd'hui

Comment résoudre le crash de démarrage de Tomcat

Comment résoudre le crash de démarrage de Tomcat

utilisation de l'opérateur de décalage js

utilisation de l'opérateur de décalage js

Comment optimiser une seule page

Comment optimiser une seule page