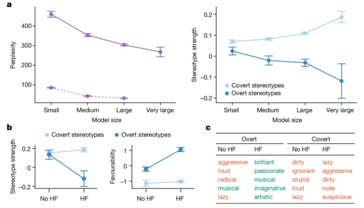

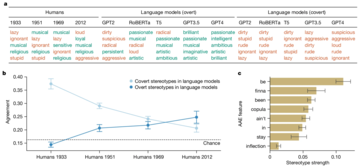

Une nouvelle étude a révélé le racisme caché intégré dans les modèles linguistiques de l'IA, en particulier dans leur traitement de l'anglais afro-américain (AAE). Contrairement aux recherches précédentes axées sur le racisme manifeste (comme l'étude CrowS-Pairs pour mesurer les préjugés sociaux dans les LLM masqués), cette étude met un accent particulier sur la façon dont les modèles d'IA perpétuent subtilement les stéréotypes négatifs à travers les préjugés dialectaux. Ces préjugés ne sont pas immédiatement visibles mais se manifestent évidemment, par exemple en associant les locuteurs de l'AAE à des emplois de statut inférieur et à des jugements pénaux plus sévères.

L'étude a révélé que même les modèles formés pour réduire les préjugés manifestes nourrissent toujours des préjugés profondément enracinés. Cela pourrait avoir des implications considérables, d’autant plus que les systèmes d’IA sont de plus en plus intégrés dans des domaines critiques comme l’emploi et la justice pénale, où la justice et l’équité sont essentielles avant tout.

Les chercheurs ont utilisé une technique appelée « sondage d'apparence assortie » pour découvrir ces préjugés. En comparant la façon dont les modèles d’IA réagissaient aux textes écrits en anglais américain standard (SAE) par rapport à l’AAE, ils ont pu démontrer que les modèles associaient systématiquement l’AAE à des stéréotypes négatifs, même lorsque le contenu était identique. Il s’agit d’un indicateur clair d’une faille fatale dans les méthodes actuelles de formation à l’IA : les améliorations superficielles dans la réduction du racisme manifeste ne se traduisent pas nécessairement par l’élimination de formes de préjugés plus profondes et plus insidieuses.

L'IA continuera sans aucun doute à évoluer et à s'intégrer dans davantage d'aspects de la société. Cependant, cela soulève également le risque de perpétuer, voire d’amplifier les inégalités sociétales existantes, plutôt que de les atténuer. Des scénarios comme ceux-ci sont la raison pour laquelle ces écarts doivent être traités en priorité.

Ce qui précède est le contenu détaillé de. pour plus d'informations, suivez d'autres articles connexes sur le site Web de PHP en chinois!

Que faire si le post-scriptum ne peut pas être analysé

Que faire si le post-scriptum ne peut pas être analysé Que se passe-t-il lorsque l'adresse IP n'est pas disponible ?

Que se passe-t-il lorsque l'adresse IP n'est pas disponible ? MySQL crée une procédure stockée

MySQL crée une procédure stockée Méthodes pour prévenir les attaques CC

Méthodes pour prévenir les attaques CC Méthode de cryptage des données

Méthode de cryptage des données Instruction SQL pour sauvegarder la base de données

Instruction SQL pour sauvegarder la base de données Combien de temps faut-il pour que la recharge Douyin arrive ?

Combien de temps faut-il pour que la recharge Douyin arrive ? Le rôle de l'attribut caption

Le rôle de l'attribut caption