Produziert von Big Data Digest

Autor: Caleb

Ich glaube, jeder hat gesehen, wie beliebt ChatGPT mittlerweile ist.

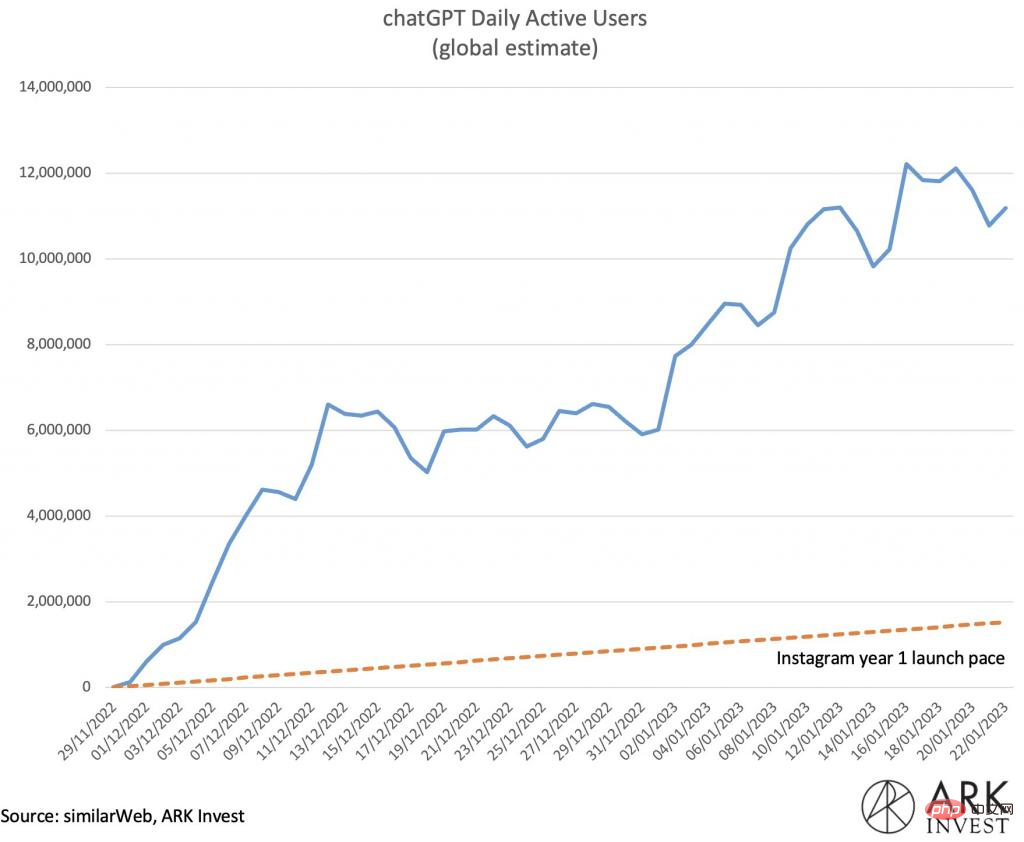

Laut Statistiken von Brett Winton, Chef-Futurist von ARK Venture Capital, dauerte es weniger als zwei Monate, bis das tägliche aktive Volumen von ChatGPT 10 Millionen überstieg. Zum Vergleich: Die letzte phänomenale Software, Instagram, brauchte 355 Tage, um dieses Kunststück zu vollbringen.

Mitte Januar berichtete die New York Times, dass Antony Aumann, Philosophieprofessor an der Northern Michigan University, angenehm überrascht war, bei der Benotung seines Weltreligionskurses einen der „besten Aufsätze der Klasse“ zu lesen. Anhand prägnanter Absätze, gut platzierter Beispiele und stichhaltiger Argumente erforschen die Schüler die moralischen Implikationen des Burka-Verbots. Auf Aumanns Befragung gab der Student jedoch zu, dass die Arbeit mit ChatGPT verfasst wurde.

Es gibt viele ähnliche Beispiele.

Gerade mit der Popularität von ChatGPT auf globaler Ebene ist OpenAI schnell an die „Schwelle“ der öffentlichen Meinung gerückt.

Man kann sagen, dass OpenAI derzeit das Chatbot-Wettrüsten anführt. Am Beispiel von ChatGPT hat die Veröffentlichung der milliardenschweren Zusammenarbeit mit Microsoft nicht nur Google und Amazon dazu angeregt, dringend künstliche Intelligenz in ihren Produktlinien einzusetzen, sondern OpenAI hat auch mit Bain zusammengearbeitet, um maschinelles Lernen in den Betrieb von Coca-Cola einzuführen. und plant eine Ausweitung auf andere Unternehmenspartner.

Es besteht kein Zweifel daran, dass die künstliche Intelligenz von OpenAI zu einem großen Geschäft geworden ist, aber tatsächlich unterscheidet sich dies etwas vom ursprünglichen Plan von OpenAI.

Letzten Freitag veröffentlichte OpenAI-CEO Sam Altman einen Blogbeitrag mit dem Titel „Planung für AGI und darüber hinaus“.

Link zum Artikel://m.sbmmt.com/link/3187b1703c3b9b19bb63c027d8efc2f1

In dem Artikel behauptete er, dass die Allgemeine Künstliche Intelligenz (AGI) von OpenAI derzeit weit davon entfernt sei, die Anforderungen zu erfüllen Viele Menschen bezweifeln, ob es der gesamten Menschheit zugute kommen kann und ob es „das Potenzial hat, jedem unglaubliche neue Fähigkeiten zu verleihen“.

Altman verwendete eine breite, idealistische Sprache, um zu argumentieren, dass die Entwicklung der künstlichen Intelligenz nicht aufhören sollte, „die Zukunft der Menschheit sollte von Menschen bestimmt werden“, was implizit auf OpenAI verwies.

Fast in der Zeit, als ChatGPT explodierte, erinnern dieser Blogbeitrag und die jüngsten Aktionen von OpenAI ständig daran, wie sehr sich der Ton und die Mission von OpenAI im Vergleich zu seiner Gründung verändert haben.

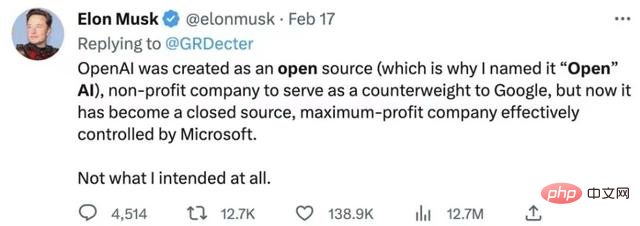

OpenAI war in seinen Anfängen nur eine gemeinnützige Organisation. Obwohl sich das Unternehmen schon immer auf die AGI-Entwicklung konzentrierte, versprach es bei seiner Gründung, keine Gewinne zu erzielen und den Entwicklungscode kostenlos weiterzugeben.

Und heute sind diese Versprechen nirgends zu finden.

Im Jahr 2015 gaben Altman, Musk, Peter Thiel und Reid Hoffman die Gründung einer gemeinnützigen Forschungsorganisation OpenAI bekannt. In seiner Gründungserklärung gab OpenAI bekannt, dass seine Forschung darauf abzielt, „künstliche Intelligenz auf eine Weise voranzutreiben, die der gesamten Menschheit am ehesten zugute kommt, ohne durch die Erzielung finanzieller Erträge eingeschränkt zu werden“. In dem Blog heißt es außerdem: „Da unsere Forschung keiner finanziellen Verpflichtung unterliegt, kann sie sich besser auf positive Auswirkungen auf den Menschen konzentrieren“ und ermutigt alle Forscher, „Papiere, Blog-Beiträge oder Codes zu teilen, unsere Patente (falls vorhanden) werden mit der Welt geteilt.“ "

8 Jahre später stehen wir vor einem Unternehmen, das weder transparent ist noch von positivem menschlichen Einfluss angetrieben wird. Stattdessen, so glauben viele Kritiker, darunter auch Musk, waren Geschwindigkeit und Gewinn die Motivation von OpenAI.

Gleichzeitig veröffentlicht OpenAI Technologie. Natürlich gibt es Fallstricke, aber es besteht immer noch die Bereitschaft, den Automatisierungswandel am Arbeitsplatz auf Kosten der menschlichen Arbeitskräfte voranzutreiben. Google beispielsweise betonte die Effizienzsteigerungen durch künstliche Intelligenz, die Code automatisch vervollständigt, was zur Entlassung von Tausenden von Arbeitnehmern führte.

In den frühen Tagen von OpenAI stellten sich Medien und Praktiker darin eine offene Möglichkeit zur Durchführung grundlegender künstlicher Intelligenzforschung mit ungewissem Zweck vor. Mitbegründer Greg Bockman sagte einmal: „Unser Ziel ist es jetzt, das Bestmögliche zu tun. Das ist ein wenig vage.“

Dies trug auch unsichtbar zum Richtungswechsel des Unternehmens im Jahr 2018 bei. Damals suchte OpenAI nach einer Richtung bei den Kapitalressourcen und sagte: „Unsere primäre treuhänderische Verantwortung liegt bei den Menschen. Wir gehen davon aus, dass wir erhebliche Ressourcen mobilisieren müssen, um unsere Mission zu erfüllen.“

Bis März 2019 hatte OpenAI seinen gemeinnützigen Titel vollständig aufgegeben und eine Abteilung mit „begrenztem Gewinn“ eingerichtet. Dies ermöglicht OpenAI die Annahme von Investitionen und bietet Anlegern Gewinne, die auf das 100-fache ihrer Investition begrenzt sind.

Diese Entscheidung wurde als Konkurrenz zu großen Technologieunternehmen wie Google angesehen, und bald erhielt das Unternehmen erwartungsgemäß auch eine Investition von 1 Milliarde US-Dollar von Microsoft. In einem Blogbeitrag, in dem das gewinnorientierte Unternehmen angekündigt wurde, verwendete OpenAI weiterhin dieselbe Rhetorik und erklärte, dass seine Mission darin bestehe, „sicherzustellen, dass allgemeine künstliche Intelligenz der gesamten Menschheit zugute kommt“.

Aber wie Motherboard schreibt, ist es kaum zu glauben, dass Risikokapitalgeber die Menschheit retten können, wenn ihr Hauptziel der Profit ist.

Im Jahr 2019 sah sich OpenAI mit der Ankündigung und Veröffentlichung des GPT-2-Sprachmodells einer öffentlichen Gegenreaktion ausgesetzt.

Zunächst erklärte das Unternehmen, es werde den Quellcode für das trainierte Modell aufgrund „Bedenken hinsichtlich böswilliger Anwendungen der Technologie“ nicht veröffentlichen. Dies spiegelt zwar zum Teil sein Engagement für die Entwicklung nützlicher künstlicher Intelligenz wider, ist aber auch nicht sehr „offen“.

Kritiker fragten sich, warum OpenAI ein Tool ankündigte, es aber nicht veröffentlichte, und viele dachten, es sei nur ein Werbegag. Erst drei Monate später veröffentlichte OpenAI das Modell auf GitHub und sagte, die Aktion sei „eine wichtige Grundlage für die verantwortungsvolle Freisetzung künstlicher Intelligenz, insbesondere wenn es um leistungsstarke generative Modelle geht.“ Laut der investigativen Reporterin Karen Hao, die im Jahr 2020 mehrere Tage im Unternehmen verbrachte, spiegelte die interne Kultur von OpenAI nicht mehr die Vorsicht statt eines forschungsorientierten KI-Entwicklungsprozesses wider, der sich mehr auf das Weiterkommen konzentrierte, was auch zu Vorwürfen geführt hat Befeuert den „KI-Hype-Zyklus“. Außerdem sind die Mitarbeiter nun verpflichtet, über die anstehenden Arbeiten Stillschweigen zu bewahren, um die neuen Satzungen des Unternehmens einzuhalten.

„Es besteht ein Missverhältnis zwischen dem, was das Unternehmen öffentlich unterstützt, und der Art und Weise, wie es hinter verschlossenen Türen agiert. Im Laufe der Zeit hat es dazu geführt, dass der transparente, offene und kollaborative Ansatz des Gründungsideals durch starken Wettbewerb und zunehmenden finanziellen Druck untergraben wurde.“ “, schrieb Hao.

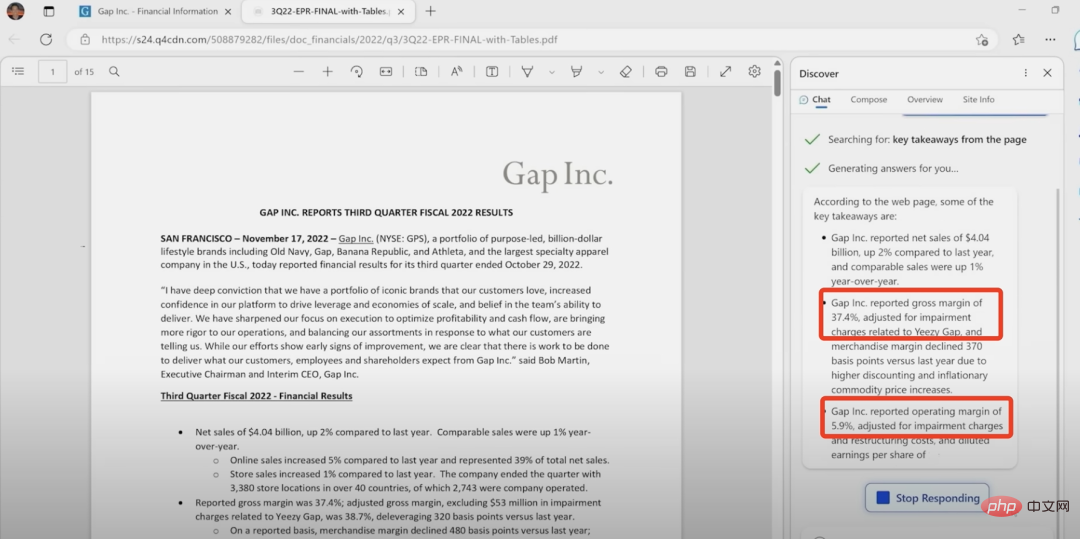

Nach der Kombination mit ChatGPT befindet sich der Bing-Chatbot von Microsoft in einem „besessenen“ Zustand, indem er Benutzer ständig täuscht und beschimpft und Fehlinformationen verbreitet. OpenAI kann von seinem eigenen Chatbot generierte Texte nicht zuverlässig erkennen, auch wenn Pädagogen zunehmend besorgt sind, dass Schüler die App zum Betrügen nutzen. Es ist auch leicht, Sprachmodelle mit einem Jailbreak zu versehen, indem man die Schutzmaßnahmen ignoriert, die OpenAI um sie herum errichtet hat, und Bots, die zufällige Wörter und Phrasen eingeben, stürzen ab. Niemand kann klar sagen, warum, da OpenAI den Code des zugrunde liegenden Modells nicht teilt und es unwahrscheinlich ist, dass OpenAI selbst bis zu einem gewissen Grad vollständig verstehen wird, wie es funktioniert.

Vor diesem Hintergrund sollten wir alle sorgfältig darüber nachdenken, ob OpenAI das Vertrauen verdient, das die Öffentlichkeit uns entgegenbringt, worauf OpenAI in keiner substanziellen Weise reagiert hat.

//m.sbmmt.com/link/b4189d9de0fb2b9cce090bd1a15e3420

Das obige ist der detaillierte Inhalt vonWarum ist ChatGPT beliebt, OpenAI jedoch keine große Aufmerksamkeit erhalten?. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!

ChatGPT-Registrierung

ChatGPT-Registrierung

Inländische kostenlose ChatGPT-Enzyklopädie

Inländische kostenlose ChatGPT-Enzyklopädie

So installieren Sie ChatGPT auf einem Mobiltelefon

So installieren Sie ChatGPT auf einem Mobiltelefon

Kann Chatgpt in China verwendet werden?

Kann Chatgpt in China verwendet werden?

CSS-Textfarbe festlegen

CSS-Textfarbe festlegen

Was soll ich tun, wenn mein iPad nicht aufgeladen werden kann?

Was soll ich tun, wenn mein iPad nicht aufgeladen werden kann?

So lösen Sie das Problem, dass der Druckprozessor nicht vorhanden ist

So lösen Sie das Problem, dass der Druckprozessor nicht vorhanden ist

Einstellungen der Java-Umgebungsvariablen

Einstellungen der Java-Umgebungsvariablen