Kürzlich haben das Stanford HAI Institute und das Stanford Regulation, Evaluation and Governance Laboratory gemeinsam das Whitepaper „Implementation Challenges of the Three Pillars of the U.S. Artificial Intelligence Strategy“ veröffentlicht, das den Fortschritt der künstlichen Intelligenz in den Vereinigten Staaten systematisch bewertet.

Das Whitepaper konzentriert sich hauptsächlich auf die drei Säulen der KI-Innovation und vertrauenswürdiger KI:

1. Das Gesetz über künstliche Intelligenz in der Regierung von 2020;

3. Executive Order zu „Künstliche Intelligenz in der Regierung“.

Insgesamt sind diese Durchführungsverordnungen und das Gesetz über künstliche Intelligenz in der Regierung von entscheidender Bedeutung, um die nationale Strategie der Vereinigten Staaten für künstliche Intelligenz sicherzustellen, die einfach „einen Wettbewerbsvorteil gegenüber dem Rest der Welt im nächsten Jahrzehnt“ darstellt.

Nachdem der Autor den Umsetzungsstatus jeder Anforderung in mehr als 200 Bundesbehörden umfassend überprüft hatte, stellte er fest, dass die Vereinigten Staaten zwar große Fortschritte bei Innovationen im Bereich der künstlichen Intelligenz gemacht haben, aber auch mit bestimmten Problemen konfrontiert sind:

Weniger Die Umsetzung von mehr als 40 % aller Anforderungen kann öffentlich nachgewiesen werden.

88 % der befragten Institutionen haben es versäumt, einen KI-Plan zur Identifizierung von Regulierungsbehörden im Zusammenhang mit KI vorzulegen.

Um von der „Vierten Industriellen Revolution“ oder der „Dritten Welle der Digitalen Revolution“ zu profitieren, priorisieren Länder Bemühungen zur Neuorganisation ihres öffentlichen und privaten Sektors, zur Finanzierung von Forschung und Entwicklung (F&E) und zum Aufbau von Infrastruktur zur Entfesselung von KI Innovationsstruktur und -politik.

In den Vereinigten Staaten fördern das Weiße Haus und der Kongress KI-Innovationen und ihren vertrauenswürdigen Einsatz, indem sie die Investitionen in Forschung und Entwicklung erhöhen, Mechanismen erkunden, um den gleichberechtigten Zugang zu KI-bezogenen Ressourcen durch nationale KI-Forschungsressourcen zu verbessern, und nationale künstliche Intelligenz finanzieren Das Intelligence Institute, das durch CHIPS und den Science Act 280 Milliarden US-Dollar in die inländische Halbleiterfertigung und „Industrien der Zukunft“ investiert, koordiniert die KI-Politik im Büro der National Artificial Intelligence Initiative des Weißen Hauses.

1. Nationale Strategie für künstliche Intelligenz: Executive Order und Gesetzgebung

Während die Artificial Intelligence Leadership Order darauf abzielt, technologische Durchbrüche in allen US-Sektoren voranzutreiben, konzentrieren sich die anderen beiden Bemühungen auf den Einsatz von KI durch die Bundesregierung.Executive Order 13859

Mit der Artificial Intelligence Leadership Order wurde die American Artificial Intelligence Initiative ins Leben gerufen, um „Bundesressourcen auf die Entwicklung künstlicher Intelligenz zu konzentrieren, um den amerikanischen Wohlstand zu steigern, die nationale und wirtschaftliche Sicherheit Amerikas zu stärken und die Qualität zu verbessern.“ Konkret geht es darum, die Bemühungen des Bundes zu beschleunigen, indem der Schwerpunkt auf KI-bezogenen Daten und Ressourcen, regulatorischen Leitlinien und technischen Standards, der KI-Belegschaft und dem Verständnis der Öffentlichkeit für künstliche Intelligenz liegt Ein tiefgreifender Ansatz, der Vertrauen in Geheimdienstinformationen und internationales Engagement umfasst, schafft die Infrastruktur, die politische Grundlage und die Talente, die für die Führungsrolle der USA im Bereich KI erforderlich sind.

Darüber hinaus ist eine „koordinierte Strategie der Bundesregierung“ erforderlich und KI „wird sich auf die Aufgaben fast aller Exekutivabteilungen und Behörden auswirken“. Die KI-Führungsverordnung ermächtigt die Behörden außerdem, sechs damit verbundene strategische Ziele zu verfolgen: „Förderung und Schutz der Fortschritte der USA in der künstlichen Intelligenz.“

Executive Order 13960

Die Verordnung über künstliche Intelligenz in der Regierung weist Bundesbehörden an, das „Potenzial künstlicher Intelligenz zur Verbesserung der Regierungsabläufe“ zu nutzen. In der Erkenntnis, dass „die weitere Einführung und Akzeptanz von KI stark vom Vertrauen der Öffentlichkeit abhängen wird“, legt die KI-Verordnung neun Grundsätze fest, die Bundesbehörden bei der Gestaltung, Entwicklung, Anschaffung und Nutzung von KI umsetzen sollten.

Diese Grundsätze legen fest, dass künstliche Intelligenz (a) legal, (b) leistungsorientiert, (c) genau, zuverlässig und effektiv, (d) sicher, zuverlässig und belastbar, (e) verständlich sein sollte, (f ) rechenschaftspflichtig und nachvollziehbar, (g) regelmäßig überwacht, (h) transparent und (i) rechenschaftspflichtig. „Gesetz über künstliche Intelligenz in der Regierung“ von 2020 Dazu gehört die Einrichtung einer KI-Karrierereihe, die Forderung nach formellen Leitlinien für den Einsatz von Behörden, Beschaffung, Voreingenommenheitsbewertung und Eindämmung von KI sowie die Schaffung eines Kompetenzzentrums innerhalb der General Services Administration (GSA), um die Einführung künstlicher Intelligenz durch die Regierung zu unterstützen.

2. Gesamtumsetzung Der Autor untersuchte die Umsetzung der Bestimmungen jeder Abteilung in den beiden Durchführungsverordnungen und dem Gesetz über künstliche Intelligenz in der Regierung.

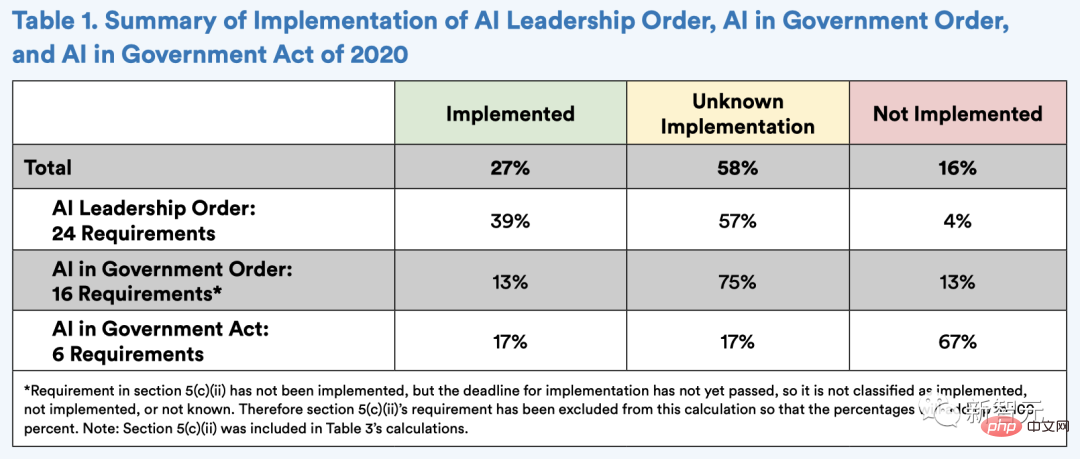

In den beiden oben genannten Durchführungsverordnungen und dem Gesetz über künstliche Intelligenz in der Regierung von 2020 stellten die Autoren fest, dass 11 der 45 Anforderungen, also etwa 27 %, umgesetzt wurden.

Allerdings wurden 7 von 45 Anforderungen (16 %) nicht fristgerecht umgesetzt und bei den restlichen 26 Anforderungen (58 %) konnte nicht bestätigt werden, ob sie vollständig umgesetzt wurden oder nicht.

Allerdings wurden 7 von 45 Anforderungen (16 %) nicht fristgerecht umgesetzt und bei den restlichen 26 Anforderungen (58 %) konnte nicht bestätigt werden, ob sie vollständig umgesetzt wurden oder nicht.

Auch bei den bereits umgesetzten Anforderungen ist der konkrete Umsetzungsstand ungewiss. Dazu gehören Bemühungen, Daten und Quellcode für die KI-Forschung und -Entwicklung besser zugänglich zu machen, neue KI-bezogene Bildungs- und Personalentwicklungsprogramme besser zu nutzen und zu entwickeln und sicherzustellen, dass sich die Behörden umfassend engagieren, um vertrauenswürdige KI weiter zu implementieren.

Vier fristbasierte Anforderungen des Gesetzes über künstliche Intelligenz in der Regierung wurden nicht umgesetzt:

Das Office of Personnel Management (OPM) sollte dem Kongress bis Mai 2021 ein Gründungsdokument vorlegen. Pläne für die künstliche Intelligenz

OMB sollte bis Oktober 2021 ein Memorandum zur Beschaffung künstlicher Intelligenz veröffentlichen, um diskriminierende Auswirkungen oder Voreingenommenheit zu reduzieren.

Agenturen sollten bis April 2022 ein entsprechendes Memorandum veröffentlichen. OPM sollte eine KI-Karriere schaffen Serie bis Juli 2022 und schätzen Sie den KI-bezogenen Personalbedarf für jede Bundesbehörde.

OPM sollte eine KI-Karriere schaffen Serie bis Juli 2022 und schätzen Sie den KI-bezogenen Personalbedarf für jede Bundesbehörde.

Viele der umgesetzten Maßnahmen hinken dem Zeitplan hinterher. Beispielsweise legte der Sonderausschuss für künstliche Intelligenz des National Science and Technology Council (NSTC) dem Präsidenten seinen Bericht über die bessere Nutzung der Cloud-Computing-Technologie 16 Monate nach Ablauf der Frist vor.

1 Fordern Sie die OMB auf, ein Memorandum an die Behördenleiter herauszugeben, das Leitlinien dazu enthält, wie Behörden künstliche Intelligenz regulieren sollten

2. Fordern Sie Agenturen mit „Regulierungsbefugnis“ auf, einen Plan („Agency Artificial Intelligence Plan“) zu entwickeln und öffentlich zu veröffentlichen, um „Konsistenz“ mit den von OMB bereitgestellten Leitlinien zu erreichen.

Am 17. November 2020 veröffentlichte die OMB das Memorandum an Leiter von Exekutivabteilungen und Agenturen zu regulatorischen Leitlinien für Anwendungen der künstlichen Intelligenz (OMB M-21-06), in dem sie die Agenturen aufforderte, einen „Regulierungsansatz zur Förderung von Innovation und Wachstum“ zu verfolgen „Schaffen Sie Vertrauen und schützen Sie gleichzeitig die Grundwerte Amerikas.“

Das Memorandum beschreibt 10 Grundsätze für die Verwaltung von Anwendungen der künstlichen Intelligenz, um die regulatorischen und nicht-regulierenden Ansätze der Behörden für künstliche Intelligenz zu leiten, identifiziert nicht-regulierende Ansätze, wenn eine Regulierung unangemessen ist, und empfiehlt verschiedene von den Behörden ergriffene Maßnahmen Institutionen, um Hindernisse für den Einsatz und die Nutzung von KI abzubauen.

Agenturen sind verpflichtet, Pläne bis Mai 2021 (die Frist zur Einhaltung der Artificial Intelligence Leadership Order) einzureichen und ihre Pläne öffentlich auf den Websites ihrer Agentur zu veröffentlichen.

Derzeit haben von den 41 bewerteten Agenturen nur 5 (13 %) KI-Pläne nach der im OMB AI Regulation Memorandum bereitgestellten Vorlage veröffentlicht. Bei diesen Behörden handelt es sich um die Ministerien für Energie (DOE), Gesundheits- und Sozialwesen (HHS) und Veteranenangelegenheiten (VA) sowie die Umweltschutzbehörde (EPA) und die US-amerikanische Agentur für internationale Entwicklung (USAID).

Die verbleibenden 36 Institutionen haben keine eigenen Pläne für künstliche Intelligenz angekündigt.

Das Mandat für künstliche Intelligenz in der Regierung konzentriert sich auf die Förderung der Entwicklung, Einführung und Anschaffung vertrauenswürdiger künstlicher Intelligenz innerhalb der Bundesregierung.

Zu diesem Zweck müssen die Behörden „eine Liste nicht vertraulicher und nicht sensibler Anwendungsfälle für künstliche Intelligenz erstellen“ und diese mit dem Federal Chief Information Officers Council (CIO Council), anderen Behörden und anderen Behörden teilen öffentlich.

Allerdings war es schon immer ein Problem, die Liste der KI-Anwendungsfälle öffentlich zu veröffentlichen.

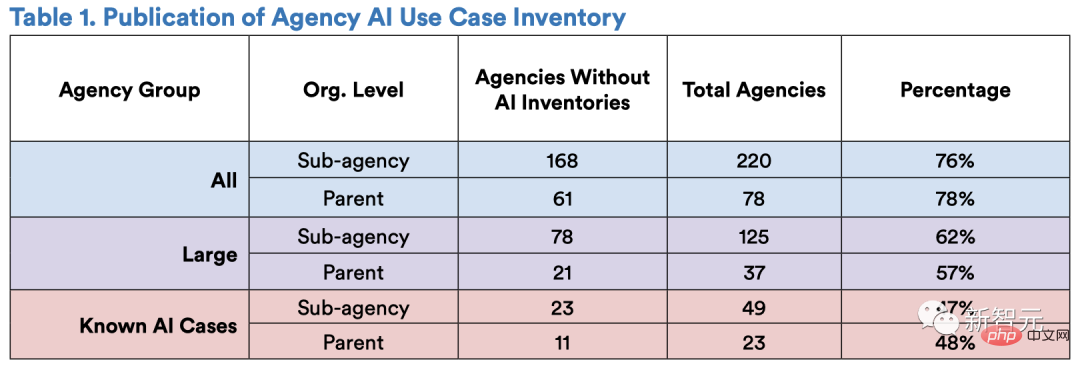

Von den 220 Institutionen, die möglicherweise dieser Anforderung unterliegen, verfügen 168 Institutionen nicht über ein unabhängiges Inventar von KI-Anwendungsfällen oder ihre KI-Anwendungsfälle sind nicht im Inventar ihrer Mutterbehörde enthalten. Von den 78 untersuchten Mutteragenturen veröffentlichten nur 17 Listen mit KI-Anwendungsfällen.

Das heißt, von allen 220 übergeordneten und untergeordneten Institutionen haben 76 % der Institutionen die Liste nicht veröffentlicht, und 78 % der Institutionen haben die Liste in der oberen Bewertung nicht veröffentlicht.

Darüber hinaus haben von den 49 Institutionen auf höherer und unterer Ebene, von denen bekannt ist, dass sie über Anwendungsfälle für künstliche Intelligenz verfügen, 47 % der Institutionen keine Liste von Anwendungsfällen für künstliche Intelligenz veröffentlicht (23 auf der oberen und unteren Ebene). -Institutionen). Von der engsten Gruppe von Institutionen, den 23 großen Institutionen mit bekannten KI-Anwendungsfällen auf Mutterunternehmensebene, haben nur 11 KI-Inventare veröffentlicht.

Die Listen selbst spiegeln die Herausforderungen bei der Umsetzung wider.

Erstens legen Agenturen keine KI-Anwendungsfälle offen, obwohl diese öffentlich dokumentiert wurden.

Zweitens weist die Inkonsistenz der Institutionen bei der Implementierung von Checklisten für KI-Anwendungsfälle auf drei wichtige Punkte hin, die noch nicht klar sind.

Bei den Agenturen, die keine Liste veröffentlicht haben, ist unklar, ob sie behaupten, keine künstliche Intelligenz einzusetzen oder diese Anforderung einfach nicht erfüllen.

Mit Ausnahme der NIST-Liste werden alle veröffentlichten Listen auf der Ebene der übergeordneten Behörde veröffentlicht (z. B. Handelsministerium oder Energieministerium), nicht auf der NOAA- oder Electric Power Administration-Liste. Es ist jedoch unklar, ob nicht in der Liste aufgeführte Unterbehörden keine relevanten Anwendungsfälle haben oder ob sie nicht auf die Berichtspflichten der vermeintlichen Mutterbehörde reagieren.

Definition von künstlicher Intelligenz, bereitgestellt im NDAA für das Geschäftsjahr 2019 und in die Regierungsrichtlinie zu künstlicher Intelligenz aufgenommen, Mai recht weit gefasst sein, was es für Behörden möglicherweise schwieriger macht, die Vorschriften einzuhalten, wenn sie bestimmte Technologien für Inventarisierungszwecke als „künstliche Intelligenz“ klassifizieren.

Drittens enthalten Agenturlisten häufig bestehende Transparenzinitiativen, variieren jedoch stark.

Insgesamt ist der Autor der Ansicht, dass die drei Säulen der US-amerikanischen Strategie für künstliche Intelligenz die Führungsordnung der künstlichen Intelligenz und die künstliche Regierung sind Intelligenz Das Gesetz der Reiwa-Regierung zur künstlichen Intelligenz ist in der Praxis nicht ideal.

Die aktuellen Anforderungen werden von vielen Organisationen als „unfinanzierte Aufgaben“ angesehen. Als Reaktion darauf sollte der Kongress den Agenturen die Personalressourcen zur Verfügung stellen und das technische Fachwissen entwickeln, um strategische KI-Pläne zu entwickeln.

Das Versäumnis, geeignete Ressourcen bereitzustellen und leitendes Personal nicht zur Wahrnehmung dieser Aufgaben zu befähigen, wird wahrscheinlich die Führungsrolle der USA im Bereich der künstlichen Intelligenz untergraben.

Über den Autor

Christie Lawrence ist außerordentliche Professorin an der Stanford Law School und JD/MPP-Kandidat der Harvard Kennedy School und Mitglied des Stanford Regulation, Evaluation, and Governance Laboratory (RegLab). Sie war Forschungs- und Analysedirektorin beim National Security Council on Artificial Intelligence (NSCAI) und hat am Stanford Institute for Human-Centered Artificial Intelligence, im Cyber Program des Belfer Centers der Harvard University, im Außenministerium und als Unternehmensberaterin gearbeitet . Sie hat einen Bachelor-Abschluss in öffentlicher Politik von der Duke University.

Isaac Cui ist ein J.D.-Student im ersten Jahr an der Stanford Law School, Mitglied des RegLab und ein Mitglied des Knight-Hennessy Scholar der Stanford University. Er erwarb einen Bachelor-Abschluss in Physik und Politikwissenschaften am Pomona College sowie einen Master-Abschluss in angewandter Sozialdatenwissenschaft und einen Master-Abschluss in Regulierung an der London School of Economics and Political Science, wo er Marshall Scholar war. Daniel E. Ho ist William Benjamin Scott und Luna M. Scott Professor für Recht und Politikwissenschaft an der Stanford University und Senior Fellow am Stanford Institute for Economic Policy Research. Er ist designiertes Mitglied des National Artificial Intelligence Advisory Council (NAIAC), stellvertretender Direktor des Institute for Human-Centered Artificial Intelligence (HAI) an der Stanford University, Fakultätsmitglied am Center for Advanced Study in the Behavioral Sciences und Direktor des Supervisionslabors. Er erhielt seinen J.D. von der Yale Law School und seinen Ph.D. von der Harvard University.

Das obige ist der detaillierte Inhalt vonStanford HAI veröffentlicht neuestes Weißbuch: Die Vereinigten Staaten machen seit zwei Jahren nur langsame Fortschritte bei ihrer nationalen KI-Strategie. Für weitere Informationen folgen Sie bitte anderen verwandten Artikeln auf der PHP chinesischen Website!