课程 2672

课程介绍:Golang深入理解GPM调度器模型及全场景分析,希望您看完这套视频有所收获;包括调度器的由来和分析、GMP模型简介、以及11个场景总结。

课程 5963

课程介绍:flex 属性用于设置或检索弹性盒模型对象的子元素如何分配空间,它是 flex-grow、flex-shrink 和 flex-basis 属性的简写属性。注意:如果元素不是弹性盒模型对象的子元素,则 flex 属性不起作用。

课程 2857

课程介绍:课程简介:1、跨域处理、token管理、路由拦截;2、真实接口调试、API层封装;3、Echarts及分页组件二次封装;4、Vue打包优化及常见疑难问题解答。

课程 1795

课程介绍:Apipost是集API设计、API调试、API文档、自动化测试为一体的API研发协同平台,支持grpc、http、websocket、socketio、socketjs类型接口调试,支持私有化部署。在正式学习ApiPost之前, 一定要了解一些相关的概念、开发模式、专业术语。 Apipost官网:https://www.apipost.cn

课程 5521

课程介绍:(咨询微信:phpcn01)综合实战课程旨在巩固前两阶段的学习成果,达到前端和PHP核心知识点的灵活运用,实训完成自己的项目,并指导上线。 综合实战重点实战课程包含:社交电商系统后台开发、商品管理、支付/订单管理、客户管理、分销/优惠券体系设计、微信/支付宝支付全流程、阿里云/宝塔运维、项目上线运营......

tp6 model模型关联多个数据表查询时,使用查询器会很慢,要怎么优化,有没有优化的方法呀!求助!!!!!

2023-11-17 08:50:36 0 0 84

如何根据角色为每个用户定义一组权限的Laravel Spatie权限设置方法?

2023-11-14 12:58:58 0 1 292

使用Laravel 8的blade asset来显示图片,但从资源子文件夹加载

2023-11-09 12:47:02 0 1 314

如何在Laravel功能测试中模拟一个使用GuzzleHttp客户端向第三方API发出请求的情况?

2023-11-09 11:42:58 0 1 207

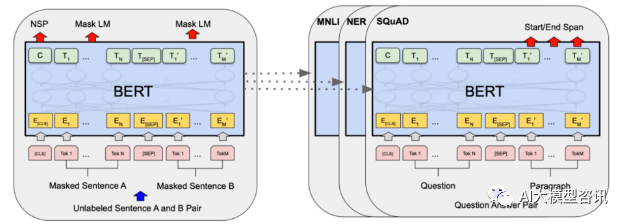

课程介绍:2018年谷歌发布了BERT,一经面世便一举击败11个NLP任务的State-of-the-art(Sota)结果,成为了NLP界新的里程碑;BERT的结构如下图所示,左边是BERT模型预训练过程,右边是对于具体任务的微调过程。其中,微调阶段是后续用于一些下游任务的时候进行微调,例如:文本分类,词性标注,问答系统等,BERT无需调整结构就可以在不同的任务上进行微调。通过”预训练语言模型+下游任务微调”的任务设计,带来了强大的模型效果。从此,“预训练语言模型+下游任务微调”便成为了NLP领域主流训

2023-10-07 评论 0 909

课程介绍:微调是指在特定任务上对预训练模型进行轻微调整,以提升性能。在情感分析中,可以利用预训练的自然语言处理模型(如BERT、RoBERTa、ALBERT)作为基础模型,并结合特定的情感分析数据集进行微调,从而实现更准确的情感分析结果。通过微调,模型可以根据具体任务的需求进行适应,提高模型在特定任务上的表现。微调模型的目的是为了将通用的自然语言处理模型进行细微调整,以提升其在情感分析任务中的识别能力和预测准确性。通过微调,我们可以将模型的学习能力转移至特定的领域,使其更好地适应特定任务要求。这样的微调过

2024-01-22 评论 0 745

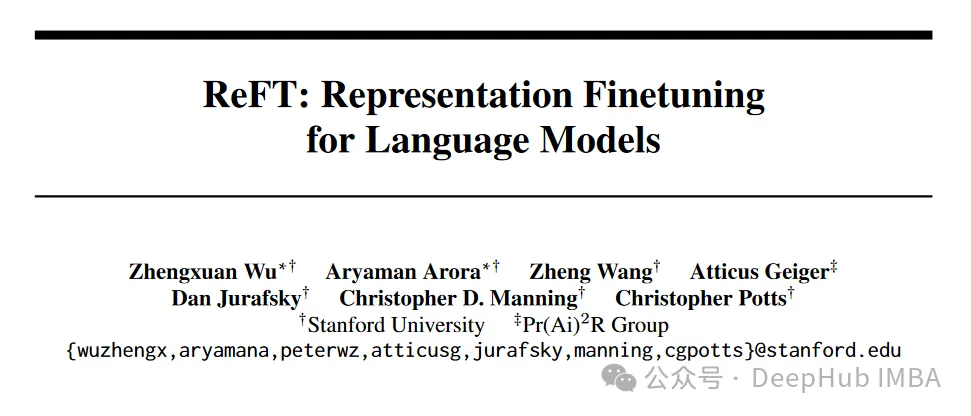

课程介绍:ReFT(RepresentationFinetuning)是一种突破性的方法,有望重新定义我们对大型语言模型进行微调的方式。斯坦福大学的研究人员最近(4月)在arxiv上发布的论文,ReFT与传统的基于权重的微调方法大有不同,它提供了一种更高效和有效的方法来适应这些大规模的模型,以适应新的任务和领域!在介绍这篇论文之前,我们先看看PeFT。参数高效微调PeFTParameterEfficientFine-Tuning(PEFT)是一种微调少量或额外的模型参数的高效微调方法。与传统的预测网络微调

2024-04-15 评论 812

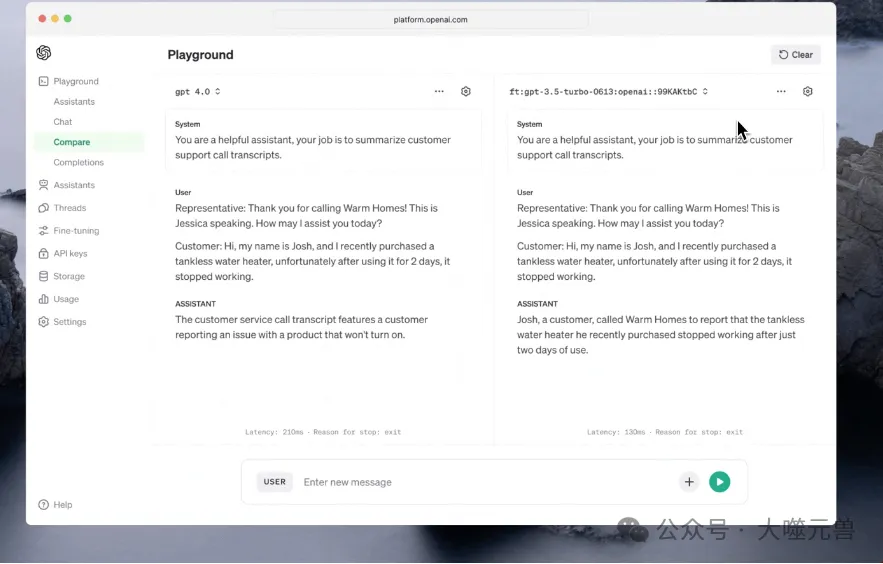

课程介绍:OpenAI宣布了对其微调API的重大增强,以及其定制模型程序的扩展。这些更新将赋予开发者前所未有的控制权,以微调AI模型,并为构建特定业务需求的定制模型提供新途径。自2023年8月推出以来,GPT-3.5的微调API已经成为组合精细化AI模型以执行特定任务的一个转折点。微调工具在AI模型的发展中起着至关重要的作用。它们允许开发者根据特定的数据集和应用场景来优化模型的性能。2022年4月,OpenAI发布了一系列对其微调API的改进,这些改进不仅提高了模型的灵活性和准确性,还为开发者提供了更多的

2024-04-07 评论 844

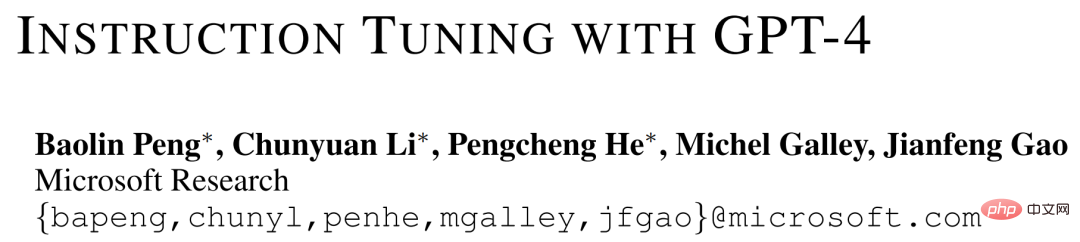

课程介绍:我们知道,从谷歌 T5 模型到 OpenAI GPT 系列大模型,大语言模型(LLMs)已经展现出了令人印象深刻的泛化能力,比如上下文学习和思维链推理。同时为了使得 LLMs 遵循自然语言指令和完成真实世界任务,研究人员一直在探索 LLMs 的指令微调方法。实现方式有两种:一是使用人类标注的 prompt 和反馈在广泛任务上微调模型,二是使用通过手动或自动生成指令增强的公共基准和数据集来监督微调。在这些方法中,Self-Instruct 微调是一种简单有效的方法,它从 SOTA 指令微调的教师

2023-04-10 评论 0 1200