强化学习中的奖励设计问题

强化学习中的奖励设计问题,需要具体代码示例

强化学习是一种机器学习的方法,其目标是通过与环境的交互来学习如何做出能够最大化累积奖励的行动。在强化学习中,奖励起着至关重要的作用,它是代理人(Agent)学习过程中的信号,用于指导其行为。然而,奖励设计是一个具有挑战性的问题,合理的奖励设计可以极大地影响到强化学习算法的性能。

在强化学习中,奖励可以被视为代理人与环境之间的沟通桥梁,它可以告诉代理人当前行动的好坏。一般来说,奖励可以分为稀疏奖励和稠密奖励两种类型。稀疏奖励指的是在任务中只有少数几个特定时间点给予奖励,而稠密奖励则是在每个时间点都有奖励信号。稠密奖励比稀疏奖励更容易让代理人学到正确的行动策略,因为它提供了更多的反馈信息。然而,稀疏奖励在现实任务中更为普遍,这就给奖励设计带来了挑战。

奖励设计的目标是为代理人提供尽可能准确的反馈信号,使其能够快速、有效地学习到最佳策略。大多数情况下,我们希望奖励函数能够在代理人达到预定目标时给予高奖励,在代理人做出错误决策时给予低奖励或惩罚。然而,设计合理的奖励函数并不是一件容易的事情。

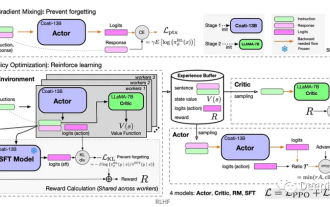

为了解决奖励设计问题,一种常见的方法是使用基于人类专家的演示来指导代理人的学习。在这种情况下,人类专家会为代理人提供一系列的样本行动序列以及它们的奖励,代理人通过学习这些样本来熟悉任务,并在之后的交互中逐渐改进自己的策略。这种方法可以有效地解决奖励设计问题,但也会增加了人力成本,并且专家的样本可能并非完全正确。

另一种方法是使用逆强化学习(Inverse Reinforcement Learning)来解决奖励设计问题。逆强化学习是一种从观察行为中推导出奖励函数的方法,它假设代理人在学习过程中试图最大化一种潜在的奖励函数,通过从观察到的行为中反推出这个潜在的奖励函数,可以为代理人提供更准确的奖励信号。逆强化学习的核心思想是将观察到的行为解释为一种最优策略,并通过反推出这个最优策略对应的奖励函数来指导代理人的学习。

以下是一个简单的逆强化学习的代码示例,演示了如何从观察到的行为中反推出奖励函数:

import numpy as np

def inverse_reinforcement_learning(expert_trajectories):

# 计算状态特征向量的均值

feature_mean = np.mean(expert_trajectories, axis=0)

# 构建状态特征矩阵

feature_matrix = np.zeros((len(expert_trajectories), len(feature_mean)))

for i in range(len(expert_trajectories)):

feature_matrix[i] = expert_trajectories[i] - feature_mean

# 使用最小二乘法求解奖励函数的权重向量

weights = np.linalg.lstsq(feature_matrix, np.ones((len(expert_trajectories),)))[0]

return weights

# 生成示例轨迹数据

expert_trajectories = np.array([[1, 1], [1, 2], [2, 1], [2, 2]])

# 使用逆强化学习得到奖励函数的权重向量

weights = inverse_reinforcement_learning(expert_trajectories)

print("奖励函数的权重向量:", weights)上述代码使用了最小二乘法来求解奖励函数的权重向量,权重向量可以用于计算任意状态特征向量的奖励。通过逆强化学习可以从样本数据中学习到一个合理的奖励函数,从而指导代理人的学习过程。

总结而言,奖励设计是强化学习中一个重要且具有挑战性的问题。合理的奖励设计可以极大地影响到强化学习算法的性能。通过利用基于人类专家的演示或逆强化学习等方法,可以解决奖励设计问题,并为代理人提供准确的奖励信号,从而指导其学习过程。

以上是强化学习中的奖励设计问题的详细内容。更多信息请关注PHP中文网其他相关文章!

热AI工具

Undresser.AI Undress

人工智能驱动的应用程序,用于创建逼真的裸体照片

AI Clothes Remover

用于从照片中去除衣服的在线人工智能工具。

Undress AI Tool

免费脱衣服图片

Clothoff.io

AI脱衣机

AI Hentai Generator

免费生成ai无尽的。

热门文章

热工具

记事本++7.3.1

好用且免费的代码编辑器

SublimeText3汉化版

中文版,非常好用

禅工作室 13.0.1

功能强大的PHP集成开发环境

Dreamweaver CS6

视觉化网页开发工具

SublimeText3 Mac版

神级代码编辑软件(SublimeText3)

强化学习中的奖励函数设计问题

Oct 09, 2023 am 11:58 AM

强化学习中的奖励函数设计问题

Oct 09, 2023 am 11:58 AM

强化学习中的奖励函数设计问题引言强化学习是一种通过智能体与环境的交互来学习最优策略的方法。在强化学习中,奖励函数的设计对于智能体的学习效果至关重要。本文将探讨强化学习中的奖励函数设计问题,并提供具体代码示例。奖励函数的作用及目标奖励函数是强化学习中的重要组成部分,用于评估智能体在某一状态下所获得的奖励值。它的设计有助于引导智能体通过选择最优行动来最大化长期累

使用Panda-Gym的机器臂模拟实现Deep Q-learning强化学习

Oct 31, 2023 pm 05:57 PM

使用Panda-Gym的机器臂模拟实现Deep Q-learning强化学习

Oct 31, 2023 pm 05:57 PM

强化学习(RL)是一种机器学习方法,它允许代理通过试错来学习如何在环境中表现。行为主体会因为采取行动导致预期结果而获得奖励或受到惩罚。随着时间的推移,代理会学会采取行动,以使得其预期回报最大化RL代理通常使用马尔可夫决策过程(MDP)进行训练,MDP是为顺序决策问题建模的数学框架。MDP由四个部分组成:状态:环境的可能状态的集合。动作:代理可以采取的一组动作。转换函数:在给定当前状态和动作的情况下,预测转换到新状态的概率的函数。奖励函数:为每次转换分配奖励给代理的函数。代理的目标是学习策略函数,

C++中的深度强化学习技术

Aug 21, 2023 pm 11:33 PM

C++中的深度强化学习技术

Aug 21, 2023 pm 11:33 PM

深度强化学习技术是人工智能领域备受关注的一个分支,目前在赢得多个国际竞赛的同时也被广泛应用于个人助手、自动驾驶、游戏智能等领域。而在实现深度强化学习的过程中,C++作为一种高效、优秀的编程语言,在硬件资源有限的情况下尤其重要。深度强化学习,顾名思义,结合了深度学习和强化学习两个领域的技术。简单理解,深度学习是指通过构建多层神经网络,从数据中学习特征并进行决策

解决C++代码中出现的'error: redefinition of class 'ClassName'”问题

Aug 25, 2023 pm 06:01 PM

解决C++代码中出现的'error: redefinition of class 'ClassName'”问题

Aug 25, 2023 pm 06:01 PM

解决C++代码中出现的“error:redefinitionofclass'ClassName'”问题在C++编程中,我们经常会遇到各种各样的编译错误。其中一个常见的错误是“error:redefinitionofclass'ClassName'”(类‘ClassName’的重定义错误)。这个错误通常出现在同一个类被定义了多次的情况下。本文将

解决jQuery无法获取表单元素值的方法

Feb 19, 2024 pm 02:01 PM

解决jQuery无法获取表单元素值的方法

Feb 19, 2024 pm 02:01 PM

解决jQuery.val()无法使用的问题,需要具体代码示例对于前端开发者,使用jQuery是常见的操作之一。其中,使用.val()方法来获取或设置表单元素的值是非常常见的操作。然而,在一些特定的情况下,可能会出现无法使用.val()方法的问题。本文将介绍一些常见的情况以及解决方案,并提供具体的代码示例。问题描述在使用jQuery开发前端页面时,有时候会碰

聚类算法中的聚类效果评估问题

Oct 10, 2023 pm 01:12 PM

聚类算法中的聚类效果评估问题

Oct 10, 2023 pm 01:12 PM

聚类算法中的聚类效果评估问题,需要具体代码示例聚类是一种无监督学习方法,通过对数据进行聚类,将相似的样本归为一类。在聚类算法中,如何评估聚类的效果是一个重要的问题。本文将介绍几种常用的聚类效果评估指标,并给出相应的代码示例。一、聚类效果评估指标轮廓系数(SilhouetteCoefficient)轮廓系数是通过计算样本的紧密度和与其他簇的分离度来评估聚类效

教你如何诊断常见问题的iPhone故障

Dec 03, 2023 am 08:15 AM

教你如何诊断常见问题的iPhone故障

Dec 03, 2023 am 08:15 AM

iPhone以其强大的性能和多方面的功能而闻名,它不能幸免于偶尔的打嗝或技术困难,这是复杂电子设备的共同特征。遇到iPhone问题可能会让人感到沮丧,但通常不需要警报。在这份综合指南中,我们旨在揭开与iPhone使用相关的一些最常遇到的挑战的神秘面纱。我们的分步方法旨在帮助您解决这些常见问题,提供实用的解决方案和故障排除技巧,让您的设备恢复到最佳工作状态。无论您是面对一个小故障还是更复杂的问题,本文都可以帮助您有效地解决这些问题。一般故障排除提示在深入研究具体的故障排除步骤之前,以下是一些有助于

解决PHP报错:继承父类时遇到的问题

Aug 17, 2023 pm 01:33 PM

解决PHP报错:继承父类时遇到的问题

Aug 17, 2023 pm 01:33 PM

解决PHP报错:继承父类时遇到的问题在PHP中,继承是一种重要的面向对象编程的特性。通过继承,我们能够重用已有的代码,并且能够在不修改原有代码的情况下,对其进行扩展和改进。尽管继承在开发中应用广泛,但有时候在继承父类时可能会遇到一些报错问题,本文将围绕解决继承父类时遇到的常见问题进行讨论,并提供相应的代码示例。问题一:未找到父类在继承父类的过程中,如果系统无