課程 2672

課程介紹:Golang深入理解GPM調度器模型及全場景分析,希望您看完這套影片有所收穫;包括調度器的由來和分析、GMP模型簡介、以及11個場景總結。

課程 5963

課程介紹:flex 屬性用於設定或檢索彈性盒模型物件的子元素如何分配空間,它是 flex-grow、flex-shrink 和 flex-basis 屬性的簡寫屬性。注意:如果元素不是彈性盒模型物件的子元素,則 flex 屬性不起作用。

課程 2857

課程介紹:課程簡介:1、跨域處理、token管理、路由攔截;2、真實介面調試、API層封裝;3、Echarts及分頁元件二次封裝;4、Vue打包優化及常見疑難問題解答。

課程 1795

課程介紹:Apipost是集API設計、API調試、API文件、自動化測試為一體的API研發協同平台,支援grpc、http、websocket、socketio、socketjs類型介面調試,支援私有化部署。在正式學習ApiPost之前, 一定要了解一些相關的概念、發展模式、專業術語。 Apipost官網:https://www.apipost.cn

課程 5521

課程介紹:(諮詢微信:phpcn01)綜合實戰課程旨在鞏固前兩階段的學習成果,達到前端和PHP核心知識點的靈活運用,實踐完成自己的項目,並指導上線。 綜合實戰重點實戰課程包含:社交電商系統後台開發、商品管理、支付/訂單管理、客戶管理、分銷/優惠券體系設計、微信/支付寶支付全流程、阿里雲/寶塔運維、專案上線運營. .....

tp6 model模型關聯多個資料表查詢時,使用查詢器會很慢,要怎麼優化,有沒有最佳化的方法呀!求助! ! ! ! !

2023-11-17 08:50:36 0 0 84

如何根據角色為每個使用者定義一組權限的Laravel Spatie權限設定方法?

2023-11-14 12:58:58 0 1 292

使用Laravel 8的blade asset來顯示圖片,但從資源子資料夾加載

2023-11-09 12:47:02 0 1 314

如何在Laravel功能測試中模擬一個使用GuzzleHttp客戶端向第三方API發出請求的情況?

2023-11-09 11:42:58 0 1 207

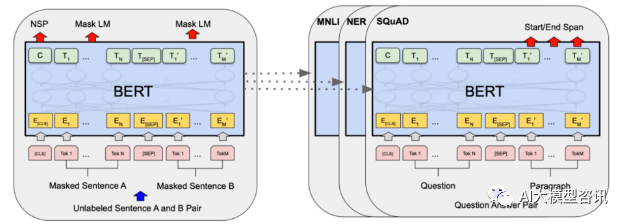

課程介紹:2018年Google發布了BERT,一經面世便一舉擊敗11個NLP任務的State-of-the-art(Sota)結果,成為了NLP界新的里程碑;BERT的結構如下圖所示,左邊是BERT模型預訓練過程,右邊是對於具體任務的微調過程。其中,微調階段是後續用於一些下游任務的時候進行微調,例如:文本分類,詞性標註,問答系統等,BERT無需調整結構就可以在不同的任務上進行微調。透過」預訓練語言模型+下游任務微調」的任務設計,帶來了強大的模型效果。從此,「預訓練語言模型+下游任務微調」便成為了NLP領域主流訓

2023-10-07 評論 0 909

課程介紹:微調是指在特定任務上對預訓練模型進行輕微調整,以提升表現。在情緒分析中,可以利用預先訓練的自然語言處理模型(如BERT、RoBERTa、ALBERT)作為基礎模型,並結合特定的情緒分析資料集進行微調,從而實現更準確的情緒分析結果。透過微調,模型可以根據具體任務的需求進行適應,提高模型在特定任務上的表現。微調模型的目的是為了對通用的自然語言處理模型進行細微調整,以提升其在情緒分析任務中的辨識能力和預測準確性。透過微調,我們可以將模型的學習能力轉移到特定的領域,使其更能適應特定任務要求。這樣的微調過

2024-01-22 評論 0 745

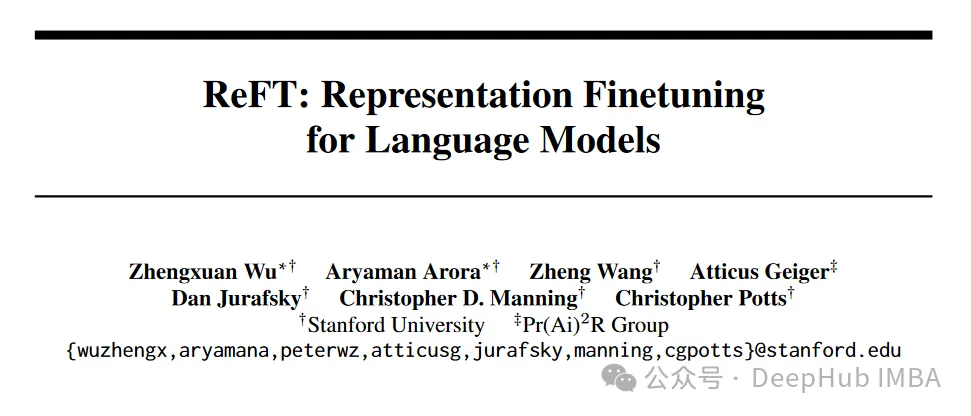

課程介紹:ReFT(RepresentationFinetuning)是一種突破性的方法,有望重新定義我們對大型語言模型進行微調的方式。史丹佛大學的研究人員最近(4月)在arxiv上發布的論文,ReFT與傳統的基於權重的微調方法大有不同,它提供了一種更有效率和有效的方法來適應這些大規模的模型,以適應新的任務和領域!在介紹這篇論文之前,我們先來看看PeFT。參數高效微調PeFTParameterEfficientFine-Tuning(PEFT)是一種微調少量或額外的模型參數的高效微調方法。與傳統的預測網絡微調

2024-04-15 評論 812

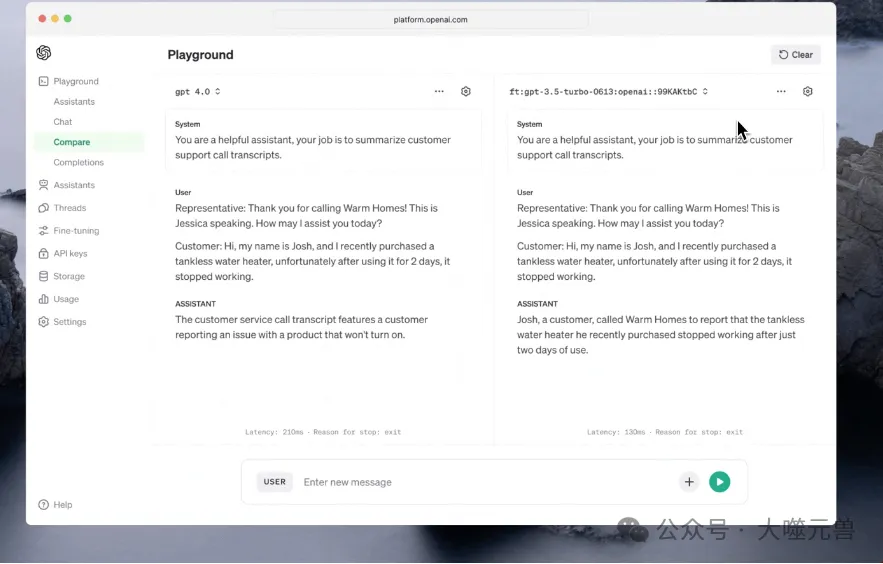

課程介紹:OpenAI宣布了對其微調API的重大增強,以及其客製化模型程式的擴展。這些更新將賦予開發者前所未有的控制權,以微調AI模型,並為建立特定業務需求的客製化模型提供新途徑。自2023年8月推出以來,GPT-3.5的微調API已成為組合精細化AI模型以執行特定任務的轉捩點。微調工具在AI模型的發展中扮演著至關重要的角色。它們允許開發者根據特定的資料集和應用場景來優化模型的效能。 2022年4月,OpenAI發布了一系列對其微調API的改進,這些改進不僅提高了模型的靈活性和準確性,也為開發者提供了更多的

2024-04-07 評論 844

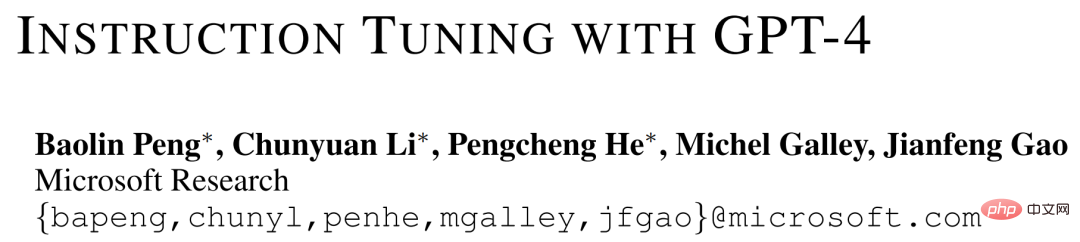

課程介紹:我們知道,從Google T5 模型到 OpenAI GPT 系列大模型,大語言模型(LLMs)已經展現了令人印象深刻的泛化能力,例如上下文學習和思維鏈推理。同時為了使得 LLMs 遵循自然語言指令和完成真實世界任務,研究人員一直在探索 LLMs 的指令微調方法。實作方式有兩種:一是使用人類標註的 prompt 和回饋在廣泛任務上微調模型,二是使用透過手動或自動產生指令增強的公共基準和資料集來監督微調。在這些方法中,Self-Instruct 微調是一種簡單有效的方法,它從 SOTA 指令微調的教師

2023-04-10 評論 0 1200