大語言模型潛力被激發-

無需訓練大語言模型就能實現高精度時序預測,超越一切傳統時序模型。

蒙納士大學、螞蟻和IBM研究院共同開發了一個通用框架,成功推動了大語言模型跨模態處理序列資料的能力。該框架已成為一項重要的技術創新。

時序預測有益於城市、能源、交通、遙感等典型複雜系統的決策。

自此,大模型可望徹底改變時序/時空資料探勘方式。

研究團隊提出了一個通用框架,將大語言模型輕鬆用於一般時間序列預測,而無需做任何訓練。

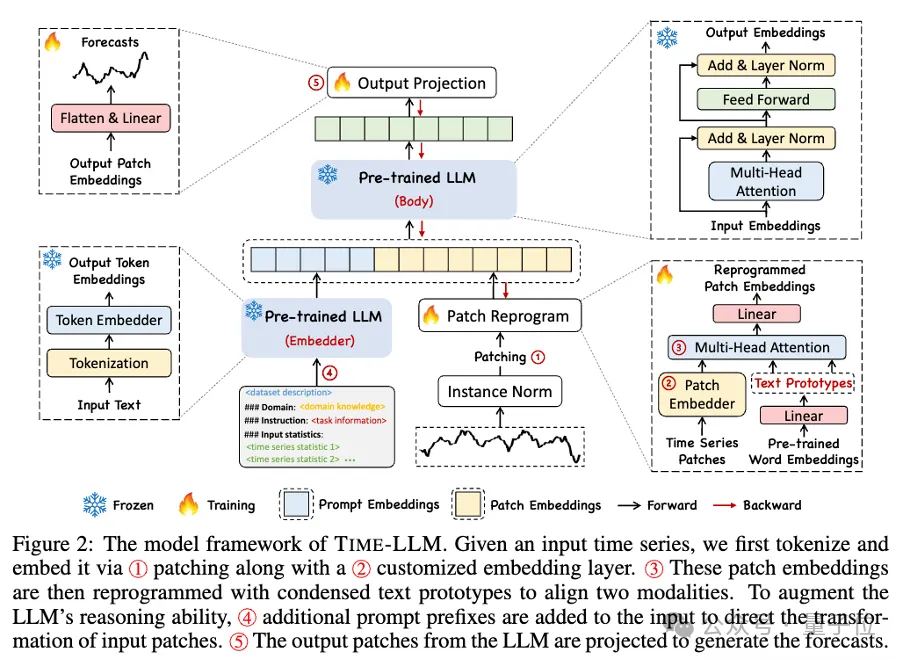

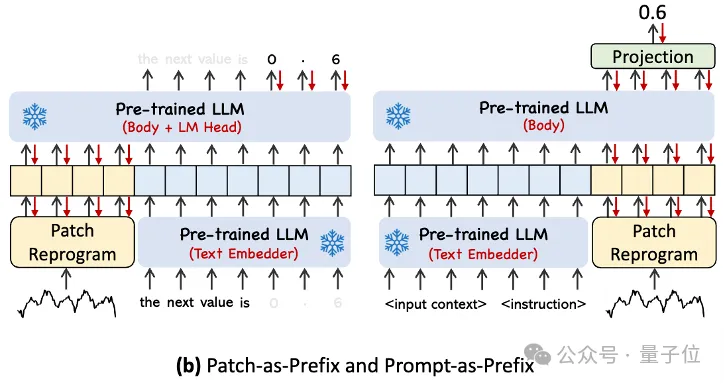

主要提出兩大關鍵技術:時序輸入重編程;提示做前綴。

Time-LLM首先使用文字原型(Text Prototypes)對輸入的時間資料進行重編程,透過使用自然語言表徵來表示時間資料的語義訊息,進而對齊兩種不同的資料模態,使大語言模型無需任何修改即可理解另一種資料模態背後的資訊。同時,透過大語言模型不需要任何特定的訓練資料集,即可理解不同的資料模態的背後訊息。這種方法不僅能夠提高模型的準確性,還能夠簡化資料預處理過程。

為了更好地處理輸入時序資料和對應任務的解析,作者提出了Prompt-as-Prefix(PaP)的範式。此範式透過在時序資料表徵前加入額外的上下文資訊和任務指令,充分啟動LLM在時序任務上的處理能力。這種方法可以在時序任務上實現更精細的解析,並且透過在時序資料表格前添加額外的上下文資訊和任務指令,充分啟動LLM在時序任務上的處理能力。

主要貢獻包括:

具體來看這個框架,首先,輸入時序資料先透過RevIN歸一化操作,然後被切分成不同patch並對應到隱空間。

時序資料和文字資料在表達方式上有顯著差異,兩種屬於不同的模態。

時間序列既不能直接編輯,也不能無損地用自然語言描述。因此,我們需要將時序輸入特徵對齊到自然語言文字域上。

而對齊不同模態的一個常見方式是cross-attention,但是LLM固有的詞彙表很大,因此無法有效直接將時序特徵對齊到所有單字上,而且也並不是所有字詞都和時間序列有對齊的語意關係。

為了解決這個問題,這項工作對詞彙表進行了線形組合來獲取文本原型,其中文本原型的數量遠小於原始詞彙量,組合起來可以用於表示時序數據的變化特徵。

而為了充分啟動LLM在指定時序任務上的能力,這項工作提出了提示做前綴的範式。

通俗點說,就是把時間序列資料集的一些先驗訊息,以自然語言的方式,作為前綴prompt,和對齊後的時序特徵拼接餵給LLM,是不是能夠提升預測效果?

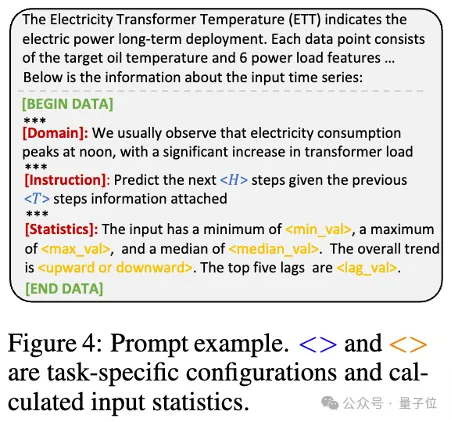

在實務中,作者確定了建立有效提示的三個關鍵元件:

資料集上下文;(2)任務指令,讓LLM適配不同的下游任務;(3)統計描述,例如趨勢、延遲等,讓LLM更能理解時序資料的特性。

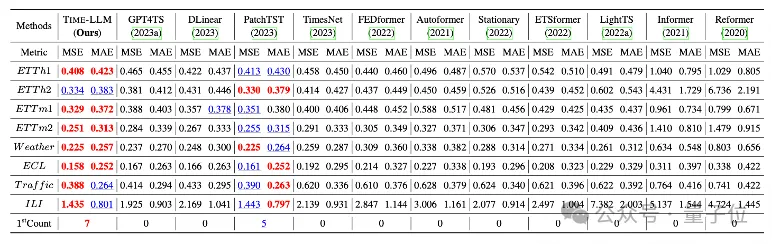

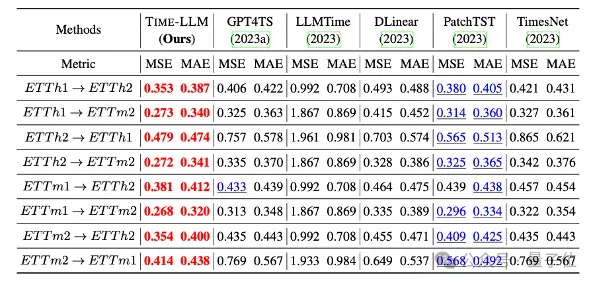

团队在长程预测上经典的8大公开数据集上进行了全面的测试。

结果Time-LLM在基准比较中显著超过此前领域最优效果,比如对比直接使用GPT-2的GPT4TS,Time-LLM有明显提升,表明了该方法的有效性。

此外,在zero-shot场景中也表现了很强的预测能力。

本项目获得蚂蚁集团智能引擎事业部旗下AI创新研发部门NextEvo支持。

感兴趣的小伙伴可戳下方链接了解论文详情~

论文链接https://arxiv.org/abs/2310.01728。

以上是大模型做時序預測也很強!華人團隊啟動LLM新能力,超越一眾傳統模式實現SOTA的詳細內容。更多資訊請關注PHP中文網其他相關文章!