如果你一直在關注大型語言模型的架構,你可能會在最新的模型和研究論文中看到「SwiGLU」這個詞。 SwiGLU可以說是在大語言模型中最常使用的激活函數,我們這篇文章就來對它進行詳細的介紹。 SwiGLU其實是2020年Google提出的激活函數,它結合了SWISH和GLU兩者的特徵。 SwiGLU的中文全名為“雙向門控線性單元”,它將SWISH和GLU兩種激活函數進行了優化和結合,以提高模型的非線性表達能力。 SWISH是一種非常普遍的激活函數,它在大語言模型中廣泛應用,而GLU則在自然語言處理任務中表現出色。 SwiGLU的優點在於它能夠同時獲得SWISH的平滑特性和GLU的門控特性,從而在模型的非線性表達上更加

##我們一個一個來介紹:

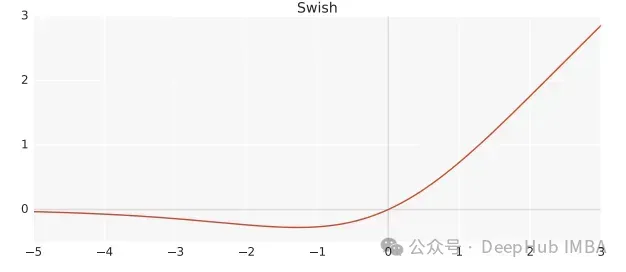

#Swish是非線性激活函數,定義如下:

Swish(x) = x*sigmoid(ßx)

其中,ß 為可學習參數。 Swish 可以比ReLU活化函數更好,因為它給予了更平滑的轉換,這可以帶來更好的最佳化。

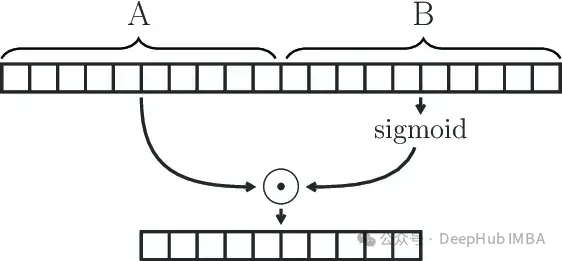

GLU(Gated Linear Unit)定義為兩個線性變換的分量積,其中一個線性變換由sigmoid激活。

GLU(x) = sigmoid(W1x+b)⊗(Vx+c)

GLU模組可以有效地捕捉序列中的遠端依賴關係,同時避免了LSTM和GRU等其他閘控機制相關的一些梯度消失問題。

我們已經說過SwiGLU是兩者的結合。它是一個GLU,但不是將sigmoid作為激活函數,而是使用ß=1的swish,因此我們最終得到以下公式:

SwiGLU(x) = Swish(W1x+b)⊗(Vx+c)

我們用SwiGLU函數建構一個前饋網路

FFNSwiGLU(x) = (Swish1(xW)⊗xV)W2

class SwiGLU(nn.Module): def __init__(self, w1, w2, w3) -> None:super().__init__()self.w1 = w1self.w2 = w2self.w3 = w3 def forward(self, x):x1 = F.linear(x, self.w1.weight)x2 = F.linear(x, self.w2.weight)hidden = F.silu(x1) * x2return F.linear(hidden, self.w3.weight)

我們程式碼使用的F.silu函數與ß=1時的swish相同的,所以就直接拿來使用了。

程式碼可以看到,我們的激活函數中也有3個權重是可以訓練的,這就是來自於GLU公式裡的參數。

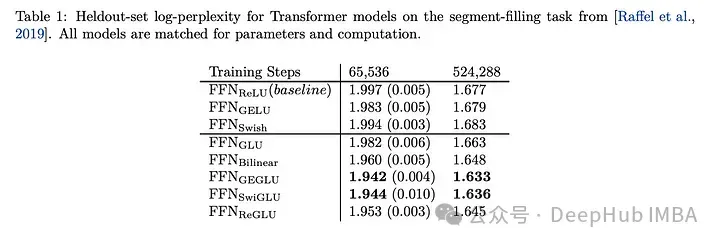

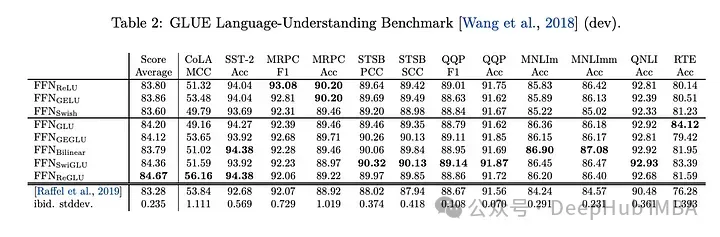

SwiGLU與其他GLU變異體比較,我們可以看到SwiGLU在兩種預訓練期間都表現得更好。

下游任務

#效果表現得最好,所以現在的llm,如LLAMA, OLMO和PALM都在其實作上採用SwiGLU。但是為什麼SwiGLU比其他的好呢?

論文中只給了測試結果而且並沒有說明原因,而是說:

We offer no explanation as to why these architectures seem to work; we attribute their success, as all else, to divine benevolence.

#作者說煉丹成功了。

但現在已經是2024年了我們可以強行的解釋一波:

1、Swish對於負值的回應相對較小克服了ReLU 某些神經元上輸出始終為零的缺點

2、GLU 的閘控特性,這意味著它可以根據輸入的情況決定哪些資訊應該通過、哪些訊息應該被過濾。這種機制可以使網路更有效地學習到有用的表示,有助於提高模型的泛化能力。在大語言模型中,這對於處理長序列、長距離依賴的文字特別有用。

3、SwiGLU 中的參數W1,W2,W3,b1,b2,b3W1,W2,W3,b1,b2,b3 可以透過訓練學習,使得模型可以根據不同任務和資料集動態調整這些參數,增強了模型的靈活性和適應性。

4、運算效率相比某些較複雜的激活函數(如 GELU)更高,同時仍能保持較好的效能。這對於大規模語言模型的訓練和推理是很重要的考量。

選擇 SwiGLU 作為大語言模型的活化函數,主要是因為它綜合了非線性能力、閘控特性、梯度穩定性和可學習參數等方面的優點。在處理語言模型中複雜的語意關係、長依賴問題、以及維持訓練穩定性和計算效率方面,SwiGLU 表現出色,因此被廣泛採用。

論文地址

以上是為什麼大型語言模型都在使用 SwiGLU 作為激活函數?的詳細內容。更多資訊請關注PHP中文網其他相關文章!