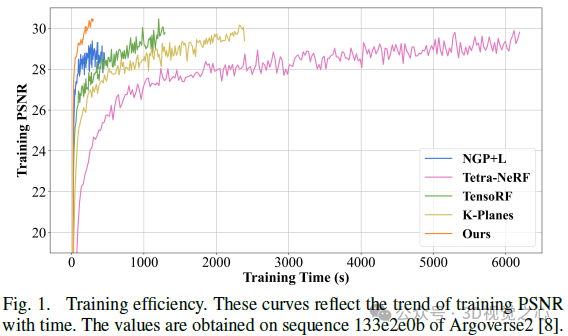

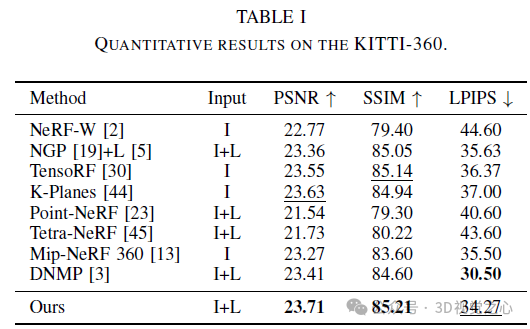

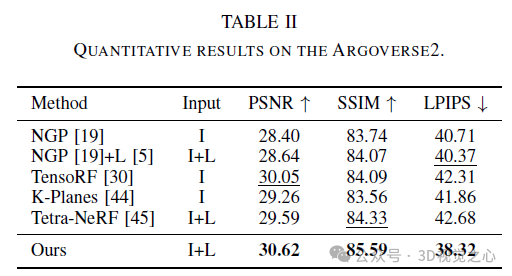

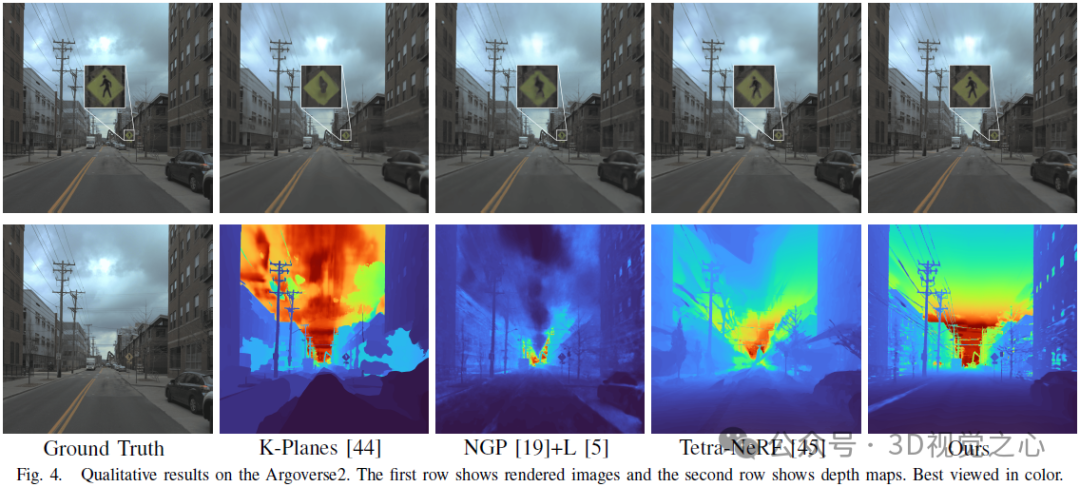

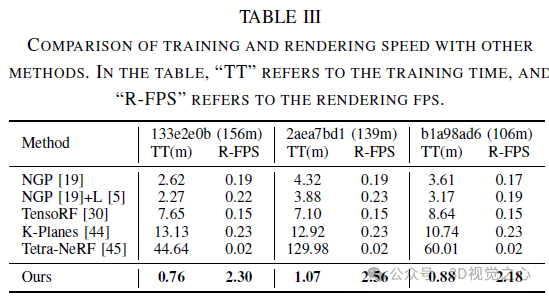

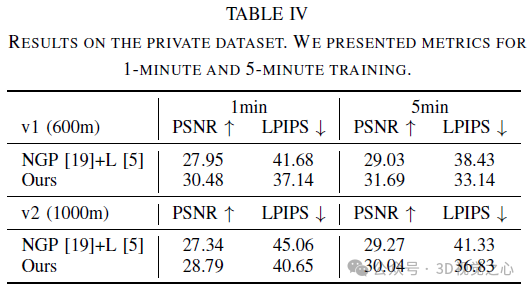

最近的研究强调了NeRF在自动驾驶环境中的应用前景。然而室外环境的复杂性,加上驾驶场景中的视点受限,使精确重建场景几何体的任务变得复杂。这些挑战往往会导致重建质量下降,训练和渲染的持续时间延长。为了应对这些挑战,我们推出了Lightning NeRF。它使用了一种高效的混合场景表示,在自动驾驶场景中有效地利用了激光雷达的几何先验。Lightning NeRF显著提高了NeRF的新颖视图合成性能,并减少了计算开销。通过对真实世界数据集(如KITTI-360、Argoverse2和我们的私人数据集)的评估,我们证明了我们的方法不仅在新视图合成质量方面超过了当前最先进的技术,而且在训练速度上提高了五倍,在渲染速度上也提高了十倍。

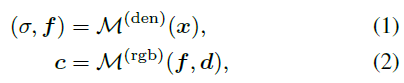

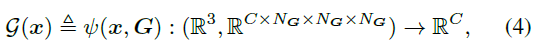

NeRF是一种表示具有隐式函数的场景的方法,这种隐式函数通常由MLP进行参数化。它能够根据观察方向d返回场景中3D点x的颜色值c和体积密度预测σ。

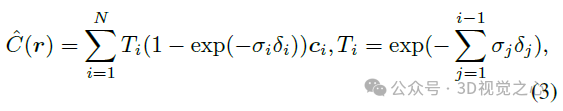

为了呈现像素,NeRF使用分层体积采样沿着射线r生成一系列点,然后通过累积组合这些位置的预测密度和颜色特征。

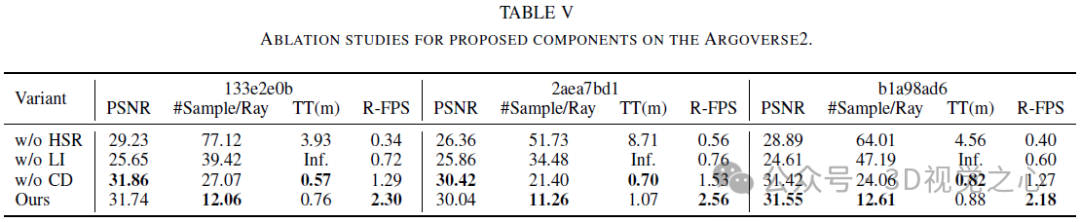

尽管NeRF在新视角合成方面表现出色,但它的长训练时间和慢渲染速度主要是由于采样策略效率低造成的。为了改善模型的效率,我们在训练过程中保持粗略的网格占用,并仅对占用体积内的位置进行采样。这种采样策略与现有工作类似,有助于提高模型的性能并加快训练速度。

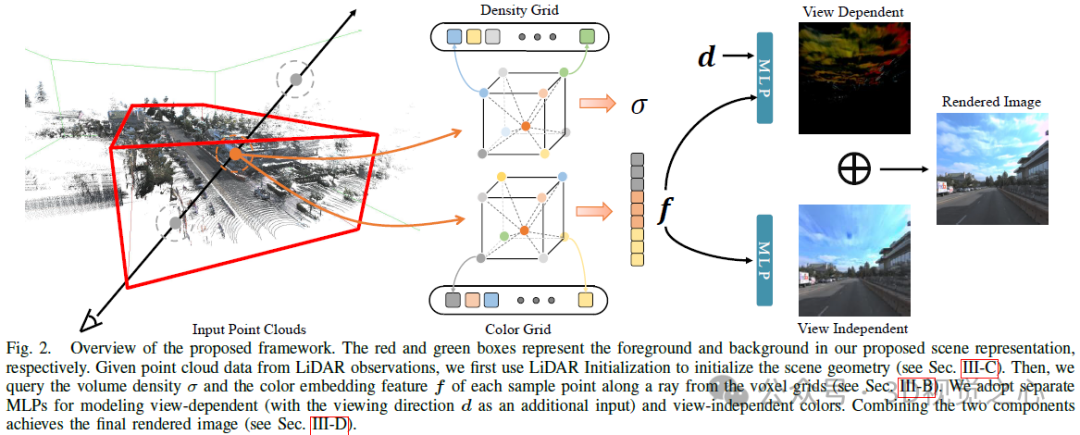

混合体积表示已经使用紧凑的模型实现了快速优化和渲染。鉴于此,我们采用混合体素网格表示来对辐射场进行建模以提高效率。简言之,我们通过在网格顶点存储σ来显式地对体积密度进行建模,同时使用浅MLP以隐式方式将颜色嵌入f解码为最终颜色c。为了处理户外环境的无边界性质,我们将场景表示分为前景和背景两部分,如图2所示。具体来说,我们从轨迹序列中检查每一帧中的相机截头体,并定义前景边界框,使其紧密包裹对齐坐标系中的所有截头体。背景框是通过沿每个维度按比例放大前景框而获得的。

體素網格表示。體素網格表示在其網格頂點中明確儲存場景屬性(例如,密度、RGB顏色或特徵),以支援高效的特徵查詢。這樣,對於給定的3D位置,我們可以透過三線性插值來解碼對應的屬性:

前景。我們建立了兩個獨立的特徵網格,用於對前景區域的密度和顏色嵌入進行建模。具體來說,密度網格映射將位置映射到密度標量σ中,用於體積渲染。對於顏色嵌入網格映射,我們透過哈希表以不同解析度備份實例化多個體素網格,以獲得更精細的細節,並具有可承受的記憶體開銷。最終的顏色嵌入f是透過在L個解析度層級上串聯輸出而獲得的。

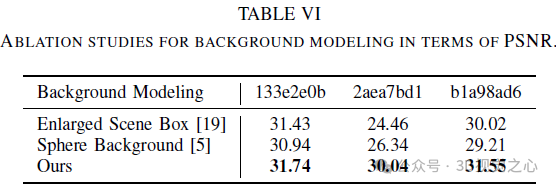

背景儘管前面提到的前景建模適用於物件層級的輻射場,但將其擴展到無界的室外場景並非易事。一些相關技術,如NGP,直接擴展其場景邊界框,以便可以包括背景區域,而GANcraft和URF引入了球形背景輻射來處理這個問題。然而,前一種嘗試導致其功能的浪費,因為其場景框內的大多數區域都用於背景場景。對於後一種方案,它可能無法處理城市場景中複雜的全景(例如,起伏的建築或複雜的景觀),因為它只是假設背景輻射僅取決於視線方向。

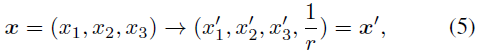

為此,我們設定了一個額外的背景網格模型,以保持前景部分的解析度不變。我們採用[9]中的場景參數化作為背景,並經過精心設計。首先與反球面建模不同,我們使用反三次建模,用ℓ∞ 範數,因為我們使用體素網格表示。其次我們不實例化額外的MLP來查詢背景顏色以節省記憶體。具體來說,我們透過以下方式將3D背景點扭曲為4D:

使用我們的混合場景表示,當我們直接從有效的體素網格表示而不是計算密集型MLP查詢密度值時,模型可以節省計算和記憶體。然而,考慮到城市場景的大規模性質和複雜性,由於密度網格的分辨率有限,這種輕量級表示很容易在最佳化中陷入局部極小值。幸運的是,在自動駕駛中,大多數自動駕駛汽車(SDV)都配備了LiDAR感測器,為場景重建提供了粗略的幾何先驗。為此,我們建議使用雷射測距儀點雲來初始化我們的密度網格,以減輕場景幾何和輻射聯合優化的障礙。

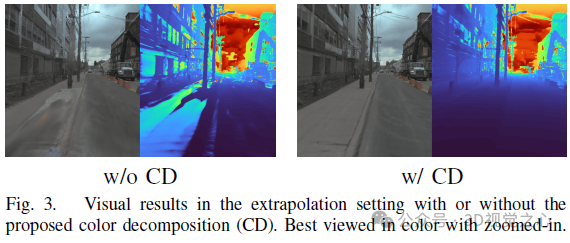

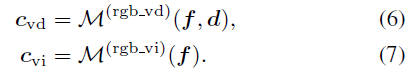

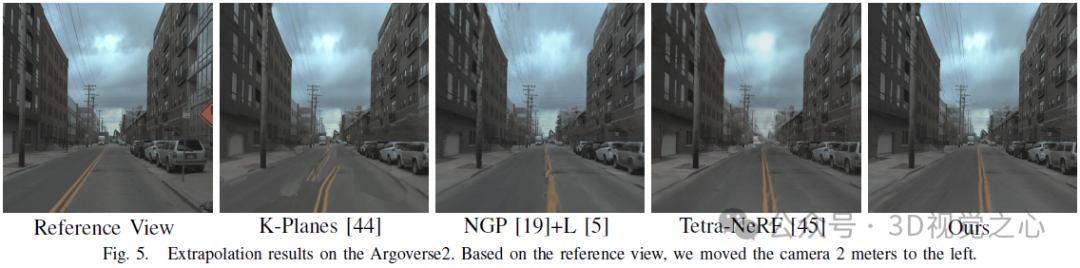

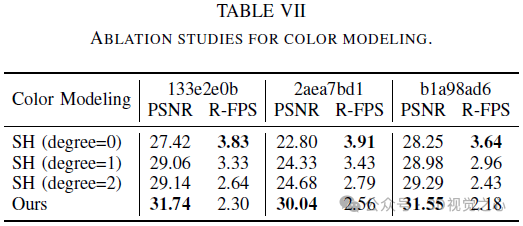

最初的NeRF使用與視圖相關的MLP來對輻射場中的顏色進行建模,這是對物理世界的簡化,其中輻射由漫射(與視圖無關)顏色和鏡面(與視圖相關)顏色組成。此外,由於最終輸出顏色c與觀看方向d完全糾纏,因此難以在看不見的視圖中渲染高保真圖像。如圖3所示,我們在沒有顏色分解(CD)的情況下訓練的方法在外推設置中的新視圖合成中失敗(即,基於訓練視圖將觀看方向向左移動2米),而我們在顏色分解的情況下給出了合理的渲染結果。

取樣位置的最終顏色是這兩個因素的總和:

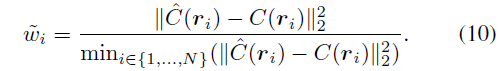

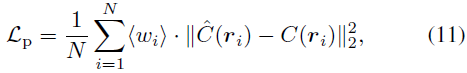

我們使用重新縮放的權重wi來修改光度損失,以優化我們的模型,使其專注於硬樣本以實現快速收斂。權重係數定義為:

本文介绍了Lightning NeRF,这是一种高效的户外场景视图合成框架,它集成了点云和图像。所提出的方法利用点云快速初始化场景的稀疏表示,实现了显著的性能和速度增强。通过更有效地对背景进行建模,我们减少了前景上的代表性应变。最后,通过颜色分解,分别对视图相关和视图无关的颜色进行建模,增强了模型的外推能力。在各种自动驾驶数据集上进行的大量实验表明,我们的方法在性能和效率方面都优于以前的先进技术。

以上是為自動駕駛而生,Lightning NeRF:速度提升10倍的詳細內容。更多資訊請關注PHP中文網其他相關文章!