近期,具身智慧方向取得了許多進展。從Google的 RT-H 到 OpenAI、Figure 聯合打造的 Figure 01,機器人的互動性、通用性越來越強。

如果未來機器人成為人們日常生活的助手,你期待它們能完成哪些任務?泡一杯熱氣騰騰的手沖咖啡,整理桌面,甚至幫你精心安排一場浪漫的約會,這些任務,只需一句指令,清華的具身智能新框架“CoPa”都能完成。

CoPa(Robotic Manipulation through Spatial Constraints of Parts)是清華大學機器人研究團隊在高陽教授的領導下提出的最新智慧框架。這個框架首次實現了機器人在多種場景下,面對長距離任務和複雜的3D行為時的泛化能力。

論文網址:https://arxiv.org/abs/2403.08248

計畫首頁: https://copa-2024.github.io/

由於對視覺語言大模型(VLMs)的獨特應用,CoPa 在沒有經過任何特定訓練的情況下可以在開放的場景中泛化,並且可以處理複雜的指令。 CoPa 最引人注目的地方在於展現出對場景中物體物理屬性的深入理解,以及其精確的規劃和操作能力。

在該任務中,CoPa 不僅可以理解複雜桌面陳設中每個物體的作用,還可以透過精確的控制,完成對它們的物理操作。例如「把水從水壺倒到漏斗中」這項任務,機器人將水壺移動到漏斗的上方,精確地將其旋轉至適當的角度,使得水可以從壺口流到漏斗中。

CoPa 還能精心安排一場浪漫的約會。在了解研究人員的約會需求後,CoPa 幫助其佈置了精美的西餐桌。

在深入理解使用者需求的同時,CoPa 也展現了精確的操作物體本領。例如「把花插入花瓶」這個任務,機器人首先抓住了花的莖,將其旋轉至正對著花瓶,最後將其插入。

方法介紹

#演算法流程

#大多數操作任務可以分解為兩個階段:物體的抓取,以及完成任務所需的後續動作。例如,在開抽屜時,我們需要先抓住抽屜的把手,再沿著直線拉出抽屜。基於此,研究人員設計了兩個階段,即首先透過「任務導向的抓取模組(Task-Oriented Grasping)」產生機器人抓取物體的位姿,再透過「任務相關的運動規劃模組(Task-Aware Motion Planning)」產生抓取後完成任務所需的位姿。機器人在相鄰位姿之間的轉移可以透過傳統的路徑規劃演算法來實現。

重要部分偵測模組

研究人員觀察到大多數操作任務都需要對場景中的物件具有細緻的“部分級(part-level)理解」。例如在用小刀切東西時,我們會握著刀柄而非刀刃;在戴眼鏡時,我們會拿著鏡框而非鏡片。基於這個觀察,研究團隊設計了「由粗到細的部分檢測(coarse-to-fine part grounding)模組」來定位場景中和任務相關的部分。具體來說,CoPa 先透過粗粒度物體偵測來定位場景中和任務相關的物體,隨後透過細粒度部分偵測來定位這些物體上和任務相關的部分。

在「任務導向的抓取模組」中,CoPa 首先透過此重要部分偵測模組定位抓取的位置(例如工具的柄),該位置資訊被用來過濾GraspNet(可以產生場景中所有可能的抓取位姿的模型)所產生的抓取位姿,進而得到最終的抓取位姿。

任務相關的運動規劃模組

為了讓視覺語言大模型來幫助機器人進行操作任務,該研究需要設計一個接口,該接口既可以讓大模型以語言的方式推理,又有利於機器人操作。研究團隊發現,在執行任務的過程中,與任務相關的物體通常會受到許多空間幾何的限制。例如,在為手機充電時,充電頭必須正對著充電口;在蓋瓶蓋時,蓋子必須被正放在瓶口位置。基於此,研究團隊提出使用空間限製作為視覺語言大模型和機器人之間的橋樑。具體來說,CoPa 首先透過視覺語言大模型產生任務相關的物體在完成任務時需要滿足的空間限制,再透過一個求解模組基於這些限制解出機器人的位姿。

實驗結果

#CoPa 能力評估

CoPa 在現實世界中操作任務中展現了極強的泛化能力。得益於對視覺語言大模型中蘊含的常識知識的利用,CoPa 對場景中物體的物理屬性有深入的理解。

例如,在「錘釘子」任務中,CoPa 首先抓住了錘柄,再將錘子旋轉至鎚頭正對著釘子,最後向下錘。此任務要求精確辨識出錘柄、錘面以及釘面,並充分理解它們的空間關係,證明 CoPa 對場景中物體的物理屬性具有深入的理解。

在「把橡皮放进抽屉」任务中,CoPa 首先定位到了橡皮的位置,然后发现橡皮的一部分被纸包裹着,于是聪明地抓取了该部分,确保橡皮不会被弄脏。

在「把勺子插入杯子」任务中,CoPa 首先抓住了勺柄,将其平移旋转至竖直朝下,并正对着杯子,最后将其插入杯中,证明 CoPa 可以很好的理解完成任务时物体需要满足的空间几何限制。

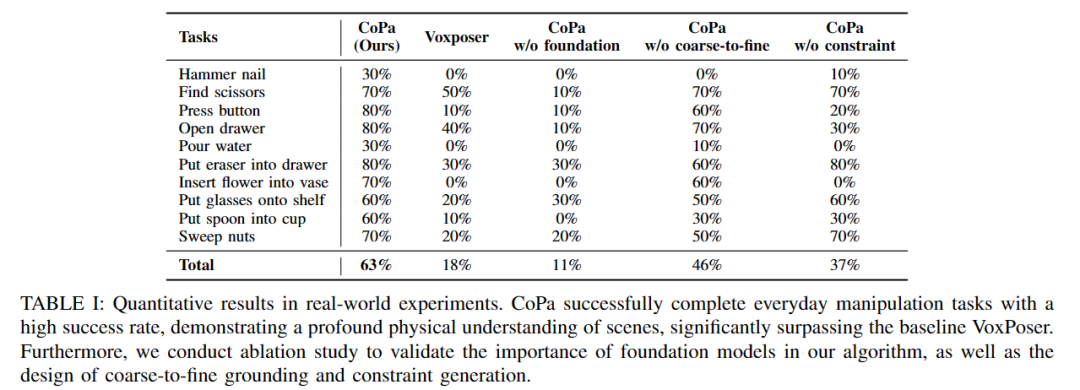

研究团队在 10 个现实世界任务上进行了充分的定量实验。如表一所示,CoPa 在处理这些复杂任务的表现上显著超过了基线方法以及许多消融变种方法。

消融实验

研究人员通过一系列消融实验证明了 CoPa 框架中如下三个组成部分的重要性:基础模型、由粗到细的部分检测、空间限制生成。实验结果如上方表一中所示。

基础模型

表中 CoPa w/o foundation 消融实验去除了 CoPa 中对基础模型的使用,转而通过检测模型来定位物体,以及基于规则的方法生成空间限制。实验结果表明该消融变种的成功率很低,证明了基础模型中蕴含的丰富常识知识在 CoPa 中的重要作用。比如在「扫螺母」任务中,该消融变种不知道场景中哪个工具适合用来扫。

由粗到细的部分检测

表中 CoPa w/o coarse-to-fine 消融实验去除了 CoPa 由粗到细的部分检测设计,转而直接使用细粒度分割来定位物体。该变种在定位物体重要部分相对困难的任务中表现显著降低。比如在「锤钉子」任务中,缺少「由粗到细」这一设计导致很难识别出锤面。

空间限制生成

表中 CoPa w/o constraint 消融实验去除了 CoPa 的空间限制生成模块,转而让视觉语言大模型直接输出机器人的目标位姿的具体数值。实验表明根据场景图片直接输出机器人目标位姿是十分困难的。比如在「倒水」任务中,水壶需要被倾斜一定的角度,该变种完全无法生成此时机器人的位姿。

了解更多内容,请参考原论文。

以上是一句指令就能沖咖啡、倒紅酒、鎚釘子,清華具身智能CoPa「動」手了的詳細內容。更多資訊請關注PHP中文網其他相關文章!